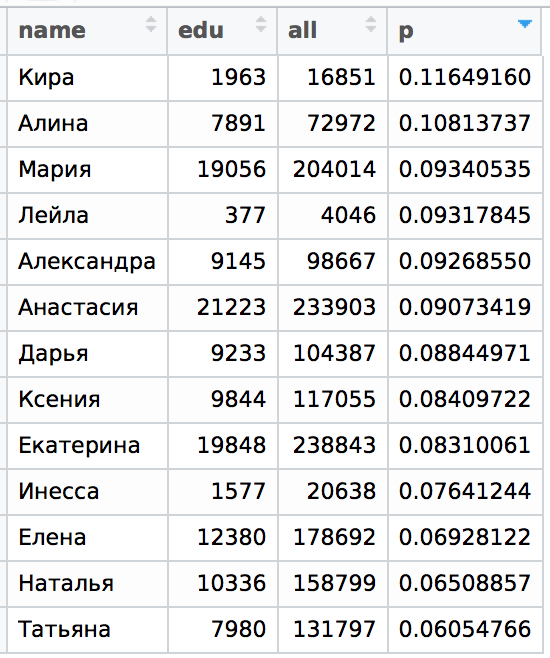

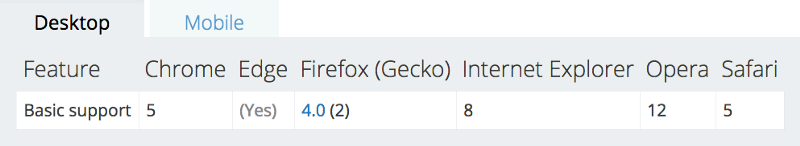

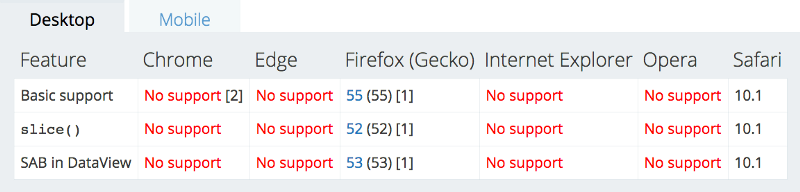

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

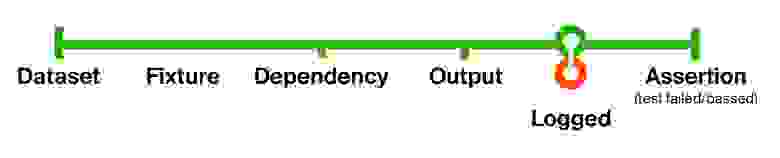

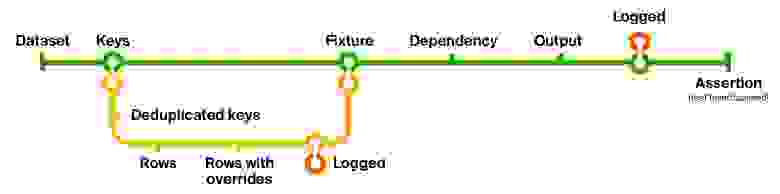

values | source stringclasses 4

values |

|---|---|---|---|---|

# Потоки Redis как чистая структура данных

Новая структура данных Redis 5 под названием «потоки» (streams) вызвала живой интерес в сообществе. Как-нибудь я поговорю с теми, кто использует потоки в продакшне, и напишу об этом. Но сейчас хочу рассмотреть немного другую тему. Мне начинает казаться, что многие представляют потоки неким сюрреалистичным инструментом для решения ужасно трудных задач. Действительно, эта структура данных \*также\* осуществляет обмен сообщениями, но будет невероятным упрощением считать, что функциональность Redis Streams ограничена только этим.

Потоки — потрясающий шаблон и «ментальная модель», которую можно с большим успехом применить в проектировании систем, но на самом деле потоки, как и большинство структур данных Redis, являются более общей структурой и могут использоваться для кучи других задач. В этой статье мы представим потоки как чистую структуру данных, полностью игнорируя блокирующие операции, группы получателей и всю остальную функциональность обмена сообщениями.

Потоки — это CSV на стероидах

=============================

Если хотите записать ряд структурированных элементов данных и думаете, что БД будет здесь излишеством, можете просто открыть файл в режиме `append only` и записать каждую строку как CSV (Comma Separated Value):

```

(open data.csv in append only)

time=1553096724033,cpu_temp=23.4,load=2.3

time=1553096725029,cpu_temp=23.2,load=2.1

```

Выглядит просто. Люди делали это давным-давно и до сих пор делают: это надёжный шаблон, если знать, что к чему. Но какой будет эквивалент в памяти? В памяти становится возможной гораздо более продвинутая обработка данных, и автоматически снимаются многие ограничения файлов CSV, такие как:

1. Трудно (неэффективно) выполнять запросы диапазона.

2. Слишком много избыточной информации: в каждой записи почти одинаковое время, а поля дублируются. В то же время удаление данных сделает формат менее гибким, если я хочу переключиться на другой набор полей.

3. Смещения элементов — это просто смещение байтов в файле: если мы изменим структуру файла, смещение станет неправильным, поэтому здесь нет реальной концепции первичного идентификатора. Записи по сути невозможно представить как-то однозначно.

4. Не имея возможности сбора мусора и не переписывая лог нельзя удалить записи, а только пометить их как невалидные. Переписывание логов обычно отстой по нескольким причинам, желательно его избегать.

В то же время такой лог CSV по-своему хорош: нет фиксированной структуры, поля могут меняться, его тривиально генерировать и он довольно компактен. Идея с потоками Redis заключалась в том, чтобы сохранить достоинства, но преодолеть ограничения. В результате получается гибридная структура данных, очень похожая на сортированные наборы Redis: они \*выглядят как\* фундаментальная структура данных, но для получения такого эффекта используют несколько внутренних представлений.

Введение в потоки (можете пропустить, если уже знакомы с основами)

==================================================================

Потоки Redis представлены в виде дельта-сжатых макроузлов, связанных базисным деревом. В результате можно очень быстро искать случайные записи, получать диапазоны, удалять старые элементы и т. д. В то же время интерфейс для программиста очень похож на CSV-файл:

```

> XADD mystream * cpu-temp 23.4 load 2.3

"1553097561402-0"

> XADD mystream * cpu-temp 23.2 load 2.1

"1553097568315-0"

```

Как видно из примера, команда XADD автоматически генерирует и возвращает идентификатор записи, который монотонно увеличивается и состоит из двух частей: -. Время в миллисекундах, а счётчик увеличивается для записей с одинаковым временем.

Итак, первая новая абстракция для идеи CSV-файла в режиме `append only` заключается в использовании звёздочки в качестве аргумента ID для XADD: так мы бесплатно получаем с сервера идентификатор записи. Этот идентификатор полезен не только для указания на определённый элемент в потоке, он также связан со временем добавления записи в поток. Фактически, с помощью XRANGE можно выполнять запросы диапазона или извлекать отдельные элементы:

```

> XRANGE mystream 1553097561402-0 1553097561402-0

1) 1) "1553097561402-0"

2) 1) "cpu-temp"

2) "23.4"

3) "load"

4) "2.3"

```

В этом случае я использовал одинаковый ID для начала и конца диапазона, чтобы идентифицировать один элемент. Однако я могу использовать любой диапазон и аргумент COUNT для ограничения количества результатов. Точно так же нет необходимости указывать для диапазона полные идентификаторы, я могу просто использовать только unix-время, чтобы получить элементы в заданном диапазоне времени:

```

> XRANGE mystream 1553097560000 1553097570000

1) 1) "1553097561402-0"

2) 1) "cpu-temp"

2) "23.4"

3) "load"

4) "2.3"

2) 1) "1553097568315-0"

2) 1) "cpu-temp"

2) "23.2"

3) "load"

4) "2.1"

```

На данный момент нет необходимости показывать вам другие возможности API, для этого есть документация. Пока давайте просто сосредоточимся на этом шаблоне использования: XADD для добавления, XRANGE (а также XREAD) для извлечения диапазонов (в зависимости от того, что вы хотите сделать), и давайте посмотрим, почему потоки настолько мощны, чтобы называть их структурой данных.

Если хотите узнать больше о потоках и API, обязательно почитайте [учебник](https://redis.io/topics/streams-intro).

Теннисисты

==========

Несколько дней назад мы с другом, который начал изучать Redis, моделировали приложение для отслеживания местных теннисных кортов, игроков и матчей. Способ моделирования игроков совершенно очевиден, игрок — это небольшой объект, поэтому нам нужен только хеш с ключами типа `player:`. Дальше вы сразу поймёте, что нужен способ отслеживать игры в конкретных теннисных клубах. Если `player:1` и `player:2` сыграли между собой и `player:1` выиграл, мы можем отправить в поток следующую запись:

```

> XADD club:1234.matches * player-a 1 player-b 2 winner 1

"1553254144387-0"

```

Такая простая операция даёт нам:

1. Уникальный идентификатор матча: ID в потоке.

2. Нет необходимости создавать объект для идентификации матча.

3. Бесплатные запросы диапазона для постраничного просмотра матчей или просмотра матчей на определённую дату и время.

До появления потоков нам бы пришлось создавать сортированный набор по времени: элементами сортированного набора будут идентификаторы матчей, которые сохраняются в другом ключе в качестве хеш-значения. Это не только больше работы, но и больше памяти. Гораздо, гораздо больше памяти (см. ниже).

Сейчас наша цель показать, что потоки Redis являются своего рода сортированным набором в режиме `append only`, с ключами по времени, где каждый элемент является небольшим хешем. И в своей простоте это настоящая революция в контексте моделирования.

Память

======

Приведённый выше пример использования — это не просто более цельный шаблон программирования. Расход памяти в потоках настолько отличается от старого подхода с сортированным набором + хеш для каждого объекта, что теперь начинают работать некоторые вещи, которые раньше вообще было невозможно реализовать.

Вот статистика по объёму памяти для хранения миллиона матчей в конфигурации, представленной ранее:

```

Сортированный набор + хеш = 220 МБ (242 RSS)

Потоки = 16,8 МБ (18.11 RSS)

```

Разница больше, чем на порядок (а именно, в 13 раз). Это означает возможность работать с задачами, которые раньше были слишком дорогостоящими для выполнения в памяти. Теперь они вполне жизнеспособны. Магия заключается в представлении потоков Redis: макроузлы могут содержать несколько элементов, которые очень компактно закодированы в структуре данных под названием listpack. Эта структура позаботится, например, о кодировании целых чисел в двоичной форме, даже если они являются семантически строками. Кроме того, мы применяем дельта-компрессию и сжимаем одинаковые поля. Тем не менее, сохраняется возможность искать по ID или времени, потому что такие макроузлы связаны в базисном дереве, которое также разработано с оптимизацией по памяти. Всё вместе это объясняет экономное использование памяти, но интересная часть заключается в том, что семантически пользователь не видит никаких деталей реализации, делающих потоки настолько эффективными.

Теперь давайте посчитаем. Если я могу хранить 1 миллион записей примерно в 18 МБ памяти, то я могу хранить 10 миллионов в 180 МБ и 100 миллионов в 1,8 ГБ. Всего с 18 ГБ памяти у меня может быть 1 миллиард элементов.

Временные ряды

==============

Важно отметить, что пример выше с теннисными матчами семантически \*очень отличается\* от использования потоков Redis для временных рядов. Да, логически мы всё ещё регистрируем какое-то событие, но есть фундаментальное различие. В первом случае мы ведём лог и создаём записи для рендеринга объектов. А во временных рядах просто измеряем нечто происходящее снаружи, что на самом деле не представляет объект. Вы можете сказать, что это различие тривиально, но это не так. Важно понять идею, что потоки Redis можно использовать для создания небольших объектов с общим порядком и присвоения идентификаторов таким объектам.

Но даже самый простой вариант использования временных рядов, очевидно, это огромный прорыв, потому что до появления потоков Redis был практически бессилен тут что-либо сделать. Характеристики памяти и гибкость потоков, а также возможность ограничения capped-потоков (см. параметры XADD) — очень важные инструменты в руках разработчика.

Выводы

======

Потоки являются гибкими и предлагают множество вариантов использования, но я хотел написать очень краткую статью, чтобы чётко показать примеры и потребление памяти. Возможно, многим читателям такое использование потоков было очевидно. Однако беседы с разработчиками в последние месяцы оставили у меня впечатление, что у многих есть стойкая ассоциация между потоками и потоковой передачей данных, словно структура данных хороша только там. Это не так. :-) | https://habr.com/ru/post/444996/ | null | ru | null |

# Как совершить транзакцию в Nest.js

Во множестве случаев разработчики должны использовать транзации при совершении различных операций на сервере. К примеру - перевод денег, либо другой измеримой ценности, да много чего еще. При таких операциях очень не хочется получить ошибку, которая прервет процесс и нарушит целостность данных.

А что вообще такое "транзакция"? Википедия [говорит](https://ru.wikipedia.org/wiki/%D0%A2%D1%80%D0%B0%D0%BD%D0%B7%D0%B0%D0%BA%D1%86%D0%B8%D1%8F_%28%D0%B8%D0%BD%D1%84%D0%BE%D1%80%D0%BC%D0%B0%D1%82%D0%B8%D0%BA%D0%B0%29) нам, что это - *группа последовательных операций с базой данных, которая представляет собой логическую единицу работы с данными. Транзакция может быть выполнена либо целиком и успешно, соблюдая целостность данных и независимо от параллельно идущих других транзакций, либо не выполнена вообще, и тогда она не должна произвести никакого эффекта. Транзакции обрабатываются транзакционными системами, в процессе работы которых создаётся история транзакций*.

Теперь, рассмотрим ситуацию, когда может произойти ошибка, ведущая к очень неприятным последствиям, если не использовать транзакции.

Я сделал небольшой [проект](https://github.com/alphamikle/nest_transact/tree/master/example), в котором есть две сущности:

* Пользователь

* Кошелек

Пользователи могут переводить друг другу деньги. При переводе проверяется достаточность суммы на балансе того, кто переводит, а также много других проверок. Если произойдет ситуация, когда с баланса отправителя деньги списаны, а на счет получателя не переведены, либо наоборот - мы увидим либо очень грустного, разъяренного человека, либо не увидим очень счастливого (*зависит от суммы перевода*).

Отлично, с тем, что транзакции важны и нужны разобрались (*надеюсь, с этим согласны все*). Но как их применять?

Для начала рассмотрим варианты запросов с ошибками и без ошибок, которые будут происходить, если использовать PostgreSQL.

Обычный набор запросов без ошибок:

```

// ...

SELECT "User"."id" AS "User_id", "User"."name" AS "User_name", "User"."defaultPurseId" AS "User_defaultPurseId"

FROM "user" "User"

WHERE "User"."id" IN ($1)

START TRANSACTION

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

START TRANSACTION

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

```

К слову - этот запрос я не писал руками, а вытащил из логов ORM, но суть он отражает. Все довольно просто и понятно. Для построения запросов использовалась [TypeORM](https://typeorm.io), к которой мы вернемся немного позднее.

Настройки ORM и Postgres выставлены по умолчанию, поэтому каждая операция будет выполняться в своей транзации, но чтобы воспользоваться этим преимуществом, необходимо написать один запрос, в котором будет происходить сразу вся логика, связанная с базой данных.

Ниже приведен пример исполнения нескольких запросов, исполняемых в одной транзакции:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

```

Ключевая разница с предыдущим примером запросов в том, что в данном случае все запросы выполняются в одной транзакции, а поэтому, если на каком-то этапе возникнет ошибка, то откатится вся транзакция со всеми запросами внутри нее. Примерно так:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

ROLLBACK

```

А вот, кстати, и код, который производил все предыдущие SQL-запросы. В нем имеется флаг, при установке которого возникает ошибка в самых неподходящий момент:

```

// ...

async makeRemittance(

fromId: number,

toId: number,

sum: number,

withError = false,

transaction = true,

): Promise {

const fromUser = await this.userRepository.findOne(fromId, { transaction });

const toUser = await this.userRepository.findOne(toId, { transaction });

if (fromUser === undefined) {

throw new Error(NOT\_FOUND\_USER\_WITH\_ID(fromId));

}

if (toUser === undefined) {

throw new Error(NOT\_FOUND\_USER\_WITH\_ID(toId));

}

if (fromUser.defaultPurseId === null) {

throw new Error(USER\_DOES\_NOT\_HAVE\_PURSE(fromId));

}

if (toUser.defaultPurseId === null) {

throw new Error(USER\_DOES\_NOT\_HAVE\_PURSE(toId));

}

const fromPurse = await this.purseRepository.findOne(fromUser.defaultPurseId, { transaction });

const toPurse = await this.purseRepository.findOne(toUser.defaultPurseId, { transaction });

const modalSum = Math.abs(sum);

if (fromPurse.balance < modalSum) {

throw new Error(NOT\_ENOUGH\_MONEY(fromId));

}

fromPurse.balance -= sum;

toPurse.balance += sum;

await this.purseRepository.save(fromPurse, { transaction });

if (withError) {

throw new Error('Unexpectable error was thrown while remittance');

}

await this.purseRepository.save(toPurse, { transaction });

const remittance = new RemittanceResultDto();

remittance.fromId = fromId;

remittance.toId = toId;

remittance.fromBalance = fromPurse.balance;

remittance.sum = sum;

return remittance;

}

// ...

```

Отлично! Мы уберегли себя от убытков или очень огорченных пользователей (*по крайней мере в вопросах, связанных с переводами денег*).

#### Другие способы

Что дальше? Какие еще есть способы написать транзакцию? Так уж получилось, что человек, статью которого вы сейчас читаете (*это я*) очень любит один замечательный фреймворк, когда ему приходится писать backend. Имя этому фреймворку - [Nest.js](https://nestjs.com). Работает он на платформе Node.js, а код в нем пишется на Typescript. В этом прекрасном фреймворке имеется поддержка, практически из коробки, той самой TypeORM. Которая (или который?) мне, так уж получилось, тоже очень нравится. Не нравилось только одно - довольно запутанный, как мне кажется, излишне усложненный подход к написанию транзакций.

Это официальный [пример](https://typeorm.io/#/transactions) по написанию транзакций:

```

import { getConnection } from 'typeorm';

await getConnection().transaction(async transactionalEntityManager => {

await transactionalEntityManager.save(users);

await transactionalEntityManager.save(photos);

// ...

});

```

Второй способ создания транзакций из документации:

```

@Transaction()

save(user: User, @TransactionManager() transactionManager: EntityManager) {

return transactionManager.save(User, user);

}

```

В целом, смысл этого подхода заключается в следующем: вам необходимо получить `transactionEntityManager: EntityManager` - сущность, которая позволит выполнять запросы в рамках транказции. А затем использовать эту сущность для всех действий с базой. Звучит неплохо, до тех пор, пока не придется столкнуться с использованием данного подхода на практике.

Для начала - мне не очень нравится идея прокидывания зависимостей непосредственно в методы классов-сервисов, а также то, что написанные таким образом методы становятся обособленными в части использования вн едренных в сам сервис зависимостей. Все необходимые для работы метода зависимости придется в него же и прокидывать. Но самое неприятное - если ваш метод будет обращаться к другим сервисам, внедренным в ваш, то вам придется создавать такие же специальные методы в тех сторонних сервисах. И в них же передавать `transactionEntityManager`. При этом, стоит иметь в виду то, что если вы решили использовать подход через декораторы, то при передаче `transactionEntityManager` из одного сервиса во второй, и метод второго сервиса будет также отдекорирован - во втором методе вы получите не переданный в качестве зависимости `transactionEntityManager`, а тот, что создается декоратором, а значит - две разные транзакции, а значит горе-пользователей.

#### Начнем с примеров

Ниже показан код экшена контроллера, обрабатывающего пользовательские запросы:

```

// ...

@Post('remittance-with-typeorm-transaction')

@ApiResponse({

type: RemittanceResultDto,

})

async makeRemittanceWithTypeOrmTransaction(@Body() remittanceDto: RemittanceDto) {

return await this.connection.transaction(transactionManager => {

return this.appService.makeRemittanceWithTypeOrmV1(

transactionManager,

remittanceDto.userIdFrom,

remittanceDto.userIdTo,

remittanceDto.sum,

remittanceDto.withError,

);

});

}

// ...

```

В нём нам необходимо иметь доступ к объекту соединения `connection`, чтобы создать `transactionManager`. Мы могли бы поступить, как советуют в документации к TypeORM - и просто использовать функцию `getConnection`, как было показано выше:

```

import { getConnection } from 'typeorm';

// ...

@Post('remittance-with-typeorm-transaction')

@ApiResponse({

type: RemittanceResultDto,

})

async makeRemittanceWithTypeOrmTransaction(@Body() remittanceDto: RemittanceDto) {

return await getConnection().transaction(transactionManager => {

return this.appService.makeRemittanceWithTypeOrmV1(

transactionManager,

remittanceDto.userIdFrom,

remittanceDto.userIdTo,

remittanceDto.sum,

remittanceDto.withError,

);

});

}

// ...

```

Но сдается мне, что такой код будет тестироваться уже сложнее, да и это просто неправильно (*отличный аргумент*). Поэтому нам придется прокидывать зависимость `connection` в конструктор контроллера. Очень повезло, что Nest позволяет это сделать просто описав поле в конструкторе с указанием соответствующего типа:

```

@Controller()

@ApiTags('app')

export class AppController {

constructor(

private readonly appService: AppService,

private readonly connection: Connection, // <-- it is - what we need

) {

}

// ...

}

```

Таким образом мы приходим к выводу, что чтобы иметь возможность использовать транзакции в Nest при использовании TypeORM - необходимо прокидывать в конструктор контроллера / сервиса - класс `connection`, пока просто запомним это.

Теперь посмотрим на метод `makeRemittanceWithTypeOrmV1` нашего `appService`:

```

async makeRemittanceWithTypeOrmV1(transactionEntityManager: EntityManager, fromId: number, toId: number, sum: number, withError = false) {

const fromUser = await transactionEntityManager.findOne(User, fromId); // <-- we need to use only provided transactionEntityManager, for make all requests in transaction

const toUser = await transactionEntityManager.findOne(User, toId); // <-- and there

if (fromUser === undefined) {

throw new Error(NOT_FOUND_USER_WITH_ID(fromId));

}

if (toUser === undefined) {

throw new Error(NOT_FOUND_USER_WITH_ID(toId));

}

if (fromUser.defaultPurseId === null) {

throw new Error(USER_DOES_NOT_HAVE_PURSE(fromId));

}

if (toUser.defaultPurseId === null) {

throw new Error(USER_DOES_NOT_HAVE_PURSE(toId));

}

const fromPurse = await transactionEntityManager.findOne(Purse, fromUser.defaultPurseId); // <-- there

const toPurse = await transactionEntityManager.findOne(Purse, toUser.defaultPurseId); // <-- there

const modalSum = Math.abs(sum);

if (fromPurse.balance < modalSum) {

throw new Error(NOT_ENOUGH_MONEY(fromId));

}

fromPurse.balance -= sum;

toPurse.balance += sum;

await this.appServiceV2.savePurse(fromPurse); // <-- oops, something was wrong

if (withError) {

throw new Error('Unexpectable error was thrown while remittance');

}

await transactionEntityManager.save(toPurse);

const remittance = new RemittanceResultDto();

remittance.fromId = fromId;

remittance.toId = toId;

remittance.fromBalance = fromPurse.balance;

remittance.sum = sum;

return remittance;

}

```

Весь проект синтетический, но чтобы показать неприятность сего подхода - я вынес в отдельный сервис `appServiceV2` метод `savePurse`, используемый для сохранения кошелька, и использовал этот сервис с этим методом внутри рассматриваемого метода `makeRemittanceWithTypeOrmV1`. Код данного метода и сервиса вы можете увидеть ниже:

```

@Injectable()

export class AppServiceV2 {

constructor(

@InjectRepository(Purse)

private readonly purseRepository: Repository,

) {

}

async savePurse(purse: Purse) {

await this.purseRepository.save(purse);

}

// ...

}

```

Собственно, при этой ситуации мы получаем такие SQL-запросы:

```

START TRANSACTION

// ...

SELECT "User"."id" AS "User_id", "User"."name" AS "User_name", "User"."defaultPurseId" AS "User_defaultPurseId"

FROM "user" "User"

WHERE "User"."id" IN ($1)

START TRANSACTION // <-- this transaction from appServiceV2

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

```

Если мы отправим запрос, чтобы происходила ошибка, то явно увидим, что внутренняя транзакция, от `appServiceV2` не откатывается, а поэтому - мы огребаем от наших пользователей.

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

START TRANSACTION

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

ROLLBACK

```

Тут мы делаем вывод, что для стандартного подхода к транкациям необходимо иметь специальные методы, в которые будет нужно прокидывать `transactionEntityManager`.

Если же мы хотим избавиться от необходимости явного внедрения `transactionEntityManager` в соответствующие методы - то документация советует нам взглянуть на декораторы.

Применив их мы получим такого вида экшен контроллера:

```

// ...

@Post('remittance-with-typeorm-transaction-decorators')

@ApiResponse({

type: RemittanceResultDto,

})

async makeRemittanceWithTypeOrmTransactionDecorators(@Body() remittanceDto: RemittanceDto) {

return this.appService.makeRemittanceWithTypeOrmV2(remittanceDto.userIdFrom, remittanceDto.userIdTo, remittanceDto.sum, remittanceDto.withError);

}

// ...

```

Теперь он стал проще - нет необходимости в использовании класса `connection`, ни в конструкторе, ни вызывая глобальный метод TypeORM. Прекрасно. Но метод нашего сервиса, по прежнему, должен получать зависимость - `transactionEntityManager`. Тут на помощь и приходят те самые декораторы:

```

// ...

@Transaction() // <-- this

async makeRemittanceWithTypeOrmV2(fromId: number, toId: number, sum: number, withError: boolean, @TransactionManager() transactionEntityManager: EntityManager = null /* <-- and this */) {

const fromUser = await transactionEntityManager.findOne(User, fromId);

const toUser = await transactionEntityManager.findOne(User, toId);

if (fromUser === undefined) {

throw new Error(NOT_FOUND_USER_WITH_ID(fromId));

}

if (toUser === undefined) {

throw new Error(NOT_FOUND_USER_WITH_ID(toId));

}

if (fromUser.defaultPurseId === null) {

throw new Error(USER_DOES_NOT_HAVE_PURSE(fromId));

}

if (toUser.defaultPurseId === null) {

throw new Error(USER_DOES_NOT_HAVE_PURSE(toId));

}

const fromPurse = await transactionEntityManager.findOne(Purse, fromUser.defaultPurseId);

const toPurse = await transactionEntityManager.findOne(Purse, toUser.defaultPurseId);

const modalSum = Math.abs(sum);

if (fromPurse.balance < modalSum) {

throw new Error(NOT_ENOUGH_MONEY(fromId));

}

fromPurse.balance -= sum;

toPurse.balance += sum;

await this.appServiceV2.savePurseInTransaction(fromPurse, transactionEntityManager); // <-- we will check is it will working

if (withError) {

throw new Error('Unexpectable error was thrown while remittance');

}

await transactionEntityManager.save(toPurse);

const remittance = new RemittanceResultDto();

remittance.fromId = fromId;

remittance.toId = toId;

remittance.fromBalance = fromPurse.balance;

remittance.sum = sum;

return remittance;

}

// ...

```

С тем, что простое использование метода стороннего сервиса ломает наши транзакции - мы уже разобрались. Поэтому мы использовали новый метод стороннего сервиса `transactionEntityManager`, который имеет следующий вид:

```

// ..

@Transaction()

async savePurseInTransaction(purse: Purse, @TransactionManager() transactionManager: EntityManager = null) {

await transactionManager.save(Purse, purse);

}

// ...

```

Как видно из кода, в данном методе мы также применили декораторы - так мы достигаем единообразия по всем методам в проекте (*ага*), а также избавляемся от необходимости использования `connection` в конструкторе контроллеров, использующих наш сервис `appServiceV2`.

При таком подходе мы получаем такие запросы:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

START TRANSACTION

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

```

И, как следствие - разрушение транзакции и логики приложения при ошибке:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

START TRANSACTION

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

ROLLBACK

```

Единственный рабочий способ, который описывает документация - это отказ от использования декораторов, т.к. если использовать декораторы во всех методах сразу - то в те из них, что будут использоваться другими сервисами, будут внедрены свои собственные `transactionEntityManager`'ы, как это произошло с нашим сервисом `appServiceV2` и его методом `savePurseInTransaction`. Попробуем заменить данный метод другим:

```

// app.service.ts

@Transaction()

async makeRemittanceWithTypeOrmV2(fromId: number, toId: number, sum: number, withError: boolean, @TransactionManager() transactionEntityManager: EntityManager = null) {

// ...

await this.appServiceV2.savePurseInTransactionV2(fromPurse, transactionEntityManager);

// ...

}

// app.service-v2.ts

// ..

async savePurseInTransactionV2(purse: Purse, transactionManager: EntityManager) {

await transactionManager.save(Purse, purse);

}

// ..

```

Т.к. для единообразия наших методов, и избавления появившейся иерархии, проявляющейся в том, что одни методы могут вызывать другие, но третьи не смогут вызывать первые - мы изменим и метод класса `appService`, придя к первому способу из документации.

#### Рояль в кустах

Что же, кажется, нам все равно придется внедрять этот `connection` в конструкторы контроллеров. Но предлагаемый способ написания кода с транзакциями по прежнему выглядит очень громоздким и неудобным. Что делать? Решая данную неприятность я сделал пакет, который позволяет наиболее простым способом использовать транзакции. Называется он [nest-transact](https://www.npmjs.com/package/nest-transact).

Что он делает? Тут все просто. На нашем примере с пользователями и переводами посмотрим на ту же логику, написанную с помощью nest-transact.

Код нашего контроллера не изменился, и, раз уж мы убедились в том, что без `connection` в конструкторе не обойтись - укажем его:

```

@Controller()

@ApiTags('app')

export class AppController {

constructor(

private readonly appService: AppService,

private readonly connection: Connection, // <-- use this

) {

}

// ...

}

```

Экшен контроллера:

```

// ...

@Post('remittance-with-transaction')

@ApiResponse({

type: RemittanceResultDto,

})

async makeRemittanceWithTransaction(@Body() remittanceDto: RemittanceDto) {

return await this.connection.transaction(transactionManager => {

return this.appService.withTransaction(transactionManager)/* <-- this is interesting new thing*/.makeRemittance(remittanceDto.userIdFrom, remittanceDto.userIdTo, remittanceDto.sum, remittanceDto.withError);

});

}

// ...

```

Его отличие от экшена, в случае использования первого способа из документации:

```

@Post('remittance-with-typeorm-transaction')

@ApiResponse({

type: RemittanceResultDto,

})

async makeRemittanceWithTypeOrmTransaction(@Body() remittanceDto: RemittanceDto) {

return await this.connection.transaction(transactionManager => {

return this.appService.makeRemittanceWithTypeOrmV1(transactionManager, remittanceDto.userIdFrom, remittanceDto.userIdTo, remittanceDto.sum, remittanceDto.withError);

});

}

```

В том, что мы можем использовать обычные методы сервисов, не создавая специфические вариации для транзакций, в которые необходимо прокидывать `transactionManager`. А также - что перед использованием нашего бизнес-метода сервиса, мы вызываем метод `withTransaction`, на этом же сервисе, передавая в него наш `transactionManager`. Тут можно задаться вопросом - откуда взялся этот метод? Отсюда:

```

@Injectable()

export class AppService extends TransactionFor /\* <-- step 1 \*/ {

constructor(

@InjectRepository(User)

private readonly userRepository: Repository,

@InjectRepository(Purse)

private readonly purseRepository: Repository,

private readonly appServiceV2: AppServiceV2,

moduleRef: ModuleRef, // <-- step 2

) {

super(moduleRef);

}

// ...

}

```

А вот и код запросов:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

```

И с ошибкой:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

ROLLBACK

```

Но вы его уже видели в самом начале.

Чтобы эта магия заработала - нужно выполнить два шага:

* Наш сервис должен наследоваться от класса `TransactionFor`

* Наш сервис должен иметь в списке зависимостей конструктора специальный класс `moduleRef: ModuleRef`

Все. Кстати, т.к. внедрение зависимостей самим фреймворком никуда не делось - явно прокидывать `moduleRef` не придется. *Только при тестировании.*

Возможно, вы подумаете - *А зачем мне наследоваться от этого класса? Вдруг мой сервис должен будет наследоваться от какого-то другого?* Если подумали - то предлагаю посчитать, сколько ваших сервисов отнаследованы от других классов, и используются при транзакциях.

Теперь, как это работает? Появившийся метод `withTransaction` - пересоздает для данной транзакции ваш сервис, а также все зависимости вашего сервиса и зависимости зависимостей - всё, всё, всё. Отсюда следует, что если вы каким-то образом храните некое состояние в ваших сервисах (*ну а вдруг?*) - то его не будет при создании транзакции таким образом. Оригинальный инстанс вашего сервиса все так же существует и при его вызове все будет как и раньше.

В дополнение к предыдущему примеру я добавил и жадный метод: перевод с комиссией, в котором используются сразу два сервиса в одном экшене контроллера:

```

// ...

@Post('remittance-with-transaction-and-fee')

@ApiResponse({

type: RemittanceResultDto,

})

async makeRemittanceWithTransactionAndFee(@Body() remittanceDto: RemittanceDto) {

return this.connection.transaction(async manager => {

const transactionAppService = this.appService.withTransaction(manager); // <-- this is interesting new thing

const result = await transactionAppService.makeRemittance(remittanceDto.userIdFrom, remittanceDto.userIdTo, remittanceDto.sum, remittanceDto.withError);

result.fromBalance -= 1; // <-- transfer fee

const senderPurse = await transactionAppService.getPurse(remittanceDto.userIdFrom);

senderPurse.balance -= 1; // <-- transfer fee, for example of using several services in one transaction in controller

await this.appServiceV2.withTransaction(manager).savePurse(senderPurse);

return result;

});

}

// ...

```

Этот метод производит следующие запросы:

```

START TRANSACTION

// ...

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

// this is new requests for fee:

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."userId" = $1

LIMIT 1

SELECT "Purse"."id" AS "Purse_id", "Purse"."balance" AS "Purse_balance", "Purse"."userId" AS "Purse_userId"

FROM "purse" "Purse"

WHERE "Purse"."id" IN ($1)

UPDATE "purse"

SET "balance" = $2

WHERE "id" IN ($1)

COMMIT

```

Из которых мы видим, что все запросы, по прежнему, происходят в одной транзации и работать она будет корректно.

Подводя итоги, хочется сказать - при использовании данного пакета в нескольких реальных проектах я получил намного более удобный способ написания транзакций, разумеется - в рамках стека Nest.js + TypeORM. Надеюсь, что он будет полезен и вам. Если вам понравится данный пакет и вы решите попробовать его использовать, маленькая просьба - поставьте ему звездочку на [GitHub](https://github.com/alphamikle/nest_transact). Вам не сложно, а мне и проекту полезно. Также буду рад услышать конструктивную критику и возможные способы улучшения данного решения. | https://habr.com/ru/post/541866/ | null | ru | null |

# Создание инсталлятора с помощью WiX

Для начала — что такое WiX? Технология WiX (Windows Installer XML) представляет собой набор инструментов и спецификаций упрощающих процесс создания дистрибутивов на базе MSI (Microsoft Installer). Если объяснять проще то это обертка вокруг MSI с человеческим лицом.

На мой взгляд изучать проще всего на простых примерах. В данной статье я приведу пример простейшего инсталлятора.

Для начала поставим условия задачи — необходимо создать установочный дистрибутив, который будет содержать следующие диалоги:

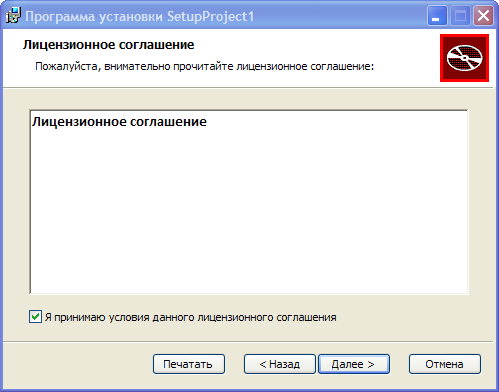

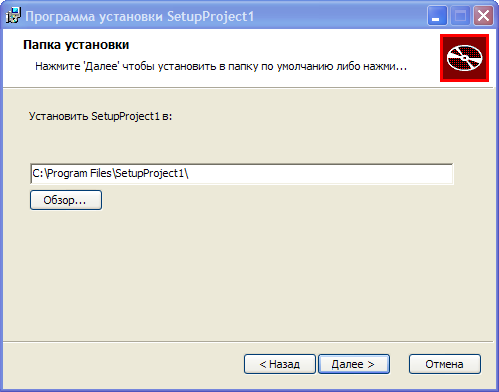

**Приветствие**

**Лицензионное соглашение**

**Выбор директории**

**Начало установки**

Для создания дистрибутива нам понадобится сам WiX, последнюю версию которого всегда можно скачать на [Source Forge](http://wix.sourceforge.net/releases/). На данный момент последняя версия 3.5.0828.0.

Необходимо скачать и установить:

1. [ProjectAggregator2.msi](http://wix.sourceforge.net/releases/3.5.0828.0/ProjectAggregator2.msi) — нужен, для того, чтобы установить Votive (находится внутри дистрибутива номер 2). Который, в свою очередь, является дополнением для Visual Studio, облегчающим процесс работы с WiX (подсветка синтаксиса, IntelliSense).

2. [Wix35.msi](http://wix.sourceforge.net/releases/3.5.0828.0/Wix35.msi) или [Wix35\_x64.msi](http://wix.sourceforge.net/releases/3.5.0828.0/Wix35_x64.msi) (в зависимости от платформы)

3. [Русский языковой файл](http://files.rsdn.ru/11344/WixUI_ru-ru.v3.zip)

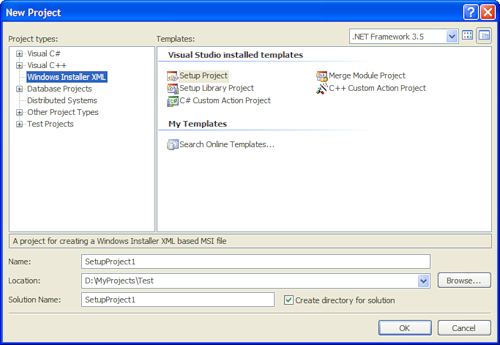

Итак, скачали, установили, запускаем Visual Studio. Меню File -> New Project, если все установлено правильно — появился новый раздел Windows Installer XML. Выбираем шаблон проекта Setup Project, вводим название проекта (я оставил как есть SetupProject1).

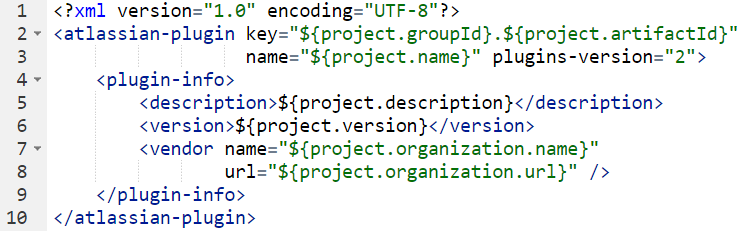

Проект будет состоять из одного файла Product.wxs с ним мы и будем работать. В моем случае файл выглядел следующим образом:

> `</fontxml version="1.0" encoding="UTF-8"?>

>

> <Wix xmlns="http://schemas.microsoft.com/wix/2006/wi">

>

> <Product Id="b7bc7c6f-9a4e-4973-be84-eca8e3427c97" Name="SetupProject1" Language="1033" Version="1.0.0.0" Manufacturer="SetupProject1" UpgradeCode="06a81104-1e30-463d-87e1-e8a79b4c682a">

>

> <Package InstallerVersion="200" Compressed="yes" />

>

>

>

> <Media Id="1" Cabinet="media1.cab" EmbedCab="yes" />

>

>

>

> <Directory Id="TARGETDIR" Name="SourceDir">

>

> <Directory Id="ProgramFilesFolder">

>

> <Directory Id="INSTALLLOCATION" Name="SetupProject1">

>

>

>

>

>

>

>

>

>

> Directory>

>

> Directory>

>

> Directory>

>

>

>

> <Feature Id="ProductFeature" Title="SetupProject1" Level="1">

>

>

>

>

>

> Feature>

>

> Product>

>

> Wix>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

**Для начала настроим внешний вид и добавим поддержку русского языка.**

Начнем с добавления русского языка. Для этого:

1. В ключе Product изменяем 1033 на 1049

2. В свойствах проекта (*правой клавишей по названию проекта в Solution Explorer -> Properties*), закладка Build, в поле Cultures to build вставляем ru-RU

3. Добавляем к проекту (*правой клавишей по названию проекта в Solution Explorer -> Add -> Existing Item*) файл WixUI\_ru-ru.wxl (из архива WixUI\_ru-ru.v3.zip)

В сгенерированном проекте нет ни одного диалогового окна. Существуют два варинта добавления диалоговых окон — создавать самостоятельно, либо воспользоваться готовым набором диалоговых окон.

Мы пойдем вторым путем, начинать знакомство лучше с простого. Для этого необходимо добавить ссылку на WixUIExtension.dll (*правой клавишей по названию проекта в Solution Explorer -> Add Reference — открываем папку, в которую был установлен WiX, подкаталог bin*)

Ссылку добавили, указываем какой набор мы будем использовать, в конце раздела Product добавим

> `<Property Id="WIXUI\_INSTALLDIR" Value="INSTALLLOCATION" >Property>

>

> <WixVariable Id="WixUILicenseRtf" Overridable="yes" Value="License.rtf"/>

>

> <UIRef Id="WixUI\_InstallDir"/>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

**WixVariable Id=«WixUILicenseRtf**» — указывает на путь к файлу лицензии (речи о нем пока не шло, добавили сразу, чтобы два раза не ходить).

**WixUI\_InstallDir** — готовый набор диалоговых окон. Данный набор включает все необходимые нам диалоги. Помимо него так же существуют наборы WixUI\_Advanced, WixUI\_Mondo, WixUI\_FeatureTree, WixUI\_InstallDir, WixUI\_Minimal.

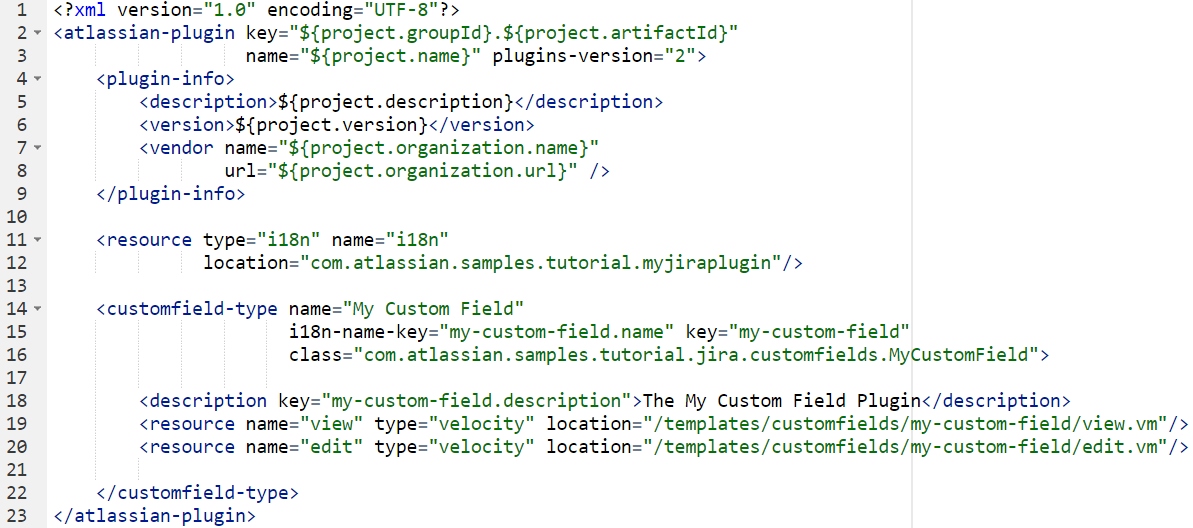

Приготовления закончены, можно приступать к редактированию файла установки. Для начала посмотрим, что нам нагенерила студия:

**Ключ Product** — описывает свойства продукта.

**Id** — идентификатор продукта, уникальный GUID.

**Name** — название продукта

**Language** — язык пакета установки

**Version** — версия продукта

**Manufacturer** — производитель

**UpgradeCode** — уникальный GUID

Чтобы упростить себе жизнь определим некоторые переменные. Для чего — название продукта, например, не раз может встречаться в скрипте, если нам захочется его изменить придется искать его по всему скрипту и менять на новое. Чтобы избежать этого определим переменную, которая будет содержать название продукта и, в случае необходимости, будем менять только ее. Над разделом **Product** добавим:

> `</fontdefine ProductName="SetupProject1" ?>

>

> </fontdefine ProductVersion="1.0.0.0" ?>

>

> </fontdefine ProductCode="b7bc7c6f-9a4e-4973-be84-eca8e3427c97"?>

>

> </fontdefine UpgradeCode="06a81104-1e30-463d-87e1-e8a79b4c682a"?>

>

> </fontdefine Manufacturer="MyCompany"?>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

Теперь заменим значение параметров ключа **Product** на переменные:

> `<Product Id="$(var.ProductCode)" Name="$(var.ProductName)" Language="1049" Version="$(var.ProductVersion)" Manufacturer="$(var.Manufacturer)" UpgradeCode="$(var.UpgradeCode)">

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

Определимся теперь с тем куда мы будем устанавливать наш продукт.

**Ключ Directory** — определяет путь для установки.

**Directory Id=«TARGETDIR»** корневой элемент для всех папок, которые будут использоваться для установки проекта.

**Directory Id=«ProgramFilesFolder»** папка Program Files (на что указывает Id=«ProgramFilesFolder»).

**Directory Id=«INSTALLLOCATION»** папка с именем SetupProject1 в папке Program Files. Заменим сразу Name=«SetupProject1» на Name="$(var.ProductName)"

Добавим файлы в пакет установки. Для этого сначала добавим устанавливаемые компоненты. Следуя совету «Remove the comments around this Component» уберем комментарии с Component внутри целевой папки и добавим туда, например, калькулятор.

> `<Component Id="ProductComponent" Guid="b11556a2-e066-4393-af5c-9c9210187eb2">

>

> <File Id='Calc' DiskId='1' Source='C:\WINDOWS\system32\calc.exe'/>

>

> Component>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

Установка компонента невозможна без включения его в одну из Feature (*если честно не уверен как в данном случае можно перевести этот термин на русский язык*). Этот элемент может быть использован когда нам необходимо дать пользователю возможность выбора, что устанавливать, а что нет. В условиях нашей задачи ничего не говорилось о возможности выбора, но несмотря на это нам необходимо привязать описанный Component к одной единственной Feature:

> `<Feature Id="ProductFeature" Title="$(var.ProductName)" Level="1">

>

> <ComponentRef Id="ProductComponent" />

>

> Feature>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

Осталось добавить ярлык в меню Пуск.

Сначала укажем, что мы собираемся работать с папкой меню Пуск и хотим там создать папку с именем нашей программы, содержащую ярлык на калькулятор.

В раздел Directory Id=«TARGETDIR», где-нибудь в конце добавляем:

> `<Directory Id="ProgramMenuFolder">

>

> <Directory Id="ApplicationProgramsFolder" Name="$(var.ProductName)">

>

> <Component Id="ApplicationShortcutCalc" Guid="4CEBD68F-E933-47f9-B02C-A4FC69FDB551">

>

> <Shortcut Id="ShortcutCalc"

>

> Name="Calc"

>

> Description="$(var.ProductName)"

>

> Target="[INSTALLLOCATION]Calc.exe"

>

> WorkingDirectory="INSTALLLOCATION"/>

>

> <RemoveFolder Id="ApplicationProgramsFolder" On="uninstall"/>

>

> <RegistryValue Root="HKCU" Key="Software\$(var.Manufacturer)\$(var.ProductName)" Name="installed" Type="integer" Value="1" KeyPath="yes"/>

>

> Component>

>

> Directory>

>

> Directory>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

Начинаем разбираться:

**Directory Id=«ProgramMenuFolder»** — указывает на директорию, в которой содержатся ярлыки меню Пуск.

**Directory Id=«ApplicationProgramsFolder»** — папка нашей программы в меню Пуск

**Component** — компонент, содержащий ярлык (не забыть включить его в Feature)

**Shortcut** — собственно ярлык к калькулятору

Финальная версия файла должна выглядеть так:

> `</fontxml version="1.0" encoding="UTF-8"?>

>

>

>

> <Wix xmlns="http://schemas.microsoft.com/wix/2006/wi">

>

> </fontdefine ProductName="SetupProject1" ?>

>

> </fontdefine ProductVersion="1.0.0.0" ?>

>

> </fontdefine ProductCode="b7bc7c6f-9a4e-4973-be84-eca8e3427c97"?>

>

> </fontdefine UpgradeCode="06a81104-1e30-463d-87e1-e8a79b4c682a"?>

>

> </fontdefine Manufacturer="MyCompany"?>

>

>

>

> <Product Id="$(var.ProductCode)" Name="$(var.ProductName)" Language="1049" Version="$(var.ProductVersion)" Manufacturer="$(var.Manufacturer)" UpgradeCode="$(var.UpgradeCode)">

>

> <Package InstallerVersion="200" Compressed="yes" />

>

>

>

> <Media Id="1" Cabinet="media1.cab" EmbedCab="yes" />

>

>

>

> <Directory Id="TARGETDIR" Name="SourceDir">

>

> <Directory Id="ProgramFilesFolder">

>

> <Directory Id="INSTALLLOCATION" Name="$(var.ProductName)">

>

> <Component Id="ProductComponent" Guid="b11556a2-e066-4393-af5c-9c9210187eb2">

>

> <File Id='Calc' DiskId='1' Source='C:\WINDOWS\system32\calc.exe'/>

>

> Component>

>

> Directory>

>

> Directory>

>

> <Directory Id="ProgramMenuFolder">

>

> <Directory Id="ApplicationProgramsFolder" Name="$(var.ProductName)">

>

> <Component Id="ApplicationShortcutCalc" Guid="4CEBD68F-E933-47f9-B02C-A4FC69FDB551">

>

> <Shortcut Id="ShortcutCalc"

>

> Name="Calc"

>

> Description="$(var.ProductName)"

>

> Target="[INSTALLLOCATION]Calc.exe"

>

> WorkingDirectory="INSTALLLOCATION"/>

>

> <RemoveFolder Id="ApplicationProgramsFolder" On="uninstall"/>

>

> <RegistryValue Root="HKCU" Key="Software\$(var.Manufacturer)\$(var.ProductName)" Name="installed" Type="integer" Value="1" KeyPath="yes"/>

>

> Component>

>

> Directory>

>

> Directory>

>

> Directory>

>

>

>

> <Feature Id="ProductFeature" Title="SetupProject1" Level="1">

>

> <ComponentRef Id="ProductComponent" />

>

> <ComponentRef Id="ApplicationShortcutCalc" />

>

> Feature>

>

>

>

> <Property Id="WIXUI\_INSTALLDIR" Value="INSTALLLOCATION" >Property>

>

> <WixVariable Id="WixUILicenseRtf" Overridable="yes" Value="License.rtf"/>

>

> <UIRef Id="WixUI\_InstallDir"/>

>

>

>

> Product>

>

> Wix>

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

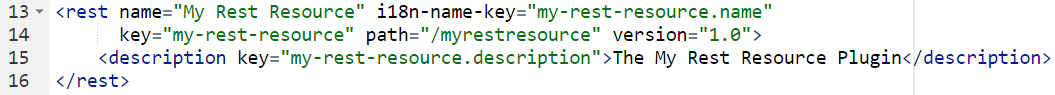

Делаем Build, запускаем, проверяем результат.

Где еще почитать

[Страница проекта](http://wix.sourceforge.net/)

[Alex Shevchuk: From MSI to WiX](http://blogs.technet.com/alexshev/default.aspx) (в основном на английском, но есть немного на русском)

[WiX Tutorial](http://www.tramontana.co.hu/wix/)

[wixwiki](http://www.wixwiki.com)

Продолжение [Часть 2 — фрагменты и инклуды](http://habrahabr.ru/blogs/development/69129/) | https://habr.com/ru/post/68616/ | null | ru | null |

# Автоматизация работы интернет-радио на Linux

Привет, `whoami`.

В этом посте я расскажу тебе об одном из методов автоматизации интернет-вещания – не самом надежном, но самом бюджетном. Сразу предупреждаю, что эта система заточена на использование ее под Linux, хотя с помощью знакомого многим «столярного инструмента», можно и под Windows реализовать. Эта статья расчитана на начинающих IT-шников, поэтому многие моменты я постарался «разжевать». Как у меня это получилось, решать тебе, мой дорогой читатель, но если мне удалось заинтересовать тебя, прошу под кат.

#### Предисловие

Итак, сначала позволю себе описать цели, которые я перед собой поставил:

1. Вещание нон-стоп 24/7/365 (не считая отключений электричества в доме).

2. Вещание по расписанию. То есть в определенный временной промежуток дня в эфире должны звучать композиции определенного стиля/жанра.

3. Поддержка «горячего» подключения и отключения ведущего/диджея.

4. Требования к сайту:

4.a. Скромная реализация голосования за звучащие композиции и, соответственно, рейтинг TOP-20/30/сколько\_угодно.

4.b. Информация о текущем треке, о текущем стиле/жанре и, если нужно, о количестве слушателей.

Теперь немного о том, что было у меня в «заначке» (точнее, в кладовке):

— домашний компьютер 2003 года, AMD Athlon 1,8 GHz, который уже давно работает как домашний сервер (кстати, я снизил тактовую частоту до 1,1 GHz для экономии электроэнергии);

— операционная система Gentoo Linux;

— доступ в глобальную сеть ~10Mbit/s + выделенный IP;

#### Настройка сервера Icecast

Итак, поехали. Я не буду описывать установку программ, т.к. в большинстве дистрибутивов они доступны в репозитариях и устанавливаются/собираются одной командой.

В качестве сервера был выбран Icecast 2.3.2, в качетсве source-клиента для нон-стопа – ices (версию не помню).

После установки нужно настроить Icecast следующим образом.

Файл /etc/icecast2/icecast.xml:

```

2

32768

5

admin

ВАШ\_ПАРОЛЬ

15

http://dir.xiph.org/cgi-bin/yp-cgi

15

http://www.oddsock.org/cgi-bin/yp-cgi

ВАШ\_IP\_АДРЕС

ПОРТ\_ДЛЯ\_СЕРВЕРА

1

/usr/share/icecast

/var/log/icecast

/home/www/icecast

/home/www/icecast/admin

access.log

error.log

3

/non-stop

ПАРОЛЬ\_НОН-СТОПА

МАКС\_КОЛ\_ВО\_СЛУШАТЕЛЕЙ

cp1251

0

НАЗВАНИЕ\_РАДИО

24/7 Non-stop music

АДРЕС\_САЙТА

Electronic

128

audio/mpeg

mp3

0

/live

ПАРОЛЬ\_ДЛЯ\_ДИДЖЕЕВ

100

/non-stop

1

0

cp1251

1

НАЗВАНИЕ\_РАДИО

ОПИСАНИЕ\_РАДИО

АДРЕС\_САЙТА

Electronic

128

audio/mpeg

mp3

0

0

icecast

nogroup

```

#### Настройка ices

С настройкой ices все проще:

Файл /etc/ices.conf:

```

/home/PUBLIC/Music/playlist.m3u

0

builtin

ices

1

localhost

ВАШ\_ПОРТ

ВАШ\_ПАРОЛЬ

http

1

1

/tmp

localhost

ВАШ\_ПОРТ

ВАШ\_ПАРОЛЬ

http

/non-stop

НАЗВАНИЕ\_РАДИО

Electronic

24/7 Non-stop music

АДРЕС\_САЙТА

128

1

0

-1

2

```

Итак, сервер Icecast настроен, и его уже можно запустить (обычно, /etc/init.d/icecast start).

Ices тоже настроен, однако его запускать пока рано, ибо нет плейлиста для нон-стопа.

Собственно это сейчас и исправим…

#### Формирование плейлистов

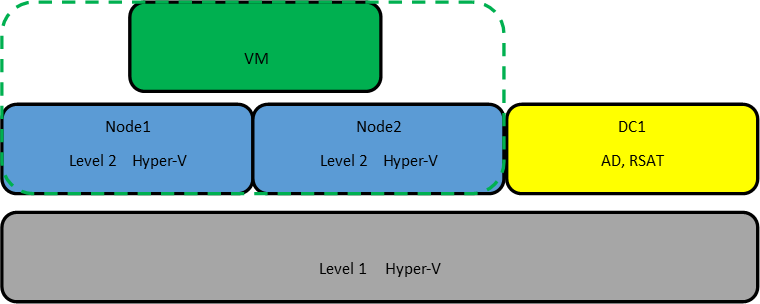

Небольшое предисловие. Эту радиостанцию я поднимал не один, а с товарищем, у которого на компьютере гораздо больший запас музыки, чем у меня. Ранее была сделана виртуальная частная сеть (VPN) между нашими компьютерами и сервером, посему мы благополучно могли обмениваться файлами. Было принято решение хранить все треки для нон-стопа в отдельном каталоге на сервере, который доступен в samba-шаре, и в который мой коллега может загружать треки (а может и удалять).

Структура каталога проста:

Music

--Genre1

----File1.mp3

----File2.mp3

----…

----playlist.m3u

--Genre2

----File1.mp3

----File2.mp3

----…

----playlist.m3u

…

playlist.m3u

Т.е. в основном каталоге Music имеется несколько подкаталогов для различных стилей (помнишь, я говорил о расписании нон-стопа?). В каждом таком подкаталоге расположены mp3-файлы и один плейлист.

Итак, начнем с маленького BASH-скрипта для формирования плейлистов для всех стилей.

Файл music\_find.sh (спасибо [differentlocal](https://habrahabr.ru/users/differentlocal/) за упрощение моего скрипта)

```

#!/bin/bash

# Каталог для хранения музыки

MUSICDIR=/home/PUBLIC/Music

cd $MUSICDIR

for i in *; do

cd $MUSICDIR/$i

find `pwd` -name "*.mp3" > playlist.m3u

done

```

*Примечание: для людей, далеких от электронной музыки, поясняю, что Breaks, Chill, Hardcore это как раз стили электронной музыки.*

И так как мой коллега далек от Linux, и не может зайти по SSH и запустить этот скрипт после обновления содержимого каталога, было решено поручить эту миссию Великому Крону:

```

# crontab -e

10,40 * * * * /root/scripts/radio/music_find.sh

```

Теперь через каждые 30 минут скрипт будет запускаться и обновлять плейлисты.

Однако, если ты еще не забыл, в конфиге ices был указан «главный» плейлист, который в этом скрипте не формируется.

Тут нужно вспомнить о расписании. Идея проста до безобразия: в определенное время (согласно расписанию эфира) копировать с заменой нужный плейлист в корневой каталог музыки (в моем случае /home/PUBLIC/Music). Сначала я думал реализовать расписание полностью на BASH, но потом вспомнил, что добрый Крон всегда готов нам помочь и выполнить всю грязную работу за нас. Таким образом возник скрипт, реализующий изменение плейлиста согласно расписанию.

Однако, сначала лирическое отступление…

Помнишь, при конфигурировании ices я отключил функцию рандомизации? Тебя наверное интересует, зачем? Причин две:

1. Бог его знает, как ices выполняет рандомизацию. Я привык (уж извините) максимально контроллировать ситуацию. Поэтому лучше сделать рандомизацию так, как сам хочешь, чтобы душа таки успокоилась.

2. Если ты читаешь эту статью, тебе, наверное, знаком термин «джингл». Так вот, если предполагается вставка джинглов в эфир (например, через каждые три трека), тут ices бессилен, т.к. он не знает, что это такое. Эта еще одна причина для написания собственной программы рандомизации.

BASH, конечно, штука хорошая, но для данной задачи я выбрал язык C++. Ниже приведен исходный код программы на C++, которая просто считывает содержимое созданного ранее плейлист-файла (имя передается ей в качестве параметра), перемешивает, и записывает в тот же файл.

Исходный код программы рандомизации:

```

#include

#include

#include

#include

#include

#include

using namespace std;

int main(const int argc, const char \*argv[])

{

if (argc<2)

{

cout << "ERROR: no argument recieved." << endl;

return 1;

}

vector list;

string line;

ifstream infile(argv[1]);

if (infile.fail())

return 1;

cout << "Using file: " << argv[1] << endl;

while (!infile.eof())

{

getline(infile,line);

list.push\_back(line);

}

infile.close();

cout << "End of file reached." << endl;

int n = list.size();

if (n>1)

{

cout << "Begin shuffle." << endl;

srand(time(0));

string temp;

for (int i=0; i<(n-1); i++)

{

int r = i + (rand() % (n-i));

temp = list[i];

list[i] = list[r];

list[r] = temp;

}

cout << "Finished shuffle." << endl;

ofstream outfile(argv[1]);

for (int i=0; i

```

В этой программе я не стал реализовывать вставку джинглов, но я искренне надеюсь, что ты, мой дорогой читатель, при необходимости легко подстроишь этот код по свои нужды или, что еще лучше, сам напишешь свой.

#### Реализация расписания

Итак, лирическое отступление закончено, вернемся к расписанию:

Файл playlist\_update:

```

#!/bin/bash

MUSICDIR=/home/PUBLIC/Music

cd $MUSICDIR

cp -f $1/playlist.m3u playlist.m3u

/root/scripts/radio/shuffle playlist.m3u >> /dev/null

echo "$1" > /home/www/HabrFM.ru/genre_non-stop.txt

if ps -A | grep ices

then

killall -HUP ices

else

/etc/init.d/ices start

fi

```

Сначала скрипт выполняет копирование с заменой нужного плейлист-файла, затем запускает программу рандомизации, записывает в текстовый файл текущий жанр (зачем, узнаешь позже)

и посылает сигнал «перечитать плейлист» ices. Если ранее ices завершил работу, скрипт его снова запустит. При этом важно знать, что ices начнет проигрывать новый плейлист только, когда закончит проигрывать текущий трек. Поэтому расписание будет выглядеть не очень элегантно, зато его можно поручить нашему другу Крону.

Привожу пример со своими стилями:

```

crontab -e

58 01 * * * /root/scripts/radio/playlist_update Breaks

58 03 * * * /root/scripts/radio/playlist_update Chill

58 09 * * * /root/scripts/radio/playlist_update Dance

58 14 * * * /root/scripts/radio/playlist_update House

58 17 * * * /root/scripts/radio/playlist_update Trance

58 21 * * * /root/scripts/radio/playlist_update Hardstyle

58 23 * * * /root/scripts/radio/playlist_update Hardcore

```

Та-да-дам! Вот теперь строительство вещания по расписанию закончено. Когда нет диджея, играет по расписанию нон-стоп, когда появляется диджей — слушателей автоматически перенаправляет на его «эфир». Однако, если ты помнишь, еще остались нереализованные задачи, касающиеся сайта.

#### База данных музыкальных композиций

Ах да, совсем забыл. Для реализации системы голосования я использовал БД MySQL. Так что потрудись, друг мой, обзавестись таковым, если еще этого не сделал.

Итак, нам нужно хранить в БД информацию о всех треках, которые присутствуют в «корневом музыкальном каталоге». Нужно создать базу данных (в моем примере это radio), а в ней две таблицы следующей структуры:

Таблица songs

id INT(11) AUTO\_INCREMENT PRIMARY\_KEY

Genre VARCHAR(15)

Title VARCHAR(100)

Filename VARCHAR(200)

Rate INT(11)

Таблица votes

id INT(11)

ip VARCHAR(16)

Теперь о печальном. Во-первых, далеко не у всех mp3-файлов (даже у лицензионных) корректные ID3-теги, а у большинства их вообще нет. Во-вторых, я не смог найти скрипт для чтения ID3-тегов из файлов. Поэтому пришлось пойти на некоторые жертвы. А именно: с помощью программы TagScanner вручную править ID3-теги всех файлов, а затем с помощью этой же программы переименовывать файлы согласно их уже корректным ID3-тегам. Я выбрал следующий шаблон:

<счетчик>. <Исполнитель> — <Композиция>.mp3

Я не буду описывать в этой статье работу с этой программой. Скажу лишь, что принципиально важно сохранять ВСЕ ID3-теги **НЕ** в UTF-8. В настройках программы есть соответствующая опция. кроме того, нужно заменить все символы ‘&’ на, например, “and”. Программа позволяет делать это сразу для всех файлов.

ОК, предположим, что у нас теперь есть корректные имена файлов, соответствующие шаблону, и база данных правильной структуры. Далее, собственно, еще один скрипт, но уже на PHP (так что не забудь на досуге установить и его).

Файл db\_update.php:

```

#!/usr/bin/php

php

$MUSICDIR="/home/PUBLIC/Music";

$hostname = "localhost";

$username = "radio"; // Имя пользователя для БД

$password = "12345"; // И пароль

$dbName = "radio"; // Имя БД

mysql_connect($hostname,$username,$password) OR die("Can't connect to database.");

mysql_select_db($dbName) or die(mysql_error());

$Gen = array('Dance','House','Trance','Hardstyle','Hardcore','Chill','Breaks','Pumping');

$sql = "SELECT * FROM radio.songs";

$all = mysql_query($sql);

$num_before = mysql_num_rows($all);

echo "There are $num_before records in database.\n";

echo "\n";

echo "Searching for non-existing file names...\n";

$deleted = 0;

while($row = mysql_fetch_array($all, MYSQL_ASSOC)) {

$id = $row['id'];

$db_filename = $row['Filename'];

$exist = @fopen($db_filename,"r");

if (!$exist) {

echo "Deleting: [$id] $db_filename\n";

$sql = "DELETE FROM radio.songs WHERE id=$id";

mysql_query($sql);

$deleted++;

}

}

if (!$deleted) {

echo "Nothing deleted.\n";

}

else {

echo "Total deleted: $deleted records.\n";

}

echo "\n";

$added = 0;

echo "Searching for new tracks...\n";

for ($i=0;$i<count($Gen);$i++) {

$genre=$Gen[$i];

$fp = fopen("$MUSICDIR/$genre/playlist.m3u","r");

while (!feof($fp)) {

$filename = fgets($fp);

if (strpos($filename,".mp3")) {

$filename = substr($filename,0,strlen($filename)-1);

$sql = sprintf("SELECT * FROM radio.songs WHERE Filename='%s'",mysql_real_escape_string($filename));

$res = mysql_query($sql);

$num = mysql_num_rows($res);

if ($num == 0) {

$title = strstr($filename," ");

$start = strpos($filename,". ")+2;

$len = strpos($filename,".mp3") - $start;

$title = substr($filename,$start,$len);

$filename = substr($filename,0,strpos($filename,".mp3")+4);

$sql = sprintf("INSERT INTO radio.songs ( `id`, `Genre`, `Title`, `Filename`, `Rate` ) VALUES ( NULL, '$genre', '%s', '%s', '0' )", mysql_real_escape_string($title),mysql_real_escape_string($filename));

mysql_query($sql) or die(mysql_error());

$added++;

echo "Adding $filename\n";

}

}

}

}

if (!$added) {

echo "Nothing added.\n";

}

else {

echo "Total added: $added records.\n";

}

echo "\n";

$sql = "SELECT * FROM radio.songs";

$all = mysql_query($sql);

$num_after = mysql_num_rows($all);

if ($num_before == $num_after) {

echo "There are still $num_after records in database.\n";

}

else {

echo "There are $num_after records in database.\n";

}

mysql_close();

?

```

Приведенный выше скрипт сначала удаляет из БД записи о треках, которых уже нет в соответствующем каталоге, а затем добавляет новые, если они есть.

Было бы логично запускать этот скрипт сразу после составления плейлистов, поэтому добавим одну строчку в файл music\_find.sh (предварительно, заменив путь на свой):

```

/root/scripts/radio/db_update.php

```

Теперь при составлении плейлистов автоматически будет обновляться информация в БД.

Вторую таблицу (votes) оставлю на закуску.

#### Сбор информации о вещании

Тут не буду особо вдаваться в подробности. Вашему вниманию предлагается php-скрипт, записывающий название текущего трека, стиль и количество слушателей в текстовые файлы. Предполагается, что эти файлы находятся в корне нашего сайта, т.е. если у тебя, друг мой, не установлен вебсервер, то поспеши его установить.

Файл icecast\_status.php:

```

#!/usr/bin/php

php

$STATS_FILE = 'http://IP_АДРЕС_СЕРВЕРА:ПОРТ_СЕРВЕРА/status.xsl';

$DOCROOT = '/var/www/HabrFM.ru'; // Корень сайта

$hostname = "localhost";

$username = "radio"; // Имя пользователя для БД

$password = "12345"; // И пароль

$dbName = "radio"; // Имя БД

mysql_connect($hostname,$username,$password) OR die("Can't connect to database.");

mysql_select_db($dbName) or die(mysql_error());

for($i=1;$i<13;$i++) {

$fp = fopen($STATS_FILE,'r');

if(!$fp) { die("Unable to connect to Icecast server."); }

$stats_file_contents = '';

while(!feof($fp)) { $stats_file_contents .= fread($fp,1024); }

fclose($fp);

$radio_info = array();

$radio_info['genre'] = '';

$radio_info['listeners'] = '';

$radio_info['now_playing'] = '';

$temp = array();

$search_for = "<td\s[^]*class=\"streamdata\">(.*)<\/td>";

$search_td = array(' ',' |');

if(preg_match_all("/$search_for/siU",$stats_file_contents,$matches)) {

foreach($matches[0] as $match) {

$to_push = str_replace($search_td,'',$match);

$to_push = trim($to_push);

array_push($temp,$to_push);

}

}

$radio_info['listeners'] = $temp[5];

$radio_info['now_playing'] = $temp[9];

if(strpos($stats_file_contents,'/live')) {

$radio_info['genre'] = "DJ On-Air";

}

else {

$fp = fopen("$DOCROOT/genre_non-stop.txt","r");

$radio_info['genre'] = fgets($fp);

fclose($fp);

$radio_info['genre'] = substr($radio_info['genre'],0,strlen($radio_info['genre'])-1);

}

if ($radio_info['genre'] == "DJ On-Air"){

$rate = "1000+";

}

else {

$sql = sprintf("SELECT * FROM songs WHERE ( Genre='%s' AND Title='%s' )", mysql_real_escape_string($radio_info['genre']), mysql_real_escape_string($radio_info['now_playing']));

$res = mysql_query($sql) or die();

$row = mysql_fetch_array($res, MYSQL_ASSOC);

$rate = $row['Rate'];

$id = $row['id'];

}

$fp = fopen("$DOCROOT/now_playing.txt","w");

fputs($fp,$radio_info['now_playing']);

fclose($fp);

$fp = fopen("$DOCROOT/id.txt","w");

fputs($fp,$id);

fclose($fp);

$fp = fopen("$DOCROOT/listeners.txt","w");

if ($radio_info['listeners'] > 0) { fputs($fp,''.$radio\_info['listeners'].''); }

else { fputs($fp,''.$radio\_info['listeners'].''); }

fclose($fp);

$fp = fopen("$DOCROOT/genre.txt","w");

fputs($fp,$radio_info['genre']);

fclose($fp);

$fp = fopen("$DOCROOT/rate.txt","w");

if ($rate > 0) { fputs($fp,'+'.$rate.''); }

if ($rate < 0) { fputs($fp,''.$rate.''); }

if ($rate == 0) { fputs($fp,''.$rate.''); }

fclose($fp);

sleep(5);

}

?>

```

Этот скрипт нужно запускать каждую минуту, причем он выполняется 12 раз с задержками по 5 секунд. Этот «велосипед» связан с тем, что наш друг Крон не подразумевает о существовании единиц измерения времени меньше, чем 1 минута. А нам нужно обновлять эту информацию хотя бы раз в 5 секунд.

Что же, попросим Крона (в последний раз) запускать этот скрипт каждую минуту:

```

crontab -e

*/1 * * * * /root/scripts/radio/icecast_status.php

```

ОК, теперь в корне нашего сайта лежат аж 5 замечательных файлов:

• now\_playing.txt — исполнитель и название текущего трека;

• id.txt — уникальный номер в БД текущей композиции;

• genre.txt — стиль трека, если играет нон-стоп, или строка «DJ On-Air”, если в эфире диджей;

• listeners.txt — количество слушателей (с учетом HTML-форматирования: если больше 0, то зеленым цветом, если ноль — черным);

• rate.txt — рейтинг трека (тоже с учетом HTML-форматирования).

Ух ты, мы уже почти получили все, что хотели (или то, чего я хотел). Осталось реализовать голосование и, собственно, показ нужной информации на сайте.

#### Голосование за композиции

Первое, о чем я подумал, когда захотел реализовать голосование — а как блокировать повторные голосования за один трек? Обычно используют Cookies, но я с ними никогда не работал (да, такое тоже бывает), и решил блокировать по IP-адресу. Поэтому в таблице votes всего два поля: id и ip.

Файл vote.php (должен располагаться в корне сайта):

```

php

//Это, надеюсь, в комментариях не нуждается

$DOCROOT = '/var/www/HabrFM.ru';

$hostname = "localhost";

$username = "radio";

$password = "12345";

$dbName = "radio";

mysql_connect($hostname,$username,$password) OR die("Can't connect to database.");

mysql_select_db($dbName) or die(mysql_error());

$fp = fopen("$DOCROOT/id.txt", "r");

$id = fgets($fp);

fclose($fp);

$sql = sprintf("SELECT * FROM votes WHERE ( id='%s' AND ip='%s' )", $id, mysql_real_escape_string($_SERVER['REMOTE_ADDR']));

$res = mysql_query($sql);

$num = mysql_num_rows($res);

if ($num == 0)

{

$type = $_GET['type'];

if ($type == 'plus') {

$sql = sprintf("UPDATE songs SET Rate=Rate+1 WHERE id='%s'", $id);

}

else {

if ($type == 'minus') {

$sql = sprintf("UPDATE songs SET Rate=Rate-1 WHERE id='%s'", $id);

}

else {

die('Irregular argument.');

}

}

if (mysql_query($sql)) {

$sql = sprintf("INSERT INTO votes (`id`, `ip`) VALUES ('%s', '%s')", $id, mysql_real_escape_string($_SERVER['REMOTE_ADDR']));

mysql_query($sql);

echo 'Ваш голос учтен.';

}

else {

echo 'Произошла ошибка.';

}

}

else {

echo "Вы уже голосовали за этот трек.";

}

mysql_close();

?

```

Этот скрипт принимает один параметр — вид голосования (за или против). Соответственно, вызов

```

vote.php?type=plus

```

добавит 1 рейтинга текущему треку, а

```

vote.php?type=minus

```

отнимет 1 рейтинга.

#### Показ информации на сайте

Итак, голосование — есть. Осталось, разве, что вывести на сайте всю необходимую информацию. Я не буду приводить конкретный HTML-код. Просто напомню, если вдруг ты забыл, о существовании замечательного фреймворка jQuery.

Пусть в нужных местах HTML-кода стоят элементы или с id='now\_playing' для названия трека, с id='genre’ для жанра и тд.

Тогда удобно встроить в следующий вызов (конечно, библиотеку jQuery нужно добавить в каталог сайта и подключить):

```

function show() {

$.ajax({ url: "now\_playing.txt", cache: false, success: function(html){ $("#now\_playing").html(html); } });

$.ajax({ url: "genre.txt", cache: false, success: function(html){ $("#genre").html(html); } });

$.ajax({ url: "listeners.txt", cache: false, success: function(html){ $("#listeners").html(html); } });

$.ajax({ url: "rate.txt", cache: false, success: function(html){ $("#rate").html(html); } });

}

$(document).ready(function(){ show(); setInterval('show()',5000); });

```

И тогда каждые 5 секунд информация на странице будет обновляться (причем, без перезагрузки страницы).

Помнишь, в начале статьи я заявил о показе рейтинга TOP20? Да, это было бы здорово.

Итак, последний скрипт, который выдает таблицу лучших (type=1) или худших (type=2) треков определенного стиля/жанра в следующем формате:

| Композиция | Рейтинг |

Файл top20.php (лучше допилить инструментом под свой сайт):

```

php

$Gen = array('Dance','House','Trance','Hardstyle','Hardcore','Chill','Breaks','Pumping');

//Опять те же строки :)

$hostname = "localhost";

$username = "radio";

$password = "12345";

$dbName = "radio";

mysql_connect($hostname,$username,$password) OR die("Can't connect to database.");

mysql_select_db($dbName) or die(mysql_error());

$genre = $_GET["genre"];

$type = $_GET["type"];

echo "<br\n";

if (!(in_array($genre,$Gen))) { die("Irregular argument."); }

$sql = sprintf("SELECT Title, Rate FROM songs WHERE (Genre='%s'",mysql_real_escape_string($genre));

if ($type==1) { $sql = $sql . " AND Rate>0) ORDER BY Rate DESC LIMIT 20"; }

else if ($type==2) { $sql = $sql . " AND Rate<0) ORDER BY Rate ASC LIMIT 20"; }

else { die("Irregular argument"); }

$res = mysql_query($sql);

if (mysql_num_rows($res)>0) {

echo '

';

echo "\n";

echo '| № | Исполнитель - Трек | Рейтинг |

';

echo "\n";

}

else {

echo "Этот рейтинг пока пуст. Вы можете проголосовать за какой-нибудь трек во время его звучания на радио.";

}

$i = 1;

while ($row = mysql\_fetch\_array($res, MYSQL\_ASSOC)) {

echo "|";

echo ' ' . $i . '. |';

echo ' ' . $row['Title'] . ' |';

echo ' ' . $row['Rate'] . ' |';

echo "

\n";

$i++;

}

if (mysql\_num\_rows($res)>0) {

echo '

';

}

mysql_close();

?>

```

Вот и все. Далее нужно встроить этот скрипт в нужное место HTML-кода (можно использовать тот же jQuery, только без setInterval('show()',5000). Но это я оставляю тебе, мой юный друг, в качестве домашнего задания.

Искренне надеюсь, что мой рассказ окажется тебе полезным или просто интересным. | https://habr.com/ru/post/131116/ | null | ru | null |

# Опыт использования js-ctypes в Firefox 4 в Windows

Компания, в которой я работаю, занимается разработкой вспомогательных программ для интернет-пользователей. Для вызова этих программ из файрфокса у нас есть специальное расширение. Работает оно очень просто — ищет окно в системе и передает ему данные через WM\_COPYDATA. Но для такого взаимодействия с Windows-программами в свое пришлось написать XPCOM компонент на C. В четвертом файрфоксе старые бинарные компоненты перестали работать и одновременно появился механизм для прямой работы с win-библиотеками из яваскрипта — js-ctypes. Пока я переписывал код с C на JS, умудрился нарваться на все подводные камни, которыми теперь и хочу поделиться.

Упрощенная версия кода выглядит так:

> `Components.utils.import("resource://gre/modules/ctypes.jsm")

>

>

>

> //Первая проблема - разный тип вызовов системных функций для 64 и 32 битных систем. В Firefox-64 надо использовать default\_abi, в 32 битной версии default\_abi или winapi\_abi. Можно было бы везде использовать default\_abi, но универсальное объявление калбэк-функций оказалось невозможным. Поэтому пришлось учитывать разрядность браузера

>

>

>

> var CallBackType;

>

> var WinABI;

>

>

>

> //Чтобы отличить FF64 от FF32, пришлось воспользоваться таким хаком - проверкой размера типа данных size\_t, который равен 8 и 4 байтам соответственно

>

> if (ctypes.size\_t.size == 8) {

>

> CallBackABI = ctypes.default\_abi;

>

> WinABI = ctypes.default\_abi;

>

> } else {

>

> CallBackABI = ctypes.stdcall\_abi;

>

> WinABI = ctypes.winapi\_abi;

>

> }

>

>

>

> //грузим dll

>

> var user32dll = ctypes.open('user32.dll');

>

> var kernel32dll = ctypes.open('kernel32.dll');

>

>

>

> //объявляем нужные функции

>