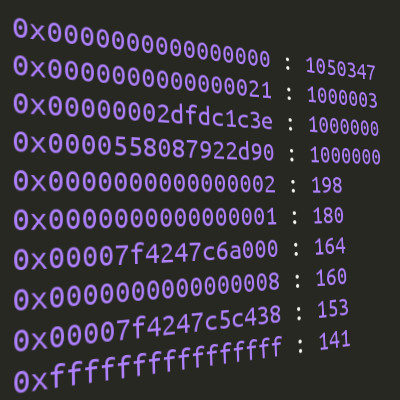

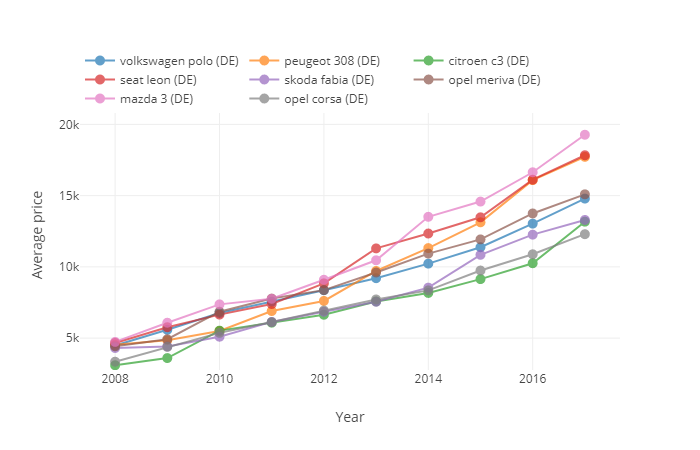

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

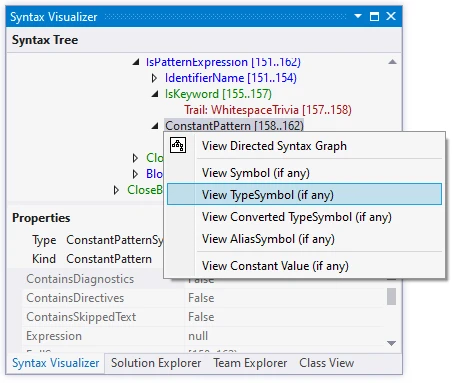

values | source stringclasses 4

values |

|---|---|---|---|---|

# Общение между потоками через ResultReceiver

Как известно каждому Android-разработчику Android SDK, предоставляет несколько способов заставить опреденный кусок кода выполнятся в параллельном потоке. Многопоточность это хорошо, но кроме ее организации нужно также наладить канал общения между потоками. Например, между UI-потоком и потоком, в котором выполняются фоновые задачи. В данном коротком эссе хочу осветить один из способов, основанный на применении встроенного класса ResultReceiver.

#### Вместо вступления

В большинстве Android-проектов приходится организовывать общение с внешним миром, т.е. организовывать сетевое взаимодействие. Не буду повторяться почему выполнять такой долгоиграющий код в UI-потоке плохо. Это всем известно. Более того, начиная с API 11 (Honeycomb который) система бьет разработчика по рукам исключением когда тот пытается в UI-потоке делать сетевые вызовы.

Одним из вариантов общения UI-потока с параллельным потоком (в котором, к примеру, выполняется http-запрос) есть подход, основанный на применении встроенного системного класса `android.os.ResultReceiver` совместно с сервисом.

#### Немного о архитектуре подхода

Для организации отдельного потока я выбрал IntentService. Почему именно он, а не простой Service? Потому, что IntentService при поступлении к нему команды автоматически начинает выполнять метод `onHandleIntent(Intent intent)` в отдельном от UI потоке. Простой Service такого не позволяет ибо он выполняется в основном потоке. Организовывать запуск потока из Service'а нужно самостоятельно.

Общение между Activity и IntentService-ом будет происходить с помощью Intent'ов.

#### Код

Сначала исходный код, потом ниже краткие комментарии к тому, что там и как происходит.

##### Реализация ResultReceiver'а

```

public class AppResultsReceiver extends ResultReceiver {

public interface Receiver {

public void onReceiveResult(int resultCode, Bundle data);

}

private Receiver mReceiver;

public AppResultsReceiver(Handler handler) {

super(handler);

}

public void setReceiver(Receiver receiver) {

mReceiver = receiver;

}

@Override

protected void onReceiveResult(int resultCode, Bundle resultData) {

if (mReceiver != null) {

mReceiver.onReceiveResult(resultCode, resultData);

}

}

}

```

Здесь следует обратить внимание на коллбэк (`Receiver`). При получении результата в `onReceiveResult()` делается проверка на не-null коллбэка. Дальше в коде активити будет показано как активировать и деактивировать ресивер с помощью этого коллбэка.

##### IntentService

```

public class AppService extends IntentService {

public AppService() {

this("AppService");

}

public AppService(String name) {

super(name);

}

@Override

protected void onHandleIntent(Intent intent) {

final ResultReceiver receiver = intent.getParcelableExtra(Constants.RECEIVER);

receiver.send(Constants.STATUS_RUNNING, Bundle.EMPTY);

final Bundle data = new Bundle();

try {

Thread.sleep(Constants.SERVICE_DELAY);

data.putString(Constants.RECEIVER_DATA, "Sample result data");

} catch (InterruptedException e) {

data.putString(Constants.RECEIVER_DATA, "Error");

}

receiver.send(Constants.STATUS_FINISHED, data);

}

}

```

`onHandleIntent()` будет вызван после того, как вызывающий код (UI-классы etc.) выполнит `startService()`. Инстанс ResultReceiver'а будет извлечен из интента и ему тут же будет отослана команда «ОК, я пошел трудиться». После выполнения полезной работы в этом методе результаты (извлеченные из JSON классы-модели, строки, что-угодно) помещается в бандл и отправляется ресиверу. Причем для индикации типа ответа используются разные коды (описаны константами). Как ResultReceiver получает и отправляет данные можно почитать в его исходниках.

##### Посылка команды сервису и обработка результата (Activity)

```

public class MainActivity extends Activity implements AppResultsReceiver.Receiver {

private AppResultsReceiver mReceiver;

private ProgressBar mProgress;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

mProgress = (ProgressBar) findViewById(R.id.progressBar);

}

@Override

protected void onResume() {

super.onResume();

mReceiver = new AppResultsReceiver(new Handler());

mReceiver.setReceiver(this);

}

@Override

protected void onPause() {

super.onPause();

mReceiver.setReceiver(null);

}

public void onStartButtonClick(View anchor) {

final Intent intent = new Intent("SOME_COMMAND_ACTION", null, this, AppService.class);

intent.putExtra(Constants.RECEIVER, mReceiver);

startService(intent);

}

@Override

public void onReceiveResult(int resultCode, Bundle data) {

switch (resultCode) {

case Constants.STATUS_RUNNING :

mProgress.setVisibility(View.VISIBLE);

break;

case Constants.STATUS_FINISHED :

mProgress.setVisibility(View.INVISIBLE);

Toast.makeText(this, "Service finished with data: "

+ data.getString(Constants.RECEIVER_DATA), Toast.LENGTH_SHORT).show();

break;

}

}

}

```

Здесь все просто. Activity реализует интерфейс `AppResultsReceiver.Receiver`. При старте создает экземпляр ресивера, при паузе — отвязывается от прослушивания ответов от сервиса. При клике на кнопку формируется команда (интент), в него помещается ссылка на наш `ResultReceiver` и стартуется сервис.

При получении ответа от сервиса в методе `onReceiveResult()` проверяется код ответа и выполняется соответствующее действие. Вот и все.

Демо-приложение выглядит просто, оно имеет всего одну кнопку «Послать запрос».

Исходный код демо-проекта [доступен на GitHub](https://github.com/gshockv/result-receiver-demo)

#### Вместо заключения

Обработка команды в фоновом сервисе реализована до безобразия просто: поток просто ставится на паузу на некоторое время. Конечно же в реальных приложениях нужно в интенте передавать код команды (action), которую нужно выполнить, дополнительные параметры и прочее. ООП вам в руки. Также стоит помнить, что данные (например, модели), которые будучи упакованными в бандл должны быть Parcelable-объектами. Это повысит эффективность их сериализации.

Конечно же описанный подход не есть истина в последней инстанции. Мы вольны выбирать разные архитектурные подходы, средства и комбинации. Будь то AsyncTask'и, Service+Thread+BroadcastReceiver или «ручная» передача Message'ей посредством Handler'а в UI-поток. Выбирать, как говориться, вам. Но это уже совсем другая история. | https://habr.com/ru/post/167679/ | null | ru | null |

# Создание движка для блога с помощью Phoenix и Elixir / Часть 3. Добавляем роли

От переводчика: «*Elixir и Phoenix — прекрасный пример того, куда движется современная веб-разработка. Уже сейчас эти инструменты предоставляют качественный доступ к технологиям реального времени для веб-приложений. Сайты с повышенной интерактивностью, многопользовательские браузерные игры, микросервисы — те направления, в которых данные технологии сослужат хорошую службу. Далее представлен перевод серии из 11 статей, подробно описывающих аспекты разработки на фреймворке Феникс казалось бы такой тривиальной вещи, как блоговый движок. Но не спешите кукситься, будет действительно интересно, особенно если статьи побудят вас обратить внимание на Эликсир либо стать его последователями.

В этой части мы добавим поддержку ролей и начнём разграничивать права доступа. Ключевой момент данной серии статей — здесь очень много внимания уделяется тестам, а это здорово!

**Дочитайте до конца, чтобы узнать, зачем нужно подписываться на Wunsh.ru и как выиграть крайне полезный приз***».

На данный момент наше приложение основано на:

* **Elixir**: v1.3.1

* **Phoenix**: v1.2.0

* **Ecto**: v2.0.2

* **Comeonin**: v2.5.2

Где мы остановились

-------------------

Мы расстались с вами в прошлый раз на том, что закончили связывать посты с пользователями и начали процесс по ограничению доступа к постам для пользователей, не являющихся их авторами. Нам также хотелось бы обеспечить соблюдение пользователями правил, не дожидаясь развития событий, при котором какой-нибудь негодник удалит всех пользователей, либо все посты.

Для решения этой проблемы мы воспользуемся довольно стандартным подходом: создадим роли.

Создание ролей

--------------

Начнём с запуска следующей команды в терминале:

```

$ mix phoenix.gen.model Role roles name:string admin:boolean

```

Которая должна вывести что-то похожее:

```

* creating web/models/role.ex

* creating test/models/role_test.exs

* creating priv/repo/migrations/20160721151158_create_role.exs

Remember to update your repository by running migrations:

$ mix ecto.migrate

```

Предлагаю воспользоваться советом скрипта и сразу же запустить команду `mix ecto.migrate`. Исходя из предположения, что наша база данных настроена должным образом, мы должны увидеть аналогичный вывод:

```

Compiling 21 files (.ex)

Generated pxblog app

11:12:04.736 [info] == Running Pxblog.Repo.Migrations.CreateRole.change/0 forward

11:12:04.736 [info] create table roles

11:12:04.742 [info] == Migrated in 0.0s

```

Мы также прогоним тесты, чтобы убедиться, что добавление новой модели ничего не поломало. Если все они зелёные, то двинемся дальше и свяжем роли с пользователями.

Добавление связи между ролями и пользователями

----------------------------------------------

Основной замысел, которому я следовал при реализации этой возможности — у каждого пользователя может быть только одна роль, при этом каждая роль принадлежит сразу нескольким пользователям. Для этого изменим файл `web/models/user.ex` в соответствии с написанным ниже.

Внутри секции схемы **«users»** добавим следующую строчку:

```

belongs_to :role, Pxblog.Role

```

В этом случае мы собираемся разместить внешний ключ **role\_id** в таблице **users**, т. е. мы говорим, что пользователь «принадлежит» роли. Также откроем файл `web/models/role.ex` и добавим в секцию схемы **«roles»** следующую строчку:

```

has_many :users, Pxblog.User

```

Затем снова запустим тесты, но на этот раз получим кучу ошибок. Мы сказали **Ecto**, что наша таблица пользователей имеет связь с таблицей ролей, но нигде в базе данных не определили это. Так что нам нужно изменить таблицу пользователей, чтобы хранить ссылку на роль в поле **role\_id**. Вызовем команду:

```

$ mix ecto.gen.migration add_role_id_to_users

```

Вывод:

```

Compiling 5 files (.ex)

* creating priv/repo/migrations

* creating priv/repo/migrations/20160721184919_add_role_id_to_users.exs

```

Давайте откроем свежесозданный файл миграции. По умолчанию он выглядит так:

```

defmodule Pxblog.Repo.Migrations.AddRoleIdToUsers do

use Ecto.Migration

def change do

end

end

```

Нам нужно внести несколько коррективов. Начнём с изменения таблицы **users**. Добавим в неё ссылку на роли таким образом:

```

alter table(:users) do

add :role_id, references(:roles)

end

```

Нам также нужно добавить индекс на поле **role\_id**:

```

create index(:users, [:role_id])

```

Наконец, выполним команду `mix ecto.migrate` снова. Миграция должна пройти успешно! Если мы запустим тесты теперь, все они снова будут зелёными!

К сожалению, наши тесты не идеальны. Прежде всего мы не изменяли их вместе с моделями **Post**/**User**. Поэтому не можем быть уверенными в том, что, например, у поста обязательно определён пользователь. Аналогично, у нас не должно быть возможности создавать пользователей без роли. Изменим функцию **changeset** в файле `web/models/user.ex` следующим образом (обратите внимание на добавление **:role\_id** в двух местах):

```

def changeset(struct, params \\ %{}) do

struct

|> cast(params, [:username, :email, :password, :password_confirmation, :role_id])

|> validate_required([:username, :email, :password, :password_confirmation, :role_id])

|> hash_password

end

```

Создание хелпера для тестов

---------------------------

В результате запуска тестов сейчас можно получить большое количество ошибок, но это нормально! Нам нужно проделать много работы, чтобы привести их в порядок. И начнём мы с добавления некого тестового хелпера, который избавит нас от написания одного и того же кода снова и снова. Создадим новый файл `test/support/test_helper.ex` и заполним его следующим кодом:

```

defmodule Pxblog.TestHelper do

alias Pxblog.Repo

alias Pxblog.User

alias Pxblog.Role

alias Pxblog.Post

import Ecto, only: [build_assoc: 2]

def create_role(%{name: name, admin: admin}) do

Role.changeset(%Role{}, %{name: name, admin: admin})

|> Repo.insert

end

def create_user(role, %{email: email, username: username, password: password, password_confirmation: password_confirmation}) do

role

|> build_assoc(:users)

|> User.changeset(%{email: email, username: username, password: password, password_confirmation: password_confirmation})

|> Repo.insert

end

def create_post(user, %{title: title, body: body}) do

user

|> build_assoc(:posts)

|> Post.changeset(%{title: title, body: body})

|> Repo.insert

end

end

```

Перед тем, как двинемся править тесты дальше, давайте поговорим о том, что же этот файл делает. Первое, на что следует обратить внимание — это то, куда мы его положили. А именно в директорию **test/support**, в которую мы так же можем класть любые модули, чтобы сделать их доступными нашим тестам в целом. Нам по-прежнему нужно будет ссылаться на этот хелпер из каждого тестового файла, но так и должно быть!

Итак, сначала мы указываем алиасы для модулей **Repo**, **User**, **Role** и **Post**, чтобы укоротить синтаксис для их вызова. Затем импортируем **Ecto**, чтобы получить доступ к функции **build\_assoc** для создания ассоциаций.

В функции **create\_role** мы ожидаем получить на вход словарь, включающий название роли и флаг администратора. Так как мы воспользовались здесь функцией `Repo.insert`, значит получим на выходе стандартный ответ `{:ok, model}` при успешном добавлении. Другими словами это просто вставка ревизии **Role**.

Мы начинаем двигаться по цепочке вниз с полученной на вход роли, которую передаём дальше для создания модели пользователя (т.к. мы определили **:users** в качестве ассоциации), на основе которой создаём ревизию **User** с упомянутыми ранее параметрами. Конечный результат передаём в функцию `Repo.insert()` и всё готово!

Хоть и будучи сложным для объяснения, мы имеем дело с супер читаемым и супер понятным кодом. Получаем роль, создаём связанного с ней пользователя, подготавливаем его для добавления в базу данных и затем непосредственно добавляем!

В функции **create\_post** мы делаем аналогичные вещи, за исключением того, что вместо пользователя и роли мы работаем с постом и пользователем!

Исправляем тесты

----------------

Начнём с правки файла `test/models/user_test.exs`. Сперва нам нужно добавить `alias Pxblog.TestHelper` в самый верх определения модуля, что позволит использовать удобные хелперы, созданные нами чуть раньше. Затем мы создадим блок **setup** перед тестами, чтобы повторно использовать роль.

```

setup do

{:ok, role} = TestHelper.create_role(%{name: "user", admin: false})

{:ok, role: role}

end

```

А затем в первом же тесте с помощью сопоставления с образцом, мы получим роль из блока **setup**. Давайте сэкономим себе ещё немного времени и напишем функцию-хелпер для получения валидных атрибутов вместе с ролью:

```

defp valid_attrs(role) do

Map.put(@valid_attrs, :role_id, role.id)

end

test "changeset with valid attributes", %{role: role} do

changeset = User.changeset(%User{}, valid_attrs(role))

assert changeset.valid?

end

```

Подведём итог. Мы сопоставляем с образцом ключ **role**, получаемый из блока **setup**, а затем изменяем ключ **valid\_attrs**, чтобы включить валидную роль в наш хелпер! Как только мы изменим этот тест и запустим его снова, то сразу же вернёмся к зелёному состоянию файла `test/models/user_test.exs`.

Теперь откройте файл `test/controllers/user_controller_test.exs`. Для прохождения тестов из него мы воспользуемся теми же самыми уроками. В самый верх добавим инструкцию `alias Pxblog.Role`, а также `alias Pxblog.TestHelper` следом. После чего расположим блок **setup**, в котором создаётся роль и возвращается объект **conn**:

```

setup do

{:ok, user_role} = TestHelper.create_role(%{name: "user", admin: false})

{:ok, admin_role} = TestHelper.create_role(%{name: "admin", admin: true})

{:ok, conn: build_conn(), user_role: user_role, admin_role: admin_role}

end

```

Добавим хелпер **valid\_create\_attrs**, принимающий роль в качестве аргумента, и возвращающий новый словарь валидных атрибутов с добавленным **role\_id**.

```

defp valid_create_attrs(role) do

Map.put(@valid_create_attrs, :role_id, role.id)

end

```

Наконец сделаем так, чтобы действия **create** и **update** использовали этот хелпер, а также сопоставление с образцом значения **user\_role** из нашего словаря.

```

test "creates resource and redirects when data is valid", %{conn: conn, user_role: user_role} do

conn = post conn, user_path(conn, :create), user: valid_create_attrs(user_role)

assert redirected_to(conn) == user_path(conn, :index)

assert Repo.get_by(User, @valid_attrs)

end

test "updates chosen resource and redirects when data is valid", %{conn: conn, user_role: user_role} do

user = Repo.insert! %User{}

conn = put conn, user_path(conn, :update, user), user: valid_create_attrs(user_role)

assert redirected_to(conn) == user_path(conn, :show, user)

assert Repo.get_by(User, @valid_attrs)

end

```

Теперь все тесты контроллера пользователей должны проходить! Тем не менее, запуск `mix test` по-прежнему показывает ошибки.

Исправляем тесты контроллера постов

-----------------------------------

Работу с тестами **PostController** мы завершили на добавлении кучи хелперов, облегчающих создание постов с пользователями. Поэтому теперь нам нужно добавить в них концепцию ролей, чтобы можно было создавать валидных пользователей. Начнём с добавления ссылки на **Pxblog.Role** в самый верх файла `test/controllers/post_controller_test.exs`:

```

alias Pxblog.Role

alias Pxblog.TestHelper

```

Затем создадим блок **setup**, немного отличающийся от того, что мы делали ранее.

```

setup do

{:ok, role} = TestHelper.create_role(%{name: "User Role", admin: false})

{:ok, user} = TestHelper.create_user(role, %{email: "test@test.com", username: "testuser", password: "test", password_confirmation: "test"})

{:ok, post} = TestHelper.create_post(user, %{title: "Test Post", body: "Test Body"})

conn = build_conn() |> login_user(user)

{:ok, conn: conn, user: user, role: role, post: post}

end

```

Первое, что мы здесь сделали — создали стандартную роль без администраторских привелегий. На следующей строчке на основе этой роли мы создали пользователя. Затем для этого пользователя создали пост. Мы уже обсуждали кусок со входом, так что идём дальше. Наконец, мы возвращаем все только что созданные модели, чтобы каждый из тестов с помощью сопоставления с образцом выбрал из них те, что ему нужны.

Нам требуется изменить всего один тест, чтобы всё снова стало зелёным. Тест *“redirects when trying to edit a post for a different user”* падает потому, что пытается создать на лету ещё одного пользователя, ничего не зная о роли. Чуть-чуть поправим его:

```

test "redirects when trying to edit a post for a different user", %{conn: conn, user: user, role: role, post: post} do

{:ok, other_user} = TestHelper.create_user(role, %{email: "test2@test.com", username: "test2", password: "test", password_confirmation: "test"})

conn = get conn, user_post_path(conn, :edit, other_user, post)

assert get_flash(conn, :error) == "You are not authorized to modify that post!"

assert redirected_to(conn) == page_path(conn, :index)

assert conn.halted

end

```

Итак, мы добавили получение роли через сопоставление с образцом в определении теста, а затем немного изменили создание **other\_user**, чтобы и здесь использовался **TestHelper** вместе с полученной ролью.

У нас появилась возможность для рефакторинга благодаря тому, что мы добавили объект **post** из **TestHelper** в качестве одного из значений, которые можно получить с помощью сопоставления с образцом. Поэтому мы можем изменить все вызовы **build\_post** на объект **post**, полученный таким образом. После всех изменений файл должен выглядеть следующим образом:

```

defmodule Pxblog.PostControllerTest do

use Pxblog.ConnCase

alias Pxblog.Post

alias Pxblog.TestHelper

@valid_attrs %{body: "some content", title: "some content"}

@invalid_attrs %{}

setup do

{:ok, role} = TestHelper.create_role(%{name: "User Role", admin: false})

{:ok, user} = TestHelper.create_user(role, %{email: "test@test.com", username: "testuser", password: "test", password_confirmation: "test"})

{:ok, post} = TestHelper.create_post(user, %{title: "Test Post", body: "Test Body"})

conn = build_conn() |> login_user(user)

{:ok, conn: conn, user: user, role: role, post: post}

end

defp login_user(conn, user) do

post conn, session_path(conn, :create), user: %{username: user.username, password: user.password}

end

test "lists all entries on index", %{conn: conn, user: user} do

conn = get conn, user_post_path(conn, :index, user)

assert html_response(conn, 200) =~ "Listing posts"

end

test "renders form for new resources", %{conn: conn, user: user} do

conn = get conn, user_post_path(conn, :new, user)

assert html_response(conn, 200) =~ "New post"

end

test "creates resource and redirects when data is valid", %{conn: conn, user: user} do

conn = post conn, user_post_path(conn, :create, user), post: @valid_attrs

assert redirected_to(conn) == user_post_path(conn, :index, user)

assert Repo.get_by(assoc(user, :posts), @valid_attrs)

end

test "does not create resource and renders errors when data is invalid", %{conn: conn, user: user} do

conn = post conn, user_post_path(conn, :create, user), post: @invalid_attrs

assert html_response(conn, 200) =~ "New post"

end

test "shows chosen resource", %{conn: conn, user: user, post: post} do

conn = get conn, user_post_path(conn, :show, user, post)

assert html_response(conn, 200) =~ "Show post"

end

test "renders page not found when id is nonexistent", %{conn: conn, user: user} do

assert_error_sent 404, fn ->

get conn, user_post_path(conn, :show, user, -1)

end

end

test "renders form for editing chosen resource", %{conn: conn, user: user, post: post} do

conn = get conn, user_post_path(conn, :edit, user, post)

assert html_response(conn, 200) =~ "Edit post"

end

test "updates chosen resource and redirects when data is valid", %{conn: conn, user: user, post: post} do

conn = put conn, user_post_path(conn, :update, user, post), post: @valid_attrs

assert redirected_to(conn) == user_post_path(conn, :show, user, post)

assert Repo.get_by(Post, @valid_attrs)

end

test "does not update chosen resource and renders errors when data is invalid", %{conn: conn, user: user, post: post} do

conn = put conn, user_post_path(conn, :update, user, post), post: %{"body" => nil}

assert html_response(conn, 200) =~ "Edit post"

end

test "deletes chosen resource", %{conn: conn, user: user, post: post} do

conn = delete conn, user_post_path(conn, :delete, user, post)

assert redirected_to(conn) == user_post_path(conn, :index, user)

refute Repo.get(Post, post.id)

end

test "redirects when the specified user does not exist", %{conn: conn} do

conn = get conn, user_post_path(conn, :index, -1)

assert get_flash(conn, :error) == "Invalid user!"

assert redirected_to(conn) == page_path(conn, :index)

assert conn.halted

end

test "redirects when trying to edit a post for a different user", %{conn: conn, role: role, post: post} do

{:ok, other_user} = TestHelper.create_user(role, %{email: "test2@test.com", username: "test2", password: "test", password_confirmation: "test"})

conn = get conn, user_post_path(conn, :edit, other_user, post)

assert get_flash(conn, :error) == "You are not authorized to modify that post!"

assert redirected_to(conn) == page_path(conn, :index)

assert conn.halted

end

end

```

Исравляем тесты для Session Controller

--------------------------------------

Некоторые тесты из файла `test/controllers/session_controller_test.exs` не проходят из-за того, что мы не сказали им начать использовать наш **TestHelper**. Как и раньше добавим алиасы наверх файла и изменим блок **setup**:

```

defmodule Pxblog.SessionControllerTest do

use Pxblog.ConnCase

alias Pxblog.User

alias Pxblog.TestHelper

setup do

{:ok, role} = TestHelper.create_role(%{name: "user", admin: false})

{:ok, _user} = TestHelper.create_user(role, %{username: "test", password: "test", password_confirmation: "test", email: "test@test.com"})

{:ok, conn: build_conn()}

end

```

Этого должно быть достаточно, чтобы тесты начали проходить! Ура!

Исправляем оставшиеся тесты

---------------------------

У нас по-прежнему есть два сломанных теста. Так сделаем же их зелёными!

```

1) test current user returns the user in the session (Pxblog.LayoutViewTest)

test/views/layout_view_test.exs:13

Expected truthy, got nil

code: LayoutView.current_user(conn)

stacktrace:

test/views/layout_view_test.exs:15

2) test current user returns nothing if there is no user in the session (Pxblog.LayoutViewTest)

test/views/layout_view_test.exs:18

** (ArgumentError) cannot convert nil to param

stacktrace:

(phoenix) lib/phoenix/param.ex:67: Phoenix.Param.Atom.to_param/1

(pxblog) web/router.ex:1: Pxblog.Router.Helpers.session_path/4

test/views/layout_view_test.exs:20

```

В самом верху файла `test/views/layout_view_test.exs` можно увидеть как создаётся пользователь без роли! В блоке **setup** мы также не возвращаем этого пользователя, что и приводит к таким печальным последствиям! Ужас! Так что давайте скорее отрефакторим весь файл:

```

defmodule Pxblog.LayoutViewTest do

use Pxblog.ConnCase, async: true

alias Pxblog.LayoutView

alias Pxblog.TestHelper

setup do

{:ok, role} = TestHelper.create_role(%{name: "User Role", admin: false})

{:ok, user} = TestHelper.create_user(role, %{email: "test@test.com", username: "testuser", password: "test", password_confirmation: "test"})

{:ok, conn: build_conn(), user: user}

end

test "current user returns the user in the session", %{conn: conn, user: user} do

conn = post conn, session_path(conn, :create), user: %{username: user.username, password: user.password}

assert LayoutView.current_user(conn)

end

test "current user returns nothing if there is no user in the session", %{conn: conn, user: user} do

conn = delete conn, session_path(conn, :delete, user)

refute LayoutView.current_user(conn)

end

end

```

Здесь мы добавляем алиас для модели **Role**, создаём валидную роль, создаём валидного пользователя с этой ролью и затем возвращаем получившегося пользователя с объектом **conn**. И в конце концов в обеих тестовых функциях мы получаем пользователя с помощью сопоставления с образцом. Теперь запускаем `mix test` и…

Все тесты зелёные! Но мы получили несколько предупреждений (т.к. слишком перестарались с заботой о чистом коде).

```

test/controllers/post_controller_test.exs:20: warning: function create_user/0 is unused

test/views/layout_view_test.exs:6: warning: unused alias Role

test/views/layout_view_test.exs:5: warning: unused alias User

test/controllers/user_controller_test.exs:5: warning: unused alias Role

test/controllers/post_controller_test.exs:102: warning: variable user is unused

test/controllers/post_controller_test.exs:6: warning: unused alias Role

```

Для исправления просто зайдите в каждый из этих файлов и удалите проблемные алиасы и функции, т.к. они нам больше не нужны!

```

$ mix test

```

Вывод:

```

.........................................

Finished in 0.4 seconds

41 tests, 0 failures

Randomized with seed 588307

```

Создаём начальные данные администратора

---------------------------------------

В конечном счёте нам нужно позволить создавать новых пользователей только администратору. Но тем самым это означает, что возникнет ситуация, при которой изначально мы не сможем создать ни пользователей, ни администраторов. Вылечим этот недуг с помощью добавления начальных данных (*seed data*) для администратора по умолчанию. Для этого откроем файл `priv/repo/seeds.exs` и вставим в него следующий код:

```

alias Pxblog.Repo

alias Pxblog.Role

alias Pxblog.User

role = %Role{}

|> Role.changeset(%{name: "Admin Role", admin: true})

|> Repo.insert!

admin = %User{}

|> User.changeset(%{username: "admin", email: "admin@test.com", password: "test", password_confirmation: "test", role_id: role.id})

|> Repo.insert!

```

И затем загрузим наши сиды с помощью выполнения следующей команды:

```

$ mix run priv/repo/seeds.exs

```

Что будет дальше

----------------

Теперь, когда наши модели настроены и готовы взаимодействовать с ролям, а все тесты снова зелёные, нам нужно начать добавлять контроллерам функционал для ограничения определённых операций, если у пользователя нет прав для их исполнения. В следующем посте мы рассмотрим как лучше всего реализовать этот функционал, как добавить модуль-хелпер, и конечно же, как удержать тесты зелёными.

Другие статьи серии

-------------------

1. [Вступление](https://habrahabr.ru/post/311088/)

2. [Авторизация](https://habrahabr.ru/post/313482/)

3. Добавляем роли

4. [Обрабатываем роли в контроллерах](https://habrahabr.ru/post/316368/)

5. [Подключаем ExMachina](https://habrahabr.ru/post/316996/)

6. [Поддержка Markdown](https://habrahabr.ru/post/317550/)

7. [Добавляем комментарии](https://habrahabr.ru/post/318790/)

8. [Заканчиваем с комментариями](https://habrahabr.ru/post/323462/)

9. [Каналы](https://habrahabr.ru/post/332094/)

10. [Тестирование каналов](https://habrahabr.ru/post/333020/)

11. [Заключение](https://habrahabr.ru/post/335048/)

Заключение от Вуншей

--------------------

У нас сразу две отличные новости! Во-первых, нас становится больше, и благодаря этому **все подписчики уже завтра получат на почту новую статью** (*которая не относится к данному циклу*) о том, чем Эликсир притягивает разработчиков и благодаря чему их удерживает. Так что, если вы ещё не подписались, то не теряйте времени и [скорее делайте это](http://wunsh.ru)!

Во-вторых, мы решили **разыграть супер-полезный подарок — книгу Dave Thomas *«Programming Elixir»***. Великолепное введение в язык (*и далеко не только для новичков*) от гуру обучающей литературы по программированию Дэйва Томаса. Для того, чтобы заполучить её, вам необходимо опубликовать пост на Хабрахабре на тему языка Elixir и указать, что статья опубликована специально для конкурса от Wunsh.ru. Победителем станет человек, чья статья наберёт наибольший рейтинг. [Подробные условия читайте по ссылке](http://wunsh.ru/first_contest.html?utm_source=habr&utm_medium=content&utm_campaign=first_contest).

Другие части:

1. [Вступление](https://habrahabr.ru/post/311088/)

2. [Авторизация](https://habrahabr.ru/post/313482/)

3. Добавление ролей

4. Скоро...

Успехов в изучении, оставайтесь с нами! | https://habr.com/ru/post/315252/ | null | ru | null |

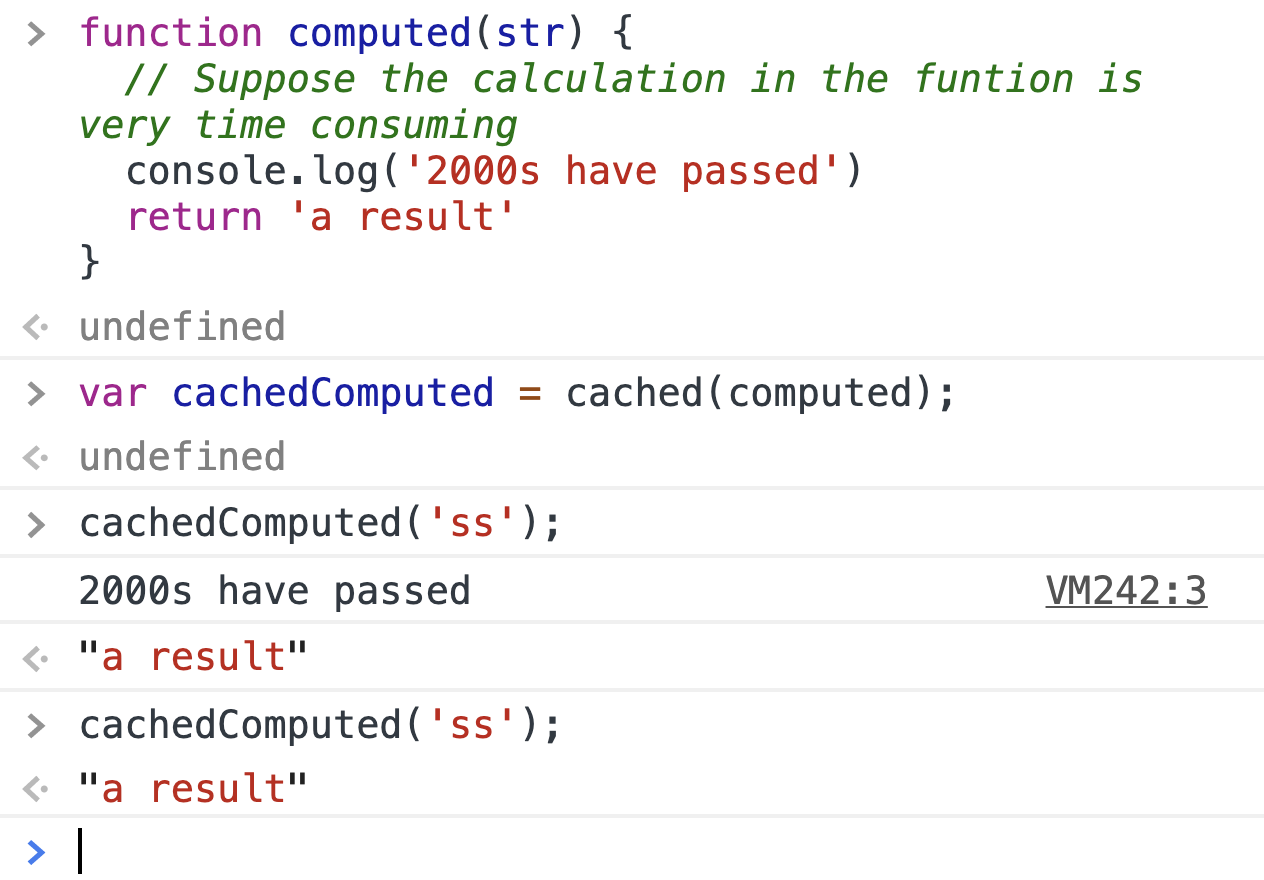

# Делись, рыбка, быстро и нацело

Деление — одна из самых дорогих операций в современных процессорах. За доказательством далеко ходить не нужно: Agner Fog[[1](https://www.agner.org/optimize/instruction_tables.pdf)] вещает, что на процессорах Intel / AMD мы легко можем получить Latency в 25-119 clock cycles, а reciprocal throughput — 25-120. В переводе на Русский — МЕДЛЕННО! Тем не менее, возможность избежать инструкции деления в вашем коде — есть. И в этой статье, я расскажу как это работает, в частности в современных компиляторах(они то, умеют так уже лет 20 как), а также, расскажу как полученное знание можно использовать для того чтобы сделать код лучше, быстрее, мощнее.

Собственно, я о чем: если делитель известен на этапе компиляции, есть возможность заменить целочисленное деление умножением и логическим сдвигом вправо (а иногда, можно обойтись и без него вовсе — я конечно про реализацию в Языке Программирования). Звучит весьма обнадеживающе: операция целочисленного умножения и сдвиг вправо на, например, Intel Haswell займут не более 5 clock cycles. Осталось лишь понять, как, например, выполняя целочисленное деление на 10, получить тот же результат целочисленным умножением и логическим сдвигом вправо? Ответ на этот вопрос лежит через понимание… Fixed Point Arithmetic (далее FPA). Чуть-чуть основ.

При использовании FP, экспоненту (показатель степени 2 => положение точки в двоичном представлении числа) в числе не сохраняют (в отличие от арифметики с плавающей запятой, см. IEE754), а полагают ее некой оговоренной, известной программистам величиной. Сохраняют же, только мантиссу (то, что идёт после запятой). Пример:

*0.1 — в двоичной записи имеет 'бесконечное представление', что в примере выше отмечено круглыми скобками — именно эта часть будет повторяться от раза к разу, следуя друг за другом в двоичной FP записи числа 0.1.*

В примере выше, если мы используем для хранения FP чисел 16-битные регистры, мы не сможем уместить FP представление числа 0.1 в такой регистр не потеряв в точности, а это в свою очередь скажется на результате всех дальнейших вычислений в которых значение этого регистра участвует.

Пусть дано 16-битное целое число A и 16-битная Fraction часть числа B. Произведение A на B результатом дает число с 16 битами в целой части и 16-тью битами в дробной части. Чтобы получить только целую часть, очевидно, нужно сдвинуть результат на 16 бит вправо.

Поздравляю, вводная часть в FPA окончена.

Формируем следующую гипотезу: для выполнения целочисленного деления на 10, нам нужно выполнить умножение Числа Делимого на FP представление числа 0.1, взять целую часть и дело в шля… минуточку… А будет ли полученный результат точным, точнее его целая часть? — Ведь, как мы помним, в памяти у нас хранится лишь приближенная версия числа 0.1. Ниже я выписал три различных представления числа 0.1: бесконечно точное представление числа 0.1, обрезанное после 16-ого бита без округления представление числа 0.1 и обрезанное после 16 ого бита с округлением вверх представление числа 0.1.

Оценим погрешности truncating представлений числа 0.1:

Чтобы результат умножения целого числа A, на Аппроксимацию числа 0.1 давал точную целую часть, нам нужно чтобы:

, либо

Удобнее использовать первое выражение: при  мы всегда получим тождество (но, заметь, не все решения, что в рамках данной задачи — более чем достаточно). Решая, получаем . То есть, умножая любое 14-битное число A на truncating with rounding up представление числа 0.1, мы всегда получим точную целую часть, которую бы получили умножая бесконечно точно 0.1 на A. Но, по условию у нас умножается 16-битные число, а значит, в нашем случае ответ будет неточным и довериться простому умножению на truncating with rounding up 0.1 мы не можем. Вот если бы мы могли сохранить в FP представлении числа 0.1 не 16 бит, а, скажем 19, 20 — то все было бы ОК. И ведь можем же!

Внимательно смотрим на двоичное представление — truncating with rounding up 0.1: старшие три бита — нулевые, а значит, и никакого вклада в результат умножения не вносят (новых бит).

Следовательно, мы можем сдвинуть наше число влево на три бита, выполнить округление вверх и, выполнив умножение и логический сдвиг вправо сначала на 16, а затем на 3 (то есть, за один раз на 19 вообще говоря) — получим нужную, точную целую часть. Доказательство корректности такого '19' битного умножения аналогично предыдущему, с той лишь разницей, что для 16-битных чисел оно работает правильно. Аналогичные рассуждения верны и для чисел большей разрядности, да и не только для деления на 10.

Ранее я писал, что вообще говоря, можно обойтись и без какого-либо сдвига вовсе, ограничившись лишь умножением. Как? Ассемблер x86 / x64 на барабане:

В современных процессорах, есть команда MUL (есть еще аналоги IMUL, MULX — BMI2), которая принимая один, скажем 32 / 64 -битный параметр, способна выполнять 64 / 128 битное умножение, сохраняя результат частями в два регистра (старшие 32 / 64 бита и младшие, соответственно):

```

MUL RCX ; умножить RCX на RAX, а результат (128 бит) сохранить в RDX:RAX

```

В регистре RCX пусть хранится некое целое 62-битное A, а в регистре RAX пускай хранится 64 битное FA представление truncating with rounding up числа 0.1 (заметь, никаких сдвигов влево нету). Выполнив 64-битное умножение получим, что в регистре RDX сохранятся старшие 64 бита результата, или, точнее говоря — целая часть, которая для 62 битных чисел, будет точной. То есть, сдвиг вправо (SHR, SHRX) не нужен. Наличие же такого сдвига нагружает Pipeline процессора, вне зависимости поддерживает ли он OOOE или нет: как минимум появляется лишняя зависимость в, скорее всего и без того длинной цепочке таких зависимостей (aka Dependency Chain). И вот тут, очень важно упомянуть о том, что современные компиляторы, видя выражение вида some\_integer / 10 — автоматически генерируют ассемблерный код для всего диапазона чисел Делимого. То есть, если вам известно что числа у вас всегда 53-ех битные (в моей задаче именно так и было), то лишнюю инструкцию сдвига вы получите все равно. Но, теперь, когда вы понимаете как это работает, можете сами с легкостью заменить деление — умножением, не полагаясь на милость компилятору. К слову сказать, получение старших битов 64 битного произведения в C++ коде реализуется интринсиком (something like mulh), что по Asm коду, должно быть равносильно строчкам инструкции {I}MUL{X} выше.

Возможно, с появлением контрактов (в С++ 20 не ждем) ситуация улучшится, и в каких-то кейсах, мы сможем довериться машине! Хотя, это же С++, тут за все отвечает программист — не иначе.

Рассуждения описанные выше — применимы к любым делителям константам, ну а ниже список полезных ссылок:

[[1] https://www.agner.org/optimize/instruction\_tables.pdf](https://www.agner.org/optimize/instruction_tables.pdf)

[[2] Круче чем Агнер Фог](https://uops.info/table.html)

[[3] Телеграмм канал, с полезной информацией о оптимизациях под Intel / AMD / ARM](http://t.me/pro_optimise)

[[4] Про деление нацело, но по Английски](https://homepage.divms.uiowa.edu/~jones/bcd/divide.html) | https://habr.com/ru/post/468581/ | null | ru | null |

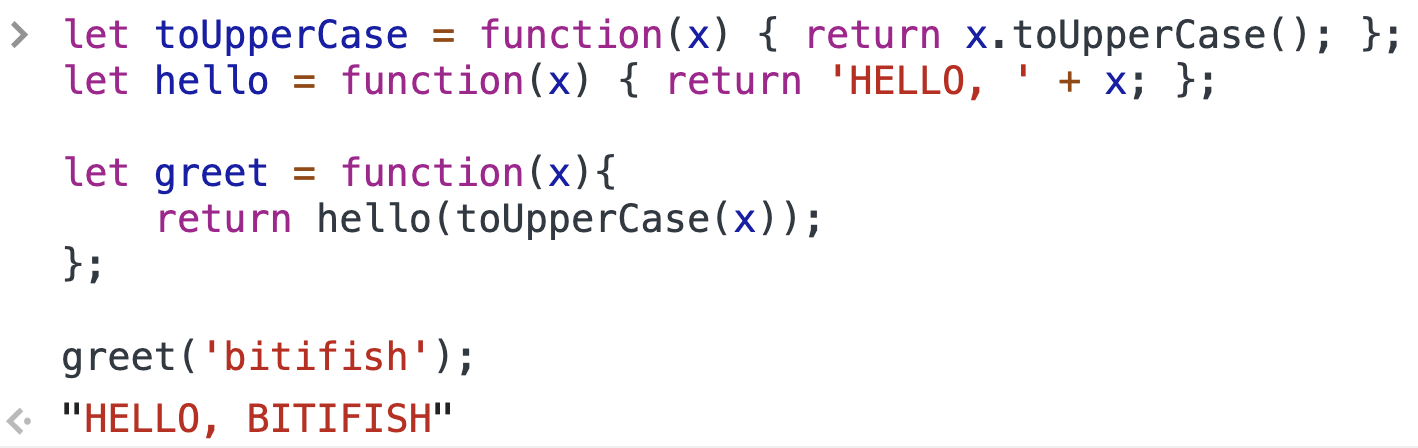

# Объекты в PHP 7

На сегодняшний день разработчики PHP ведут работу над API уровня С. И в этом посте я буду по большей части рассказывать о внутренней разработке PHP, хотя если по ходу повествования встретится что-то интересное с точки зрения пользовательского уровня, то я буду делать отступление и объяснять.

Изменения в объектах по сравнению с PHP 5

=========================================

Чтобы полностью вникнуть в тему объектов в PHP, рекомендую сначала ознакомиться с постом [Подробно об объектах и классах в PHP](https://habrahabr.ru/company/mailru/blog/255237/).

Итак, что же изменилось в седьмой версии по сравнению с пятой?

* На пользовательском уровне почти ничего не изменилось. Иными словами, в PHP 7 объекты остались такими же, как и в PHP 5. Не было сделано каких-то глубоких изменений, ничего такого, что вы могли бы заметить в своей повседневной работе. Объекты ведут себя точно так же. Почему ничего не было изменено? Мы считаем, что наша объектная модель является зрелой, она очень активно используется, и мы не видим нужды вносить смуту в новых версиях PHP.

* Но всё же было несколько низкоуровневых улучшений. Изменения небольшие, тем не менее они требуют патчей расширений. В принципе, в PHP 7 внутренние объекты стали гораздо выразительнее, яснее и логичнее, чем в PHP 5. Самое главное нововведение связано с основным изменением в PHP 7: обновлением zval и управлением сборкой мусора. Но в этом посте мы не будем рассматривать последний, потому что тема поста — объекты. Однако нужно помнить, что сама природа новых zval и механизма сборки мусора оказывает влияние на внутреннее управление объектами.

Структура объекта и управление памятью

======================================

В первую очередь можете попрощаться с `zend_object_value`, от этой структуры в PHP 7 отказались.

Давайте посмотрим пример определения объекта zend\_object:

```

/* in PHP 5 */

typedef struct _zend_object {

zend_class_entry *ce;

HashTable *properties;

zval **properties_table;

HashTable *guards;

} zend_object;

/* in PHP 7 */

struct _zend_object {

zend_refcounted_h gc;

uint32_t handle;

zend_class_entry *ce;

const zend_object_handlers *handlers;

HashTable *properties;

zval properties_table[1]; /* C struct hack */

};

```

Как видите, есть небольшие отличия от PHP 5.

Во-первых, здесь содержится заголовок `zend_refcounted_h`, являющийся частью нового zval и механизма сборки мусора.

Во-вторых, теперь объект содержит свой `handle`, в то время как в PHP 5 эту задачу выполнял `zend_object_store`. А в PHP 7 у объектного хранилища (object store) уже гораздо меньше обязанностей.

В-третьих, для замещения `properties_table` вектора zval используется структурный хак на языке С, он пригодится при создании кастомных объектов.

Управление кастомными объектами

===============================

Важное изменение коснулось управления кастомными объектами, которые мы создаём для своих нужд. Теперь они включают в себя `zend_object`. Это очень важная особенность объектной модели Zend Engine: расширения могут объявлять свои собственные объекты и управлять ими, развивая возможности стандартной реализации объектов в Zend без изменения исходного кода движка.

В PHP 5 мы просто создаём наследование в виде С-структуры, включающей базовое определение `zend_object`:

```

/* PHP 5 */

typedef struct _my_own_object {

zend_object zobj;

my_custom_type *my_buffer;

} my_own_object;

```

Благодаря наследованию С-структуры нам достаточно создать простую конструкцию:

```

/* PHP 5 */

my_own_object *my_obj;

zend_object *zobj;

my_obj = (my_own_object *)zend_objects_store_get_object(this_zval);

zobj = (zend_object *)my_obj;

```

Вы могли заметить, что при получении zval в PHP 5, например $this в методах ОО, вы не можете изнутри этого zval получить доступ к объекту, на который он прямо указывает. Для этого вам придётся обратиться к объектному хранилищу. Извлечь обработчик из zval (в PHP 5) и с его помощью попросить хранилище вернуть найденный объект. Этот объект — он может быть кастомным — возвращается в виде `void*`. Если вы ничего не кастомизировали, то его нужно представить в виде `zend_object*`, в противном случае — в виде `my_own_object*`.

Короче, чтобы получить от метода объект, в PHP 5 вам нужно осуществить процедуру поиска. А это не слишком хорошо сказывается на производительности.

В PHP 7 всё устроено иначе. Объект — неважно, кастомный или классический `zend_object`, — хранится прямо в zval. При этом **объектное хранилище больше не поддерживает операцию извлечения**. То есть вы не можете больше считывать содержимое объектного хранилища, только записывать в него или стирать.

**Размещённый объект целиком встроен в zval**, так что если вы вызываете zval в качестве параметра и хотите получить область памяти объекта, на которую он указывает, то вам не нужно будет дополнительно осуществлять поиск. Вот как в PHP 7 можно получить объект:

```

/* PHP 7 */

zend_object *zobj;

zobj = Z_OBJ_P(this_zval);

```

Гораздо проще, чем в PHP 5, не так ли?

Иначе теперь устроена работа с кастомным размещением объектов. Из приведённого выше кода видно, что единственный способ получения кастомного объекта заключается в манипуляции с памятью: переместить указатель в любом нужном направлении в рамках необходимого объёма памяти. Чистое программирование на С и высокая производительность: вы наверняка останетесь в той же физической странице памяти, и, следовательно, ядро не будет подгружать новую страницу.

Объявление кастомного объекта в PHP 7:

```

/* PHP 7 */

typedef struct _my_own_object {

my_custom_type *my_buffer;

zend_object zobj;

} my_own_object;

```

Обратите внимание на перестановку компонентов структуры по сравнению с PHP 5. Для чего это сделано? Когда вы считываете `zend_object` из zval, то для получения своего `my_own_object` вам придётся брать память в обратном направлении, вычитая смещение (offset) `zend_object`’а в структуре. Делается это с помощью `OffsetOf()` из [stddef.h](https://ru.wikipedia.org/wiki/Stddef.h) (при необходимости можно легко эмулировать). Это считается использованием продвинутой С-структуры, но если вы хорошо знаете используемый вами язык (а по-другому и быть не должно), то вам наверняка уже приходилось выполнять подобное.

Для получения кастомного объекта в PHP 7 нужно сделать так:

```

/* PHP 7 */

zend_object *zobj;

my_own_object *my_obj;

zobj = Z_OBJ_P(this_zval);

my_obj = (my_own_object *)((char *)zobj - XoffsetOf(struct my_own_object, zobj));

```

Здесь некоторую путаницу вносит использование `offsetof()`: **последним компонентом объекта `your_custom_struct` должен быть `zend_object`**. Очевидно, что если вы после этого объявите типы, то из-за особенностей организации размещения `zend_object` в PHP 7 впоследствии у вас будут затруднения с доступом к этим типам.

Не забывайте, что в PHP 7 `zend_object` теперь использует структурный хак. Это означает, что выделенная память будет отличаться от `sizeof(zend_object)`. Размещение `zend_object`:

```

/* PHP 5 */

zend_object *zobj;

zobj = ecalloc(1, sizeof(zend_object));

/* PHP 7 */

zend_object *zobj;

zobj = ecalloc(1, sizeof(zend_object) + zend_object_properties_size(ce));

```

Поскольку ваш класс знает всё об объявленных атрибутах, то он определяет размер памяти, которую вы должны выделить для компонентов.

Создание объекта

================

Рассмотрим реальный пример. Пусть у нас есть кастомный объект:

```

/* PHP 7 */

typedef struct _my_own_object {

void *my_custom_buffer;

zend_object zobj; /* MUST be the last element */

} my_own_object;

```

Так может выглядеть его обработчик `create_object()`:

```

/* PHP 7 */

static zend_object *my_create_object(zend_class_entry *ce)

{

my_own_object *my_obj;

my_obj = ecalloc(1, sizeof(my_obj) + zend_object_properties_size(ce));

my_obj->my_custom_buffer = emalloc(512); /* Допустим, наш кастомный буфер уместится в 512 байт */

zend_object_std_init(&my_obj->zobj, ce); /* Не забудьте также и про zend_object! */

object_properties_init(&my_obj->zobj, ce);

my_obj->zobj.handlers = &my_class_handlers; /* У меня используется кастомный обработчик, о нём речь пойдёт дальше */

return &my_obj->zobj;

}

```

В отличие от PHP 5, здесь нельзя забывать об объёме выделяемой памяти: помните о структурном хаке, замещающем свойства `zend_object`. Кроме того, здесь больше не используется объектное хранилище. В PHP 5 обработчик создания объекта должен был зарегистрировать его в хранилище, а затем передать некоторые указатели функций для будущего уничтожения и освобождения объекта. В PHP 7 этого больше не нужно делать, функция `create_object()` работает гораздо яснее.

Для использования этого кастомного обработчика `create_object()` нужно объявить его в вашем расширении. Таким образом вы будете объявлять каждый обработчик:

```

/* PHP 7 */

zend_class_entry *my_ce;

zend_object_handlers my_ce_handlers;

PHP_MINIT_FUNCTION(my_extension)

{

zend_class_entry ce;

INIT_CLASS_ENTRY(ce, "MyCustomClass", NULL);

my_ce = zend_register_internal_class(&ce);

my_ce->create_object = my_create_object; /* Обработчик создания объекта */

memcpy(&my_ce_handlers, zend_get_std_object_handlers(), sizeof(my_ce_handlers));

my_ce_handlers.free_obj = my_free_object; /* Обработчик free */

my_ce_handlers.dtor_obj = my_destroy_object; /* Обработчик dtor */

/* Также доступен my_ce_handlers.clone_obj, хотя здесь мы его не будем использовать */

my_ce_handlers.offset = XtOffsetOf(my_own_object, zobj); /* Здесь мы объявляем смещение для движка */

return SUCCESS;

}

```

Как видите, в MINIT мы объявляем `free_obj()` и `dtor_obj()`. В PHP 5 при регистрации объекта в хранилище их оба нужно объявлять в `zend_objects_store_put()`, но **в PHP 7 в этом больше нет необходимости**. Теперь `zend_object_std_init()` сам запишет объект в хранилище, не нужно это делать вручную, так что не забудьте про этот вызов.

Итак, мы зарегистрировали наши обработчики `free_obj()` и `dtor_obj()`, а также компонент offset, используемый при вычислении расположения нашего кастомного объекта в памяти. **Эта информация нужна движку, потому что теперь именно он занимается освобождением объектов, а не вы**. В PHP 5 это приходилось делать вручную, обычно с помощью `free()`. А раз теперь это делает движок, то для освобождения всего указателя ему нужно получить не только типы `zend_object`, но и значение `offset` для вашей кастомной структуры. Пример можно посмотреть [здесь](http://lxr.php.net/xref/PHP_7_0/Zend/zend_objects_API.c#189).

Уничтожение объекта

===================

Хочу напомнить, что деструктор вызывается при уничтожении объекта на пользовательском уровне PHP, точно так же, как вызывается `__destruct()`. Так что в случае критических ошибок деструктор может вообще не вызваться, и в PHP 7 эта ситуация не изменилась. Если вы внимательно изучили пост, о котором говорилось в начале, или [эту презентацию](http://fr.slideshare.net/jpauli/understanding-php-objects), то, скорее всего, помните, что деструктор не должен оставлять объект в нестабильном состоянии, поскольку однажды уничтоженный объект должен быть доступен в определённых ситуациях. Поэтому в PHP обработчики уничтожения и освобождения объекта отделены друг от друга. Обработчик освобождения вызывается, когда движок полностью уверен в том, что объект больше нигде не применяется. Деструктор вызывается, когда refcount объекта достигает 0, но поскольку может быть выполнен какой-то пользовательский код (`__destruct()`), то текущий объект нигде не может быть переиспользован в качестве ссылки, а значит, он должен оставаться в нестабильном состоянии. Поэтому будьте очень внимательны, если освобождаете память с помощью деструктора. Обычно деструктор прекращает использование ресурсов, но не освобождает их. Этим уже занимается обработчик освобождения.

Итак, подведём итоги относительно работы деструктора:

* Он либо не вызывается совсем, **либо** вызывается один раз (чаще всего), но никогда больше одного раза. В случае критической ошибки деструктор не вызывается.

* Деструктор не освобождает ресурсы, поскольку в некоторых редких случаях объект **может быть** переиспользован движком.

* Если из своего кастомного деструктора вы не вызываете `zend_objects_destroy_object()`, то пользовательский `__destruct()` не будет инициирован.

```

/* PHP 7 */

static void my_destroy_object(zend_object *object)

{

my_own_object *my_obj;

my_obj = (my_own_object *)((char *)object - XoffsetOf(my_own_object, zobj));

/* Теперь мы можем что-нибудь сделать с my_obj->my_custom_buffer, например отправить его в сокет, или сбросить в файл, или ещё что-то. Но здесь он не освобождается. */

zend_objects_destroy_object(object); /* Вызов __destruct() на пользовательском уровне */

}

```

Освобождение объектного хранилища

=================================

Функция освобождения хранилища инициируется движком, когда он абсолютно уверен, что объект больше нигде не используется. Перед самым уничтожением объекта движок вызывает обработчик `free_obj()`. Вы разместили какие-то ресурсы в своём кастомном обработчике `create_object()`? Пришла пора их освобождать:

```

/* PHP 7 */

static void my_free_object(zend_object *object)

{

my_own_object *my_obj;

my_obj = (my_own_object *)((char *)object - XoffsetOf(my_own_object, zobj));

efree(my_obj->my_custom_buffer); /* Освобождение кастомных ресурсов */

zend_object_std_dtor(object); /* Вызов обработчика освобождения, который освободит свойства объекта */

}

```

И всё. Вам больше не нужно заниматься освобождением самостоятельно, как в PHP 5. Раньше обработчик заканчивался чем-то вроде `free(object)`; теперь в обработчике `create_object()` выделяется место для вашей кастомной объектной структуры, но, когда в MINIT вы передаёте движку значение `offset`, тот получает возможность самостоятельно провести освобождение. Например, как [здесь](http://lxr.php.net/xref/PHP_7_0/Zend/zend_objects_API.c#189).

Конечно, во многих случаях обработчик `free_obj()` вызывается сразу же после обработчика `dtor_obj()`. Исключение составляют ситуации, когда пользовательский деструктор передаёт кому-то $this либо в случае с объектом кастомного расширения, которое плохо спроектировано. Если вас интересует полная последовательность кода при освобождении объекта движком, почитайте о [`zend_object_store_del()`](http://lxr.php.net/xref/PHP_7_0/Zend/zend_objects_API.c#147).

Заключение

==========

Мы рассмотрели, как в PHP 7 изменилась работа с объектами. На пользовательском уровне всё осталось практически без изменений, только объектная модель была оптимизирована: стала работать быстрее и имеет чуть больше возможностей. Но никаких значимых нововведений нет.

А вот «под капотом» перемен гораздо больше. Они тоже не слишком большие и не потребуют от вас многих часов изучения, но всё же понадобится приложить определённые усилия. Обе объектные модели стали несовместимы на низком уровне, поэтому вам придётся переписать ту часть исходного кода своих расширений, которая относится к объектам. В этом посте я попытался объяснить разницу. Если в разработке вы перейдёте на PHP 7, то заметите, что он стал яснее и структурированнее по сравнению с PHP 5. Новая версия освободилась от тяжёлого десятилетнего наследия. Многие вещи в PHP 7 улучшены и переделаны, чтобы избавиться от необходимости патчей кода в ряде случаев. | https://habr.com/ru/post/275497/ | null | ru | null |

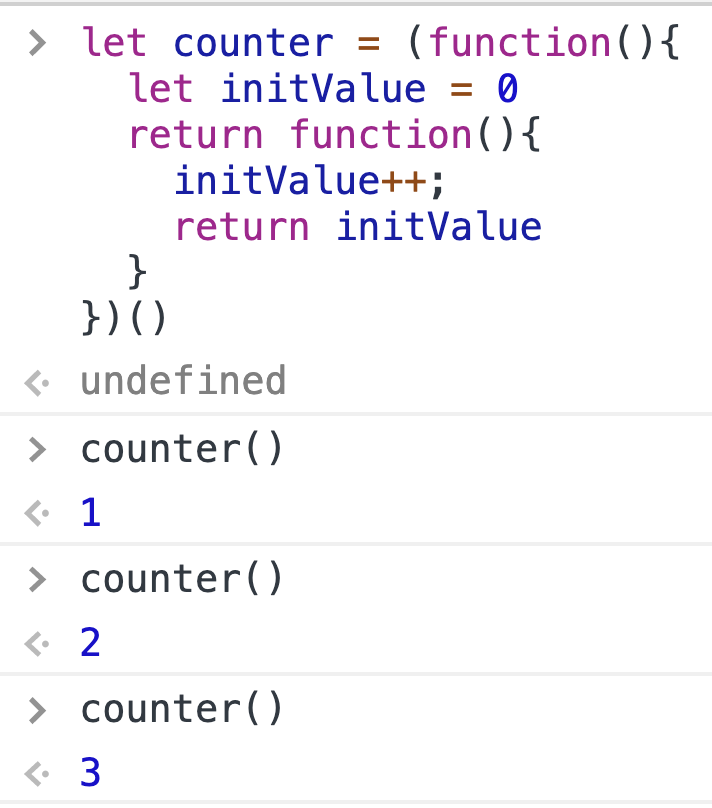

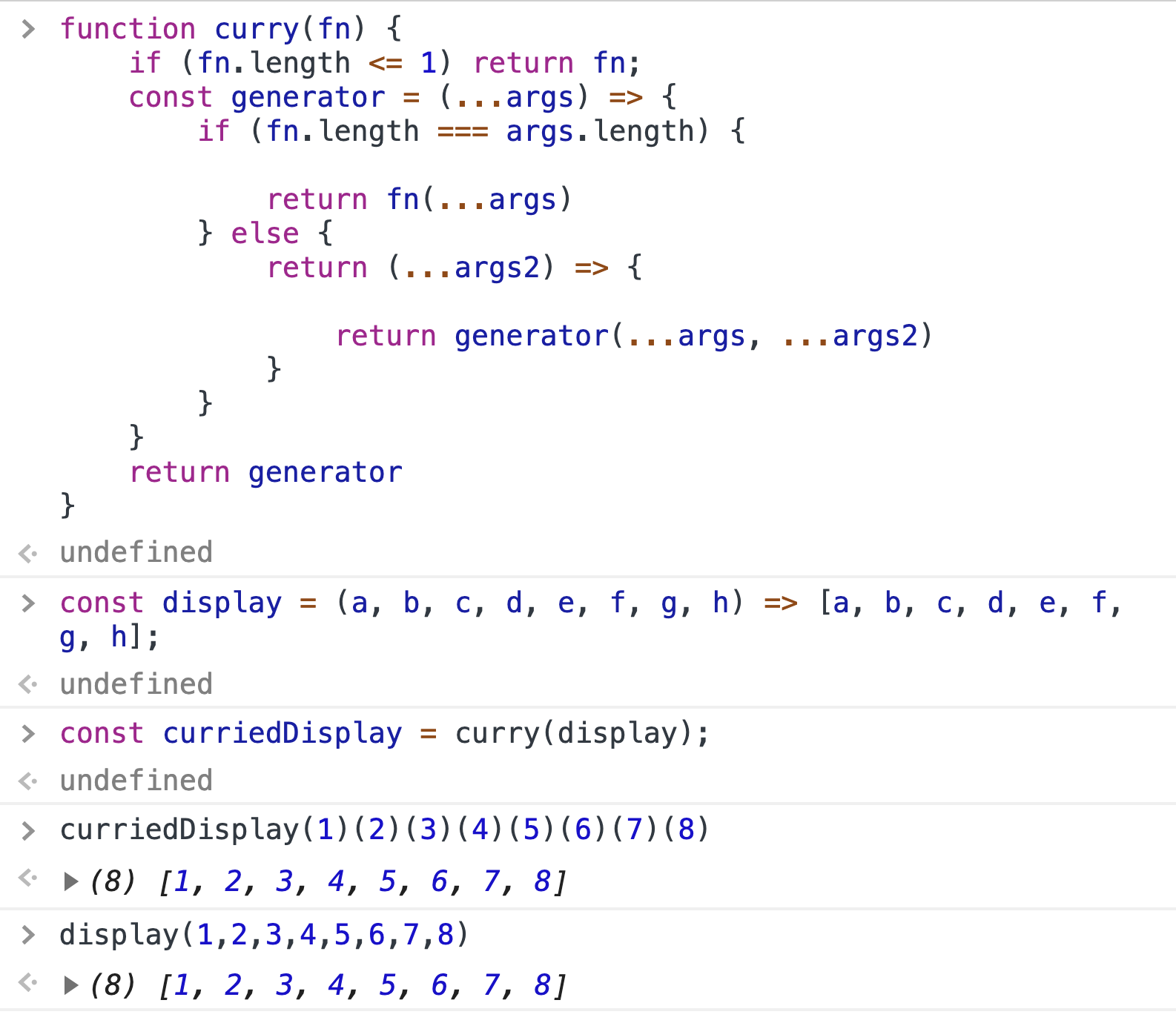

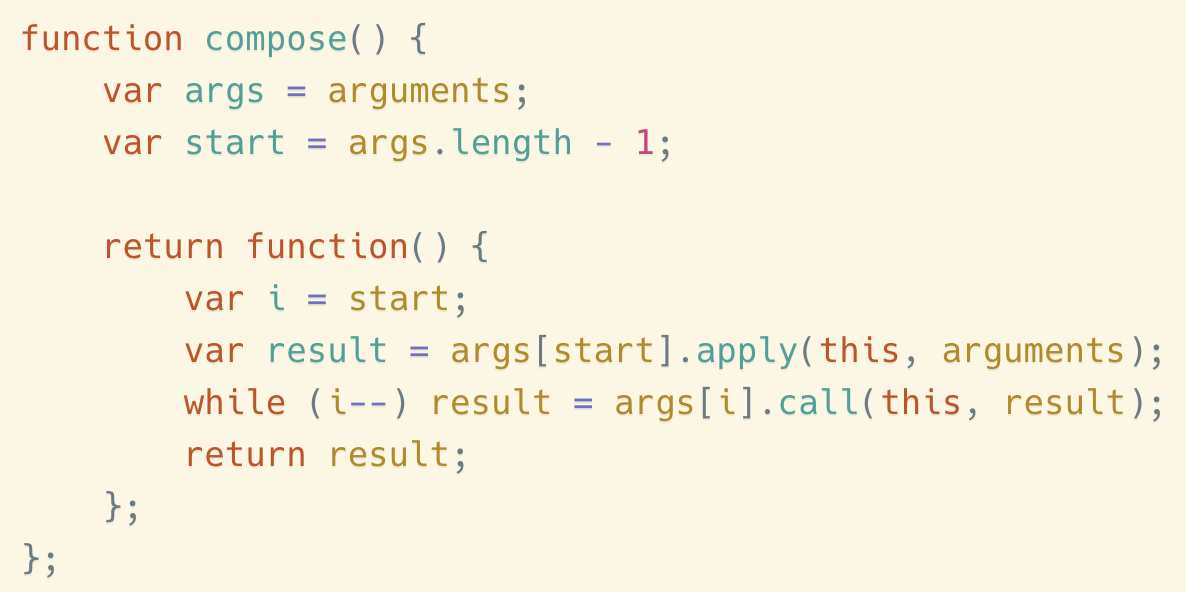

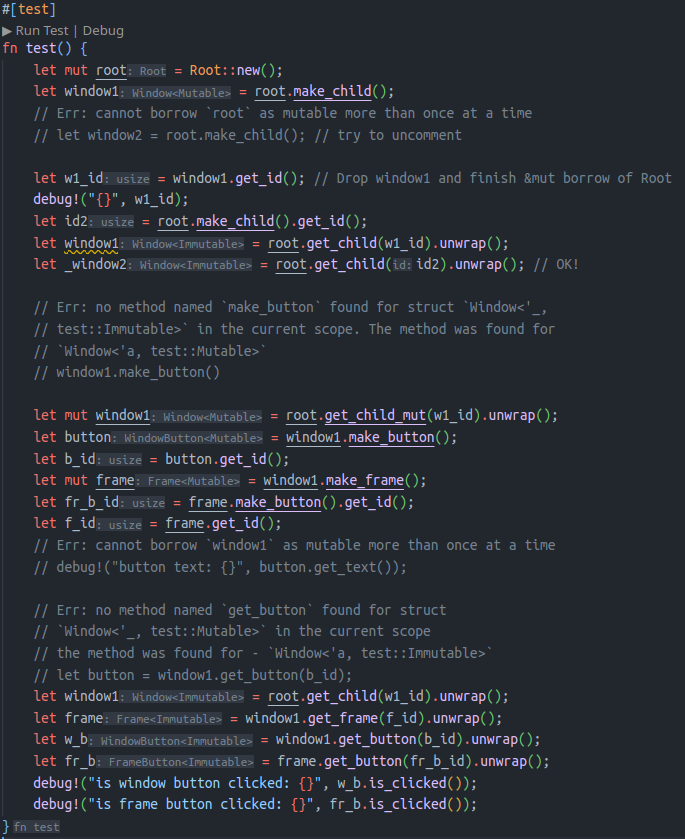

# Сделай свой AngularJS: Часть 1 — Scope и Digest

Angular — зрелый и мощный JavaScript-фреймворк. Он довольно большой и основан на множестве новых концепций, которые необходимо освоить, чтобы работать с ним эффективно. Большинство разработчиков, знакомясь с Angular, сталкиваются с одними и теми же трудностями. Что конкретно делает функция digest? Какие существуют способы создания директив? Чем отличается сервис от провайдера?

Несмотря на то, что у Angular довольно хорошая [документация](http://docs.angularjs.org/), и существует куча [сторонних ресурсов](http://syntaxspectrum.com/tag/angularjs/), нет лучшего способа изучить технологию, чем разобрать ее по кусочкам и вскрыть ее магию.

В этой серии статей я **собираюсь воссоздать AngularJS с нуля**. Мы сделаем это вместе шаг за шагом, в процессе чего, вы намного глубже поймете внутреннее устройство Angular.

В первой части этой серии мы рассмотрим устройство областей видимости (scope), и то, как, на самом деле, работают **$eval**, **$digest** и **$apply**. Проверка данных на изменение (dirty-checking) в Angular кажется магией, но это не так — вы все увидите сами.

#### Подготовка

[Исходники проекта](https://github.com/teropa/schmangular.js) доступны на github, но я бы не советовал вам их просто копировать себе. Вместо этого, я настаиваю на том, чтобы вы сделали все сами, шаг за шагом, поигравшись с кодом и покопавшись в нем. В тексте я использую [JS Bin](http://jsbin.com/), так что вы можете прорабатывать код, даже не покидая страницу (**прим. пер.** — в переводе будут только ссылки на JS Bin код).

Мы будем использовать [Lo-Dash](http://lodash.com/) для некоторых низкоуровневых операций с массивами и объектами. Сам Angular не использует Lo-Dash, но для наших целей имеет смысл убрать как можно больше шаблонного низкоуровневого кода. Везде, где вы встретите в коде (**\_**) (символ подчеркивания) — вызываются функции Lo-Dash.

Так же мы будем использовать функцию **console.assert** для простейших проверок. Она должна быть доступна во всех современных JavaScript-окружениях.

Вот пример Lo-Dash и assert в действии:

[Код на JS Bin](http://jsbin.com/UGOVUk/4/edit)

**Просмотреть код**

```

var a = [1, 2, 3];

var b = [1, 2, 3];

var c = _.map(a, function(i) {

return i * 2;

});

console.assert(a !== b);

console.assert(_.isEqual(a, b));

console.assert(_.isEqual([2, 4, 6], c));

```

Консоль:

```

true

true

true

```

#### Объекты — область видимости (scope-ы)

Объекты области видимости в Angular — это обычные JavaScript-объекты, к которым можно добавлять свойства стандартным способом. Они создаются при помощи конструктора **Scope**. Давайте напишем простейшую его реализацию:

```

function Scope() {

}

```

Теперь при помощи оператора **new** можно создавать scope-объекты и добавлять в них свойства.

```

var aScope = new Scope();

aScope.firstName = 'Jane';

aScope.lastName = 'Smith';

```

В этих свойствах нет ничего особенного. Не нужно назначать никаких специальных сеттеров (setters), нет никаких ограничений на типы значений. Вместо этого вся магия заключена в двух функциях: **$watch** и **$digest**.

#### Наблюдение за свойствами объекта: $watch и $digest

**$watch** и **$digest** — две стороны одной медали. Вместе они образуют ядро того, чем в Angular являются scope-объекты: реакцию на изменение данных.

Используя **$watch** можно добавить в scope “наблюдателя”. Наблюдатель — это то, что будет получать уведомление, когда в соответствующем scope произойдет изменение.

Создается наблюдатель передачей в **$watch** двух функций:

* *watch-функция*, которая возвращает те данные, изменение которых вам интересно

* *listener-функция*, которая будет вызываться при изменении этих данных

> В Angular вы вместо watch-функции обычно использовали watch-выражение. Это строка (что-то типа «user.firstName»), которую вы указывали в html при связывании, как атрибут директивы, или напрямую из JavaScript. Эта строка разбиралась и компилировалась Angular-ом в, аналогичную нашей, watch-функцию. Мы рассмотрим, как это делается в следующей статье. В этой же статье будем придерживаться низкоуровневого подхода, используя watch-функции.

Для реализации **$watch**, нам необходимо где-то хранить все регистрируемые наблюдатели. Давайте добавим для них массив в конструктор **Scope**:

```

function Scope() {

this.$$watchers = [];

}

```

Префикс **$$** обозначает то, что переменная является приватной во фреймворке Angular и не должна вызываться из кода приложения.

Сейчас уже можно определить функцию **$watch**. Она будет принимать две функции в качестве аргументов и сохранять их в массиве **$$watchers**. Предполагается, что эта функция нужна каждому scope-объекту, поэтому давайте вынесем ее в прототип:

```

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn

};

this.$$watchers.push(watcher);

};

```

Обратной стороной медали является функция **$digest**. Она запускает всех наблюдателей, зарегистрированных для данной области видимости. Давайте опишем ее простейшую реализацию, в которой просто перебираются все наблюдатели, и у каждого из них вызывается listener-функция:

```

Scope.prototype.$digest = function() {

_.forEach(this.$$watchers, function(watch) {

watch.listenerFn();

});

};

```

Теперь можно зарегистрировать наблюдатель, запустить **$digest**, в результате чего отработает его listener-функция:

[Код на JS Bin](http://jsbin.com/oMaQoxa/2/edit)

**Просмотреть код**

```

function Scope() {

this.$$watchers = [];

}

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn

};

this.$$watchers.push(watcher);

};

Scope.prototype.$digest = function() {

_.forEach(this.$$watchers, function(watch) {

watch.listenerFn();

});

};

var scope = new Scope();

scope.$watch(

function() {console.log('watchFn'); },

function() {console.log('listener'); }

);

scope.$digest();

scope.$digest();

scope.$digest();

```

Консоль:

```

"listener"

"listener"

"listener"

```

Само по себе это еще не особо полезно. Чего бы нам действительно хотелось, так это того, чтобы обработчики запускались только в том случае, если действительно изменились данные, обозначенные в watch-функции.

#### Обнаружение изменения данных

Как говорилось раньше, watch-функция наблюдателя должна возвращать данные, изменение которых ей интересны. Обычно эти данные находятся в scope, поэтому, для удобства, scope передается ей в качестве аргумента. Watch-функция, наблюдающая за **firstName** из scope будет выглядеть примерно так:

```

function(scope) {

return scope.firstName;

}

```

В большинстве случаев watch-функция выглядит именно так: извлекает интересные ей данные из scope и возвращает их.

Работа функции **$digest** заключается в том, чтобы вызвать эту watch-функцию и сравнить полученное от нее значение с тем, что она возвращала в прошлый раз. Если значения различаются — то данные “грязные”, и необходимо вызвать соответствующую listener-функцию.

Чтобы сделать это, **$digest** должна запоминать последнее возвращенное значение для каждой watch-функции, а так как у нас для каждого наблюдателя уже есть свой объект, удобнее всего хранить эти данные в нем. Вот новая реализация функции **$digest**, которая проверяет данные на изменение для каждого наблюдателя:

```

Scope.prototype.$digest = function() {

var self = this;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

}

watch.last = newValue;

});

};

```

Для каждого наблюдателя вызывается watch-функция, передавая текущий scope как аргумент. Далее полученное значение сравнивается с предыдущим, сохраненным в атрибуте **last**. Если значения различаются — вызывается listener. Для удобства, в listener в качестве аргументов передаются оба значения и scope. В конце, в **last**-атрибут наблюдателя записывается новое значение, чтобы можно было проводить сравнение в следующий раз.

Давайте посмотрим, как в этой реализации запускаются listener-ы при вызове **$digest**:

[Код на JS Bin](http://jsbin.com/OsITIZu/3/edit)

**Просмотреть код**

```

function Scope() {

this.$$watchers = [];

}

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn

};

this.$$watchers.push(watcher);

};

Scope.prototype.$digest = function() {

var self = this;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

}

watch.last = newValue;

});

};

var scope = new Scope();

scope.firstName = 'Joe';

scope.counter = 0;

scope.$watch(

function(scope) {

return scope.firstName;

},

function(newValue, oldValue, scope) {

scope.counter++;

}

);

// We haven't run $digest yet so counter should be untouched:

console.assert(scope.counter === 0);

// The first digest causes the listener to be run

scope.$digest();

console.assert(scope.counter === 1);

// Further digests don't call the listener...

scope.$digest();

scope.$digest();

console.assert(scope.counter === 1);

// ... until the value that the watch function is watching changes again

scope.firstName = 'Jane';

scope.$digest();

console.assert(scope.counter === 2);

```

Консоль:

```

true

true

true

true

```

Сейчас у нас уже реализовано ядро Angular-овсого scope: регистрация наблюдателей и запуск их в фукнции **$digest**.

Так же мы можем уже сейчас сделать пару выводов, касающихся производительности scope-ов в Angular:

* Добавление данных в scope само по себе не влияет на производительность. Если нет наблюдателей, следящих за данными, то без разницы добавлены ли данные в scope или нет. Angular не перебирает свойства scope, он перебирает наблюдателей.

* Каждая watch-функция обязательно вызывается во время работы $digest. По этой причине имеет смысл уделить внимание тому, сколько у вас наблюдателей, а так же производительности каждой watch-функции самой по себе.

#### Оповещение о том, что происходит digest

Если вам необходимо получать оповещения, о том, что выполняется **$digest**, можно воспользоваться тем фактом, что каждая watch-функция, в процессе работы $digest, обязательно запускается. Нужно просто зарегистрировать watch-функцию без listener.

Чтобы учесть это, в функции **$watch** необходимо проверять, не пропущен ли listener, и если да — подставлять вместо него функцию-заглушку:

```

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn || function() { }

};

this.$$watchers.push(watcher);

};

```

Если вы используете этот шаблон, имейте ввиду, Angular учитывает возвращаемое из watch-функции значение, даже если listener-функция не объявлена. Если вы будете возвращать какое-либо значение, оно будет участвовать в проверке на изменения. Чтобы не быть причиной лишней работы — просто не возвращайте ничего из функции, по умолчанию всегда будет возвращаться **undefined**:

[Код на JS Bin](http://jsbin.com/OsITIZu/4/edit)

**Просмотреть код**

```

function Scope() {

this.$$watchers = [];

}

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn || function() { }

};

this.$$watchers.push(watcher);

};

Scope.prototype.$digest = function() {

var self = this;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

}

watch.last = newValue;

});

};

var scope = new Scope();

scope.$watch(function() {

console.log('digest listener fired');

});

scope.$digest();

scope.$digest();

scope.$digest();

```

Консоль:

```

"digest listener fired"

"digest listener fired"

"digest listener fired"

```

Ядро готово, но до конца еще далеко. Например, не учтен довольно типичный сценарий: listener-функции сами могут менять свойства из scope. Если такое случится, а за этим свойством следил другой наблюдатель, то может получиться, что этот наблюдатель не получит уведомления об изменении, по крайней мере в этот проход **$digest**:

[Код на JS Bin](http://jsbin.com/eTIpUyE/2/edit)

**Просмотреть код**

```

function Scope() {

this.$$watchers = [];

}

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn || function() {}

};

this.$$watchers.push(watcher);

};

Scope.prototype.$digest = function() {

var self = this;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

}

watch.last = newValue;

});

};

var scope = new Scope();

scope.firstName = 'Joe';

scope.counter = 0;

scope.$watch(

function(scope) {

return scope.counter;

},

function(newValue, oldValue, scope) {

scope.counterIsTwo = (newValue === 2);

}

);

scope.$watch(

function(scope) {

return scope.firstName;

},

function(newValue, oldValue, scope) {

scope.counter++;

}

);

// After the first digest the counter is 1

scope.$digest();

console.assert(scope.counter === 1);

// On the next change the counter becomes two, but our other watch hasn't noticed this yet

scope.firstName = 'Jane';

scope.$digest();

console.assert(scope.counter === 2);

console.assert(scope.counterIsTwo); // false

// Only sometime in the future, when $digest() is called again, does our other watch get run

scope.$digest();

console.assert(scope.counterIsTwo); // true

```

Консоль:

```

true

true

false

true

```

Давайте исправим это.

#### Выполняем $digest до тех пор, пока есть “грязные” данные

Нужно поправить **$digest** таким образом, чтобы он продолжал делать проверки до тех пор, пока наблюдаемые значения не перестанут меняться.

Сначала, давайте переименуем текущую функцию $digest в **$$digestOnce**, и изменим ее таким образом, чтобы она, пробегая все watch-функции один раз, возвращала булеву переменную, сообщающую было ли хоть одно изменение значений наблюдаемых полей или нет:

```

Scope.prototype.$$digestOnce = function() {

var self = this;

var dirty;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

dirty = true;

}

watch.last = newValue;

});

return dirty;

};

```

После этого, заново объявим функцию **$digest**, чтобы она в цикле запускала **$$digestOnce** до тех пор пока есть изменения:

```

Scope.prototype.$digest = function() {

var dirty;

do {

dirty = this.$$digestOnce();

} while (dirty);

};

```

**$digest** сейчас выполняет зарегистрированные watch-функции по крайней мере один раз. Если в первом проходе, какое-либо из наблюдаемых значений изменилось, проход помечается, как «грязный», и запускается второй проход. Так происходит до тех пор, пока за весь проход не будет обнаружено ни одного измененного значения — ситуация стабилизируется.

> У scope-ов в Angular, на самом деле, нет функции $$digestOnce. Вместо этого данный функционал там встрое в цикл непосредственно в $digest. Для наших целей ясность и читабельность важнее производительности, поэтому мы и сделали небольшой рефакторинг.

Вот новая реализация в действии:

[Код на JS Bin](http://jsbin.com/Imoyosa/3/edit)

**Просмотреть код**

```

function Scope() {

this.$$watchers = [];

}

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn ||function() { }

};

this.$$watchers.push(watcher);

};

Scope.prototype.$$digestOnce = function() {

var self = this;

var dirty;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

dirty = true;

}

watch.last = newValue;

});

return dirty;

};

Scope.prototype.$digest = function() {

var dirty;

do {

dirty = this.$$digestOnce();

} while (dirty);

};

var scope = new Scope();

scope.firstName = 'Joe';

scope.counter = 0;

scope.$watch(

function(scope) {

return scope.counter;

},

function(newValue, oldValue, scope) {

scope.counterIsTwo = (newValue === 2);

}

);

scope.$watch(

function(scope) {

return scope.firstName;

},

function(newValue, oldValue, scope) {

scope.counter++;

}

);

// After the first digest the counter is 1

scope.$digest();

console.assert(scope.counter === 1);

// On the next change the counter becomes two, and the other watch listener is also run because of the dirty check

scope.firstName = 'Jane';

scope.$digest();

console.assert(scope.counter === 2);

console.assert(scope.counterIsTwo);

```

Консоль:

```

true

true

true

```

Можно сделать еще один важный вывод, касающийся watch-функций: они могут отрабатывать несколько раз в процессе работы $digest. Вот почему, часто говорят, что watch-функции должны быть идемпотентными: в функции не должно быть побочных эффектов, либо там должны быть такие побочные эффекты, для которых будет нормальным срабатывать несколько раз. Если, например, в watch-функции, есть AJAX-запрос, нет никаких гарантий на то, сколько раз этот запрос выполнится.

В нашей текущей реализации есть один большой изъян: что случитсья, если два наблюдателя будут следить за изменениями друг друга? В этом случае ситуация никогда не стабилизируется? Подобная ситуация реализована в коде ниже. В примере вызов **$digest** закомментирован.

Раскомментируйте его, чтобы узнать, что случиться:

[Код на JS Bin](http://jsbin.com/eKEvOYa/3/edit)

**Просмотреть код**

```

function Scope() {

this.$$watchers = [];

}

Scope.prototype.$watch = function(watchFn, listenerFn) {

var watcher = {

watchFn: watchFn,

listenerFn: listenerFn || function() { }

};

this.$$watchers.push(watcher);

};

Scope.prototype.$$digestOnce = function() {

var self = this;

var dirty;

_.forEach(this.$$watchers, function(watch) {

var newValue = watch.watchFn(self);

var oldValue = watch.last;

if (newValue !== oldValue) {

watch.listenerFn(newValue, oldValue, self);

dirty = true;

}

watch.last = newValue;

});

return dirty;

};

Scope.prototype.$digest = function() {

var dirty;

do {

dirty = this.$$digestOnce();

} while (dirty);

};

var scope = new Scope();

scope.counter1 = 0;

scope.counter2 = 0;

scope.$watch(

function(scope) {

return scope.counter1;

},

function(newValue, oldValue, scope) {

scope.counter2++;

}

);

scope.$watch(

function(scope) {

return scope.counter2;

},

function(newValue, oldValue, scope) {

scope.counter1++;

}

);

// Uncomment this to run the digest

// scope.$digest();

console.log(scope.counter1);

```

Консоль:

```

0

```

JSBin останавливает функцию через некоторое время (на моей машине происходит около 100000 итераций). Если вы запустите этот код, например, под node.js, он будет выполняться вечно.

#### Избавляемся от нестабильности в $digest

Все что нам нужно, так это ограничить работу **$digest** определенным количеством итераций. Если scope все-еще продолжает меняться после окончания итераций, мы поднимаем руки и сдаемся — вероятно состояние никогда не стабилизируется. В этой ситуации можно было бы выбросить исключение, так как состояние области видимости явно не такое, каким его ожидал видеть пользователь.

Максимальное количество итераций называется TTL (сокращение от time to live — время жизни). По умолчанию установим его равным 10. Это количество может показаться маленьким (мы только что запускали digest около 100000 раз), но учтите, это уже вопрос производительности — digest выполняется часто, и в нем каждый раз отрабатывают все watch-функции. К тому же кажется маловероятным, что у пользователя будет более 10 выстроенных в цепочку watch-функций.

> В Angular TTL можно настраивать. Мы еще вернемся к этому в следующих статьях, когда будем обсуждать провайдеры и внедрение зависимостей.

Ну ладно, продолжим — давайте добавим счетчик в digest-цикл. Если достигли TTL — выбрасываем исключение:

```

Scope.prototype.$digest = function() {

var ttl = 10;

var dirty;

do {

dirty = this.$$digestOnce();

if (dirty && !(ttl--)) {

throw "10 digest iterations reached";

}

} while (dirty);

};

```

Обновленная версия предыдущего примера выбрасывает исключение:

[Код на JS Bin](http://jsbin.com/uNapUWe/2/edit)

**Просмотреть код**

```