text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

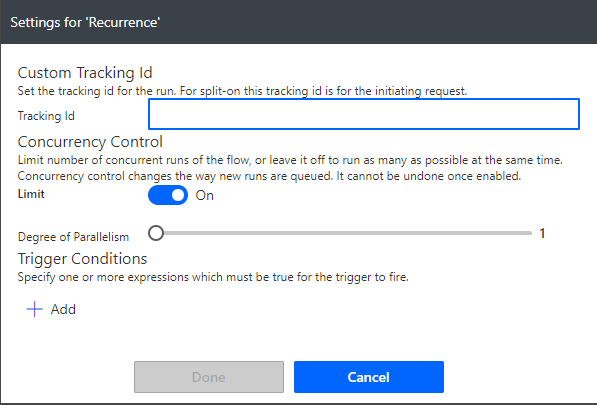

values | source stringclasses 4

values |

|---|---|---|---|---|

# Использование Midnight Commander в качестве IDE (codejump)

**#### Преамбула…**

я давно искал редактор способный удовлетворить мои скромные запросы в плане написания кода на языке C. Он должен: 1. работать в консоли;

2. быть по возможности максимально быстрым;

3. поддерживать подсветку синтаксиса;

4. иметь возможность навигации по исходному коду (переход к определению функций, отображение свойств объектов, и т.п.);

5. устанавливать закладки в тексте и перемещаться по ним;

6. отображать номера строк;

7. позволять удобно и интуитивно форматировать исходный код программы;

8. иметь привычное для меня сочетание клавиш, либо иметь возможность эти сочетания переопределить;

Таких редакторов не так уж и много — vim, emacs, motor и еще небольшая кучка разношерстых редакторов в стадии 0.0.7-pre-alfa. Первые два ну всем хороши, кроме одной небольшой, но существенной для меня детали — они весьма специфичны в плане сочетания клавиш, и поведения. Крайне досадно бывало после долгого сидения в vim портить текст редактируемый в far. Больше всего напрягали постоянные нажатия esc (на автомате после vim) в far-е которые рано или поздно приводили к тому, что набранный текст или попросту не сохраняется после очередного эскейпа или портится. И наоборот после far-а сложно было переключиться на набор текста в vim. Другими словами я получил кучу проблем вместо удовольствия от написания кода :)

Motor был всем хорош, но не держал юникод и существенное время не обновлялся (последняя овость на их сайте датировалась 2000-м годом). Промучившись с полгода я решил что не стоит пытаться научить старую собаку новым трюкам, нужно найти какую-то иной редактор более привычный для меня. Им как ни странно оказался встроенный редактор Миднайт коммандера. Ниже представлена одна из возможностей mc 4.7, а именно использование утилит ctags/etags совместно с mcedit для навигации по коду.

**#### Навигация по коду**

#### Подготовка

Поддержка данного функционала появилась в mcedit с версии 4.7.0-pre1.

Чтобы им воспользоваться необходимо проиндексировать каталог проектом с помощью утилиты ctags либо etags, для этого необходимо выполнить следующие команды:

`$ cd /home/user/projects/myproj

$ find . -type f -name "*.[ch]" | etags -l c --declarations -`

либо

`$ find . -type f -name "*.[ch]" | ctags --c-kinds=+p --fields=+iaS --extra=+q -e -L-`

После завершения работы утилиты в корневом каталоге нашего проекта появится файл TAGS, который mcedit и будет использовать.

Ну вот практически и все что нужно сделать для того чтобы mcedit мог находить определение функций переменных или свойств исследуемого объекта.

#### Использование

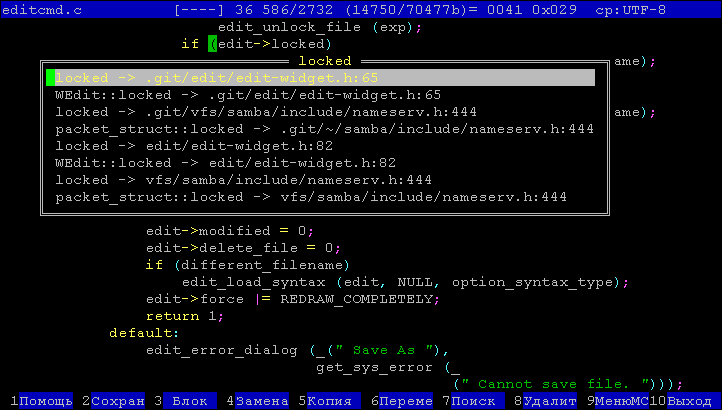

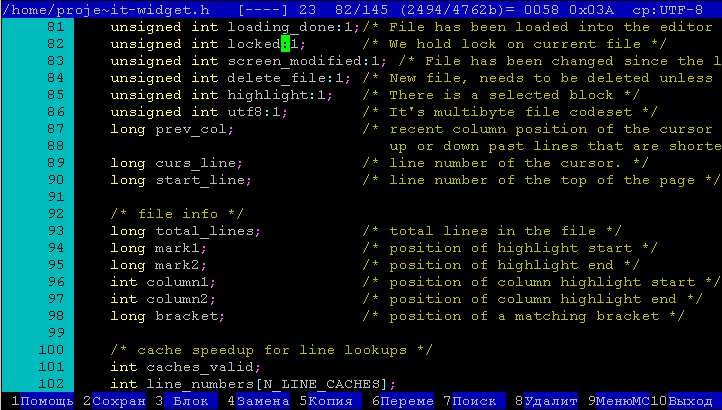

Представим что нам необходимо определить место где находится определение свойства **locked** объекта **edit** в неком исходнике довольно большого проекта.

`/* Succesful, so unlock both files */

if (different_filename) {

if (save_lock)

edit_unlock_file (exp);

if (edit->locked)

edit->locked = edit_unlock_file (edit->filename);

} else {

if (edit->locked || save_lock)

edit->locked = edit_unlock_file (edit->filename);

}`

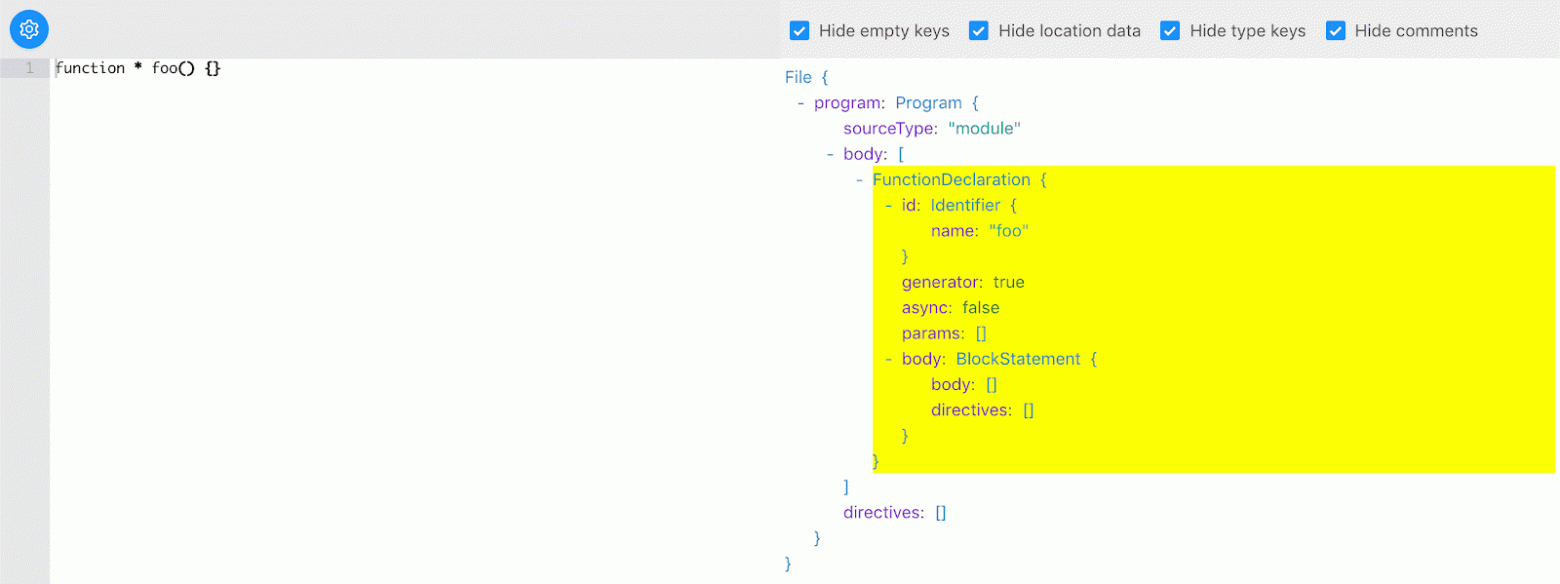

Для этого помещаем курсор в конец слова **locked** и нажимаем **alt+enter**, появляется список возможных вариантов, как на представленном ниже скриншоте

После выбора нужного варианта мы попадаем на строку с определением.

Чтобы вернуться к редактируемому файлу нужно нажать **alt+'-'**, чтобы снова перейти к нужному определению необходимо нажать **alt+'='** | https://habr.com/ru/post/70266/ | null | ru | null |

# Основы создания 2D персонажа в Godot. Часть 2: компилирование шаблонов, немного о GDScript, движение и анимация героя

В предыдущей [статье](http://habrahabr.ru/post/212583/) мы рассмотрели азы создания нового проекта в [Godot](http://www.godotengine.org/wp/). И с этими поверхностными знаниями можно разве что поглядеть demo-версии игр.

Во второй части на повестке дня у нас:

1) Экспорт готового проекта в бинарные файлы для выбранной архитектуры.

2) Новые анимации. Параметры персонажа.

3) Управление.

3) GDScript. Добро пожаловать в настоящий кодинг!

4) Импорт простейших Tilesets.

5) Бонус: разбор устройства простейших задников.

Ну и как обычно, много картинок!

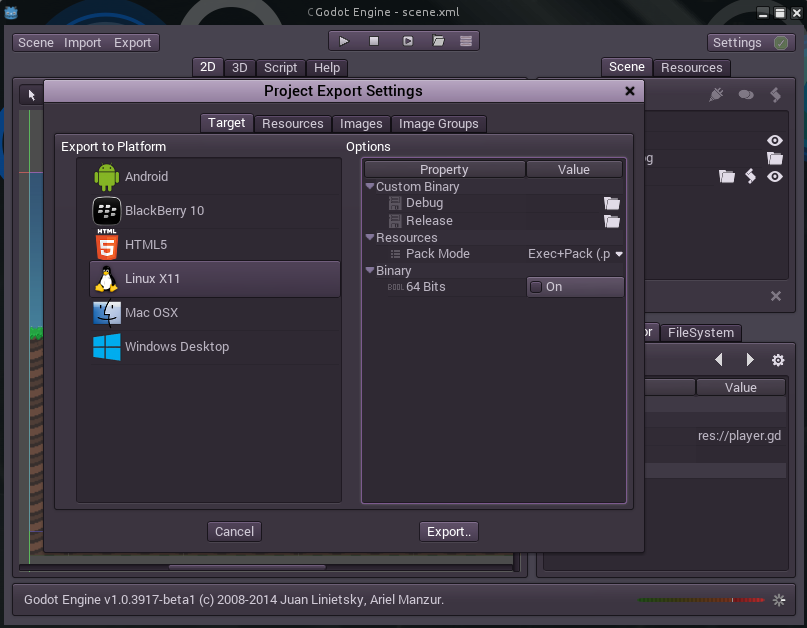

##### Компиляция....?

В прошлой статье я упоминал что авторы не предусматривали бинарники для linux x86. На время написания статьи бинарные файлы всё ещё были не готовы. Но экспортировать готовые проекты, demo или просто тесты уже хотелось. Но что делать, если нет Шаблонов экспорта? Правильно! Скомпилировать их самому!

Переходим в директорию с исходными файлами и компилируем

```

cd ./godot

```

Средства отладки:

```

scons bin/godot target=release_debug tools=no

```

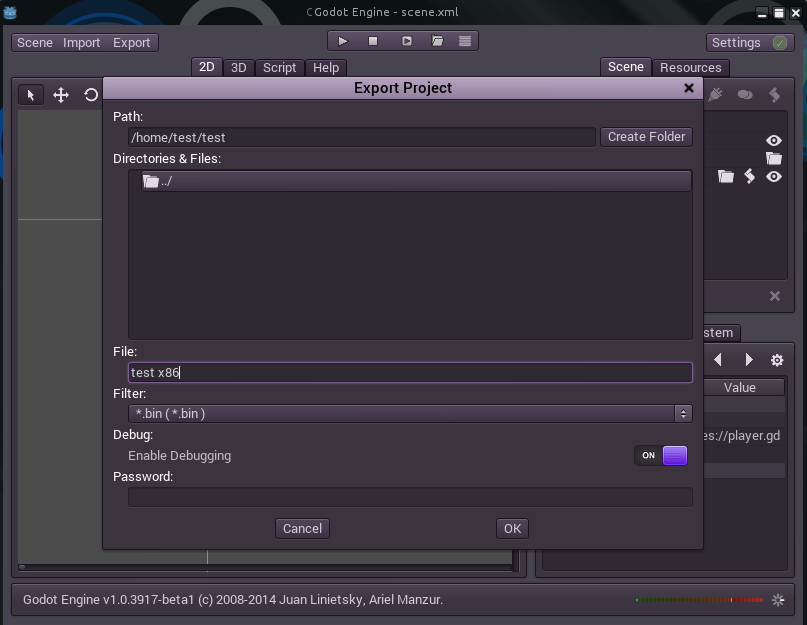

После успешной компиляции переименовываем свежеполученный файл в linux\_x11\_32\_debug

Сам шаблон экспорта:

```

scons bin/godot_rel target=release tools=no

```

Переименовываем в linux\_x11\_32\_release

Запаковываем в zip-архив.

```

find ./* -name "linux_x11_32_*" -exec zip ./linux_x11_32_templates.zip "{}" +

```

Скармливаем архив Godot. Вуаля, теперь можно экспортировать проект для ОС GNU/Linux любой разрядности.

Да даже под ОС и разрядности, отличные от Вашей. Бинарные файлы для Windows без проблем смог завести в wine, главное не забыть снять или поставить галочку 64bits, и выключить debugging, если не нужен.

Подробнее про настройки [экспорта](http://www.godotengine.org/wiki/doku.php?id=export) можно почитать на [сайте](http://www.godotengine.org/wiki/doku.php?id=export_pc) проекта на английском языке. Если будет актуально и востребовано, можно будет подумать о русской локализации статей и создания русскоязычной wiki по Godot.

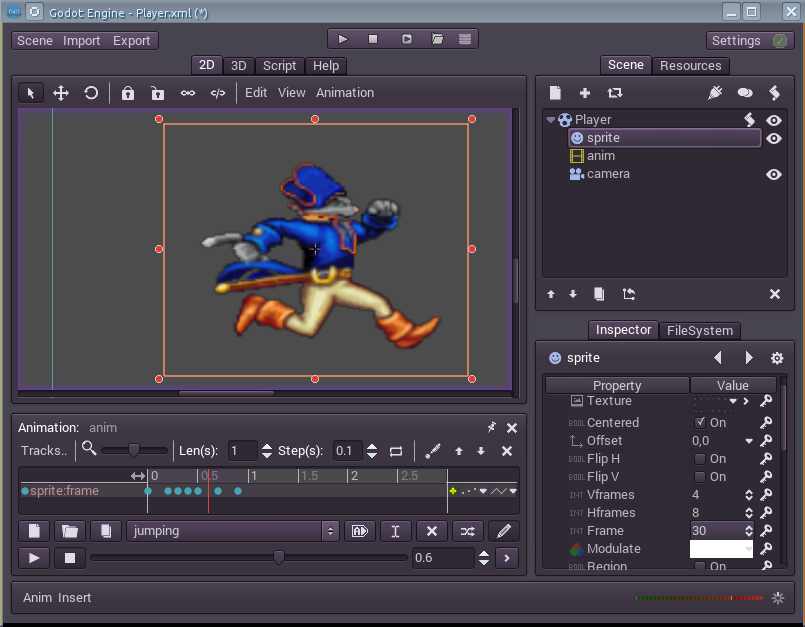

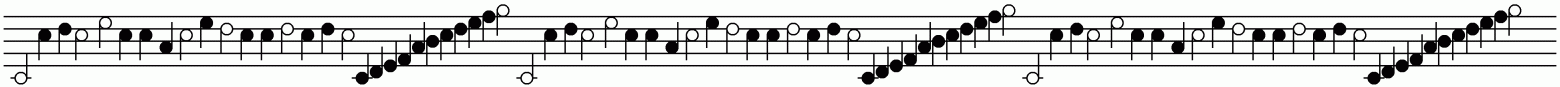

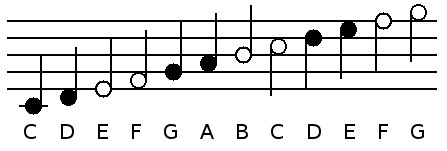

##### Анимация бега и прыжков

В прошлом уроке я заранее подготовил текстурку со спрайтами бега и прыжка нашего Капитана. Поэтому я думаю создать две анимации jumping и run не составит труда. Я думаю это не трудно будет сделать. Скажу лишь параметры:

```

run:

Len(s): 0.9

Step(s): 0.1

Looping: yes

jumping:

Len(s): 1

Step(s): 0.1

Animation: ○х○○○○х○х○х , где кружки - последовательность кадров от 24 до 30, а крестики - их отсутствие.

Looping: no

```

Да, прыжок — это только прыжок. Значит нужна ещё анимация падения.

```

falling:

Len(s): 0.1

Step(s): 0.1

Animation: кадр №30

Looping: yes

```

###### Параметры персонажа

Три пункта:

* Камера

* Касание с землей

* Геометрия персонажа

1) Напоминаю. Проверьте, стоит ли галочка на параметре Camera2D/Current, отвечающая за привязку объекта «камера» к объекту player.

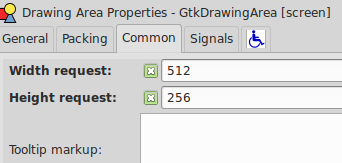

2) Добавим Node CollisionShape2D. Эта «Нода» отвечает за положение нашего Капитана в 2D-пространстве.

В Inspector выбираем CollisionShape2D -> Shape -> New RayShape2D. В 2-х миллиметрах правее появится небольшая стрелочка — нажимаем на неё — откроются параметры RayShape2D.

Параметр RayShape2D/Lenght оставим 20, а вот Custom Solver Bias выставим 0.5 (этим мы разрешим небольшое смещение)

Теперь в самой игре в будущем, если персонаж будет «не попадать ногами по полу», его положение можно будет отрегулировать этой стрелочкой. Именно она проверяет «касается ли спрайт пола».

3) С геометрией веселее. Для начала надо добавить Node CollisionPolygon2D. Теперь нам надо нарисовать этот самый полигон, дающий персонажу «массу».То-есть надо нарисовать то, чем герой будет «биться об стенки» при столкновении с ними. Иначе он будет просто проходить «сквозь стены».

Выбираем карандаш. Теперь левой клавишей мыши «ставим» 3 вершины треугольника. Два на каждом из плечей, и один в районе живота. И правой клавишей (просто щёлкнуть на рабочей области) рисуем треугольник. Желательно чтобы он в итоге получился равнобедренный или равносторонний. С нижней вершиной на оси Y. Теперь увеличим его. Немного. Иначе персонаж будет проходить сквозь потолок например.

Готово, наш персонаж — болванчик готов. Теперь самое лёгкое — управление.

##### Создание клавиш управления

1. Стандартное управление.

Создать такое довольно легко. Идём в Scene -> Project Settings -> Input Map

Создаём 3 клавиши управления — move\_left, move\_right и jump. Назначаем им клавиши. Готово!

Как видно, Godot умеет работать и с геймпадами, правда для каждого надо будет настраивать своё управление. Но об этом как-нибудь в другой раз.

2. Управление с тачскрина.

Тут тоже особо ничего сложного нет. Привязываем к нашему герою Node CanvasLayer с названием «ui». А к ней в свою очередь — 3 копии TouchScreenButton. Называем их left, right и jump.

К каждой привязываем изображение клавиши. Они сразу появятся в рабочей области программы. Расставляем так, как нам кажется будет удобнее. Не забываем что синее окошко — это «область показа камеры».

В разделы Action вписываем параметры move\_left, move\_right и jump соответственно. Ну и выставляем параметр Visibility Mode в TouchScreen Only. Готово!

##### GDScript

Тут я немного в ступоре. Дело в том что из меня программист честно сказать не очень. Я сам многое не понимаю. И читаю книжки по Python чтобы лучше разбираться в вопросе. Потому что GDScript очень похож на него.

###### Внимание!

* Движок не понимает кириллицу. Но если случайно на ней что-то написать, он её просто не отображает. А просто помечает всю строчку с ней, как одну большую ошибку.

* Отступы очень важны. Не там отступ — и герой может провалиться в пол, могут выполняться не те функции.

* Ещё раз повторяю, в программировании я нуб, но постараюсь объяснить всё как можно проще.

Небольшая просьба — если знаете как оформить лучше — напишите пожалуйста. Буду рад учесть все замечания.

Напомню предыдущий код отображения простейшей анимации:

**Что было**

```

extends RigidBody2D

var anim=""

func _integrate_forces(s):

var new_anim=anim

new_anim=«idle»

if (new_anim!=anim):

anim=new_anim

get_node(«anim»).play(anim)

```

Добавляем и изменяем код:

**Объявляем переменные**

```

extends RigidBody2D

var anim="" #переменная анимации

var siding_left=false #переменная перемещения влево

var jumping=false #переменная прыжка

var stopping_jump=false #переменная завершения прыжка

var WALK_ACCEL = 800.0 #скорость перемещения по горизонтали

var WALK_DEACCEL= 800.0 #скорость торможения

var WALK_MAX_VELOCITY= 800.0 #максимальная скорость

var GRAVITY = 900.0 #гравитация

var AIR_ACCEL = 200.0 #скорость перемещения по горизонтали в прыжке

var AIR_DEACCEL= 200.0 #торможение прыжка (перемещения в обратном направлении) в прыжке. Значение, близкое к нулю будет делать игру похожую на Mario Bros'

var JUMP_VELOCITY=460 #скорость прыжка

var STOP_JUMP_FORCE=900.0 #сила торможения прыжка

var MAX_FLOOR_AIRBORNE_TIME = 0.15 #Время касания, после которого уже прыгнуть нельзя. То-есть время, в течении которого можно сделать второй прыжок. Не меняйте, если не хотите "двойных" или бесконечных прыжков.

var airborne_time=1e20 #время в воздухе

var floor_h_velocity=0.0

```

Начинаем функцию integrate\_forces. Вот что пронеё сказано в Help:

Измените функцию, чтобы использовать свою физику взаимодействий. Ну хорошо, этим и займёмся.

PS не знаю как комментировать код дальше. Поэтому просто оставлю его так:

**Пишем функцию взаимодействия**

```

func _integrate_forces(s):

var lv = s.get_linear_velocity()

var step = s.get_step()

var new_anim=anim

var new_siding_left=siding_left

```

**Получаем управление**

```

var move_left = Input.is_action_pressed("move_left")

var move_right = Input.is_action_pressed("move_right")

var jump = Input.is_action_pressed("jump")

#Замедление по оси x (торможение)

lv.x-=floor_h_velocity

floor_h_velocity=0.0

```

**Поиск земли (проверяем контакт текстуры с полом)**

```

var found_floor=false

var floor_index=-1

for x in range(s.get_contact_count()):

var ci = s.get_contact_local_normal(x)

if (ci.dot(Vector2(0,-1))>0.6):

found_floor=true

floor_index=x

if (found_floor):

airborne_time=0.0

else:

airborne_time+=step #время, проведенное в воздухе

var on_floor = airborne_time < MAX_FLOOR_AIRBORNE_TIME

```

**Процесс прыжка**

```

if (jumping):

if (lv.y>0):

#Завершаем прыжок если он закончен (достигли наивысшей точки прыжка)

jumping=false

elif (not jump):

stopping_jump=true

if (stopping_jump):

lv.y+=STOP_JUMP_FORCE*step

```

**Движение персонажа на земле**

```

if (on_floor):

if (move_left and not move_right):

if (lv.x > -WALK_MAX_VELOCITY):

lv.x-=WALK_ACCEL*step

elif (move_right and not move_left):

if (lv.x < WALK_MAX_VELOCITY):

lv.x+=WALK_ACCEL*step

else:

var xv = abs(lv.x)

xv-=WALK_DEACCEL*step

if (xv<0):

xv=0

lv.x=sign(lv.x)*xv

#Проверка прыжка

if (not jumping and jump):

lv.y=-JUMP_VELOCITY

jumping=true

stopping_jump=false

#Проверка перемещения и смена анимации

if (lv.x < 0 and move_left):

new_siding_left=true

elif (lv.x > 0 and move_right):

new_siding_left=false

if (jumping):

new_anim="jumping"

elif (abs(lv.x)<0.1):

new_anim="idle"

else:

new_anim="run"

```

**Движение персонажа в воздухе**

```

else:

if (move_left and not move_right):

if (lv.x > -WALK_MAX_VELOCITY):

lv.x-=AIR_ACCEL*step

elif (move_right and not move_left):

if (lv.x < WALK_MAX_VELOCITY):

lv.x+=AIR_ACCEL*step

else:

var xv = abs(lv.x)

xv-=AIR_DEACCEL*step

if (xv<0):

xv=0

lv.x=sign(lv.x)*xv

if (lv.y<0):

new_anim="jumping"

else:

new_anim="falling"

```

**Перемещение персонажа**

```

if (new_siding_left!=siding_left):

if (new_siding_left):

get_node("sprite").set_scale( Vector2(-1,1) )

else:

get_node("sprite").set_scale( Vector2(1,1) )

siding_left=new_siding_left

```

**Смена анимации**

```

if (new_anim!=anim):

anim=new_anim

get_node("anim").play(anim)

```

**Применение скорости перемещения на земле**

```

if (found_floor):

floor_h_velocity=s.get_contact_collider_velocity_at_pos(floor_index).x

lv.x+=floor_h_velocity

```

**Применение гравитации на это всё безобразие**

```

lv+=s.get_total_gravity()*step

s.set_linear_velocity(lv)

```

Блин, это был ужас.

**Теперь всё вместе без комментариев:**

```

extends RigidBody2D

var anim=""

var siding_left=false

var jumping=false

var stopping_jump=false

var WALK_ACCEL = 300.0

var WALK_DEACCEL= 300.0

var WALK_MAX_VELOCITY= 400.0

var GRAVITY = 900.0

var AIR_ACCEL = 300.0

var AIR_DEACCEL= 300.0

var JUMP_VELOCITY=460

var STOP_JUMP_FORCE=200.0

var MAX_FLOOR_AIRBORNE_TIME = 0.15

var airborne_time=1e20

var floor_h_velocity=0.0

func _integrate_forces(s):

var lv = s.get_linear_velocity()

var step = s.get_step()

var new_anim=anim

var new_siding_left=siding_left

var move_left = Input.is_action_pressed("move_left")

var move_right = Input.is_action_pressed("move_right")

var jump = Input.is_action_pressed("jump")

lv.x-=floor_h_velocity

floor_h_velocity=0.0

var found_floor=false

var floor_index=-1

for x in range(s.get_contact_count()):

var ci = s.get_contact_local_normal(x)

if (ci.dot(Vector2(0,-1))>0.6):

found_floor=true

floor_index=x

if (found_floor):

airborne_time=0.0

else:

airborne_time+=step

var on_floor = airborne_time < MAX_FLOOR_AIRBORNE_TIME

if (jumping):

if (lv.y>0):

jumping=false

elif (not jump):

stopping_jump=true

if (stopping_jump):

lv.y+=STOP_JUMP_FORCE*step

if (on_floor):

if (move_left and not move_right):

if (lv.x > -WALK_MAX_VELOCITY):

lv.x-=WALK_ACCEL*step

elif (move_right and not move_left):

if (lv.x < WALK_MAX_VELOCITY):

lv.x+=WALK_ACCEL*step

else:

var xv = abs(lv.x)

xv-=WALK_DEACCEL*step

if (xv<0):

xv=0

lv.x=sign(lv.x)*xv

if (not jumping and jump):

lv.y=-JUMP_VELOCITY

jumping=true

stopping_jump=false

if (lv.x < 0 and move_left):

new_siding_left=true

elif (lv.x > 0 and move_right):

new_siding_left=false

if (jumping):

new_anim="jumping"

elif (abs(lv.x)<0.1):

new_anim="idle"

else:

new_anim="run"

else:

if (move_left and not move_right):

if (lv.x > -WALK_MAX_VELOCITY):

lv.x-=AIR_ACCEL*step

elif (move_right and not move_left):

if (lv.x < WALK_MAX_VELOCITY):

lv.x+=AIR_ACCEL*step

else:

var xv = abs(lv.x)

xv-=AIR_DEACCEL*step

if (xv<0):

xv=0

lv.x=sign(lv.x)*xv

if (lv.y<0):

new_anim="jumping"

else:

new_anim="falling"

if (new_siding_left!=siding_left):

if (new_siding_left):

get_node("sprite").set_scale( Vector2(-1,1) )

else:

get_node("sprite").set_scale( Vector2(1,1) )

siding_left=new_siding_left

if (new_anim!=anim):

anim=new_anim

get_node("anim").play(anim)

if (found_floor):

floor_h_velocity=s.get_contact_collider_velocity_at_pos(floor_index).x

lv.x+=floor_h_velocity

lv+=s.get_total_gravity()*step

s.set_linear_velocity(lv)

```

PS чтобы заработала гравитация, надо поставить галочку в Scene -> Project Settings -> Physics2D -> Default Gravity

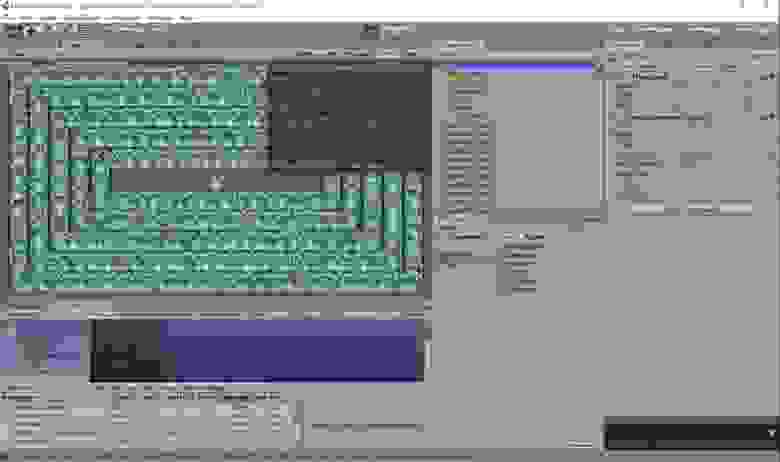

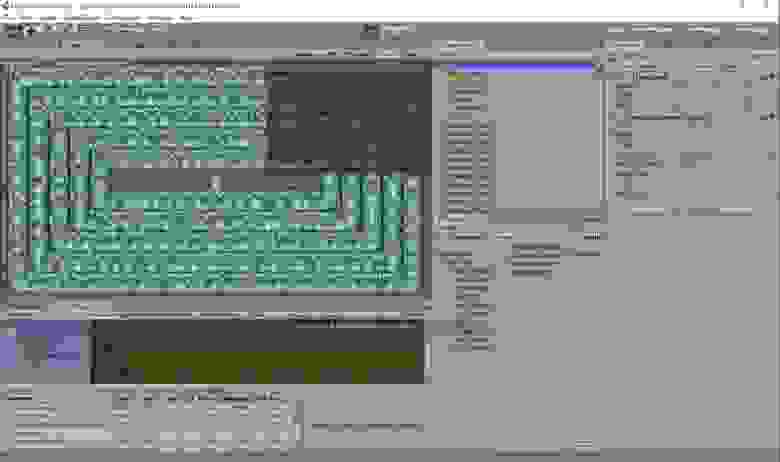

##### Импорт TileSets

Рассказать подробно про tileset я в этот раз не успеваю. Могу лишь предложить свою готовую сцену (из моего проекта) или Вам создать свою из TileSet. Скачать сет можно по ссылке ниже, после чего добавить в проект Node TileMap. В настройках к ней надо добавить готовый TileSet ( TileSet -> Load -> tileset.xml ). Простейший пол/землю нарисовать сможете. Как рисовать уровни, TileSets я подробно расскажу в следующем уроке.

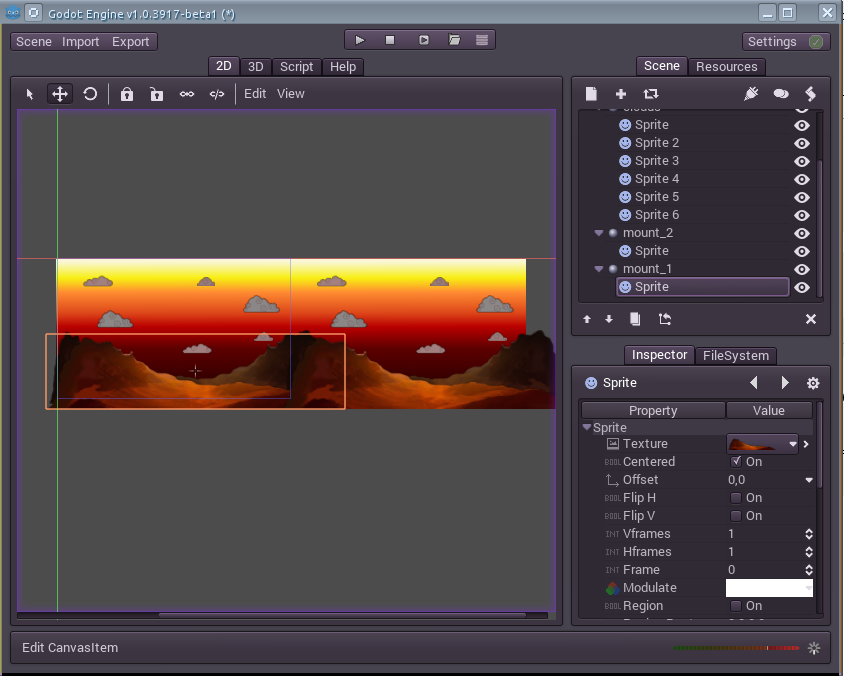

##### Бонус! Добавление задников!

Создаём новую сцену. Добавляем в неё «Node» ParallaxBackground. Называем её parallax\_bg и сохраняем как parallax\_bg.xml.

К ней создаём ParallaxLayer 4 штуки. Называем их sky, clouds, mount\_1, mount\_2. Соответственно небо, облака, и горы.

Разрешение нашей игры 800x600 (Посмотрите в настройках Scene -> Project Settings -> Display). Поэтому ставим каждой «Ноде» параметр Mirroring 800,0 — зеркалирование по оси Y. Поменяйте параметры Scale у «Нод» clouds, mount\_1, mount\_2 на 0.1,1; 0.2,1 и 0.4,1 соответственно.

К Node sky добавляем спрайт самого неба. Свой я уже нарисовал заранее. А вы можете скачать всё по ссылкам ниже.

На рабочей области появилось сразу 2 полоски. Переносим на рабочую область изображения, масштабируем. Видим что изменяя главный спрайт меняется и его зеркальное отражение.

К Node clouds добавляем облачка. Думаю можно будет продублировать каждый из 3-х чтобы в итоге было 6, mirror дублирует ещё раз, итого у нас будет аж 12 облаков!

Теперь к Node mount\_1 и mount\_2 добавим горы. Но слой mount\_2 поднимем выше mount\_1.

Сохраняем сцену. Открываем stage.xml. И к нашему Stage добавляем через «плюсик» сцену с задниками.

И как обычно небольшое видео геймплея:

Небольшой FAQ (Будет пополняться):

* Если персонаж не двигается — проверьте добавили и правильно ли добавили клавиши управления

* Проблемы с анимацией — правильно ли добавили анимацию. Проверьте looping анимаций idle, run и falling.

* Персонаж проваливается в пол/проходит сквозь стены, потолки — увеличьте треугольник CollisionPolygon2D.

* Персонаж частично в текстурах/выше них — поработайте со стрелкой CollisionShape2D

Скачать:

* [](https://www.dropbox.com/s/z5djwtpvts96pdp/test.zip) [Исходники проекта](https://www.dropbox.com/s/z5djwtpvts96pdp/test.zip)

* [](https://www.dropbox.com/s/ulxle83xut852o3/parallax_bg.tar.gz) [Задники (zip)](https://www.dropbox.com/s/ulxle83xut852o3/parallax_bg.tar.gz)

* [](https://www.dropbox.com/s/q1774rvwgdq1u8c/linux_x11_32_templates.zip) [Скомпилированные шаблоны экспорта для Linux x86 (zip)](https://www.dropbox.com/s/q1774rvwgdq1u8c/linux_x11_32_templates.zip)

* [](https://www.dropbox.com/s/r0jdvpku54a4jws/Linux%20x86) [Бинарники Demo урока Linux x86](https://www.dropbox.com/s/r0jdvpku54a4jws/Linux%20x86)

* [](https://www.dropbox.com/s/c19eo3yax7dwrmn/Linux%20amd64) [Бинарники Demo урока Linux amd64](https://www.dropbox.com/s/c19eo3yax7dwrmn/Linux%20amd64)

* [](https://www.dropbox.com/s/ne0vfeam7cz065g/Windows%20x86) [Бинарники Demo урока Windows x86](https://www.dropbox.com/s/ne0vfeam7cz065g/Windows%20x86)

* [](https://www.dropbox.com/s/whfzlvmitfpaijs/Windows%20x86_64) [Бинарники Demo урока Windows x86\_64](https://www.dropbox.com/s/whfzlvmitfpaijs/Windows%20x86_64)

* [](https://www.dropbox.com/s/pegktdn9ev2d8e9/MacOS%20%20x86) [Бинарники Demo урока MacOS x86](https://www.dropbox.com/s/pegktdn9ev2d8e9/MacOS%20%20x86)

* [](https://www.dropbox.com/s/kaozjptvh4l519b/MacOS%20amd64) [Бинарники Demo урока MacOS amd64](https://www.dropbox.com/s/kaozjptvh4l519b/MacOS%20amd64)

Спасибо, если осилили и дочитали до конца. В случае недочётов пишите в личку. Спасибо, увидимся! | https://habr.com/ru/post/212837/ | null | ru | null |

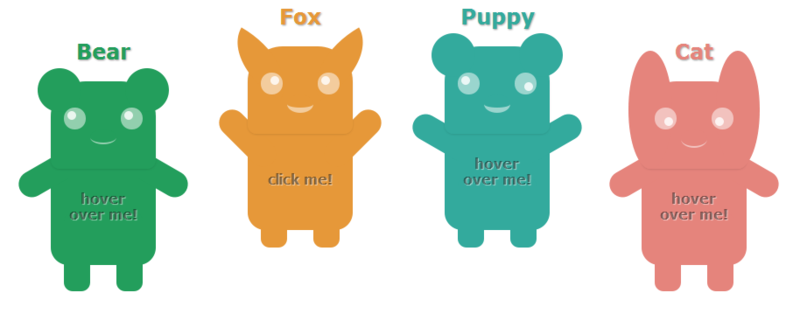

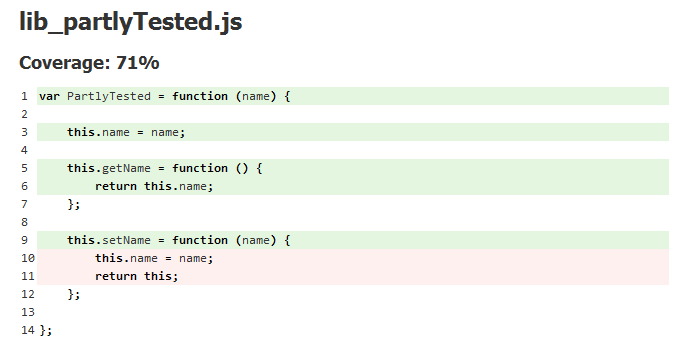

# Зверюшки на CSS3 transitions & transforms

#### Пора

Одним прекрасным вечером увидел одну забавную картинку с подобными зверюшками и решил вдохнуть в них жизнь. Решил я это сделать ради ~~научного~~ эксперимента: выявить, действительно ли эти нововведения можно претворять в жизни.

[Более 65% пользователей](http://css3.bradshawenterprises.com/) уже могут увидеть transitions в действии.

#### CSS

[Демо](http://goldfinch.pro/pavepies.html) [Код на jsfiddle](http://jsfiddle.net/JpKfJ/)

Так как я люблю CSS, решил сделать интерактивных зверюшек на чистом CSS, без каких-либо скриптов.

Благодаря псевдоклассу **:checked**, можно реализовать действие по клику, что обычно приписывается на js. А также используя уже привычные псевдоклассы **:hover** и **:active**, я оживил зверюшек:

```

.pavepy .body .hand.left,

.pavepy:hover .body .hand.right,

input:checked + .pavepy .body .hand.right,

input:checked + .pavepy:hover .body .hand.left,

input:checked + .pavepy.fox .head .ear.right {

-webkit-transform: rotate(-30deg);

-moz-transform: rotate(-30deg);

-ms-transform: rotate(-30deg);

-o-transform: rotate(-30deg);

transform: rotate(-30deg);

}

```

**Disclaimer.** Некоторые свойства я намеренно опустил, дабы не было слишком много кода.

##### CSS Transitions или они улыбаются!

Несмотря на внушительную уже поддержку браузерами этого свойства без преффикса, я решил использовать полную запись со всеми преффиксами:

```

.pavepy .head > .nose {

width: 30px;

height: 15px;

top: 55px;

border-bottom: 2px solid rgba(255,255,255,.5);

border-radius: 50%;

margin: 0 auto;

position: relative;

-webkit-transition: all 0.3s;

-moz-transition: all 0.3s;

-ms-transition: all 0.3s;

-o-transition: all 0.3s;

transition: all 0.3s;

}

.pavepy:hover .head > .nose,

input:checked + .pavepy .head > .nose {

border-bottom: 6px solid rgba(255,255,255,.5);

}

```

Пусть это и нос, но они улыбаются. Меняем толщину нижнего бордюра при 50%-ном радиусе. Получается весьма забавный эффект.

##### CSS Transforms или они нам машут!

Расмотрим пример с движением «ручек» наших зверюшек.

При наведении мыши, ручки должны подниматься на 30 градусов относительно линии горизонта. Так как ручки первоначально опущены (примечательно, также на 30 градусов), то плодить лишнего кода не нужно, и мы просто объединяем свойства поворота для левой руки и правой руки при наведении, и правой руки и левой руки при наведении:

```

.pavepy .body .hand.left,

.pavepy:hover .body .hand.right {

-webkit-transform: rotate(-30deg);

-moz-transform: rotate(-30deg);

-ms-transform: rotate(-30deg);

-o-transform: rotate(-30deg);

transform: rotate(-30deg);

}

```

У лисички аналогично поворачиваются ушки. Там также выбран поворот на 30 градусов, так что к коду, представленному выше, добавляются еще несколько строк для ушек.

```

.pavepy .head > .ear {

width: 50px;

height: 50px;

border-radius: 50%;

/* Подобная связка обеспечивает нам идеальный круг */

}

.pavepy.fox .head > .ear {

top: -10px;

width: 80px; /* Делаем из круг эллипс, так как ширина уха заявлена чуть выше, мы ее не переопределяем */

-webkit-transition: all 0.5s;

-moz-transition: all 0.5s;

-ms-transition: all 0.5s;

-o-transition: all 0.5s;

transition: all 0.5s;

}

/* Делаем сплюснутый эллипс для ушек лисички */

.pavepy.fox .head > .ear.left {border-radius: 0 100%; left: -25px;} /* Удобно использовать двойные классы для правых и левых элементов */

.pavepy.fox .head > .ear.right {border-radius: 100% 0; right: -25px;}

```

##### Прыжок с помощью :checked

Взяв самый обычный input с **type='checked'**, мы можем использовать псевдокласс :checked

При клике, я решил, чтобы зверюшки подпрыгивали вверх и замирали там. Для этого, используя transitions, я менял высоту ножек, отступ снизу для зверюшки.

Чтобы зверюшка не замирала при наведении мыши, когда она находится в состоянии :checked, было решено еще немножечко поднимать ручки: на 45 градусов.

Чтобы на клик зверюшки реагировали везде, input был сделан прозрачным, и на всю ширину и высоту:

```

.wrapper > ul li input {

display: block;

opacity: 0;

position: absolute;

width: 100%;

height: 100%; /* задав размеры родительскому контенту можно оперировать процентами */

left: 0;

top: 0;

}

```

##### Меняющийся текст

Свойства **opacity**, **delay** в **transitions** и никакой магии. Есть два блока text и text1:

```

.pavepy .body .text {

margin: 0px auto; /* Центрируем */

padding-top: 35px;

position: relative; /* не absolute, так как с последним не работает центрирование margin: 0 auto*/

text-align: center;

text-shadow: 1px 1px 1px rgba(255, 255, 255, 0.506);

width: 80px;

z-index: 10; /* Таким образом этот текст находится поверх второго */

-webkit-transition: all 0.5s 0.3s;

-moz-transition: all 0.5s 0.3s;

-ms-transition: all 0.5s 0.3s;

-o-transition: all 0.5s 0.3s;

transition: all 0.5s 0.3s;

}

.pavepy:hover .body .text {

opacity: 0; /* При наведении мыши скрываем, чтобы второй блок смог появиться */

}

.pavepy .body .text2 {

margin: -18px auto; /* смещаем, чтобы строки совместились */

position: relative;

text-align: center;

text-shadow: 1px 1px 1px rgba(255, 255, 255, 0.506);

width: 80px;

z-index: 5; /* Таким образом, этот текст не накладывается на предыдущий при уведении курсора*/

opacity: 0; /* По-умолчанию прозрачен */

-webkit-transition: all 0.5s 1.0s;

-moz-transition: all 0.5s 1.0s;

-ms-transition: all 0.5s 1.0s;

-o-transition: all 0.5s 1.0s;

transition: all 0.5s 1.0s; /* delay в 1 секунду прекрасно выполняет свою функцию */

}

.pavepy:hover .body .text2 {

opacity: 1;

}

```

#### Баги

Я не стал проводить долгие часы в установке разных версий браузеров, но все равно нашел несколько курьезов:

* **Opera:** в последней версии (12.10), если мы возвращаем зверюшек на землю, **transitions** работает некорректно — происходит рывок. В предыдущей версии Opera такого нет;

* **Opera:** не работает псведокласс **:active** из-за проблем со слоями: **input** и **div**-родителя зверюшки;

* **Chrome:** отчего-то происходит дрожание скругленных краев блоков;

* В основном, полет нормальный, в IE10 работает все максимально плавно, в Opera на слабой машине подтормаживает, тогда как Chrome плавно все делает. Safari также не подкачала.

P.S.: Для свойств opacity, box-shadow, border-radius, text-shadow я не прописывал префиксы, так как беспрефиксовые вариации уже давно были введены. Transitions без префиксов хоть и добавлены у Firefox, Opera и Internet Explorer 10, но совсем недавно.

P.S. 2: В планах научить их издавать звуки, моргать и привести в более приятный и уникальный вид. | https://habr.com/ru/post/159161/ | null | ru | null |

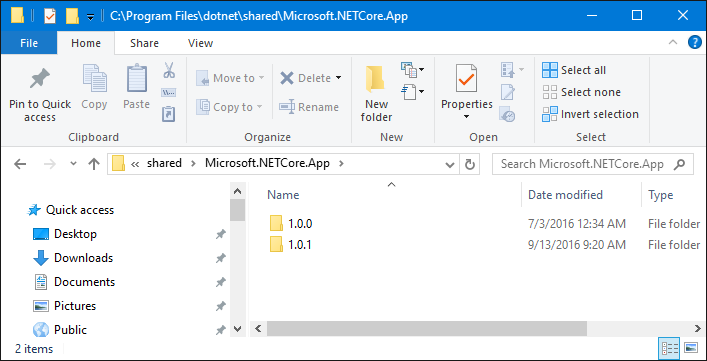

# Self-contained дистрибуция .NET Core приложений

[](http://habrahabr.ru/post/311520/)

Если вы вдруг пропустили, то .NET теперь open source, а .NET Core это бесплатный, open source, кроссплатформенный фреймворк, который вы можете скачать и запустить за время <10 минут. Вы можете получить его на Mac, Windows и на пол-дюжине Unix-ов с сайта [dot.net](http://dot.net) Попробуйте его вместе с бесплатной, кроссплатформенной Visual Studio Code и вы будете писать на C# и F# всегда и везде.

OK, с учётом вышесказанного, есть два способа развертывать .NET Core приложения. Это FDD и SCD. Поскольку ТБА (трехбуквенные акронимы) это глупо, то это Framework-dependent и Self-contained Deployment.

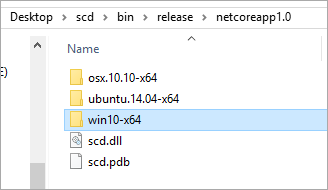

Когда .NET Core устанавливается, то он находится, например, в C:\program files\dotnet на Windows. В директории “Shared” есть куча .NET штук, которые, скажем так, shared т.е. общие. Может быть множество директорий внутри, как вы можете увидеть ниже в моей папке на скриншоте. У вас может быть множество установок .NET Core.

Когда вы устанавливаете свое приложение и его зависимости, НО НЕ .NET Core само, то вы зависите от .NET Core, которое уже установлено на целевой машине. Это прекрасно для Web Apps или для систем с большим количеством приложений, но что если я захочу написать приложение и дать его вам в качестве zip или на usb флешке и я просто хочу чтобы оно работало. Я могу включить .NET Core в придачу, тогда из всего это и получится Self Contained Deployment.

Я сделаю мое «Hello World» приложение по размеру больше, чем оно было бы, используя общесистемную установку, но я буду знать, что оно будет Просто Работать потому что оно полностью самостоятельное.

Если я разверну мое приложение вместе с .NET Core, то важно помнить, что я буду ответственен за сервис .NET Core и поддержку его в актуальном обновленном состоянии. Также мне нужно выбрать целевые платформы заранее. Если я хочу, чтобы оно запускалось на Mac, Windows и Linux И просто работало, то мне нужно включить эти целевые платформы и построить пакеты для них. Это все интуитивно понятно, но хорошо и знать наверняка.

Для примера, я возьму мое небольшое приложение (я использую простое “dotnet new” приложение) и модифицирую project.json в текстовом редакторе.

Мое приложение это .NETCore.App, но оно не будет использовать платформу .NET Core, которая установлена. Она будет использовать локальную версию так что я удалю “type=“platform”” из зависимостей. Вот что останется:

```

"frameworks": {

"netcoreapp1.0": {

"dependencies": {

"Microsoft.NETCore.App": {

"version": "1.0.1"

}

}

}

}

```

Далее я добавлю runtimes секцию, чтобы указать какие из runtime я хочу задать. Список всех [Runtime IDE находится здесь](https://docs.microsoft.com/en-us/dotnet/articles/core/rid-catalog)

```

"runtimes": {

"win10-x64": {},

"osx.10.10-x64": {},

"ubuntu.14.04-x64": {}

}

```

*Примечание переводчика (на всякий случай): эта секция добавляется перед последней скобкой*

После запуска команды «dotnet restore» вам захочется построить проект для каждого из runtime таким образом:

```

dotnet build -r win10-x64

dotnet build -r osx.10.10-x64

dotnet build -r ubuntu.14.04-x64

```

И после этого опубликовать релиз после того как вы протестировали и т.п.

```

dotnet publish -c release -r win10-x64

dotnet publish -c release -r osx.10.10-x64

dotnet publish -c release -r ubuntu.14.04-x64

```

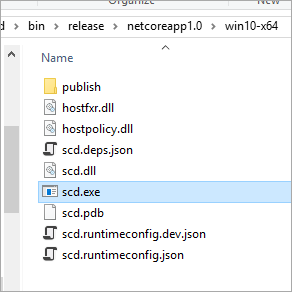

После того, как это сделано, я получу мое портативное приложение в n папках, готовое для разворачивания на любой системе, на какой мне захочется.

Вы можете увидеть в директории Win10 приложение «MYAPPLICATION.exe» (мое называется scd.exe) которое может быть запущено сразу, а не с помощью этих штук, вроде “dotnet run”, которые используют разработчики.

В [.NET Core Docs](https://docs.microsoft.com/en-us/dotnet/articles/core/deploying/index) есть уйма хорошей документации, по поводу того как настроить и определить точно, что будет развернуто с вашим self-contained приложением. Вы можете также обратить внимание на статью [trimming to .NET Core](https://docs.microsoft.com/en-us/dotnet/articles/core/tutorials/managing-package-dependency-versions), где ведется речь о том, что в будущем все станет более автоматическим, возможно вплоть до уровня метода. | https://habr.com/ru/post/311520/ | null | ru | null |

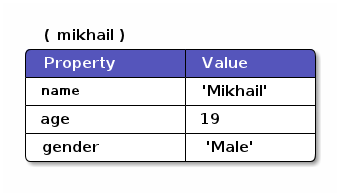

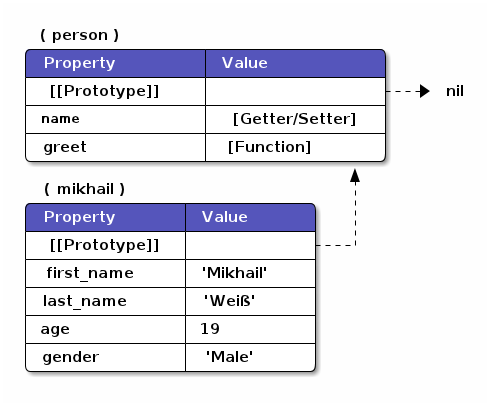

# Работа с Freebase из .NET

Недавно начал работать над проектом, который требует информацию о фильмах, музыке, книгах. Для этого необходимо наполнить базу данных из другого ресурса. Решил воспользоваться свободной базой данных Freebase.

Freebase — большая база знаний, содержащая структурированные данные, собранные из множества различных источников. На данный момент она насчитывает примерно 23 миллиона тем. Каждая тема ассоциирована с одним или несколькими типами (люди, места, фильмы).

Для получения данных из Freebase существует несколько вариантов:

* Скачать dump базы данных (это можно сделать [тут](http://download.freebase.com/datadumps/))

* Использовать API

Постоянное восстановление из дампа отбросил сразу (хочется чего то более автоматизированного). Стал разбираться дальше. Для работы с API необходимо воспользоваться одним из 6 сервисов:

* Search Service — поиск сущностей по ключевому слову;

* Mql Read Service — извлечение детализированных данных о сущностях;

* Topic Service — извлечение всей информации о сущности;

* RDF Service — извлечение всей информации о сущности в RDF формате;

* Text Service — извлечение короткого описания для сущности;

* Image Service — получение картинки для сущности.

Первая задача которая передо мной стояла сделать autocomplete с использованием Freebase и последующей записью в свою базу данных. Для этой цели подходят два сервиса: Search Service и Mql Read Service. Выбрал второй так как с помощью него можно не только найти но и получить дополнительную информацию. Сразу же загуглил на предмет готовых либ (не люблю писать велосипеды). Все что удалось найти [freebase-dotnet](http://code.google.com/p/freebase-dotnet/) (использует старый API) и [google-api-dotnet-client](http://code.google.com/p/google-api-dotnet-client/). Обе либы не реализуют асинхронных возможностей C#.

Поэтому вынужден был писать свою либу, которую можно найти [здесь](https://freebase4net.codeplex.com/). Она пока ещё в бета версии, но по ходу текущего проекта я её дорабатываю и делаю стабильной, так как она будет использоваться в продакшине.

Прописав в nuget поиске Freebase4net, устанавливаем готовый package.

Чтобы пользоваться API нам надо получить ключ у [Google](https://code.google.com/apis/console/) (metaweb был куплен гуглом). Количество возможных запросов ограничено 100k запросов в день.

Для установки ApiKey мы можем сделать так

```

FreebaseServices.SetApiKey("YOUR API KEY");

```

либо так

```

```

Дальше создаем необходимый сервис:

```

MqlReadService readService = FreebaseServices.CreateMqlReadService();

```

Для поиска по имени сущности нужно отправить следующий MQL запрос, который использует regex:

`[{

"type":"/music/artist",

"name":null,

"name~=":"^The Sco*$"

}]`

Делается это очень просто с использованием dynamic:

```

dynamic films = new ExpandoObject();

films.type = "/film/film";

films.name = FreebaseHelpers.Operators.CreateLikeOperator("^The Sco*$");

```

Теперь собственно делаем запрос и получаем данные. Синхронно

```

MqlReadServiceResponse result = _readService.Read(films);

```

или асинхронно

```

MqlReadServiceResponse result = await _readService.ReadAsync(films);

```

Под капотом используется новый HttpClient и его асинхронные возможности.

Далее получаем имя сущности

```

var name = result.Results[0].name;

```

Results — массив dynamic. Так как ответ зависит от запроса, то есть динамический.

P.S. Существует уже готовый [autocomplete](http://wiki.freebase.com/wiki/Freebase_Suggest), который имеет достаточно привлекательный вид и функционал. Но мне надо было сделать свою логику по кешированию данных в свою базу данных.

С autocomplete разобрались, едем дальше. Далее на странице фильма мне надо вывести описание и картинку. Для этого можно воспользоваться Topic Service, но его структура ответа достаточно сложная — надо разбираться где достать нужную информацию. Для упрощения были созданы TextService и ImageService. Поэтому решил использовать их.

```

string id = "/en/the_animal";

var textService = FreebaseServices.CreateTextService();

var response = await textService.ReadAsync(id);

string description = response.Result;

```

Получение ссылки на картинку:

```

string id = "/en/the_animal";

var imageService = FreebaseServices.CreateImageService();

string image = imageService.GetImageUrl(id, maxwidth: "150");

```

Если же вам надо сделать несколько запросов асинхронно реализован функционал.

```

dynamic thescorpions = new ExpandoObject();

thescorpions.name = "The Scorpions";

thescorpions.type = "/music/artist";

dynamic thepolice = new ExpandoObject();

thepolice.name = "The Police";

thepolice.type = "/music/artist";

List multiFreebaseResponse = readService.ReadMultipleAsyncWithWait(thescorpions, thepolice);

```

Если у вас есть идеи как это можно было сделать лучше, буду рад их услышать. | https://habr.com/ru/post/164709/ | null | ru | null |

# Генерация простых чисел

В продолжение темы, начатой в [этой серии статей](https://habr.com/ru/post/467463/), сегодня мы поговорим о генерации простых чисел. Генерация бывает вероятностной и бывает гарантированной. Так вот, наш случай — с гарантией, которая позволяет использовать получаемые числа в приложениях, связанных с криптографией, что обеспечивает, например, безопасность распоряжения вашими деньгами через банковские приложения. Далее вы увидите, как гарантированно получать простые числа достаточного для криптографии размера, а так же какими могут быть проблемы, если пренебречь гарантиями.

Общая схема обеспечения безопасности при обмене данными опирается на сложность разложения большого составного числа на множители. При этом если множителей много, то они будут маленькими, а это сильно упрощает взлом системы безопасности. Поэтому большое составное число получают при помощи умножения двух простых чисел определённого размера. Но здесь очевидна одна проблема — как выбрать достаточно большое простое число?

Сначала определимся с размером. В современной криптографии порядок составного числа определяется формулой , то есть собственно порядок равен 2048 в двоичной систем счисления. А делители у этого составного числа бывают порядка 1024, то есть где-то около значений . Почему 1024? Потому что уже лет десять назад было разложено на множители число порядка 768, а сегодня уже весьма вероятно разложение составных чисел порядка 1024. Вот и решено для надёжности увеличить порядок сразу в два раза, то есть до 2048. Ну а отталкиваясь от этого порядка легко определить порядок необходимых сомножителей.

Но что будет, если порядок сомножителей окажется много меньше 1024? Тогда за приемлемое время можно разложить составное число, даже если оно имеет порядок 2048. Значит нужно гарантировать, что выбранные нами сомножители действительно имеют порядок близкий к 1024 и при этом являются простыми, то есть не разлагаются на множители. Но вот сам выбор осуществляется по вероятностной схеме, а это как раз и ведёт к потенциальным проблемам.

Проверка вероятности простоты числа осуществляется на основе предположения о том, что число «скорее всего» простое, если его период (о котором рассказывается [здесь](https://habr.com/ru/post/467203/)) является делителем самого числа, минус единица (). В виде формулы это выглядит так:

Здесь  — исследуемое число,  — значение от  до  (оно определяет основание системы счисления, в которой вычисляется период),  — период исследуемого числа. Операция  здесь означает взятие остатка от деления первого операнда на второй.

Существующие проверки опираются именно на такой подход, поскольку для больших чисел безусловное определение простоты известными тестами занимает очень много времени. Но минус такой проверки очевиден — иногда можно получить составное число, вместо простого. При этом какие делители окажутся в составе такого числа — никто не знает. Точнее это сможет выяснить злоумышленник, применив известные методы факторизации, которые начинают работать за приемлемое время, если множители окажутся порядка менее чем несколько сотен бит.

Как часто ошибается вероятностная проверка простоты? Достаточно редко. Бывает одна ошибка на несколько десятков тысяч простых, а бывает и две, но ничто не гарантирует нас и от трёх. Кроме того, многое зависит от используемого теста. Так, например в стандартной библиотеке языка Java в классе BigInteger реализована проверка, которая допускает промах 2-3 раза на тысячу простых. То есть не стоит думать, что если теоретически ошибок очень мало, то и на практике всё будет в шоколаде.

Чем это опасно? Вроде бы и не так страшно, как могут сказать некоторые, ведь ну что с того, если какой-нибудь сайт, закрывающий просмотр своих страниц протоколом https, получит легко вычисляемый ключ, то какие от этого будут проблемы? Ну узнают хакеры, какие новости вы читали на этом сайте, а что толку? Но на самом деле шифрование производится не только при просмотре веб-страниц. Более неприятная ситуация случится, если хакеры узнают ключ вашего любимого банковского сервиса по дистанционному управлению вашими деньгами. Хотя опять же, вроде бы для того, чтобы наверняка вскрыть обмен с банком (и если банк использует слабую проверку простоты), хакеру придётся ждать примерно 500 лет, пока наконец реализуется вероятность выпуска легко вычисляемого ключа, ведь ключи обычно имеют срок действия 1 год и потому чтобы гарантировать взлом нужно ждать пока не будут проведены 500 выпусков нового ключа. Вроде всё логично, но есть очередное «но» — банков на свете гораздо больше, чем 500 штук. Поэтому прямо сейчас, возможно именно в вашем любимом банке, хакеры могут получить доступ к вашим же деньгам.

Испугались? Наверняка нет, ведь все мы очень смелые, пока жареный петух не клюнет. Но пугаться всё же есть чего. Пусть вероятность успешной атаки хакеров именно на ваш банк и не так высока, но тем не менее, если она реализуется, то ваши деньги наверняка не найдут. Почему? Очень просто — стандартное первое предположение службы безопасности банка — виноват кто-то из сотрудников с соответствующими правами доступа. Не хакер, вероятность вмешательства которого они тоже рассматривают как минимальную, а именно кто-то свой. Поэтому хакер вполне может остаться безнаказанным.

Как устранить эту проблему? Нужно научиться получать гарантированно простые числа. Но как гарантировать их простоту? Для этого существуют четыре метода.

Первый метод — перебор с минимумом ограничений. Обычно это вариант усовершенствованного решета Эратосфена. Метод надёжный и гарантированный, но ограничен очень скромными порядками (менее сотни). Поэтому такой метод неприменим в криптографии.

Второй метод — перебор с более сильными ограничениями. Так, если период числа равен самому числу, минус один, то число гарантированно простое. Формула здесь такая — . Но вот для определения равенства периода разности числа и единицы, используются очень тяжёлые методы, которые работают не для всех классов чисел. Поэтому применение их в криптографии упирается либо в ограниченность количества чисел специфических классов, либо во время выполнения проверки, если мы будем наращивать размер числа. И кроме того, даже числа определённого класса сами по себе ничего не гарантируют, что означает необходимость перебирать много чисел-кандидатов. Вот, например, числа Мерсенна, для которых есть безусловный тест простоты, уже все перебрали и выяснили, что в используемом в криптографии диапазоне их практически нет. Вот весь их список с близкими порядками — 1279, 2203, 2281, 3217. Как вы видите, от 1024 до 2048 есть лишь одно подходящее число. Но даже если взять остальные, то их количество нам очень наглядно намекает — не стоит! Значит опять нам не повезло с методом проверки.

Третий метод — вероятностный. Именно его сегодня используют, в том числе, в вашем любимом банке. Как он работает? Очень просто — проверяется остаток от деления произвольного числа в степени  на , если остаток равен единице — вероятно, что число простое. И вот слово «вероятно» здесь наиболее неприятное. И хотя вероятностные методы проверки простоты содержат ещё и дополнительные улучшения, но тем не менее, как было показано выше, стандартная библиотека Java довольно часто ошибается.

И наконец, четвёртый метод. Он работает не так быстро, как вероятностные тесты (хотя и здесь можно кое-что оптимизировать), но зато даёт гарантированно простые числа, да ещё и с легко определяемым периодом. Для чего нужен период простого числа, спросите вы? Например для генерации псевдослучайной или шифрующей последовательности. Точнее, зная период, мы точно знаем, сколько чисел будет в последовательности, что позволяет легко планировать, как долго мы можем использовать генератор последовательности на основе данного числа. Правда это уже относится к симметричному шифрованию, но тоже может пригодиться в ряде случаев. Далее же мы рассмотрим теорию гарантирующей простоту проверки чисел-кандидатов.

### Теоретические основы

Чтобы понять, как генерировать гарантированно простые числа, нужно немного погрузиться в математику. Но не пугайтесь, математика здесь на уровне пятого класса.

Для полноты понимания рекомендуется посмотреть [здесь](https://habr.com/ru/post/467203/) подробности о том, что такое период и ряды остатков. Ну а кратко скажем, что ряд остатков образуется при делении «уголком» (известный любому школьнику метод) единицы на выбранное для исследования число. При этом на каждом шаге появляется разность между выше расположенным числом, с дописанным к нему ноликом, и произведением исследуемого числа на значение от 0 до 9 (для десятичной системы счисления) — это и есть остаток. Но шагов при делении «уголком» много, поэтому и остатков тоже много, а вместе они образуют ряд остатков, в котором один и тот же набор чисел периодически повторяется бесконечное число раз. Признаком начала нового цикла является остаток, равный единице. Количество остатков между единицами — это длина периода (или цикла). Вот, собственно, и всё, но также стоит понимать, что такой метод построения ряда остатков можно применить, используя любую систему счисления, и в частности далее чаще всего будет использована система с основанием 2 (а не 10, как принято в школе). При использовании других систем счисления все правила сохраняются, но количество вариантов произведений на каждом шаге будет другим, равным b (от base), то есть основанию системы счисления.

Итак, из ранее показанного мы знаем, что составные числа всегда дают относительно короткие периоды, не включающие ряд «запрещённых» значений. Зная разложение составного числа на множители легко вычислить, сколько значений обязаны отсутствовать в ряде остатков, формирующих период данного числа. Ряд остатков не будет содержать множители и все числа, кратные этим множителям, если сам ряд построен по основанию системы счисления, не кратному ни одному из делителей (то есть основание не делится на делители числа). Например, если множителей всего два, то количество кратных им остатков определяется по формуле , где  — количество кратных остатков,  и  — множители, формирующие наше составное число. Зная количество «запрещённых» остатков, легко вычислить, что ряд остатков длиною более половины значения , будет иметь длину, равную . То есть такой ряд будет на  короче, чем ряд, который получился бы, если данное число было бы простым. Это объясняет, почему все числа с периодом, равным полному периоду (то есть ), оказываются простыми — если бы из последовательности остатков был исключён хотя бы один элемент (который «запрещён»), то период стал бы меньше . В результате наличия такой закономерности мы наблюдаем работоспособность всех тех вероятностных тестов, которыми сегодня проверяют простоту числа. Эти тесты вычисляют значения в ряде остатков на позиции  или , и если значения равны  или , то можно с большой вероятностью утверждать, что число простое. Почему лишь с большой вероятностью, а не гарантировано? Потому что период вероятностные тесты не вычисляют, а между позициями  и  могут встретиться ещё единицы, что будет означать неравенство периода значению , но если период не равен , то число может быть составным. При этом само по себе отсутствие равенства не критично, важно другое — такое расположение единиц могут дать псевдопростые числа. Среди проверенных таким тестом чисел можно найти псевдопростые, которые являются составными и тем помогают хакерам, ворующим ваши деньги. Ведь каковы делители таких составных чисел? Они вполне могут оказаться достаточно малыми для того, чтобы злоумышленник легко вскрыл зашифрованный обмен данными.

Теперь вспомним, почему вообще могут появляться псевдопростые числа. Такие числа имеют короткие периоды, которые повторяются много раз в пределах полного периода , а потому иногда могут «вмастить» и уложиться целое количество раз в полный период. Так, например, число 25 имеет период длиною 4 для системы счисления с основанием 7.  для 25 равно 24, попробуем поделить: 24/4=6. То есть данный период уложился целое число раз в полный период. Этот факт можно проверить по приведённой выше формуле для сокращения периода, но с учётом того факта, что a и b в данном случае одинаковы. Максимально возможный период будет равен 24-4=20, здесь 24 — полное количество остатков, 4 — количество остатков, кратных 5. Но период не всегда бывает максимальным, а все остальные варианты можно получить поделив нацело максимальный период. 20 делится на 2,4,5,10, и как раз при делении 20 на число из приведённого списка мы получаем период длиною 4, который и даёт нам в конце полного периода  единицу. А при проверке простоты проверяют как раз значения на позиции , то есть последнее значение в полном периоде. И для 25 оно равно 1, что является признаком простоты числа. Хотя на самом деле однозначный признак простоты, это когда для всех оснований систем счисления, менее , последнее значение в полном периоде равно единице. Но проверять все системы счисления для больших чисел нет никакой возможности, вот и появляются псевдопростые числа, которые иногда используются даже в криптографии, чем повышают уязвимость наших финансов.

Как устранить влияние псевдопростых чисел? В принципе просто — можно проверить периоды для всех систем счисления, но тогда на эту операцию для больших чисел не хватит никакого времени. Поэтому мы пойдём другим путём. И путь тоже простой (в буквальном смысле — в нём используются другие простые числа). Мы видели, что короткие периоды могут уложиться в полный период целое число раз, и это даёт нам псевдопростые числа. Но что нам мешает эти понедельники «взять и отменить»? Да в общем-то, ничего не мешает.

Для существования коротких периодов полный период () должен делиться на много делителей. Так для числа 25 полный период 24 делится на 2, 3, 4, 6, 8, 12. Вот столько есть возможностей для проникновения на охраняемую территорию псевдопростых чисел. Значит нам нужно просто взять в качестве полного периода простое число, ведь оно вообще ни на что не делится и потому автоматически спасает нас от вражеского элемента. Правда есть одно «но» — нам нужны простые числа, а они, как известно, нечётные (кроме одного исключения — 2), значит если  простое, то само  простым уже быть не может. Поэтому нам придётся допустить возможность для появления неполных периодов. Чем это плохо? Как мы видели выше — полный период гарантирует простоту числа, а вот про неполный — мы пока не доказали. Значит нам нужно доказать данный момент.

Доказательство довольно простое — для составного  период, длиною, укладывающейся в  два раза, полученный в системе счисления, не кратной делителям N, имеет всего два ряда остатков, и ни один из них не должен содержать чисел, кратных делителям числа  («запрещённых» чисел). Если исключается хоть один элемент из одного ряда остатков, то и второй автоматически уменьшается на столько же (ведь один ряд равен другому, домноженному на любое число, отсутствующее в первом). Значит при наличии делителей у числа , мы получим меньшую суммарную длину двух периодов со всеми «разрешёнными» остатками, нежели значение полного периода и тем самым сдвинем единицу с места в конце полного периода, чем обеспечим отсутствие псевдопростоты. Но может ли количество кратных делителям остатков оказаться таким, чтобы дать ровно половину или одну треть полного периода? Ведь тогда мы получили бы, например, две трети «разрешённых» остатков (два ряда) и одну треть «запрещённых», а в сумме — полный период. Но для получения одной трети нам нужно обеспечить делимость полного периода () на 3, что мы можем довольно легко исключить — берём простое число, умножаем его на два и прибавляем к результату единицу — вуаля, перед нами гарантированно исключающее псевдопростоту число. У него количество кратных делителям остатков не может быть равным одной третьей полного периода, потому что на три полный период не делится. Остаётся вариант с половиной остатков, кратных делителям . Этот вариант устраняется чуть сложнее, поэтому ниже будет небольшое отступление.

### Вычисление периода, или все числа — дети Мерсенна

Период любого числа можно вычислить. В простейшем случае вычисление производится простым делением уголком  до тех пор, пока нам не встретится остаток, равный единице (в системе счисления, не кратной делителям ). Но для больших чисел это нереально долго. Поэтому есть необходимость в выводе формулы для вычисления периода. И такая формула существует, правда не в идеальном виде, когда на входе имеем число, а на выходе — период. Формула такая:

Здесь  — исследуемое число,  — основание используемой системы счисления (base),  — максимальная степень , при которой результат возведения в степень меньше  (по другому — индекс старшего разряда в  в системе счисления ),  — расстояние слева направо в ряду остатков от индекса  (равного количеству разрядов в ) до единицы,  — некоторый целый коэффициент.

### Вывод формулы

По определению формулы понятно, что **(1)** , то есть первая степень , которая больше , позволяет вычесть  и получить некую разницу в виде . Так же из определения следует, что **(2)** , здесь  — целочисленный коэффициент. Если домножить **(1)** на  и заменить  на его значение из **(2)**, которое равно , то получим .

### Полезные свойства

Как мы видим, используя эту формулу можно получать числа с заранее известным периодом. Правда есть одна сложность — нужно подбирать коэффициент , что для больших чисел опять превращается в нечто недостижимое. Но формула даёт нам другое — мы наглядно видим, как формируются все числа. Да, абсолютно все положительные целые числа можно получить по этой формуле, ведь у всех чисел есть какой-то период. И что интересно — все числа получаются от деления числа Мерсенна на один из его делителей. Вспомним, что числом Мерсенна называется такое число, которое равно . В формуле же в числителе мы видим обобщение для чисел Мерсенна с любым основанием (включая 2, разумеется). И если нас интересуют простые числа, то другие основания, кроме 2, нам вообще не понадобятся.

Зная, что мы делим число Мерсенна, нам было бы полезно уметь вычислять период чисел именно для случая деления чисел Мерсенна (вспомним расширенное понятие периода [здесь](https://habr.com/ru/post/467463/)). Но что очень замечательно — формула для вычисления мерсенновского периода совпадает с формулой для вычисления периода типа . Ну а для вывода формулы деления чисел Мерсенна используется тот же принцип, что и при выводе формулы для деления , за исключением формулы для вычисления значения в ряде остатков с индексом , которая выглядит так — , а для двоичных чисел получаем .

Теперь у нас все карты на руках и мы можем начинать игру по вскрытию псевдопростых засланцев в рядах простых чисел.

Как мы знаем из предыдущих серий, при делимости нацело мерсенновский период числа должен укладываться в количество разрядов числа Мерсенна целое число раз. Поэтому в формуле выше решение в целых числах возможно лишь если знаменатель имеет период либо равный числителю, либо кратно меньший. Но кратно меньший период даст нам, в том числе, и делители самого числа , ведь если  делит число Мерсенна, то значит и его делители тоже делят число Мерсенна. И это очень важный момент, ведь из него вытекает, что длины периодов делителей N делят длину периода  нацело. То есть если мы возьмём  такое, что его период равен периоду числителя, тогда все делители  будут одновременно и делителями числа Мерсенна, а потому должны укладываться в период и , и числа Мерсенна целое число раз.

### Снова про половину периода

Теперь вспомним, что мы остановились на поиске способа доказать, что мы можем исключить случай, когда половина длины ряда остатков числа кратна его делителям. Доказать мы это хотели для устранения псевдопростых чисел при выборе одного простого числа в качестве основы для конструирования периода следующего простого числа. Так вот теперь мы знаем, что если конструируемое число имеет делители, то их периоды всегда делят период конструируемого числа нацело. Тогда нам остаётся проверить — какие делители могут уложиться в ранее заданные ограничения на конструируемое число. А ограничения такие — его период делится лишь на  и на . Значит и делителями могут быть лишь числа с периодами  и . Период  имеет число , более ни одно число такого периода не имеет. Период  не укладывается целое количество раз в , ведь  — простое, поэтому делимость на три исключается при таком периоде. Значит остаётся лишь одна возможность — делители имеют период . Но число не может быть меньше или равно своему периоду, поэтому минимальное значение для делителей такое — . Если перемножить два минимальных делителя, то получим — , такое значение должно быть не больше , ведь мы говорим о делителях . Тогда получаем неравенство . Это неравенство может быть отрицательным или равным нулю только при , поэтому для всех сконструированных таким способом чисел псевдопростота исключена, если полученное число больше . Ну а для меньших чисел мы можем проверить простоту даже в уме.

Теперь есть два варианта — новое число простое число, что нам и требовалось, либо это число составное и тогда его период не укладывается целое число раз в полный период, а потому такое число легко проверить на простоту, вычислив последнее значение в полном ряду остатков. То есть сконструированное число можно смело проверять стандартными вероятностными тестами простоты, и что важно, результат теста будет уже не вероятностный, а гарантированный. Вот так в итоге мы освободились от проклятия псевдопростоты, давлеющей над всеми вероятностными тестами.

Но конечно, жизнь была бы мёдом, если бы все проблемы решались так просто. Исключив псевдо-простоту, мы так и не исключили числа, которые ни от кого не прячутся и ни подо что не маскируются. А с ними есть ещё одна проблема — мы пока что умеем проверять произвольный член последовательности остатков лишь при помощи возведения в степень с последующим взятием остатка. Но такой метод очень медленный. Точнее, он достаточно быстр для чисел, используемых в криптографии, но вот для поиска больших простых он не пригоден в домашних условиях, ибо требует много лет вычислений обычного домашнего компьютера, что не даёт нам возможность получить 400k$ (как показано [здесь](https://habr.com/ru/post/467463/)).

Но тем не менее, для вычисления криптографических простых у нас уже почти всё готово. Хотя остаётся ещё наш старый друг — максимализм. Он спрашивает — раз можно использовать период , то что мешает использовать периоды  и т.д.? И оказывается, что при должной осторожности — ничего не мешает!

Точно так же, как и в случае с периодом , для периода  имеем возможность задать ограничение снизу, умножив простое число на 4 и прибавив 1. Тогда мы гарантируем себя от псевдопростых с периодами менее . Значит остаётся рассмотреть возможность появления псевдопростых с периодом, кратным 4, 3, 2 (1 для составных исключается, как показано выше). Из формулы для вычисления числа по периоду видно, что период делимого числа должен быть равен наименьшему общему кратному его делителей, из чего следует, что возможный период числа  должен не только укладываться целое количество раз в  (иначе не будет псевдопростоты), но и содержать в себе целое количество периодов делителей. Таким образом резко ограничивается количество возможных делителей псевдопростого числа. Поскольку период любого числа не может быть длиннее , то для возможного делителя , дающего в результате деления 3, период не может быть длиннее , кроме того учтём, что период числа 3 равен 2.  должно быть нечётным, поскольку нечётным является . Из перечисленного следует, что чётный период N/3-1 является наименьшим общим кратным с периодом 2 числа 3, значит возможный период потнециально псевдопростого N должен быть равен периоду числа . Всего есть одно значение величины периода , для которого возможна псевдопростота, это . Для остальных значений либо  слишком мало, либо его период (а вместе с ним и период ) уйдёт в запрещённую область ниже . Такая же история и с нечётными числами, меньше , но у них периоды не могут быть больше , а потому все они просто исключаются из рассмотрения. Теперь покажем, что  не может иметь период , а значит не может делить полный период нацело. Сначала вспомним формулу , которая даёт нам количество кратных делителям остатков для числа, делящегося только на  и . В нашем случае , как предполагается, может делиться на  и на 3, все остальные делители исключены, поэтому получаем — . Теперь из полного периода нужно вычесть «запрещённые» значения, которых будет , а потом разделить на 4. Получаем возможный период произведения : , что меньше , то есть период длиной  невозможен из-за необходимости учитывать «запрещённые» остатки, которая уводит все возможные псевдопростые периоды в запрещённую область (меньше ). Значит такая ситуация гарантирует нам, что сконструированное число не псевдопростое, а потому мы снова можем быть уверены в результатах последующего вероятностного теста простоты.

Аналогично, и с учётом делимости полного периода, можно получить такие же результаты и для других значений. Но если мы хотим так получать криптографические простые числа, то домножая на 2,4,6 мы будем очень долго наращивать размер числа, поэтому есть смысл посмотреть в сторону другого варианта — умножения двух простых чисел. Если мы умножим одно простое на другое, то получим нечётное число, поэтому обязательно нужно домножить ещё и на 2, чтобы получить чётный полный период и нечётное число-кандидат в простые. Полный период в таком случае будет делиться на , где  и  — простые числа. Теперь нам нужно доказать, что либо указанные периоды не дадут псевдопростоты, либо обнаружить признаки, предупреждающие нас о наличии псевдопростоты. Сразу заметим, что если период будет равен , то число будет простым (как показано выше). Так же выше показано, что число с половинным периодом не может быть псевдопростым, поэтому период длиной  можно исключить. Хотя для полноты картины можно проверить период  альтернативными способами. Так, если период равен , то учитывая, что  и  простые, становится понятно, что наименьшее общее кратное периодов делителей  может быть равно только , при этом периоды делителей могут быть равны либо  у обоих, либо у одного , а у другого . Поскольку период всегда меньше самого числа, то  явно будет больше . Значит и псевдопростота при таком периоде невозможна. Поэтому остаётся проверить периоды . 2 меньше минимального возможного периода периода для всех чисел, больше 3, поэтому такой период исключаем. Теперь предположим, что сконструированное число делится на  и , тогда при равенстве периода  значению , их периоды тоже будут равны , потому что это единственное наименьшее общее кратное для двух чисел, ведь  не делится ни на что. Отсюда вытекает, что , где  — первый возможный сомножитель с периодом , и  — второй. Далее:     . Здесь  может быть равен только единице, иначе слева не получится целое число. Тогда: , из чего следует, что если , то псевдопростых с периодом  быть не может. Остаётся проверить псевдопростоту при , что можно сделать проверкой значения в ряду остатков на позиции , если там 1, то такое число может быть псевдопростым и его стоит исключить из дальнейших операций. Рассуждения для  полностью аналогичны, что означает необходимость проверки равенства единице и его остатка при условии .

Для периода  имеем:       . Получаем, что при  (или эквивалентно — ) опять не может быть простоты, но если , то нужно проверять остаток на позиции . Аналогично и для  — проверяем если . В сумме получаем и для  и для  необходимость выполнить проверку лишь для позиций  и , потому что периоды  и  дадут повтор как раз в положении  и . Проверку выполняем лишь при указанных выше условиях, что почти в два раза ускорит процесс при проверке больших значений  или , ведь для них обязательно выполняется  при предложенной ниже схеме генерации простых, а меньшие значения будут проверяться очень быстро из-за их небольшой величины.

Таким образом выше были показаны теоретические основы для получения возможности генерировать гарантированно простые числа для таких критичных областей, как криптография.

Кроме того, открывается путь для проверки простоты произвольного числа, при условии нахождения делителей его полного периода (). Так, для простых чисел < 126 000 000 количество принадлежащих к классу «перемноженных простых» равняется 676625, при общем количестве простых 7163812, что даёт нам немного меньше, чем 9.5%. Для простых чисел до миллиарда имеем 3.49% относящихся к классу 2p+1, 1.8116% из класса 4p+1, 2.4709% из класса 6p+1, а всего — 7.7746%, где p — простое число. Правда следует учесть, что разложение полного периода больших чисел сильно затруднено. В таком случае можно предложить рекурсивную проверку, которая немного повысит размер доступных для проверки чисел, но при этом сильно сократит долю проходящих такую проверку чисел, ведь если коэффициент, определяющий принадлежность к классам рекурсивно простых чисел, принять равным 0.2, то уже на второй проверке будем иметь всего 0.04, или 4% от общего количества простых чисел. Но тем не менее, в ряде случаев такой подход может принести пользу.

### Практические результаты

Собственно генератор, разумеется, был написан и протестирован, благо сложность там минимальная. По ходу проверки выяснилось, что вполне работоспособным будет следующий алгоритм:

Получаем на вход, например, 1000 начальных простых чисел, которые можно сгенерировать при помощи решета Эратосфена или просто скачать [отсюда](https://primes.utm.edu/lists/small/millions/). Затем перемножаем каждое значение с каждым оставшимся и не забываем домножить на два, а потом прибавить единицу. Получившийся кандидат часто делится на 3, поскольку у простых чисел есть специфическая особенность, аналогичная наличию заряда у частиц в физике. Простые с одинаковым «зарядом» отталкиваются, а с разными — притягиваются. В данном случае «заряд» это остаток от деления на 3. То есть если остаток от деления на 3 у обоих простых одинаковый — новое простое не получится, потому что оно будет делиться на 3. А если остаток отличается — вот тогда мы можем получить подходящего кандидата в простые. При этом все полученные перемножением простые «синхронизируются», то есть получают одинаковый остаток, равный 2. Поэтому снова перемножать их самих на себя бесполезно. Значит для получения новых простых нам нужно отфильтровать ту часть начальной 1000, у которой модуль тройки (остаток от деления на 3) равен 1. Таким образом после первого перемножения всех со всеми, получаем подросшие в размере числа, которые уже бессмысленно перемножать друг с другом, поэтому для дальнейшего роста размера (до используемого в криптографии) мы должны снова и снова перемножать полученные простые на ранее отобранные «противоположно заряженные» числа. После перемножений и добавления единицы выполняем проверки по критерию возможности псевдопростоты и если критерий выполняется, то проверяем остаток на позиции 2a для каждого кандидата. Если там 1, то кандидат отклоняется. Далее каждый кандидат проверяется обычным вероятностным тестом, то есть вычисляется значение в ряду остатков на позиции , если это 1 или , то перед нами — гарантированно простое число.

При выполнении генерации следует учитывать, что на каждой итерации получается рост количества сгенерированных простых, то есть коэффициент размножения для 1000 начальных простых много больше единицы. Поэтому для получения криптографических простых необходимо ограничивать генерацию, иначе она займёт очень большое время, да и памяти может не хватить. При этом не стоит сокращать начальный набор простых, потому что генерация должна быть максимально случайной, чтобы, зная её алгоритм, злоумышленник не предсказал получаемые значения. Для этого необходимо реализовать механизм отсечения ветвей дерева генерации, позволяющий каждый раз получать уникальные простые, расположенные достаточно далеко от ранее сгенерированных. И конечно, отсечение лишнего существенно ускоряет процесс.

Время выполнения теста зависит от количества сгенерированных кандидатов. Каждый из кандидатов проходит вероятностный тест, что в наибольшей степени замедляет генерацию. В тестовых запусках для получения нескольких сотен простых в диапазоне  —  было потрачено от 5 до 20 минут. Такая разница времени объясняется различными путями, которые проходит алгоритм в дереве генерации. Так изначально генерация ограничивается примерно 10 числами, но с приближением криптографического размера генерация затухает из-за существенного сокращения коэффициента размножения с ростом величины числа. Поэтому необходимо повышать количество промежуточных простых, но на сколько конкретно — сказать сложно, а потому для ограничения используется простое повышение допустимого количества в два раза с ростом размера числа и превышением грубо задаваемого порога. В результате в рамках ограничений количество новых простых может плавать и тем самым вносить существенное различие в общее время генерации.

Далее приводится текст процедуры на Java, выполняющей генерацию простых чисел. Она, естественно, не удовлетворяет криптографическим требованиям, которые выходят далеко за рамки кода программы и в основном касаются организационных моментов. В чисто программной части в процедуре не реализован механизм отсечения ветвей дерева генерации, за исключением простейшего ограничения. Но тем не менее в качестве примера реализации алгоритма генерации программа может чем-то помочь.

Входными параметрами является начальный список простых и PrintWriter для сохранения результата в файл. После завершения алгоритма в файле будут все произведения сгенерированных простых с теми исходными числами, которые имеют модуль трёх равным единице. Результат можно проверить при помощи онлайн-сервисов, реализующих факторизацию чисел, но следует понимать, что они могут использовать вероятностную проверку на простоту перед выполнением факторизации, а потому для проверки предложенного подхода становятся бесполезными (ведь все числа и так проверены вероятностным тестом). Но ряд из них сразу берутся разлагать предложенное число на множители, такие сайты могут вселить некоторую дополнительную уверенность в правильности предложенного метода.

```

/** Генерация простых чисел путём многократного перемножения входного набора заведомо простых.

* На каждой итерации одно входное простое перемножается с другим, затем результат умножается на 2,

* после чего к результату прибавляется единица:

* probablyPrime=prime1*prime2*2+1

* Каждое потенциально простое далее проверяется на псевдопростоту в функции addIfPrime.

* Если псевдопростота исключена, то потенциально простое проверяется на простоту при помощи аналога

* теста Ферма, являющегося детерминированным для любых чисел, не являющихся псевдопростыми по основанию 2. */

public static void generatePrimes(List primes, PrintWriter pw)

{

// Список простых чисел с остатком при деление по модулю 3 = 1.

List mod3\_1 = new ArrayList();

// Список чисел признанных простыми функцией addIfPrime()

List l = new ArrayList();

// Экземпляры больших чисел со значением 3 и 2.

BigInteger three = BigInteger.valueOf(3), two = BigInteger.valueOf(2);

// Цикл обработки простых чисел, данных в виде входящего параметра в процедуру.

// В цикле для каждого входного простого вычисляется его произведение со всеми остальными простыми.

// Если результат перемножения не равен единице по модулю 3, то такие числа игнорируются из-за

// порождения при последующих пермножениях чисел, кратных трём.

for (int k = 0; k < primes.size() - 1; k++)

{

// Рассматриваемое простое число (а)

BigInteger seed = BigInteger.valueOf(primes.get(k));

// Удвоенное простое число (2а)

BigInteger s2 = seed.shiftLeft(1);

// Остаток при делении `a` на 3

BigInteger r0 = seed.remainder(three);

// Проверка на остаток = 1

if (r0.intValue() == 1) mod3\_1.add(seed);

// Цикл по тем простым числам, с которыми данное число пока что не перемножалось

for (int i = k + 1; i < primes.size(); i++)

{

BigInteger p = BigInteger.valueOf(primes.get(i)); // Перевод типа int в тип BigInteger

BigInteger r = p.remainder(three); // Остаток от деления p на 3

// Если остатки от деления очередного простого числа на три и ранее выбранного так же простого

// равны друг другу, то такую пару игнорируем из-за обязательной делимости результата на 3

if (r.intValue() == r0.intValue()) continue; // divisible by 3

else addIfPrime(p, seed, s2, two, l); // Если делимости на 3 нет, то проверяем на простоту

}

}

// Фиксируем ссылку на полученные выше результаты перемножений и проверок простоты в перменной ps

// (ps - сокращение от primes)

List ps = l;

// В этом цикле каждое ранее найденное простое перемножается с ранее отобранными простыми,

// дающими по модулю 3 единицу. Результат перемножения проверяется на простоту функцией addIfPrime.

//

do

{

System.out.println("found " + l.size() + ", bits=" + l.get(0).bitLength());

l = new ArrayList();

for (int k = 0; k < ps.size(); k++)

{

BigInteger seed = ps.get(k);

BigInteger s2 = seed.shiftLeft(1);

// Проходим по списку равных единице по модулю тройки чисел и перемножаем их на

// ранее полученные простые результаты аналогичных перемножений

for (int i = 0; i < mod3\_1.size(); i++)

addIfPrime(mod3\_1.get(i), seed, s2, two, l);

// Здесь проверяем разрядность полученных простых чисел. Если разрядность превышает порог в

// 700, 800, 900, то меняем максимально допустимое значение размера списка получаемых простых

// с целью ограничения мощности генерации. Если генерацию не ограничивать, то количество промежуточных

// простых, меньших чем требуемые нам числа криптографических порядков, будет очень большим.

int n = 100000; // change following to adjust for required bit count

if (l.size() > 0)

if (l.get(0).bitLength() < 700) n = 10;

else if (l.get(0).bitLength() < 800) n = 20;

else if (l.get(0).bitLength() < 900) n = 40;

if (l.size() > n) break; // Если количество полученных простых больше максимально допустимого, то выходим из данного цикла

}

ps = l; // Фиксируем ссылку на полученные выше результаты перемножений и проверок простоты в перменной ps

// Записываем все полученные простые в поток, полученный на входе процедуры

for (int i = 0; i < l.size(); i++)

pw.println(l.get(i));

pw.flush(); // дописываем буфер потока, что бы зафиксировать все полученные результаты

}

while (l.size() > 0);

System.out.println("Done");

}

/\*\* Вычисляем новое простое, перемножая два известных простых, затем удваивая произведение и прибавляя единицу.

\* Полученое потенциально простое число проверяется на потенциальную псевдопростоту согласно критериям из статьи.

\* Если число не является псевдопростым, то далее проводится стандартный вероятностный тест простоты,

\* который в данном случае является детерминированным в следствии устранения возможности появления

\* псевдопростых чисел предыдущей фильтрацией. \*/

private static void addIfPrime(BigInteger a, BigInteger b, BigInteger b2, BigInteger two, List l)

{

// a2=2\*a; fp=a\*b\*2; n=a\*b\*2+1;

BigInteger a2=a.shiftLeft(1), fp=b.multiply(a2), n=fp.add(BigInteger.ONE);

BigInteger r=null;

if (a2.compareTo(b)<0) r=two.modPow(a2,n); // 2a

```

Ну а теперь, когда вы (ну почти) всё знаете о генерации простых чисел, возможно ваши интересы всё же выйдут за рамки одной только криптографии и вам станет интересно позаниматься теорией чисел, благо она, как было указано выше, доступна для учеников пятого класса, но при этом ещё и позволяет самостоятельно находить истинные бриллианты, не ожидая помощи от серьёзных математиков. | https://habr.com/ru/post/470159/ | null | ru | null |

# Python как компилируемый статически типизированный язык программирования

По данным широко известного в узких кругах [Tiobe Index](https://www.tiobe.com/tiobe-index/) язык Python скорее всего станет языком 2020 года, в четвертый раз в своей карьере. Кроме того, скорее всего он обгонит Java и займет вторую строчку в общем рейтинге языков программирования вслед за языком C.