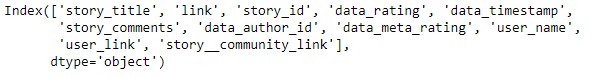

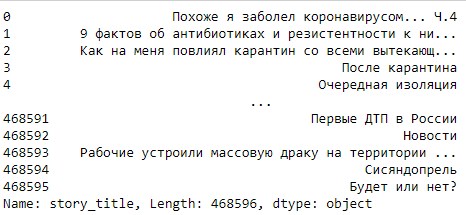

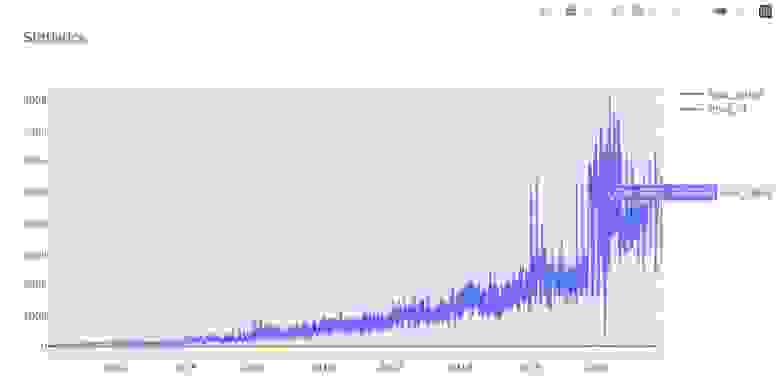

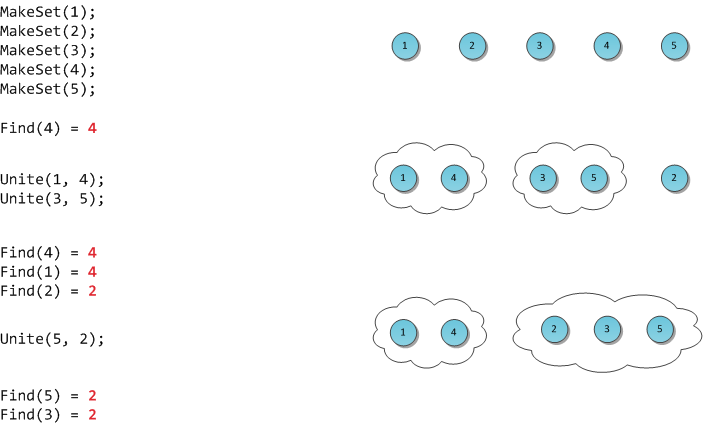

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Интеграция картин в видео фасада здания за 60 часов

### Введение

> *Прекрасно когда рядом с тобой есть любимый человек, который всегда готов выслушать или просто помолчать. А еще лучше, когда он неявным образом формирует для тебя интересные задачи!*

>

>

Художник-монументалист - человек, который выполняет действительно Большие Задачи. Вот и со мной рядом был такой человек, у которого еще не горел, но активно приобретал характерную черную корочку диплом.

На диплом художник выбрал Российскую национальную библиотеку (они выбирают объекты, и декорируют их). В итоге - 9 отдельных картин предполагаемых в технике мозаика были готовы украшать фасад здания. Сделать диплом - это полдела, но более важной задачей является подать его. По задумке камера должна вальяжно облетать здание, масштабироваться и проходить по замысловатым траекториям. Но вот незадача, курс 3D моделирования длился полгода, а результатом была модель пустой комнаты, с плинтусами и окнами. Отчаянные просмотры роликов на YouTube по темам «Как сделать 3D иллюстрации Adobe» дали понять одно - 3D визуализации не будет. Больно, грустно, обидно - но дедлайн заставляет креативить.

И вот, в один из теплых весенних вечеров, находясь в своих раздумьях, наш герой-монументалист выдал следующую фразу: «Эээх, можно конечно сделать бы видео с покадровой анимацией. Статично конечно, но зато с разных ракурсов и чтобы веточки чуть-чуть колыхались, люди ходили ну и машины разъезжались - но это же помереть можно как много копипаста, да еще и каждую картинку подогнать надо.».

Мое глубокое подсознание положило эту мысль в стек головного мозга и достало его оттуда, как это водится, перед самым сном. «Так ведь можно это все реализовать программно. Распознать рамки под панно какой-нибудь нейронкой, вставить мозаики попутно сжимая их и растягивая в нужных местах, затенить, выделить контраст и бла бла бла» подумал наш герой-программист и его было уже не остановить…

**Остановили**. Срок всего пара недель - около 60 рабочих часов, а работу никто не отменял. И ведь нужно еще отснять библиотеку, подготовить сами работы и их тоже отснять, ну и вишенка на торте - опыта в сфере работы с изображениями не так много.

Учитывая всё вышесказанное, формировались следующие задачи:

1. **Научиться определять рамки под мозаики**

2. **Понять как вставлять мозаики в нужные места фасада библиотеки, попутно деформируя их под определенные рамки**

3. **Фильтровать все неугодные пиксели: столбы, провода, листочки и пролетающих птичек**

4. **Все это нужно сделать с учетом того, что имеется всего пять видео с библиотекой для разных ракурсов.**

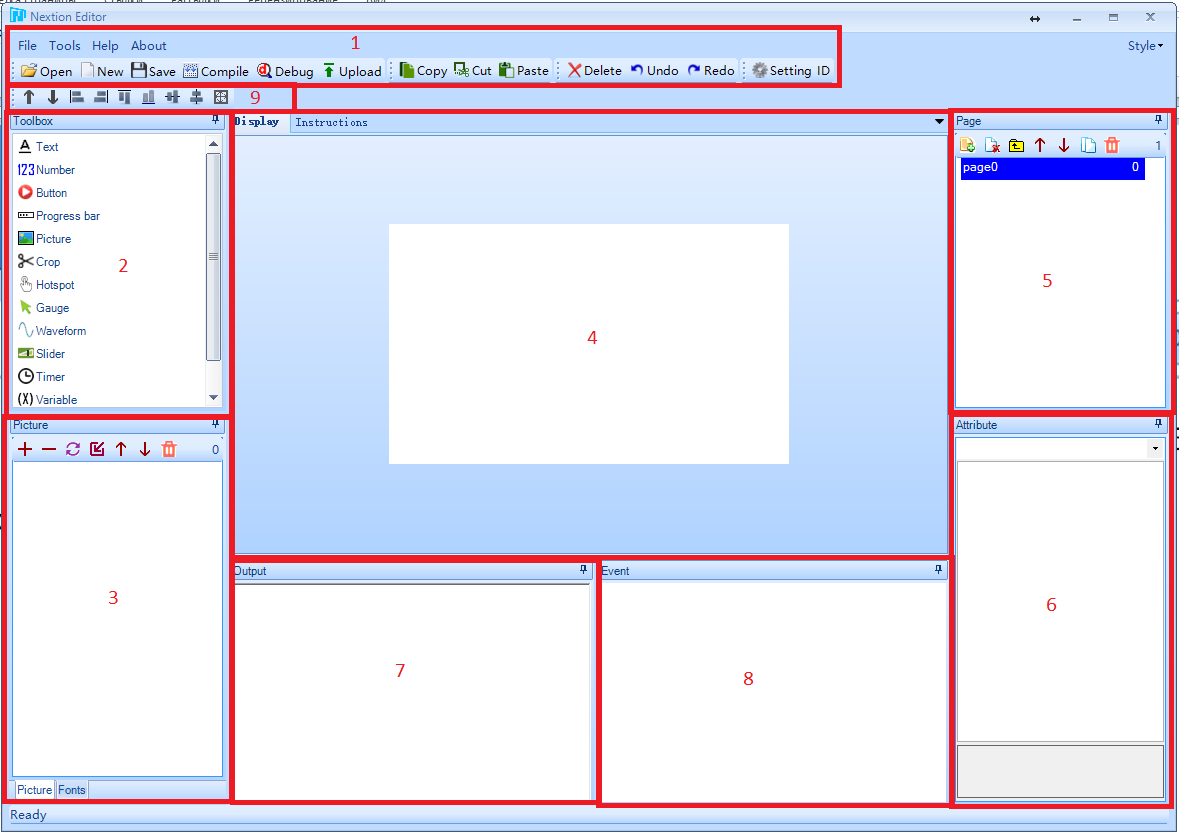

### Разметка первого фрейма

> *Фотошоп уникальная программа, одним движением руки убирает все изъяны. Жаль, что функция одна не придумана пока, чтоб движением руки скорректировать мозги.*

>

>

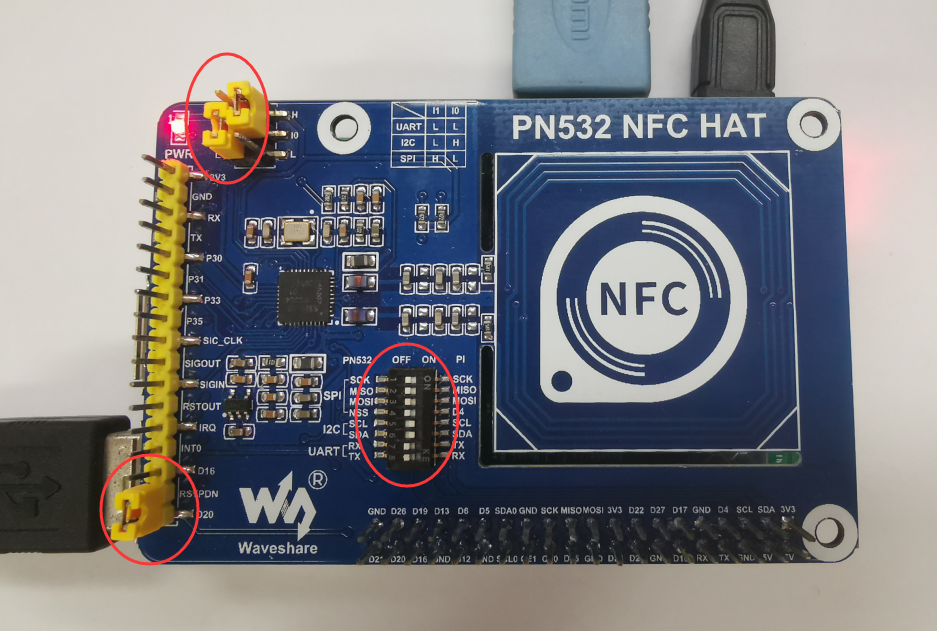

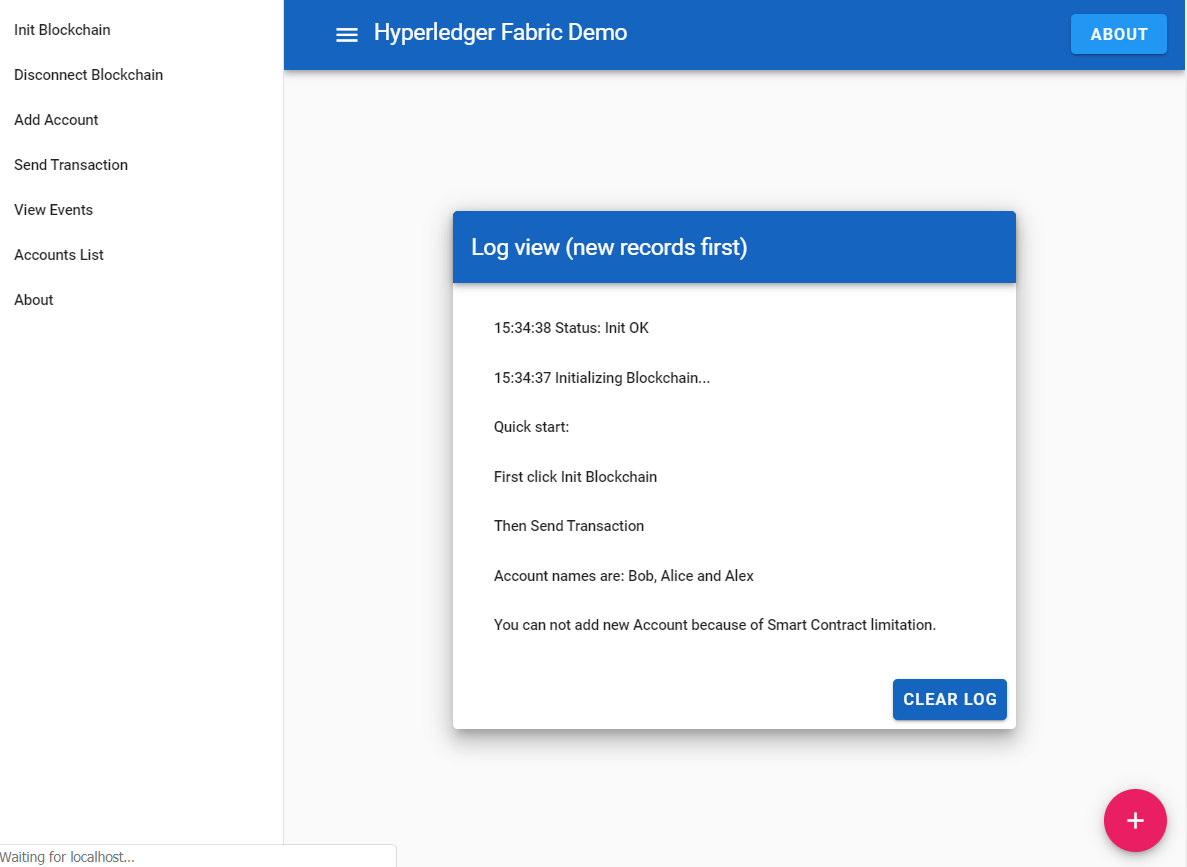

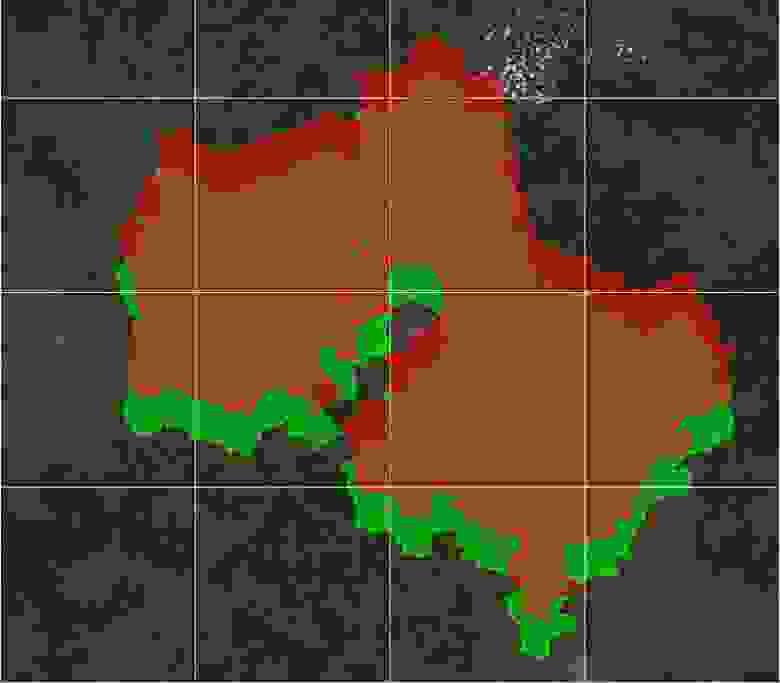

Наконец получилось заснять (***неподвижные***) видео библиотеки и сделать фотографии 9-ти панно. Проанализировав входной материал, в ход пошли школьные знания Photoshop и бесплатный инструмент [photoshop online](https://online-fotoshop.ru/) для разметки. На фото ниже совмещены первый фрейм одного из видео и его размеченный вариант.

Российская национальная библиотека. Левее - исходное изображение с выделенными контурами, правее - изображение с разметкой.Идея не нова, и заключается в том, что необходимо выделить направляющие рамок максимально неестественными цветами, которые легко можно определить программно. Так хватило 3-х цветов:

* Зеленым (0, 255, 0) определяются границы кривых контуров (полукруглые линии) и вертикальные направляющие.

* Синим (0, 0, 255) - горизонтальные границы крайних рамок. Можно было так же зеленым, но я подумал что так легче разграничить прямые и кривые линии .

* Красным (255, 0, 0) - все объекты, которые находятся перед библиотекой и её перекрывают (совсем мелкие объекты, например некоторые провода, игнорировались, так как не так сильно заметны).

*Почему не точная разметка контуров?* Так показалось проще и быстрее. Определить визуально точные рамки контуров сложно и это отнимает много времени, а вот разместить направляющие, найти их пересечения - вроде как проще. На первое изображение у меня ушло минут 30, на остальные - около 5-10 минут.

### Приведение изображений к нужным форме и пропорциям

> *Идеальные фигуры встречаются только в геометрии.*

>

>

#### Чтение линий с изображений

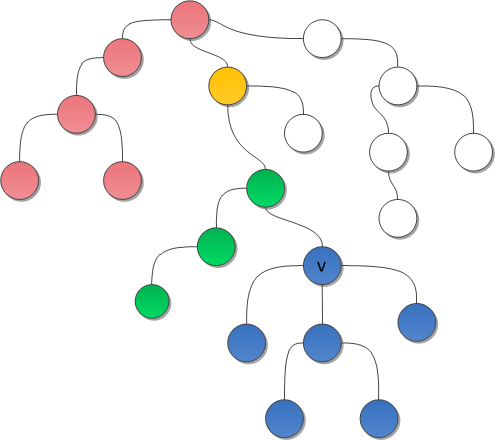

Что ж, меня эта мудрость, видимо, обошла стороной - я тут же начал писать свой постыдный алгоритм для определения линий и кривых, основывающийся на алгоритме маркировки подключенных компонентов (псевдокод писать не буду, кому интересно можно разнести меня в гитхабе). *Перед написанием статьи, я понял что перемудрил и самостоятельно разложил по всему телу скрипта минные поля.* Поэтому, хоть и поздно, сделал небольшой ресерч, а то уж совсем стыдно. Чуть-чуть покопавшись и поигравшись в преобразованиях Хафа ([здесь](https://docs.opencv.org/3.4/d9/db0/tutorial_hough_lines.html) и [здесь](https://habr.com/ru/post/208090/)) - решил туда не лезть.

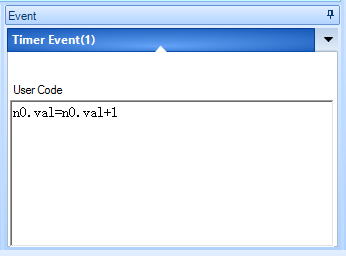

Для тех же прямых линий выглядит это так

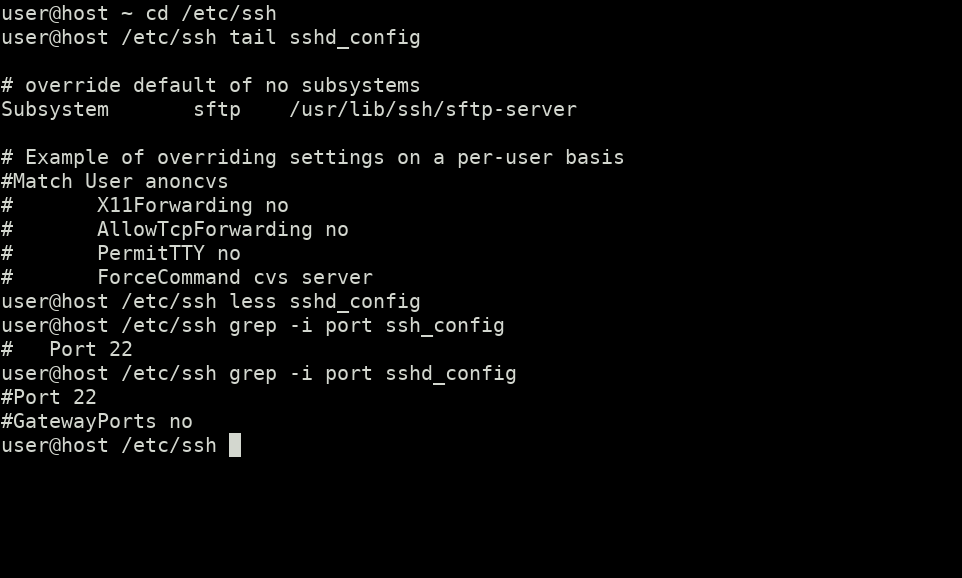

```

lines = cv2.HoughLinesP(mask_blue, rho=5.0, theta=np.pi / 70, threshold=100)

```

Параметры rho, theta и threshold подбирались экспериментально. Как мне показалось, эта не та задача где можно применять это преобразование. Для других линий даже не стал пытаться искать коэффициенты, тем более для других фотографий библиотеки.

А вот функция cv2.findContours(...) оказалась той что нужно. Естественно, нужно сделать из контуров линии, но пара строчек кода с группировкой по строкам или столбцам, в зависимости от линии, решили проблемы.

Далее, с помощью линейной регрессии экстраполируются вертикальные отрезки, чтобы продлить их до верхней границы и наверняка получить пересечение с горизонтальными направляющими. И, наконец, найдя четыре пересечения, получаются рамки.

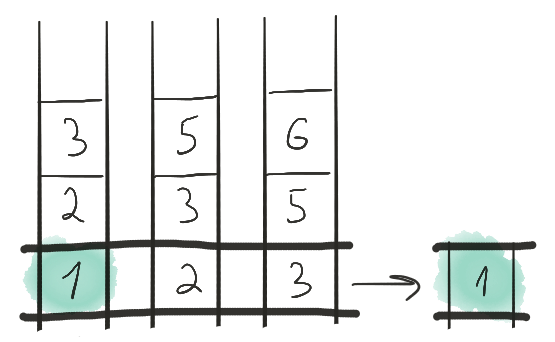

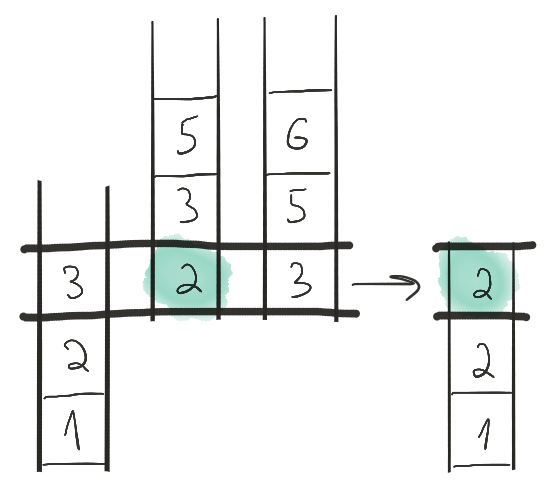

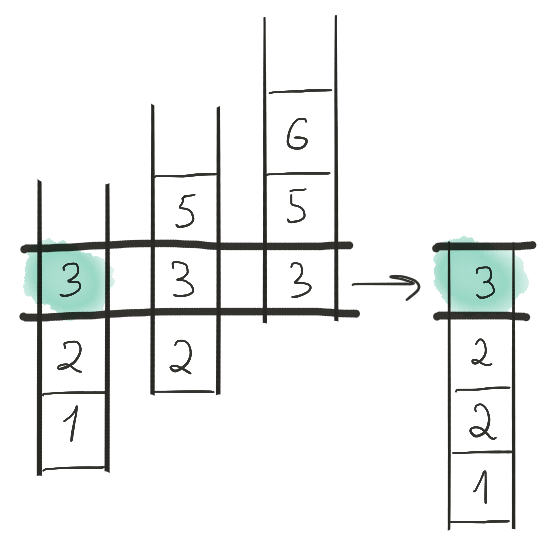

Выделенные контуры для вставки картин по заданной разметке#### Перспектива и деформация

Далее, необходимо вставить изображения в фото библиотеки. Для этого нужно подогнать форму мозаик.

Тут необходимо 2 вида преобразования: перспектива для крайних изображений и деформация для срединных, так как у последних кривые горизонтальные направляющие. И казалось бы, есть две функции и говорить здесь не о чем. *Но и здесь вылезли свои ромашки*.

Первым шагом пришлось изменить размер картин, приблизительно до размеров самих рамок.

Для перспективы, в opencv имеется функция [cv2.getPerspectiveTransform(,,,)](https://theailearner.com/tag/cv2-getperspectivetransform/), а если точнее, эта функция строит матрицу трансформации, произведение с которой и обеспечивает перспективу. Для функции необходимо составить матрицы входных и выходных рамок, записывая углы самих рамок. Далее с помощью функции “cv2.warpPerspective(...)” происходит преобразование. Более подробно всё описано [здесь](https://theailearner.com/tag/cv2-warpperspective/).

Матрица для деформации, если кому вдруг интересно

| | | |

| --- | --- | --- |

| 0.925 | -0.12 | 30. |

| -0.075 | 0.88 | 30. |

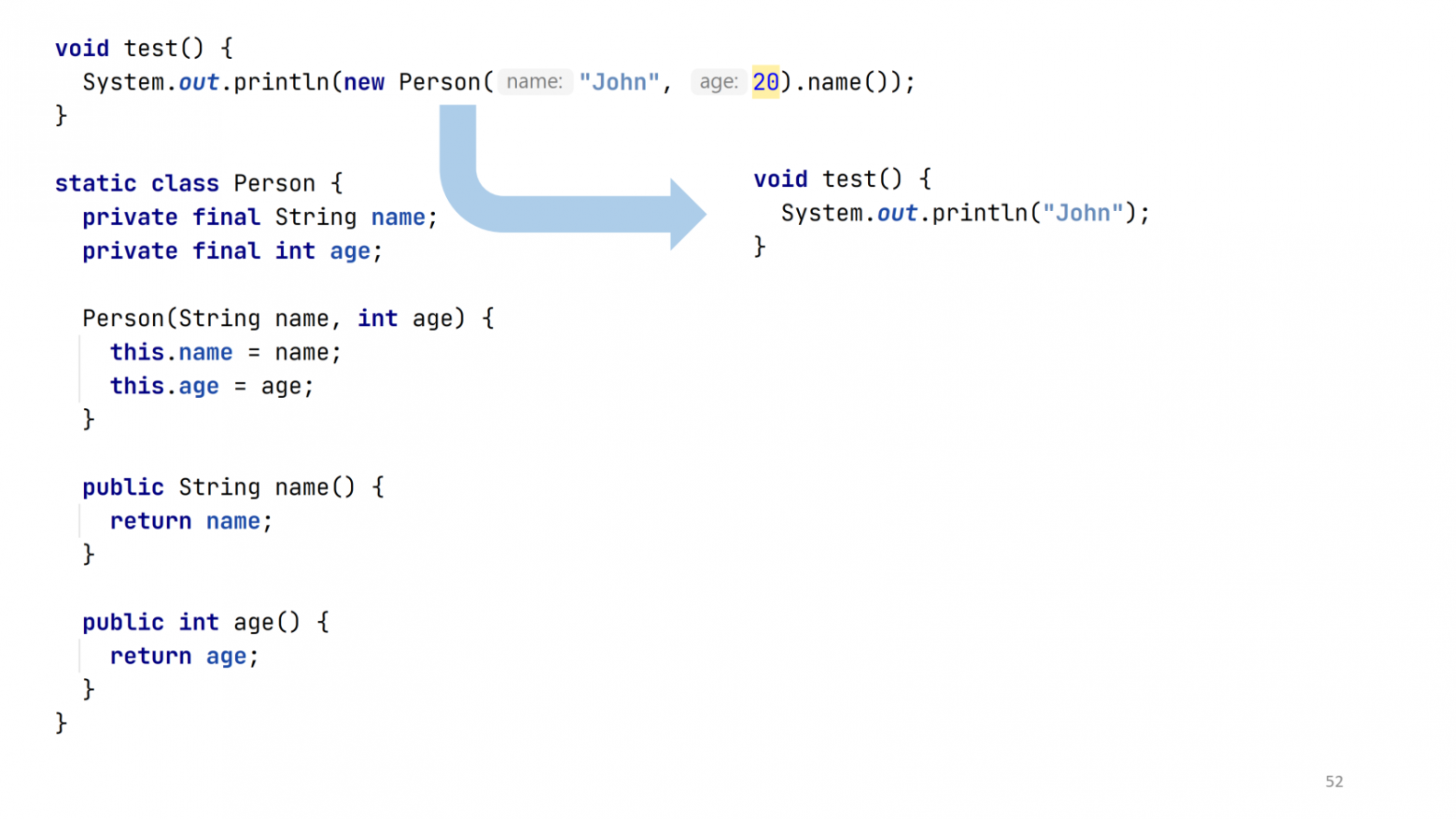

| 0. | 0. | 1. |

Нет проекции (0, 0), сдвиг по двум осям равен (30, 30), а вот поворот, перемасшабирование и т.д. задается матрицей с вещественными числами.

Демонстрация перспективы картиныВсе чинно и благородно. Хотя сперва, из-за того что при формировании dst матрицы я работал с абсолютными значениями координат, у меня в этой матрице появлялись отрицательные значения. Из-за чего приходилось расширять шаблон для вставки, а после “резать” черные свободные пиксели.

С деформацией алгоритм очень похож:

1. Составить исходную матрицу и матрицу после преобразования (здесь указываются не углы, а грани изображения)

2. Рассчитать матрицу преобразования с помощью skimage.transform.PiecewiseAffineTransform(...)

3. Преобразовать изображение используя skimage.transform.warp(...).

Демонстрация деформации картиныТаким образом, каждое преобразование ресайзится и преобразуется в зависимости от заданной рамки.

### Интеграция изображений

> *То, что не замечено ранее несет с собой ведро с помоями*

>

>

Первый «Привет» прилетел от артефактов при деформации. Сходу прикреплю пример чтобы было наглядней.

Тут смотреть нужно на черную обводку вокруг изображения. Вставить картину на её законное место дело то нехитрое:

1. Подготовить маску, по которой изображение будет вставлено - там где в маске единицы, пиксели будут скопированы:

1. `mask = np.ones(picture_shape)`

2. `mask[picture == (0, 0, 0)] = 0` - черные пиксели границ изображения заполнить нулями.

2. ~~Заполнить нулями~~ вырезать все препятствия и шибко зеленые листочки.

3. Перенести наше деформированное творчество.

Но вот нюанс, алгоритм трансформации, во имя ~~луны~~ своей алгоритменности, близ границ мозаики, оставляет вместо полностью черных пикселей `(0, 0, 0)` сглаженные пиксели `(20, 20, 20)`. Ну и возле соседних белых это смотрится как абсолютное черное тело.

В этот момент решение пришло, не успел я как следует подумать - ведь можно сгладить пиксели близ границ. Первая идея и ее реализация заключалась в размытии пикселей, находящихся рядом с границами изображения:

1. Создать матрицу коэффициентов `[0, 1]`, соответствующую маске (где единицы изображение, нули - пустота).

2. Идти окном (3, 3) с помощью замечательной функции `skimage.util.view_as_windows(...)`, и без жалости усреднять значения коэффициентов. *Несколько раз.* Ближе к границам коэффициенты распределятся по градиенту от нуля до единицы.

3. Умножаем изображение мозаики на `1 - коэффициенты`. Там где коэффициенты равны единице изображение не изменится, а в усредненных местах понизится контрастность.

4. Умножаем фон на коэффициенты, с той же логикой

5. Складываем фон и изображение, и в местах сглаженных коэффициентов получится смешение пикселей:

без сглаживания и с ним")Склейка результата вставки картины (после перспективы) без сглаживания и с нимЕсть еще неприятный момент с тенями - на примере выше отлично видно, что сверху присутствует тень которой нет на мозаике. Но в силу временных ограничений было решено что это меньшая из бед, и она ждет лучших времен. Хотя её решение скорее всего интересное.

Мои рассужденияПросто ввести Threshold не вариант, ибо кирпичи имеют разную тональность. По идее надо искать область с более низким общим тоном. Можно было бы даже кластеризовать попробовать.

### Могло бы быть и лучше

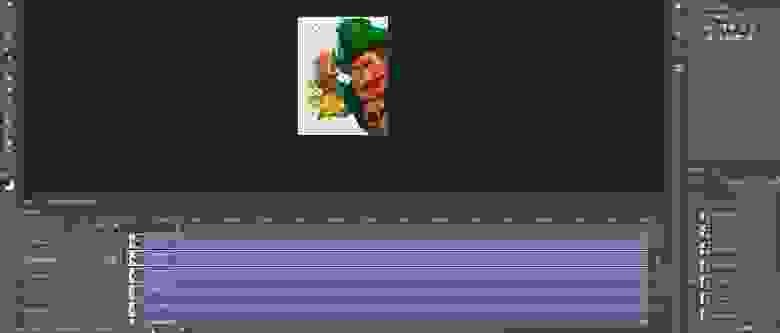

Когда все видео были готовы - вылезла последняя неприятность. При съемке видео был небольшой ветер, и вроде камера была зафиксирована на штативе, но легкие потрясения все равно просочились. Выглядит это примерно так:

Результат интеграции картин в формате gif с заметной тряскойОчевидное решение - найти эти смещения каждого фрейма относительно первого, а после сдвинуть текущий фрейм чтобы сравнять его с первым. Google подсказал метод “[cv2.phaseCorrelate(...)](https://docs.opencv.org/4.x/d7/df3/group__imgproc__motion.html#ga552420a2ace9ef3fb053cd630fdb4952)“, оперирующий фазовой корреляцией. Получилось быстро и легко, но вот только качество получилось так себе. Метод находит смещение, но не так точно как этого бы хотелось. Результат дергается чуть меньше, но все равно дергается.

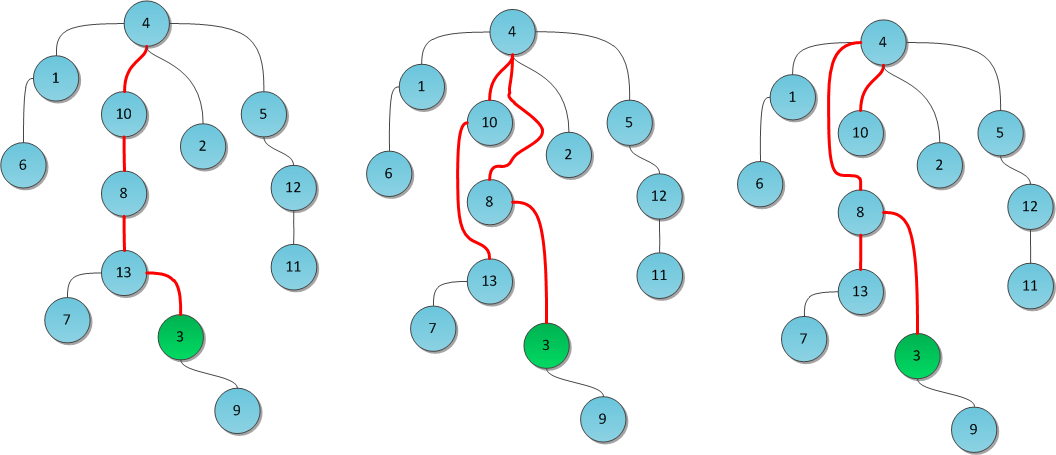

Чтобы быть до конца уверенным, попробовал также итеративный подход: необходимо задать максимально возможное смещение (в моей случае это было по вертикали), и смещая второе изображение, измерять [коэффициент взаимной корреляции](https://ru.wikipedia.org/wiki/%D0%9A%D0%BE%D1%80%D1%80%D0%B5%D0%BB%D1%8F%D1%86%D0%B8%D1%8F_%D1%86%D0%B8%D1%84%D1%80%D0%BE%D0%B2%D1%8B%D1%85_%D0%B8%D0%B7%D0%BE%D0%B1%D1%80%D0%B0%D0%B6%D0%B5%D0%BD%D0%B8%D0%B9). Не очень эффективный подход, но ради эксперимента приемлемо. Исходное видео и 2 подхода совместил и поместил ниже.

Склейка оригинального видео и двух подходов стабилизации. Слева - исходное видео, в центре phaseCorrelate и справа - итеративный подход.Здесь видно, что итеративный подход наилучшим образом обеспечивает стабилизацию, но защита диплома была без неё, и на большом экране все подергивания сильно бросались в глаза (во всяком случае мне). Однако приятное чувство завершить проект, хоть и немного с опозданием.

P. S. Буду рад замечаниям и предложениям (ссылка на проект - [GitHub](https://github.com/IvanHod/insert_images)). | https://habr.com/ru/post/676360/ | null | ru | null |

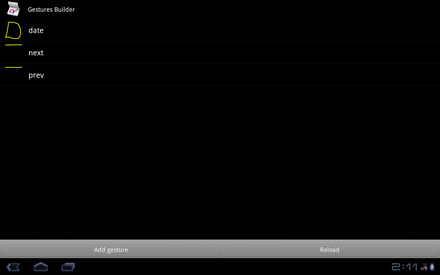

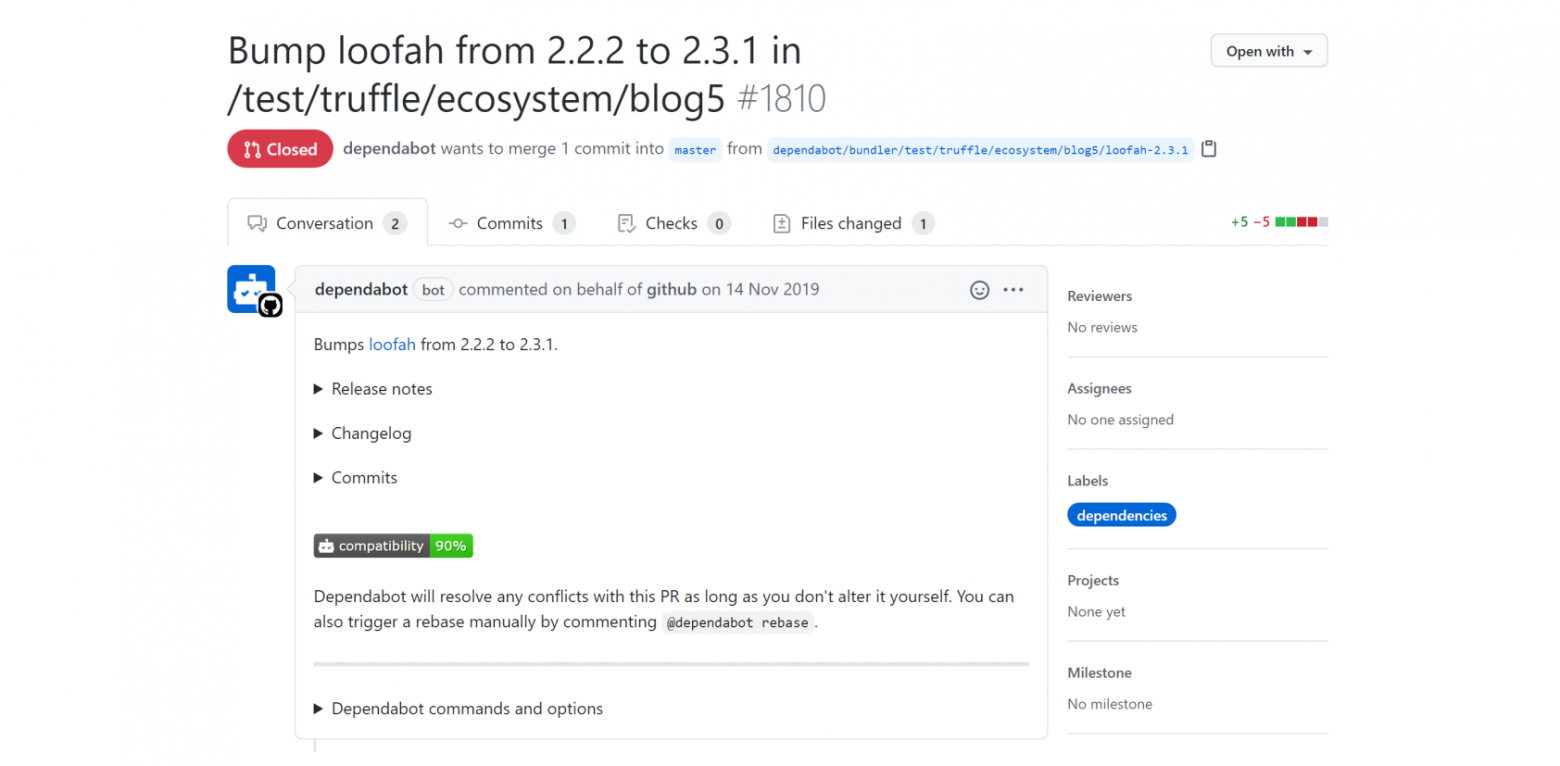

# Релиз Cordova 5.2.0

Сегодня вышел новый релиз Apache Cordova — 5.2.0.

Основные изменения в данном релизе это

* Поддержка флага --browserify

* Поддержка Windows в plugman

* Новая команда clean

* Использование ~ вместо ^ по умолчанию в config.xml при использовании --save

Также намного больший упор делается на использование NPM вместо собсвенного реестра плагинов.

Подробнее под катом.

Также будет немного о предстоящих релизах и вопросы по документации.

Думаю стоит начать с

`npm -g install cordova`

#### Поддержка флага --browserify

Теперь имеется полная поддержка --browserify и это официально. Все тесты пройдены и гипотетически это работает. Так как этот функционал долго был в основной ветке, скорее всего таки да, это таки работает.

Для разработчиков это означает что все плагины собираются в один файл, что значит меньше задержек с инициализацией, и приложение будет грузиться чуть быстрее. Также при сборке с помощью browserify кроме плагинов и общего кода для всех платформ, существуют часть функционала cordova.js которая зависит только от одной платформы, что позволяет разработчикам Cordova публиковать исправления которые затрагивают одну платформу быстрее и для получения обновления надо будет просто обновить платформу до более новой версии. Также это позволяет делать патч релизы, для тех кому не готов быстро идти в светлое будущее.

пример использования

`cordova run android --browserify`

Чтобы лучше понять что происходит можно сделать следующее

создайте тестовое приложение

```

cordova create browserifytest

cd browserifytest

cordova plugin add cordova-plugin-console

cordova plugin add cordova-plugin-device

```

После чего запустите приложение сперва как `cordova run android` подключитесь к приложению через хром и посмотрите какие файлы отображаются в вкладке Source, после чего запустите приложение как `cordova run android --browserify` и посмотрите разницу.

#### Поддержка Windows в plugman

Тут я был уверен что это было и раньше, но видимо нет. Теперь plugman поддерживает работу со всеми основными платформами, и это означает что вы можете иметь более кастомизированные версии Cordova приложений также на платформе Windows (чтобы бы не думали про нее). Это позволило plugman получить версию 1.0, так что впереди только улучшения.

#### Новая команда clean

Наверное это не требует детального описания, но теперь вы можете удалять весь компилируемый хлам для проекта. просто выполните

`cordova clean`

разумеется можно выполнять эту команду и индивидуально для каждой из установленных платформ.

`cordova clean android`

или

`cordova clean ios`

#### Использование ~ вместо ^ по умолчанию в config.xml при использовании --save

Теперь когда вы сохраняете платформы с использованием флага --save в config.xml записывается версия в виде ~4.1.0 что позволяет при восстановлении платформы получить версию у которой боляя поздняя патч версия. В силу того что в Cordova было найдено несколько уязвимостей за прошедший год, это изменение позволяет более быстро публиковать обновления безопасности, и не будет необходимости обновлять совместно с уязвимой платформой, и инструменты Cordova. Также при использовании автоматического построения, обновления безопасности будут автоматически применены, и вам не надо будет обновлять config.xml

#### Что нас ждет впереди

Впереди у нас несколько новых релизов платформ, самое интересное с моей точки зрения это будет обновление платформы Browser которое вернет возможность запускать веб-сервер с собранным приложением. Подождем и посмотрим, насколько это будет удобно. Также будет патч релиз для iOS и новый релиз платформы Windows. Я тесно не слежу пока за изменениями там, но если все три платформы выпустятся примерно в одно и тоже время попробую написать отдельно об этих релизах.

#### Документация и вопросы

С моей точки зрения документацию по Cordova находится в состоянии вроде как все есть, но иногда не найдешь то что надо. Я бы очень хотел улучшить это состояние, и определенные соображения в этом направлении есть, но хотелось бы узнать мнение людей которые работают с Cordova.

Меня интересует как русская, так и английская версии документации, если вы напишете свои пожелания в комментариях, то я буду стараться чтобы они появились в следующем релизе Cordova.

Немного ссылок:

[Apache Cordova](http://cordova.apache.org)

[Русская документация Apache Cordova](http://cordova.apache.org/docs/ru/edge/)

[Английская документация Apache Cordova](http://cordova.apache.org/docs/en/edge/) | https://habr.com/ru/post/264789/ | null | ru | null |

# Как усилить защиту паролей «12345» от brute-force атаки

**Объект:** веб-форма входа в систему.

**Дана задача:** усилить защиту аккаунта пользователя от подбора простого пароля к его аккаунту, используя минимум средств.

Что такое минимум средств? Это не использовать таблицы-справочники для блокировки по IP-адресу и User-Agent. Не использовать лишние запросы к системе, не захламлять систему авторизации лишними циклами.

И, выполнить совершенно волшебное требование — даже если бот введет нужные логин и пароль… не дать ему войти, а вот реального пользователя впустить.

Можно ли так сделать? В теории, конечно, нет. Но в практике, в частном порядке и при определенных условиях, как оказалось, весьма возможно.

Приглашаю под кат за подробностями.

Итак, предположим, что, логин у нашего пользователя «test», а пароль «12345». Мерзкий бот подключил свой словарь сгенерированных паролей, и готов работать со скоростью 700 паролей в секунду. Он знает, что логин пользователя — «test». Ситуация аховая: пароль «12345» будет вычислен за очень малое время. Пользователь, тем временем, открыл сайт и начал вводить логин и пароль в веб-форму логина.

Давайте внесем изменения в систему авторизации, пока ни один из них не начал свою работу, и не случилась беда.

Магия будет заключаться в третьей переменной, которую следует «приклеить» к паре логин-пароль. Я назвал ее **touch**.

Каждый раз, когда кто-то получает (внимание: **получает**, а не запрашивает!) логин-пароль, дата «touch» для пользователя «test» обновляется на текущую дату-время:

```

login/password/touch: 'test', '12345', '2014-12-13 14:00:00'.

```

Предположим, что бот начал первую итерацию и предложил пароль «1» для логина «test» в '2014-12-13 15:00:00'. Cрабатывает контроллер login\_check, который читает из базы данных пару логин-пароль, которую никто не «трогал» целых 2 секунды! Откуда вообще эти 2 секунды?! Об этом будет дальше.

Такая пара логин-пароль находится. Разница между последним «touch» и текущим временем — 1 час. Поэтому запись успешно возвращается на наш запрос.

Сначала пара логин-пароль сличается и login\_check приходит к выводу, что «test/12345» не равно «test/1». Контроллер возвращает «auth error». А затем дата «touch» для пользователя «test» обновляется на текущую: '2014-12-13 15:00:00'.

Бот приступает к следующей итерации: пробует пароль «2».

Скорость работы бота измеряется микросекундами. Он пытается авторизоваться сразу же: в '2014-12-13 15:00:00'.

И тут вступает в действие наш алгоритм — условие по параметру «touch» уже не выполняется. 2 секунды еще не прошли. Fail.

Модифицированный нашей логикой контроллер «login\_check» не может получить пару логин-пароль.

Запись существует, но ее дата «touch» еще слишком «свежая».

И она она уже не попадает в выборку. А раз такой пары логин-пароль нет, то контроллер ответит боту «auth error».

Бот не сдается, продолжает подбор и, наконец, приходит к правильному паролю «12345».

Вероятность, что именно текущая попытка вернет успех — крайне и крайне мала. 1/700 на каждую попытку входа! То есть, если раньше было 1:1, то теперь 1:700. И чем быстрее бот, тем больше вероятность, что его ждет fail.

В итоге только очень малая часть паролей будет действительно проверена. Остальные получат ложные срабатывания, даже если они будут верны.

**А что пользователь?**

Начнем с пользователя. Пользователь, в отличие от бота, вводит данные в веб-форму руками через клавиатуру и смотрит зрительными органами на монитор. А гибкость его алгоритмических способностей куда лучше, чем бота. По сути, пользователь в некотором роде искусственный интеллект. А значит, часть логики уже лежит в нем. И мы ею воспользуемся!

Когда пользователь видит ошибку авторизации, он часто переписывает пароль заново. Даже если пароль он только что вбил сам. Даже если пароль подставлен автоматом из password-manager. Я делал это еще до того, как применил свою систему защиты простых паролей.

Да, я обещал рассказать про две секунды. Рассказываю:

Две секунды это оптимальное время, за которое пользователь проводит операции по корректировке данных и совершает следующую попытку входа. В эти две секунды пользователь укладывается полностью. Если пользователь не уложился — он всегда может повторить попытку и за это время действие touch уже наверняка аннулируется.

**В заключение.**

Что будет если бот узнает о 2-секундной задержке? Если применить наши тестовые данные, это значит, что эффективность бота снизится: всего 1 попытка подбора пароля вместо 1400.

**P.S.** Очень хочется услышать критику, потому что система уже внедрена в один проект, и пока не создала ни одного тикета с проблемой доступа к системе.

Заранее спасибо. | https://habr.com/ru/post/245903/ | null | ru | null |

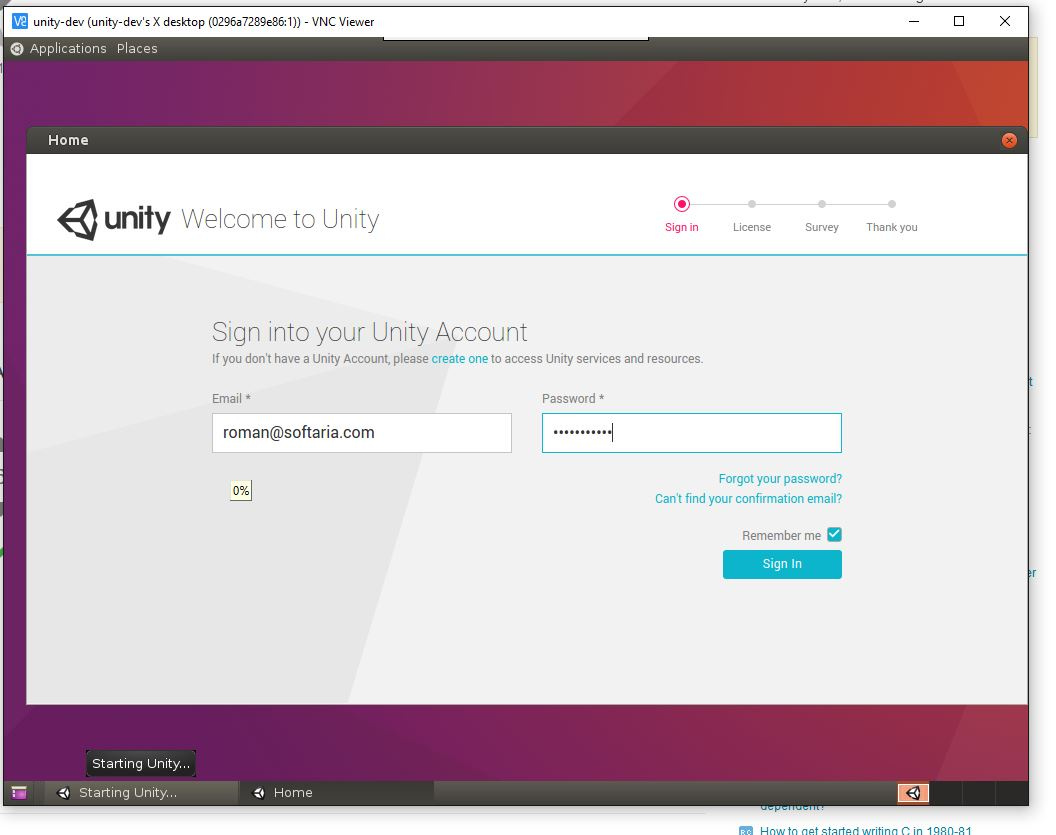

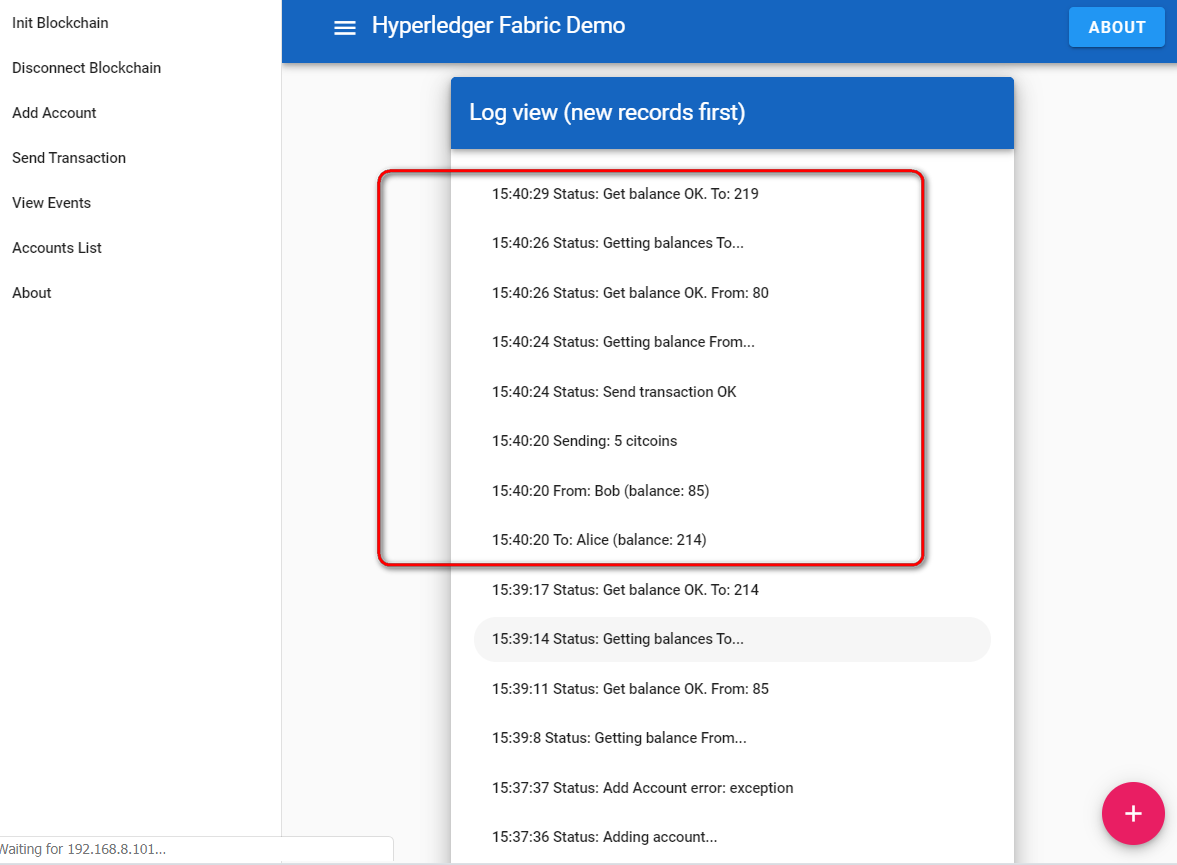

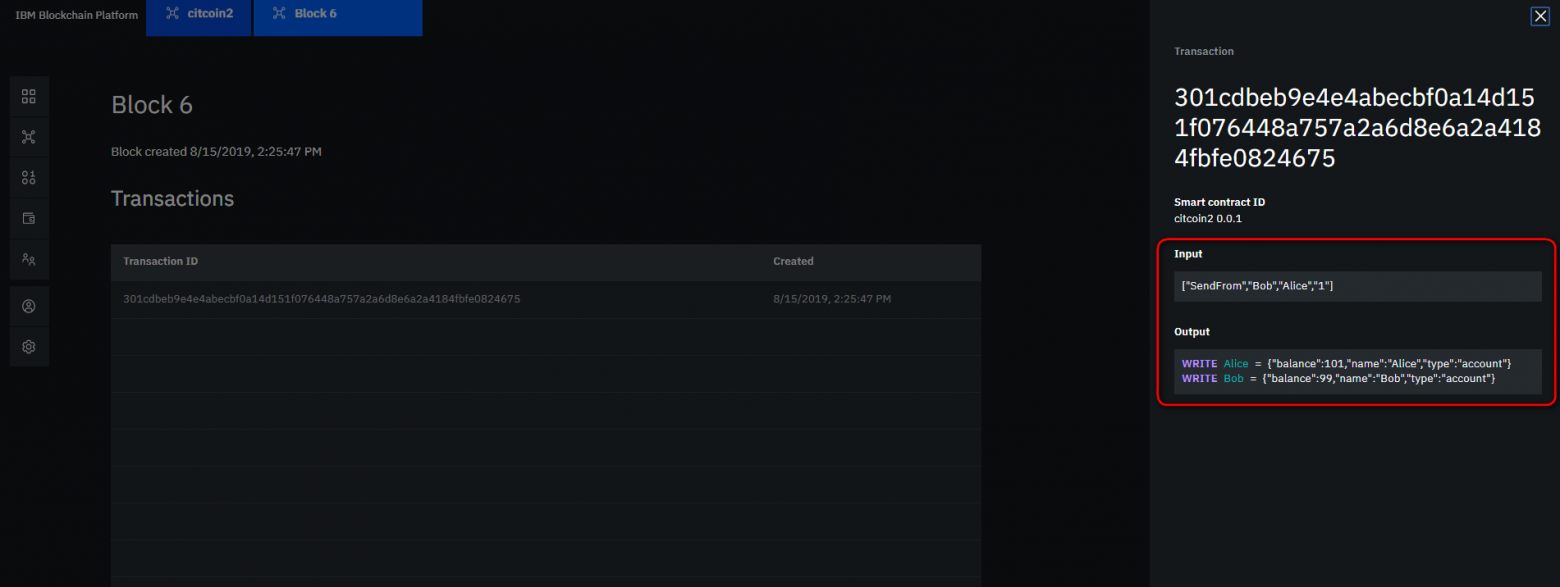

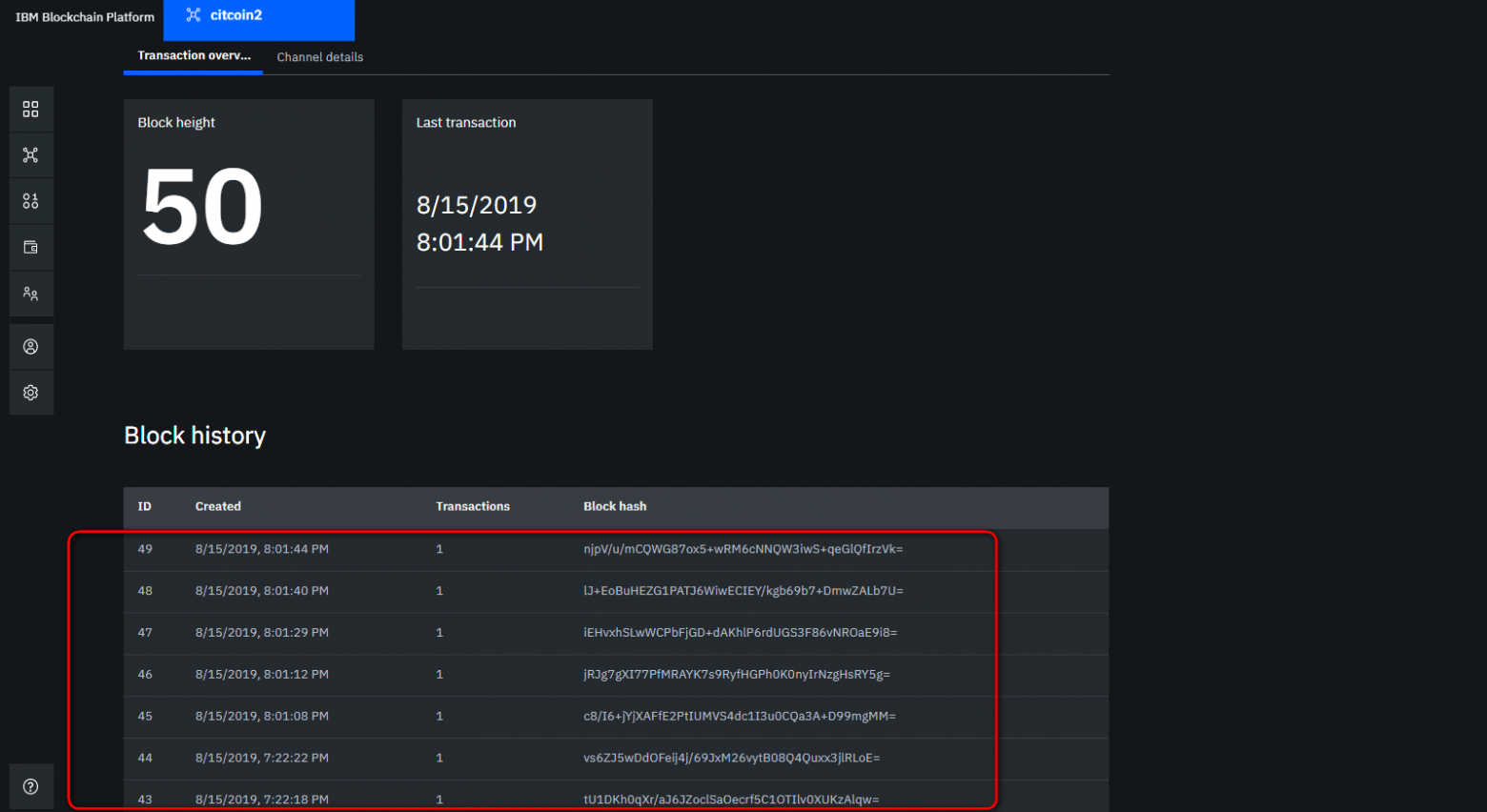

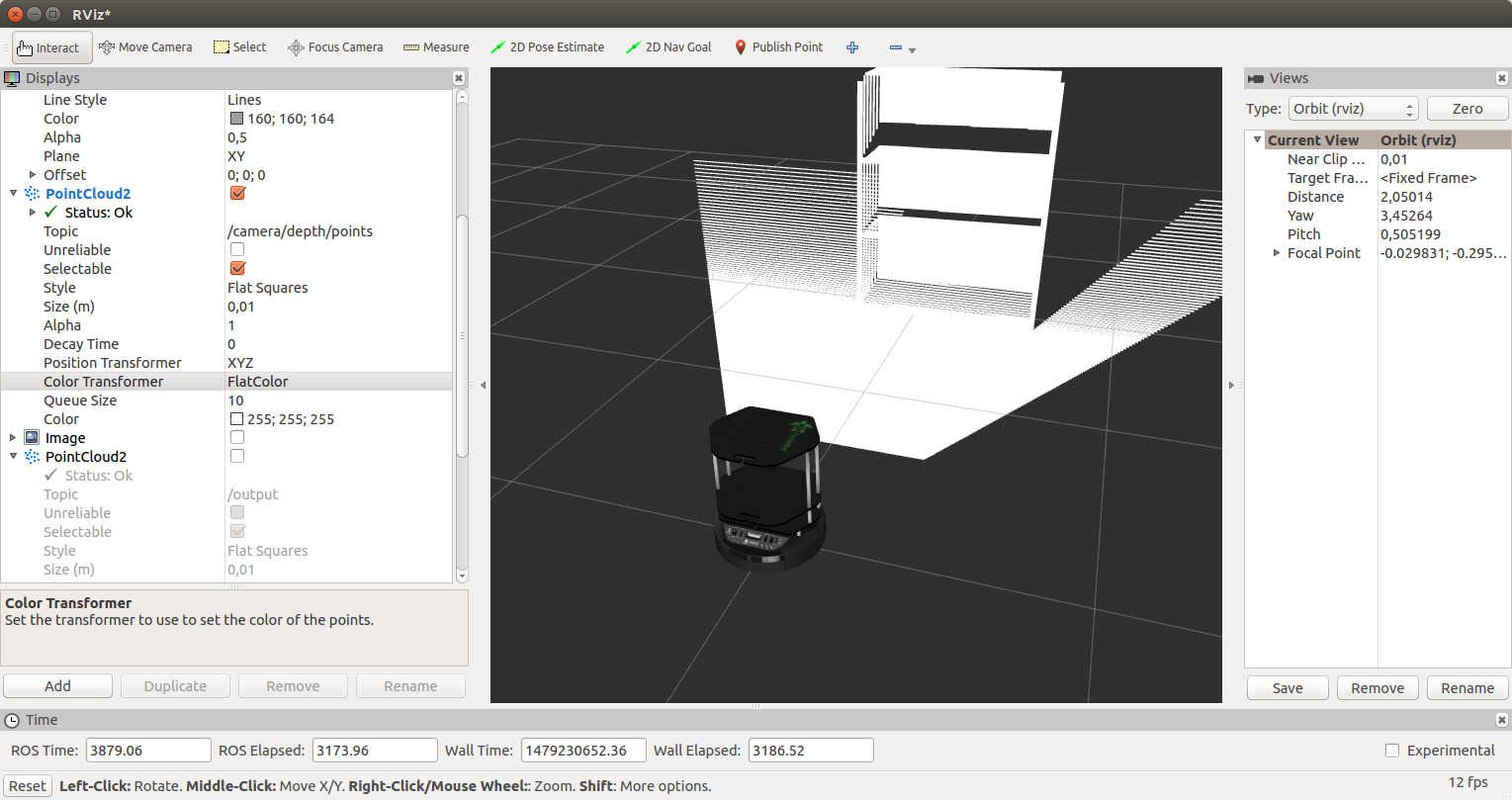

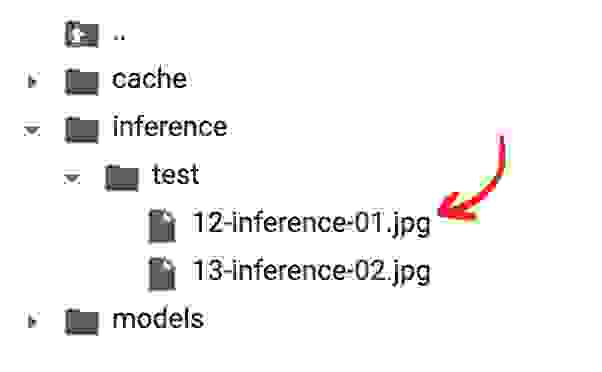

# «Сверхзвуковая» загрузка фотографий в Облако с помощью собственного NSInputStream

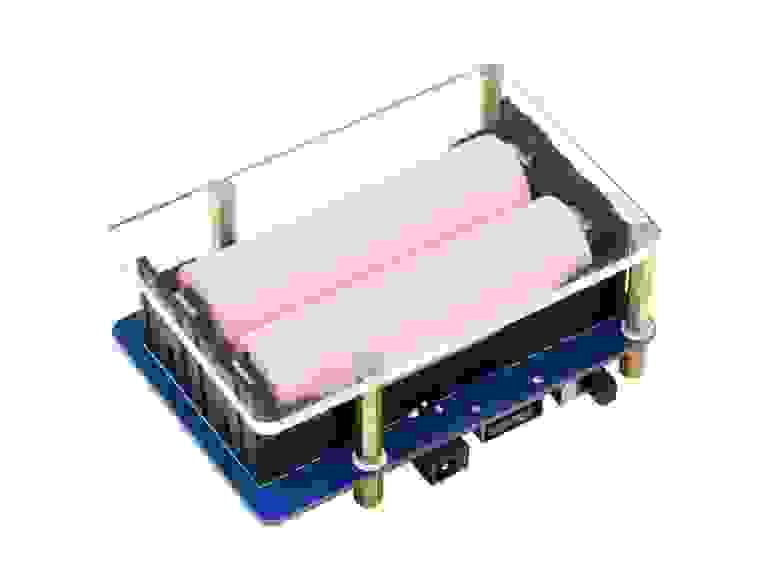

Максимально быстрая загрузка фотографий и видео с устройства на сервер была нашим основным приоритетом при разработке мобильного приложения [Облако Mail.Ru для iOS](https://itunes.apple.com/ru/app/oblako-mail.ru/id696551382?mt=8). Кроме того, с самой первой версии приложения мы предоставили пользователям возможность включить автоматическую загрузку на сервер всего содержимого системной галереи. Это очень удобно для тех, кто волнуется о возможной потере телефона, однако, как вы понимаете, увеличивает объем передаваемых данных в разы.

Итак, мы поставили перед собой задачу сделать загрузку фото и видео из мобильного приложения Облака Mail.Ru не просто хорошей, а близкой к идеальной. Результатом стала наша библиотека [POSInputStreamLibrary](https://github.com/pavelosipov/POSInputStreamLibrary), которая реализует потоковую загрузку в сеть фото и видео из системной галереи iOS. Благодаря ее тесной интеграции с фреймворками ALAssetLibrary и CFNetwork загрузка в приложении происходит очень быстро и не требует ни байта свободного места на устройстве. О реализации собственного наследника класса [NSInputStream](https://developer.apple.com/library/ios/documentation/cocoa/reference/foundation/classes/nsinputstream_class/reference/reference.html) из iOS Developer Library я расскажу в этом посте.

За время службы на благо Облака Mail.Ru поток [POSBlobInputStream](https://github.com/pavelosipov/POSInputStreamLibrary) оброс весьма богатой функциональностью:

* инициализация потока URL-ом `ALAsset`

* поддержка синхронного и асинхронного режимов работы

* автоматическая переинициализация после инвалидации объекта `ALAsset`

* кеширующее чтение данных из `ALAsset`

* возможность указать смещение, с которого будет начато чтение

* возможность интеграции с произвольным источником данных

Смысл каждой из перечисленных возможностей разъясняется в отдельном пункте. Перед их рассмотрением осталось только сказать, что исходный код библиотеки доступен [здесь](https://github.com/pavelosipov/POSInputStreamLibrary), а также в [главном репозитории](https://github.com/CocoaPods/Specs/tree/master/POSInputStreamLibrary) [CocoaPods](http://cocoapods.org/).

Инициализация потока URL-ом ALAsset

-----------------------------------

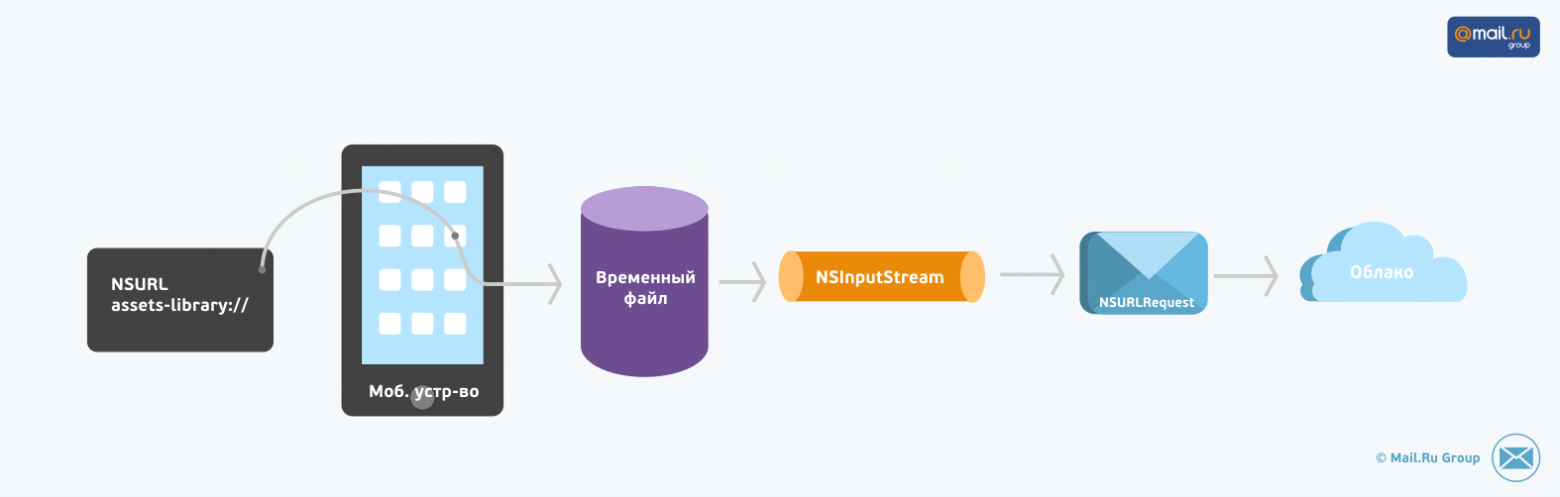

До тех пор, пока вся функциональность приложения ограничивалась лишь загрузкой фотографий, все было просто. Изображение из галереи сохранялось во временный файл, на основе которого создавался стандартный файловый поток. Последний подавался на вход `NSURLRequest` для стриминга в сеть.

```

@interface NSInputStream (NSInputStreamExtensions)

// ...

+ (id)inputStreamWithFileAtPath:(NSString *)path;

// ...

@end

```

```

@interface NSMutableURLRequest (NSMutableHTTPURLRequest)

// ...

- (void)setHTTPBodyStream:(NSInputStream *)inputStream;

// ...

@end

```

Кликабельно:

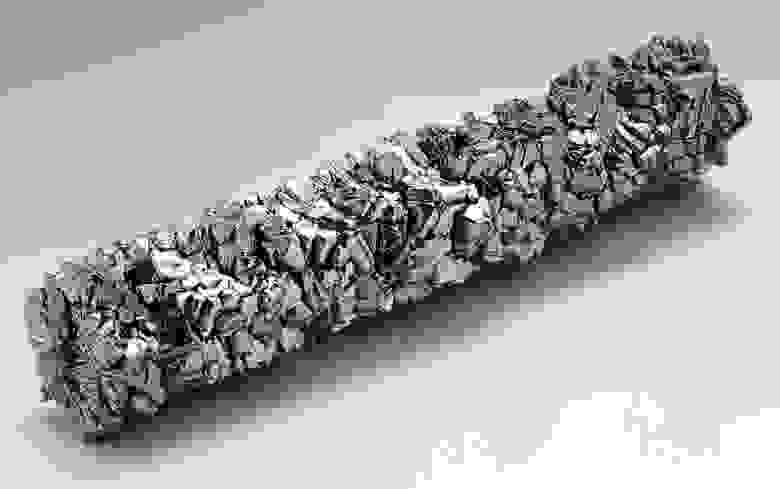

[](https://habrastorage.org/getpro/habr/post_images/8a0/9bc/f7f/8a09bcf7f2d6b8dad70f085ba71331aa.png)

Требование поддержать загрузку видеофайлов сделало этот подход непригодным. Огромный размер роликов порождал следующие проблемы:

* для загрузки требовалось наличие большого количества свободного места на устройстве

* время сохранения видео во временный файл могло достигать 10 и более минут

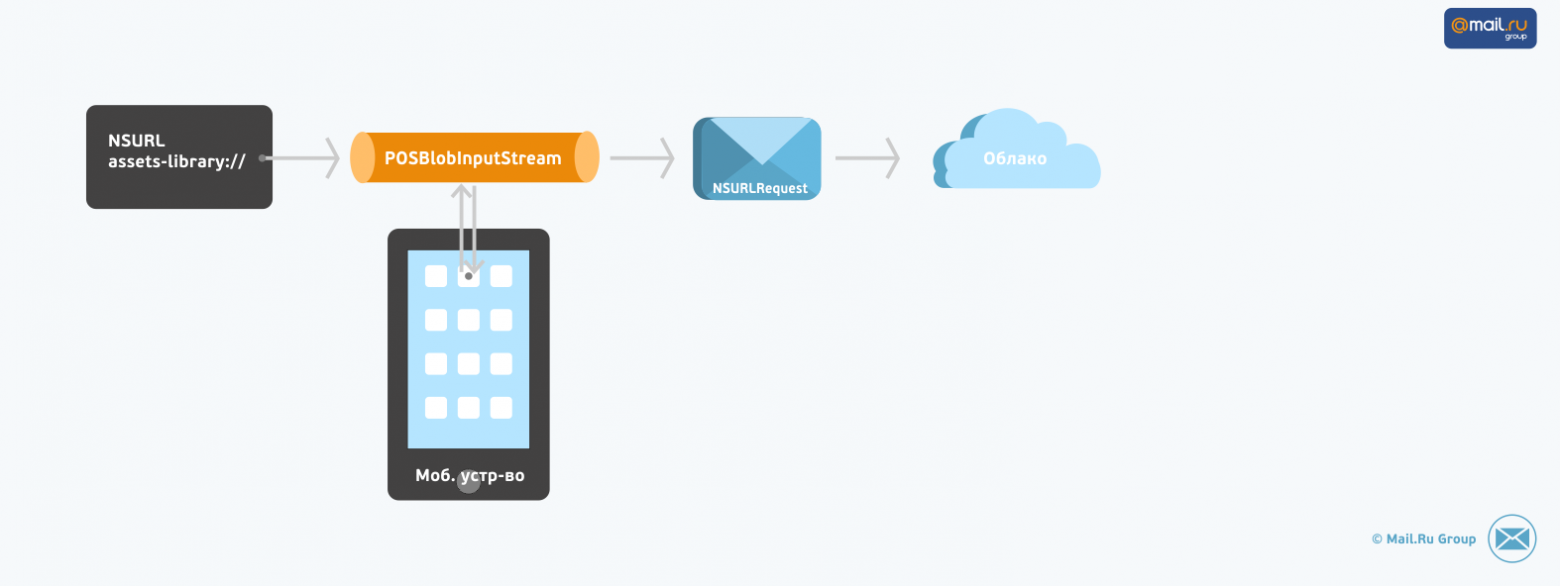

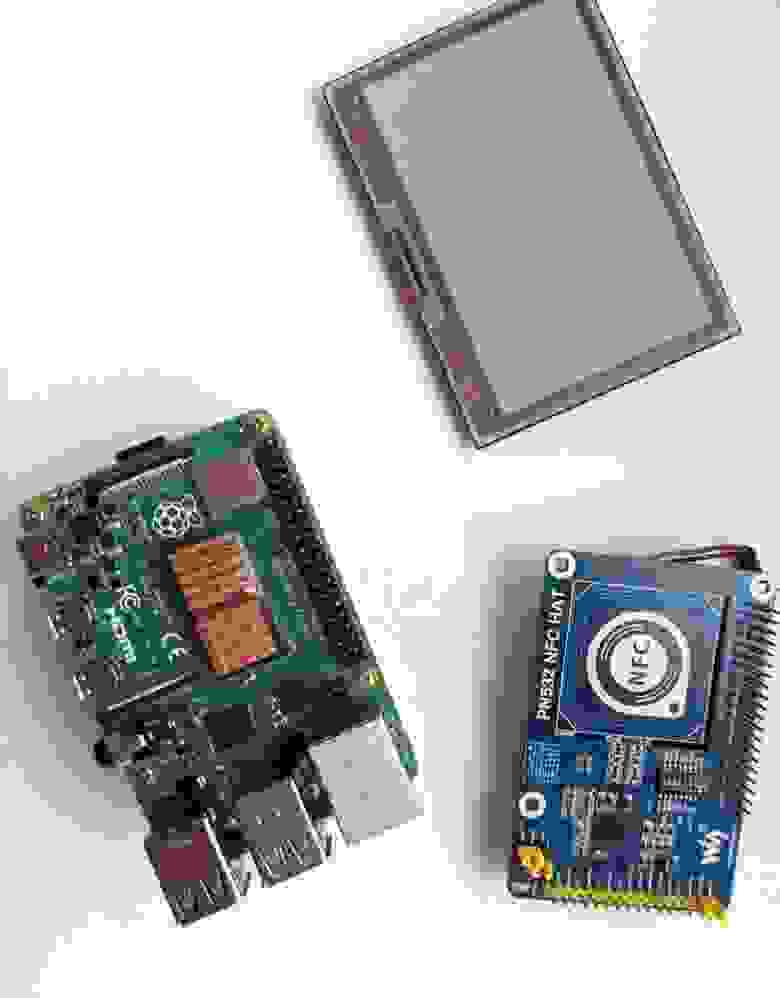

Для преодоления этих неудобств был разработан класс `POSBlobInputStream`. Он инициализируется URL-ом объекта галереи и читает данные напрямую без создания временных файлов.

```

@interface NSInputStream (POS)

+ (NSInputStream *)pos_inputStreamWithAssetURL:(NSURL *)assetURL;

+ (NSInputStream *)pos_inputStreamWithAssetURL:(NSURL *)assetURL asynchronous:(BOOL)asynchronous;

+ (NSInputStream *)pos_inputStreamForCFNetworkWithAssetURL:(NSURL *)assetURL;

@end

```

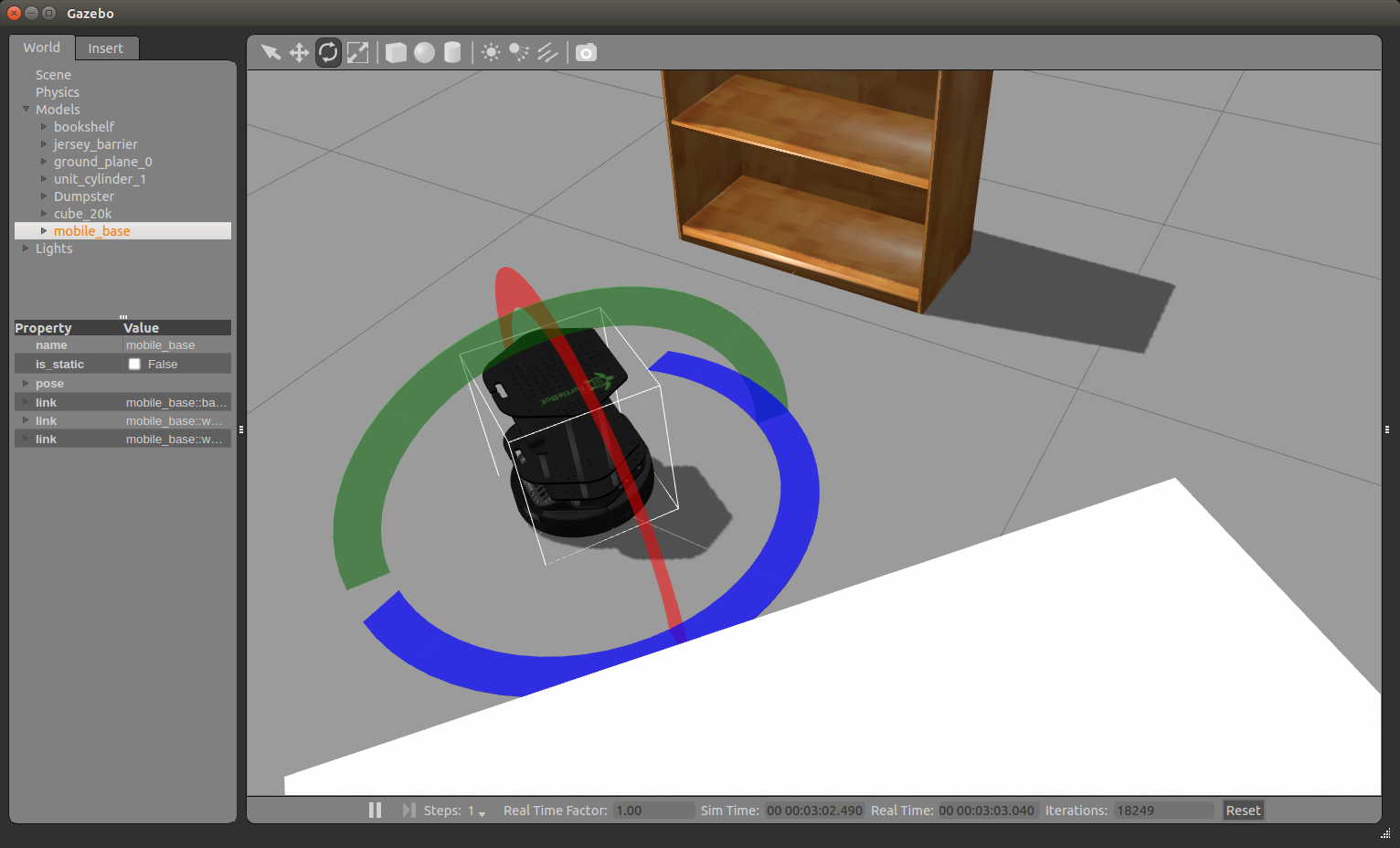

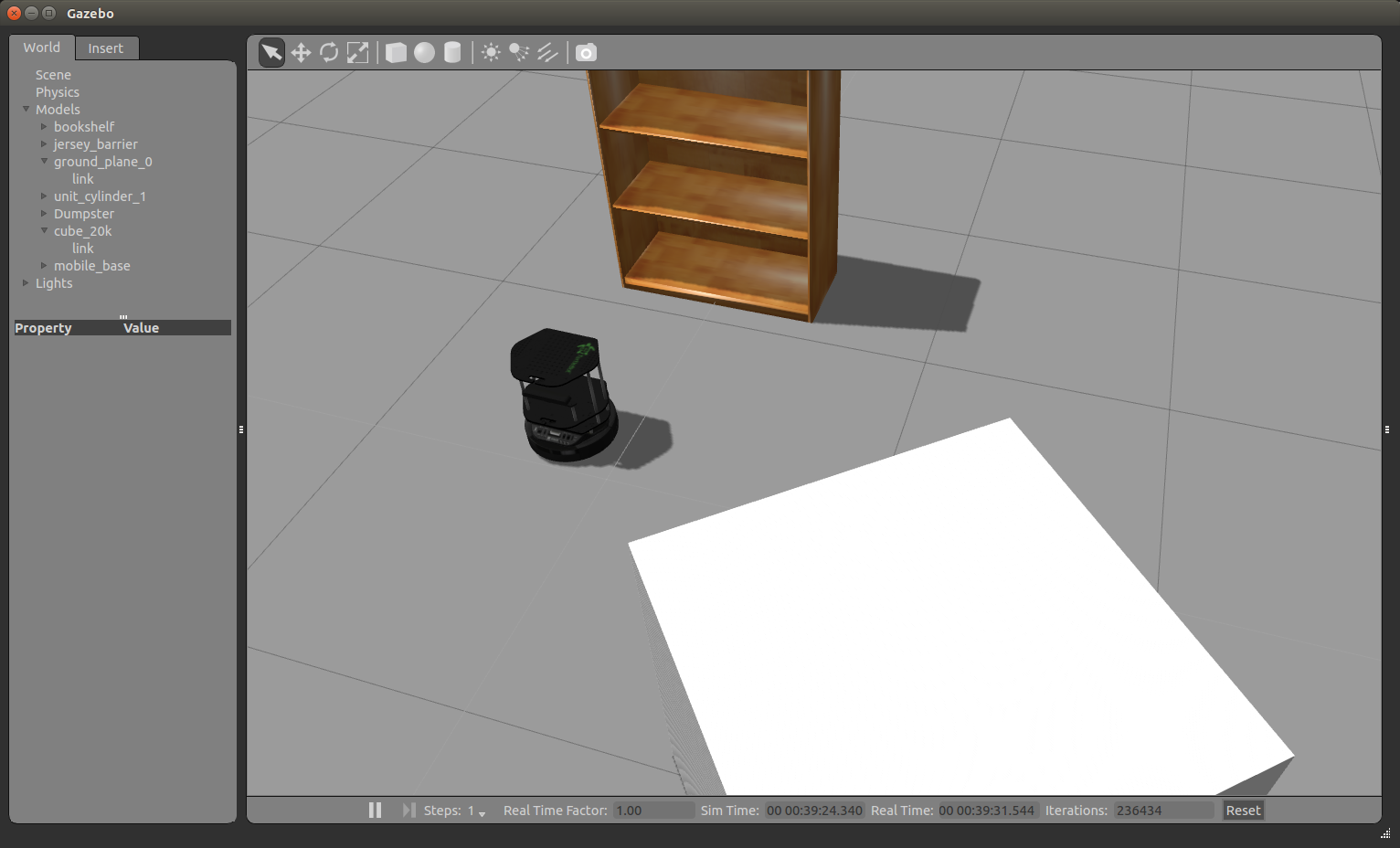

Кликабельно:

[](https://habrastorage.org/getpro/habr/post_images/6d0/f4f/a05/6d0f4fa057a2a02b77df3cb1e16f9536.png)

Поначалу у меня было ощущение, что реализация POSBlobInputStream займет минимум времени, поскольку интерфейс его базового класса тривиален.

```

@interface NSInputStream : NSStream

- (NSInteger)read:(uint8_t *)buffer maxLength:(NSUInteger)len;

- (BOOL)getBuffer:(uint8_t **)buffer length:(NSUInteger *)len;

- (BOOL)hasBytesAvailable;

@end

```

Более того, согласно [документации](https://developer.apple.com/library/ios/documentation/cocoa/reference/foundation/classes/nsinputstream_class/reference/reference.html#//apple_ref/occ/instm/NSInputStream/getBuffer:length:), `getBuffer:length:` поддерживать необязательно, так что, казалось бы, нужно реализовать всего 2 метода. Их отображение на интерфейс `ALAssetRepresentation` вопросов также не вызывало.

```

@interface ALAssetRepresentation : NSObject

// ...

- (long long)size;

- (NSUInteger)getBytes:(uint8_t *)buffer fromOffset:(long long)offset length:(NSUInteger)length error:(NSError **)error;

// ...

@end

```

Однако, спустив новоиспеченный `POSBlobInputStream` на воду, я был неприятно удивлен. Вызов любого метода базового класса NSStream завершался исключением вида:

```

*** -propertyForKey: only defined for abstract class. Define -[POSBlobInputStream propertyForKey:]

```

Причина заключается в том, что `NSInputStream` — это абстрактный класс, а каждый из его init-методов создает объект одного из классов-наследников. В Objective-C этот паттерн называется [class cluster](https://developer.apple.com/library/ios/documentation/general/conceptual/devpedia-cocoacore/ClassCluster.html). Таким образом, реализация собственного потока требует реализации в том числе и всех методов `NSStream`, а их там полна горница.

```

@interface NSStream : NSObject

- (void)open;

- (void)close;

- (id )delegate;

- (void)setDelegate:(id )delegate;

- (id)propertyForKey:(NSString \*)key;

- (BOOL)setProperty:(id)property forKey:(NSString \*)key;

- (void)scheduleInRunLoop:(NSRunLoop \*)aRunLoop forMode:(NSString \*)mode;

- (void)removeFromRunLoop:(NSRunLoop \*)aRunLoop forMode:(NSString \*)mode;

- (NSStreamStatus)streamStatus;

- (NSError \*)streamError;

@end

```

Синхронный и асинхронный режимы работы POSBlobInputStream

---------------------------------------------------------

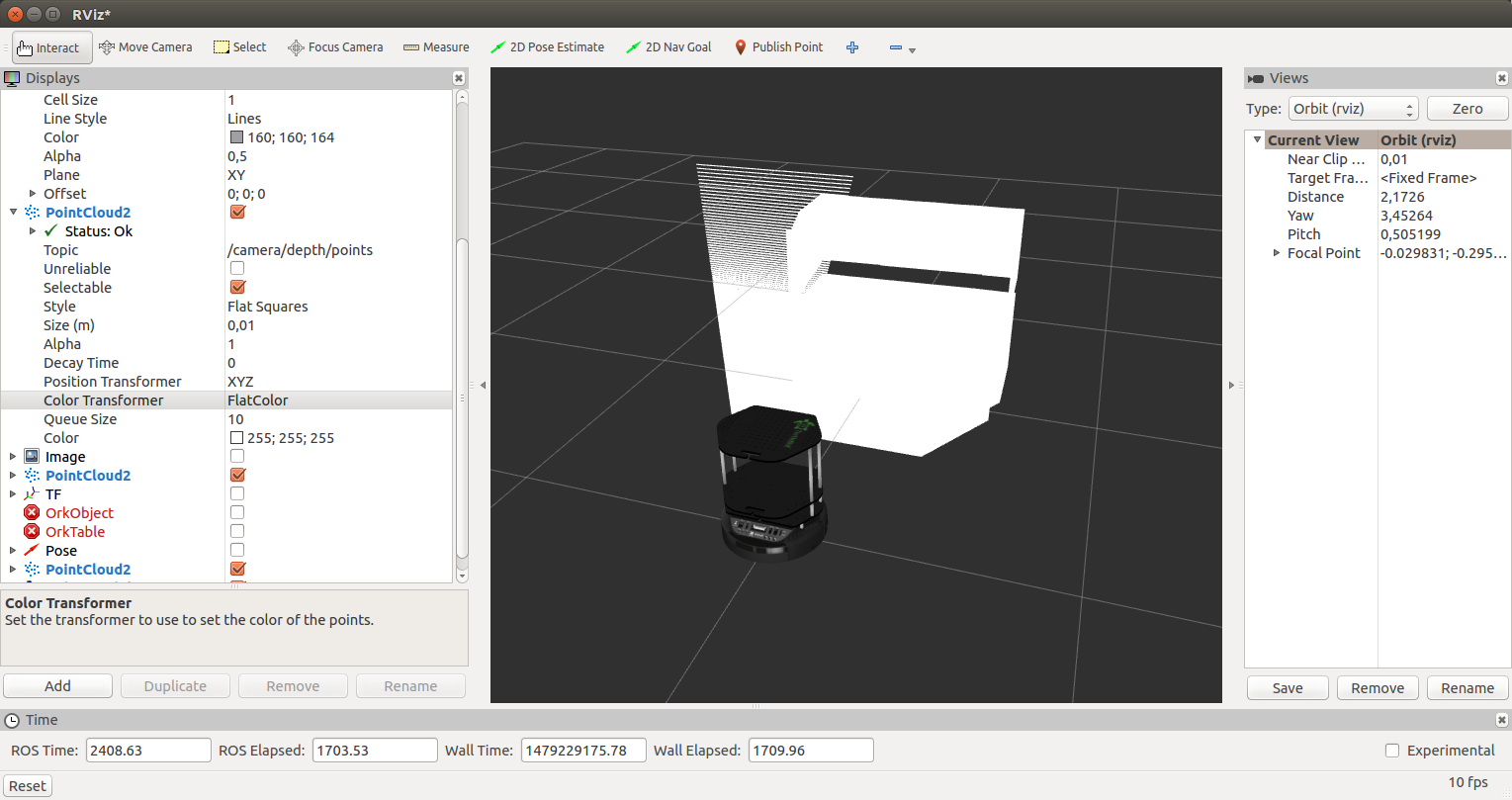

При разработке `POSBlobInputStream` наиболее сложным было реализовать механизм асинхронного уведомления об изменении состояния. В `NSStream` за него отвечают методы `scheduleInRunLoop:forMode:`, `removeFromRunLoop:forMode:` и `setDelegate:`. Благодаря им можно создавать такие потоки, которые на момент открытия не располагают ни байтом информации. `POSBlobInputStream` эксплуатирует эту возможность для следующих целей:

* Реализация неблокирующей версии метода `open`. `POSBlobInputStream` считается открытым, как только ему удалось получить объект `ALAssetRepresentation` по его `NSURL`. Как известно, с помощью iOS SDK это можно сделать только асинхронно. Таким образом, наличие механизма для асинхронного уведомления об изменении состояния потока с `NSStreamStatusNotOpen` на `NSStreamStatusOpen` или `NSStreamStatusError` здесь как нельзя кстати.

* Информирование о наличии у потока данных для чтения посредством отправки события `NSStreamEventHasBytesAvailable`.

В иллюстративных целях ниже приводятся реализации подсчета контрольной суммы файла с использованием POSBlobInputStream. Начнем с рассмотрения синхронного варианта.

```

NSInputStream *stream = [NSInputStream pos_inputStreamWithAssetURL:assetURL asynchronous:NO];

[stream open];

if ([stream streamStatus] == NSStreamStatusError) {

/* Информируем об ошибке */

return;

}

NSParameterAssert([stream streamStatus] == NSStreamStatusOpen);

while ([stream hasBytesAvailable]) {

uint8_t buffer[kBufferSize];

const NSInteger readCount = [stream read:buffer maxLength:kBufferSize];

if (readCount < 0) {

/* Информируем об ошибке */

return;

} else if (readCount > 0) {

/* Логика подсчета контрольной суммы */

}

}

if ([stream streamStatus] != NSStreamStatusAtEnd) {

/* Информируем об ошибке */

return;

}

[stream close];

```

При всей простоте у этого кода есть одна невидимая особенность. Если исполнять его в главном треде, то произойдет deadlock. Дело в том, что метод open блокирует вызывающий тред до тех пор, пока iOS SDK не вернет в главном потоке `ALAsset`. Если же функция `open` сама по себе будет вызвана в главном потоке, то получится классическая взаимоблокировка. Зачем вообще понадобилась синхронная реализация потока, будет описано ниже в разделе “Особенности интеграции с NSURLRequest”.

Асинхронная версия подсчета контрольной суммы выглядит немного сложнее.

```

@interface ChecksumCalculator ()

@end

@implementation ChecksumCalculator

- (void)calculateChecksumForStream:(NSInputStream \*)aStream {

aStream.delegate = self;

[aStream open];

dispatch\_async(dispatch\_get\_global\_queue(DISPATCH\_QUEUE\_PRIORITY\_DEFAULT, 0), ^{

NSRunLoop \*runLoop = [NSRunLoop currentRunLoop];

[aStream scheduleInRunLoop:runLoop forMode:NSDefaultRunLoopMode];

for (;;) { @autoreleasepool {

if (![runLoop runMode:NSDefaultRunLoopMode

beforeDate:[NSDate dateWithTimeIntervalSinceNow:kRunLoopInterval]]) {

break;

}

const NSStreamStatus streamStatus = [aStream streamStatus];

if (streamStatus == NSStreamStatusError || streamStatus == NSStreamStatusClosed) {

break;

}

}}

});

}

#pragma mark - NSStreamDelegate

- (void)stream:(NSStream \*)aStream handleEvent:(NSStreamEvent)eventCode {

switch (eventCode) {

case NSStreamEventHasBytesAvailable: {

[self updateChecksumForStream:aStream];

} break;

case NSStreamEventEndEncountered: {

[self notifyChecksumCalculationCompleted];

[\_stream close];

} break;

case NSStreamEventErrorOccurred: {

[self notifyErrorOccurred:[\_stream streamError]];

[\_stream close];

} break;

}

}

@end

```

`ChecksumCalculator` устанавливает себя в качестве обработчика событий `POSBlobInputStream`. Как только у потока появляются новые данные, либо, наоборот, заканчиваются, либо происходит ошибка, он шлет соответствующие события. Обратите внимание, что существует возможность указать, в какой тред их слать. Например, в приведенном листинге кода они будут приходить в некий рабочий поток, созданный GCD.

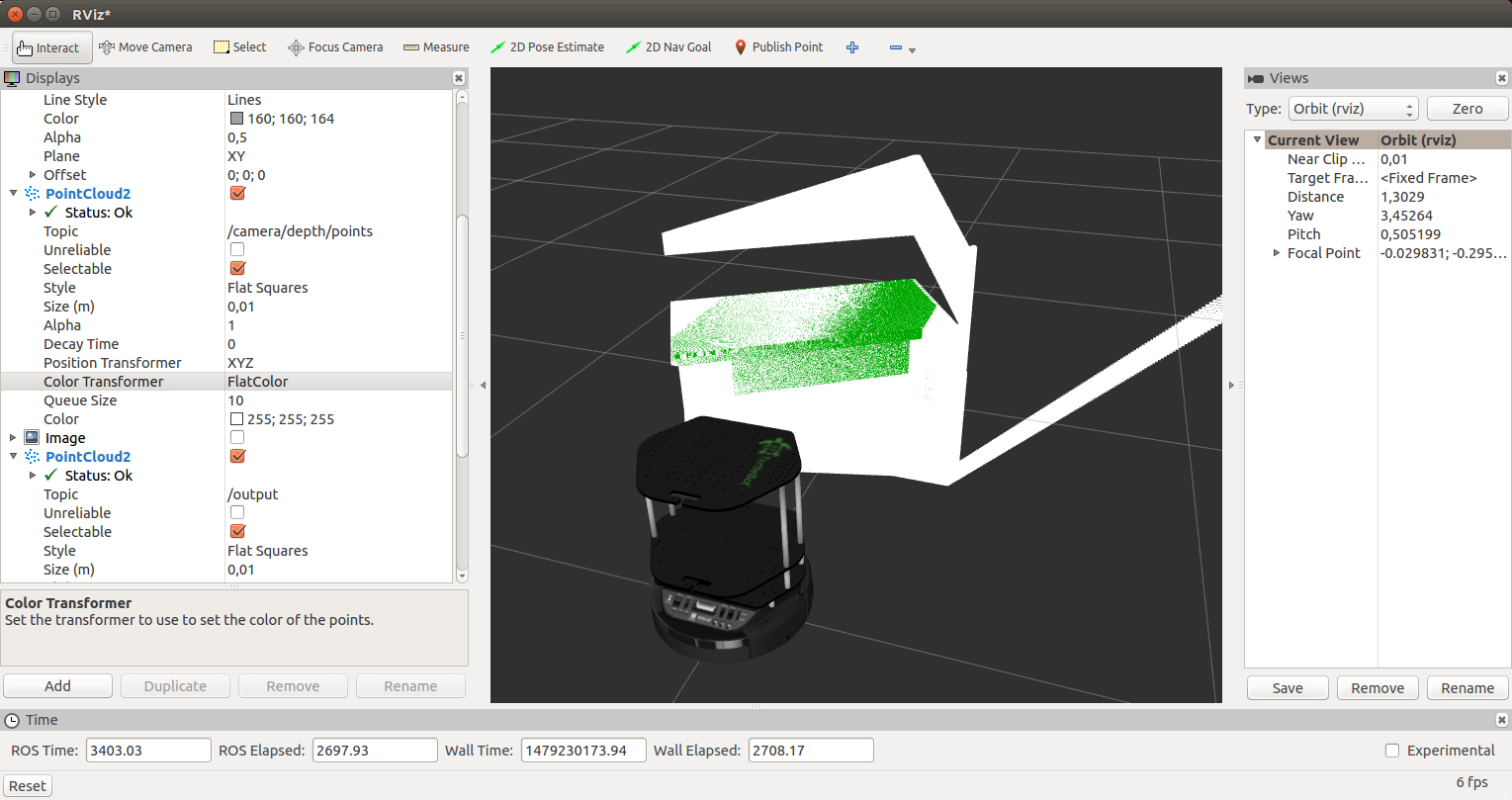

Особенности интеграции с ALAssetLibrary

---------------------------------------

При работе с ALAssetLibrary следует учитывать следующее:

* Вызовы методов `ALAssetRepresentation` обходятся очень дорого. `POSBlobInputStream` старается минимизировать их количество за счет кеширования полученных результатов. Например, существует минимальный блок данных, который будет вычитан при вызове метода `read:maxLength:`, и только по его исчерпании произойдет новое обращение.

* `ALAssetRepresentation` может становиться недействительным. Так, на iOS 5.x это происходит при сохранении фотографии в галерею телефона. С точки зрения клиентского кода это выглядит как возврат нулевого значения методом `getBytes:fromOffset:length:error:` объекта `ALAssetRepresentation`. При этом заведомо известно, что данные до конца не прочитаны. В этом случае `POSBlobInputStream` получает `ALAssetRepresentation` заново. Нелишним будет отметить, что при работе в синхронном режиме на время переинициализации вызывающий поток блокируется, а в асинхронном — нет.

Особенности интеграции с NSURLRequest

-------------------------------------

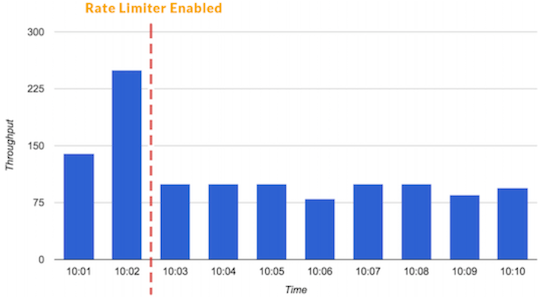

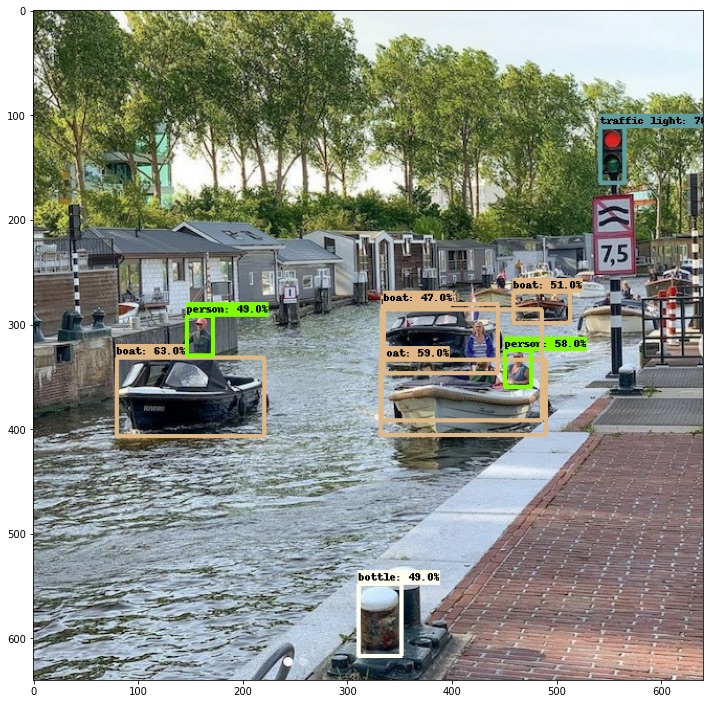

В основе реализации сетевого уровня iOS SDK в целом и `NSURLRequest` в частности лежит фреймворк CFNetwork. За долгие годы жизни он накопил немало шкафов со скелетами. Но обо всем по порядку.

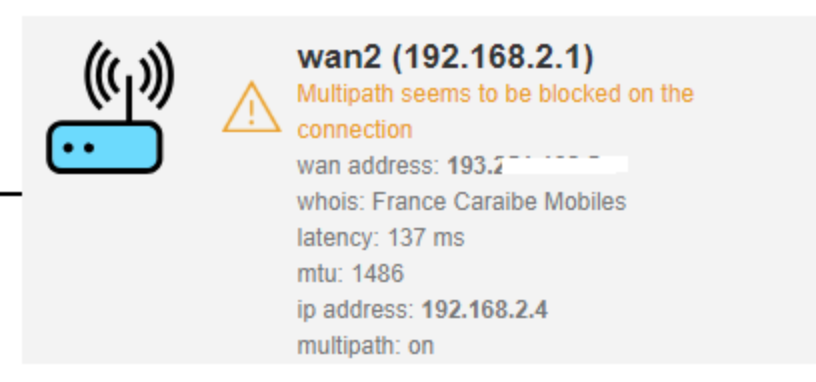

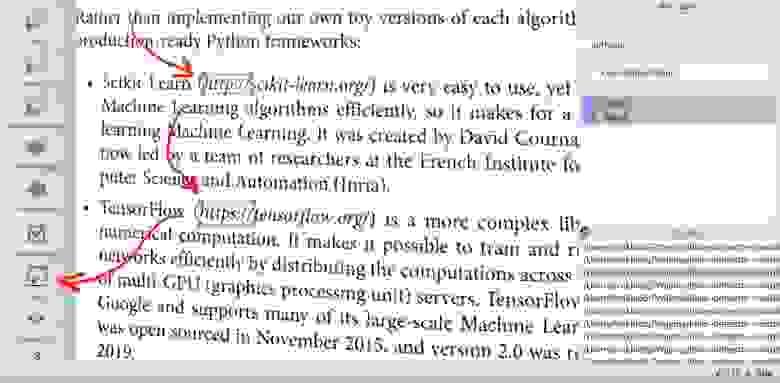

`NSInputStream` является одним из "[toll-free bridged](https://developer.apple.com/library/ios/documentation/General/Conceptual/CocoaEncyclopedia/Toll-FreeBridgin/Toll-FreeBridgin.html#//apple_ref/doc/uid/TP40010810-CH2)" классов iOS SDK. Его можно привести к [CFReadStreamRef](https://developer.apple.com/library/ios/documentation/CoreFoundation/Reference/CFReadStreamRef/Reference/reference.html#//apple_ref/c/tdef/CFReadStreamRef) и работать с ним в дальнейшем как с объектом данного типа. Это свойство лежит в основе реализации `NSURLRequest`. Последний выдает `POSBlobInputStream` за своего брата-близнеца, и CFNetwork общается с ним уже с помощью С-интерфейса. В теории все C-вызовы к `CFReadStream` должны проксироваться на вызовы соответствующих им методов `NSInputStream`. Однако на практике есть два серьезных отклонения:

1. Не все вызовы проксируются. Для некоторых эту процедуру приходится делать самостоятельно. Останавливаться на этом здесь не буду, поскольку в интернете есть хорошие статьи на эту тему: [How to implement a CoreFoundation toll-free bridget NSInputStream](http://blog.octiplex.com/2011/06/how-to-implement-a-corefoundation-toll-free-bridged-nsinputstream-subclass/), [Subclassing NSInputStream](http://bjhomer.blogspot.ru/2011/04/subclassing-nsinputstream.html).

2. Проксирование [CFReadStreamGetError](https://developer.apple.com/library/ios/documentation/CoreFoundation/Reference/CFReadStreamRef/Reference/reference.html#//apple_ref/c/func/CFReadStreamGetError) приводит к падению приложения. Это эксклюзивное знание было получено путем анализа crash-логов приложения и медитаций над [исходниками CFStream](https://github.com/opensource-apple/CF/blob/master/CFStream.c). Видимо, по этой причине указанная функция помечена в документации устаревшей, но, тем не менее, ее использование еще не искоренено изо всех мест CFNetwork. Так, каждый раз, когда `NSInputStream` информирует CFNetwork об ошибке, фреймворк пытается получить ее описание, используя эту злосчастную функцию. Итог печален.

Для борьбы со второй проблемой вариантов не так много. Поскольку отрефакторить CFNetwork невозможно, остается только не провоцировать его на враждебные действия. Чтобы CFNetwork не пытался получить описание ошибки, нужно ни при каких условиях не сообщать ему о ее появлении. По этой причине `POSBlobInputStream` обзавелся свойством `shouldNotifyCoreFoundationAboutStatusChange`. Если флаг выставлен, то:

1. поток не будет слать уведомления об изменении своего статуса посредством callback-ов C

2. метод `streamStatus` никогда не вернет значение `NSStreamStatusError`

Единственный способ узнать о возникновении ошибки при поднятом флаге — реализовать неким классом протокол `NSStreamDelegate` и установить его в качестве делегата потоку (см. пример подсчета контрольной суммы выше).

Еще одним неприятным открытием стало то, что CFNetwork работает с потоком в синхронном режиме. Несмотря на то, что фреймворк подписывается на уведомления, он все равно зачем-то занимается его poll-ингом. Например, метод `open` вызывается в цикле несколько раз, и если поток за этот интервал времени не успевает перейти в открытое состояние, он признается испорченным. Эта особенность сетевого фреймворка и была причиной поддержки в `POSBlobInputStream` синхронного режим работы, пусть и с ограничениями.

Поддержка чтения данных со смещением

------------------------------------

iOS-приложение Облака Mail.Ru умеет дозагружать файлы. Данная функциональность позволяет экономить трафик и время пользователя в случае, когда часть загружаемого файла уже находится в хранилище. Для реализации этого требования `POSBlobInputStream` был обучен считыванию содержимого фотографии не с начала, а с некоторой позиции. Смещение в нем задается свойством `NSStreamFileCurrentOffsetKey`. Благодаря тому, что оно же используется для сдвига начала стандартного файлового потока, появляется возможность указывать его единообразно.

Поддержка произвольных источников данных

----------------------------------------

`POSBlobInputStream` был создан для загрузки фото и видео из галереи. Однако спроектирован он таким образом, чтобы в случае необходимости можно было использовать и другие источники данных. Для стриминга из других источников необходимо реализовать протокол `POSBlobInputStreamDataSource`.

```

@protocol POSBlobInputStreamDataSource

//

// Self-explanatory KVO-compliant properties.

@property (nonatomic, readonly, getter = isOpenCompleted) BOOL openCompleted;

@property (nonatomic, readonly) BOOL hasBytesAvailable;

@property (nonatomic, readonly, getter = isAtEnd) BOOL atEnd;

@property (nonatomic, readonly) NSError \*error;

//

// This selector will be called before anything else.

- (void)open;

//

// Data Source configuring.

- (id)propertyForKey:(NSString \*)key;

- (BOOL)setProperty:(id)property forKey:(NSString \*)key;

//

// Data Source data.

// The contracts of these selectors are the same as for NSInputStream.

- (NSInteger)read:(uint8\_t \*)buffer maxLength:(NSUInteger)maxLength;

- (BOOL)getBuffer:(uint8\_t \*\*)buffer length:(NSUInteger \*)bufferLength;

@end

```

Свойства используются не только для получения состояния источника данных, но и для информирования потока о его изменении с помощью механизма KVO.

Итог

----

За время работы над потоком я провел немало времени в сети в поисках каких-либо аналогов. Во-первых, не хотелось изобретать велосипед, а во-вторых, дело идет гораздо быстрее, если держать перед глазами некий образец. К сожалению, хороших реализаций мне найти не удалось. Бичом большинства аналогов является реализация асинхронной работы. В лучшем случае как в [HSCountingInputStream](https://github.com/bjhomer/HSCountingInputStream) для диспетчеризации событий используется внутренний объект одного из стандартных потоков, что некорректно. Зачастую асинхронный режим работы не поддерживается вовсе, как, например, в [NTVStreamMux](https://github.com/albert-wang/iosbooru/blob/1dc9bef47a5763a9d6d3b63344ae87b3fff1b78e/iosbooru/iosbooru/NTVStreamMux.mm):

```

#pragma mark Undocumented but necessary NSStream Overrides (fuck you Apple)

- (void) _scheduleInCFRunLoop:(NSRunLoop*) inRunLoop forMode:(id)inMode {

/* FUCK YOU APPLE */

}

- (void) _setCFClientFlags:(CFOptionFlags)inFlags

callback:(CFReadStreamClientCallBack)inCallback

context:(CFStreamClientContext)inContext {

/* NO SERIOUSLY, FUCK YOU */

}

```

`POSBlobInputStream`, в свою очередь, является одним из ключевых компонентов приложения Облака Mail.Ru. За время службы он был проверен в бою армией пользователей. Было собрано и нивелировано множество граблей, и в данный момент поток является одним из наиболее стабильных компонентов. Пользуйтесь, пишите расширения, и, конечно, буду рад любой обратной связи.

*Павел Осипов,

Руководитель команды разработки Облака для iOS* | https://habr.com/ru/post/216247/ | null | ru | null |

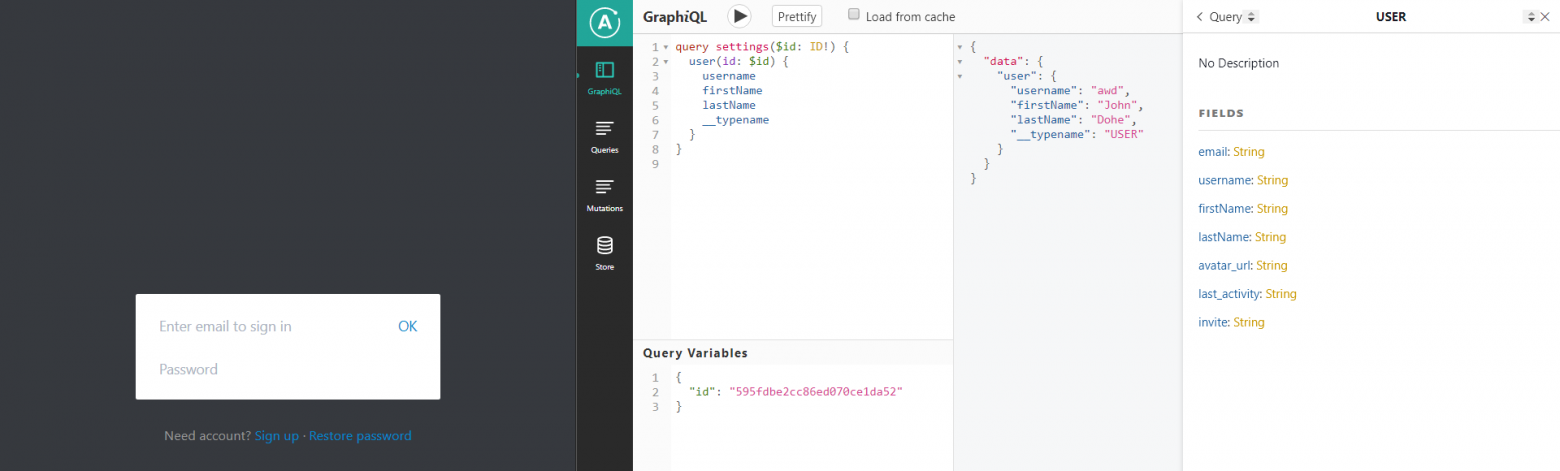

# Веб-приложение на Kotlin + Spring Boot + Vue.js

Добрый день, дорогие обитатели Хабра!

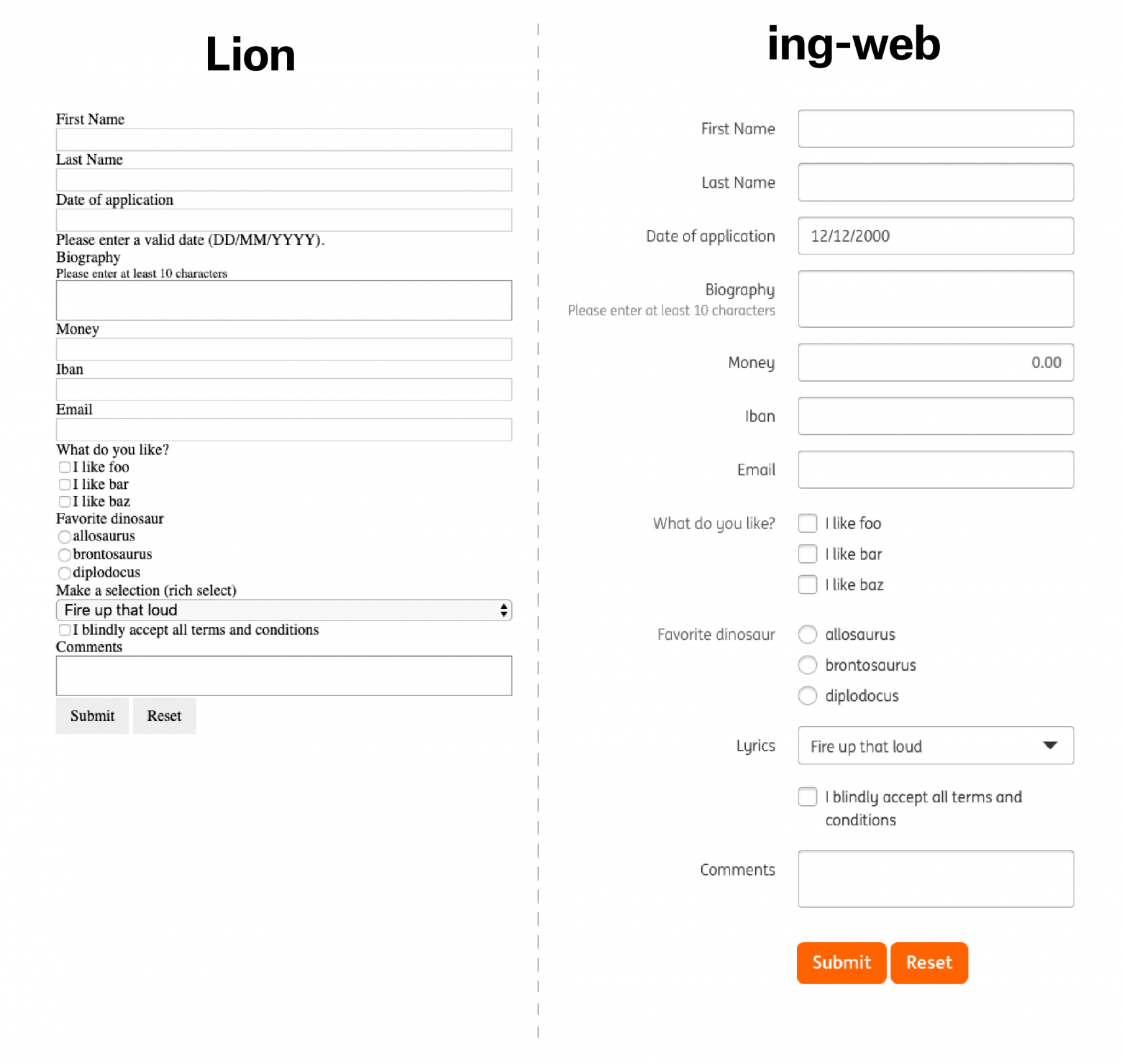

Не так давно мне представилась возможность реализовать небольшой проект без особых требований по технической части. То есть, я был волен выбирать стек технологий на своё усмотрение. Потому не преминул возможностью как следует «пощупать» ~~модные, молодёжные~~ многообещающие, но малознакомые мне на практике **Kotlin** и **Vue.js**, добавив туда уже знакомый **Spring Boot** и примерив всё это на незамысловатое веб-приложение.

Приступив, я опрометчиво полагал, что в Интернете найдётся множество статей и руководств на эту тему. Материалов действительно достаточно, и все они хороши, но только до первого REST-контроллера. Затем начинаются трудности противоречия. А ведь даже в простом приложении хотелось бы иметь более сложную логику, чем отрисовка на странице текста, возвращаемого сервером.

Кое-как разобравшись, я решил написать собственное руководство, которое, надеюсь, будет кому-нибудь полезно.

### О чём и для кого статья

Данный материал — руководство для «быстрого старта» разработки веб-приложения с бэкендом на **Kotlin** + **Spring Boot** и фронтендом на **Vue.js**. Сразу скажу, что я не «топлю» за них и не говорю о каких-то однозначных преимуществах данного стека. Цель данной статьи — поделиться опытом.

Материал рассчитан на разработчиков, имеющих опыт работы с Java, Spring Framework/Spring Boot, React/Angular или хотя бы чистым JavaScript. Подойдёт и тем, у кого нет такого опыта — например, начинающим программистам, но, боюсь, тогда придётся разбираться в некоторых деталях самостоятельно. Вообще, некоторые моменты этого руководства стоит рассмотреть подробнее, но, думаю, лучше сделать это в рамках других публикаций, чтобы сильно не отклоняться от темы и не делать статью громоздкой.

Быть может, кому это поможет сформировать представление о бэкенд-разработке на Kotlin без необходимости самому погружаться в данную тематику, а кому-то — сократить время работы, взяв за основу уже готовый скелет приложения.

Несмотря на описание конкретных практических шагов, в целом, на мой взгляд, статья имеет экспериментально-обзорный характер. Сейчас такой подход, да и сама постановка вопроса видится, скорее, как хипстерская затея — собрать как можно больше модных слов в одном месте. Но в будущем, возможно, и займёт свою нишу в энтерпрайзной разработке. Быть может, среди нас есть начинающие (и продолжающие) программисты, которым предстоит жить и работать во времена, когда Kotlin и Vue.js будут так же популярны и востребованы, как сейчас Java и React. Ведь Kotlin и Vue.js действительно подают большие надежды.

За то время, пока я писал это руководство, в сети уже стали появляться похожие публикации, как, например, [эта](https://auth0.com/blog/vuejs-spring-boot-kotlin-and-graphql-building-modern-apps-part-1/). Повторюсь, материалов, где разбирается порядок действий до первого REST-контроллера достаточно, но интересно было бы увидеть более сложную логику — например, реализацию аутентификации с разделением по ролям, что является довольно необходимым функционалом. Именно этим я дополнил своё собственное руководство.

### Содержание

* [Краткая справка](#Reference)

* [Инструменты разработки](#Instruments)

* [Инициализация проекта](#Initialization)

* [REST API](#RESTAPI)

* [Подключение к базе данных](#DB)

* [Аутентификация](#Authentication)

* [Пути улучшения](#WaysToImprove)

* [Полезные ссылки](#Links)

Краткая справка

---------------

[**Kotlin**](https://ru.wikipedia.org/wiki/Kotlin) — язык программирования, работающий поверх **JVM** и разрабатываемый международной компанией **JetBrains**.

[**Vue.js**](https://ru.wikipedia.org/wiki/Vue.js) — **JavaScript** -фреймворк для разработки одностраничных приложений в реактивном стиле.

Инструменты разработки

----------------------

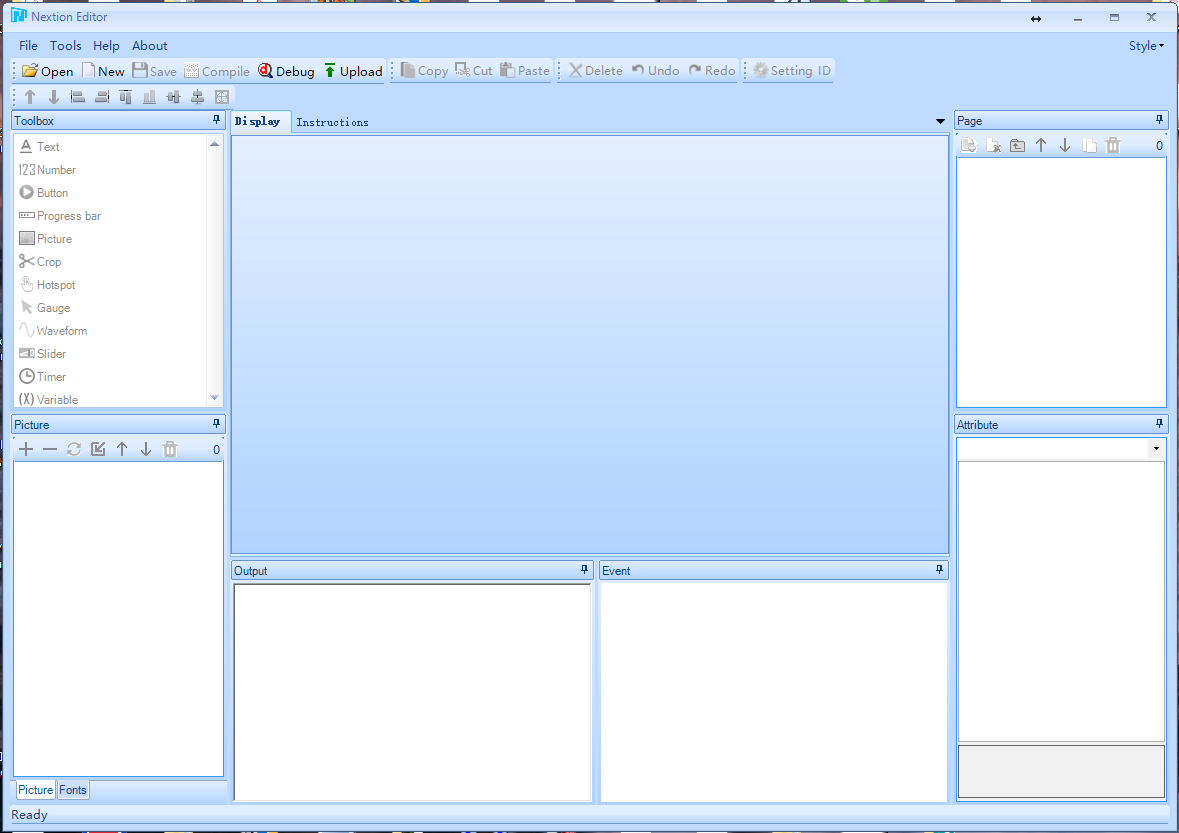

В качестве среды разработки я бы рекомендовал использовать **IntelliJ IDEA** — среду разработки от **JetBrains**, получившую широкую популярность в Java-сообществе, поскольку она имеет удобные инструменты и фичи для работы с Kotlin вплоть для преобразования Java-кода в код на Kotlin. Однако, не стоит рассчитывать, что таким образом можно мигрировать целый проект, и всё вдруг заработает само собой.

Счастливые обладатели **IntelliJ IDEA Ultimate Edition** могут для удобства работы с Vue.js установить соответствующий [плагин](https://plugins.jetbrains.com/plugin/9442-vue-js). Если же вы ищете компромисс между ~~халявой~~ ценой и удобством, то очень рекомендую использовать **Microsoft Visual Code** с плагином [Vetur](https://marketplace.visualstudio.com/items?itemName=octref.vetur).

Полагаю, для многих это очевидно, но на всякий случай напомню, что для работы c Vue.js требуется менеджер пакетов [npm](https://www.npmjs.com). Инструкцию по установке Vue.js можно найти на сайте [Vue CLI](https://cli.vuejs.org/guide/installation.html).

В качестве сборщика проектов на Java в данном руководстве используется [Maven](https://maven.apache.org), в качестве сервера баз данных — [PostgreSQL](https://www.postgresql.org).

Инициализация проекта

---------------------

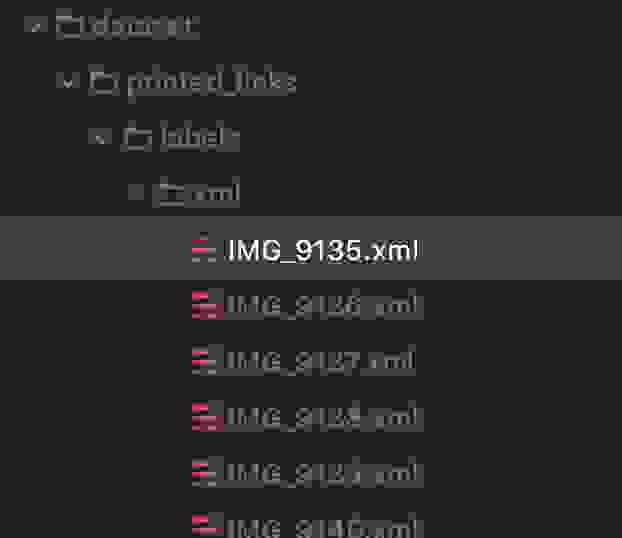

Создадим директорию проекта, назвав, например *kotlin-spring-vue*. Нашем проекте будут два модуля — **backend** и **frontend**. Сначала будет собираться фронтенд. Затем, при сборке бэкенд будет копировать себе index.html, favicon.ico и все статические файлы (\*.js, \*.css, изображения и т.д.).

Таким образом, в корневом каталоге у нас будут находится две подпапки — */backend* и */frontend*. Однако, не стоит торопиться создавать их вручную.

Инициализировать модуль бэкенда можно несколькими путями:

* вручную (путь самурая)

* сгенерирован проект Spring Boot приложения средствами **Spring Tool Suite** или **IntelliJ IDEA Ultimate Edition**

* С помощью [**Spring Initializr**](https://start.spring.io), указав нужные настройки — это, пожалуй, самый распространенный способ

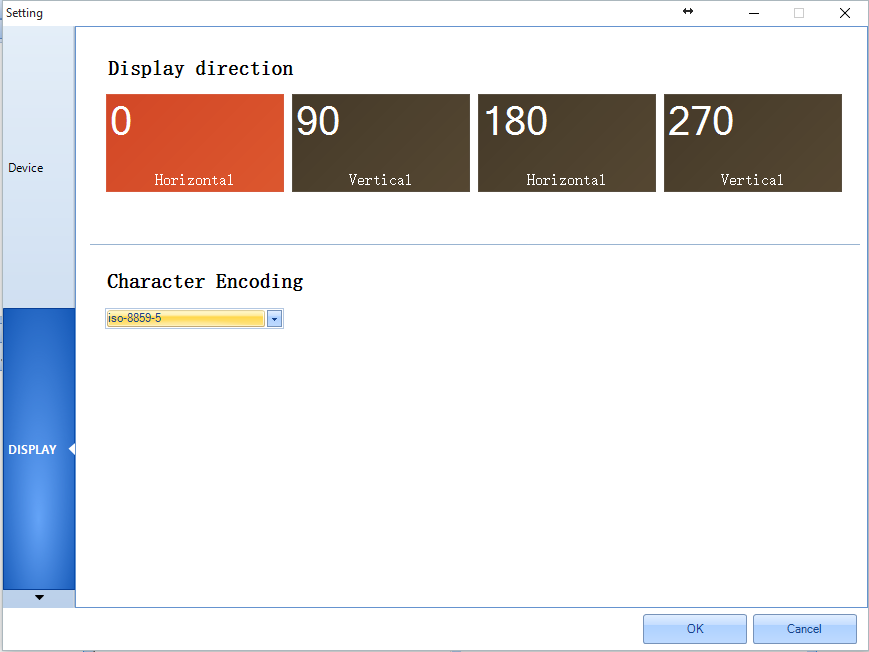

В нашем случае первичная конфигурация такова:

**Конфигуарция модуля бэкенда**

* Project: Maven Project

* Language: Kotlin

* Spring Boot: 2.1.6

* Project Metadata: Java 8, JAR packaging

* Dependencies: Spring Web Starter, Spring Boot Actuator, Spring Boot DevTools

*pom.xml* должен выглядеть следующим образом:

**pom.xml - backend**

```

xml version="1.0" encoding="UTF-8"?

4.0.0

com.kotlin-spring-vue

demo

0.0.1-SNAPSHOT

com.kotlin-spring-vue

backend

0.0.1-SNAPSHOT

backend

Backend module for Kotlin + Spring Boot + Vue.js

1.8

1.2.71

UTF-8

UTF-8

3.3.0

org.springframework.boot

spring-boot-starter-actuator

org.springframework.boot

spring-boot-starter-web

com.fasterxml.jackson.module

jackson-module-kotlin

org.jetbrains.kotlin

kotlin-reflect

org.jetbrains.kotlin

kotlin-stdlib-jdk8

org.springframework.boot

spring-boot-devtools

runtime

true

org.springframework.boot

spring-boot-starter-test

test

${project.basedir}/src/main/kotlin

${project.basedir}/src/test/kotlin

org.springframework.boot

spring-boot-maven-plugin

com.kotlinspringvue.backend.BackendApplicationKt

org.jetbrains.kotlin

kotlin-maven-plugin

-Xjsr305=strict

spring

org.jetbrains.kotlin

kotlin-maven-allopen

${kotlin.version}

maven-resources-plugin

copy Vue.js frontend content

generate-resources

copy-resources

src/main/resources/public

true

${project.parent.basedir}/frontend/target/dist

static/

index.html

favicon.ico

```

Обращаю внимание:

* Название главного класса заканчивается на *Kt*

* Выполняется копирование ресурсов из *корневая\_папка\_проекта/frontend/target/dist* в *src/main/resources/public*

* Родительский проект (parent) в лице *spring-boot-starter-parent* пренесён на уровень главного *pom.xml*

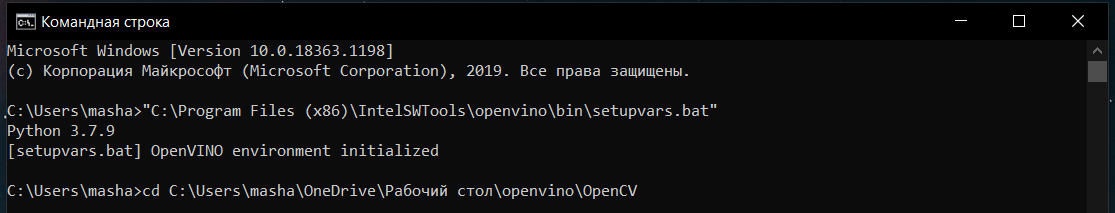

Чтобы инициализировать модуль фронтенда, переходим в корневую директорию проекта и выполняем команду:

```

$ vue create frontend

```

Далее можно выбрать все настройки по умолчанию — в нашем случае этого будет достаточно.

По умолчанию модуль будет собираться в подпапку */dist*, однако нам нужно видеть собранные файлы в папке /target. Для этого создадим файл *vue.config.js* прямо в */frontend* со следующими настройками:

```

module.exports = {

outputDir: 'target/dist',

assetsDir: 'static'

}

```

Поместим в модуль *frontend* файл *pom.xml* такого вида:

**pom.xml - frontend**

```

xml version="1.0" encoding="UTF-8"?

4.0.0

frontend

com.kotlin-spring-vue

demo

0.0.1-SNAPSHOT

UTF-8

UTF-8

1.8

1.6

com.github.eirslett

frontend-maven-plugin

${frontend-maven-plugin.version}

install node and npm

install-node-and-npm

v11.8.0

npm install

npm

generate-resources

install

npm run build

npm

run build

```

И, наконец, поместим *pom.xml* в корневую директорию проекта:

**pom.xml**

```

xml version="1.0" encoding="UTF-8"?

4.0.0

com.kotlin-spring-vue

demo

pom

0.0.1-SNAPSHOT

kotlin-spring-vue

Kotlin + Spring Boot + Vue.js

frontend

backend

org.springframework.boot

spring-boot-starter-parent

2.1.3.RELEASE

${project.basedir}

org.jacoco

jacoco-maven-plugin

pre-unit-test

prepare-agent

post-unit-test

test

report

org.eluder.coveralls

coveralls-maven-plugin

org.jetbrains.kotlin

kotlin-maven-plugin

${kotlin.version}

compile

compile

compile

test-compile

test-compile

test-compile

1.8

```

где мы видим два наших модуля — *frontend* и *backend*, а также parent — *spring-boot-starter-parent*.

**Важно:** модули должны собираться именно в таком порядке — сначала фронтенд, потом бэкенд.

Теперь мы можем выполнить сборку проекта:

```

$ mvn install

```

И, если всё собралось, запустить приложение:

```

$ mvn --projects backend spring-boot:run

```

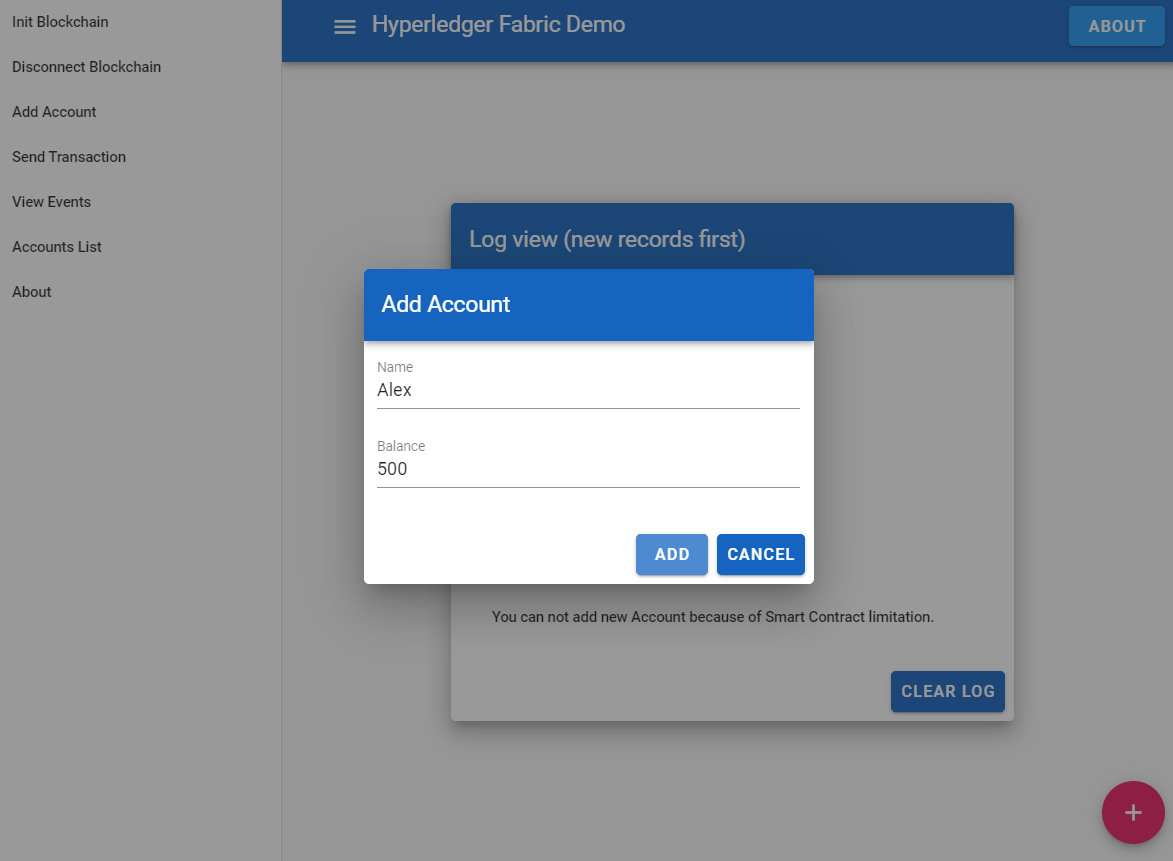

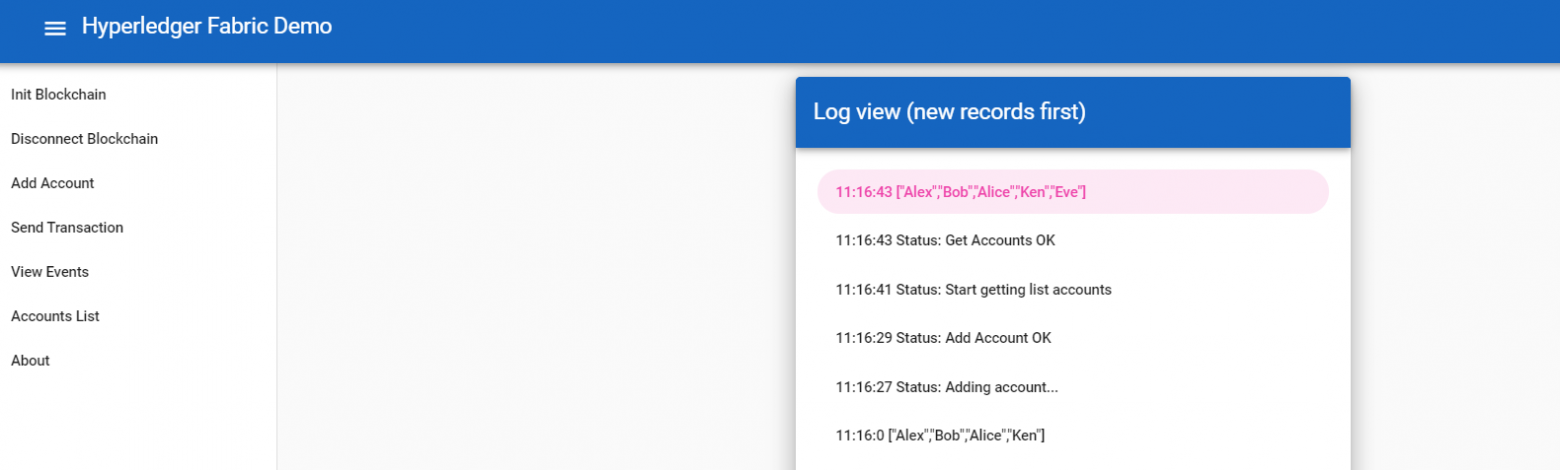

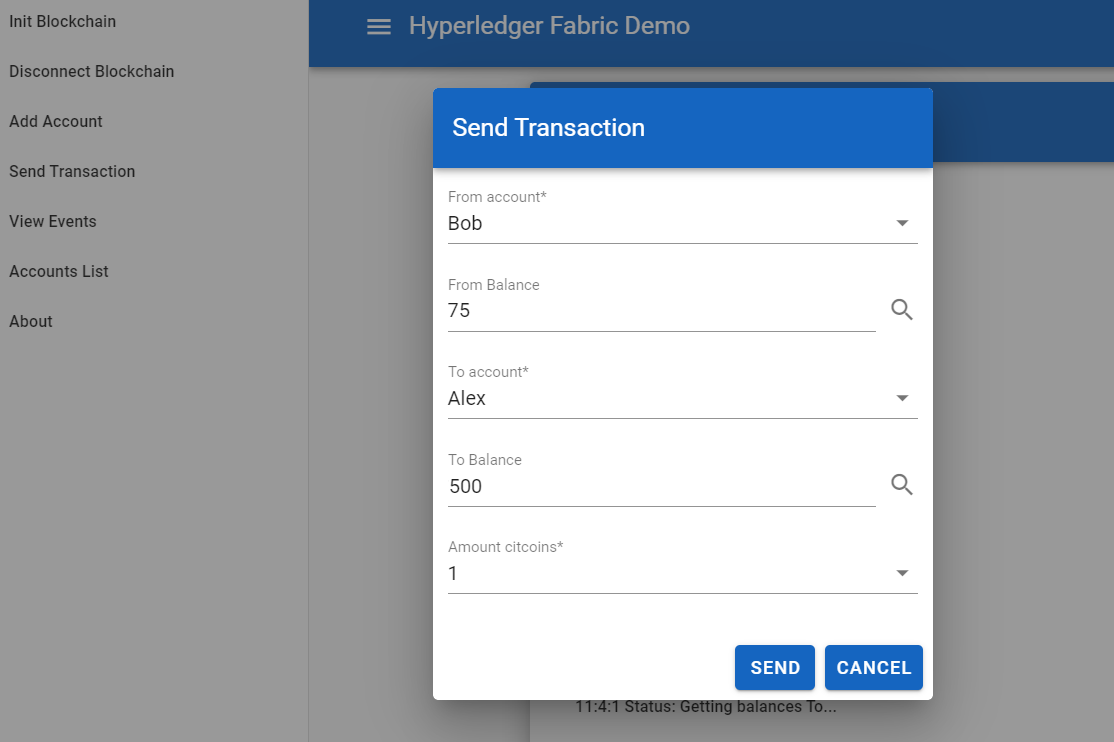

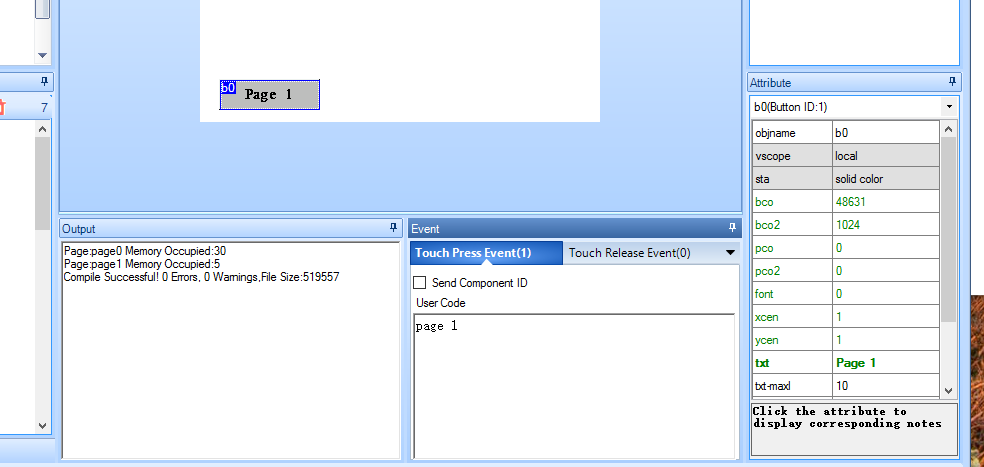

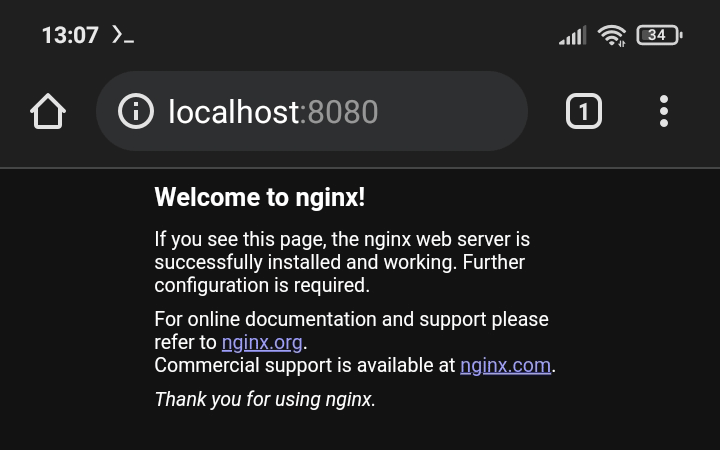

По адресу <http://localhost:8080/> будет доступна страничка Vue.js по умолчанию:

REST API

--------

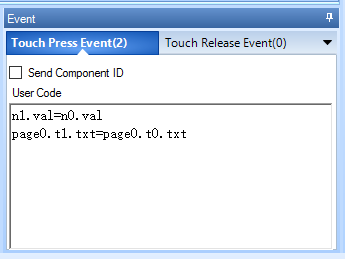

Теперь давайте создадим какой-нибудь простенький REST-сервис. Например, «Hello, [имя\_пользователя]!» (по умолчанию — World), который считает, сколько раз мы его дёрнули.

Для этого нам понадобится структура данных состоящая из числа и строки — класс, единственным назначением которого является хранение данных. Для этого в Kotlin существуют [классы данных](https://kotlinlang.ru/docs/reference/data-classes.html). И наш класс будет выглядеть так:

```

data class Greeting(val id: Long, val content: String)

```

Всё. Теперь можем написать непосредственно сервис.

**Примечание:** для удобства будет вынесить все сервисы в отдельный маршрут */api* с помощью аннотации *@RequestMapping* перед объявлением класса:

```

import org.springframework.web.bind.annotation.*

import com.kotlinspringvue.backend.model.Greeting

import java.util.concurrent.atomic.AtomicLong

@RestController

@RequestMapping("/api")

class BackendController() {

val counter = AtomicLong()

@GetMapping("/greeting")

fun greeting(@RequestParam(value = "name", defaultValue = "World") name: String) =

Greeting(counter.incrementAndGet(), "Hello, $name")

}

```

Теперь перезапустим приложение и посмотрим результат <http://localhost:8080/api/greeting?name=Vadim>:

```

{"id":1,"content":"Hello, Vadim"}

```

Обновим страничку и убедимся, что счётчик работает:

```

{"id":2,"content":"Hello, Vadim"}

```

Теперь поработаем над фронтендом, чтобы красиво отрисовывать результат на странице.

Установим *vue-router* для того, чтобы реализовать навигацию по «страницам» (по факту — по маршрутам и компонентам, поскольку страница у нас всего одна) в нашем приложении:

```

$ npm install --save vue-router

```

Добавим *router.js* в */src* — этот компонент будет отвечать за маршрутизацию:

**router.js**

```

import Vue from 'vue'

import Router from 'vue-router'

import HelloWorld from '@/components/HelloWorld'

import Greeting from '@/components/Greeting'

Vue.use(Router)

export default new Router({

mode: 'history',

routes: [

{

path: '/',

name: 'Greeting',

component: Greeting

},

{

path: '/hello-world',

name: 'HelloWorld',

component: HelloWorld

}

]

})

```

**Примечание:** по корневому маршруту ("/") нам будет доступен компонент Greeting.vue, который мы напишем чуть позже.

Сейчас же заимпортируем наш роутер. Для этого внесём изменения в

**main.js**

```

import Vue from 'vue'

import App from './App.vue'

import router from './router'

Vue.config.productionTip = false

new Vue({

router,

render: h => h(App),

}).$mount('#app')

```

Затем

**App.vue**

```

export default {

name: 'app'

}

```

Для выполнения запросов к серверу воспользуемся HTTP-клиентом AXIOS:

```

$ npm install --save axios

```

Для того, чтобы не писать каждый раз одни и те же настройки (например, маршрут запросов — "/api") в каждом компоненте, я рекомендую вынести их в отельный компонент *http-common.js*:

```

import axios from 'axios'

export const AXIOS = axios.create({

baseURL: `/api`

})

```

**Примечание:** чтобы избежать предупреждений при в выводе в консоль (*console.log()*), я рекомендую прописать эту строку в *package.json*:

```

"rules": {

"no-console": "off"

}

```

Теперь, наконец, создадим компонент (в */src/components*)

**Greeting.vue**

```

import {AXIOS} from './http-common'

### Greeting component

Counter: {{ counter }}

Username: {{ username }}

export default {

name: 'Greeting',

data() {

return {

counter: 0,

username: ''

}

},

methods: {

loadGreeting() {

AXIOS.get('/greeting', { params: { name: 'Vadim' } })

.then(response => {

this.$data.counter = response.data.id;

this.$data.username = response.data.content;

})

.catch(error => {

console.log('ERROR: ' + error.response.data);

})

}

},

mounted() {

this.loadGreeting();

}

}

```

**Примечание:**

* Параметры запросы захардкожены для того, чтобы просто посмотреть, как работает метод

* Функция загрузки и отрисовки данных (`loadGreeting()`) вызывается сразу после загрузки страницы (*mounted()*)

* мы импортировали AXIOS уже с нашими кастомными настройками из *http-common*

Подключение к базе данных

-------------------------

Теперь давайте рассмотрим процесс взаимодействия с базой данных на примере **PostgreSQL** и **Spring Data**.

Для начала создадим тестовую табличку:

```

CREATE TABLE public."person"

(

id serial NOT NULL,

name character varying,

PRIMARY KEY (id)

);

```

и наполним её данными:

```

INSERT INTO person (name) VALUES ('John'), ('Griselda'), ('Bobby');

```

**Дополним pom.xml модуля бэкенда:**

```

...

42.2.5

...

...

org.springframework.boot

spring-boot-starter-data-jpa

org.postgresql

postgresql

${postgresql.version}

...

org.jetbrains.kotlin

kotlin-maven-plugin

-Xjsr305=strict

spring

jpa

...

org.jetbrains.kotlin

kotlin-maven-noarg

${kotlin.version}

```

Теперь дополним файл *application.properties* модуля бэкенда настройками подключения к БД:

```

spring.datasource.url=${SPRING_DATASOURCE_URL}

spring.datasource.username=${SPRING_DATASOURCE_USERNAME}

spring.datasource.password=${SPRING_DATASOURCE_PASSWORD}

spring.jpa.generate-ddl=true

spring.jpa.properties.hibernate.temp.use_jdbc_metadata_defaults = false

spring.jpa.database-platform=org.hibernate.dialect.PostgreSQL9Dialect

spring.jpa.properties.hibernate.jdbc.lob.non_contextual_creation=true

```

**Примечание:** в таком виде первые три параметра ссылаются на переменные среды. Я настоятельно рекомендую передавать конфиденциальные параметры через переменные среды или параметры запуска. Но, если вы точно уверены, что они не попадут в руки коварных злоумышленников, то можете задать их явно.

Создадим сущность (entity-класс) для объектно-реляционного отображения:

**Person.kt**

```

import javax.persistence.Column

import javax.persistence.Entity

import javax.persistence.GeneratedValue

import javax.persistence.GenerationType

import javax.persistence.Id

import javax.persistence.Table

@Entity

@Table (name="person")

data class Person(

@Id

@GeneratedValue(strategy = GenerationType.AUTO)

val id: Long,

@Column(nullable = false)

val name: String

)

```

И CRUD-репозиторий для работы с нашей таблицей:

**Repository.kt**

```

import com.kotlinspringvue.backend.jpa.Person

import org.springframework.stereotype.Repository

import org.springframework.data.repository.CrudRepository

import org.springframework.data.jpa.repository.JpaRepository

import org.springframework.data.repository.query.Param

@Repository

interface PersonRepository: CrudRepository {}

```

**Примечание:** Мы будем пользоваться методом `findAll()`, который нет необходимости переопределять, поэтому оставим тело пустым.

И, наконец, обновим наш контроллер, чтобы увидеть работу с базой данных в действии:

**BackendController.kt**

```

import com.kotlinspringvue.backend.repository.PersonRepository

import org.springframework.beans.factory.annotation.Autowired

…

@Autowired

lateinit var personRepository: PersonRepository

…

@GetMapping("/persons")

fun getPersons() = personRepository.findAll()

```

Запустим приложение, перейдём по ссылке <https://localhost:8080/api/persons>, чтобы убедиться, что всё работает:

```

[{"id":1,"name":"John"},{"id":2,"name":"Griselda"},{"id":3,"name":"Bobby"}]

```

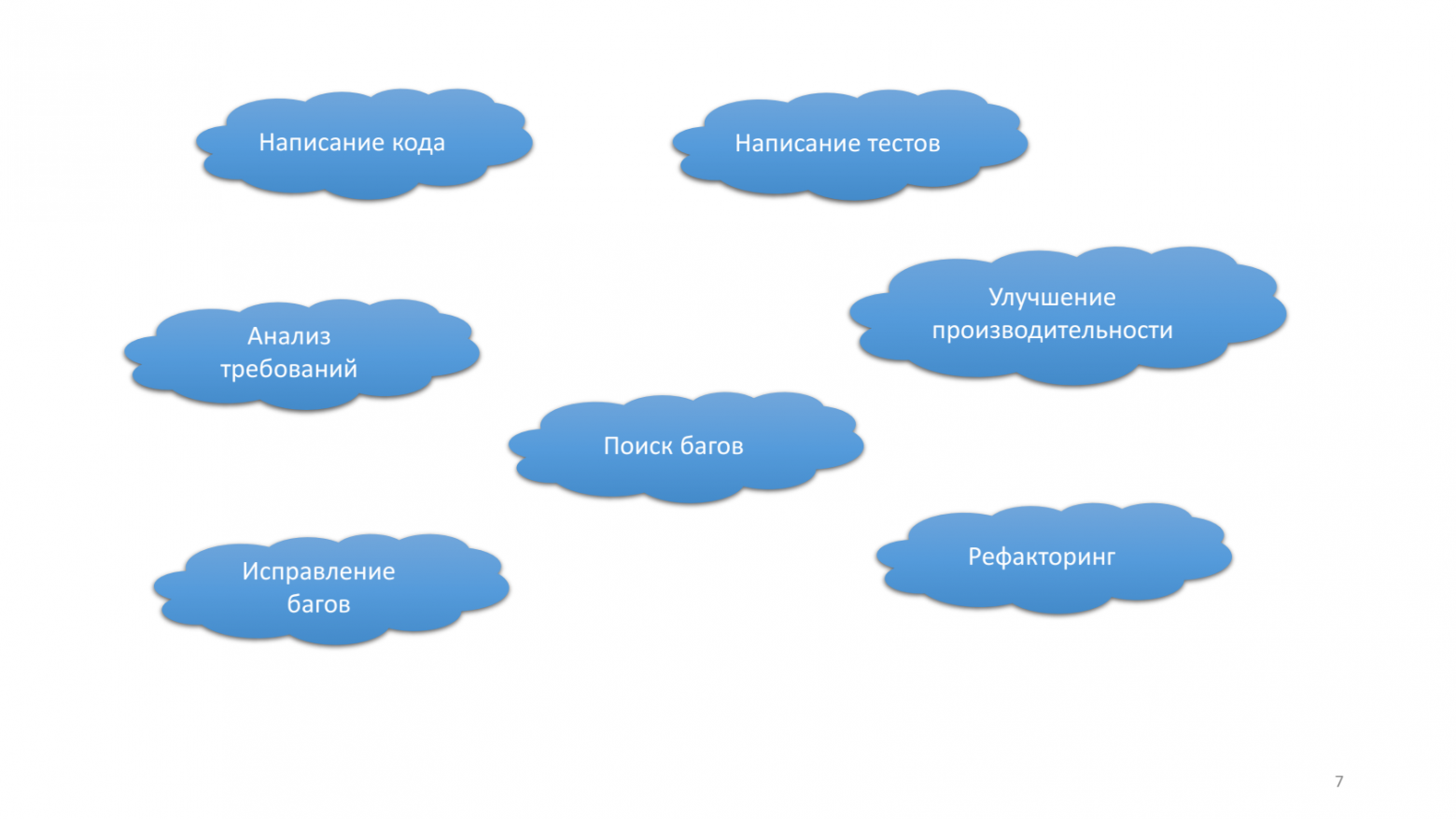

Аутентификация

--------------

Теперь мы можем перейти к аутентификации — также одной из базовых функций приложений, где предусмотрено разграничение доступа к данным.

Рассмотрим реализацию собственного сервера авторизации с использованием [JWT](https://ru.wikipedia.org/wiki/JSON_Web_Token) (JSON Web Token).

**Почему не Basic Authentication?**

* На мой взгляд, Basic Authentication не отвечает современному вызову угроз даже в относительно безопасной среде использования.

* На эту тему можно найти гораздо больше материалов.

**Почему не OAuth из ~~коробки~~ Spring Security OAuth?**

* Потому что по OAuth больше материалов.

* Такой подход может диктоваться внешними обстоятельствами: требованиями заказчика, прихотью архитектора и т.д.

* Если Вы начинающий разработчик, то в стратегической перспективе будет полезно поковыряться с функционалом безопасности более детально.

### Бэкенд

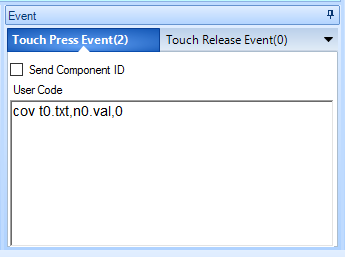

Пусть в нашем приложении помимо гостей будет две группы пользователей — рядовые пользователи и администраторы. Создадим три таблицы: *users* — для хранения данных пользователей, *roles* — для хранения информации о ролях и *users\_roles* — для связывания первых двух таблиц.

**Создадим таблицы, добавим ограничения и заполним таблицу roles**

```

CREATE TABLE public.users

(

id serial NOT NULL,

username character varying,

first_name character varying,

last_name character varying,

email character varying,

password character varying,

enabled boolean,

PRIMARY KEY (id)

);

CREATE TABLE public.roles

(

id serial NOT NULL,

name character varying,

PRIMARY KEY (id)

);

CREATE TABLE public.users_roles

(

id serial NOT NULL,

user_id integer,

role_id integer,

PRIMARY KEY (id)

);

ALTER TABLE public.users_roles

ADD CONSTRAINT users_roles_users_fk FOREIGN KEY (user_id)

REFERENCES public.users (id) MATCH SIMPLE

ON UPDATE CASCADE

ON DELETE CASCADE;

ALTER TABLE public.users_roles

ADD CONSTRAINT users_roles_roles_fk FOREIGN KEY (role_id)

REFERENCES public.roles (id) MATCH SIMPLE

ON UPDATE CASCADE

ON DELETE CASCADE;

INSERT INTO roles (name) VALUES ('ROLE_USER'), ('ROLE_ADMIN');

```

Создадим Entity-классы:

**User.kt**

```

import javax.persistence.*

@Entity

@Table(name = "users")

data class User (

@Id

@GeneratedValue(strategy = GenerationType.AUTO)

val id: Long? = 0,

@Column(name="username")

var username: String?=null,

@Column(name="first_name")

var firstName: String?=null,

@Column(name="last_name")

var lastName: String?=null,

@Column(name="email")

var email: String?=null,

@Column(name="password")

var password: String?=null,

@Column(name="enabled")

var enabled: Boolean = false,

@ManyToMany(fetch = FetchType.EAGER)

@JoinTable(

name = "users_roles",

joinColumns = [JoinColumn(name = "user_id", referencedColumnName = "id")],

inverseJoinColumns = [JoinColumn(name = "role_id", referencedColumnName = "id")]

)

var roles: Collection? = null

)

```

**Примечание:** таблицы *users* и *roles* находятся в отношении «многие-ко-многим» — у одного пользователя может быть несколько ролей (например, рядовой пользователь и администратор), и одной ролью могут быть наделены несколько пользователей.

**Информация к размышлению:** Существует подход, когда пользователей наделяют отдельными полномочиями (authorities), в то время как роль подразумевает группы полномочий. Подробнее о разнице между ролями и полномочиями можно прочитать здесь: [Granted Authority Versus Role in Spring Security](https://www.baeldung.com/spring-security-granted-authority-vs-role).

**Role.kt**

```

import javax.persistence.*

@Entity

@Table(name = "roles")

data class Role (

@Id

@GeneratedValue(strategy = GenerationType.AUTO)

val id: Long,

@Column(name="name")

val name: String

)

```

Создадим репозитории для работы с таблицами:

**UsersRepository.kt**

```

import java.util.Optional

import com.kotlinspringvue.backend.jpa.User

import org.springframework.data.repository.CrudRepository

import org.springframework.data.repository.query.Param

import org.springframework.data.jpa.repository.JpaRepository

import javax.transaction.Transactional

interface UserRepository: JpaRepository {

fun existsByUsername(@Param("username") username: String): Boolean

fun findByUsername(@Param("username") username: String): Optional

fun findByEmail(@Param("email") email: String): Optional

@Transactional

fun deleteByUsername(@Param("username") username: String)

}

```

**RolesRepository.kt**

```

import com.kotlinspringvue.backend.jpa.Role

import org.springframework.data.repository.CrudRepository

import org.springframework.data.repository.query.Param

import org.springframework.data.jpa.repository.JpaRepository

interface RoleRepository : JpaRepository {

fun findByName(@Param("name") name: String): Role

}

```

Добавим новые зависимости в

**pom.xml модуля бэкенда**

```

org.springframework.boot

spring-boot-starter-security

com.fasterxml.jackson.module

jackson-module-kotlin

io.jsonwebtoken

jjwt

0.9.0

io.jsonwebtoken

jjwt-api

0.10.6

```

И добавим новые параметры для работы с токенами в *application.properties*:

```

assm.app.jwtSecret=jwtAssmSecretKey

assm.app.jwtExpiration=86400

```

Теперь создадим классы для хранения данных, приходящих с форм авторизации и регистрации:

**LoginUser.kt**

```

class LoginUser : Serializable {

@JsonProperty("username")

var username: String? = null

@JsonProperty("password")

var password: String? = null

constructor() {}

constructor(username: String, password: String) {

this.username = username

this.password = password

}

companion object {

private const val serialVersionUID = -1764970284520387975L

}

}

```

**NewUser.kt**

```

import com.fasterxml.jackson.annotation.JsonProperty

import java.io.Serializable

class NewUser : Serializable {

@JsonProperty("username")

var username: String? = null

@JsonProperty("firstName")

var firstName: String? = null

@JsonProperty("lastName")

var lastName: String? = null

@JsonProperty("email")

var email: String? = null

@JsonProperty("password")

var password: String? = null

constructor() {}

constructor(username: String, firstName: String, lastName: String, email: String, password: String, recaptchaToken: String) {

this.username = username

this.firstName = firstName

this.lastName = lastName

this.email = email

this.password = password

}

companion object {

private const val serialVersionUID = -1764970284520387975L

}

}

```

Сделаем специальные классы для ответов сервера — возвращающий токен аутентификации и универсальный (строка):

**JwtResponse.kt**

```

import org.springframework.security.core.GrantedAuthority

class JwtResponse(var accessToken: String?, var username: String?, val authorities:

Collection) {

var type = "Bearer"

}

```

**ResponseMessage.kt**

```

class ResponseMessage(var message: String?)

```

Также нам понадобится исключение «User Already Exists»

**UserAlreadyExistException.kt**

```

class UserAlreadyExistException : RuntimeException {

constructor() : super() {}

constructor(message: String, cause: Throwable) : super(message, cause) {}

constructor(message: String) : super(message) {}

constructor(cause: Throwable) : super(cause) {}

companion object {

private val serialVersionUID = 5861310537366287163L

}

}

```

Для определения ролей пользователей нам необходим дополнительный сервис, реализующий интерфейс *UserDetailsService*:

**UserDetailsServiceImpl.kt**

```

import com.kotlinspringvue.backend.repository.UserRepository

import org.springframework.beans.factory.annotation.Autowired

import org.springframework.security.core.userdetails.UserDetails

import org.springframework.security.core.userdetails.UserDetailsService

import org.springframework.security.core.userdetails.UsernameNotFoundException

import org.springframework.stereotype.Service

import org.springframework.security.core.GrantedAuthority

import org.springframework.security.core.authority.SimpleGrantedAuthority

import java.util.stream.Collectors

@Service

class UserDetailsServiceImpl: UserDetailsService {

@Autowired

lateinit var userRepository: UserRepository

@Throws(UsernameNotFoundException::class)

override fun loadUserByUsername(username: String): UserDetails {

val user = userRepository.findByUsername(username).get()

?: throw UsernameNotFoundException("User '$username' not found")

val authorities: List = user.roles!!.stream().map({ role -> SimpleGrantedAuthority(role.name)}).collect(Collectors.toList())

return org.springframework.security.core.userdetails.User

.withUsername(username)

.password(user.password)

.authorities(authorities)

.accountExpired(false)

.accountLocked(false)

.credentialsExpired(false)

.disabled(false)

.build()

}

}

```

Для работы с JWT нам потребуются три класса:

**JwtAuthEntryPoint** — для обработки ошибок авторизации и дальнейшего использования в настройках веб-безопасности:

**JwtAuthEntryPoint.kt**

```

import javax.servlet.ServletException

import javax.servlet.http.HttpServletRequest

import javax.servlet.http.HttpServletResponse

import org.slf4j.Logger

import org.slf4j.LoggerFactory

import org.springframework.security.core.AuthenticationException

import org.springframework.security.web.AuthenticationEntryPoint

import org.springframework.stereotype.Component

@Component

class JwtAuthEntryPoint : AuthenticationEntryPoint {

@Throws(IOException::class, ServletException::class)

override fun commence(request: HttpServletRequest,

response: HttpServletResponse,

e: AuthenticationException) {

logger.error("Unauthorized error. Message - {}", e!!.message)

response.sendError(HttpServletResponse.SC_UNAUTHORIZED, "Invalid credentials")

}

companion object {

private val logger = LoggerFactory.getLogger(JwtAuthEntryPoint::class.java)

}

}

```

**JwtProvider** — чтобы генерировать и валидировать токены, а также определять пользователя по его токену:

**JwtProvider.kt**

```

import io.jsonwebtoken.*

import org.springframework.beans.factory.annotation.Autowired

import org.slf4j.Logger

import org.slf4j.LoggerFactory

import org.springframework.beans.factory.annotation.Value

import org.springframework.security.core.Authentication

import org.springframework.stereotype.Component

import org.springframework.security.core.GrantedAuthority

import org.springframework.security.core.authority.SimpleGrantedAuthority

import com.kotlinspringvue.backend.repository.UserRepository

import java.util.Date

@Component

public class JwtProvider {

private val logger: Logger = LoggerFactory.getLogger(JwtProvider::class.java)

@Autowired

lateinit var userRepository: UserRepository

@Value("\${assm.app.jwtSecret}")

lateinit var jwtSecret: String

@Value("\${assm.app.jwtExpiration}")

var jwtExpiration:Int?=0

fun generateJwtToken(username: String): String {

return Jwts.builder()

.setSubject(username)

.setIssuedAt(Date())

.setExpiration(Date((Date()).getTime() + jwtExpiration!! * 1000))

.signWith(SignatureAlgorithm.HS512, jwtSecret)

.compact()

}

fun validateJwtToken(authToken: String): Boolean {

try {

Jwts.parser().setSigningKey(jwtSecret).parseClaimsJws(authToken)

return true

} catch (e: SignatureException) {

logger.error("Invalid JWT signature -> Message: {} ", e)

} catch (e: MalformedJwtException) {

logger.error("Invalid JWT token -> Message: {}", e)

} catch (e: ExpiredJwtException) {

logger.error("Expired JWT token -> Message: {}", e)

} catch (e: UnsupportedJwtException) {

logger.error("Unsupported JWT token -> Message: {}", e)

} catch (e: IllegalArgumentException) {

logger.error("JWT claims string is empty -> Message: {}", e)

}

return false

}

fun getUserNameFromJwtToken(token: String): String {

return Jwts.parser()

.setSigningKey(jwtSecret)

.parseClaimsJws(token)

.getBody().getSubject()

}

}

```

**JwtAuthTokenFilter** — чтобы аутентифицировать пользователей и фильтровать запросы:

**JwtAuthTokenFilter.kt**

```

import java.io.IOException

import javax.servlet.FilterChain

import javax.servlet.ServletException

import javax.servlet.http.HttpServletRequest

import javax.servlet.http.HttpServletResponse

import org.slf4j.LoggerFactory

import org.springframework.beans.factory.annotation.Autowired

import org.springframework.security.authentication.UsernamePasswordAuthenticationToken

import org.springframework.security.core.context.SecurityContextHolder

import org.springframework.security.core.userdetails.UserDetails

import org.springframework.security.web.authentication.WebAuthenticationDetailsSource

import org.springframework.web.filter.OncePerRequestFilter

import com.kotlinspringvue.backend.service.UserDetailsServiceImpl

class JwtAuthTokenFilter : OncePerRequestFilter() {

@Autowired

private val tokenProvider: JwtProvider? = null

@Autowired

private val userDetailsService: UserDetailsServiceImpl? = null

@Throws(ServletException::class, IOException::class)

override fun doFilterInternal(request: HttpServletRequest, response: HttpServletResponse, filterChain: FilterChain) {

try {

val jwt = getJwt(request)

if (jwt != null && tokenProvider!!.validateJwtToken(jwt)) {

val username = tokenProvider.getUserNameFromJwtToken(jwt)

val userDetails = userDetailsService!!.loadUserByUsername(username)

val authentication = UsernamePasswordAuthenticationToken(

userDetails, null, userDetails.getAuthorities())

authentication.setDetails(WebAuthenticationDetailsSource().buildDetails(request))

SecurityContextHolder.getContext().setAuthentication(authentication)

}

} catch (e: Exception) {

logger.error("Can NOT set user authentication -> Message: {}", e)

}

filterChain.doFilter(request, response)

}

private fun getJwt(request: HttpServletRequest): String? {

val authHeader = request.getHeader("Authorization")

return if (authHeader != null && authHeader.startsWith("Bearer ")) {

authHeader.replace("Bearer ", "")

} else null

}

companion object {

private val logger = LoggerFactory.getLogger(JwtAuthTokenFilter::class.java)

}

}

```

Теперь мы можем сконфигурировать бин, ответственный за веб-безопасность:

**WebSecurityConfig.kt**

```

import org.springframework.context.annotation.Bean

import org.springframework.context.annotation.Configuration

import org.springframework.beans.factory.annotation.Autowired

import org.springframework.security.web.authentication.UsernamePasswordAuthenticationFilter

import org.springframework.security.config.http.SessionCreationPolicy

import org.springframework.security.authentication.AuthenticationManager

import org.springframework.security.config.annotation.authentication.builders.AuthenticationManagerBuilder

import org.springframework.security.config.annotation.web.configuration.EnableWebSecurity

import org.springframework.security.config.annotation.method.configuration.EnableGlobalMethodSecurity

import org.springframework.security.config.annotation.web.builders.HttpSecurity

import org.springframework.security.config.annotation.web.configuration.WebSecurityConfigurerAdapter

import org.springframework.security.crypto.bcrypt.BCryptPasswordEncoder

import com.kotlinspringvue.backend.jwt.JwtAuthEntryPoint

import com.kotlinspringvue.backend.jwt.JwtAuthTokenFilter

import com.kotlinspringvue.backend.service.UserDetailsServiceImpl

@Configuration

@EnableWebSecurity

@EnableGlobalMethodSecurity(prePostEnabled = true)

class WebSecurityConfig : WebSecurityConfigurerAdapter() {

@Autowired

internal var userDetailsService: UserDetailsServiceImpl? = null

@Autowired

private val unauthorizedHandler: JwtAuthEntryPoint? = null

@Bean

fun bCryptPasswordEncoder(): BCryptPasswordEncoder {

return BCryptPasswordEncoder()

}

@Bean

fun authenticationJwtTokenFilter(): JwtAuthTokenFilter {

return JwtAuthTokenFilter()

}

@Throws(Exception::class)

override fun configure(authenticationManagerBuilder: AuthenticationManagerBuilder) {

authenticationManagerBuilder

.userDetailsService(userDetailsService)

.passwordEncoder(bCryptPasswordEncoder())

}

@Bean

@Throws(Exception::class)

override fun authenticationManagerBean(): AuthenticationManager {

return super.authenticationManagerBean()

}

@Throws(Exception::class)

override protected fun configure(http: HttpSecurity) {

http.csrf().disable().authorizeRequests()

.antMatchers("/**").permitAll()

.anyRequest().authenticated()

.and()

.exceptionHandling().authenticationEntryPoint(unauthorizedHandler).and()

.sessionManagement().sessionCreationPolicy(SessionCreationPolicy.STATELESS)

http.addFilterBefore(authenticationJwtTokenFilter(), UsernamePasswordAuthenticationFilter::class.java)

}

}

```

Создадим контроллер для регистрации и авторизации:

**AuthController.kt**

```

import javax.validation.Valid

import java.util.*

import java.util.stream.Collectors

import org.springframework.security.core.Authentication

import org.springframework.beans.factory.annotation.Autowired