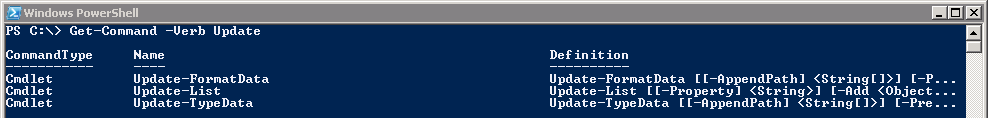

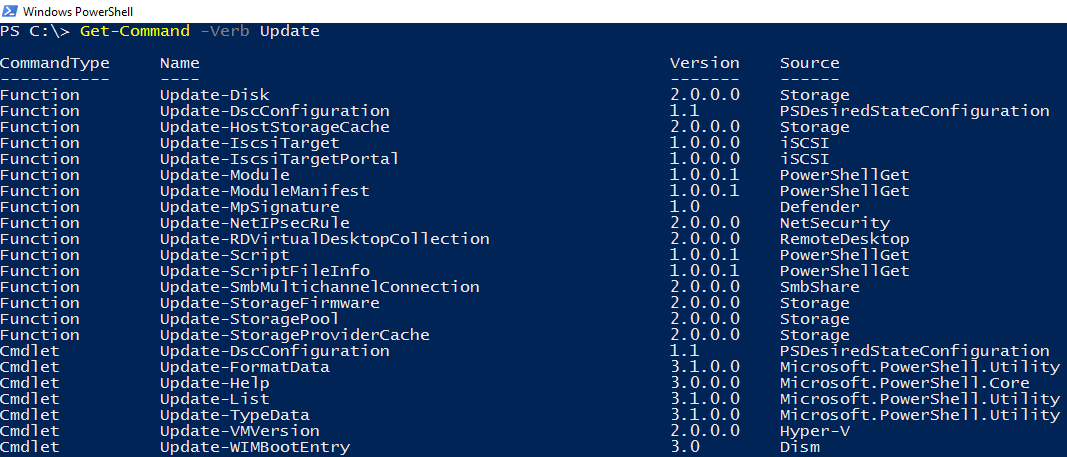

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4 values | source stringclasses 4 values |

|---|---|---|---|---|

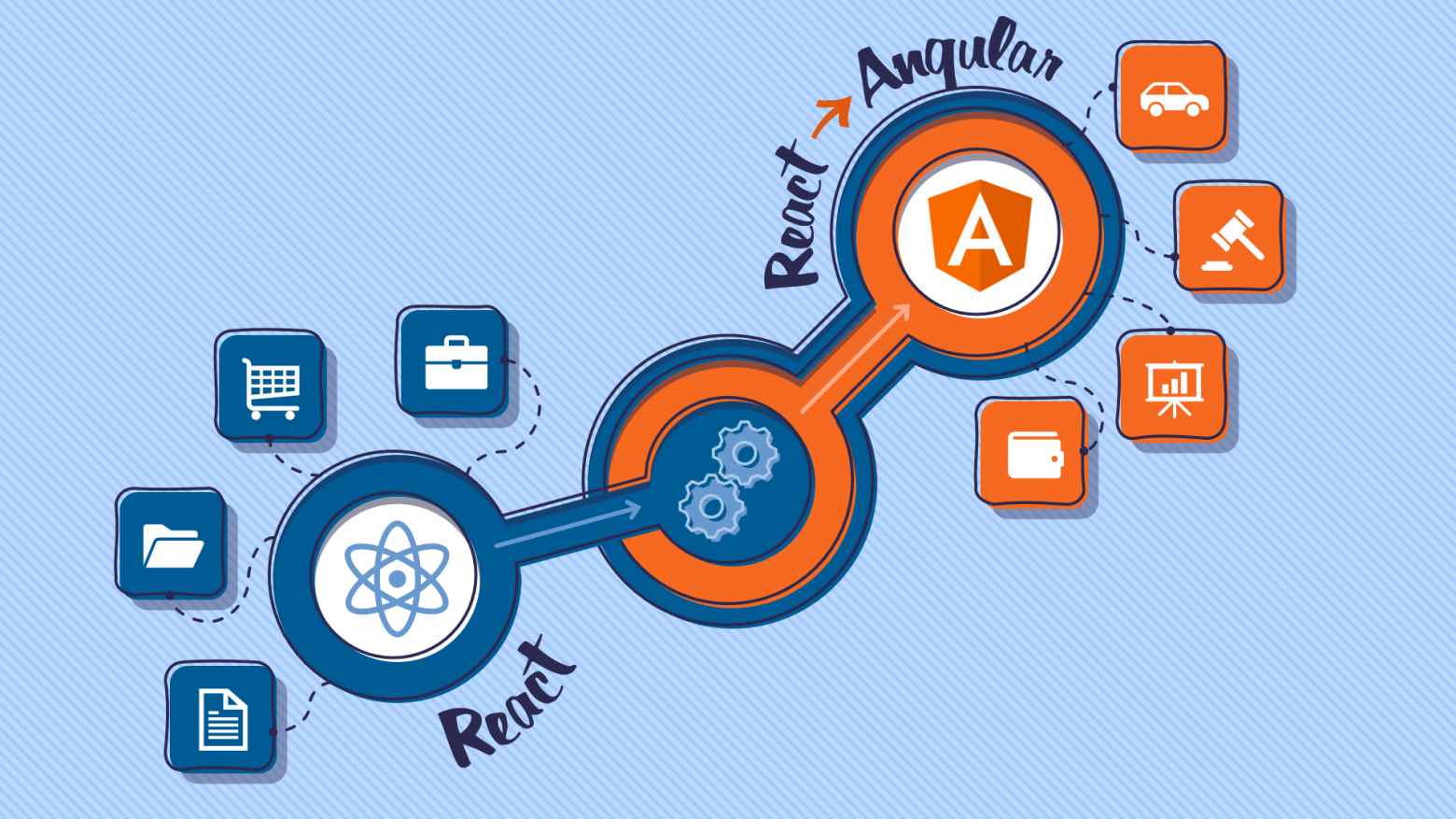

# Построение библиотек компонентов и их организация. Или как извлечь максимальную пользу для бизнеса c React и Angular

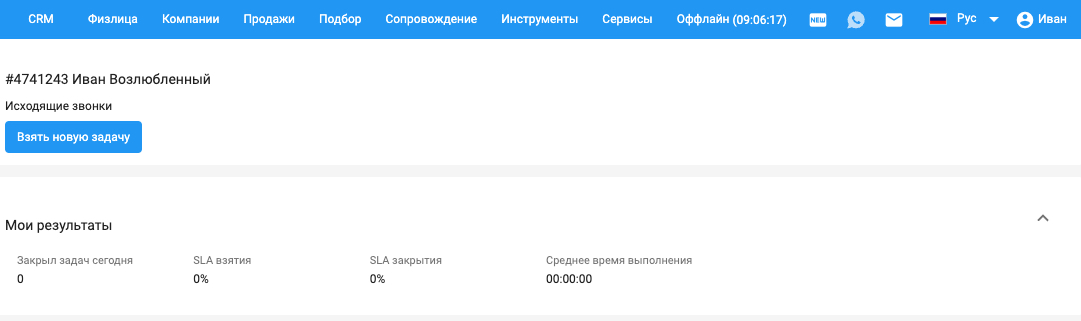

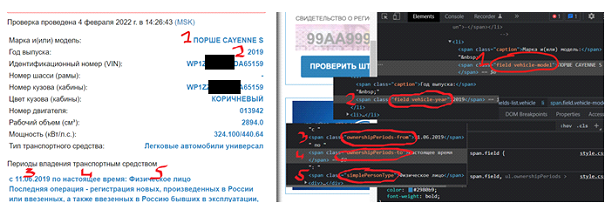

Наша компания разрабатывает десятки продуктов. Ряд продуктов работает на Angular, ряд на React. Пользователи систем в зависимости от этапа бизнес-процесса и роли взаимодействует с определенным приложением. Часто, в рамках бизнеса мы должны показывать одни и те же данные в разных местах. Эти данные отображаются в виде UI компонентов.

В этой статье мы узнаем как можно организовать библиотеки компонентов для решения задач бизнеса. Научимся переиспользовать и запускать React компоненты внутри Angular. Таким способом мы сможем решать задачи бизнеса гибко и эффективно.

Допустим у нас есть 10 приложений. 3 на React, 7 на Angular. Мы выводим на экран информацию о пользователе в красивом компоненте:

* ФИО

* Контактный телефон

* Почта

* Число сделок

* Список меток (новый пользователь, частый клиент)

Через месяц приходит бизнес и ставит задачу добавить еще 1 поле в компонент.

**Первый сценарий развития (да, такое бывает - дикий запад)**

Команды разрознены. Каждая из них разрабатывает свое приложение и держит компоненты прямо в проекте. Что происходит при доработках:

* Заходим в каждый проект в отдельности и дорабатываем компоненты

Получается достаточно накладно по времени. Совершить одни и те же действия N раз.

**Второй сценарий развития (частый сценарий)**

Деление на React и Angular пакетную базу. Это более позитивный сценарий. В этом случае есть некий UIKit для двух фронтенд инструментов. Работа будет сводиться к следующим действиям:

* Дорабатываем компонент на React

* Публикуем React пакет

* Обновляем зависимость в React приложениях

* Дорабатываем компонент на Angular

* Публикуем пакет на Angular

* Обновляем зависимость в Anguar приложениях

Действий уже меньше, но приходится делать 2 реализации одного компонента, плюс поддержка разных репозиториев.

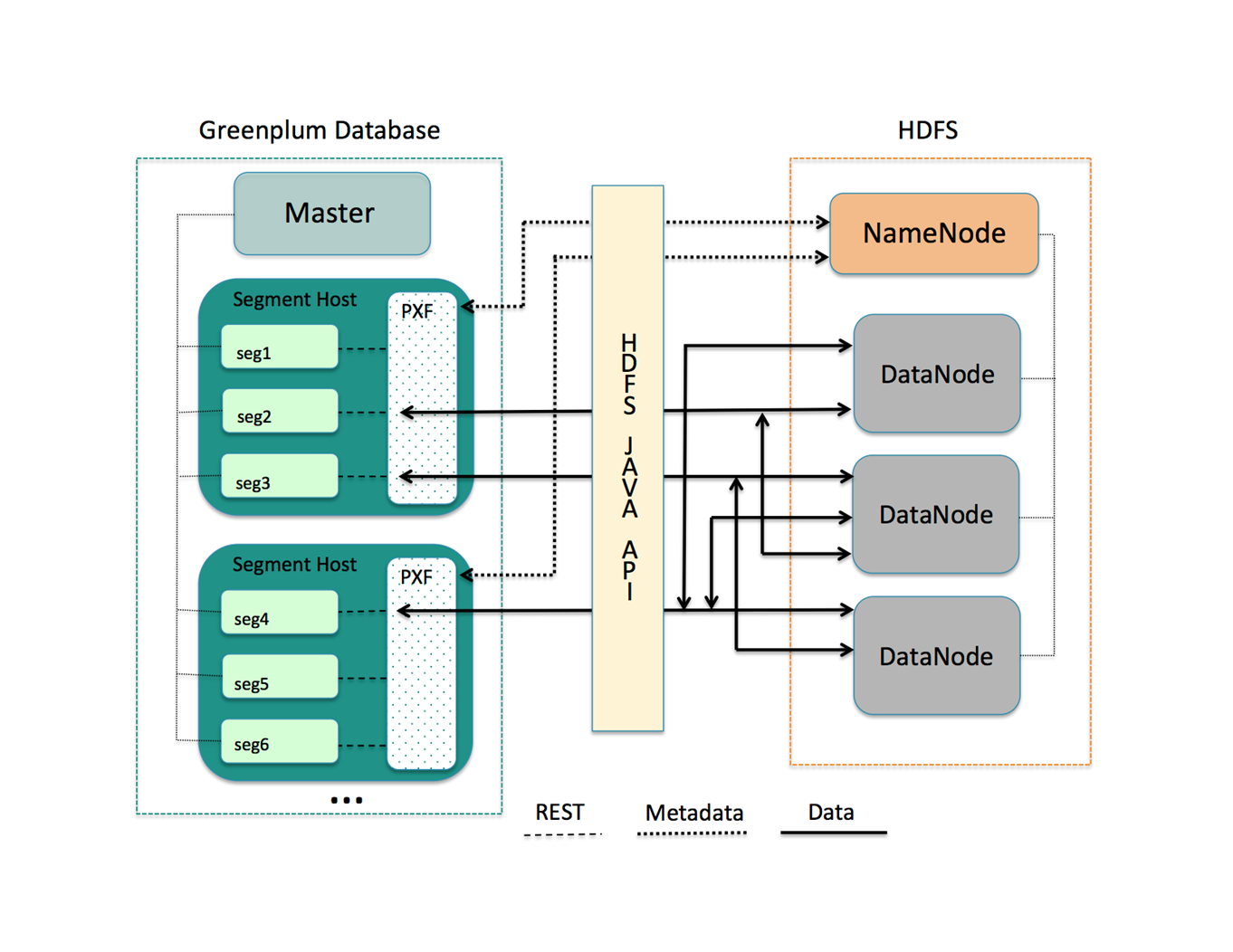

**Третий подход о котором я расскажу: основной пакет - много приложений**

Его подход заключается в следующем:

* Пишем компонент на React

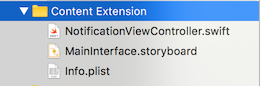

* Добавляем Angular прослойку для React компонента (прокидываем props через Input декораторы) - проект library.

* Одной командой публикуем 2 пакета

* Обновляем приложения

В этом случае мы получаем только одно место, которое нам нужно доработать под бизнес требования, и если это потребуется добавить проброс данных в Angular обертку.

**Код компонента Angular использующий React:**

> *При использовании сторонних библиотек, как в этом подходе, важно запускать их через* ***runOutsideAngular****, чтобы сократить число вызовов обнаружения изменений при работе с React компонентом.*

>

>

```

import { AfterViewInit, Component, Input, NgZone, OnChanges, OnInit } from '@angular/core';

import * as React from 'react';

import * as ReactDOM from 'react-dom';

import Avatar, { ReactAvatarProps } from 'react-avatar';

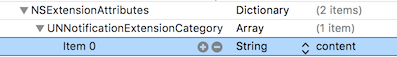

@Component({

selector: 'app-ng-avatar',

templateUrl: './ng-avatar.component.html'

})

export class NgAvatarComponent implements OnChanges, AfterViewInit {

containerId: string = 'avatar-xxxxxxxx'.replace(/[x]/g, c => (Math.random() * 16 | 0).toString(16));

@Input()

name: string = '';

@Input()

round: string = '';

@Input()

color?: string = undefined;

constructor(private _ngZone: NgZone) { }

ngOnInit() {

}

ngAfterViewInit() {

this.render();

}

ngOnChanges() {

this.render();

}

render = () => {

const props: ReactAvatarProps = {

name: this.name,

round: this.round,

color: this.color

};

if (document.getElementById(this.containerId)) {

this._ngZone.runOutsideAngular(

() => {

ReactDOM.render(React.createElement(Avatar, props),

document.getElementById(this.containerId)

);

}

);

}

}

}

```

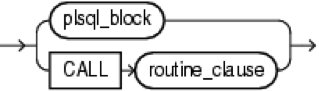

**Результат работы:**

react-avatar in angular**Плюсы для бизнеса**

* Более быстрое получение UI фичи

* Меньше времени на синхронизацию команд

* Единый стиль в продуктах

**Плюсы для команд**

* Экспертиза в разных инструментах

Заключение

----------

Теперь у вас есть один из интересных подходов в организации библиотек. Такой вариант организации прекрасно подходит компаниям, которые знают, что их продукты работают и развиваются в долгосрочной перспективе.

[Ссылка на Githib с примером](https://github.com/EuroplanOfficial/ngreactcomponent/blob/main/projects/ngreactcomponentlib/src/lib/ng-avatar.component.ts)

[Ссылка на статью - создание библиотеки компонентов на примере иконок](https://ashatilovdev.medium.com/55-angular-uikit-%D1%81%D0%B4%D0%B5%D0%BB%D0%B0%D0%B9-%D0%B1%D0%B8%D0%B1%D0%BB%D0%B8%D0%BE%D1%82%D0%B5%D0%BA%D1%83-%D0%B8%D0%BA%D0%BE%D0%BD%D0%BE%D0%BA-%D0%BF%D1%80%D0%B0%D0%B2%D0%B8%D0%BB%D1%8C%D0%BD%D0%BE-829171691ceb) | https://habr.com/ru/post/563464/ | null | ru | null |

# Rust 1.66.0: дискриминанты для перечислений с полями, black_box, cargo remove

Команда Rust рада сообщить о новой версии языка — 1.66.0. Rust — это язык программирования, позволяющий каждому создавать надёжное и эффективное программное обеспечение.

Если у вас есть предыдущая версия Rust, установленная через `rustup`, то для обновления до версии 1.66.0 вам достаточно выполнить команду:

```

rustup update stable

```

Если у вас ещё нет `rustup`, то можете установить его со [страницы](https://www.rust-lang.org/install.html) на нашем веб-сайте, а также ознакомиться с [подробным описанием выпуска 1.66.0](https://github.com/rust-lang/rust/blob/stable/RELEASES.md#version-1660-2022-12-15) на GitHub.

Если вы хотите помочь нам протестировать будущие выпуски, вы можете использовать beta (`rustup default beta`) или nightly (`rustup default nightly`) канал. Пожалуйста, [сообщайте](https://github.com/rust-lang/rust/issues/new/choose) обо всех встреченных вами ошибках.

Что стабилизировано в 1.66.0

----------------------------

### Явные дискриминанты для перечислений с полями

Перечисления с числовым представлением теперь могут использовать явный дискриминант, даже если они имеют поля.

```

#[repr(u8)]

enum Foo {

A(u8),

B(i8),

C(bool) = 42,

}

```

Ранее вы могли использовать явные дискриминанты в перечислениях, но только если ни один из вариантов не содержал поля. Явные дискриминанты полезны при передаче значения между разными языками и если значение перечисления нужно определить в обоих языках. Например:

```

#[repr(u8)]

enum Bar {

A,

B,

C = 42,

D,

}

```

Здесь перечисление `Bar` гарантированно будет иметь то же представление в памяти, что и `u8`. Кроме того, у варианта `Bar::C` гарантированно есть дискриминант 42. Варианты без явно указанных значений будут иметь дискриминанты, которые автоматически назначаются в соответствии с их порядком в исходном коде, поэтому у `Bar::A` будет дискриминант 0, у `Bar::B` будет 1, а у `Bar::D` будет 43. Без этой функции единственным способом установить явное значение `Bar::C` было бы добавить 41 ненужный вариант перед ним!

Примечание: в то время как для перечислений без полей можно проверить дискриминант через приведение `as` (например, `Bar::C as u8`), Rust не предоставляет способа на уровне языка для доступа к необработанному дискриминанту перечисления с полями. Вместо этого для проверки дискриминанта перечисления с полями необходимо использовать небезопасный в настоящее время код. Поскольку эта функция предназначена для использования с межъязыковым FFI, где уже необходим небезопасный код, мы надеемся, что это не станет слишком большой дополнительной нагрузкой. Пока же если всё, что вам нужно, — это непрозрачный дескриптор дискриминанта, см. функцию `std::mem::discriminant`.

### `core::hint::black_box`

Когда исследуется или оценивается машинный код, сгенерированный компилятором, бывает полезно отключить оптимизацию для определённых мест. В следующем примере функция `push_cap` 4 раза вызывает в цикле `Vec::push`:

```

fn push_cap(v: &mut Vec) {

for i in 0..4 {

v.push(i);

}

}

pub fn bench\_push() -> Duration {

let mut v = Vec::with\_capacity(4);

let now = Instant::now();

push\_cap(&mut v);

now.elapsed()

}

```

Если вы посмотрите оптимизированный вывод компилятора для x86\_64, то заметите, что он выглядит достаточно коротко:

```

example::bench_push:

sub rsp, 24

call qword ptr [rip + std::time::Instant::now@GOTPCREL]

lea rdi, [rsp + 8]

mov qword ptr [rsp + 8], rax

mov dword ptr [rsp + 16], edx

call qword ptr [rip + std::time::Instant::elapsed@GOTPCREL]

add rsp, 24

ret

```

Фактически вся функция `push_cap`, которую мы хотели оценить, была оптимизирована!

Мы можем обойти это при помощи новой стабилизированной функции `black_box`. Функционально `black_box` не очень интересна: она лишь берёт значение, которое вы ей передали, и возвращает его обратно. Однако внутри компилятор обрабатывает `black_box` как функцию, которая что-то делает с передаваемым ей вводом и возвращает какое-то значение (как и следует из её названия).

Это очень полезно для отключение оптимизаций — как той, что мы видели выше. Например, мы можем подсказать компилятору, что вектор будет использоваться для чего-то после каждой итерации цикла.

```

use std::hint::black_box;

fn push_cap(v: &mut Vec) {

for i in 0..4 {

v.push(i);

black\_box(v.as\_ptr());

}

}

```

Теперь мы можем найти развёрнутый цикл for в нашем [оптимизированном ассемблерном выводе](https://rust.godbolt.org/z/Ws1GGbY6Y):

```

mov dword ptr [rbx], 0

mov qword ptr [rsp + 8], rbx

mov dword ptr [rbx + 4], 1

mov qword ptr [rsp + 8], rbx

mov dword ptr [rbx + 8], 2

mov qword ptr [rsp + 8], rbx

mov dword ptr [rbx + 12], 3

mov qword ptr [rsp + 8], rbx

```

Вы также можете увидеть побочный эффект вызова `black_box` в этом ассемблерном выводе. Инструкция `mov qword ptr [rsp + 8], rbx` бесполезно повторяется после каждой итерации. Эта инструкция записывает адрес `v.as_ptr()` в качестве первого аргумента функции, которая фактически никогда не вызывается.

Обратите внимание, что сгенерированный код вообще не связан с возможностью распределения памяти, введённого вызовом `push`. Это потому, что компилятор всё ещё опирается на тот факт, что мы вызвали `Vec::with_capacity(4)` в функции `bench_push`. Вы можете поиграть с размещением `black_box` или попробовать использовать его в нескольких местах, чтобы увидеть его влияние на оптимизацию компилятора.

### cargo remove

Rust 1.62.0 представил `cargo add` — утилиту командной строки для добавления зависимостей в ваш проект. В этой же версии вы сможете использовать `cargo remove` для их удаления.

### Стабилизированные API

* [`proc_macro::Span::source_text`](https://doc.rust-lang.org/stable/proc_macro/struct.Span.html#method.source_text)

* [`u*::{checked_add_signed, overflowing_add_signed, saturating_add_signed, wrapping_add_signed}`](https://doc.rust-lang.org/stable/std/primitive.u8.html#method.checked_add_signed)

* [`i*::{checked_add_unsigned, overflowing_add_unsigned, saturating_add_unsigned, wrapping_add_unsigned}`](https://doc.rust-lang.org/stable/std/primitive.i8.html#method.checked_add_unsigned)

* [`i*::{checked_sub_unsigned, overflowing_sub_unsigned, saturating_sub_unsigned, wrapping_sub_unsigned}`](https://doc.rust-lang.org/stable/std/primitive.i8.html#method.checked_sub_unsigned)

* [`BTreeSet::{first, last, pop_first, pop_last}`](https://doc.rust-lang.org/stable/std/collections/struct.BTreeSet.html#method.first)

* [`BTreeMap::{first_key_value, last_key_value, first_entry, last_entry, pop_first, pop_last}`](https://doc.rust-lang.org/stable/std/collections/struct.BTreeMap.html#method.first_key_value)

* [`Добавлена реализация AsFd` для типов блокировок стандартных потоков для WASI](https://github.com/rust-lang/rust/pull/101768/)

* [`impl TryFrom> for Box<[T; N]>`](https://doc.rust-lang.org/stable/std/boxed/struct.Box.html#impl-TryFrom%3CVec%3CT%2C%20Global%3E%3E-for-Box%3C%5BT%3B%20N%5D%2C%20Global%3E)

* [`core::hint::black_box`](https://doc.rust-lang.org/stable/std/hint/fn.black_box.html)

* [`Duration::try_from_secs_{f32,f64}`](https://doc.rust-lang.org/stable/std/time/struct.Duration.html#method.try_from_secs_f32)

* [`Option::unzip`](https://doc.rust-lang.org/stable/std/option/enum.Option.html#method.unzip)

* [`std::os::fd`](https://doc.rust-lang.org/stable/std/os/fd/index.html)

### Прочие изменения

Выпуск Rust 1.66 включает и другие изменения:

* Теперь вы можете использовать в шаблонах диапазоны `..=X`.

* Linux-сборки теперь используют оптимизированные rustc фронтенд и LLVM бэкенд с LTO и BOLT соответственно, что оптимизирует быстродействие и использование памяти.

Проверьте всё, что изменилось в [Rust](https://github.com/rust-lang/rust/blob/stable/RELEASES.md#version-1660-2022-12-15), [Cargo](https://github.com/rust-lang/cargo/blob/master/CHANGELOG.md#cargo-166-2022-12-15) и [Clippy](https://github.com/rust-lang/rust-clippy/blob/master/CHANGELOG.md#rust-166).

### Участники 1.66.0

Многие люди собрались вместе, чтобы создать Rust 1.66.0. Без вас мы бы не справились. [Спасибо!](https://thanks.rust-lang.org/rust/1.66.0/)

От переводчиков

---------------

С любыми вопросами по языку Rust вам смогут помочь в [русскоязычном Телеграм-чате](https://t.me/rustlang_ru) или же в аналогичном [чате для новичковых вопросов](https://t.me/rust_beginners_ru). Если у вас есть вопросы по переводам или хотите помогать с ними, то обращайтесь в [чат переводчиков](https://t.me/rustlang_ru_translations).

Данную статью совместными усилиями перевели [andreevlex](https://habr.com/ru/users/andreevlex/), [TelegaOvoshey](https://habr.com/ru/users/telegaovoshey/) и [funkill](https://habr.com/ru/users/funkill/). | https://habr.com/ru/post/706176/ | null | ru | null |

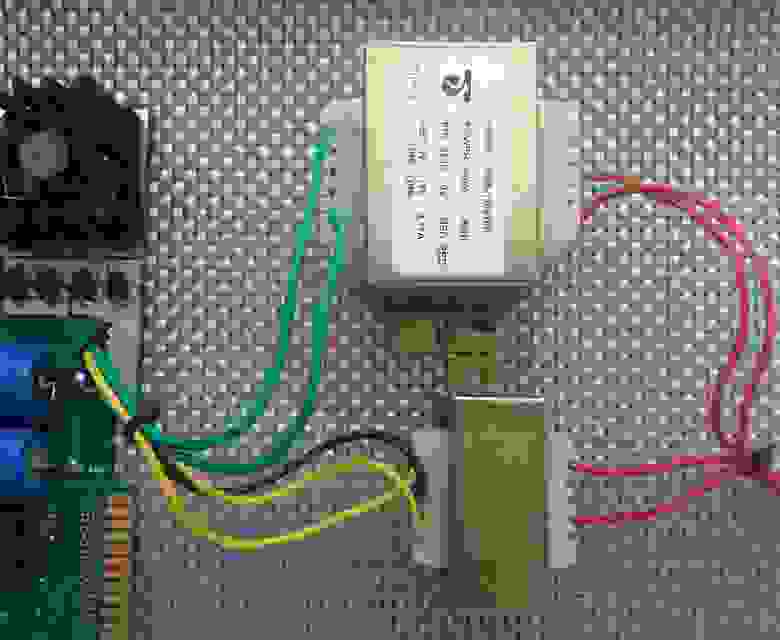

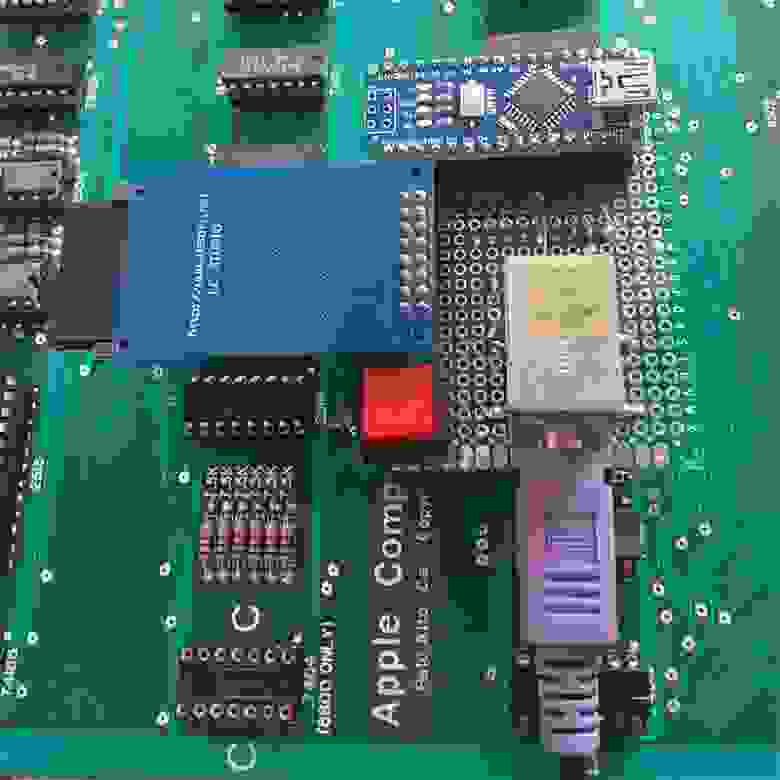

# Меньше, еще меньше! Делаем вольт-ампер-ватт метр на Attiny85

Ну вот наконец добрался до Attiny85, все хотел чего-нибудь сделать на них. А тут коллеги решили с гальваническими покрытиями поиграться. Путем нехитрых доработок блок питания для светодиодных дисплеев на 5В 60А стал регулируемым. А вот контролировать такие токи нечем. Шунт на 75мВ при 50А в местных магазинах мы нашли, а вот головку к нему нет, а стоять считать чего там милливольты показывают на мультиметре- такое себе.

Ну вот такой проект на один вечер.

ATTINY85

--------

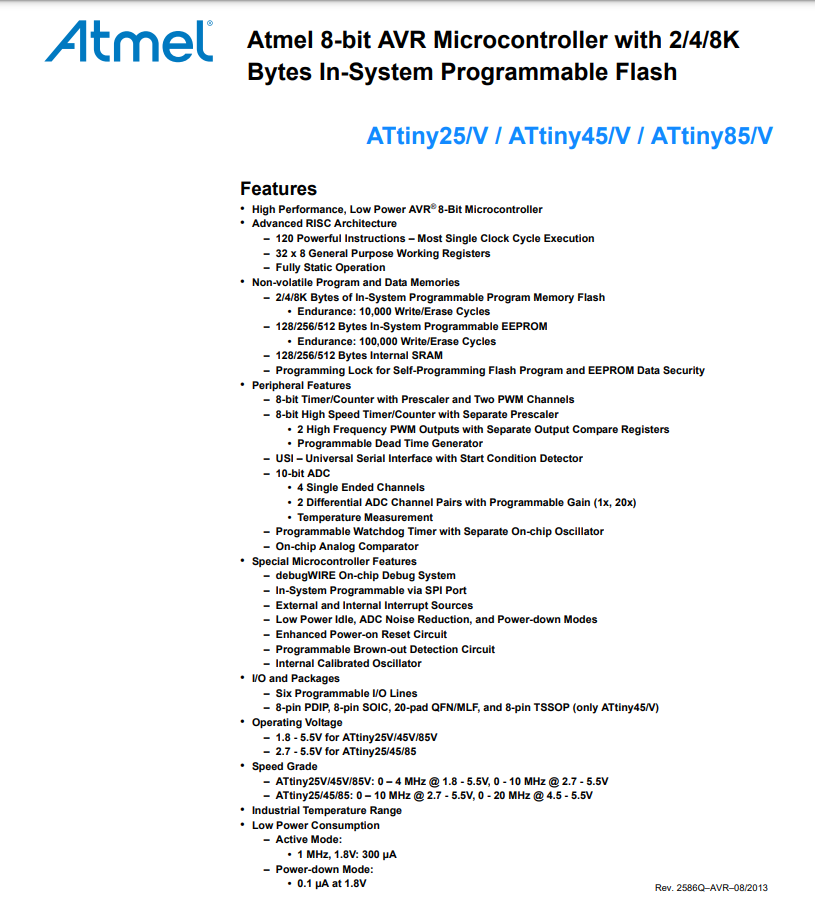

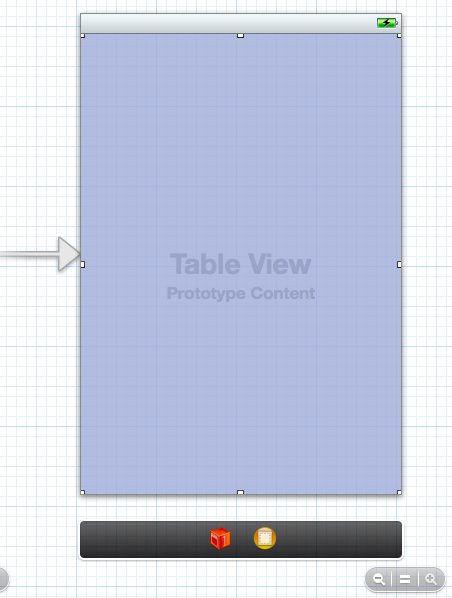

Attiny85 является старшим контроллером из 8 ногой серии МК аттини. От своих собратьев Attiny25 и 45- отличается объемом памяти. У 25- 2кБ, у 45- 4кБ, у нашей 85 соответственно целых 8кБ памяти, та же история и с EEPROM и SRAM. Да что я рассказываю, смотрите сами:

В общем отличный представитель класса компактных 8 битных МК. Пригодится там где не нужны большая производительность и обилие портов.

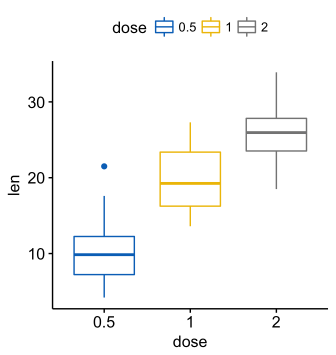

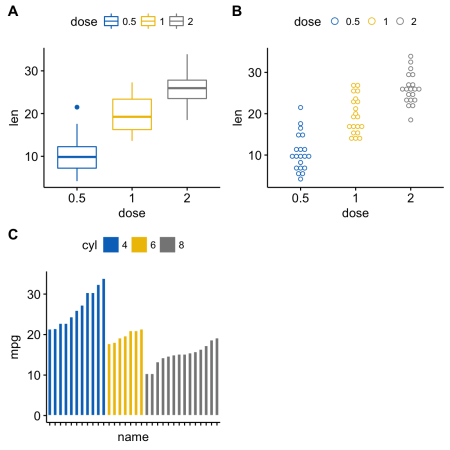

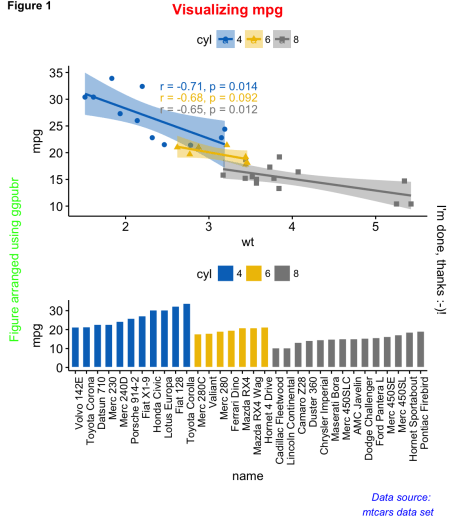

Аттини у нас маленькая, значит и дисплей надо брать маленький. Выбор пал на 0.91 дюймовый OLED с разрешением 128х32, контроллер SSD1306. Дёшево, сердито, и у меня их есть целая куча. Есть у меня такое увлечение- попытаться уложится в плату размером с дисплей, если это конечно возможно. В этот раз получилось.

Схема

-----

Все гениальное просто!Тут ничего нового. Усилитель на ОУ, пара делителей с фильтрующими емкостями, и стандартная обвязка для SSD1306. Чтобы получить из 75мВ вменяемые для АЦП значения выбран коэффициент усиления 31, что дает нам 2.2В при 71мВ и токе 47.3А на шунте. После ОУ мы это значение пилим пополам. Опорное напряжение- внутреннее 1.1В. R3 и С2 выступают фильтром ВЧ, а так-же коллега подсказал что без такой цепочки можно легко спалить вход ОУ при резком скачке тока на шунте.

Второй канал АЦП заведен через делитель на 16, что позволяет измерять до 17.6В. Так-же присутствует емкость для подавления помех. Про линейный стабилизатор на 3.3В я думаю можно не рассказывать.

В конкретно моем случае особая точность не нужна, но вы конечно можете пересчитать делители и КУ ОУ и либо увеличить точность, либо расширить диапазоны пожертвовав первой. АЦП у нас, напомню, разрядностью всего 10 бит.

Плата

-----

Плата нарисована односторонняя, под возможности ЛУТ. Дисплей на стороне компонентов, поверх них. Плата размером с дисплей, за его пределы выходят только контакты для пайки проводов.

РисуемКак вы можете заметить- все очень компактно получилось. Этому поспособствовали и несколько килограмм приехавших недавно резисторов и конденсаторов размера 0603, которые я 2 дня раскладывал по кассетницам, но это уже другая история) . Дорожки в основном 0.25.

После ЛУТаПлата вытравлена старым добрым ЛУТом. Правда в правильной модификации. Для переноса нужно использовать восковую бумагу, ту что является подложкой для самоклеящихся пленок. Написал бы отдельную статью о методе, но описаний технологии ЛУТ в интернетах уже столько, что скорее не буду.

После сборкиКак итогПрошивка

--------

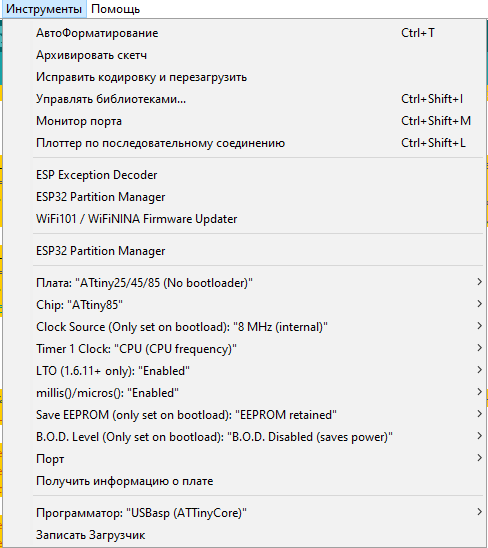

ПО написано в среде Arduino IDE. Ядро используется [AttinyCore](https://github.com/SpenceKonde/ATTinyCore). Библиотека дисплея [Tiny4kOLED](https://github.com/datacute/Tiny4kOLED) плюс [шрифты](https://github.com/datacute/TinyOLED-Fonts) . И то и другое доступно как по ссылкам выше, так и из менеджера плат и менеджера библиотек при помощи поиска.

Прошивал через USBasp и прищепку. Настройки остались все стандартные, если можно так сказать. Внутреннее тактирование на 8мГц. Прошивка грубо демонстрационная, прошу тапками не кидать, когда-нибудь скоро возможно напишу нормальную. А пока вдруг кто-нибудь решит повторить- все в ваших руках. Память используется почти вся, почти вся на шрифты. Это как первая цель для оптимизации. Еще парой строк можно добавить измерение мощности. Ну в общем есть где разгуляться.

Код

```

#include

#include "ModernDos.h"

#include "ModernDos8.h"

#include "5x5\_font.h"

int ADCV;

int ADCV1;

int ADCA;

int ADCA1;

float VOLT;

float AMP;

bool CH;

long MS;

//------------------------------------------------------------------------------

void setup() {

analogReference(INTERNAL1V1); //Устанавливаем опорное напряжение для АЦП- внутренее 1.1В

Wire.begin();

Wire.setClock(400000L);

oled.begin();

oled.clear();

oled.on();

}

//------------------------------------------------------------------------------

void loop() {

ADCV = analogRead(PB3) \* 0.985; //Читаем 3 канал АЦП и калибруем

ADCA = analogRead(PB4); //Читаем 2 канал

/\*

Дальше идет конструкция с флагами чтобы не тратить ресурсы на обновление дисплея если нет изменений.

\*/

if (ADCV1 != ADCV) { //Если резервное значение не равно значению с АЦП

ADCV1 = ADCV; //Записать в резервное значение новое значение АЦП

CH = 1; //Поднимаем флаг означающий новые данные

VOLT = float(map(ADCV, 0, 1023, 0, 1760)) / 100; //Стандартной функцией приводим значение из диапазона АЦП в диапазон нужный нам. Все это безобразие конверуем во Float и делим до реального значения.

}

if (ADCA1 != ADCA) {

ADCA1 = ADCA;

CH = 1;

AMP = float(map(ADCA, 0, 1023, 0, 47333)) / 1000;

}

if (CH && millis() > MS + 200) { //Если произошло изменение в данных, но не чаще 200мС, запускаем отрисовку данных на дисплей

MS = millis();

oled.setFontX2(FONT8X16MDOS);

oled.setCursor(0, 0);

oled.print(AMP, 1);

oled.setFontX2(FONT8X8MDOS);

oled.setCursor(64, 0);

oled.print("

```

Файлы

-----

[Исходники на гитхаб](https://github.com/ENGIN33RRR/Attiny85_VAmeter). Схема и печатная плата в DipTrace.

Забавный факт. Когда рендерил 3D вид- вдруг пришла мысль что плата на что-то похожа. А похожа она на плату от USB флешки, или на тот же Digispark в варианте что втыкается в USB. Приложил плату от флешки и понял что по ширине они практически одинаковы. Но я так думаю что человек способный такую плату изготовить не додумается ее сунуть в USB.

А еще ко мне приехало некоторое количество Attiny10. Так что будет продолжение с еще более мелким устройством и уже точно нормальным кодом. Правда я так и не придумал что это будет. Предлагайте в комментариях.

UPD: [Продолжение](https://habr.com/ru/post/710132/) на Attiny10 | https://habr.com/ru/post/709344/ | null | ru | null |

# Зеркало здесь, зеркало там: сетевая репликация дисков под Windows

Однажды на моём компьютере сгорел блок питания. С дымом, шумом, и прочими спецэффектами. Жёсткий диск тоже не выжил.

К счастью, там не было ничего ценного. Но я в очередной раз убедился, что RAID-массив не всегда помогает, т.к. может погибнуть вместе с компьютером.

Поэтому лучше, если копия данных будет находиться на другом компьютере. И хорошо, если она будет максимально свежей, чтобы в случае аварии продолжить работу с прерванного места.

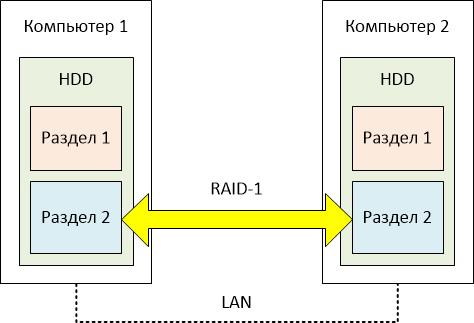

Такие решения есть для Linux и FreeBSD — DRBD и HAST. Они позволяют реплицировать блочные устройства хранения по сети. То есть, создать что-то вроде RAID-1, где «половинки» дискового массива находятся на разных компьютерах. Теперь такое решение есть и для Windows.

[](https://habr.com/ru/company/ruvds/blog/573608/)

И это не что-то новое, а тот же DRBD, портированный самими разработчиками из компании Linbit.

WinDRBD работает на 64 битных версиях Windows 10 или Server 2016. А на втором узле может быть как WinDRBD, так и DRBD под Linux. Причём узлы могут быть и виртуальными машинами.

На Хабре уже есть несколько статей по настройке DRBD, поэтому здесь я опишу только WinDRBD. Точнее — настройку репликации между двумя узлами (всего в кластере WinDRBD может быть 32 узла).

▍ Настройка

-----------

Скачиваем инсталлятор [отсюда](https://pkg.linbit.com//downloads/drbd-windows/install-windrbd-1.0.0-rc13-signed.exe), а дальше – как обычно: «Далее», «Далее», «Далее». Установленные в инсталляторе «птички» не трогаем.

Для работы WinDRBD нужен свободный раздел диска. Если свободных разделов нет – можно немного «откусить» от существующего раздела. Или добавить ещё один жёсткий диск. Главное, чтобы размеры выделенных разделов были одинаковы на обоих компьютерах. Если просто хотите попробовать, как оно работает — можете не трогать диски компьютера, а использовать USB-флешки.

Заходим в оснастку «Управление дисками», и на свободном месте создаём простой том нужного размера. Форматировать и назначать букву не нужно.

Стоит учесть, что в этом же разделе будет храниться и служебная информация WinDRBD, поэтому места для пользовательских данных останется меньше. Хотя и существует возможность вынести служебные данные на отдельный раздел, сами разработчики рекомендуют не заморачиваться и хранить всё вместе.

Следующее, что нужно настроить – открыть в брандмауэре TCP порт 7500 на вход и выход, чтобы WinDRBD с двух компьютеров могли между собой общаться. Разумеется, номер порта можно изменить в настройках.

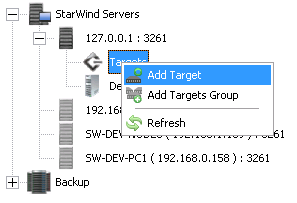

Файл с примером настроек находится в каталоге C:\windrbd\etc\drbd.d

Копируем windrbd-sample.res и даём ему понятное название, например raid1.res

Открываем его в текстовом редакторе и исправляем настройки:

```

resource “raid1” {

…

on windrbd1 {

address 192.168.0.1:7500;

node-id 1;

…

}

on windrbd2 {

address 192.168.0.2:7500;

node-id 2;

…

}

}

```

Здесь raid1 – название создаваемого ресурса, windrbd1 и windrbd2 – имена хостов.

Секция c настройками томов выглядит примерно так:

```

volume 1 {

disk “3e56b893-10bf-11e8-aedd-0800274289ab”;

device minor 1;

meta-disk internal;

}

```

Здесь раздел, выделенный для WinDRBD, указывается с помощью GUID (который можно посмотреть командой mountvol).

Не рекомендуемый, но допускаемый вариант – указать букву диска:

```

volume 1 {

disk “E:”;

…

}

```

Разделу, который появится в системе, тоже можно выдать букву:

```

device “F:” minor 1;

```

Но «для уменьшения количества проблем» разработчики рекомендуют делать как в первом варианте, без буквы. В этом случае после старта WinDRBD в системе появится не раздел, а отдельный жёсткий диск, который нужно будет инициализировать (создать таблицу разделов) и отформатировать через «Управление дисками».

Если оба хоста работают под Windows, файлы конфигурации у них будут одинаковыми – можно просто скопировать файл настроек на другой компьютер.

▍ Запуск

--------

Для выполнения приведенных ниже команд используйте командную строку с правами администратора.

Сначала проверим, что в файле настроек нет ошибок (raid1 – название файла):

```

drbdadm dump raid1

```

Затем инициализируем служебные метаданные на разделах (отвечайте «yes» на предупреждение об удалении данных):

```

drbdadm create-md raid1

```

Инициализировать их нужно на обеих машинах. И на обеих запустить сервис:

```

drbdadm up raid1

```

Текущее состояние можно посмотреть командой:

```

drbdadm status

```

Если связи со второй стороной нет – в нижней строке статуса будет написано «*Connecting*».

Когда связь установится — появится сообщение «*peer-disk:Inconsistent*»

Связь установилась, но этого недостаточно. Нужно явно указать, какой хост будет служить источником синхронизации (первичным). Выполним на первом хосте такую команду:

```

drbdadm primary raid1 --force

```

Обратите внимание – параметр `force` используется только при первом запуске, иначе потеряются данные.

С помощью команды `drbdadm status` можно отслеживать прогресс синхронизации. Когда она завершится, надпись в нижней строке сменится на «*peer-disk:UpToDate*»

Разумеется, синхронизация займёт некоторое время, зависящее от размера раздела и скорости сети.

▍ Проверка работоспособности

----------------------------

На первичном хосте во вновь появившемся разделе создаём файл test1.

Отключаем на первичном хосте WinDRBD:

```

drbdadm down raid1

```

Заходим на второй узел и переключаем его в режим первичного:

```

drbdadm primary raid1

```

При этом в системе появится новый раздел, на котором будет присутствовать файл test1.

Стоит отметить, что синхронизируемый раздел виден только на первичном узле. На вторичных узлах он скрыт.

Создадим на втором хосте ещё один файл – test2 и переключим хост обратно в режим вторичного:

```

drbdadm secondary raid1

```

Раздел скроется.

Вновь запускаем WinDRBD на первичном хосте:

```

drbdadm up raid1

```

```

drbdadm primary raid1

```

На появившемся разделе видим два файла – test1 и test2. То есть, синхронизация в обратную сторону также сработала.

▍ Итого

-------

У Linstor получилось сделать простое в настройке средство, увеличивающее надёжность хранения данных. Пока что оно не имеет всех возможностей Linux версии (географически распределённые системы, работа в кластерах и т.п.), но это обещают добавить в следующих релизах.

Кроме WinDRBD есть ещё один порт DRBD на Windows — WDRBD от компании ManTech. Возможности там примерно такие-же, как у WinDRBD, но для получения инсталлятора нужно писать запрос разработчикам, или компилировать из исходников самостоятельно.

[](http://ruvds.com/ru-rub?utm_source=habr&utm_medium=article&utm_campaign=sukhe&utm_content=Zerkalo_zdes',_zerkalo_tam:_setevaya_replikaciya_diskov_pod_Windows) | https://habr.com/ru/post/573608/ | null | ru | null |

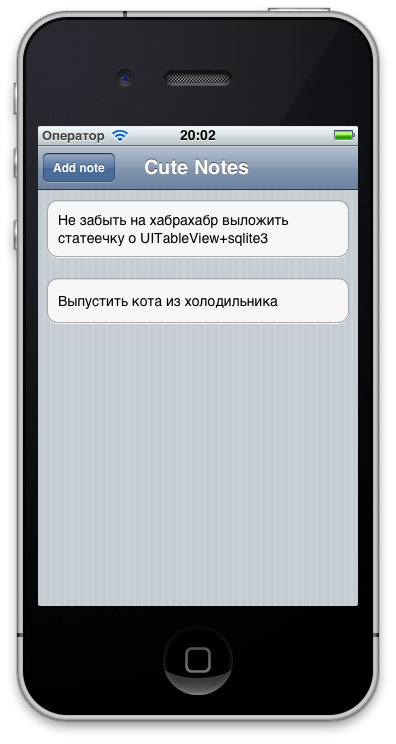

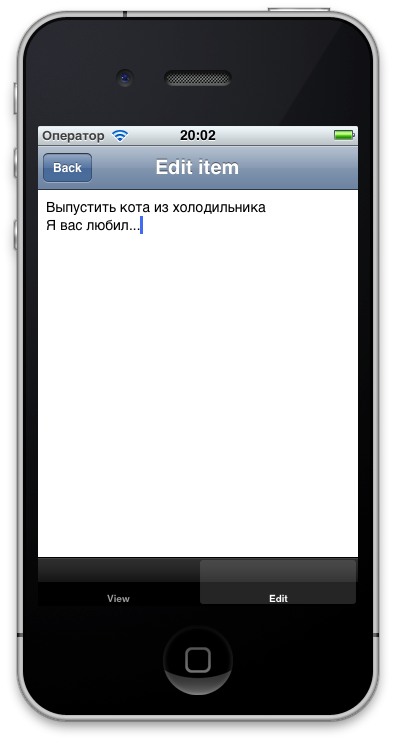

# Организация видеонаблюдения при помощи Raspberry Pi и веб камеры Logitech

Введение

--------

В данной статье хотелось бы поделиться одним простым и доступным способом как мне удалось организовать видеонаблюдение за подъездом при помощи малинки и бытовой веб камеры. Думаю, у многих нынче в закромах завалялись уже не нужные вебки. Сужу по себе, раньше, в эпоху преобладания десктопов такая камера была вещью весьма необходимой для желающих показать себя собеседнику, а то и миру. Однако время идет, десктопы все больше заменяются ноутбуками, планшетами и телефонами, имеющими на борту свою камеру. Но зачем же добру лежать без дела?

История этого проекта началась с покупки Raspberry 3b+. После получения и первичной настройки сего чудо-девайса встал нетривиальный вопрос: "Хорошо, ну а дальше то что?". Ведь покупал я ее не с конкретной целью - а скорее как катализатор погружения в волшебный мир компьютерных технологий. Забегая вперед, скажу, что план оказался отличным и работает по сей день).

И вот пришла идея подключить к малинке валяющуюся без дела вебку Logitech C270. Далее следовал период гугления, проб и ошибок, который в итоге привел к тому, что я и собираюсь описать.

Итак на выходе мы получаем:

1. Видеонаблюдение за подъездом/двором, да чем угодно)

2. При обнаружении движения в поле зрения камеры включается запись видео с дальнейшей автоматической пересылкой его в Telegram

3. Возможность просмотра картинки камеры в реальном времени в любой точке мира, где есть интернет

4. Опыт в общении с linux, хоть и не большой, но идеальный для первого знакомства, кроме того подкрепленный полезным и реально работающим сервисом, созданным своими руками :)

Итак, приступим.

Предварительная настройка

-------------------------

Первоначальную настройку Raspberry Pi, заключающуюся в установке ОС и подключению к сети описывать пожалуй не стану, так как в сети достаточно туториалов по этой процедуре.

Я использую в качестве ОС Raspbian GNU/Linux 10 (buster), соответсвенно данный туториал будет гарантированно работать для данной версии ОС, однако, думаю и на других дистрибутивах на основе Debian все будет в порядке.

Нужно обратить внимание, что для данной модели камеры драйверы не потребовались. Убедиться, что устройство корректно распознано можно при помощи следующей команды:

> `sudo v4l2-ctl --list-formats`

>

>

Результат

```

ioctl: VIDIOC_ENUM_FMT

Type: Video Capture

[0]: 'YUYV' (YUYV 4:2:2)

[1]: 'MJPG' (Motion-JPEG, compressed)

```

Камеры других моделей и производителей не проверял, но предполагаю, что аналогично заведется любая с протоколом Universal Plug and Play (UPnP) .

Для управления нашим серевером видеонаблюдения будем использовать пакет Motion — программа, которая отслеживает видеосигнал с одной или нескольких камер и способна определить, изменилась ли значительная часть изображения. Или, другими словами может обнаруживать движение. В случае обнаружения есть масса настроек что делать дальше. Можно сделать фото или записать видео, сохранить его на диск (для Raspberry скорее всего SD карту), а далее, с помощью команд, указываемых в файле конфигурации проделать с полученным контентом практически все, что угодно. Также Motion содержит в себе возможность поднятия стрима с камеры, то-есть появляется возможность наблюдения за происходящим в поле зрения камеры удаленно. Вообще, конфигурационный файл Motion позволяет производить весьма шаирокую настройку. Среди прочего можно задавать параметры изображения (яркость, контрастность и т.д.), парметры обнаружения движения (также присутствут возможность указания зоны, где обнаружение производиться не будет), параметры фотографий и видео, включая формат итогового видео, его битрейт, кодек, которым оно кодируется. Далее следуют настройки стриминга видео, действия, выполняемые на этапах с момента обнаружения движения до сохранения файла с записью, специфические настройки для моторизированных камер, на них я подробно останавливаться не буду, так как в файле конфига содержаться вполне исчерпывающие комментарии по каждой опции на английском языке.

В конце конфигурационного файла, если камер больше чем 1 или же просто для удобства присутствует возможность настройки каждой камеры в отдельном файле. Не прописанные в нем опции берутся из общего конфига, прописанные в файле заменяют собой те, что указаны в главном конфиге. Так как у меня всего одна камера буду описывать настройку в главном конфиге.

Установка и настройка Motion

----------------------------

Для установки Motion пользуемся стандартным паттерном

> sudo apt-get install motion

>

>

После установки в директории /etc/motion появляется файл motion.conf, который и является главным конфигурационным файлом. Его мы и будем сейчас редактировать

> sudo nano /etc/motion/motion.conf

>

>

Вносим изменения в следующие строки:

```

# Включаем опцию, которая понадобиться для автозагрузки Motion при включении или перезагрузке

start_motion_daemon=yes

# Выставляем максимальное разрешение, которая поддерживает камера.

width 1280

height 720

# Указываем частоту смены кадров.

framerate 10

# Указываем количество пикселей, смена состояния которых активирует датчик движения

threshold 1000

# Значение ниже указывает на минимальное количество кадров,

# при котором делается вывод о наличие движения

minimum_motion_frames 3

# Значение, указывающее максимальное количество кадров, при отсутвтии изменений

# на которых делается вывод о прекращении движения

event_gap 10

# Указываем максимальную продолжительность одного видеофайла, по истечении которой

# при продолжении движения создается следующий видеофайл

max_movie_time 20

# Если фотографии не нужны - отключаем их

output_pictures off

# Прописываем параметры видеофайлов. Подробно расписывать каждый не буду, скажу только,

# что, это оптимальный набор для возможности загрузки в Telegram и проигрывания в нем

ffmpeg_output_movies on

ffmpeg_output_debug_movies off

ffmpeg_timelapse 0

ffmpeg_bps 400000

ffmpeg_variable_bitrate 0

ffmpeg_video_codec mp4

ffmpeg_duplicate_frames true

# Выделять движущийся объект на видео

locate_motion_mode on

# Стиль выделения: красный квадрат. По подсказкам в конфиге можно выбрать другой цвет или фигуру

locate_motion_style redbox

# Указываем директорию, куда motion будет складывать отснятое. Директорию по умолчанию,

# где лежат конфиги указывать не рекомендую в связи с необходимостью автоудаленя старых

# видео (про это будет дальше)

target_dir /var/lib/motion

# Далее следуют настройки потоковой передачи видео. Порт не обязательно 90, желательно нестандартный

stream_port 90

stream_quality 100

stream_maxrate 20

stream_localhost off

stream_limit 0

# Требовать авторизацию для доступа к потоку вещания (если не требуется указываем 0)

stream_auth_method 1

stream_authentication login:password

# Указываем, что сделать с видео (послать в Telegram, указывая эту строку я немного

# забегаю вперед для того, чтобы вам не пришлось повторно возвращаться в этот файл)

on_movie_end /usr/local/bin/tg_video.sh Username %f

```

Жмем сочетание клавиш ctrl + o для сохранения, ctrl + x для выхода из текстового редактора

Собственно, на этом настройка Motion завершена.

Теперь внесем некоторые дополнительные настройки, необходимые для корректной работы.

По мере работы видеосервера видеофайлы будут накапливаться на карте памяти, пока не исчерпается свободное место. Чтобы этого не допустить организуем автоматическое удаление файлов, созданных более одного дня назад:

Запускам настройку планировщика событий crone:

> sudo crontab -e

>

>

Добавляем в него следующую строку (Если нужно удалять файлы старше более двух дней меняем цифру после mtime соответственно на +2 и т.д.):

> 0 1 \* \* \* find /var/lib/motion -mtime +1 -exec rm {} ;

>

>

Жмем сочетание клавиш ctrl + o для сохранения, ctrl + x для выхода из текстового редактора

Пришло время установить и настроить Telegram

Установка и настройка Telegram

------------------------------

Для наших целей будем использовать консольную версию телеграм - Telegram CLI.

Для начала

Обновляем пакеты, и устанавливаем необходимые для работы Telegram CLI:

> sudo apt update

>

> sudo apt upgrade

>

> sudo apt install -y libreadline-dev libconfig-dev libssl-dev sudo apt install -y lua5.2 liblua5.2-dev

>

> sudo apt install -y libevent-dev libjansson-dev libpython-dev libssl1.0-dev

>

> make git

>

>

Скачиваем Telegram CLI

> cd ~

>

> git clone --recursive https://github.com/kenorb-contrib/tg.git

>

>

Чтобы заставить CLI Telegram скомпилироваться на Raspberry Pi, нам сначала нужно изменить один из файлов исходного кода:

> nano ~/tg/tgl/mtproto-utils.c

>

>

Нажимаем CTRL + W для поиска, затем вводим BN2ull и жмем ENTER. Попадаем к следующему блоку кода:

```

static unsigned long long BN2ull (TGLC_bn *b) {

if (sizeof (unsigned long) == 8) {

return TGLC_bn_get_word (b);

} else if (sizeof (unsigned long long) == 8) {

assert (0); // As long as nobody ever uses this code, assume it is broken.

unsigned long long tmp;

/* Here be dragons, but it should be okay due to be64toh */

TGLC_bn_bn2bin (b, (unsigned char *) &tmp);

return be64toh (tmp);

} else {

assert (0);

}

}

```

В этом блоке кода мы хотим найти и заменить два вхождения assert(0), как показано ниже.

`assert(0);`

заменяем на

`//assert(0);`

Жмем сочетание клавиш ctrl + o для сохранения, ctrl + x для выхода из текстового редактора

Теперь можем скомпилировать наш Telegram

> cd ~/tg

>

> ./configure

>

> make

>

>

На этом этапе нам понадобится учетная запись, зарегистрированная на отдельный телефонный номер, которая и будет присылать видео в чат в вашем основном аккаунте. Соответственно, понадобится первоначально на смартфоне создать новую учетную запись телеграм. Кроме того, для возможности бесперебойной отправки сообщений через Telegram CLI необходимо добавить вашу основную учетную запись в контакты той, которая будет работать на малинке.

Когда все описанные подготовительные процедуры завершены можно приступать к авторизации через коммандную строку.

> cd ~/tg

>

> bin/telegram-cli -k tg-server.pub -W

>

>

Телеграм запросит ваш телефонный номер в формате +(код страны)ХХХХХХХ, вводим, жмем ENTER и все, ваш телеграм готов отправлять сообщения (и не только) через коммандную строку.

Сообщение можно отправить при помощи следующей команды:

> msg Username "текст сообщения"

>

>

Username, напоминаю, должен содержаться в списке контактов. Проверить его наличие можно командой:

> contact\_list

>

>

Для отправки видео существует похожая команда:

> msg\_video Username путь к файлу видео

>

>

Убедившись, что все работает и сообщения уходят и приходят к адресату, создадим небольшой bash скрипт для обращения к телеграму напрямую из командной строки, без необходимости запускать его коммандный интерфейс. Покидаем интерфейс телеграма при помощи сочетаня клавиш ctrl + c и приступаем к созданию bash скрипта:

> sudo nano /usr/local/bin/tg\_video.sh

>

>

В появившемся окне вводим следующий код:

```

#!/bin/bash

tgpath=/home/pi/tg

cd ${tgpath}

(sleep 3; echo "send_video $1 $2"; echo "safe_quit") | ${tgpath}/bin/telegram-cli -k tg-server.pub -W

```

Сохраняем файл при помощи ctrl + o и выходим ctrl + c. Теперь нам нужно дать права на выполнение нашего скрипта:

> `sudo chmod -R 0655` /usr/local/bin/tg\_video.sh

>

>

Как это работает: помните, мы прописывали в файле конфигурации motion.conf строку, которая выполняется при окончании записи видеофайла?

> on\_movie\_end /usr/local/bin/tg\_video.sh Username %f

>

>

То-есть, при окончании записи видеофайла motion помещает его в переменную f и вызывает скрипт для отправки видео в telegram, передавая ему 2 параметра: Username (в нашем случае это контакт в телеграме, которому мы присылаем видео) и %f - сам файл.

На этом настройка отправки видео в телеграм завершена, можно запускать motion:

> `sudo systemctl enable motion`

>

>

Убедиться, что он работает можно командой

> `sudo service motion status`

>

>

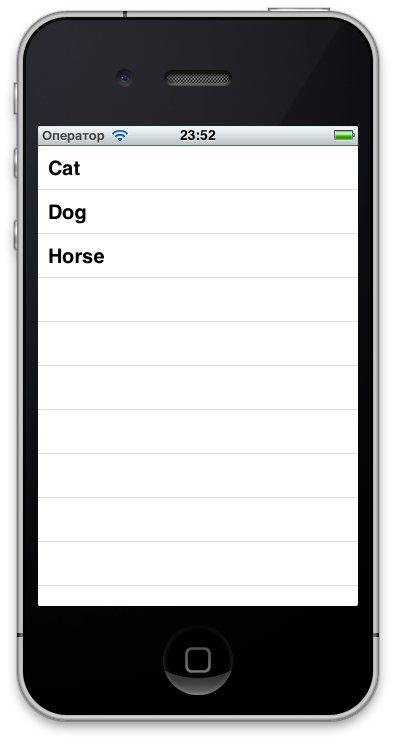

Как только движение будет зафиксировано - в telegram начнут прилетать такие видео. Что удобно, в нем можно настроить их автопроигрывание прямо в окне - не нужно загружать, сохранять и т.д.

Немного про онлайн стриминг

---------------------------

В принципе, внутри локальной сети видеопоток с камеры можно смотреть просто введя в адресную строку браузера ip адрес, присовенный малинке и через двоеточие порт, который мы указали в файле конфигурации.

[192.168.0.106](http://192.168.0.1:8080/) - это адрес Raspberry, присвоенный ей моим роутером. Для того, чтобы он оставался все время одним и тем же необходимо установить привязку ip адреса к mac адресу на вашем роутере. После чего, вводим в браузере:

> [http://192.168.0.106:90/](http://192.168.0.1:8080/)

>

>

Появится запрос на ввод логина и пароля если вы указывали необходимость авторизации, а затем можно будет наблюдать видеопоток:

Камеру я разместил на глазке входной двери, предварительно вытащив ее из корпуса для того, чтобы объектив мог войти дальше в отверстие глазка, закрепив ее двухсторонним скотчем и прикрыв небольшим пластиковым коробком. Но тут универсальных советов нет, можно включать фантазию по полной программе)

Если вы счастливый обладатель реального ip - адреса то можно пробросить порты в роутере и наблюдать за происходящим уже из любой точки интернета, введя в адресную строку браузера уже ваш реальный ip и порт. Напрмер:

Для просмотра вводим в браузере:

> [http://ваш\_реальный\_IP:9000/](http://192.168.0.1:8080/)

>

>

Лично у себя я организовал все несколько иначе: малинка постоянно подключена по VPN к облачному серверу с реальным IP адресов. Стрим по локальному VPN IP адресу приходит в Motion, установленный на облачном сервере при помощи пункта motion.conf

> netcam\_url [http://192.168.40.10:](http://192.168.42.10:8134)9000

>

>

Соответвенно в глобальный интернет стримит уже такой своеобразный "прокси" motion.

Вот собственно и все, надеюсь эта статья будет полезной в практическом плане и вдохновит на дальнейшее познание и разработку чего-нибудь нового :) | https://habr.com/ru/post/699930/ | null | ru | null |

# Поднятие хоста инкассации Ликард на Ubuntu

Хост инкассации Ликард — это «узкоспециализированное ПО, не имеющее аналогов для Linux, непригодное.....», требовательное к самым разнообразным мелочам. Не достаточно просто поднять XP на виртуальной машине, чтобы можно было вернуть потерянные часы и ночи простоя системы из-за включенной голой небезопасной Windows; держать [нечто отдельное](http://itsoft.ru/service/hosting-center/colocation/DSC_1685.jpg) для выполнения этих задач в своём тесном home-office, населённом малолетними диверсантами, не приемлимо. Занимательное действо, разыгравшееся под катом как-бы говорит нам о степени прогресса в развитии и повышении дружественности дистрибутива за последний год, и высокой пригодности его для решения подобных задач…

… Не мог же я один наделать столько шума?" (с) Пятачок

#### **1. Что такое Ликард?**

Официальную версию можно почерпнуть [здесь](http://www.licard.ru)

Кратко: сеть POS-терминалов на АЗС в странах СНГ и Восточной Европы, развёрнутая для обслуживания фирменных EMV-карт Ликард. Клиенты компании — по большей части крупные грузоперевозчики (дальнобойщики) и нефтегазовый сектор. Терминалы работают в offline-режиме, обмениваясь данными с центрами сбора и передачи данных компании несколько раз в сутки по каналу GPRS, Ethernet либо проводному телефону. Процесс обмена информацией POS-терминала и ЦСиПД — называется инкассацией, а ЦСиПД — хостами инкассации.

#### **2. Определение проблем**

Почти везде хосты инкассации расположены в специально оборудованных помещениях, в офисах компании, на выделенных под инкассацию серверах. Но в Восточной Сибири Ликард чаще всего представлен одним сотрудником, осуществляющим инкассацию терминалов, техподдержку операторов АЗС и прочее в режиме home-office, автономно. Необходимое ПО для осуществления инкассации развёрнуто на его домашнем компьютере. Изменений в ситуации не предвидится: объём покупок по топливным картам на порядок меньше, чем даже в Западной Сибири, получаемая с них прибыль (всего 3% от каждой покупки) не покроет затрат на содержание даже небольшого офиса.

Хост инкассации представляет собой композицию специально сконфигурированного железа, закрытого и устаревшего ПО: комплекса обработки входящей и генерации исходящей «почты» терминалов и комплекса инкассации терминалов (загрузка обновлённых справочников из почты, выгрузка файлов транзакций).

Железо — внешний dial-up модем (например, мой Zyxel U-1496E для надёжного соединения на самых зашумлённых линиях), 3G-брелок для инкассации терминалов через GPRS и Ethernet c подключенной услугой внешнего статического IP-адреса (# Huawei E1550), COM-порт (что в настоящее время редкость) для подключения внешного модема или коммуникационного кабеля терминала.

Основа первого комплекса — Microsoft Office 97 (в частности его компонент Access 97) и операционная система Microsoft Windows 2000 (либо XP с доработками реестра). Причём MSO97 — строго специальным образом обновлённый, более современные версии неправильно работают с написанной ещё в 97-м году на VBA базой данных, переработка её с чистого листа в более современном пакете — по неизвестным причинам считается головной организацией делом пустым.

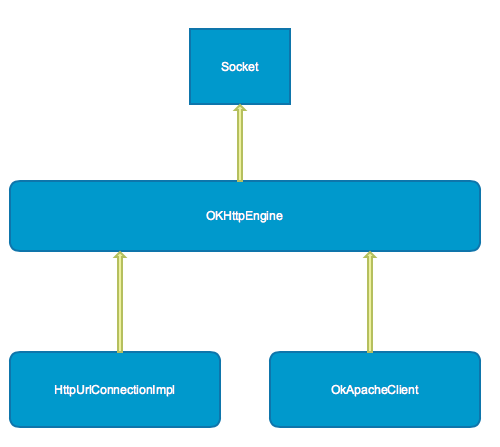

Основа второго комплекса — созданный центральным отделом разработки Хост Обмена Информацией (сокращённо ХОИ), заменивший ранее использовавшийся Prowin2k. ХОИ состоит из коммуникационного, управляющего и конфигурационного приложений. Коммуникационное — консольное приложение без интерфейса, управляющее — собственно интерфейс к нему, позволяющий наблюдать процесс инкассации и управлять коммуникационным приложением. Конфигурационное приложение — редактор ini-файла настроек, подхватывающегося коммуникационным приложением при старте. Все 3 части написаны под windows, хотя такое подразделение предполагает возможность легкого портирования на Linux.

В последние годы, при замене и модернизации железа хостов инкассации возникали различные проблемы с MSO97 — из-за более 1Gb ОЗУ, слишком больших разделов на жёстком диске. Доставляет проблем и Windows, особенно в свете подключения к Интернету через внешний статический IP-адрес — как минимум приходится закрывать ненужные порты и работать через Outpost Firewall. Но главное — всё это развёрнуто на домашнем компьютере, владельцу которого вовсе не доставляет радость работа в устаревшей и небезопасной системе. Поставленная в другой раздел винчестера Ubuntu, используемая теперь как основная система, закрывает необходимость работы с Windows не полностью. На 3 часа в день приходилось перезагружаться под Windows для приёма «почты», инкассации терминалов и создания «почты» с полученными транзакциями.

#### **3. Мой интерес**

Свести общение с Windows к нулевому значению, решая задачи Home- и Office- в операционной системе Ubuntu. Хотя опыт интенсивного использования Linux в настоящий момент всего 9 месяцев, я уже немного освоился и перевёл примерно 70ПК на работе (3 компьютерных класса и около 10 «офисных» машин). Уже через несколько месяцев использования Ubuntu в качестве основной системы ежедневные перезагрузки с вырыванием 3-х плодотворных часов из жизни порядком надоели. То обстоятельство, что половина документов, логов, истории и почты находится под одной XP, а половина — под Ubuntu, вызывало большой дискомфорт. Некрасиво…

#### **4. Описание процесса переноса ХОИ**

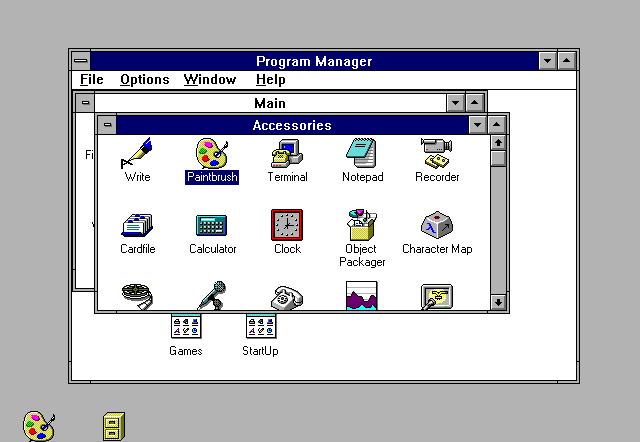

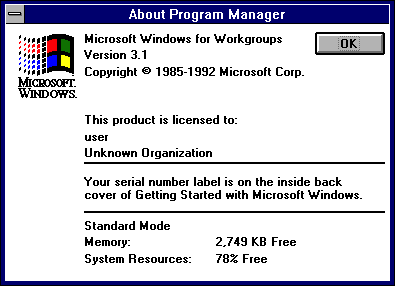

##### a) Ubuntu 9.10, обновлённая до 10.04

Начались эксперименты с открытой виртуальной машиной от Oracle, доступной из репозитория Ubuntu. Малоинтересная часть (банальная установка WinXP на созданный виртуальный диск) не будет описана здесь. Следующая, более интересная часть ниже.

###### Настройки и неудачи.

1. *Oracle VirtualBox OSE не достаточно хорошо предоставлял COM-порт гостевой системе, не умел работать с USB-устройствами*. Пришлось перейти на закрытую версию, благо и виртуальный диск, и настройки она подхватила без проблем. На ней внешний dial-up модем немедленно подружился с хостом. Радость от наблюдения первого инкассирующегося терминала была невыразима. 3 выпадающих из жизни полезных часа сократились до бесполезных 15 минут

2. *Закрытый Oracle VirtualBox отказывался «включать» прекрасно видимый им, разрешённый к проброске 3G-модем..* Это значило, что «быстро и просто», включая GPRS прямо из гостевой системы — не получится. Оставалось заставить работать 3G-модем из под Ubuntu. До этого момента 3G под Ubuntu я не использовал — изначально Network Manager в Ubuntu 9.10 мешал работе всякого сконфигурированного pppoe-подключения или 3G-подключения — не подхватывал предоставляемые подключениями адреса DNS-серверов. Поэтому его пакеты были удалены, а про 3G до случая забыто. Не желая возвращения Network Manager-a, был найден и установлен MobilePartner, интерфейс управления 3G-модемами под Linux от Мегафона. Успех был не полон, т.к. проявилась проблема сброса режима брелка в «modem+CD» из единственно годного «modem only». Она была преодолена следующим образом: физически отключаем модем, подаём через терминал команду восстановления режима, подключаем модем обратно. Не самое оптимальное решение, но модем стал стабильно определяться, и в нужный момент не вдавался в капризы

3. *Oracle VirtualBox по-умолчанию закрывает все порты для гостевой системы* В опциях VM включен NAT, браузер гостевой ХР открывает веб-страницы, но инкассация по GPRS на хост не идёт. После выяснения обстоятельств (спасибо [openkazan](http://www.openkazan.info/VirtualBox-Ubuntu)), [нужный порт был проброшен в гостевую систему](http://linux.irk.ru/forum/viewthread.php?thread_id=329#post_4357). Теперь и 15 минут каждый день меня более под виндой не видели)…

4. *Время гостевой и хостовой систем не соответствовали друг другу.* Хостовая система жила по летнему времени, а гостевая — по зимнему. VirtualBox не эмулирует BIOS, правка времени из «часов» гостевой помогала на пару секунд — потом время «синхронизировалось» с таймером виртуального BIOS-a, и разница возвращалась. Визуально помогала смена зон — но на время в ХОИ это не влияло. Время терминалов синхронизировалось с ложным значения, возник бардак. Терминалы звонили одновременно, а на другие сутки звонили раньше или позже чем полагалось, приходилось вновь терять 3 часа жизни, чтобы только синхронизировать время терминалов и восстановить порядок. Ранее, подобная проблема мной встречалась и на WinXP, сразу после обновления до SP3 — она, как и Ubuntu, переводила время фиктивно, только на часах в трее. В результате сбивалось расписание инкассации и файлы транзакций, полученные в первый час после полуночи записывались вчерашним днём, а это совершенно недопустимо. Первоначально помогал перевод времени XP ещё на час вперёд, потом был найден лучший способ — отключение автоматического перевода часов и синхронизации с сервером времени — применив первое и думая о чём-то подобном второму, Google помог найти лекарство получше от этой беды.

Да, VirtualBox не позволяет задать абсолютную величину времени для гостевой системы. Но он позволяет задать отклонение в миллисекундах времени гостевой относительно времени хостовой… Перевод команды из win в lin и несколько опытов закончились [подбором правильного значения параметра](http://linux.irk.ru/forum/viewthread.php?thread_id=329#post_4374) *сдвига по фазе :)*, контрольной синхронизацией времени уже под Ubuntu, и бутылочкой Паулайнера себе в награду)

5. *Простое копирование файлов в подключенную сетевым диском папку хостовой машины сбивает на них аттрибуты времени.* Утром, копируя принятые файлы транзакций в нужную папку хостовой машины, подключенную как сетевой диск Z, обнаружился вышеописанный трабл. Но простое решение пришло само — архивируем переносимые файлы с помощью 7z на гостевой системе, копируем архив куда\_надо, распаковываем — и аттрибуты целы. Характерно то, что обратное копирование (с хостового Z на гостевой С) аттрибуты времени не сбивает.

6. *Одновременно работающие 2 подключения нарушают прохождение пакетов к ХОИ.* Последнее из встреченных проблем. Если подключить 3G одновременно с подключенным pppoe — никакой GPRS-инкассации не будет… Первое кривое-полевое решение — физически отцепить кабель pppoe, перезагрузиться, включить GPRS. Второе, кривое несколько менее и без перезагрузки:

`sudo poff dsl-provider

<включаем GPRS через GUI Mobile Partner>>

...

15 минут, инкассация проходит успешно

...

<выключаем GPRS через GUI Mobile Partner>

sudo pon dsl-provider

<инкассируем остальные терминалы>`

Так, наступив на все грабли и выжив, моя инкассация стала проходить строго по регламенту)

##### b) Ubuntu 10.10 «из коробки». С 10.2010 по сий день

###### В октябре стал доступен Maverick..

Я читал мнение общественности его о многочисленных недоработках, отговоры от перехода, но мой самый сильный промах установкой Ubuntu 9.10 — выделение всего 16Gb на все её разделы, стал сказываться всё чаще. Сначала кончились 4Gb корневого раздела, а когда они были увеличены до 10Gb за счёт сокращения раздела с /home, проблемы возникли уже с последним. Ежедневное увеличение архива служебной почты на 10~20Мб — и вот база Thunderbird съедала чуть более, чем половину раздела… Так удобно разложенные Picassa фото с цифровика пришлось несколько раз перевозить на win-раздел и каждый раз потом долго искать, на какой именно (их 7)… Постоянный контроль свободного места в течении 2 месяцев, вывод на стабильные 1.2Gb и понимание — я не желаю заходить без особой необходимости на разделы NTFS, FAT32. Итогом стала большая чистка, высвобождение 80Gb у одного из на NTFS-разделов (28 корень + 2 swap + 50 /home) и установка самого свежего из имеющихся на болванке Ubuntu 10.10, с успокоением — я ничего не теряю, не понравится — вернусь в свою 10.04 и поставлю на закачку свежий дистрибутив ArchLinix)… Но — понравилось.

* *Во первых — Network Manager удалить не пришлось..* Так уж вышло, что сразу он заработал. Даже pppoe без pppoeconf поднялось (что в 9.10 никак не выходило, скорее всего из-за проблем с подхватом DNS; и замечу, что pppoeconf входит в дистрибутив изначально, от скачивания пакета под старой системой, чтобы установить его вручную в новую пользователь избавлен. И от манипуляций с resolv.conf тоже

* *Во вторых — мой 3G-брелок Huawei E1550 опознан без дополнительной установки* udev-modeswitch, подключается и отключается прямо из NM, режим не теряет, и вообще ведёт себя неожиданно пристойно… Очень редко пропадает из системы, но вынуть-встравить из порта помогает (пропадание ему свойственны и под Windows, с таким же решением).

* *В третьих — необходимость в ежедневном общении с терминалом совсем пропала)..* мышкой отключаем DSL, включаем 3G, после прохождения инкассации по GPRS повторяем в обратном порядке… Не питая антипатию к командной строке, но испытывая по ней стойкую ностальгию со времён БК10100 и NC v2.5, я провожу в ней столько же времени, сколько и на 10.04, но уже за более полезными для себя занятиями…

Значительно уменьшенные размеры еженедельных обновлений (зоопарка ПО и мусора пакетов в новой системе нет, т.к. с необходимым набор я для себя уже определился), успешно скопированные почтовая база и нужные настройки ПО из старого /home, более мелкие плюсы — отдельного упоминания не заслуживают *(вроде прекратившихся зависаний Х-ов посреди работы)*. Виртуальный диск с ХОИ перенесён в /home и отпавшая необходимость автомонтирования ntfs-разделов при загрузке…

***За год, с релиза 9.10 по релиз 10.10 сделано очень много, Ubuntu стала на порядок дружественнее, в самых разных проявлениях, я гарантирую это)..***

#### 5. Profit

Цели достигнуты, задачи выполнены, интерес приобретён)… Даже в бОльшем объёме и лучшем качестве, нежели предполагалось ранее. Так, VDI-образ винта с хостом можно безболезненно переносить на самое разное железо и ОС, не имея каждый раз сношений с установкой нужного софта, первичным его конфигурированием и прочими утехами windows-юзера… Работа под белымвнешнимстатическим IP стала безопаснее для хоста, ибо кроме как по открытому руками 8888-му порту и некоторым общеизвестным — доступа нет… Проблемы Google-Earth и прочего софта, кривого в своих последних linux-версиях, /me также не особо уж трогают — они поселились в виртуальной машине, хотя ради них одних поднимать её не стал бы)…

[](https://habr.com/images/px.gif#%3D%22http%3A%2F%2Fimg638.imageshack.us%2Fi%2F54898942.png%2F%22 "ImageShack - Image And Video Hosting")

Собственно результат :)

Респект [neonxp](https://habrahabr.ru/users/neonxp/) за корректорские правки)

P.S.: эх, плакала моя к..) | https://habr.com/ru/post/107302/ | null | ru | null |

# Подготовка библиотек FMOD, Cocos2D-x, OpenAL и OpenSSL для Android-устройств, построенных на платформе Intel

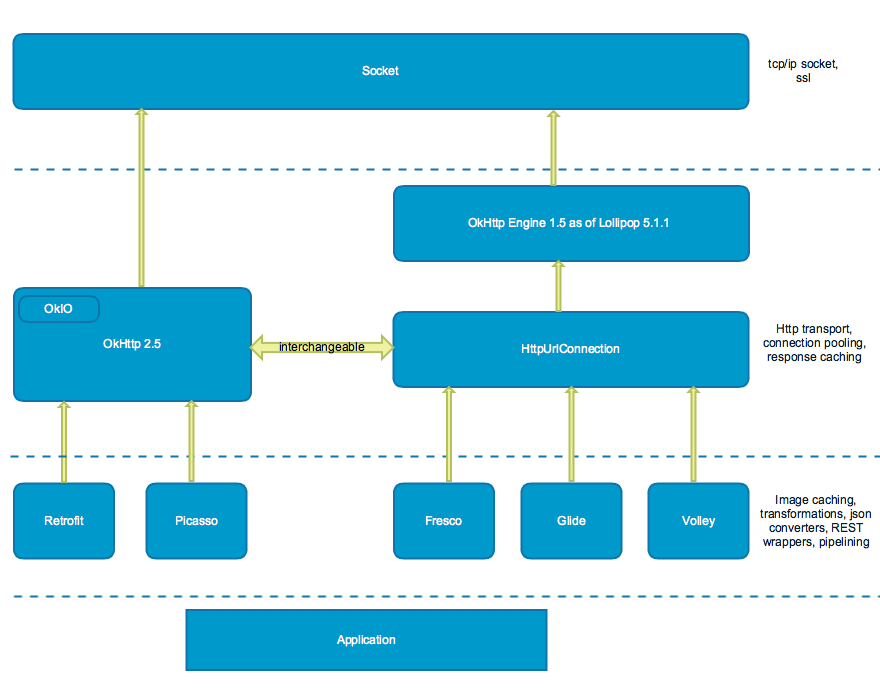

Ни один серьёзный Android-проект не обходится без сторонних библиотек. Иногда их можно найти в пригодном для целевой архитектуры виде, иногда – нет. Тогда библиотеки приходится готовить самостоятельно, например, собирая из исходного кода.

[](http://habrahabr.ru/company/intel/blog/271013/)

Из этого практического руководства вы узнаете о библиотеках FMOD, Cocos2D-x, OpenAL и OpenSSL для Android-устройств, построенных на платформе x86. Они, в особенности – первые три, пригодятся тем, кто разрабатывает игры и мультимедийные приложения. А именно, мы поговорим об их настройке, компиляции и использовании в Android-приложениях.

Предварительная подготовка

--------------------------

Прежде, чем мы начнём, нужно кое-что подготовить. Если вы уже разрабатываете приложения для Android, вполне вероятно, что большая часть того, о чём идёт речь, у вас уже есть. Однако и в этом случае полезным будет просмотреть предложенный список.

А именно, вам понадобятся следующие программные инструменты.

* Среда разработки Android-приложений. [С этой страниц](http://developer.android.com/intl/ru/sdk/index.html)ы нужно загрузить Android SDK. Мы, приводя практические примеры, используем IDE [Eclipse](https://eclipse.org/).

* [Android NDK](http://developer.android.com/intl/ru/tools/sdk/ndk/index.html).

* [Cygwin](http://www.cygwin.com/install.html). В ходе установки, на этапе настройки состава пакетов, нужно выбрать следующие: Autoconf, Automake, binutils, gcc-core, gcc-g++, gcc4-core, gcc4-g++, gdb, pcre, pcre-devel, gawk, make, python. Не забудьте выбрать GNU-версию make, иначе вы не сможете выполнять построение проектов с использованием NDK.

* [JDK](http://www.oracle.com/technetwork/java/javase/downloads/jdk7-downloads-1880260.html).

* [Apache Ant](http://ant.apache.org/).

После того, как всё это у вас есть, нужно отредактировать переменные среды. Или, по крайней мере, проверить их, так как в ходе установки вышеописанных инструментов некоторые из них уже могут оказаться в нужном нам состоянии.

1. Запишите в переменную среды **JAVA\_HOME** путь, который ведет к установленному Java JDK. В нашем случае это `– C:\Program Files\Java\jdk1.7.0_45`

2. Запишите в переменную **ANDROID\_SDK\_ROOT** полный путь к папке Android SDK. Например, в нашем случае пакет разработчика Android был распакован в папку `D:\android\`, в результате в эту переменную был записан путь `D:\android\adt-bundle-windows-x86-20131030\sdk`

3. В переменную **NDK\_ROOT** нужно записать полный путь к папке, в которой располагаются файлы NDK. В нашем случае – это папка `D:\android\android-ndk-r9b`.

4. Переменную **Path** нужно привести к состоянию, в котором она содержит следующие пути:

– путь к папке JDK;

– путь к папке bin JDK;

– путь к папке NDK;

– путь к папке bin Cygwin;

– путь к папке bin ANT;

– путь к папке tools Android SDK;

– путь к папке platform-tools Android SDK.

Эти пути должны быть разделены знаком точки с запятой (;). В нашем случае содержимое этой переменной выглядит так:

```

D:\cygwin64\bin;C:\Program Files\Java\jdk1.7.0_40\bin;D:\android\adt-bundle-windows-x86_64-20131030\sdk\tools;D:\android\adt-bundle-windows-x86_64-20131030\sdk\platform-tools;%JAVA_HOME%\bin;%ANT_HOME%\bin

```

Обратите внимание на то, что в конце пути к нужной папке не должно быть специальных символов, вроде «/» или «’».

FMOD

----

FMOD – это коммерческая библиотека для работы со звуком. Это – набор инструментов, который работает в разных ОС и позволяет воспроизводить звуковые файлы различных форматов. Его используют при реализации звуковой составляющей игр и мультимедийных приложений.

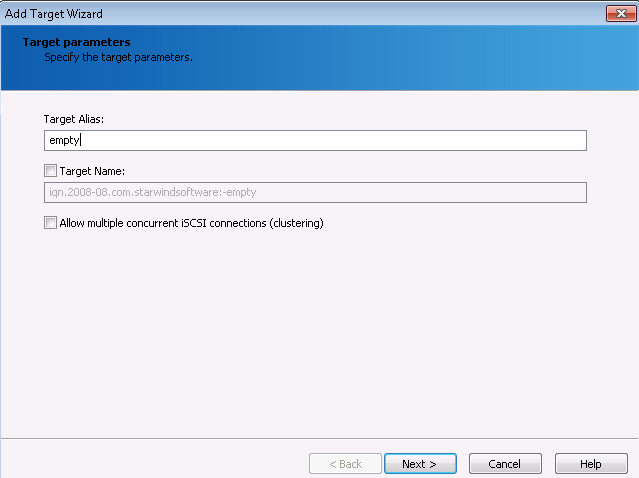

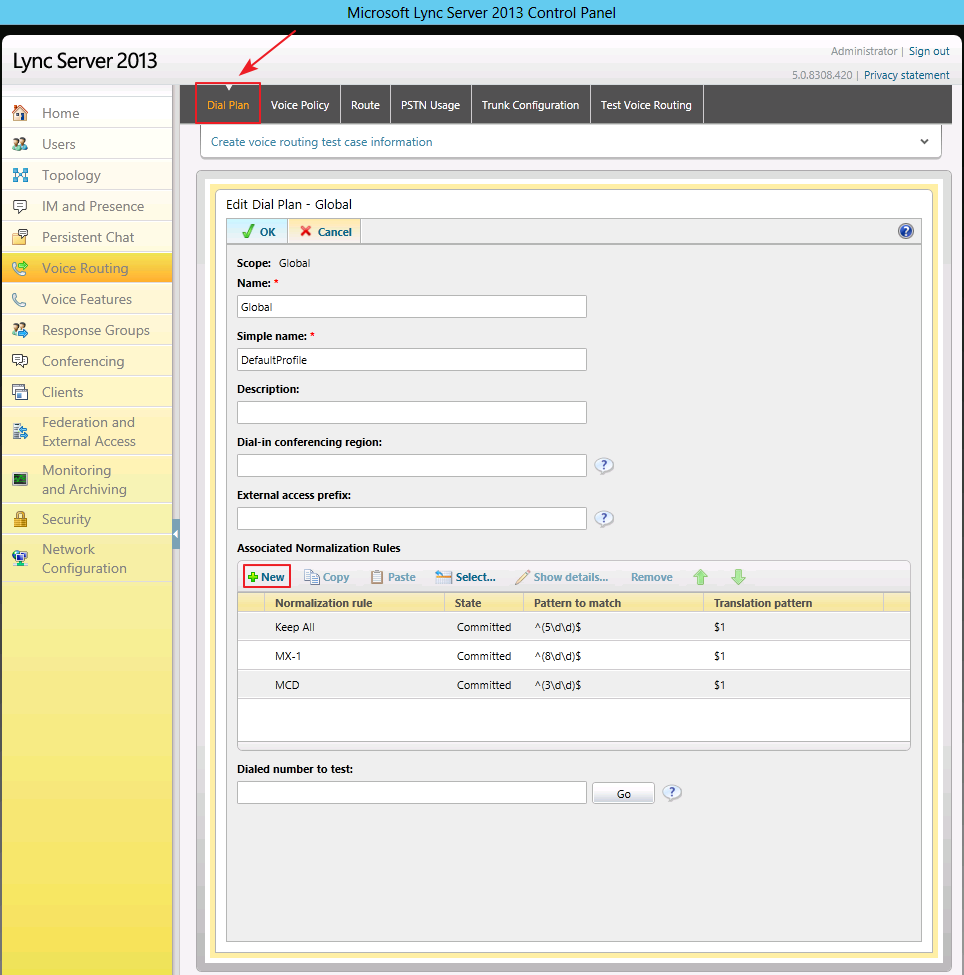

Ниже приведено пошаговое руководство по интеграции библиотеки FMOD в Android-приложение, рассчитанное на платформу x86 с использованием IDE Eclipse.

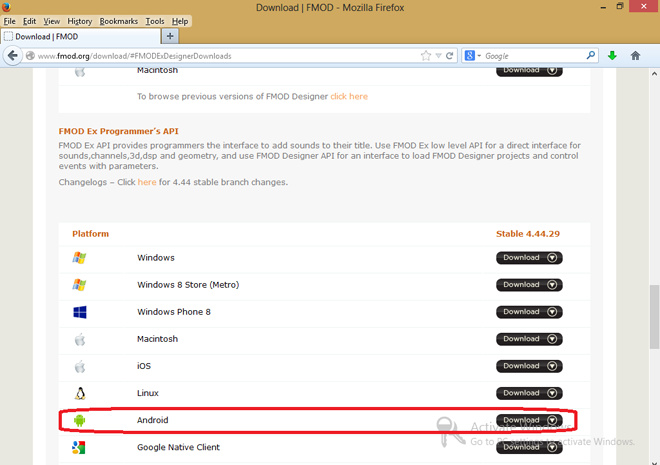

Для начала нужно [загрузить FMOD](http://www.fmod.org/download/). В частности, нас интересует Android-версия FMOD Ex Programmer’s API.

*Загрузка FMOD Ex*

Установка FMOD заключается в распаковке загруженного архива в локальную папку компьютера разработчика.

Сборка с помощью средств Android NDK

------------------------------------

Для того чтобы работать со звуком посредством API FMOD Ex, нужно включить соответствующую C/C++ библиотеку в приложение и обратиться к ней с использованием механизма jni.

Функциональность FMOD реализована в виде C/C++ библиотек, к которым можно обращаться через jni, с ними можно работать и из C/C++ компонентов разрабатываемого приложения.

* Библиотека **libfmodex.so** используется в готовых к выпуску приложениях.

* Библиотека **libfmodexL.so** – это та же библиотека с включённым отладочным выводом. Её можно использовать в ходе разработки приложения, при его отладке, для выявления и устранения ошибок.

Библиотеки FMOD Ex поставляются в виде armeabi и armeabi-v7a сборок для android-3 и в виде x86-сборки для android-9. Найти эти сборки можно по такому пути:

```

{$FMOD INSTALLED PATH}\api\lib\$(ABI)

```

«Родной» аудио-интерфейс Android OpenSL используется по умолчанию для воспроизведения аудио на устройствах, которые его поддерживают (android-9). На таких устройствах дополнительные файлы для работы не требуются. Для тех устройств, которые OpenSL не поддерживают, понадобится применять режим вывода звука Audio Track. Для этого понадобится jar-файл FMOD. Этот файл нужно добавить в Java-приложение для выполнения инициализации и вывода звука через FMOD.

```

fmodex.jar

```

Ниже мы это обсудим.

Обратит е внимание на то, что демонстрационное приложение, которое мы рассмотрим, является частью библиотеки. Его код мы сюда не включаем. Вместо этого здесь показана последовательность действий, необходимая для работы с FMOD, описаны изменения, которые нужно внести в файлы проекта приложения.

Инициализация Java-драйвера

---------------------------

Для того чтобы выводить звук с использованием метода Audio Track, в проект приложения нужно включить аудио-драйвер FMOD (реализованный на Java) и инициализировать его. Если используется режим вывода OpenSL, этого делать не нужно.

Для подключения драйвера нужно добавить файл `fmodex.jar` в проект и импортировать пакет `org.fmod.FMODAudioDevice`. Для работы Java-драйвера нужно, чтобы приложение загружало библиотеку `fmodex`.

В классе `FMODAudioDevice` есть две функции, `start ()` и `stop ()`, которые нужно вызывать для инициализации системы проигрывания звука и её отключения. Их можно вызывать в любое время и в любом месте, но мы рекомендуем поместить вызовы функций `start ()` и `stop ()` в переопределённые в вашем проекте методы жизненного цикла объекта класса `Activity onStart()` и `onStop()`.

Приложение-пример для Android-устройства, основанного на платформе x86

----------------------------------------------------------------------

Создание данного приложения – это то же самое, что сборка NDK-приложения для Android. Взглянем на пример, для которого мы будем использовать демонстрационное приложение, расположенное по следующему адресу:

```

{$FMOD INSTALLED PATH}\examples\playsound

```

Мы будем упоминать эту папку как {$PROJECT DIRECTORY}. Однако прежде чем мы займёмся сборкой, нам нужно выполнить некоторые изменения в демонстрационном приложении.

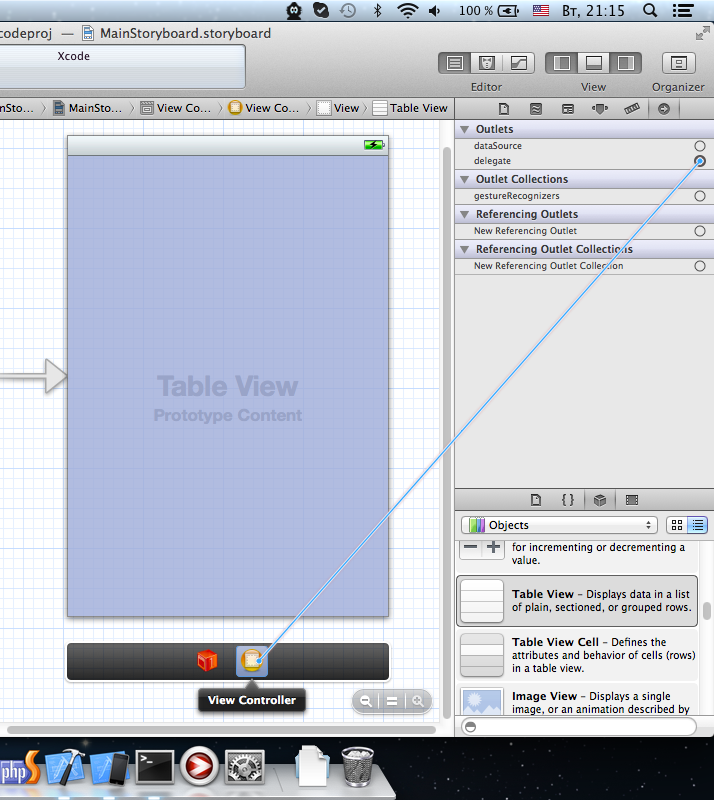

1. Перейдём в папку `{$PROJECT DIRECTORY}/jni` и откроем файл `Application.mk`.

2. Изменим этот код:

```

APP_ABI := armeabi armeabi-v7a

```

На этот:

```

APP_ABI := x86

```

Теперь откроем Cygwin и выполним следующие задачи для построения приложения:

1. Обновим переменную PATH в Cygwin:

```

export PATH=.:/cygdrive/{$PATH TO NDK}:$PATH

```

2. Перейдём в папку проекта:

```

cd /cygdrive/{$PROJECT DIRECTORY}

```

3. Выполним команду для построения приложения:

```

ndk-build

```

Проект будет собран и готов для развёртывания.

Обратите внимание на то, что здесь символы «\», которые используются в Windows при указании путей к папкам, заменены на символы «/», которые используются в путях формата GNU.

После успешной сборки проекта в окне Cygwin вы увидите следующие сообщения:

```

[x86] Prebuilt

: libfmodex.so <= jni/../../../api/lib/x86/

[x86] Install

: libfmodex.so => libs/x86/libfmodex.so

[x86] Cygwin

: Generating dependency file converter script

[x86] Compile

: main <= main.c

[x86] SharedLibrary

: libmain.so

[x86] Install

: libmain.so => libs/x86/libmain.so

```

Теперь, после успешного построения проекта, его можно импортировать в Eclipse и подготовить к запуску на Android-устройстве.

Подготовка и запуск приложения в IDE Eclipse

--------------------------------------------

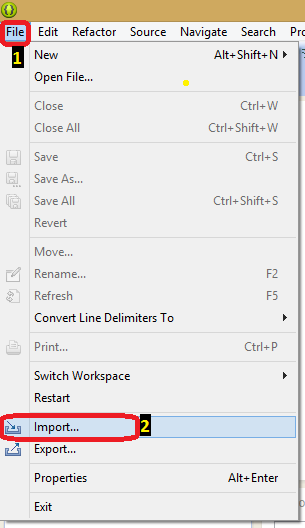

Для того чтобы подготовить приложение к запуску с использованием IDE Eclipse, нужно выполнить следующие шаги.

1. Запустите Eclipse и выполните команду File > Import

*Команда импорта в Eclipse*

2. Выберите параметр Existing Android… и нажмите кнопку Next.

*Выбор типа источника для импорта*

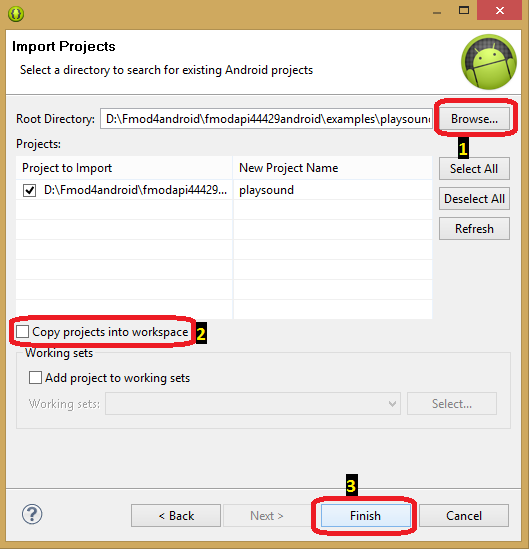

3. Перейдите в корневую папку проекта (т.е. в ту папку, что мы `называем {$PROJECT DIRECTORY}`), затем проверьте, чтобы флаг Copy projects… был снят и нажмите Finish.

*Завершение процесса импорта проекта*

4. На данном этапе вы заметите на импортированном проекте, в обозревателе проектов, красный восклицательный знак.

*Восклицательный знак в обозревателе проектов*

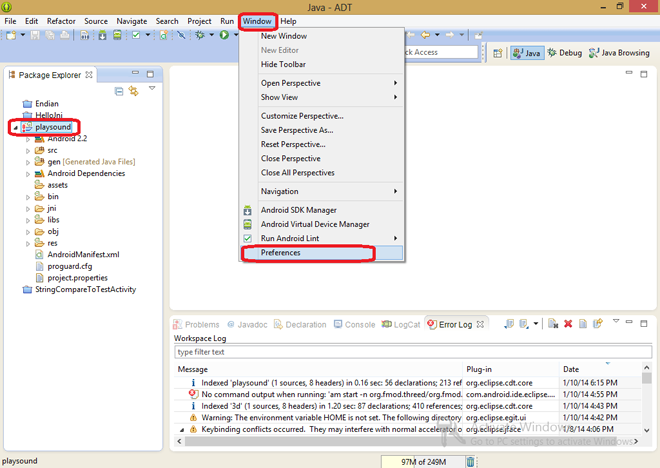

5. Для того чтобы решить проблему, на которую этот знак указывает, выполните команду Window > Preferences, вызвав окно настроек. В окне перейдите к набору настроек Classpath Variables.

*Окно настроек*

6. Щёлкните на странице Classpath Variables кнопку New…, появится окно для настройки новой переменной. Его нужно привести к виду, показанному на рисунке.

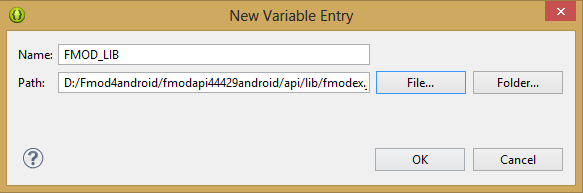

*Окно настройки параметров новой переменной*

7. В поле Name введите `FMOD_LIB`

8. Для заполнения поля Path нажмите на кнопку File и найдите следующий файл:

```

{$FMOD INSTALLED PATH}/api/lib/fmodex.jar

```

9. Нажмите ОК.

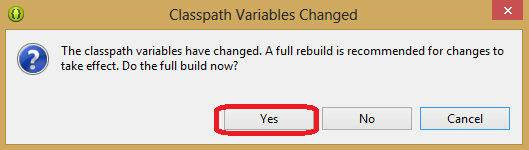

10. Затем снова нажмите ОК, появится окно, показанное ниже. Нажмите в нём кнопку Yes.

*Подтверждение полного перестроения проекта*

11. Теперь красный восклицательный знак исчезнет, проблема будет решена.

12. Выполните команду Project > Properties.

*Выполнение команды для доступа к свойствам проекта*

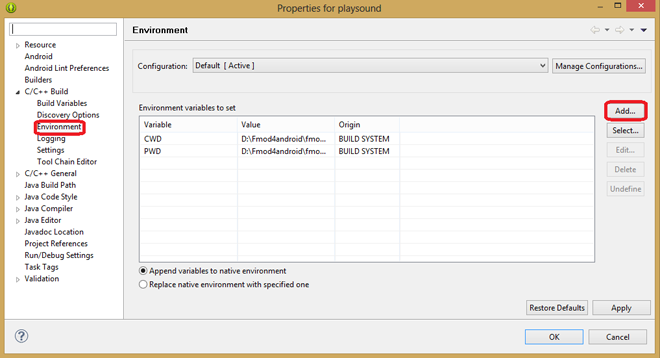

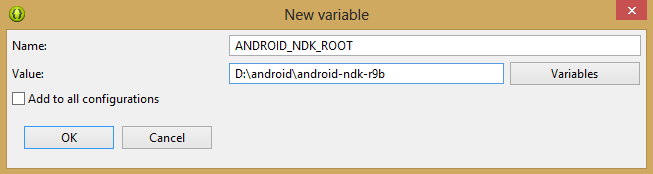

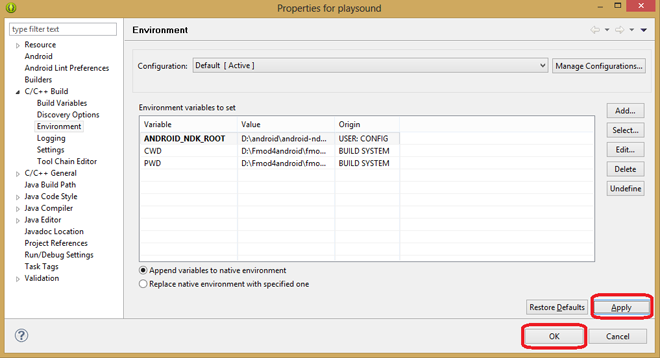

13. В появившемся окне, в разделе C/C++ Build > Environment, нажмите на кнопку Add.

*Окно настройки рабочего окружения*

14. В появившемся окне, в поле Name, введите ANDROID\_NDK\_ROOT, в поле Value – полный путь к установленному на компьютере NDK и нажмите ОК.

*Настройка переменной, указывающей на NDK*

15. Теперь нажмите на кнопку Apply, после чего – на кнопку OK.

*Сохранение сведений о пути к NDK*

Теперь можно запустить приложение на Android-устройстве. Для того чтобы всё работало как надо, сначала на устройство нужно скопировать, в папку `fmod`, которая должна располагаться в корневом каталоге SD-карты, два набора демонстрационных файлов:

```

{$FMOD INSTALLED PATH}\examples\media\*

{$FMOD INSTALLED PATH}\fmoddesignerapi\examples\media\*

```

Обратите внимание на то, что на Android-эмуляторе это приложение может не запуститься.

Настройки, специфические для платформы x86

------------------------------------------

При сборке приложения, рассчитанного на платформу x86, очень важно внести в проект следующее изменение. Обратите внимание на то, что это делается до начала построения библиотеки.

* Нужно перейти в директорию `{$PROJECT DIRECTORY}\jni` и открыть файл Application.mk (или создать такой файл, если его в этой директории нет).

* В указанном файле нужно заменить код

```

APP_ABI := armeabi armeabi-v7a

```

на

```

APP_ABI := x86

```

Материалы, которые получаются после построения

----------------------------------------------

Материалы, получаемые при сборке, размещаются в папке `{$PROJECT DIRECTORY}\`. А именно, библиотеки `libmain.so` и `libfmodex.so` окажутся в папке `{$PROJECT DIRECTORY}\libs\x86`. Сгенерированные объектные файлы попадают в папку `{$PROJECT DIRECTORY}\obj`.

Известные ошибки и проблемы

---------------------------

Если в ходе построения проекта с использованием NDK появляются сообщения об ошибках, нужно настроить разрешение доступа к файлам. А именно, изменить разрешение на «Полный доступ» («Full Control») для группы «Все» («Everyone»).

Кроме того, обратите внимание на то, что приложение, которое использует рассматриваемые библиотеки, может не запуститься в эмуляторе. Учтите и то, что для его нормальной работы на физическом устройстве нужно скопировать файлы из папок `{$FMOD INSTALLED PATH}\examples\media\*` и `{$FMOD INSTALLED PATH}\fmoddesignerapi\examples\media\` в папку `fmod`, которая должна быть расположена в корневой директории SD-карты устройства.

Fmod Studio API, работа в Android Studio

----------------------------------------

Fmod, помимо библиотеки Fmod Ex, предлагает продукт Fmod Studio, предназначенный для подготовки звука для компьютерных игр, и соответствующую библиотеку для различных платформ, которая позволяет работать с проектами Fmod Studio. Всё это можно загрузить [отсюда](http://www.fmod.org/download/#Studio).

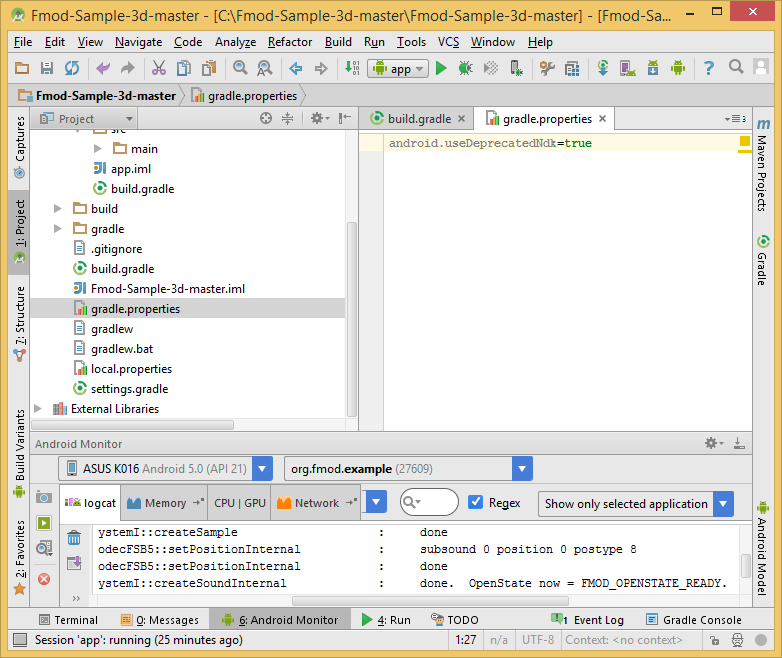

Для того чтобы быстро получить работающий пример использования Fmod Studio API на Android, вы можете воспользоваться проектом с GitHub [Fmod Sample 3D](https://github.com/WillCoder/Fmod-Sample-3d). В частности, в проекте присутствует библиотека, рассчитанная на архитектуру x86. Его можно импортировать в вашу IDE, например — в Android Studio. Если при импорте возникнет ошибка `NDK integration is deprecated…`, для её исправления в корневой папке проекта нужно создать файл `gradle.properties` и записать в него строку `android.useDeprecatedNdk=true`.

*Запуск демонстрационного приложения на Asus FonePad 8*

Многие примеры использования сторонних библиотек в Android-проектах, которые, в частности, можно обнаружить на GitHub, созданы с использованием IDE Eclipse. Их можно импортировать и в Android Studio, однако, в ходе импорта могут возникнуть ошибки.

Например, если системе не удаётся обнаружить NDK – вероятнее всего, неверно указан путь к нему в настройках проекта. Проверить это можно в файле `local.properties`, в корневой директории проекта. Исправить – записав верный путь в переменную `ndk.dir`.

Если Eclipse-проект содержит ссылки на внешние файлы, которые в вашей копии импортированного проекта неактуальны, Android Studio может отказаться импортировать проект до исправления таких ссылок. Для успешного импорта проекта нужно найти файлы (например – `project.properties`), содержащие такие ссылки (например, вида «`android.library.reference.1=`») и исправить их на те, которые актуальны для вашего окружения.

Cocos2d-x

---------

Рассмотрим теперь процесс создания кросс-платформенного Android-приложения с использованием игрового движка Cocos2d-x для целевой платформы x86.

Приложение-пример, которое используется в этом руководстве, является частью материалов, доступных при загрузке Cocos2d-x. Приложение можно найти в папке `\samples\Cpp\`, которая расположена, в нашем случае, в директории `cocos2d-x-2.1.1`.

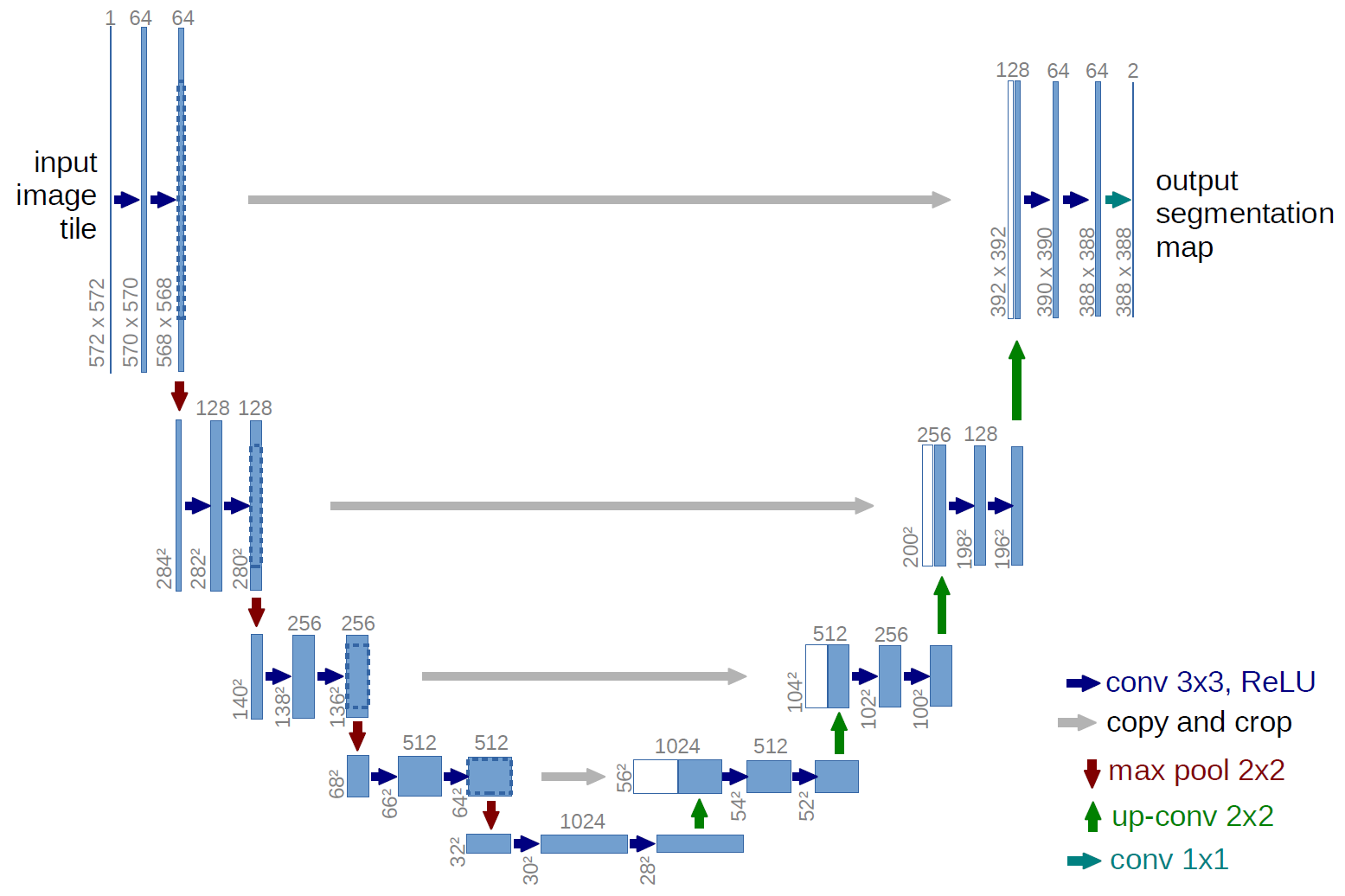

[Cocos2d-x](http://discuss.cocos2d-x.org/) – это библиотека, написанная на C++ и портированная на множество платформ. Среди них – iOS, Android, Windows, Marmalade, Linux, Bada и Blackberry 10. В качестве скриптовых языков при работе с игровым движком используются Lua и JavaScript. Подробности о движке можно найти в [документации](http://www.cocos2d-x.org/learn) к нему.

Прежде чем приступать к работе с Cocos2D-x, вам нужно подготовить всё необходимое – так, как описано в начале этого материала.

Загрузка Cocos2d-x

------------------

Загрузите свежую версию [Cocos2d-x](http://www.cocos2d-x.org/download). Обратите внимание на то, что нам нужна обычная, а не html-5 версия движка.

Установка и настройка Cocos2d-x

-------------------------------

1. Распакуйте архив, загруженный на предыдущем шаге, на диск. В нашем случае архив извлечён в папку `D:\Cocos2d-x`.

2. После распаковки архива, для описываемой версии движка, в целевой папке будут находиться директории `D:\Cocos2d-x\__MACOSX` и `D:\Cocos2d-x\cocos2d-x-2.2.1`.

3. Настройте переменную среды для Cocos2d-x следующим образом:

**COCOS2DX\_ROOT** = полный путь к папке `cocos2d-x-2.2.1`, в нашем случае это: `D:\Cocos2d-x\cocos2d-x-2.2.1.`

Прежде чем мы продолжим, обратите внимание на несколько переменных, указывающих на пути к различным папкам. Мы будем пользоваться ими ниже:

* `{$ADT PATH}` = полный путь к Android ADT, в нашем случае это: `D:\android\adt-bundle-windows-x86_64-20131030.`

* `{$ECLIPSE PATH}` = полный путь к Eclipse. В нашем случае, так как Eclipse входит в состав ADT, путь будет выглядеть как: `{$ADT PATH}\eclipse`

* `{$COCOS2D-X PATH}` = полный путь к папке cocos2d-x-2.2.1, в нашем случае это: `D:\Cocos2d-x\cocos2d-x-2.2.1.`

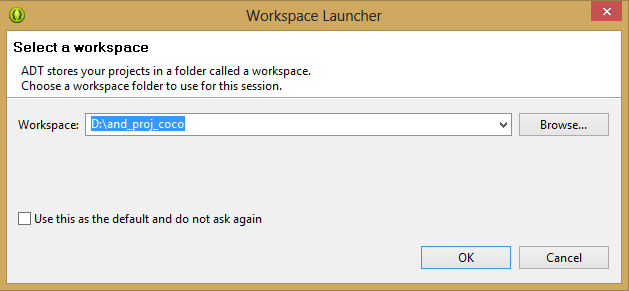

* `{$WORKSPACE PATH}` = полный путь к папке рабочего пространства Android-проекта Eclipse. У нас это: `D:\and_proj_coco`.

Настройка проекта Cocos2d-x в IDE Eclipse

-----------------------------------------

1. Запустите Eclipse, воспользовавшись исполняемым файлом `{$ECLIPSE PATH}\eclipse.exe`.

2. Создайте рабочее пространство. Мы создали его по адресу `{$WORKSPACE PATH}`, как показано на рисунке.

*Рабочее пространство Android-проекта*

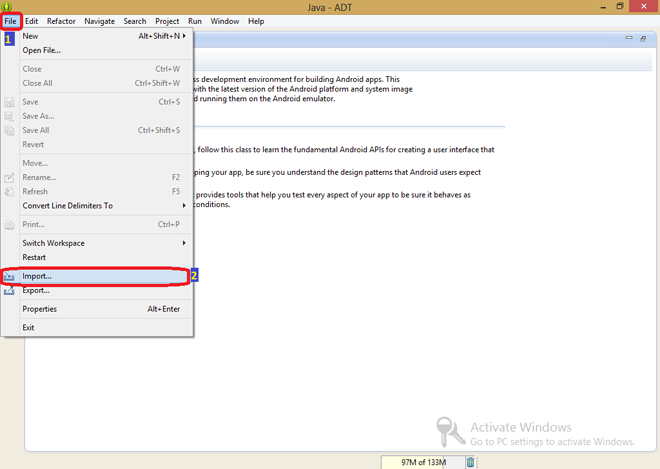

3. Выполните команду File > Import.

*Команда импорта*

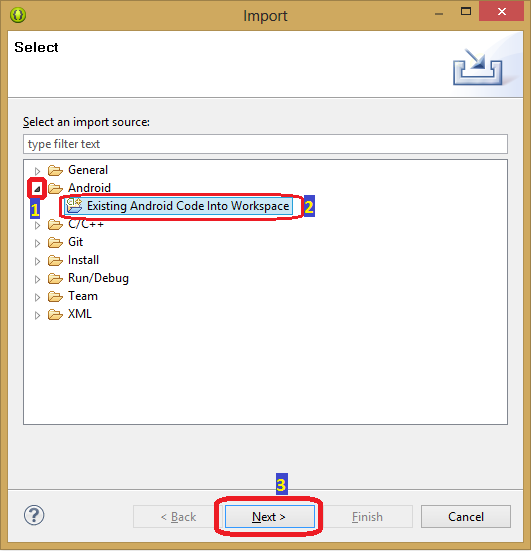

4. Появится окно, похожее на то, что приведено на рисунке.

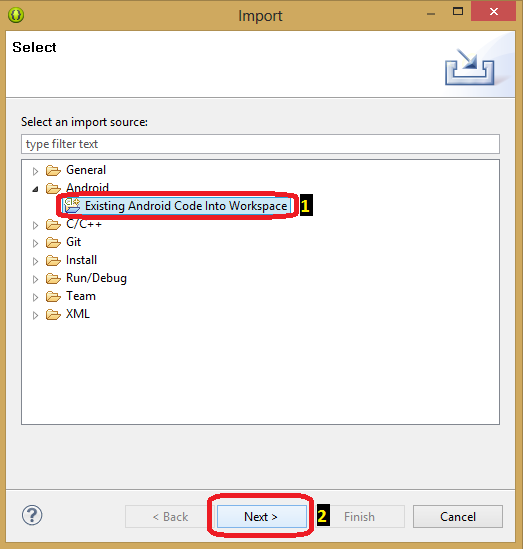

*Окно импорта*

5. Разверните раздел Android, выберите пункт Existing Android Code Into Workspace и нажмите кнопку Next.

6. В следующем окне нажмите на кнопку Browse, как показано ниже.

*Поиск корневой директории проекта для импорта*

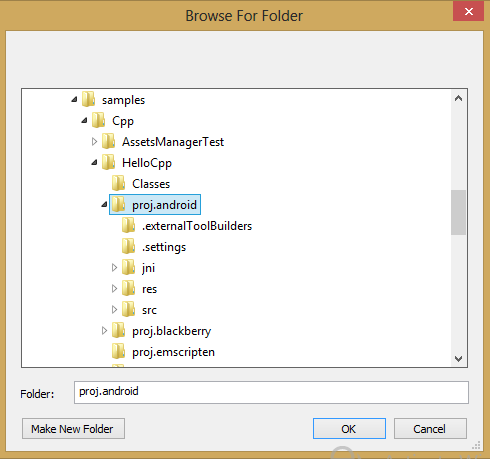

7. Найдите папку {$COCOS2D-X PATH}\samples\Cpp\HelloCpp\proj.android, как показано на рисунке, и нажмите OK.

*Выбор корневой директории проекта для импорта*

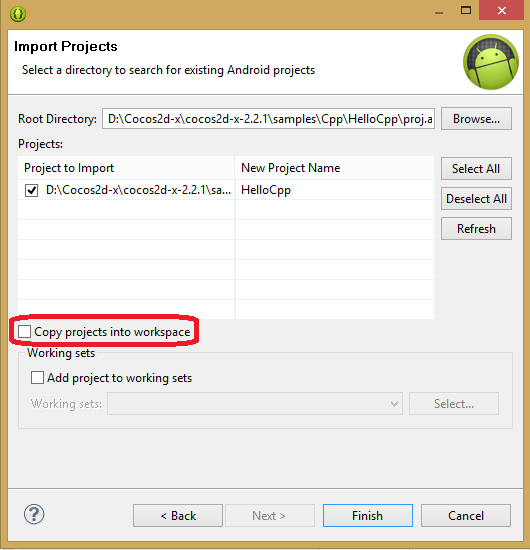

8. Для этого демонстрационного примера, прежде чем нажимать на кнопку Finish, проверьте, чтобы флаг Copy projects into workspace **не был установлен**.

*Флаг Copy projects into workspace должен быть сброшен*

9. После импорта в Eclipse могут появиться сообщения об ошибках. Пока на них можно не обращать внимания и переходить к следующим шагам.

Обратите внимание на то, что если в будущем вы решите оставить исходный код проекта в неприкосновенности и будете при этом уверены, что импорт кода проекта в рабочее пространство не повлияет на его исполнение, вышеописанный флаг Copy projects into workspace можно установить.

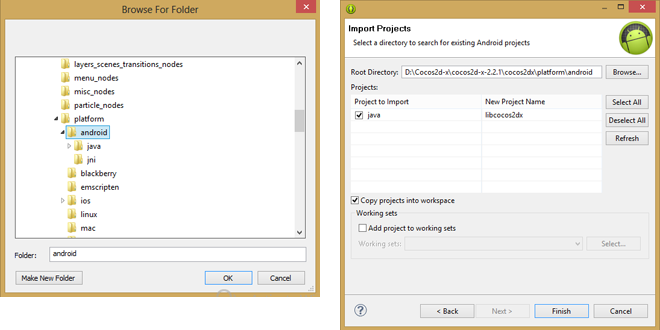

10. Теперь повторите шаги 3 – 8, с той разницей, что вместо импорта `{$COCOS2D-X PATH}\samples\Cpp\HelloCpp\proj.android`, нужно выполнить импорт `{$COCOS2D-X PATH}\cocos2dx\platform\android` как показано ниже. Если хотите, установите флаг Copy project into workspace.

*Импорт другого проекта*

11. Если сообщения об ошибках, которые возникли на шаге 8, не исчезли, выполните следующие шаги для решения проблем.

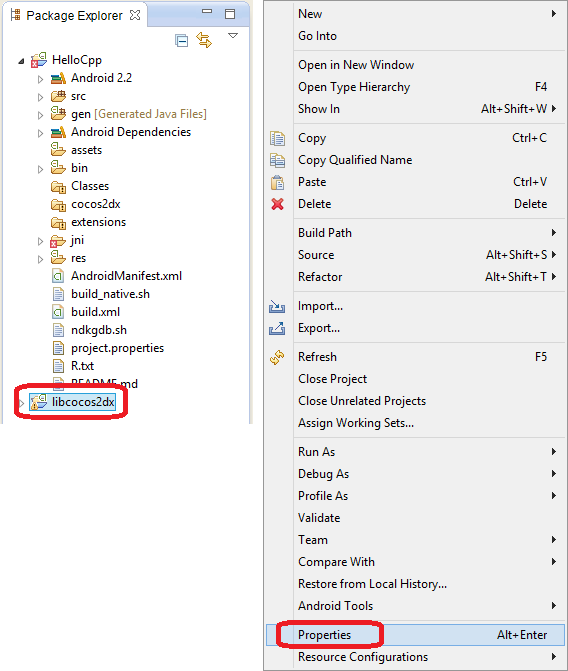

12. На закладке Package Explorer, слева, щёлкните правой кнопкой мыши libcocos2dx и в появившемся меню выберите пункт Properties.

*Команда для вызова окна свойств проекта*

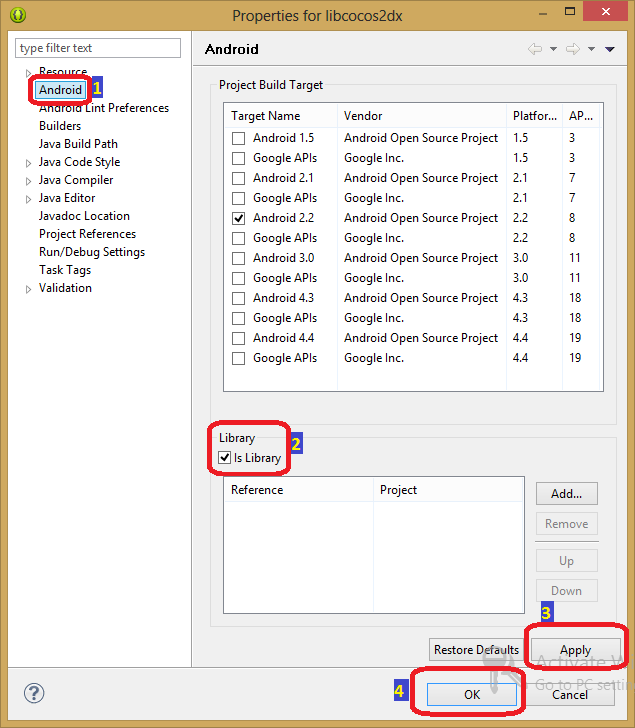

13. В появившемся окне выберите, в левой колонке, пункт Android и проверьте, установлен ли флаг Is Library, как показано на рисунке ниже. Если это не так, установите флаг, нажмите Apply и OK.

*Настройка параметров проекта*

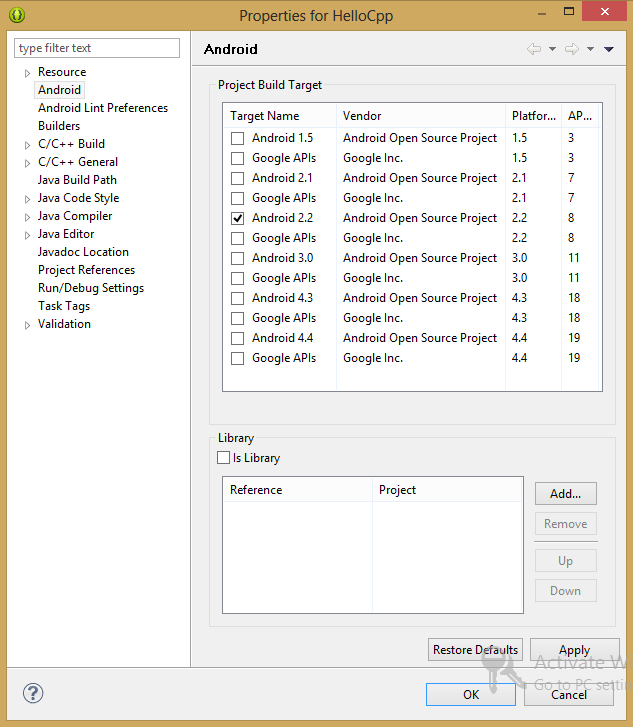

14. Так же, как было описано выше, откройте свойства проекта HelloCpp, добравшись до окна, показанного на рисунке.

*Окно свойств проекта HelloCpp*

15. Уберите из раздела Library всё, что отмечено красным крестиком и нажмите кнопку Add.

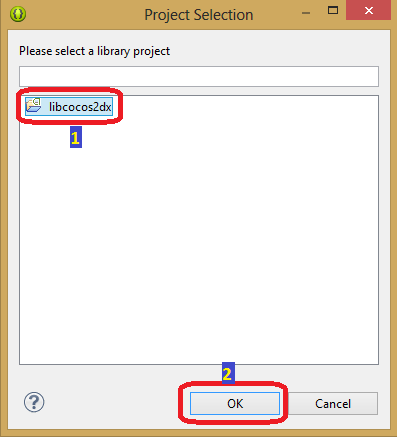

16. Выберите libcocos2dx и нажмите OK.

*Выбор проекта libcocos2dx*

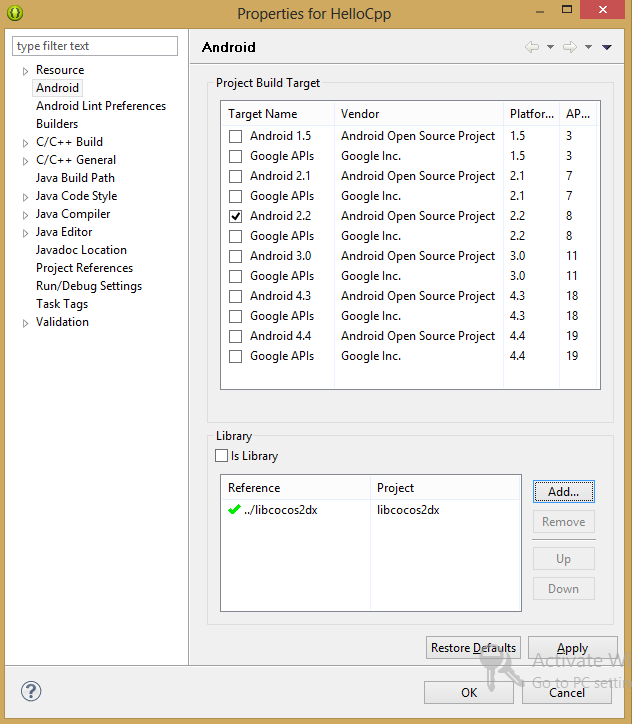

17. Теперь вы увидите, что в разделе Library появилось название проекта с зелёной галочкой. После этого можно нажать кнопку Apply, и затем – OK.

*Завершение настройки проекта HelloCpp*

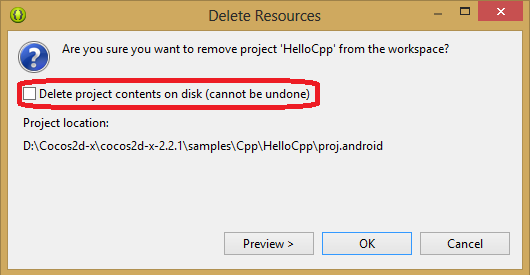

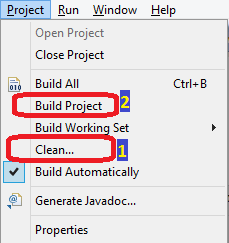

18. На данном этапе Eclipse выполнит перестроение проекта. Если сообщений об ошибках не появилось, пропустите этот шаг. Если нет – удалите проект HelloCpp из панели Package Explorer. При этом обратите внимание на то, чтобы флаг Delete project contents on disk**… не был установлен**. Если он будет установлен, данное действие нельзя будет отменить. Теперь снова выполните шаги 3 – 8 и 13 – 16.

*Удаление проекта из панели Project Explorer*

19. Теперь ваш проект должен выглядеть примерно так, как показано на рисунке.

*Проект, готовый к дальнейшей работе*

Если вы успешно добрались до этого места – примите поздравления! Проект успешно открыт в IDE Eclipse, всё готово к его сборке.

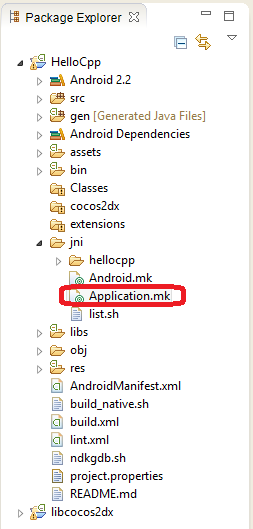

Построение проекта Cocos2d-x в IDE Eclipse

------------------------------------------

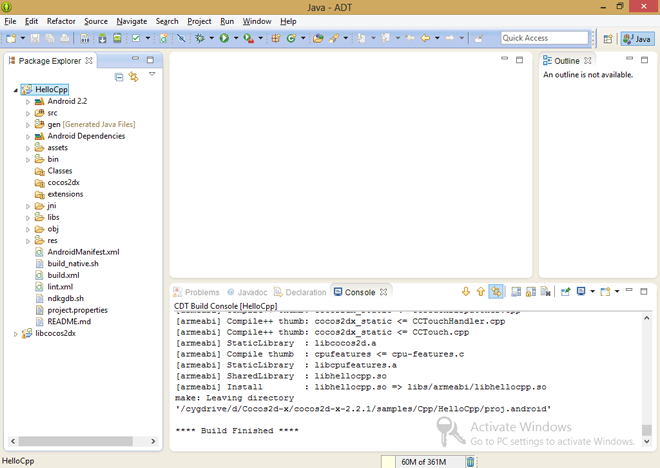

1. На закладке Package Explorer найдите файл HelloCpp > jni > Application.mk

*Файл Application.mk*