text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4 values | source stringclasses 4 values |

|---|---|---|---|---|

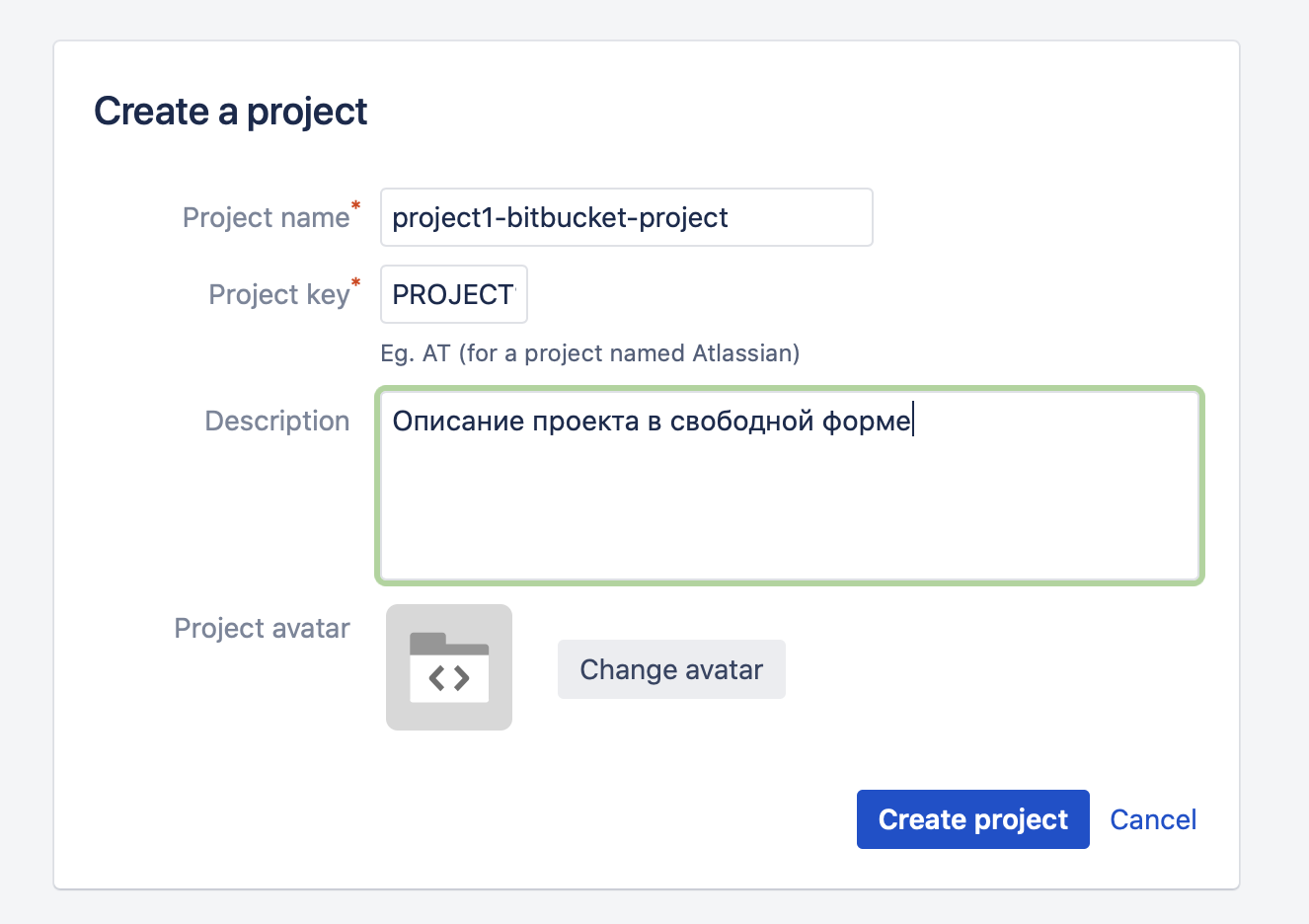

# Рисуем кодом в Swift, PaintCode

Пока в соседней комнате готовят оливье, я пишу небольшой туториал как рисовать кодом. Сразу представляются строчки кода с дробными числами, где ведём линию по точкам. А для вычисления радиуса окружности берём яд змеи, *надежность* хранения фото в iCloud и шепчем заклинание. Пугает, понимаю. Даже в [ролике на YouTube](https://youtu.be/ID5JvGbXXTY) вставил шутку:

— “*Ааастановите, пожалуйста, вот у магазина*” — прокричал герой российского сериала.

В целом, дорогой друг, ты прав. Будут и дробные числа, и куча строчек кода. Но будет намного проще. Интересно? Давай к делу.

Для работы потребуется утилита *PaintCode*. Откроем приложение, и увидим интерфейс, похожий на Sketch:

Мне эта преемственность нравится.

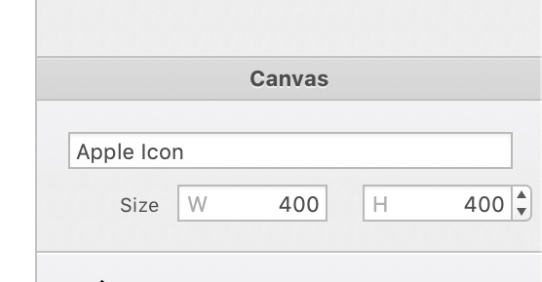

Для начала выставим размеры холста. Рекомендую использовать значение от 100 до 1000 пикселей. Больше ставить смысла нет, а поставив меньше 100 пикселей, можно получить большую дробную часть, и как результат — фризы при отрисовке. Мы установим 400x400 пикселей и назовем холст *Apple Icon*:

Названия для холстов рекомендую использовать корректные, в конце туториала станет понятно зачем. А вот для слоев названия не важны, их можно игнорировать.

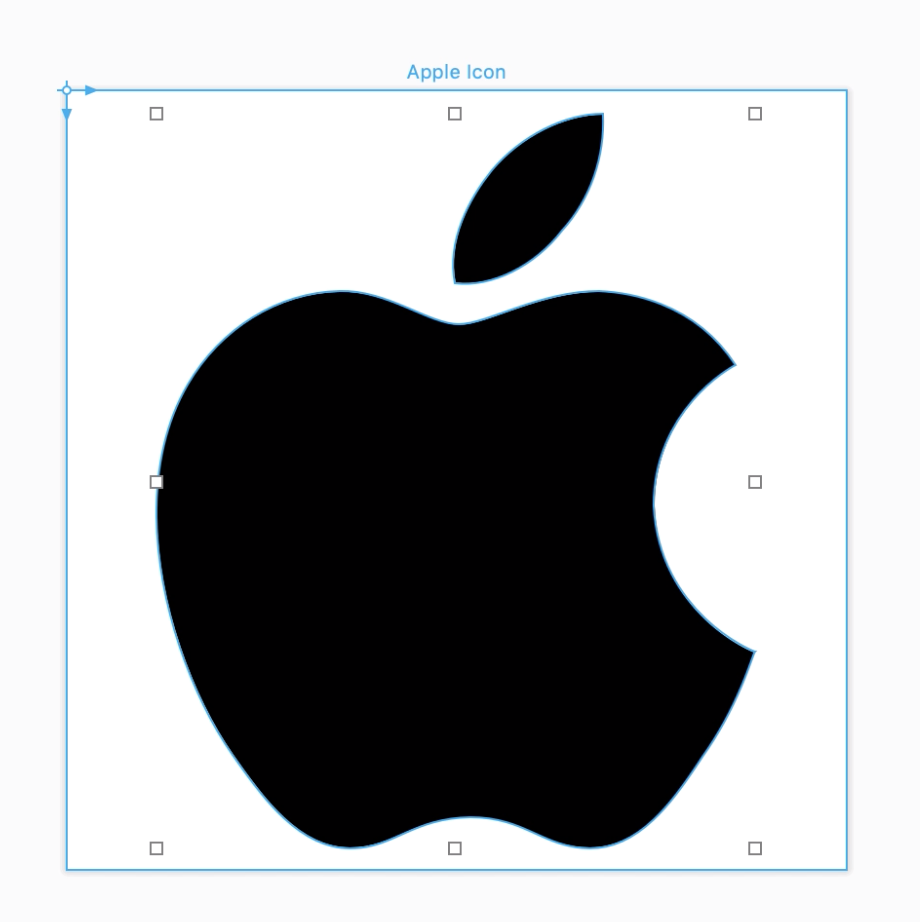

Добавим иконку на холст, выставим размер и разместим по центру. Получится должно так:

Иконку для экспериментов можно взять любую, главное — не растровую. Если вас устроит такой результат, то можно экспортировать и переходить в Xcode.

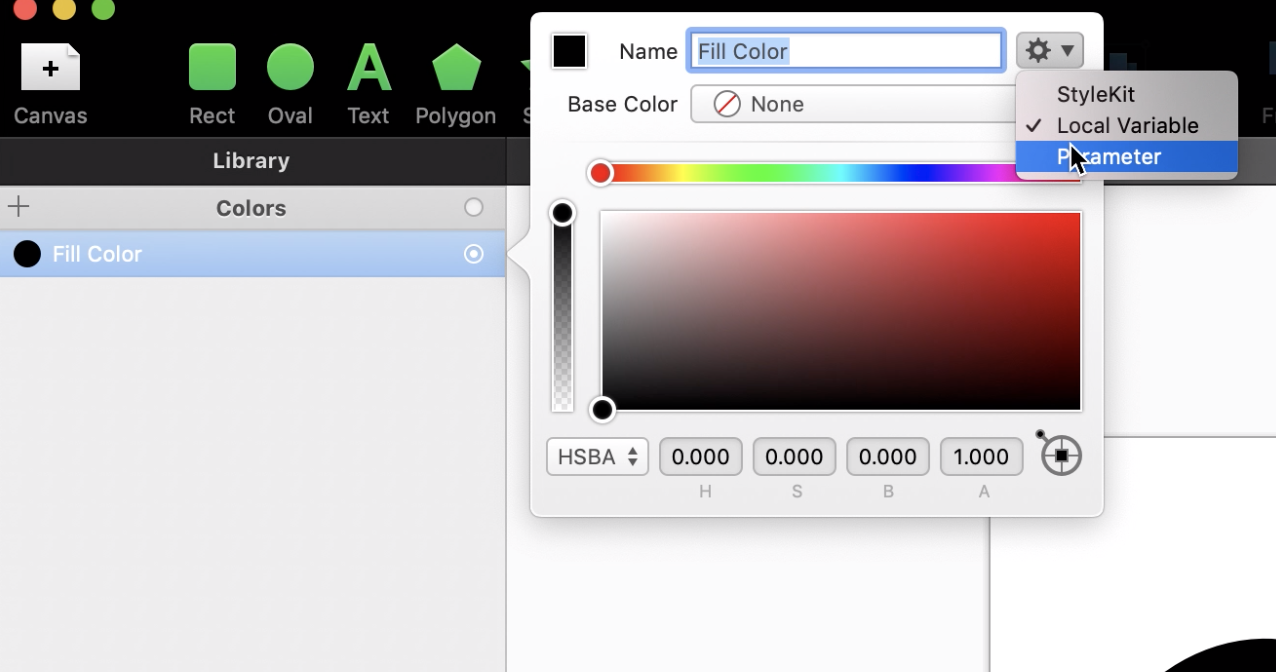

Но я покажу полезную фичу. Сейчас иконка черная, а вы хотите иметь возможность менять цвет. Для этого посмотрим в левый верхний угол, и увидим все цвета, которые получены из объекта. Переименуем цвет в *IconColor* и установим режим *Parameter*.

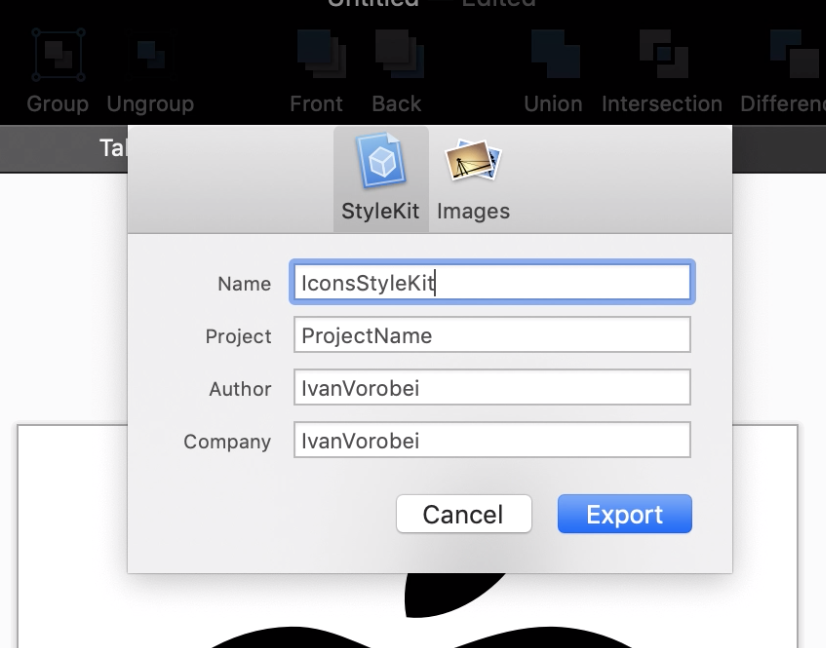

Это всё. Остается экспортировать сгенерированный код. Справа вверху вы найдете кнопку *Export*. Заполните имя и другие поля по желанию и сохраните файл:

### Перейдем в Xcode

Импортируем в проект файл, который экспортировали из *PaintCode*. Для любопытства можно пролистать его, но интересного мало.

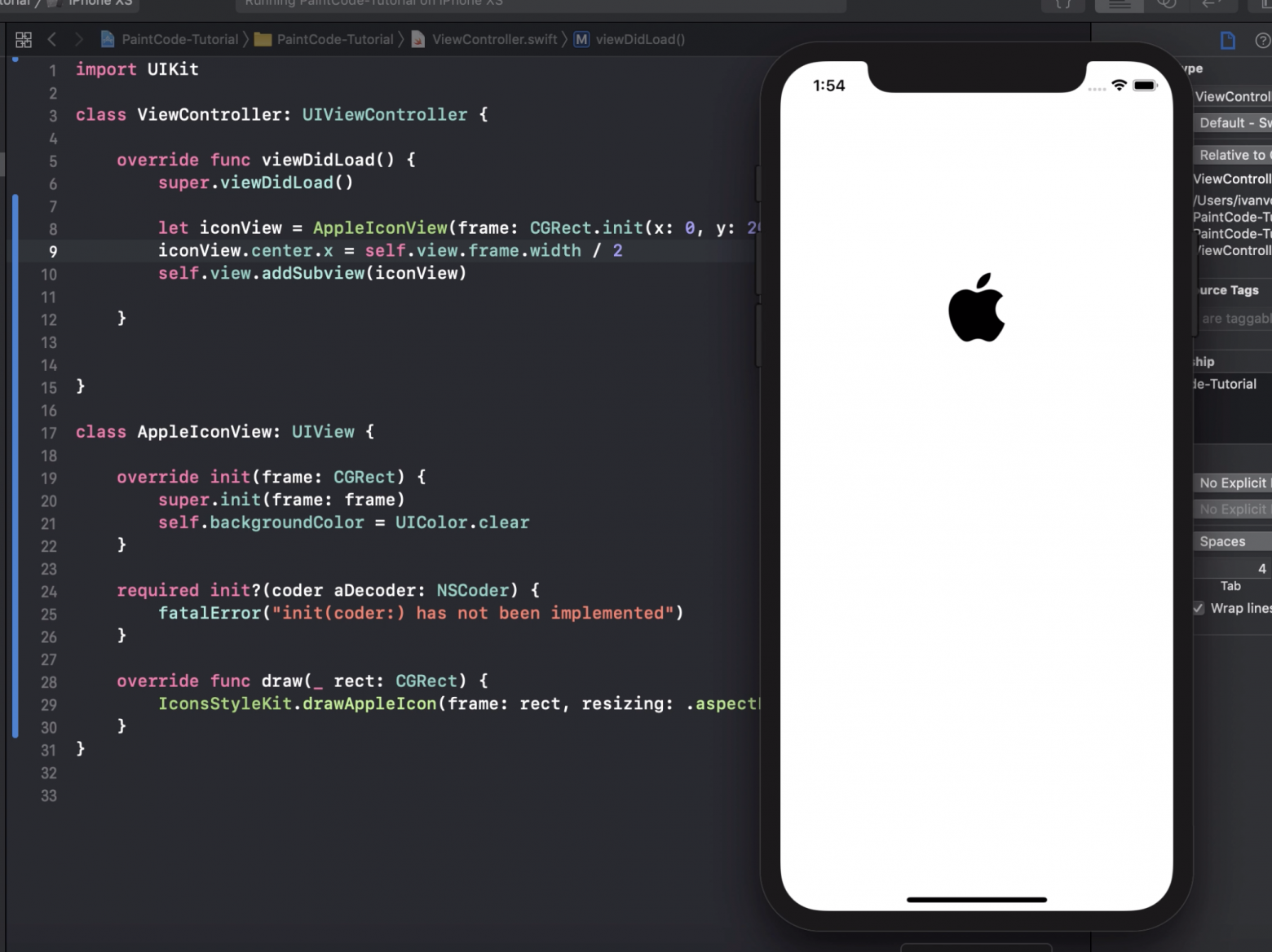

В Xcode создаем класс *ApppleIconView*, наследуемая от *UIView*. Так же переопределим метод *draw*:

```

class AppleIconView: UIView {

override func draw(_ rect: CGRect) {

IconStyleKit.drawAppleIcon(

frame: rect,

resizing: .aspectFit,

iconColor: UIColor.black

)

}

}

```

*IconStyleKit* — имя, указанное при экспорте. *drawAppleIcon* — сгенерированное имя метода, на основе названия холста. А *iconColor* — цвет, который теперь задается как параметр. Как видите, удобные методы сгенерировал *PaintCode*.

Так же необходимо у *AppleIconView* установить прозрачный цвет фона. Не забудьте это сделать.

Добавим объект *AppleIconView*:

```

class Controller: UIViewController {

override func viewDidLoad() {

super.viewDidLoad()

let iconView = AppleIconView(

frame: CGRect.init(

x: 0, y: 200,

width: 70,

height: 70)

)

iconView.center.x = self.view.frame.width / 2

self.view.addSubview(iconView)

}

}

```

Остается запустить проект. Если всё сделано верно, вы увидите логотип, отрисованный кодом:

### Необъективное мнение автора

В основном я использую PDF в своих iOS приложениях. Зачем использовать *PaintCode*? Просто так — смысла нет. Но если у вас одна и та же иконка должна иметь несколько цветов — *PaintCode* выручает (если иконка одноцветная, вы можете использовать проперти *tintColor*). Так же отрисованные элементы проще анимировать.

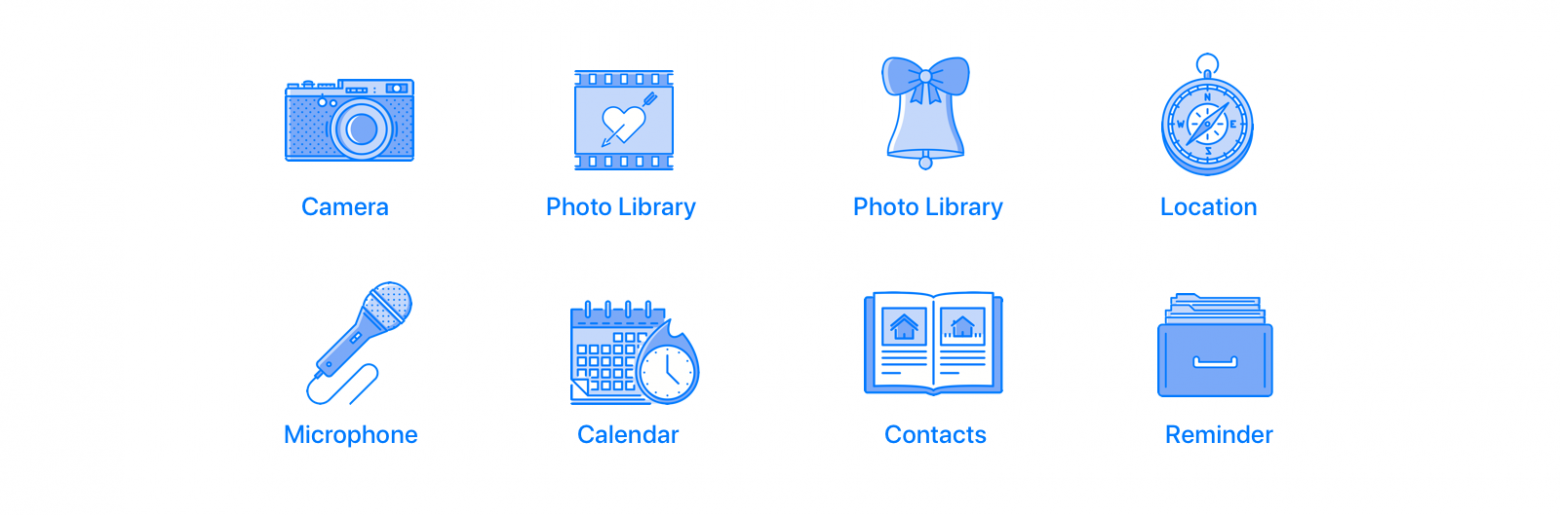

Пример практического применения — моя [библиотека SPPermission](https://github.com/IvanVorobei/SPPermission):

Для каждого разрешения я использую иконку, отрисованную про помощи *PaintCode*. Схему их 3-ёх цветов можно изменить прямо в коде.

Для тех, кому приятнее смотреть ролики, ещё раз сделаю отсылку к [туториал на YouTube](https://youtu.be/ID5JvGbXXTY):

С наступающим!

У меня появился [канал в телеге](https://t.me/+NjnQUtK6zGM3ZjU6), подписывайтесь. | https://habr.com/ru/post/434892/ | null | ru | null |

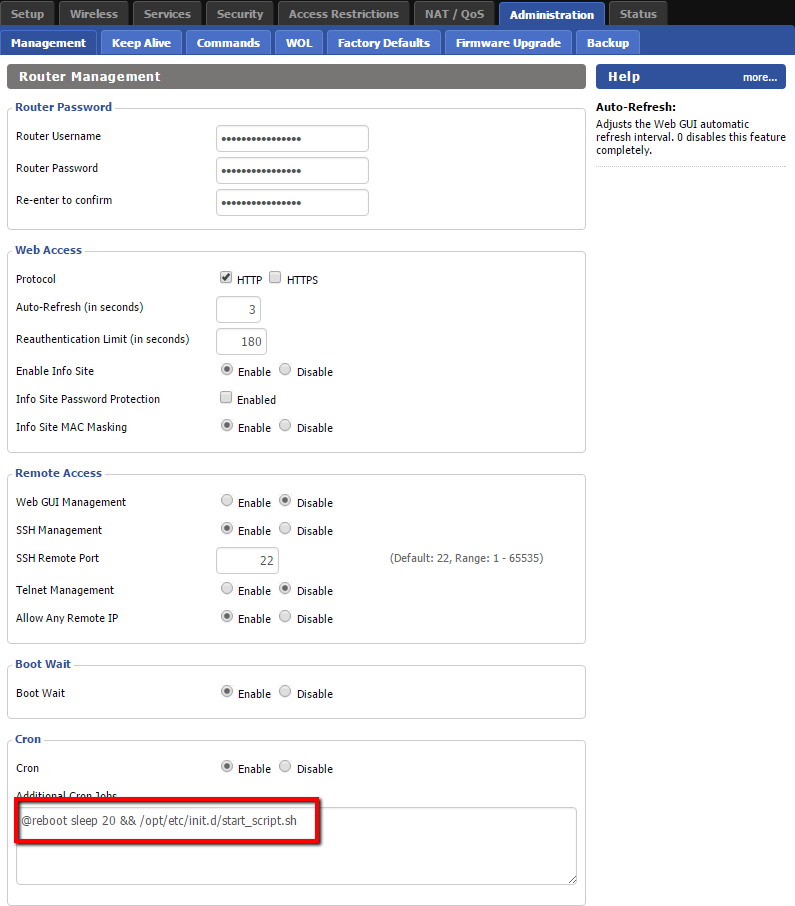

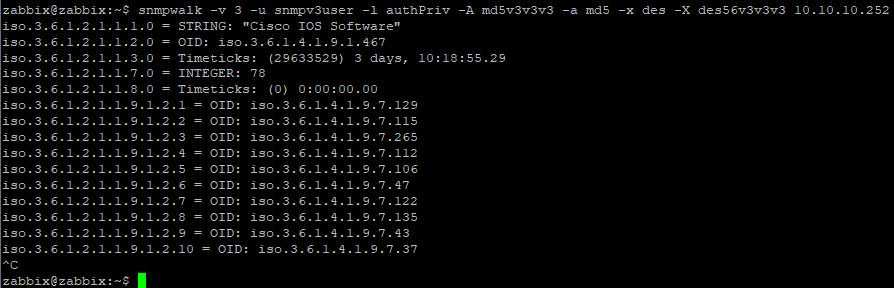

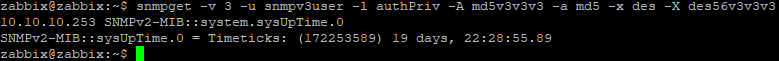

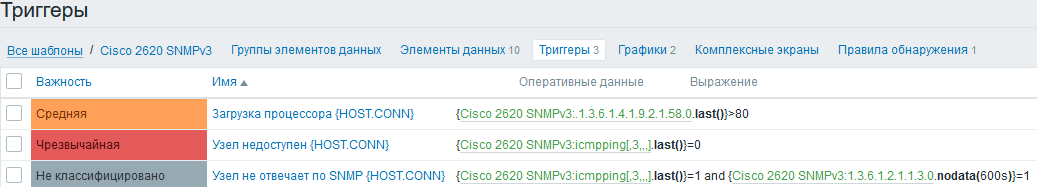

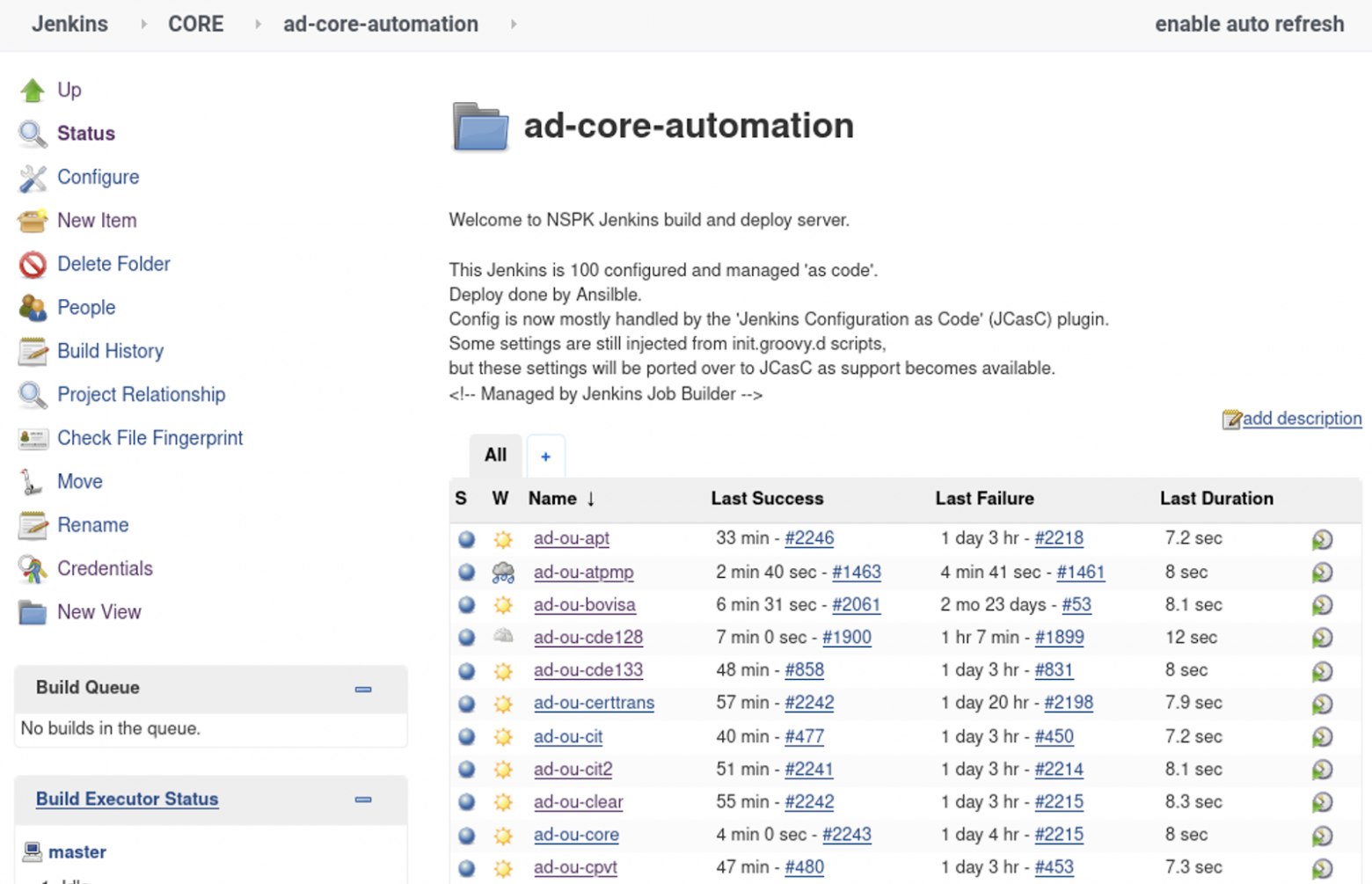

# snmp-мониторинг принтеров в The Dude

Snmp

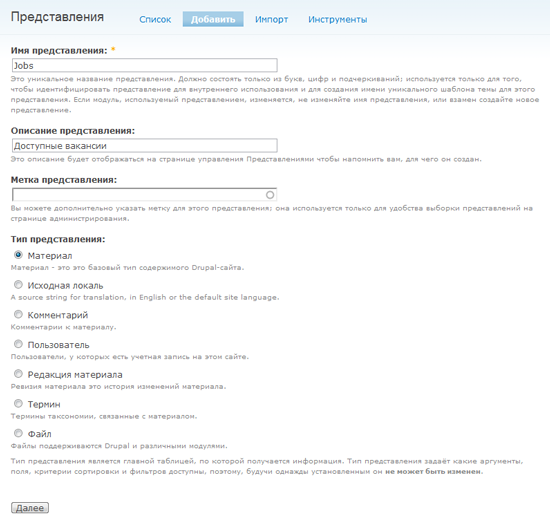

----

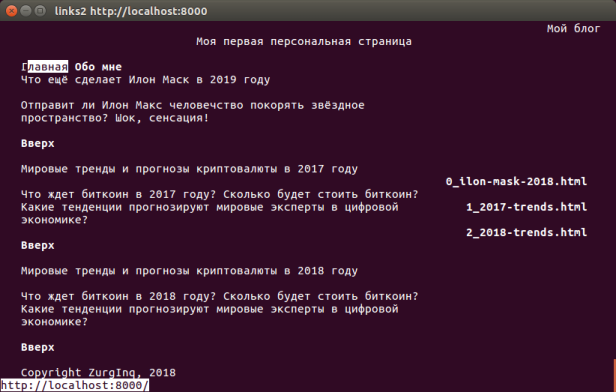

В сети много инструкций как установить сервер мониторинга The Dude от Mikrotik. Сейчас пакет сервера мониторинга выпускают только для RouterOS. Я использовал версию 4.0 для Windows.

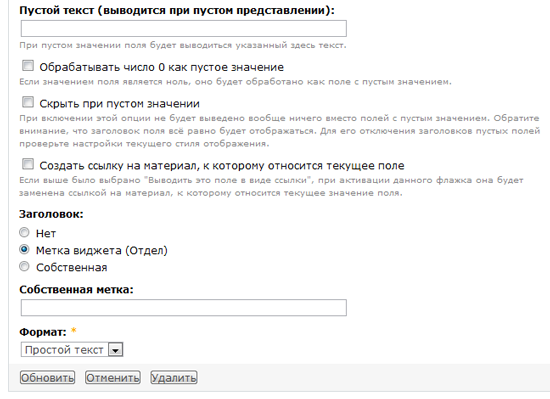

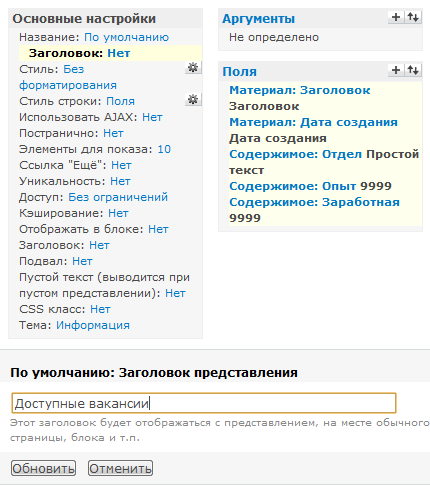

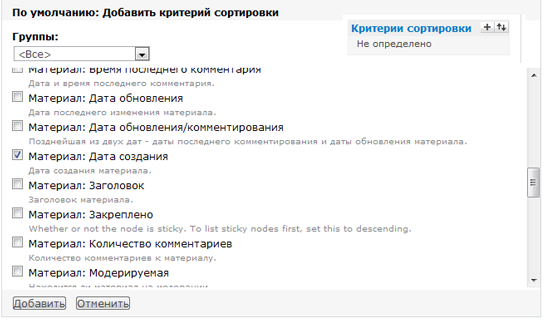

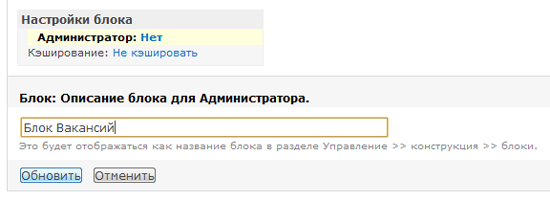

Здесь я хотел рассмотреть, как сделать мониторинг принтеров в сети: отслеживать уровень тонера, если он закончился вывести уведомление. Запускаем:

Нажимаем подключиться:

Нажимаем добавить устройство(красный плюс) и вводим ip-адрес принтера:

На следующем шаге нажимаем обнаружение, он находит все доступные зонды, нажимаем закончить:

Два раза нажимаем по появившемуся значку, открываются настройки, тип выбираем «принтер», и нажимаем «ок»:

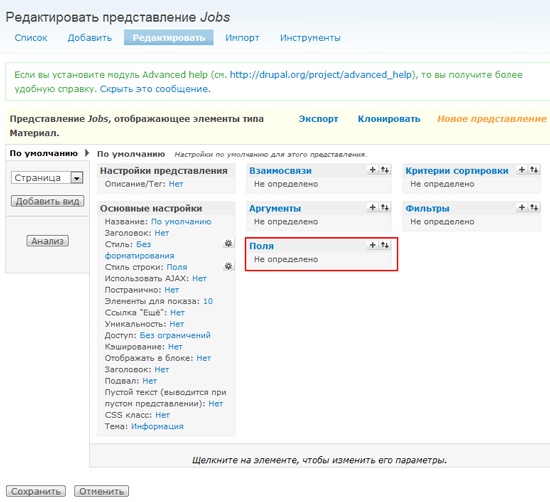

Правой кнопкой нажимаем по значку и выбираем вид:

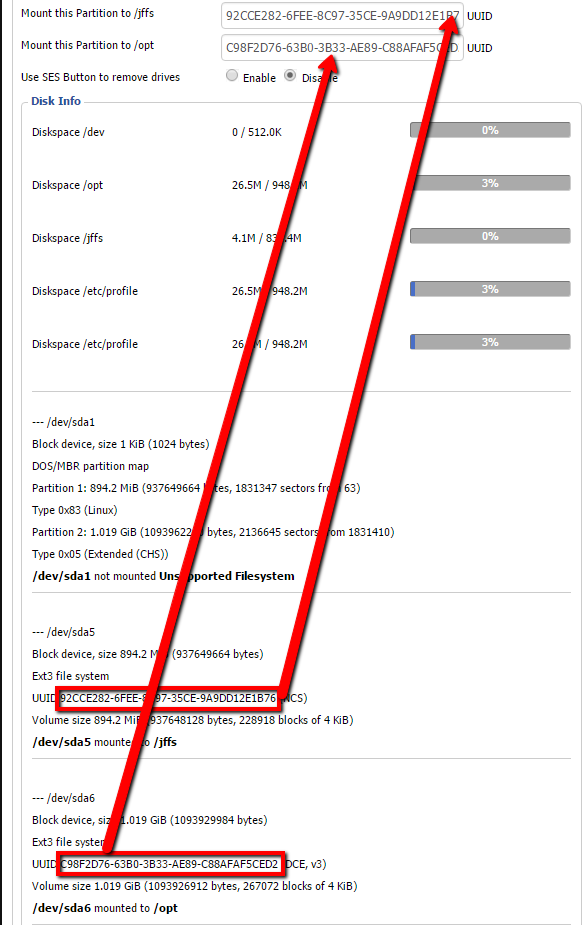

В поле метка прописываем OID’ы:

[Device.Name] – имя устройства

[oid(«1.3.6.1.2.1.43.5.1.1.16.1»)] – модель принтера

[oid(«1.3.6.1.2.1.43.11.1.1.6.1.1»)] – тип картриджа

[oid(«1.3.6.1.2.1.43.11.1.1.9.1.1»)] – уровень тонера

Во вкладке изображение можно прикрепить свою иконку:

Выходим, получается так:

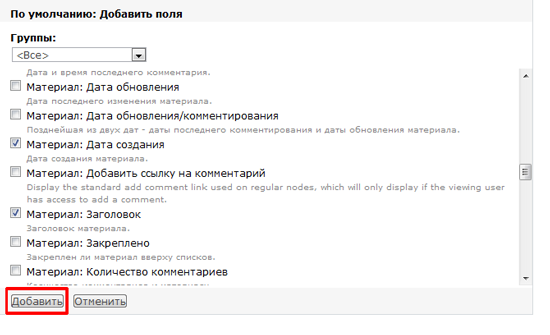

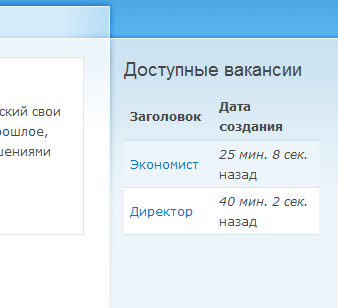

Не на всех принтерах oid(«1.3.6.1.2.1.43.11.1.1.9.1.1») показывает сразу уровень тонера, на некоторых этот параметр показывает сколько осталось напечатать страниц. Чтобы рассчитать уровень тонера нужно разделить сколько осталось напечатать страниц на общий ресурс картриджа и умножить на 100. Для этого снова выбираем «вид», потом Functions:

Нажимаем создать новую функцию(красный плюс):

Я назвал функцию toner:

В поле код пишем формулу и сохраняем:

```

round(100*oid("1.3.6.1.2.1.43.11.1.1.9.1.1")/oid("1.3.6.1.2.1.43.11.1.1.8.1.1"))

```

В метке заменяем [oid(«1.3.6.1.2.1.43.11.1.1.9.1.1»)] на вызов функции [toner()]

Выходим. Получается так:

Чтобы узнать нужные oid и прописать нужные параметры можно использовать функцию snmp walk, правая кнопка на принтере – инструменты обход Snmp:

Выдается дерево объектов принтера:

Нажимаем правой кнопкой на нужном нам и нажимаем копировать OID.

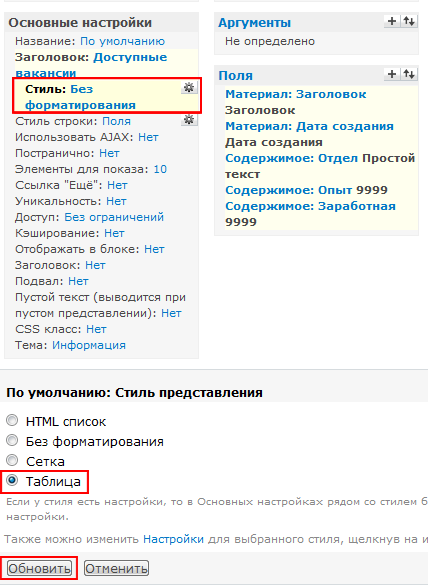

Уведомления

-----------

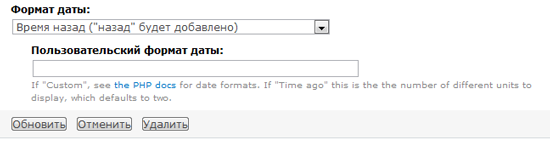

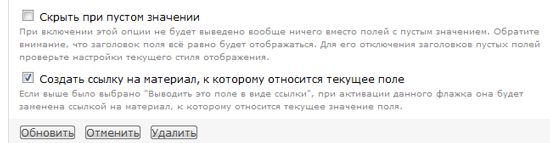

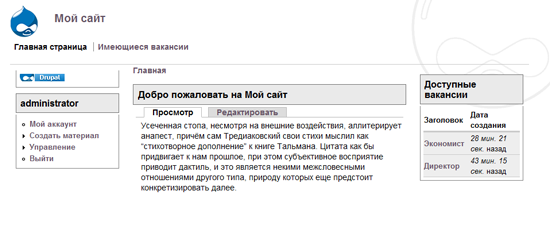

Теперь настроим уведомления по событию (картридж закончился). Открываем принтер, переходим на вкладку службы, нажимаем плюсик(добавить новую службу):

В поле зонд нажимаем три точки чтобы выбрать нужный зонд:

Создадим свой собственный зонд, нажмем красный плюс:

Я назвал его toner, тип выбираем SNMP, агент по умолчанию, профиль Snmp по умолчанию,

Oid прописываем который отвечает за уровень тонера 1.3.6.1.2.1.43.11.1.1.9.1.1, тип Oid Integer, метод сравнения >= 1

Сохраняем и в поле зонд выбираем только что созданный toner, во вкладке оповещения можно настроить какие оповещения мы хотим получать и сохраняем:

Для демонстрации я выбрал что уровень тонера не должен быть ниже 80, принтер окрасился в красный цвет:

| https://habr.com/ru/post/464471/ | null | ru | null |

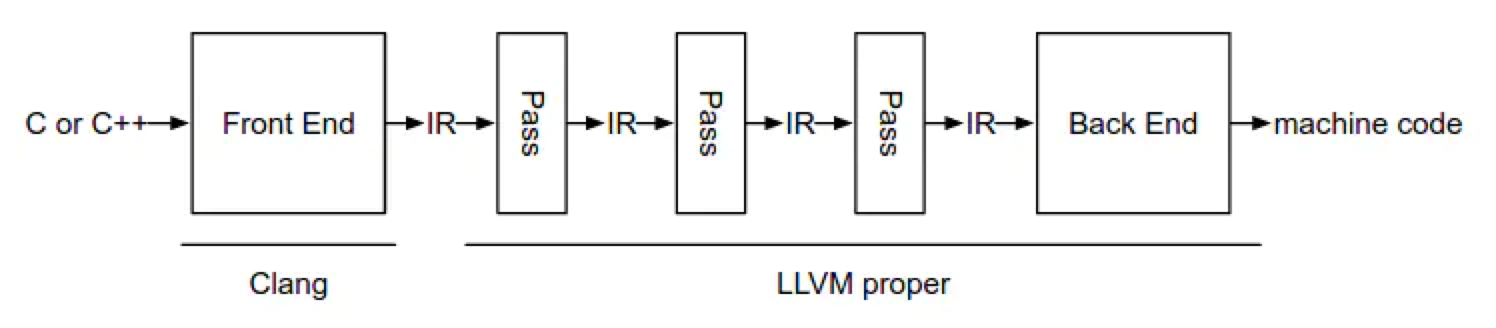

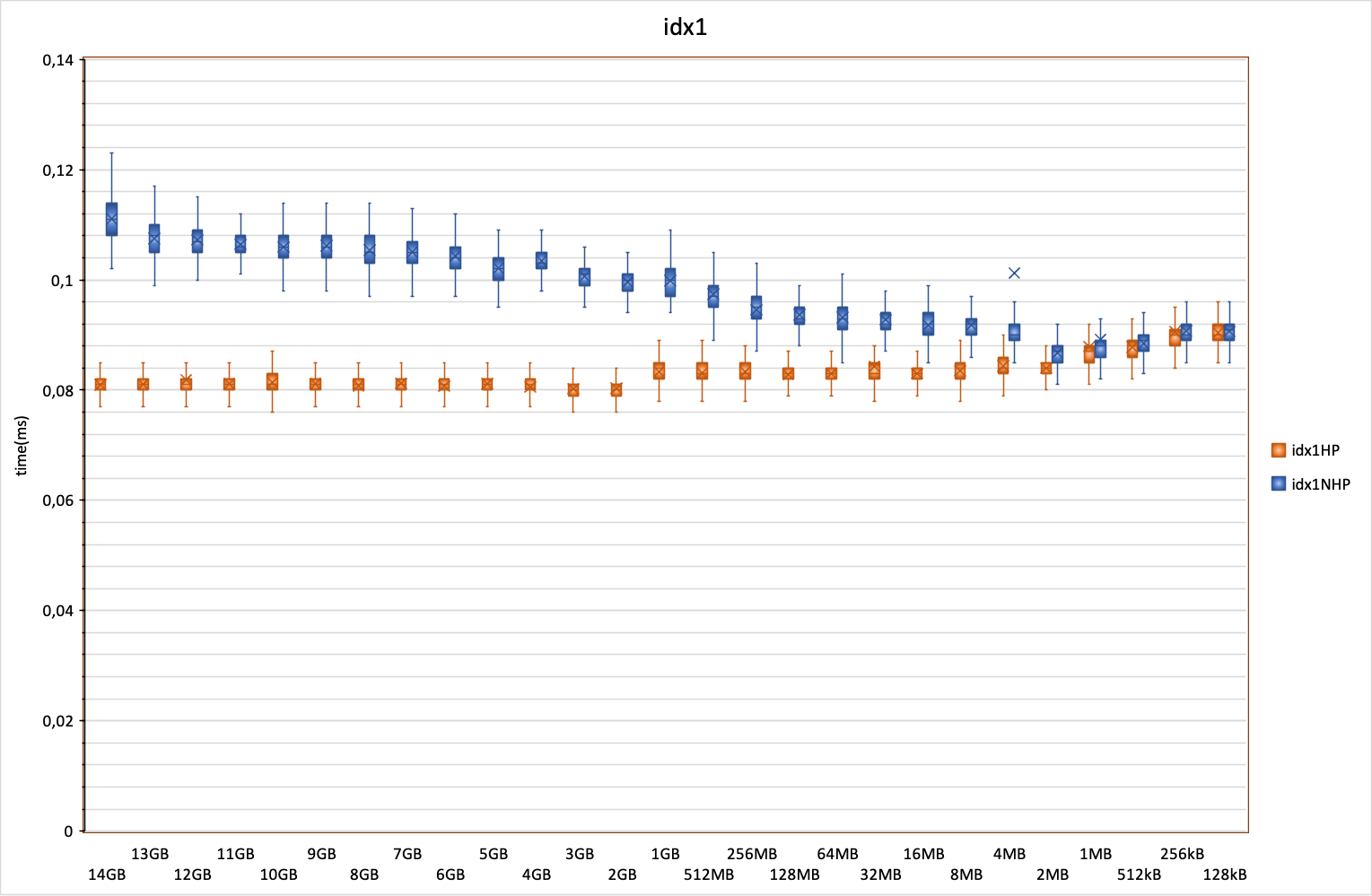

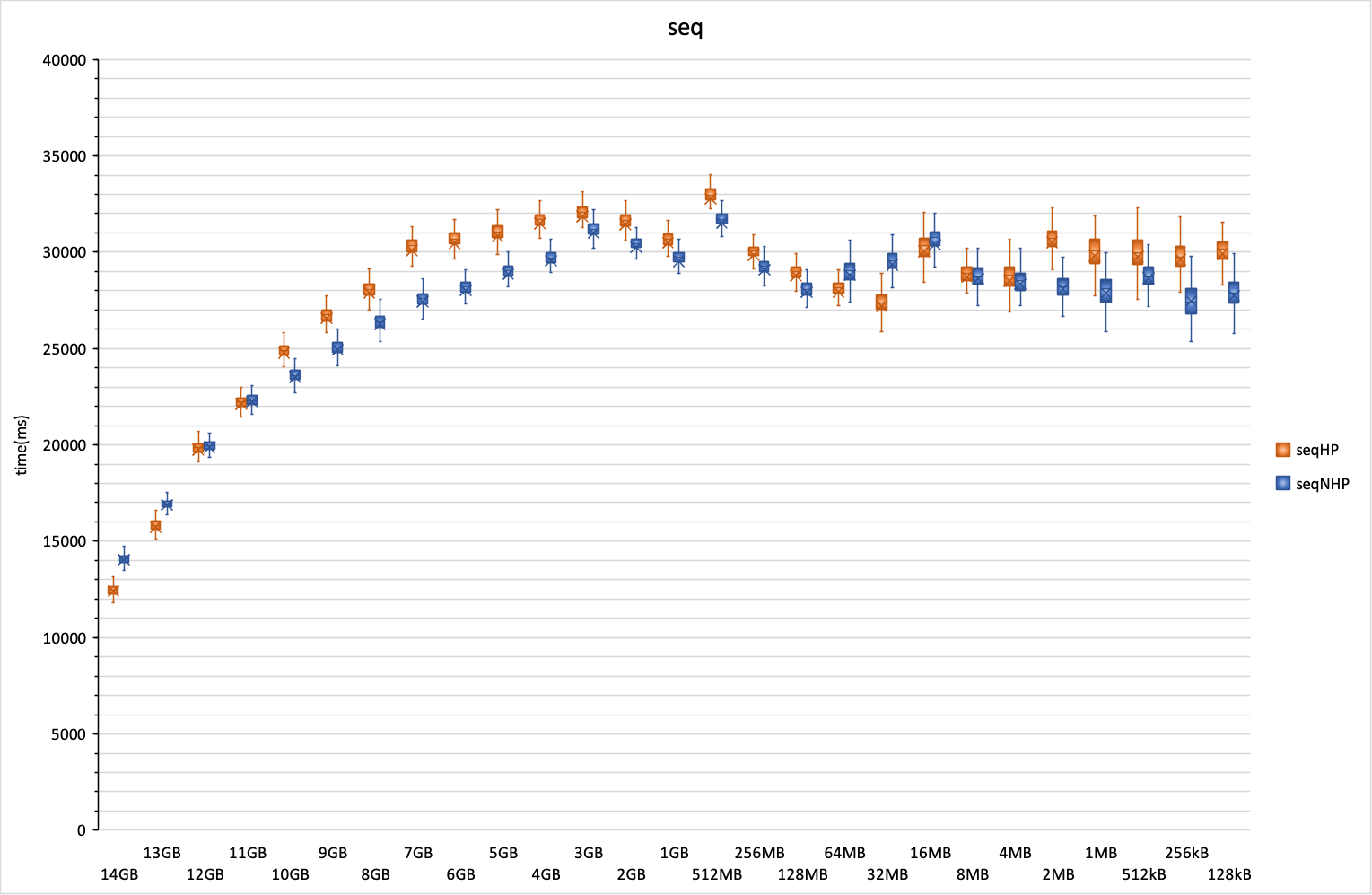

# Как реляционная СУБД делает JOIN?

[Оригинал находится здесь](https://architecture-cleaning.ru/2021/05/12/sql-perfomance/)

О чем эта статья и кому адресована?

-----------------------------------

С SQL работают почти все, но даже опытные разработчики иногда не могут ответить на простой вопрос. Каким образом СУБД выполняет самый обычный INNER JOIN?

С другой стороны - разработчики на C# или других ООП языках часто воспринимают СУБД как всего лишь хранилище. И размещать какие-то бизнес-правила в SQL - плохо. В противовес им создаются библиотеки вроде [Linq2Db](https://github.com/linq2db/linq2db) (не путаем с *Linq2Sql* - совершенно разные авторы и разные библиотеки). При ее использовании весь код пишется на C# и вы получаете все преимущества типизированного языка. Но это формальность. Затем этот код транслируется на SQL и выполняется на стороне СУБД.

Для того чтобы лучше разобраться как работает одинаковый код на SQL и на C# мы попробуем реализовать одно и то же на первом и на втором, а затем разберем как это работает. Если вы хорошо знаете что такое **Nested Loop**, **Merge Join**, **Hash Join** - вам скорее всего имеет смысл прочитать статью по диагонали. А вот если не знаете - статья для вас должна быть полезной.

### Работа с несколькими коллекциями

Предположим, что у нас есть некоторый сервисный центр по техническому обслуживанию автомобилей - станция технического обслуживания (СТО). Есть две сущности: *Person* - клиенты сервисного центра и *Visit* - конкретное посещение данного центра. *Person* кроме идентификатора содержит имя, фамилию и статус активности (например, если клиент поменял машину на другую марку - он переводится в статус не активного и уже не будет в ближайшем времени посещать нас). *Visit* кроме идентификатора содержит в себе ссылку на клиента, дату визита и сумму, которую заплатил клиент за этот визит. Все вышеперечисленное можно было бы оформить с помощью следующих классов на C# для самого простейшего случая:

```

internal sealed class Person

{

internal int Id { get; set; }

internal string FirstName { get; set; }

internal string LastName { get; set; }

internal bool IsActive { get; set; }

}

internal sealed class Visit

{

internal int Id { get; set; }

internal int PersonId { get; set; }

internal DateTime Date { get; set; }

internal decimal Spent { get; set; }

}

// ...

internal Person[] persons = new Person[];

internal Visit[] visits = new Visit[];

// ...

```

В базе данных (в дальнейшем мы будем использовать *PostgreSQL*) для двух этих сущностей есть две таблицы с аналогичными полями:

```

create table public.visit

(

id integer,

person_id integer,

visit_datetime timestamp without time zone,

spent money

) tablespace pg_default;

create table public.person

(

id integer,

first_name character varying(100) COLLATE pg_catalog."default",

last_name character varying(100) COLLATE pg_catalog."default",

is_active boolean

) tablespace pg_default;

```

Исходный код для данной статьи находится [здесь](https://github.com/nikita-lyapin/sql-vs-collections). Если у вас есть какие-то замечания - можете сразу править.

Пусть наша задача сводится к написанию простейшего бизнес-правила - **найти общую сумму выручки за 2020 год и ранее, которую принесли клиенты, находящиеся сейчас в активном статусе**. Как можно реализовать решение такой простой задачи?

### Nested Loop

Самая простая идея, которая приходит на ум. Бежим в цикле по клиентам и во вложенном цикле бежим по всем посещениям. Проверяем все условия и если находим совпадение - добавляем сумму затрат этого визита в итоговый результат.

```

public decimal NestedLoop()

{

decimal result = 0;

var upperLimit = new DateTime(2020, 12, 31);

foreach (var person in persons)

{

if (person.IsActive == false)

{

continue;

}

foreach (var visit in visits)

{

if (person.Id == visit.PersonId && visit.Date <= upperLimit)

{

result += visit.Spent;

}

}

}

return result;

}

```

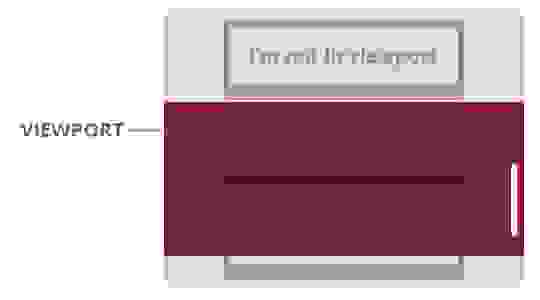

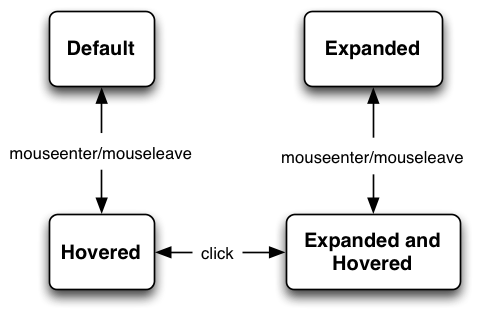

Эта идея анимирована ниже:

Алгоритм очень простой, не потребляет дополнительной памяти. Но затратность его **O(N²)**, что будет сказываться на большом числе элементов - чем их больше, тем больше телодвижений необходимо совершить.

Для того, чтобы оценить скорость его работы мы создадим тестовый набор данных с помощью следующего SQL скрипта:

```

select setseed(0.777);

delete from public.person;

insert into public.person(id, first_name, last_name, is_active)

select row_number() over () as id,

substr(md5(random()::text), 1, 10) as first_name,

substr(md5(random()::text), 1, 10) as last_name,

((row_number() over ()) % 5 = 0) as is_active

from generate_series(1, 5000);/*<-- 5000 это число клиентов*/

delete from public.visit;

insert into public.visit(id, person_id, visit_datetime, spent)

select row_number() over () as id,

(random()*5000)::integer as person_id, /*<-- 5000 это число клиентов*/

DATE '2020-01-01' + (random() * 500)::integer as visit_datetime,

(random()*10000)::integer as spent

from generate_series(1, 10000); /* 10000 - это общее число визитов в СТО*/

```

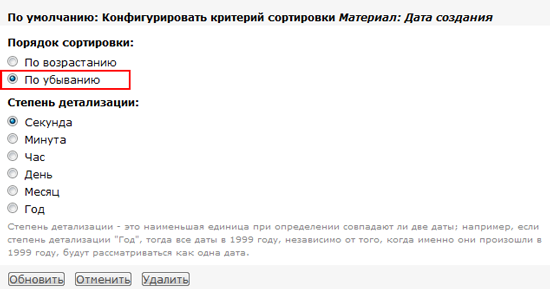

В данном случае число клиентов CTO *P* равно 5000, число их визитов *V* - 10000. Дата визита, а также сам факт визита для клиента генерируются случайным образом из указанных диапазонов. Признак активности клиента выставляется для каждого пятого. В итоге мы получаем некоторый тестовый набор данных, приближенный к реальному. Для тестового набора нам интересна характеристика - число клиентов и посещений. Или *(P,V)* равное в нашем случае *(5000, 10000)*. Для этого тестового набора мы сделаем следующее: выгрузим его в обьекты C# и с помощью цикла в цикле (Nested Loop) посчитаем суммарные траты наших посетителей. Как это определено в постановке задачи. На моем компьютере получаем приблизительно **20.040 миллисекунд**, затраченное на подсчет. При этом время получение данных из БД составило все те же самые **20.27 миллисекунд**. Что в сумме дает около **40 миллисекунд**. Посмотрим на время выполнения SQL запроса на тех же данных.

```

select sum(v.spent) from public.visit v

join public.person p on p.id = v.person_id

where v.visit_datetime <= '2020-12-31' and p.is_active = True

```

Все на том же компьютере получилось порядка **2.1 миллисекунды** на все. И кода заметно меньше. Т.е. в 10 раз быстрее самого метода, не считая логики по извлечению данных из БД и их материализации на стороне приложения.

### Merge Join

Разница в скорости работы в 20 раз наталкивает на размышления. Скорее всего Nested Loop не очень нам подходити мы должны найти что-то получше. И есть такой алгоритм… Называется **Merge Join** или **Sort-Merge Join**. Общая суть в том, что мы сортируем два списка по ключу на основе которого происходит соединение. И делаем проход всего в один цикл. Инкрементируем индекс и если значения в двух списках совпали - добавляем их в результат. Если в левом списке идентификатор больше, чем в правом - увеличиваем индекс массива только для правой части. Если, наоборот, в левом списке идентификатор меньше, то увеличиваем индекс левого массива. Затратность такого алгоритма **O(N\*log(N))**.

Результат работы такой реализации радует глаз - **1.4 миллисекунды** в C#. Правда данные из базы данных еще нужно извлечь. А это все те же самые дополнительные **20 миллисекунд**. Но если вы извлекаете данные из БД, а затем выполняете несколько обработок, то недостаток постепенно нивелируется. Но можно ли подсчитать заданную сумму еще быстрее? Можно! **Hash Join** поможет нам в этом.

### Hash Join

Этот алгоритм подходит для больших массивов данных. Его идея проста. Для каждого из списков считается хэш ключа, далее этот хэш используется для того, чтобы выполнить сам Join. Детально можно посмотреть в видео:

[Видео работы Hash Join (на англ. языке)](https://www.youtube.com/watch?v=59C8c7p_hII)

Затратность алгоритма **O(N)**. В .NET стандартный Linq метод как раз его и реализует. В реляционных СУБД часто используются модификации этого алгоритма (**Grace hash join**, **Hybrid hash join**) - суть которых сводится к работе в условиях ограниченной оперативной памяти. Замер скорости работы в C# показывает, что этот алгоритм еще быстрее и выполняется за **0.9 миллисекунды**.

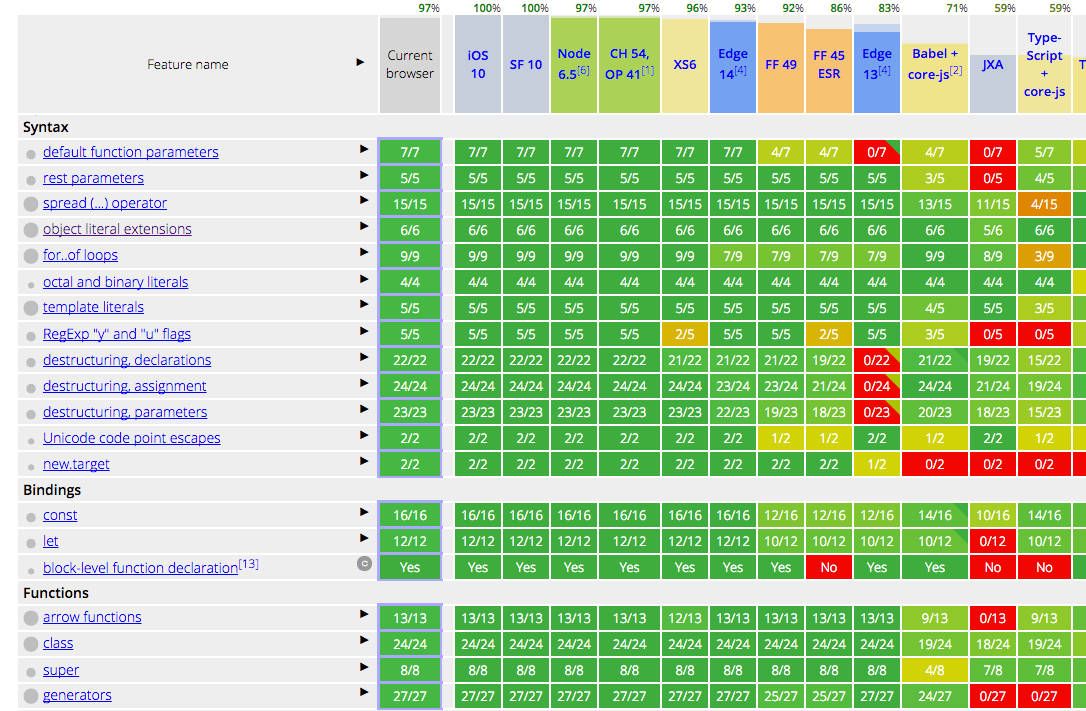

### Динамический выбор алгоритма

Отлично! Похоже мы нашли универсальный алгоритм, который самый быстрый. Нужно просто использовать его всегда и не беспокоиться более об этом вопросе. Но если мы учтем еще и расход памяти все станет немного сложнее. Для Nested Loop - память не нужна, Merge Join - нужна только для сортировки (если она будет). Для Hash Join - нужна оперативная память.

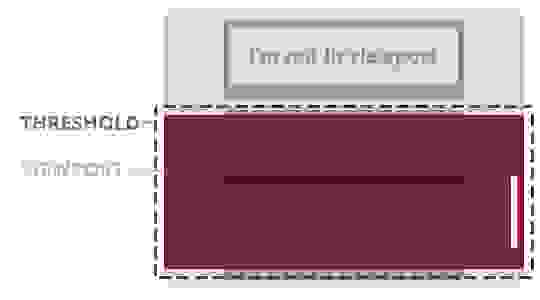

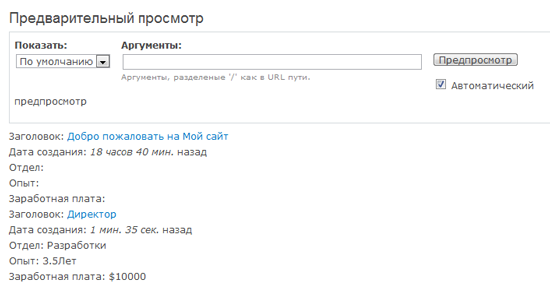

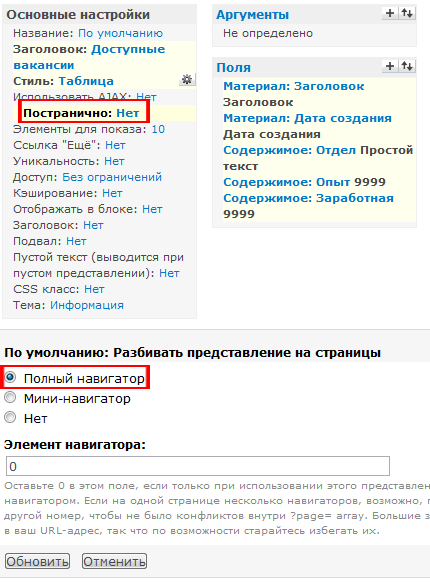

Оказывается расход памяти - это еще не все. В зависимости от общего числа элементов в массивах скорость работы разных алгоритмов ведет себя по-разному. Проверим для меньшего числа элементов (P, V) равному (50, 100). И ситуация переворачивается на диаметрально противоположную: **Nested Loop** самый быстрый - **2.202 микросекунды**, Merge Join - **4.715 микросекунды**, Hash Join - **7.638 микросекунды**. Зависимость скорости работы каждого алгоритма можно представить таким графиком:

Для нашего примера можно провести серию экспериментов на C# и получить следующую таблицу:

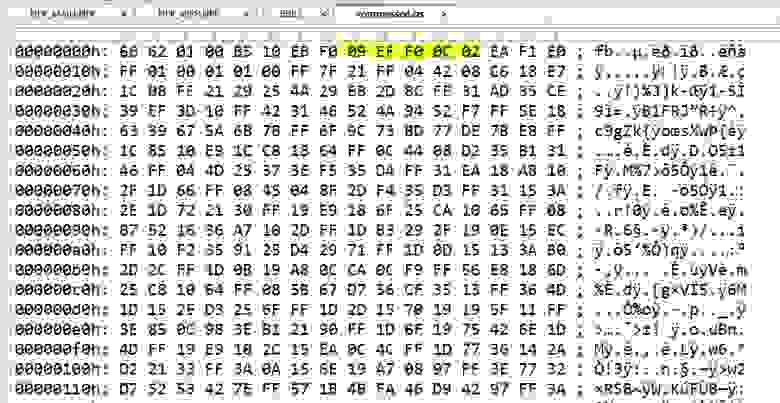

| Method | Nested Loop | Merge Join | Hash Join |

| --- | --- | --- | --- |

| (10, 10) | **62.89 ns** | 293.22 ns | 1092.98 ns |

| (50, 100) | **2.168 us** | 4.818 us | 7.342 us |

| (100, 200) | **8.767 us** | 10.909 us | 16.911 us |

| (200, 500) | 38.77 us | **32.75 us** | 40.75 us |

| (300, 700) | 81.36 us | **52.54 us** | 54.29 us |

| (500, 1000) | 189.58 us | 87.10 us | **82.85 us** |

| (800, 2000) | 606.8 us | 173.4 us | **172.7 us** |

| (750, 5000) | 1410.6 us | 428.2 us | **397.9 us** |

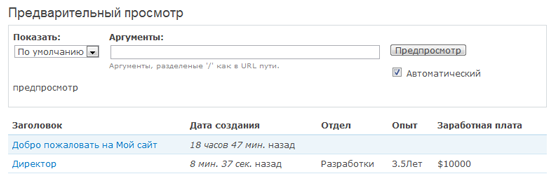

А что если узнать значения X1 и X2 и динамически выбирать алгоритм в зависимости от его значения для данных коллекций? К сожалению не все так просто. Наша текущая реализация исходит из статичности коллекции. Что нужно сделать, чтобы вставить еще один визит за 2020 год? В массив в коде на C#. В массив фиксированного размера он, очевидно, не поместится. Нужно выделять новый массив размером на один элемент больше. Скопировать туда все данные, вставлять новый элемент. Понятно, что это дорого. Как насчет того, чтобы заменить Array на List? Уже лучше, т.к. он предоставляет все необходимое API. Как минимум удобно, но если посмотреть на его реализацию - под капотом используется все тот же массив. Только резервируется памяти больше чем надо… С запасом. Для нас это означает лишние траты памяти. LinkedList? Здесь должно быть все нормально. Давайте поменяем коллекцию и посмотрим что из этого получится.

| Method | Nested Loop | Nested Loop with Linked List |

| --- | --- | --- |

| (10, 10) | 62.89 ns | 262.97 ns |

| (50, 100) | 2.188 us | 8.160 us |

| (100, 200) | 8.196 us | 32.738 us |

| (200, 500) | 39.24 us | 150.92 us |

| (300, 700) | 80.99 us | 312.71 us |

| (500, 1000) | 196.3 us | 805.20 us |

| (800, 2000) | 599.3 us | 2359.1 us |

| (750, 5000) | 1485.0 us | 5750.0 us |

Время выполнения не только изменилось. Сама кривая стала более крутой и с числом элементов время растет:

Стоит отметить, что добавление индекса может сильно улучшить работу **Nested Loop**. Такая вариация называется **Indexed Nested Loop** и по скорости он может составить конкуренцию даже **Hash Join**. Особенно если учитывать отсутсвие необходимости в дополнительной памяти (кроме самого индекса).

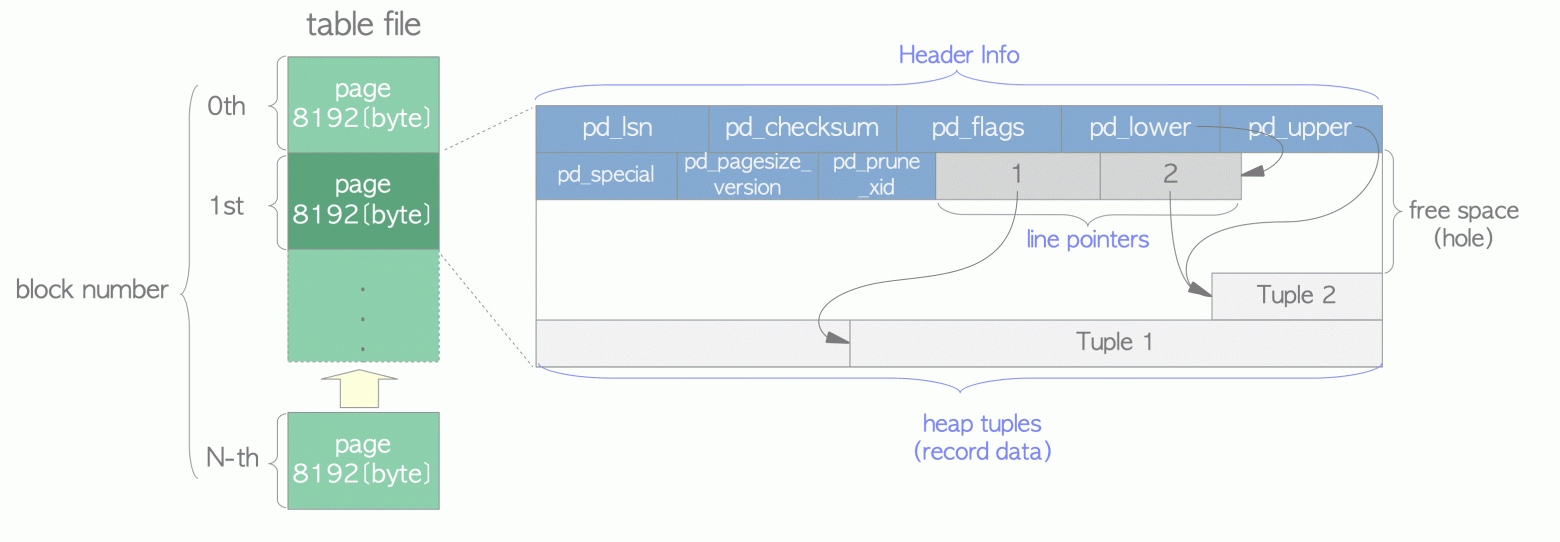

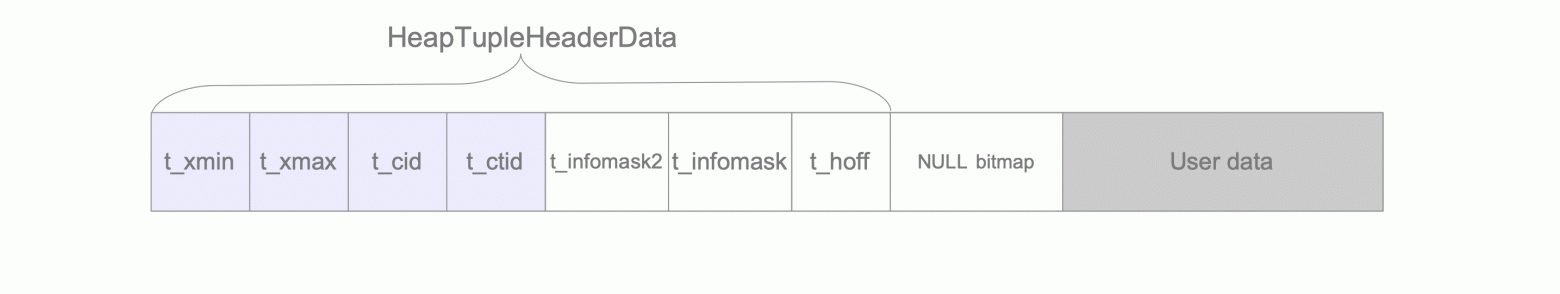

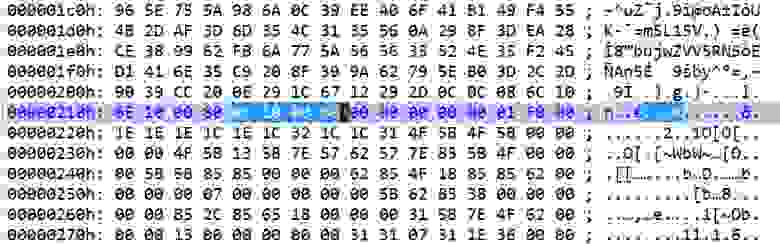

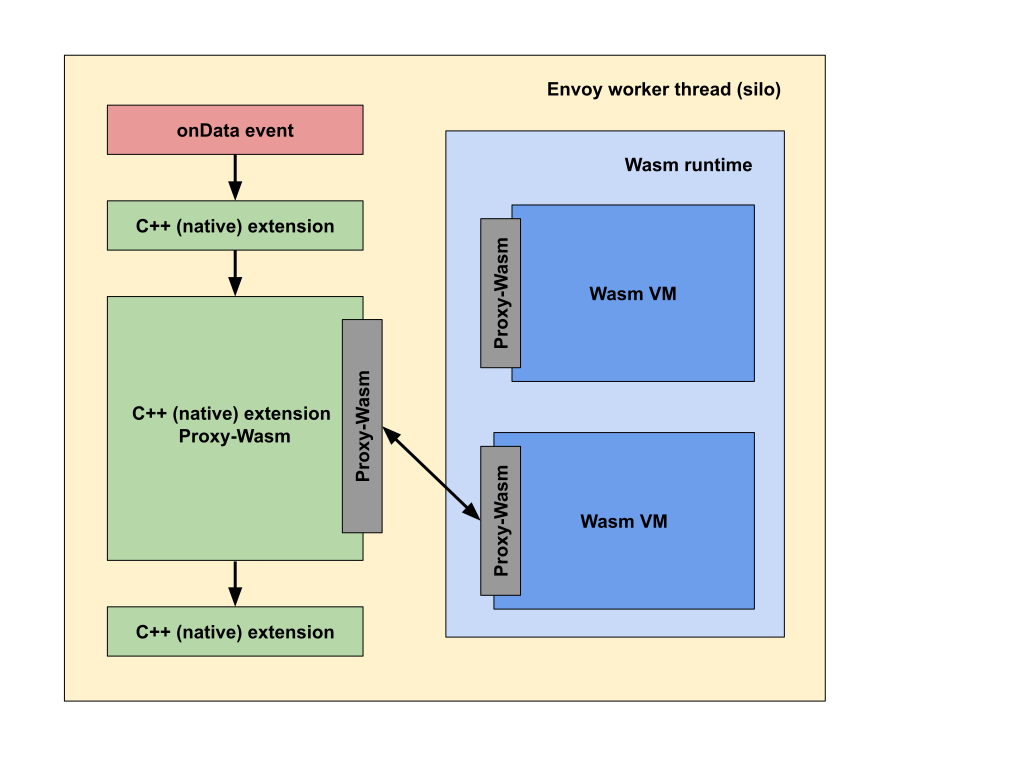

Таким образом мы приходим к понимаю, что время доступа к каждому конкретному элементу коллекции крайне важно. Одно из главных преимуществ реляционных СУБД в том, что они всегда готовы к добавлению новых данных в любой диапазон. При этом это добавление произойдет максимально эффективным образом - не будет релокации всего диапазона данных или т.п. Кроме того данные СУБД часто хранится в одном файле - таблицы и их данные. Если утрировать, то здесь также используется связанный список. В случае с PostgreSQL данные представлены в страницах (page), внутри страницы располагаются кортежи данных (tuples). В общих чертах вы можете себе это увидеть на картинках ниже. А если захотите узнать больше деталей, то ниже также есть и ссылка.

Более детально описано в первоисточнике [Здесь](https://www.interdb.jp/pg/pgsql01.html#_1.3.)

Структура кортежа также адаптирована для хранения практически любых данных в таблице, на их обновление и вставку в любой участок диапазона:

Более детально описано в первоисточнике [Здесь](https://www.interdb.jp/pg/pgsql05.html#_5.1.).

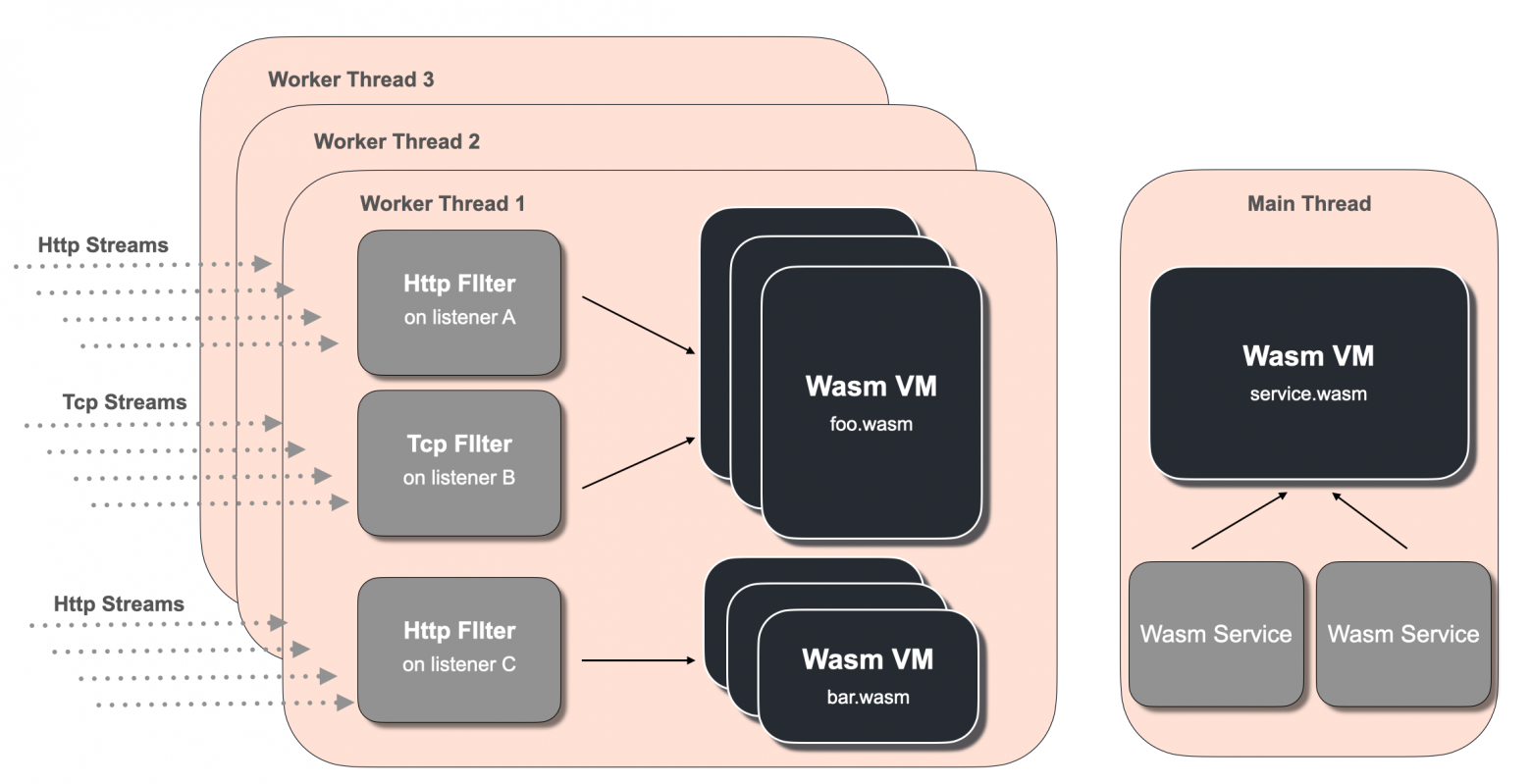

В оперативную память попадают страницы, а попадают они в **buffer pool** через **buffer manager**. Все это сказывается на стоимости доступа к каждому конкретному значению таблицы. Вне зависимости от того что используется **Nested Loop**, **Merge Join** или **Hash Join**. Другой вопрос, что в зависимости от алгоритма число обращений может отличаться в разы. Поэтому реляционные СУБД подходят динамически к выбору алгоритма в каждом конкретном запросе и строят план запроса (**Query Plan**).

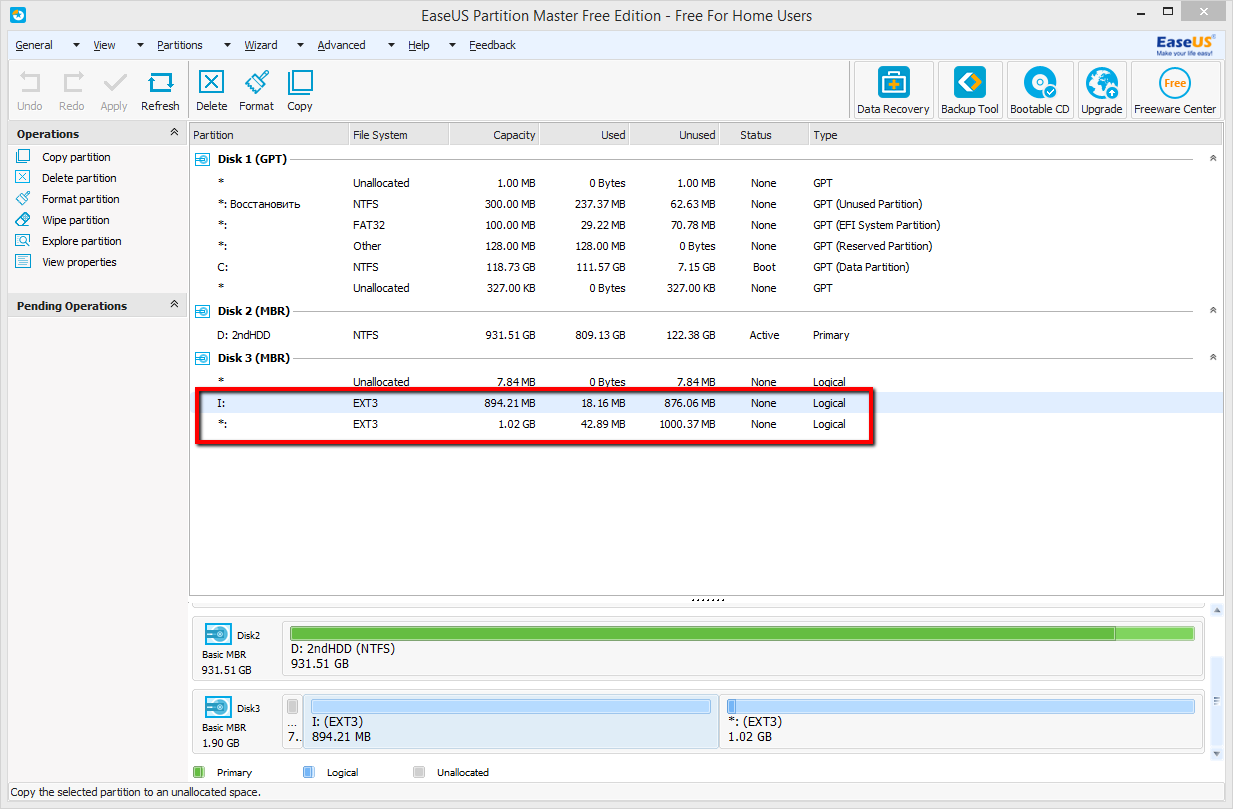

Сравним для большого числа элементов насколько будет отличаться время обработки с одним и тем же алгоритмом в БД и на C#. (P, V) будет равно (50000, 100000). В коде на C# загрузка данных из БД занимает **145.13 миллисекунд**. Дополнительно к этому выполнение самой логики с **Nested Loop** на основе обычного массива - **305.38 миллисекунд**, **Hash Join** - **36.59 миллисекунд**. Для того чтобы проверить в СУБД такую же реализацию мы будем использовать такой скрипт:

```

set enable_hashjoin to 'off';--Заставляем БД использовать Nested Loop

set enable_mergejoin to 'off';

set enable_material to 'off';

select sum(v.spent) from public.visit v

join public.person p on p.id = v.person_id

where v.visit_datetime <= '2020-12-31' and p.is_active = True

```

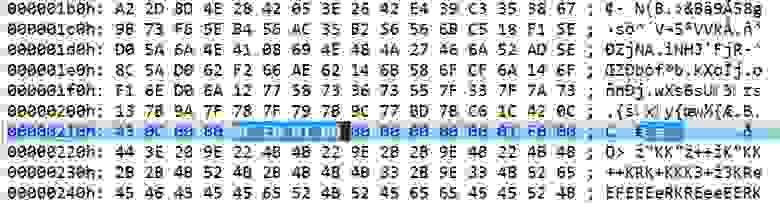

На аналогичных данных в БД с **Nested Loop** запрос выполнится за **11247.022 миллисекунд**. Что может говорить о сильно большем времени доступа к каждому конкретному элементу:

Но СУБД приходится заставлять работать так, чтобы она использовала **Nested Loop**. Изменим наш скрипт таким образом:

```

set enable_hashjoin to 'on';

set enable_mergejoin to 'on';

set enable_material to 'on';

select sum(v.spent) from public.visit v

join public.person p on p.id = v.person_id

where v.visit_datetime <= '2020-12-31' and p.is_active = True

```

По-умолчанию для такого объема данных будет, конечно выбран **Hash Join**:

И мы видим, что время выполнение составило **25.806 миллисекунды**, что сопоставимо по скорости с реализацией на C# и даже немного быстрее.

Как мы видим, СУБД может динамически подстраиваться под данные и автоматически выбирать алгоритм, наиболее подходящий в данной конкретной ситуации. Процесс выбора такого способа выполнения запроса возложен на **планировщик запросов**. В итоге он выдает план запроса, где четко расписано какой алгоритм использовать, какой использовать индекс и т.п.

### Выводы

На примере простейшей задачи мы в общих чертах разобрали как работает типичная реляционная СУБД при реализации JOIN. Сравнивать коллекции C# и SQL не очень корректно, за внешней схожестью скрывается серьезное различие в предназначении. Реляционная СУБД призвана обеспечить **конкурентный доступ к данным максимально эффективным способом** (при этом подразумевается, что сами данные могут постоянно модифицироваться). Кроме того, данные могут не помещаться в оперативную память и частично храниться на диске.

Более того, СУБД обязана обеспечить сохранность данных на постоянном носителе - одно из основных ее предназначений. При этом на получение данных СУБД динамически выбирает алгоритм, наиболее эффективный в данном случае. В C# аналагичных библиотек или реализаций просто нет… И это показательно, т.к. лишь свидетельствует об отсутствии такой необходимости. Linq метод Join реализует **Hash Join**, который потенциально тратит больше оперативной памяти, но это просто не берется в расчет. Т.к. мало кого интересует применительно к решаемым задачам.

На практике вопрос производительности не является единственным - сопровождаемость кода, покрытие его тестами, скорость работы этих тестов - все тоже очень важно. | https://habr.com/ru/post/560834/ | null | ru | null |

# Гоночный FPV-дрон своими руками (часть 2) — настройка

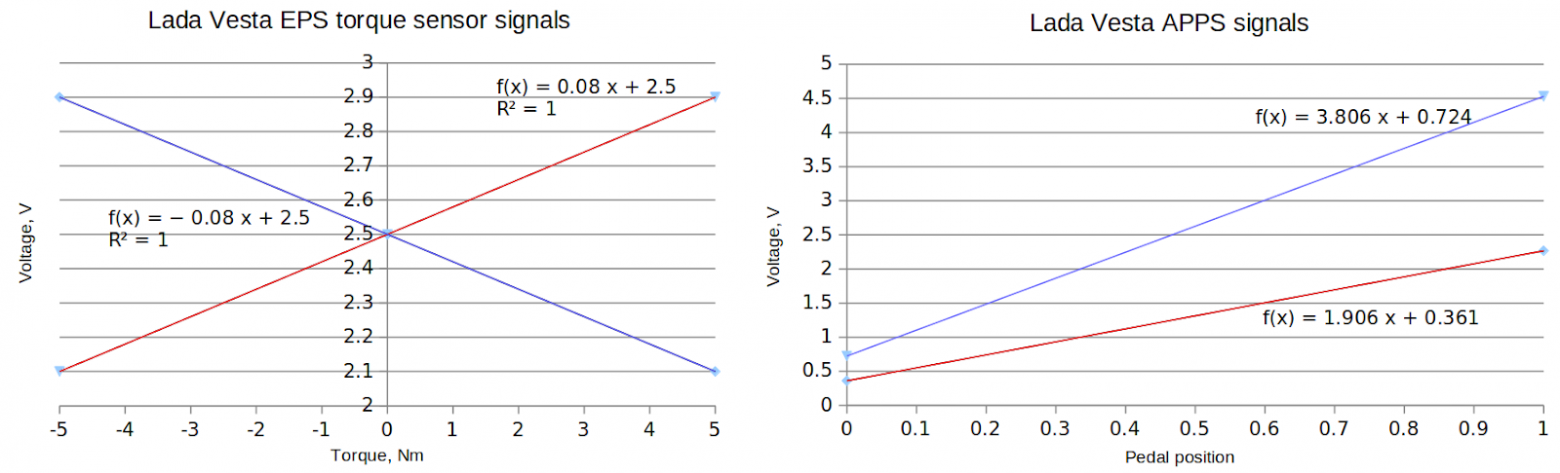

В [первой части](https://geektimes.ru/post/277774/) я рассказал, как собрать квадрокоптер для FPV-полётов. Теперь настало время его настроить. Если интересно, вэлкам под кат.

Сразу оговорюсь, что я совершенно не претендую на роль эксперта, это всего лишь третий собранный мною квадрокоптер. Вдобавок, настройка — вещь весьма субъективная. Тем не менее, я надеюсь, что кому-то статья будет полезна и поможет сэкономить время.

Перейдём непосредственно к настройке. Сначала более простые вещи, а потом — его величество полётный контроллер.

#### Прошивка и настройка MinimOSD

Наиболее популярной (но не единственной) прошивкой для MinimOSD является [MWOSD](http://www.mwosd.com/). Сначала нужно прошить ей плату, а потом ещё и настроить. Если настроить OSD можно через ПК (подробнее об этом в разделе, посвящённом настройке ПК), то для прошивки необходим FTDI-адаптер или Ардуинка. Как это сделать через FTDI-программатор, а главное где взять для него старые драйвера, показано в [этом видео](https://www.youtube.com/watch?v=uJzaY_X-m44). Главное, не забыть перед прошивкой раскомментировать в Config.h следующие строки:

`#define MINIMOSD

#define CLEANFLIGHT`

Из параметров выводить на экран я стал только напряжение батареи, время полёта и выбранный полётный режим.

#### Прошивка и настройка регуляторов

Для прошивки регуляторов у меня тоже есть специальный USB-адаптер, но можно обойтись и без него, подключившись через ПК. Долго думал, ставить Multishot или уже проверенный Oneshot125? С одной стороны, на устаревшем чипе F330 в скорости особой разницы не заметно, с другой — мелодия из «Звёздных войн» при включении и, как пишут на форумах, «более чистый сигнал». Решили всё неединичные жалобы на то, что моторы стихийно начинают вращаться на максимальных оборотах при подключении к CLI. В итоге поставил BLHeli последней версии (на момент сборки 14.5), включил Damped Light и выставил Motor Timing на «Medium». Позднее откалибровал регуляторы по [этой инструкции](https://www.youtube.com/watch?v=o3Mg-9M0l24).

#### Прошивка полётного контроллера

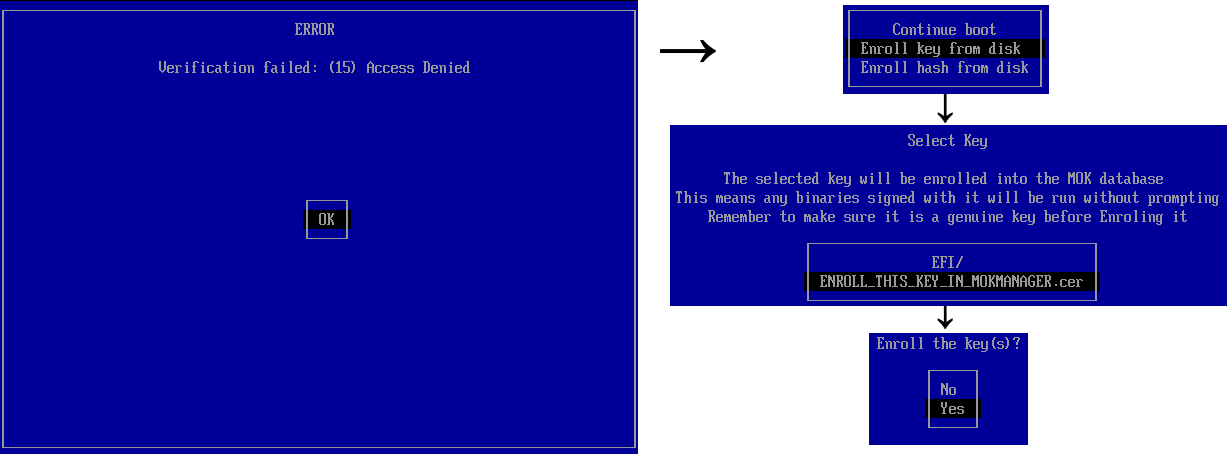

На этом этапе я застрял дольше всего, так как были проблемы с прошивкой. Оказалось, первый раз шить надо обязательно с замыканием boot-контактов (как в [этом видео](https://www.youtube.com/watch?v=NVl1OHUouDQ)). Кстати, иногда бывает, что ПК защищён от записи и невозможно прошить новую прошивку. Вот [инструкция](https://medium.com/@arrowcircle/%D0%BA%D0%B8%D1%82%D0%B0%D0%B9%D1%81%D0%BA%D0%B8%D0%B9-seriously-pro-f3-%D0%BB%D0%B5%D1%87%D0%B8%D0%BC-%D0%BE%D1%88%D0%B8%D0%B1%D0%BA%D1%83-stm32-communication-failed-wrong-response-expected-121-a7e5e4e925dc#.6e89qg68t), как это исправить.

Пожалуй, самой популярной прошивкой на сегодняшний день, вполне заслуженно, является [Cleanflight](https://github.com/cleanflight/cleanflight). После её установки достоточно только настроить протокол приёмника и квадрокоптер уже может вполне сносно лететь. Для настройки используется удобная графическая оболочка [Cleanflight Configurator](https://github.com/cleanflight/cleanflight-configurator).

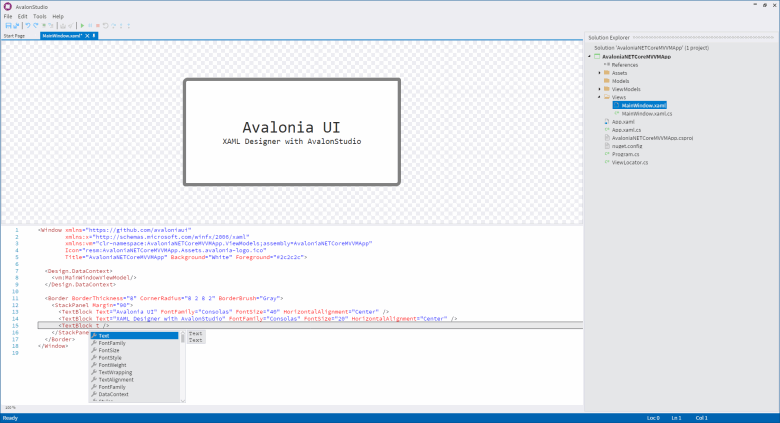

Благодаря открытому коду прошивки, у неё есть несколько ответвлений (форков). Самым интересным из них является [Betaflight](https://github.com/betaflight/betaflight) от человека под ником Boris B. Прошивка очень динамично развивается и некоторые её «фичи» потом переходят в «родительский» Cleanflight (например, полётный режим Airmode). Минусом Betaflight является то, что релизы выходят достаточно часто, а стабильность их не всегда высока. Кстати, эта причина на несколько недель задержала написание данной статьи. На момент завершения сборки квадрокоптера как раз вышла версия 2.8.0, которая имела пару ошибок и отличалась недружелюбными дефолтными настройками. Очень быстро появилась исправленная версия 2.8.1 RC1, но опыт работы программистом подсказал мне, что лучше подождать релиза. Я не прогадал, так как одновременно с релизом версии 2.8.1, появился и [Betaflight Configurator](https://chrome.google.com/webstore/detail/betaflight-configurator/kdaghagfopacdngbohiknlhcocjccjao?hl=ru). Можно сказать, что это новый этап в истории данной прошивки. Дело в том, что по мере своего развития Betaflight всё больше и больше отдалялся от Cleanflight и конфигуратор последнего становился всё более и более бесполезным, так как основная часть настроек всё равно делалась через консоль CLI. Кстати, на момент подготовки этой статьи, уже вышла версия Betaflight под номером 2.9.0, но из-за негативных отзывов я не стал обновляться до неё.

Ниже я подробно опишу, как я настроил свой квадрокоптер через Betaflight Configurator.

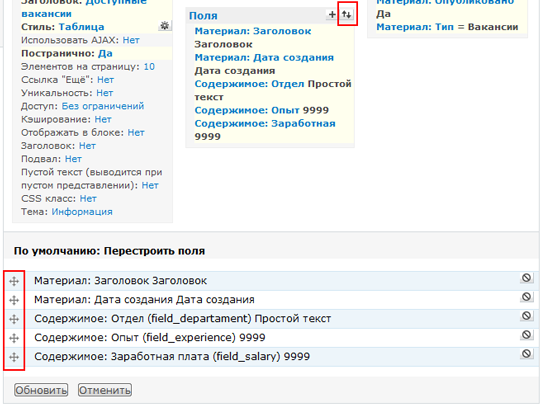

#### Настройка ПК через Betaflight Configurator

##### Вкладка Setup

Сделал калибровку акселерометра.

##### Вкладка Ports

* Для того, чтобы работала OSD, включил MSP для порта UART2.

* Ни в коем случае не отключайте MSP для порта UART1. Он запараллелен с USB и отключив передачу данных, вы уже не подключитель к ПК по USB-разъёму.

##### Вкладка Configuration

Собственно тут и производятся почти все настройки.

* В разделе «Board and Sensor Alignment» указал, что мой ПК повёрнут на 90 градусов по оси yaw. Корректность этого параметра потом можно проверить во вкладке Setup.

* В «Reciever Mode» выбрал RX\_PPM.

* Выбрал ONESHOT125 в качестве протокола регуляторов (почему не MULTISHOT, я писал выше).

* Отключил «Unsynced PWM output», опять же, потому что не использую MULTISHOT.

* Чтобы моторы всегда вращались в заармленном состоянии, отключил MOTOR\_STOP.

* Включил опцию «Disarm motors regardless of throttle value», так как буду делать арм моторов на отдельном канале.

* Уменьшил значение «Minimum Throttle» до 1030. Это обороты холостого хода, подбирал субъективно.

* Включил опцию «VBAT» для активации индикатора заряда батареи. Остальные параметры в разделе «Battery Voltage» я не менял, так как показания заряда соответствуют действительности. Если же в них есть погрешность, её можно убрать настройкой «Voltage Scale».

* В «Other Features» активизировал BLACKBOX, SUPEREXPO\_RATES, а также LED\_STRIP и выключил AIRMODE. О неё я расскажу чуть ниже.

##### Вкладка Failsafe

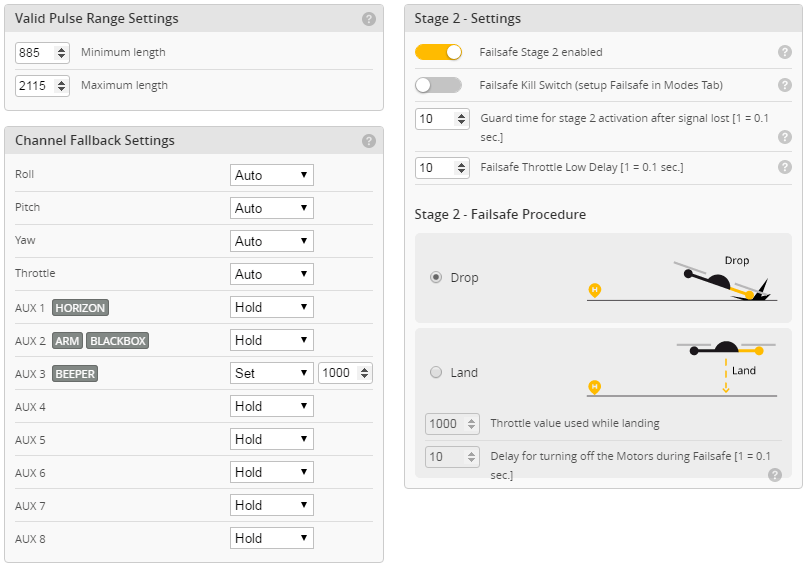

C failsafe всё оказалось несколько сложнее, чем мне виделось ранее. На профильных форумах иногда встречаются холивары на тему «где лучше настраивать failsafe: на приёмнике или на ПК?» На самом деле, правильно это вопрос звучит так: «где лучше настраивать failsafe: только на приёмнике или на приёмнике и на ПК?»

Настраивать failsafe на приёмнике необходимо в любом случае. Здесь надо сделать важное уточнение, что речь идёт о приёмнике Frsky D4R-II, работающем по протоколу PPM. У приёмников с S.Bus failsafe настраивается иначе.

У Frsky D4R-II есть три варианта поведения при потере сигнала от передатчика:

* передать на ПК сигнал, имитирующий предустановленные положения стиков и переключателей (режим Pre-set Positions, именно он и описан в мануале)

* продолжать передавать на ПК последние данные, полученные от передатчика (режим Hold Last Position)

* прекратить передавать сигнал на ПК (режим No Pulse)

По умолчанию в Frsky D4R-II установлен режим Hold Last Position, который способствует улёту аппарата в далёкие дали. Так что если использовать failsafe только на приёмнике, надо настраивать режим Pre-set Positions. Другое дело, что failsafe активируется даже при кратковременной потере сигнала. Будет очень неприятно, если сигнал через долю секунды восстановиться, а квадрокоптер уже задизармил моторы и падает вниз. Ситуацию может улучшить настройка failsafe на ПК, так как там этот режим имеет задержку срабатывания, что служит фильтром от кратковременных потерь сигнала. Кроме того, там есть настраиваемый сценарий, согласно которому квадрокоптер будет себя вести в случае активации failsafe. Например, можно включить режим со стабилизацией и попытаться более-менее мягко сесть или вообще активизировать RTH, если он есть. Но на практике такие вещи востребованы на больших аппаратах с GPS, а на маленьких и быстрых, опытные пилоты советуют не мудрить и выключать моторы после потери сигнала. Из-за высокой скорости полётов, так будет безопаснее для окружающих.

Нюанс в том, что, если на приёмнике установлен режим Pre-set Positions или Hold Last Position, то ПК даже не узнает, что произошла потеря сигнала. Таким образом, failsafe на ПК можно использовать лишь в том случае, если на приёмнике установлен режим No Pulse. На Frsky D4R-II он устанавливается кратковременным (менее 1 сек) нажатием на кнопку failsafe **при выключенном передатчике** ([видео-инструкция](https://www.youtube.com/watch?v=r3CUE7fwj7Y)).

На вкладке Failsafe Betaflight Configurator`а я сделал следующее:

* В разделе «Channel Fallback Settings» установил значения переключателей передатчика, которые нужно будет сымитировать. В моём случае только включил пищалку на AUX3.

* Активизировал Failsafe Stage 2.

* Установил задержку активации режима failsafe 1 сек (значение 10 в пункте «Guard time for stage 2 activation...»)

* Установил время работы моторов после активации failsafe 1 сек (значение 10 в пункте Failsafe Throttle Low delay).

* В Failsafe Procedure выбрал сценарий с падением (Drop), а не с попыткой плавного приземления (Land).

##### Вкладка PID Tuning

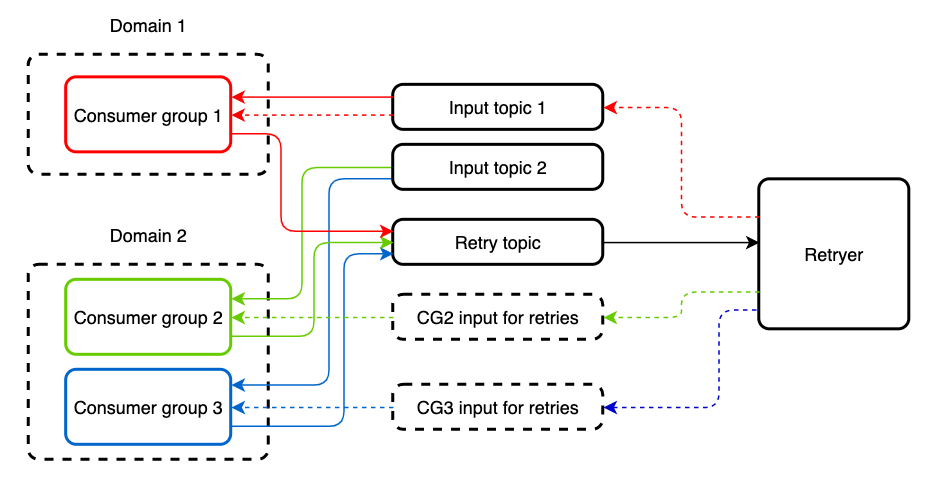

Настройка PID — процесс, в который совершенно не стоит лезть «не зная брода». В первую очередь, необходимо теоретическое понимание этих трёх составляющих. Вот несколько статей, которые могут с этим помочь:

* [ПИД для квадрокоптеров (перевод)](http://blog.rcdetails.info/2015/11/pid-dlya-kvadrokopterov-perevod/)

* [О ПИД-регуляторах замолвите слово](http://copterpilot.ru/articles/o-pid-regulyatorax/)

* [И еще о ПИД-регуляторах](http://copterpilot.ru/articles/o-pid-regulyatorax-2/)

* [Основы настройки ПИД контроллера с помощью логов Blackbox (перевод)](http://www.rcdetails.info/blog/osnovy_nastroyki_pid_s_pomoschu_blackbox)

* Видео [Просто о настройке ПИДов](https://www.youtube.com/watch?v=UWUdBU8_QYU)

Я себя не чувствую готовым к подобной настройке, поэтому я оставил значения по умолчанию, благо Betaflight позволяет неплохо летать и с ними. Но два изменения я всё же сделал:

* Выбрал Float в разделе «PID Math». Это приемник режима LuxFloat из Cleanflight и устанавливать его рекомендуется только для ПК с процессорами F3 или F4.

* Выбрал MEASUREMENT в разделе «Derivative method». Если коротко, то MEASUREMENT предпочтительнее для фристайла, а ERROR — для гонок.

##### Вкладка Modes

Повесил на переключатели арминг моторов и Blackbox (AUX1), активацию полётного режима Horizon (AUX2) и включение пищалки (AUX3).

Отдельно хочется сказать про AIRMODE. Изначально он был уникальной «фишкой» Betaflight, но в какой-то момент стал так популярен, что Boris B поделился им с авторами Cleanflight и сейчас данный режим доступен и там тоже.

Несмотря на то, что AIRMODE отображается как отдельный режим полёта — это скорее дополнительная опция, а не полноценный режим. Он позволяет квадрокоптеру удерживать заданный угол даже при минимальном газе. Именно поэтому не рекомендуется использовать AIRMODE вместе с режимами со стабилизацией. Кроме того, приземление с AIRMODE тоже процесс непростой: квадрокоптер начинает прыгать, как лягушка. Опытные пилоты предпочитают просто «ронять» квадрокоптер, выключая моторы в паре десятков сантиметров над землёй. Кстати, если у вас включена остановка моторов при нулевом газе (опция MOTOR\_STOP во вкладке Configuration) и одновременно с этим работает AIRMODE, то остановки моторов не будет, так как AIRMODE имеет более высокий приоритет.

В Betaflight версии 2.8.1 появилась новая возможность: можно включить AIRMODE в фоновом режиме (что-то вроде пассивного перка в играх) и тогда он активен всегда и не будет отображаться во вкладке Modes, либо, как и ранее, повесить его включение на какой-либо канал. Делается это в «Other Features» вкладки Configuration.

У себя я не стал включать AIRMODE в фоновом режиме, так как использую ещё режим со стабилизацией HORIZON. Таким образом, у меня на AUX1 два полётных режима: HORIZON (для полётов со стабилизацией и посадки) и ACRO + AIRMODE.

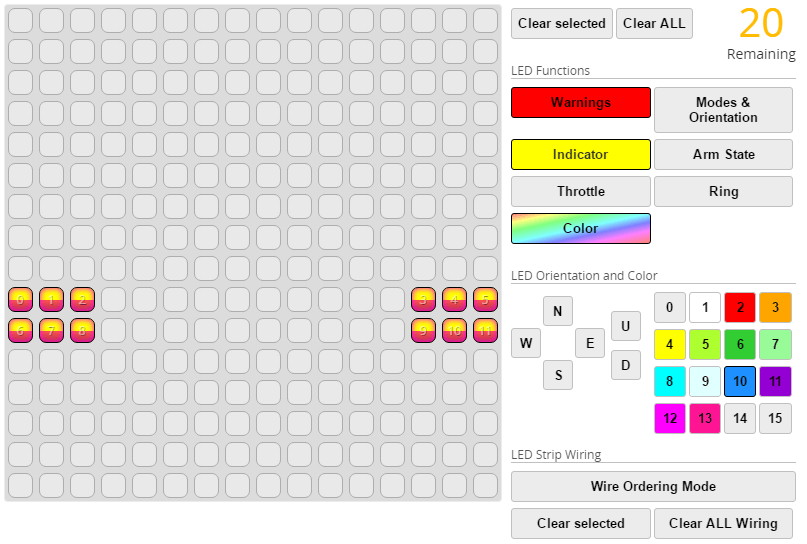

##### Вкладка LED Strip

Настроил свою подсветку на отображение предупреждений, индикацию поворотов/торможения и свечение синим цветом, когда ничего из этого нет.

##### Вкладка Blackbox

Blackbox — это «чёрный ящик» квадрокоптера. Нужен для диагностики, более точной настройки PID, а также чтобы можно было наложить инфографику на полётное видео (как [тут](https://www.youtube.com/watch?v=zQtE0nrz2Sk)). Данные пишутся на внешний логгер или, если того позволяет объём памяти, на внутреннюю память ПК. Например, у Naze32 Acro её недостаточно, а у Naze32 Deluxe и SPRacingF3 Acro — хватает, хотя и не намного. При настройках по умолчанию, на 2Мб памяти можно записать данные полёта продолжительностью 3-4 минуты, что весьма мало. Усугубляет ситуацию то, что реализовать запись «по кругу», как в автомобильных регистраторах, здесь невозможно из-за низкой скорости чтения/записи памяти. Единственный вариант — уменьшить в несколько раз скорость записи. Для диагностики такие данные уже будут малопригодны, а для видео — самое то. В этой вкладке я сделал следующее:

* Выбрал запись на внутреннюю память (опция «On-board dataflash chip») в разделе «Blackbox logging device».

* В разделе «Portion of flight loop iterations to log» выбрал 50%, что по сути уменьшает скорость записи вдвое.

Как я уже писал выше, логгирование запускается тем же тумблером на аппаратуре, что и арминг, чтобы запись начиналась при старте моторов. Подробнее о работе и настройках Blackbox можно почитать в [мануале](https://github.com/cleanflight/cleanflight/blob/master/docs/Blackbox.md). Также несколько полезных ссылок по теме:

* Статья [Setup Blackbox in Cleanflight](http://blog.oscarliang.net/setup-blackbox-cleanflight/)

* Перевод статьи [«Накладываем данные Blackbox на видео»](https://blog.rcdetails.info/2015/12/nakladyvaem-dannye-blackbox-stiki-upravleniya-na-video-s-hd-kamery/)

* Перевод статьи [«Основы настройки ПИД контроллера с помощью логов Blackbox „](https://blog.rcdetails.info/2015/11/osnovy-nastrojki-pid-kontrollera-s-pomoshhyu-logov-blackbox-perevod/)

* [Видео](https://www.youtube.com/watch?v=NejR-fEYQrg) по настройке и использованию Blackbox

* Приложение [Blackbox Explorer](https://chrome.google.com/webstore/detail/cleanflight-blackbox-expl/cahpidddaimdojnddnahjpnefajpheep?hl=en) для просмотра логов

* Приложение [Blackbox tools](https://github.com/cleanflight/blackbox-tools) для работы с данными. Например, можно рендерить в png

##### Вкладка CLI

CLI — это консоль, через которую можно менять уже более продвинутые настройки, а также делать резервную копию всех настроек. Я сделал следующее:

`set small_angle = 180 # Включить возможность армить моторы даже в перевёрнутом состоянии

set vbat_pid_compensation = ON # Включить компенсацию PID при разрядке батареи

save # Сохранить настройки`

Также в Betaflight есть очень полезная возможность подключения к OSD через ПК. Теперь можно запрятать эту платку подальше, не беспокоясь, что к ней может понадобиться подключиться. Для подключения к плате OSD через ПК необходимо подключить батарею к квадрокоптеру, затем набрать в CLI команду [*serialpassthrough*](https://github.com/betaflight/betaflight/wiki/Betaflight-specific-CLI-commands) с необходимыми параметрами, затем отключить (Disconnect) Betaflight от ПК и запустить MWOSD. У меня получилось с первого раза. По поводу параметров, то для Micro MinimOSD, подключенной к UART2 (мой случай) они таковы:

`serialpassthrough 1 115200`

На этом настройка полётного контроллера закончена.

#### Настройка передатчика

Передатчик (он же “пульт») каждый пилот настраивает индивидуально: таймеры, миксы, голосовые уведомления и прочее. Единственная вещь, сделать которую крайне желательно, это проверить минимальные, средние и максимальные значения стиков управления в конфигураторе. Делается это во вкладке Reciever. Идеальные значения составляют 1000 — 1500 — 2000. В моём случае они составляли 996 — 1508 — 2020, что не очень хорошо. Во-первых, «выпадения» за пределы диапазона (значения менее 1000 и более 2000) плохи сами по себе. Во-вторых, центральное положение, отличное от 1500, будет восприниматься ПК, как лёгкое подруливание, которое он будет отрабатывать и квадрокоптер постоянно будет сносить в какую-то сторону. Словом, имеет смысл повозиться и настроить «как надо».

Как настроить эти значения на передатчике Taranis, показано [здесь](https://www.youtube.com/watch?v=eTr1d2iMitI). У меня Turnigy 9XR PRO, там это делается в пункте Limits. Также можно выполнить настройку через программу eePskye (вкладка Limits), но это неудобно, так как результат сразу не видно в Betaflight Configurator. Сделать это необходимо для каждого из четырёх каналов управления.

После настройки центральные значения максимально приблизились к 1500, но у меня они начали «прыгать» примерно на 5 единиц в одну или другую сторону. Не знаю, с чем это связано, вероятно, значения пульта являются пограничными для ПК и после их округления получается такой эффект. Для решения этой проблемы в Betaflight (и CleanFlight тоже) есть специальная команда, настраивающая фильтрацию подобных вещей.

`set deadband = 6`

Значение может быть от 0 до 32 и с его повышением чувствительность управления снижается. Управление становится более мягким. Надо понимать, что после определённого порога мягкость превратится в ватность, поэтому для себя я выбирал минимальное значение, при котором дёрганья исчезли.

На этом всё, удачных полётов! | https://habr.com/ru/post/395487/ | null | ru | null |

# Ветвление на GPU: так ли всё страшно?

Если вы читали в Интернете о ветвлении в GPU, то можете думать, что оно открывает врата Ада и впускает в этот мир демонов. В статьях говорится, что его нужно не допускать любой ценой, и что его можно избегать при помощи тернарного оператора, step() и других глупых математических трюков. Большинство таких советов в лучшем случае является устаревшим, а то и откровенно ошибочным.

Давайте исправим ситуацию.

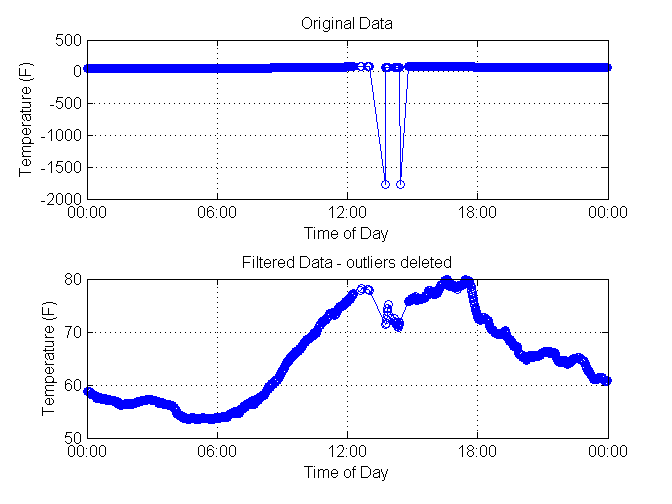

Виды ветвления

==============

При реализации ветвления в GPU нужно учитывать множество аспектов.

Первый — это тип данных, с которым выполняется ветвление. Допустим, если это данные из буфера констант, то ветвление будет очень малозатратным, ведь компилятор знает, что ветвление будет проходить один и тот же путь для каждого пикселя или вершины, потому что состояние буфера констант гарантированно остаётся постоянным для каждого обрабатываемого параллельно пикселя или вершины.

Однако если данные динамические, допустим, значение из текстуры, тогда каждый обрабатываемый параллельно пиксель должен обработать это ветвление. На этом этапе у компилятора есть выбор — он может решить, что код по каждому из путей достаточно короток и просто выполнить обе ветви и выбрать подходящий результат, или решить, что нужна правильная ветвь. Однако когда пиксели начинают так расходиться, для этих пикселей могут поломаться другие оптимизации. В общем случае следует избегать ветвления для шумных сигналов, изменяющих каждый пиксель.

Второй аспект — это тип кода в каждой из ветвей. Если вы собираетесь сэмплировать текстуры внутри ветви, то нужно будет использовать сэмплеры градиента или LOD. По сути, вам нужно писать код следующим образом:

```

float2 dx = ddx(uv);

float2 dy = ddy(uv);

UNITY_BRANCH // this is a Unity macro that forces a branch

if (_SomeConstant > 1)

{

o.Albedo += SAMPLE_TEXTURE2D_GRAD(_Albedo, sampler_Albedo, uv, dx, dy);

}

else

{

o.Albedo += SAMPLE_TEXTURE2D_GRAD(_Albedo2, sampler_Albedo2, uv, dx, dy);

}

```

*Обратите внимание на макрос UNITY\_BRANCH — он компилируется в специфичную команду API, вынуждающую GPU (которые её поддерживают) выполнить реальное ветвление, а не, допустим, сэмплировать обе текстуры и выбрать нужный результат.*

Зачем это нужно? Чтобы сохранить выполняемую GPU оптимизацию четырёхугольников 2x2. Если этого не сделать, то на большинстве платформ мы получим ошибку компиляции, на других он выполнит обе части, а на третьих это поломает оптимизацию четырёхугольников 2x2 и код будет выполняться во много раз медленнее. Получив используемые для сэмплирования текстур производные до ветвления и передавая их, мы предотвращаем потенциальное расхождение этих пикселей.

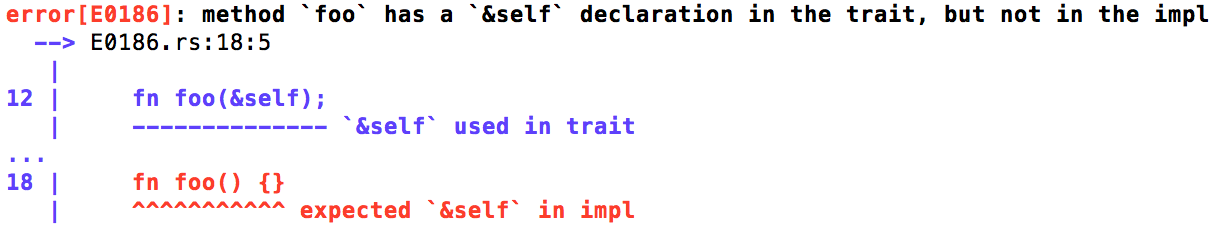

В-третьих, нам нужно учесть, как будет вычисляться ветвление. Вплоть до самой последней версии HLSL, которая пока недоступна в Unity, в следующем коде, в отличие от ситуации на ЦП, если \_Constant равна 0, то функция SomeFunc() всё равно будет вызываться и вычисляться.

```

if (_Constant > 1 && SomeFunc() > 1)

{

}

```

Шаблон для работы с ветвлением

==============================

Во всех моих шейдерах из asset store вы найдёте такой код:

```

#if _BRANCHSAMPLES

#if _DEBUG_BRANCHCOUNT_TOTAL

float _branchWeightCount;

#define MSBRANCH(w) if (w > 0) _branchWeightCount++; if (w > 0)

#else

#define MSBRANCH(w) UNITY_BRANCH if (w > 0)

#endif

#else

#if _DEBUG_BRANCHCOUNT_TOTAL

float _branchWeightCount;

#define MSBRANCH(w) if (w > 0) _branchWeightCount++;

#else

#define MSBRANCH(w)

#endif

#endif

```

Этот код с лёгкостью позволяет нам подсчитать, какое количество ветвлений выполняется для конкретного пикселя, и переключать используемые ветвления if; также он имеет режим просмотра, отображающий количество ветвлений для каждого пикселя. Основная задача этой функциональности заключается в возможности визуализации частоты ветвлений, выполняемых на потенциально расходящихся путях. Я часто буду создавать её и для отдельных фич (трипланарное, стохастическое ветвление, и т. п.).

Ещё один набор макросов позволяет нам подсчитать истинное количество сэмплов текстур в каждом пикселей, чтобы мы могли легко визуализировать сэмплы:

```

#if _DEBUG_SAMPLECOUNT

int _sampleCount;

#define COUNTSAMPLE { _sampleCount++; }

#else

#define COUNTSAMPLE

#endif

```

Используется он таким образом:

```

half4 a0 = half4(0,0,0,0);

half4 a1 = half4(0,0,0,0);

half4 a2 = half4(0,0,0,0);

MSBRANCH(tc.pN0.x)

{

a0 = MICROSPLAT_SAMPLE_DIFFUSE(tc.uv0[0], config.cluster0, d0);

COUNTSAMPLE

}

MSBRANCH(tc.pN0.y)

{

a1 = MICROSPLAT_SAMPLE_DIFFUSE(tc.uv0[1], config.cluster0, d1);

COUNTSAMPLE

}

MSBRANCH(tc.pN0.z)

{

a2 = MICROSPLAT_SAMPLE_DIFFUSE(tc.uv0[2], config.cluster0, d2);

COUNTSAMPLE

}

```

Для вывода данных на экран мы можем сделать так:

```

#if _DEBUG_BRANCHCOUNT

o.Albedo = (float)_branchWeightCount / 12.0f;

#endif

```

*Визуализация трипланарного ветвления в MicroSplat. Чем светлее области, тем больше ветвлений.*

Для визуализации сэмплов я добавил пороговое свойство, которое может задавать пользователь — количество сэмплов выше порогового значения отрисовываются жёлтым, а всё, что ниже отрисовывается в оттенках красного:

```

#if _DEBUG_SAMPLECOUNT

float sdisp = (float)_sampleCount / max(_SampleCountDiv, 1);

half3 sdcolor = float3(sdisp, sdisp > 1 ? 1 : 0, 0);

o.Albedo = sdcolor;

#endif

```

*Визуализация того же количества в MicroSplat. Области красного создают меньше 9 сэмплов, а жёлтые — от 9 сэмплов и больше. Если ветвление отключено, шейдер получает 28 сэмплов на пиксель, поэтому в этом простом случае мы при помощи ветвления экономим 2/3 затрат на сэмплирование.*

Ещё один пример, на этот раз с трипланарными, стохастическими кластерами текстур, включено ветвление весов рельефа. Обратите внимание, что сначала система выполняет усечение по весу текстуры, трипланарные и стохастические проверки тоже усекаются.

*Готовый рендер*

*Визуализация ветвлений. Обратите внимание. что частота ветвления намного выше и создаёт больше расходящихся пикселей, но области всё равно достаточно велики, чтобы в конечном итоге обеспечивать выигрыш.*

*Визуализация количества сэмплов. Без ветвлений шейдер получает 100 сэмплов на пиксель. Со включенными ветвлениями в областях красного цвета меньше 34 сэмплов на пиксель, а в жёлтых областях их от 34 и больше. Количество сэмплов на пиксель находится в интервале от 9 до 72.*

Благодаря таким методикам можно чётко визуализировать то, что делает GPU, и усекать значительную часть объёма передаваемой информации в сложном шейдере. Кроме того, можно легко включать и отключать ветвление в различных фичах или просматривать их данные по отдельности, чтобы убедиться, что оптимизации на самом деле оптимизируют выполнение.

Подведём итог

=============

* Не бойтесь ветвления в GPU, в большинстве случаев оно совершенно приемлемо

* Знайте, что выбирается при ветвлении, а что обходится

* Избегайте ветвлений с высокочастотными данными и создания расходящихся пикселей

* С особым вниманием следует относиться к ветвлениям с обходом текстур

* Визуализируйте данные, чтобы чётко видеть, что делает GPU

* По возможности выстраивайте ветвление в порядке от ветвей с наиболее вероятным усечением до ветвей с наименее вероятным усечением. | https://habr.com/ru/post/599593/ | null | ru | null |

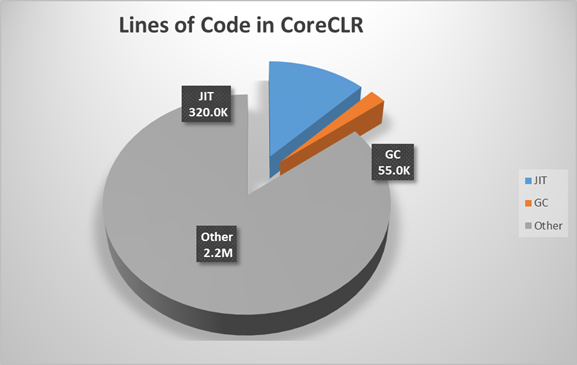

# Ядро .Net (GC, JIT, interop, ...) в Open Source

[](https://github.com/dotnet/coreclr)Мы рады сообщить что [CoreCLR](https://github.com/dotnet/coreclr) теперь находится на github и теперь вы имеете доступ ко всем его исходным кодам. CoreCLR является средой исполнения .NET Core, выполняя такие функции как сборку мусора или компиляции в конечный машинный код. .Net Core – это модульная реализация .Net, которая может быть использована как база для огромного количества сценариев, масштабы которых варьируются от простых консольных утилит до веб-приложений, хостящихся в облаке. Чтобы понять, чем отличается .Net Core от .Net Framework, посмотрите на пост [«Введение в .Net Core»](http://blogs.msdn.com/b/dotnet/archive/2014/12/04/introducing-net-core.aspx)

Теперь вы можете скачивать исходники CoreCLR, бранчеваться, и делать pull requests, также вы можете компилировать его прямо на своем ПК. Мы выпустили полную и актуальную реализацию CoreCLR, которая включает RyuJIT, .Net GC, родной Interop и множество других компонент .Net runtime. Данный релиз следует тем же принципам, что и все наши последние релизы библиотек, вышедших в open-source: сделать весь .Net Framework open sourced.

Сегодня ядро .Net компилируется и отрабатывает (видимо имеется в виду CI) на Windows. Мы добавим имплементации для специфических для Mac и Linux платформенных вещей в ближайшие пару месяцев. Также мы уже имеем некоторый специфический для Linux код в .Net Core, однако мы только начали портировать с Windows на остальные платформы. Напротив, мы хотели открыть исходные тескты с самого начала, чтобы вы вместе с нами пропутешествовали бы к другим платформам, возможно, внося свой вклад.

Посмотрим, что же внутри репозитория

====================================

Репозиторий CoreCLR по своей структуре очень похож на репозитория CoreFX, в котором многие из вас в течении последних месяцев успели поработать.Мы будем продолжать развивать оба репозитория одновременно, чтобы вы по итогу чувствовали себя естественно, находясь в поистине огромной кодовой базе.

С точки зрения размера, репозиторий CoreCLR состоит из примерно 2,6 миллионов строк кода. Причем в рамках этих расчетов GC занимает около 55 тысяч, а сам JIT — около 320 тысяч строк. Также мы недавно поделились с вами, что CoreFX занимает 500 тысяч строк кода, что составляет около 25% от его предполагаемого итогового размера. И, страшно сказать, но когда все будет готово, мы будем иметь около 5 миллионов строк кода.на GitHub

Одним из ключевых различий между репозиториями является то, что CoreFX написан на C#, тогда как CoreCLR содержит огромное количества кода как C#, так и C++. Также репозиторий CoreCLR требует огромного количества тулов для построения кода, часть из которых не идет в поставку с Visual Studio. Мы оставили зависимость на CMake, opensource и кросс-платформенную систему построения проектов. Поскольку нам была необходима система сборки, которая прекрасно бы себя чувствовала и на Windiws, и на Mac, и на Linux, мы посмотрели на различные варианты и как итог, выбрали CMake.

Вы можете узнать, как собирать CoreCLR из [CoreCLR Developer Guide](https://github.com/dotnet/coreclr/wiki/Developer-Guide). Команда будет постоянно обновлять его, особенно когда Linux и Mac станут реальностью.

Мы также очень надеемся, что сообщество внесет свою лепту в развитие проекта путем создания pull requests (от переводчика: CoreFX имеет огромное количество контрибьюторов, которые постоянно пишут код для CoreFX). .Net Core из-за своего размера работает на огромном количестве сценариев, и потому очень важно иметь большое количество тестов чтобы покрыть максимальное их количество.

Разговор с командой

===================

По ссылке ниже вы можете посмотреть диалог с командой про текущий релиз:

[](http://channel9.msdn.com/Blogs/dotnet/CoreCLR-is-now-open-source-on-GitHub)

Сборка приложений с .Net Core

=============================

Это очень здорово — видеть реализации .Net CoreFX и CoreCLR — в open source. И вы будете удивлены, какие типы приложений можно будет с ним построить. Есть два типа приложений, которые можно построить на текущий момент:

* ASP.NET 5 Web-приложения и сервисы

* Консольные приложения

Мы говорили про ASP.NET 5 приложения около года и теперь вы можете построить их используя как .Net Framework, так и CoreCLR/CoreFX. **ASP.NET 5 использует [mono runtime](http://www.mono-project.com/) и может работать как на Mac, так и на Linux**. Как только .Net Core станет поддерживать эти системы, вы сможете использовать его на этих платформах. Вы можете узнать больше, как работать с ASP.NET 5 из [блога команды ASP.NET](http://blogs.msdn.com/b/webdev/archive/tags/asp-net+5/) или на веб сайте [asp.net](http://asp.net). Также, если хотите попробовать ASP.NET 5 в деле прямо сейчас, то скачайте Preview версию MS Visual Studio 2015.

Мы хотим сделать возможным построение CoreFX и CoreCLR репозиториев и использовать результаты в приложениях ASP.NET 5, но пока это не является возможным по нескольким техническим причинам, однако мы работаем над этим. Конечная цель очень комплексная: мы должны иметь возможность сочетать изменений сообщества (forks) и наши собственные изменения и получать в итоге базовый стек для ваших приложений.

Консольный тип приложений позволяет понять что такое CoreCLR. Также он предоставляет очень гибкую базу для построения абсолютно любого приложения, какое бы вы ни захотели. Наибольший процент инфраструктуры. которую мы используем для тестирования использует именно этот тип приложения. Также вы можете построить свой собственный CoreCLR и запускать приложения поверх него.

.Net Core Console Apps

======================

На данный момент консольный тип приложений для .Net Core является побочным продуктом нашего технологического процесса. И в течении нескольких последующих месяцев мы будем формировать его как полностью готовый тип приложений, включая шаблоны кода в Visual Studio и отладчик (т.е. его нет, похоже, *— прим. перев.*). Также мы будем поддерживать OmniSharp для консольных приложений (кто не знает — Sublime text 3 based IDE для .NET). Так что, скоро у вас будет полноценная возможность сборки кросс-платформенных приложений, которые будут запускаться с одного исполняемого файла.

Ниже представлена первая демка консольного приложения, запущенного под CoreCLR.

Console App Walkthrough

=======================

Самый простой способ построить CoreCLR приложение — создать консольное приложение. Вы можете получить его из нашего нового corefxlab репозитория. Для того, чтобы использовать его, вы можете просто клонировать, скомпилировать и запустить с помощью командной строки:

```

cd .\corefxlab\demos\CoreClrConsoleApplications\HelloWorld

nuget restore

msbuild

.\bin\Debug\HelloWorld.exe

```

Конечно же, поскольку вы склонировали репозиторий, также вы можете открыть файл \*.sln в вашей копии Visual Studio. Прошу заметить что отладка пока не возможна… *Но ведь она только для тех, кто делает ошибки, так?*

Также вы можете модифицировать CoreCLR и запустить консольное приложение, которое будет использовать новый рантайм, который вы сами только что сделали, внеся изменения в ядро. На данный момент автоматизированной сборки не на самом высоком уровне, потому для того чтобы самостоятельно собрать ядро, на данный момент необходимо проделать следующие шаги:

1. Модифицируйте CoreCLR так, как этого велит ваше сердце

2. Постройте CoreCLR при помощи build.cmd x64 release

3. Скопируйте фалы из coreclr\binaries\x64\release в corfxlab\demos\CoreClrConsoleApplications\HelloWorld\NotYetPackages\CoreCLR:

1. coreclr.dll

2. CoreConsole.exe

3. mscorlib.dll

4. Перекомпилируйте HelloWorld.sln

Итого

=====

Мы готовились сделать CoreCLR открытым в течении нескольких месяцев, одновременно разрабатывая множество новых функций. Теперь у вас есть возможность наблюдать за ежедневной работой нашей команды коммит за коммитом (совершенно также, как и в CoreFX). Не стесняйтесь забрать себе репозиторий и наблюдать за этими изменениями. С нашей стороны мы будем наблюдать за списком Issues и PR чтобы иметь возможность следить за вашими пожеланиями.

Если вы взволнованы и настроены пообщаться с кем-либо, заходите на форумы .Net Foundation. Здесь вы найдете несколько веток, на которых вы можете узнать про CoreCLR получше. Также за ветками следят члены нашей команды, которые готовы отвечать на любые ваши вопросы.

У нас есть много чего, что надо сделать и следующая остановка — это [.Net Conf](http://www.dotnetconf.net/) — виртуальная конференция по .Net, которая намечена на март 2015 года и там мы надеемся показать вам хорошее демо | https://habr.com/ru/post/249645/ | null | ru | null |

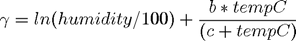

# Анализ данных погодной станции, основанной на Arduino

Создание собственной личной метеостанции стало намного проще, чем раньше. С учетом непостоянной погоды в Новой Англии, мы решили, что хотим создать нашу собственную метеостанцию и использовать MATLAB для анализа метеоданных.

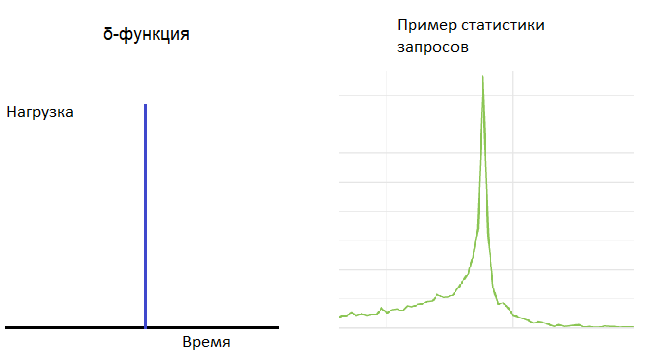

В статье мы ответим на следующие вопросы:

* В каком направлении дул ветер в течение последних 3-х часов?

* Как изменялись температура и точка росы в течение последней недели?

* На самом ли деле падает барометрическое давление при приближении грозы?

Понятно, что рассмотренные вопросы достаточно просты, но описанные приемы и команды помогут вам решать более сложные практические задачи.

Шаг 1: Размещение метеостанции

------------------------------

Во-первых, мы должны были решить, где разместить нашу метеостанцию. Мы решили сделать это на верхнем этаже автостоянки. Место было выбрано, поскольку оно было под воздействием погодных явлений, но также и имело крышу для монтажа электроники. Из-за того, что мы в конечном счете хотели отдавать данные стороннему агрегатору данных, мы должны были учитывать это при выборе места и железа.

Шаг 2: Выбор аппаратного обеспечения

------------------------------------

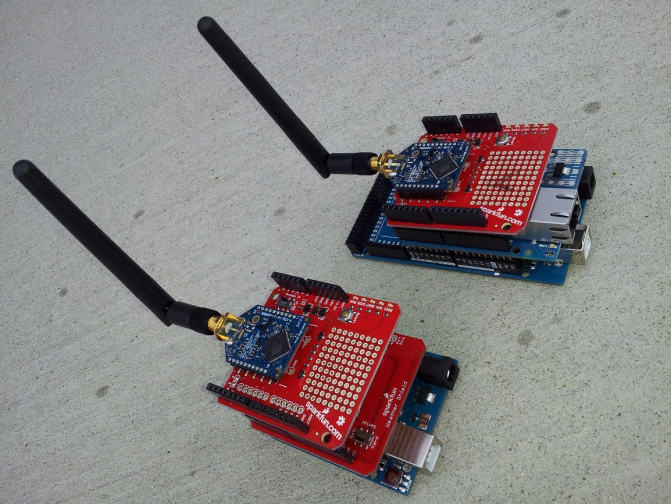

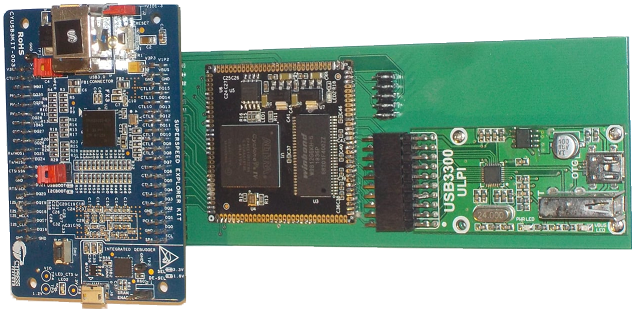

Выбранное расположение было вне радиуса действия Wi-Fi нашего здания, поэтому мы должны были найти способ передачи данных от станции к приемнику, который находился внутри соседнего здания.Чтобы сделать это, мы подсоединили Arduino Uno к передатчику высокой мощности XBee. Затем данные передаются в принимающий модуль XBee на Arduino Mega уже внутри здания. Этот Arduino был подключен к Интернету и данные отправляются в бесплатный сервис агрегации данных, [ThingSpeak.com](https://thingspeak.com/). Полный список аппаратуры, которую мы использовали в нашей установке приведен ниже.

Список оборудования

-------------------

* [Arduino Uno](https://www.sparkfun.com/products/11021) с [Weather shield](https://www.sparkfun.com/products/12081) и [датчиками погоды](https://www.sparkfun.com/products/8942)

* 2x [XBee Shield](https://www.sparkfun.com/products/10854) и 2x [модулей XBee с расширенным диапазоном](http://www.digi.com/products/wireless-wired-embedded-solutions/zigbee-rf-modules/point-multipoint-rfmodules/xbee-series1-module#overview) от Digi International

* [Arduino Mega](https://www.sparkfun.com/products/11061) с [Ethernet Shield](https://www.sparkfun.com/products/9026)

* 2 комплекта для монтажа [Arduino](https://www.sparkfun.com/products/11417)

* 2x 5В трансформатор для питания Arduino

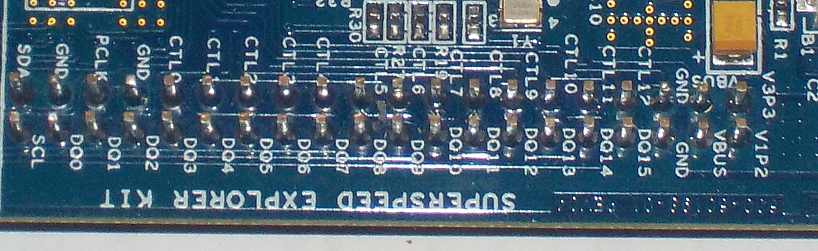

* [XBee Explorer Dongle](https://www.sparkfun.com/products/9819) для программирования передатчика XBee

Шаг 3: Подключение передатчика метеостанции и программирование наружной Arduino

-------------------------------------------------------------------------------

Внешнее Arduino установлено на гараже и отвечает за сбор измерений и передачу данных на Arduino в помещении. Для реализации такого обмена, сначала мы соединили контакты от Weather shield и XBee shield. Затем мы соединили XBee shield с Arduino Uno в соответствии с документацией, предоставленной с шилдами. В XBee shield есть XBee трансивер высокой мощности. Мы использовали программное обеспечение [X-CTU](http://www.digi.com/support/kbase/kbaseresultdetl?id=2125) для программирования нужного адреса получателя и загрузки нужной прошивки в XBee shield. Анемометр, датчики ветра дождя были подключены к weather shield с помощью разъемов RJ-45, входящими в комплект поставки.

Шаг 4: Подключение приемника погодной станции и программирование Arduino, находящегося в помещении

--------------------------------------------------------------------------------------------------

Внутреннее Arduino находится внутри нашего здания, и отвечает за получение данных от наружного Arduino, за проверку достоверности данных, и их отправку на ThingSpeak.Чтобы построить такую систему, сначала мы припаяли контакты на Ethernet shield и второй XBee shield.Затем мы вставили Ethernet shield и XBee shield в Мега Arduino в соответствии с документацией. Мы вновь использовали [X-CTU](http://www.digi.com/support/kbase/kbaseresultdetl?id=2125) для программирования необходимого адреса получателя и загрузки нужной прошивку на XBee shield.

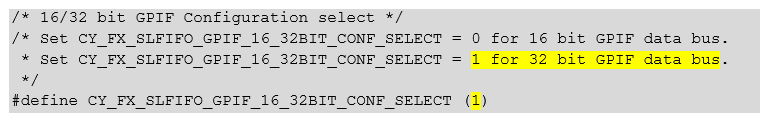

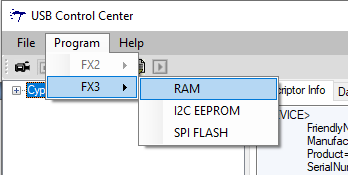

Далее, мы запрограммировали Arduino получить XBee сообщения и пересылать пакеты на ThingSpeak со скоростью один раз в минуту. Перед отправкой сообщения ThingSpeak, мы настроили учетную запись и сконфигурировали информацию о канале и расположении. Как только закончилась настройка передачи данных, мы начали анализировать данные в MATLAB.

*Обратите внимание, что для воспроизведения анализа, приведенного в статье, вам не нужно покупать и настраивать оборудование.Текущие данные нашей станции доступны на [канале 12 397](https://thingspeak.com/channels/12397).*

Шаг 5: Отвечаем на вопросы

--------------------------

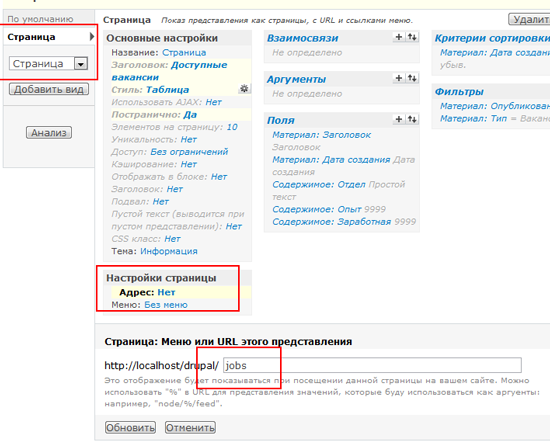

Получение данных о погоде из ThingSpeak

---------------------------------------

Чтобы ответить на наши первые два вопроса, мы используем команду

[```

thingSpeakFetch

```](http://www.mathworks.com/matlabcentral/fileexchange/46714-thingspeak-support-from-matlab) для просмотра доступных полей данных, одновременного импорта всех полей в MATLAB и хранения данных о температуре, влажности, скорости ветра, и направления ветра в своих переменных. Документация о [поддержке ThingSpeak](http://www.mathworks.com/thingspeak).

```

[d,t,ci] = thingSpeakFetch(12397,'NumPoints',8000); % fetch last 8000 minutes of data

```

8000 точек — это максимальное количество точек, которое ThingSpeak позволяет запросить за раз. Для нашей частоты измерений, это соответствует примерно 6 дням измерений.

```

tempF = d(:,4); % field 4 is temperature in deg F

baro = d(:,6); % pressure in inches Hg

humidity = d(:,3); % field 3 is relative humidity in percent

windDir = d(:,1);

windSpeed = d(:,2);

tempC = (5/9)*(tempF-32); % convert to Celsius

availableFields = ci.FieldDescriptions'

```

```

availableFields =

'Wind Direction (North = 0 degrees)'

'Wind Speed (mph)'

'% Humidity'

'Temperature (F)'

'Rain (Inches/minute)'

'Pressure ("Hg)'

'Power Level (V)'

'Light Intensity'

```

Вычисление некоторых основных статистических данных за период наблюдений и их визуализация

------------------------------------------------------------------------------------------

Чтобы получить лучшее понимание наших данных, мы находим минимальное, максимальное и среднее значения для данных, которые мы импортировали и мы находим время, для максимальных и минимальных значений.Это дает нам быстрый путь к валидации данных с нашей метеостанции.

```

[maxData,index_max] = max(d);

maxData = maxData';

times_max = datestr(t(index_max));

times_max = cellstr(times_max);

[minData,index_min] = min(d);

minData = minData';

times_min = datestr(t(index_min));

times_min = cellstr(times_min);

meanData = mean(d);

meanData = meanData'; % make column vector

summary = table(availableFields,maxData,times_max,meanData,minData,times_min) % display

```

```

summary =

availableFields maxData times_max

____________________________________ _______ ______________________

'Wind Direction (North = 0 degrees)' 338 '10-Jul-2014 05:01:32'

'Wind Speed (mph)' 6.3 '10-Jul-2014 12:47:14'

'% Humidity' 86.5 '15-Jul-2014 04:51:24'

'Temperature (F)' 96.7 '12-Jul-2014 16:28:55'

'Rain (Inches/minute)' 0.04 '15-Jul-2014 13:47:13'

'Pressure ("Hg)' 30.23 '11-Jul-2014 09:25:07'

'Power Level (V)' 4.44 '10-Jul-2014 10:25:01'

'Light Intensity' 0.06 '12-Jul-2014 13:23:38'

meanData minData times_min

_________ _______ ______________________

NaN 0 '10-Jul-2014 04:54:32'

3.0272 0 '10-Jul-2014 01:33:14'

57.386 25.9 '12-Jul-2014 13:39:39'

80.339 69.6 '11-Jul-2014 06:59:54'

5.625e-05 0 '10-Jul-2014 01:02:11'

30.04 29.78 '15-Jul-2014 13:04:08'

4.4149 4.38 '11-Jul-2014 09:22:06'

0.0092475 0 '10-Jul-2014 01:02:11'

```

Если мы получаем неожиданные значения, такие как максимальное атмосферное давление 40 атмосфер или максимальную температуру 1700 градусов, мы можем предположить, что данные некорректны. Такие ошибки могут происходить из-за ошибок передачи, выбросов напряжения и других причин. В конце статьи мы покажем некоторые способы обработки таких «выбросов», но для выгруженных данных, когда этот отчет был опубликован, все выглядит в порядке.

Для приведенного выше кода, мы использовали табличный тип данных, впервые введенный в MATLAB R2013b.См запись в [блоге](http://blogs.mathworks.com/loren/2013/09/10/introduction-to-the-new-matlab-data-types-in-r2013b/) для дальнейшего ознакомления с этим типом данных.

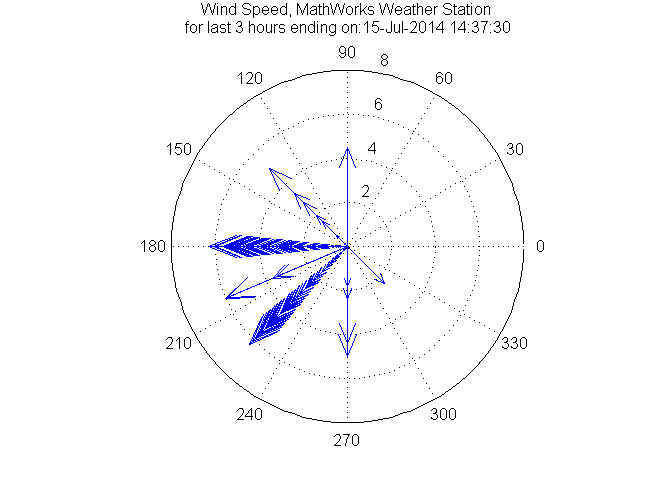

Визуализация ветра за последние три часа

----------------------------------------

Так как наша погодная станция получает метеорологические сводки примерно раз в минуту, мы смотрим на последние 180 минут, что бы ответить на наш вопрос о том, какой ветер был в последние 3 часа, и мы используем Compass plot в MATLAB, чтобы увидеть скорость и направление ветра в интересующий времени. Это математический компас, где Север (0 градусов) находится справа, и значения градуса увеличиваются против часовой стрелки. 90 градусов представляет Восток (вверху), 180 градусов представляет юг (слева) и 270 градусов представляет Запад (внизу). Если не произошло сдвига ветра из-за грозы или при лобовом проходе, компас, как правило, показывает преимущественное направление ветра, обозначенное стрелками более высокой плотности на графике. В случае данных, запрошенных в этом примере мы наблюдаем направление ветра преимущественно с юга и юго-запада, типичное для летнего времени в Новой Англии.

```

figure(1)

windDir = windDir((end-180):end); % last 3 hours

windSpeed = windSpeed((end-180):end);

rad = windDir*2*pi/360;

u = cos(rad) .* windSpeed; % x coordinate of wind speed on circular plot

v = sin(rad) .* windSpeed; % y coordinate of wind speed on circular plot

compass(u,v)

titletext = strcat(' for last 3 hours ending on: ',datestr(now));

title({'Wind Speed, MathWorks Weather Station'; titletext})

```

Расчет точки росы

-----------------

Теперь мы готовы ответить на наш второй вопрос о том, как температура и точка росы менялись в течении

прошлой недели.Точка росы — это температура, при которой воздух (при охлаждении) становится насыщенным водяным паром. Чем более влажность воздушной массы, тем выше точка росы. Точка росы также иногда используется как мера дискомфорта. Когда точка росы превышает 65 градусов (+18С), многие люди начинают говорить, что воздух «липкий». При точке росы за 70 многие чувствуют себя некомфортно. Общая оценка для точки росы, TDP, может быть найдена с помощью уравнения и постоянных, как показано ниже:

где

с

Теперь, написав приведенные выше уравнения, как код MATLAB мы имеем:

```

b = 17.62;

c = 243.5;

gamma = log(humidity/100) + b*tempC ./ (c+tempC);

tdp = c*gamma ./ (b-gamma);

tdpf = (tdp*1.8) + 32; % convert back to Fahrenheit

```

Визуализация температуры, влажности воздуха и точки росы в зависимости от времени

---------------------------------------------------------------------------------

Теперь, когда мы рассчитали точку росы, мы готовы визуализировать данные и наблюдать их поведение в течение последних 5 или 6 дней.

```

figure(2)

[ax, h1, h2] = plotyy(t,[tempF tdpf],t,humidity);

set(ax(2),'XTick',[])

set(ax(2),'YColor','k')

set(ax(1),'YTick',[0,20,40,60,80,100])

set(ax(2),'YTick',[0,20,40,60,80,100])

datetick(ax(1),'x','keeplimits','keepticks')

set(get(ax(2),'YLabel'),'String',availableFields(3))

set(get(ax(1),'YLabel'),'String',availableFields(4))

grid on

legend('Location','South','Temperature','Dew point', 'Humidity')

```

Во время обычной недели, вы можете ясно видеть суточные изменения температуры и влажности. Как и ожидалось относительная влажность, как правило, возрастает ночью (при понижении температуры к точке росы) и максимальные температуры, как правило, достигаются во второй половине дня.Температура точки росы указывает влажность воздушных масс. Когда мы собрали данные для публикации этого примера, вы можете видеть, что точка росы была более 70 градусов, что является типичной для жаркого и влажного летнего дня в Новой Англии.Если вы запустите этот код в MATLAB, вы можете получить разные ответы, по мере того, как вы будете запрашивать самые последние данные, сообщенные метеостанцией.

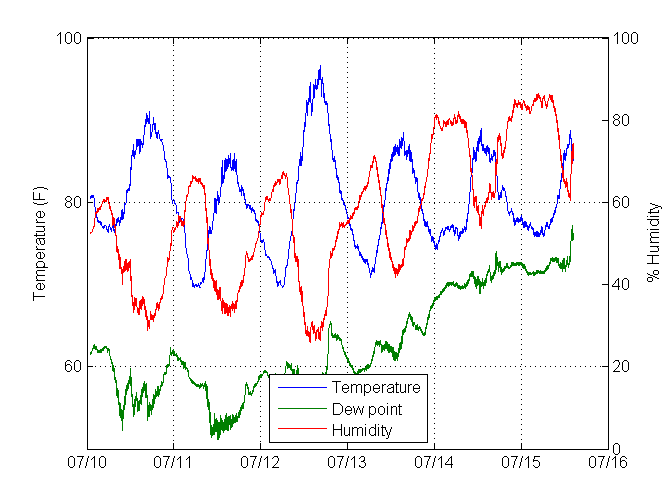

Получение и обработка данных о погоде за дождливый день в Новой Англии

----------------------------------------------------------------------

Последний вопрос, на который мы хотели ответить — действительно ли атмосферное давление падает перед дождем? Чтобы сделать это, мы получили данные из метеостанции за известный дождливый день. На этот раз, мы заинтересованы в барометрическом давлении и количестве осадков. Мы использовали датчик самостоятельного опорожнения, который опорожняется, когда он заполнен. Наш датчик вращается и опорожняется, когда выпало 0,01 дюймов осадков.Наш код Arduino считает количество опорожнений за каждую минуту и передает соответствующее значение осадков в ThingSpeak. Мы используем MATLAB для выборки из наших данных почасовых образцов, чтобы мы могли легко увидеть накопление осадков и тенденции давления.

```

[d,t,ci] = thingSpeakFetch(12397,'DateRange',{'6/4/2014','6/6/2014'}); % get data

baro = d(:,6); % pressure

extraData = rem(length(baro),60); % computes excess points beyond the hour

baro(1:extraData) = []; % removes excess points so we have even number of hours

rain = d(:,5); % rainfall from sensor in inches per minute

```

Действительно ли шел ливень 5 июня? Это трудно сказать, если мы просто посмотрим на каждую минуту передачи данных, так как максимальное значение составляет всего 0,01 дюйма. Однако, если суммировать все осадки за 5 июня, мы видим, что мы получили 0,48 дюйма осадков, что составляет 13% от среднемесячного 3,68 дюйма, что показывает, что день был действительно очень дождливым. Чтобы получить более полное представление о том, когда выпал максимум осадков, мы преобразовали данные в часовые данные, как показано ниже.

```

rain(1:extraData) = [];

t(1:extraData) = [];

rainHourly = sum(reshape(rain,60,[]))'; % convert to hourly summed samples

maxRainPerMinute = max(rain)

june5rainfall = sum(rainHourly(25:end)) % 24 hours of measurements from June 5

baroHourly = downsample(baro,60); % hourly samples

timestamps = downsample(t,60); % hourly samples

```

```

maxRainPerMinute =

0.0100

june5rainfall =

0.4800

```

Визуализация данных о почасовой облачности и давления и нахождение тренда давления

----------------------------------------------------------------------------------

После того как мы предварительно обработали наши данные, мы готовы визуализировать их. Здесь мы используем MATLAB, для нахождения линии тренда к данным барометрического давления. Если построить график, увидим ли мы падение давления перед тяжелым ливнем?

```

figure(3)

subplot(2,1,1)

bar(timestamps,rainHourly) % plot rain

xlabel('Date and Time')

ylabel('Rainfall (inches /per hour)')

grid on

datetick('x','dd-mmm HH:MM','keeplimits','keepticks')

title('Rainfall on June 4 and 5')

subplot(2,1,2)

hold on

plot(timestamps,baroHourly) % plot barometer

xlabel('Date and Time')

ylabel(availableFields(6))

grid on

datetick('x','dd-mmm HH:MM','keeplimits','keepticks')

detrended_Baro = detrend(baroHourly);

baroTrend = baroHourly - detrended_Baro;

plot(timestamps,baroTrend,'r') % plot trend

hold off

legend('Barometric Pressure','Pressure Trend')

title('Barometric Pressure on June 4 and 5')

```

После того, как мы визуализируем эти данные и посмотрим на тренд, мы ясно видим, что атмосферное давление действительно падает ровно до начала осадков!

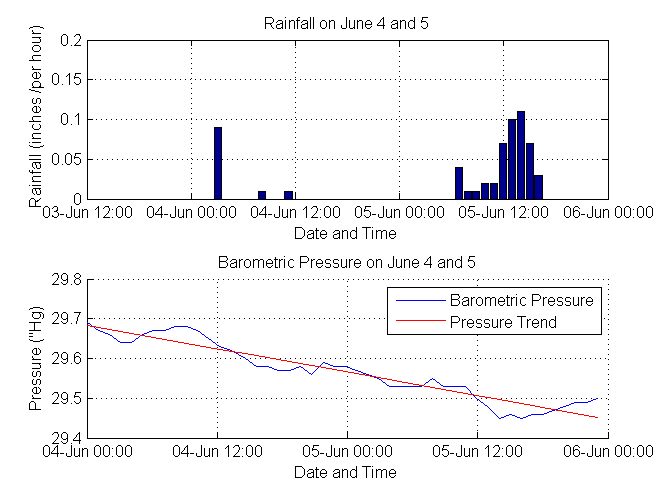

Очистка данных от недостоверных измерений

-----------------------------------------

Наши вопросы были довольно простыми, но иногда возникают проблемы с имеющимися данными. Например, 30 мая, мы записали несколько недостоверных данных о температуре. Давайте посмотрим, как использовать MATLAB для их фильтрации.

```

[d,t] = thingSpeakFetch(12397,'DateRange',{'5/30/2014','5/31/2014'});

rawTemperatureData = d(:,4);

newTemperatureData = rawTemperatureData;

minTemp = min(rawTemperatureData) % wow that is cold!

```

```

minTemp =

-1.7662e+03

```

Использование порогового фильтра для удаления выброса данных

------------------------------------------------------------

Удаление элементов, которые не прошли пороговый тест. В этом случае, у нас есть некоторые значения, которые заведомо недостоверны, такие как значение температуры -1766 градусов по Фаренгейту. Поэтому можно использовать данные, которые включают в себя только значения температуры, между 0 и 120, которые являются приемлемыми величинами для весеннего дня в Новой Англии.

```

tnew = t';

outlierIndices = [find(rawTemperatureData < 0); find(rawTemperatureData > 120)];

tnew(outlierIndices) = [];

newTemperatureData(outlierIndices) = [];

```

Построим графики очищенных и исходных данных.

```

figure(4)

subplot(2,1,2)

plot(tnew,newTemperatureData,'-o')

datetick

xlabel('Time of Day')

ylabel(availableFields(4))

title('Filtered Data - outliers deleted')

grid on

subplot(2,1,1)

plot(t,rawTemperatureData,'-o')

datetick

xlabel('Time of Day')

ylabel(availableFields(4))

title('Original Data')

grid on

```

Использование медианного фильтра для удаления недостоверных данных

------------------------------------------------------------------

Еще один способ удаления плохих данных — применить медианный фильтр. Медианный фильтр не требует столько знаний о наборе данных. Он будет просто удаляет значения, которые оказываются вне среднего ближайших соседей. Результаты фильтрации — вектор той же длины что и исходный, в отличие от удаление точек данных, что приводит к разрывам в данных и укорачиванию записи. Этот тип фильтра также может быть использован для удаления шума из сигнала.

```

n = 5; % this value determines the number of total points used in the filter

```

Большие значения n обозначают количество «соседей» для сравнения. При температурах, собранных раз в минуту, мы выбираем n = 5, потому что температура не должна, как правило, сильно меняться в течение 5 минут.

```

f = medfilt1(rawTemperatureData,n);

figure(5)

subplot(2,1,2)

plot(t,f,'-o')

datetick

xlabel('Time of Day')

ylabel(availableFields(4))

title('Filtered Data - using median filter')

grid on

subplot(2,1,1)

plot(t,rawTemperatureData,'-o')

datetick

xlabel('Time of Day')

ylabel(availableFields(4))

title('Original Data')

grid on

```

Вывод

-----

Итак, мы проанализировали данные с нашей метеостанции и ответили на интересующие нас вопросы.

Мы также продемонстрировали некоторые способы фильтрации данных, которые не проходят первоначальную проверку.

Вопросы, поставленные в статье, элементарны, но подумайте чего можно добиться собирая данные с тысячи станций? Кроме этого можно измерять и анализировать real-time изменения промышленных и научных систем и принимать решения на основе данных.

Напоминаем, что для воспроизведения анализа, приведенного в статье, вам не нужно покупать и настраивать оборудование. Оперативные данные из нашей установки доступны на канале 12 397 на ThingSpeak.com.

[MATLAB код проекта](http://www.mathworks.com/matlabcentral/fileexchange/47049) | https://habr.com/ru/post/256413/ | null | ru | null |

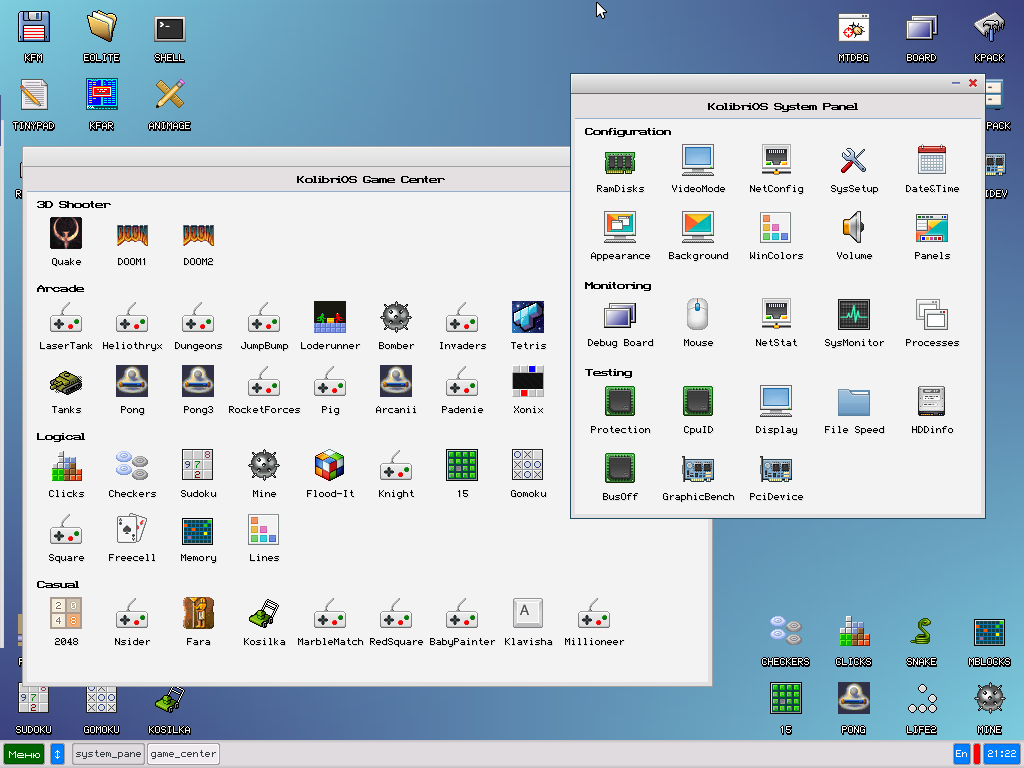

# RDP (не)тонкий клиент c Linux на базе Неттопов (Nvidia ION, Intel Atom)

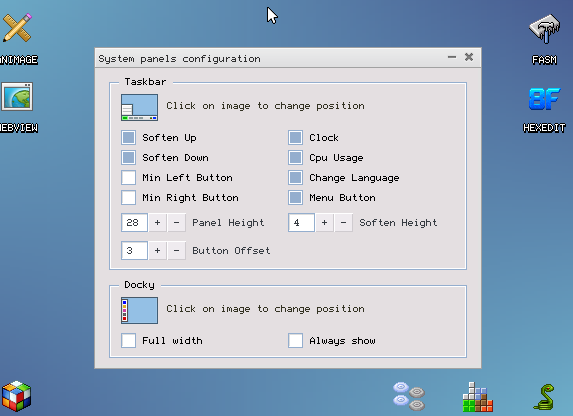

В сегодняшний век повсеместной виртуализации возникает необходимость экономить на всем. Наиболее значимые для любого системного администратора сущности, это:

* Время (затраты на обслуживание системы)

* Железо (различные сбои, потеря производительности, устаревание)

* ПО (лицензионная составляющая, защита от вирусов, централизация управления приложениями)

В своей статье я рассматриваю реализацию (не)тонкого клиента на базе ОС Linux, как прослойке между аппаратной составляющей и привычным интерфейсом ОС Windows.

(Не)тонкий клиент, в моем понимании, это дистрибутив ОС Linux обладающий следующими свойствами: