text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# 3D ML. Часть 4: дифференциальный рендеринг

В нескольких предыдущих заметках данной серии мы уже упоминали понятие ***дифференциального рендеринга***. Сегодня пришло время разъяснить что это такое и с чем это едят.

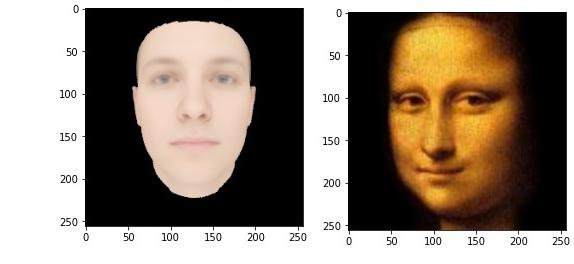

Мы поговорим о том, почему традиционный пайплайн рендеринга не дифференцируем, зачем исследователям в области ***3D ML*** потребовалось сделать его дифференцируемым и как это связано с нейронным рендерингом. Какие существуют подходы к конструированию таких систем, и рассмотрим конкретный пример — ***SoftRasterizer*** и его реализацию в ***PyTorch 3D***. В конце, с помощью этой технологии, восстановим все пространственные характеристики “Моны Лизы” Леонардо Да Винчи так, если бы картина была не написана рукой мастера, а отрендерена с помощью компьютерной графики.

Серия 3D ML на Хабре:

1. [Формы представления 3D данных](https://habr.com/ru/company/itmai/blog/503358/)

2. [Функции потерь в 3D ML](https://habr.com/ru/company/itmai/blog/504416/)

3. [Датасеты и фреймворки в 3D ML](https://habr.com/ru/company/itmai/blog/516404/)

4. Дифференциальный рендеринг

5. [Сверточные операторы на графах](https://habr.com/ru/company/itmai/blog/533746/)

[Репозиторий](https://github.com/phygitalism/3DML-Habr-paper) на GitHub для данной серии заметок.

Заметка от партнера IT-центра МАИ и организатора магистерской программы “[VR/AR & AI](https://priem.mai.ru/master/programs/item/index.php?id=103770)” — компании [PHYGITALISM](http://phygitalism.com/).

Rendering pipeline: forward and inverse

---------------------------------------

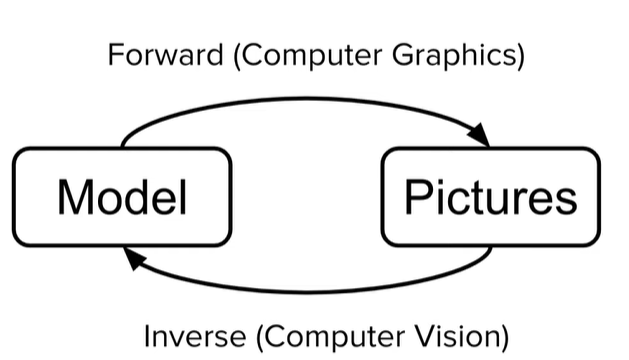

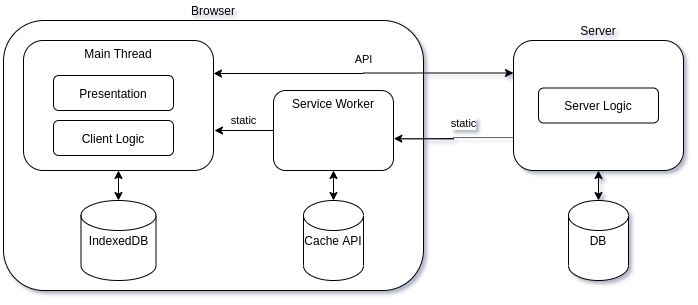

Если мы рассматриваем все возможные задачи, в которых требуется как-то взаимодействовать с 3D моделями, то глобально появляется возможность разделить их на два класса задач:

* Задачи, в которых из 3D сцены мы хотим сгенерировать изображение (такие задачи можно отнести к традиционным задачам компьютерной графике) т.н. forward rendering;

* Задачи, где по изображению нам требуется восстанавливать параметры 3D объектов (такие задачи относятся скорее к компьютерному зрению) т.н. inverse rendering.

До недавнего времени два этих класса задач обычно рассматривались отдельно друг от друга, но сегодня все чаще приходится иметь дело с алгоритмами, которые должны работать в обе стороны (особенно это касается области машинного обучения).

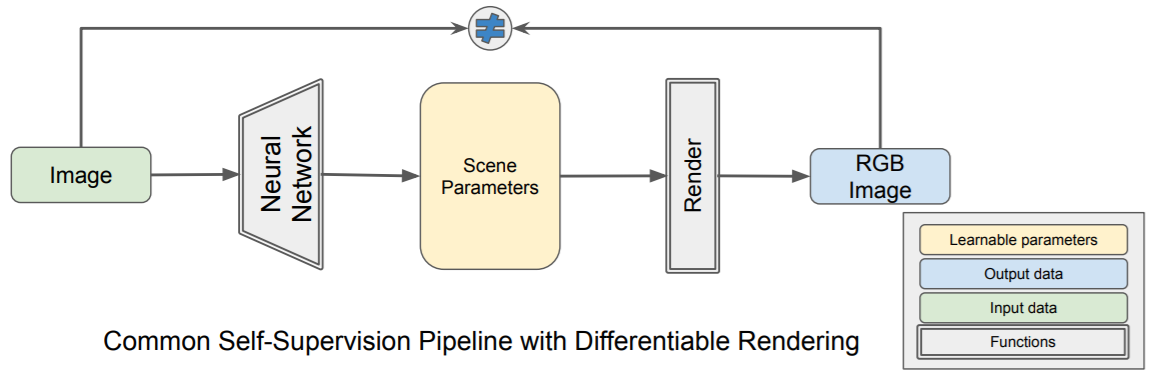

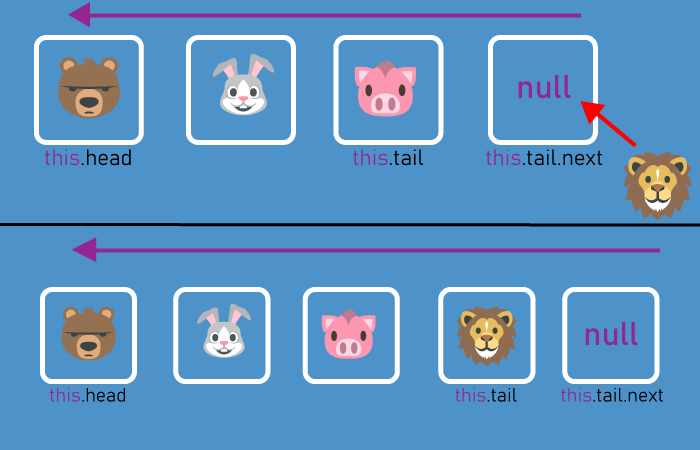

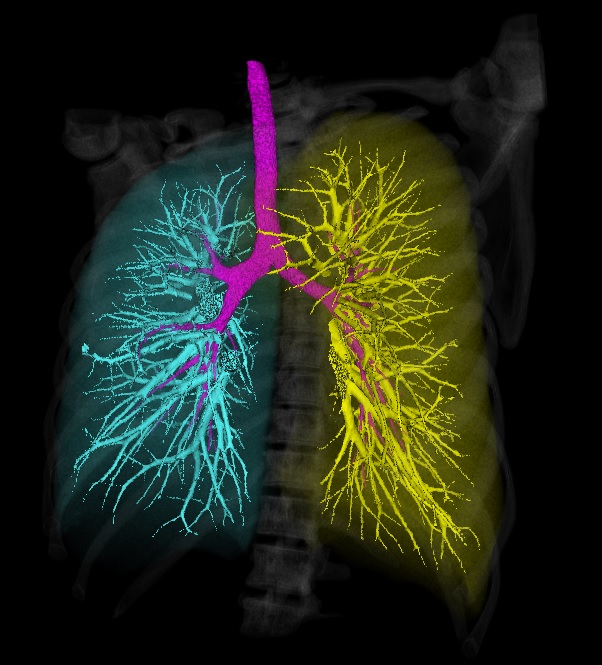

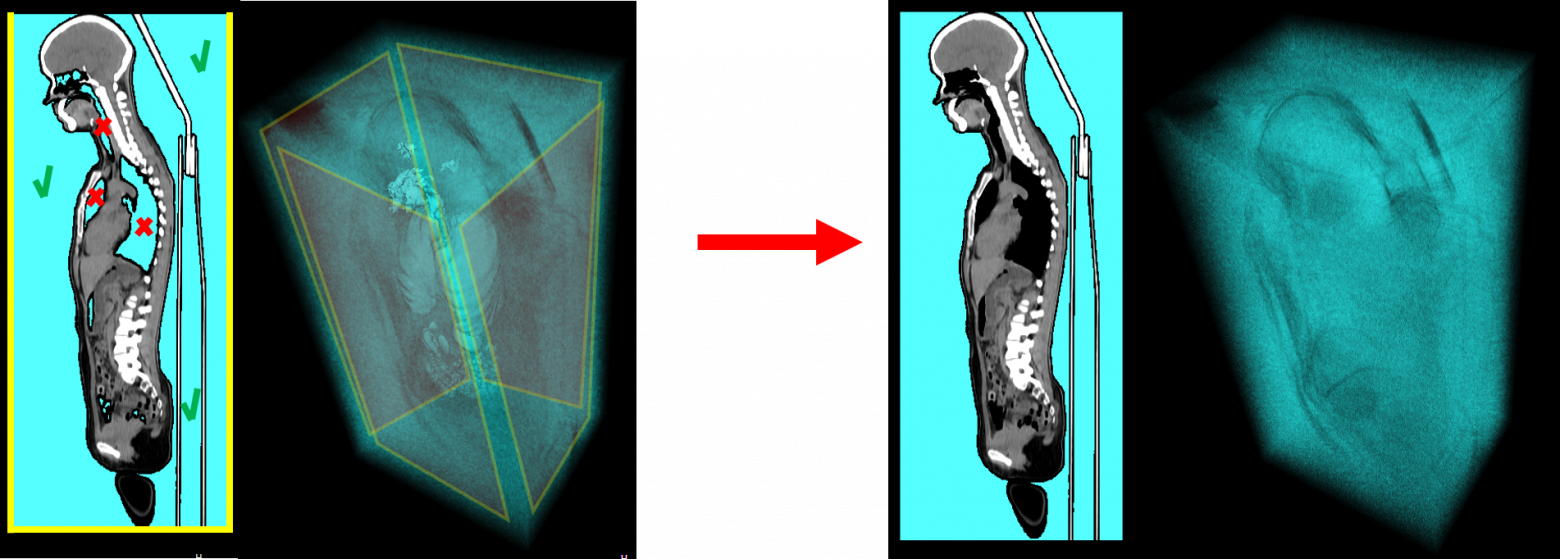

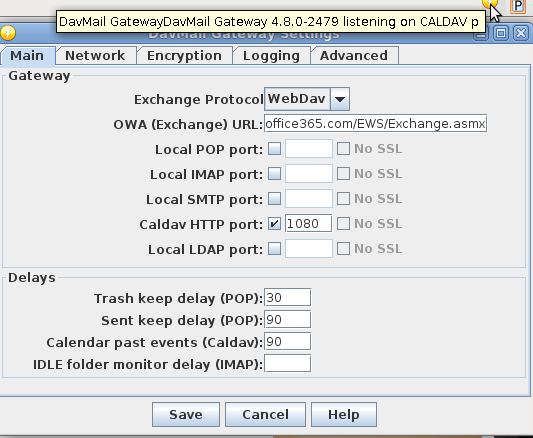

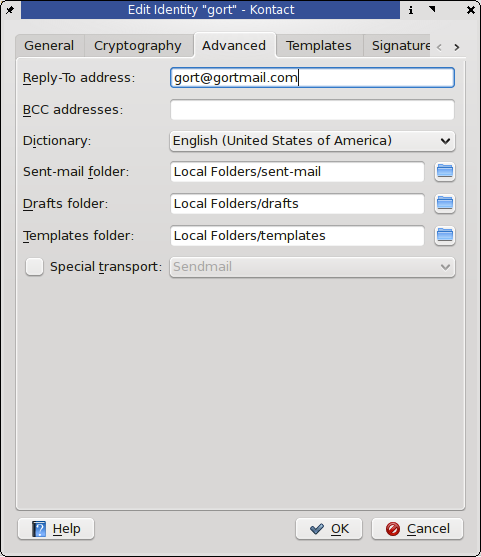

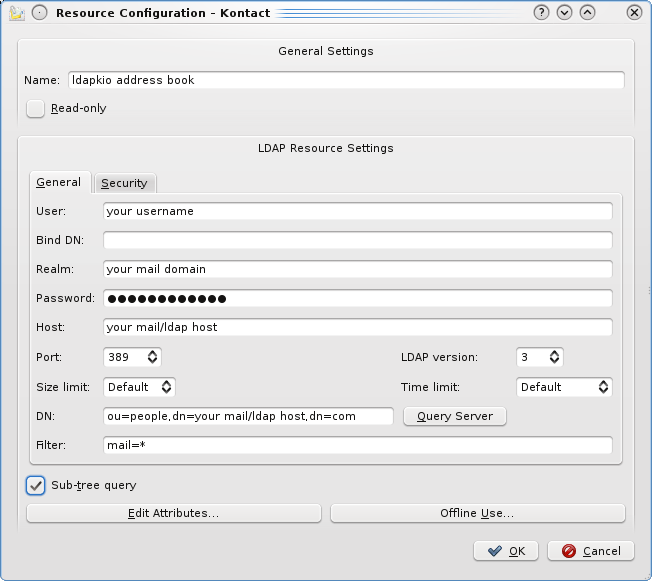

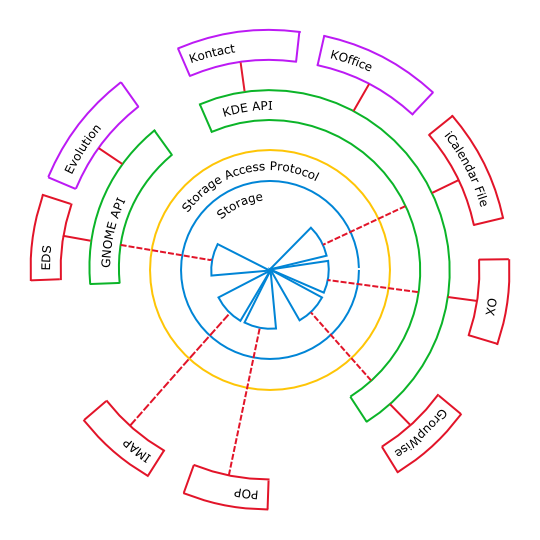

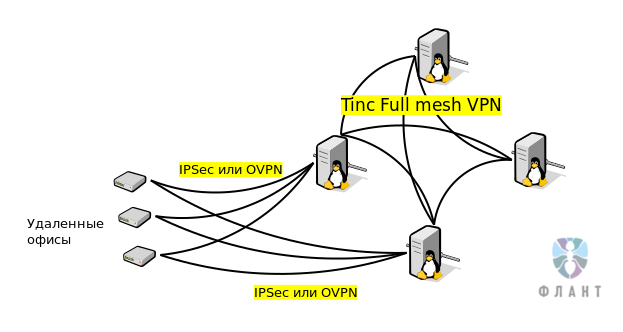

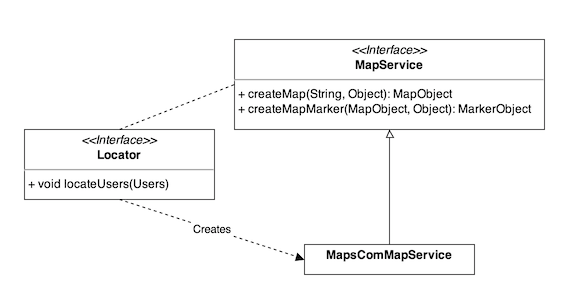

*Рис.1 Из презентации TensorFlow Graphics ([github page](https://github.com/tensorflow/graphics)).*

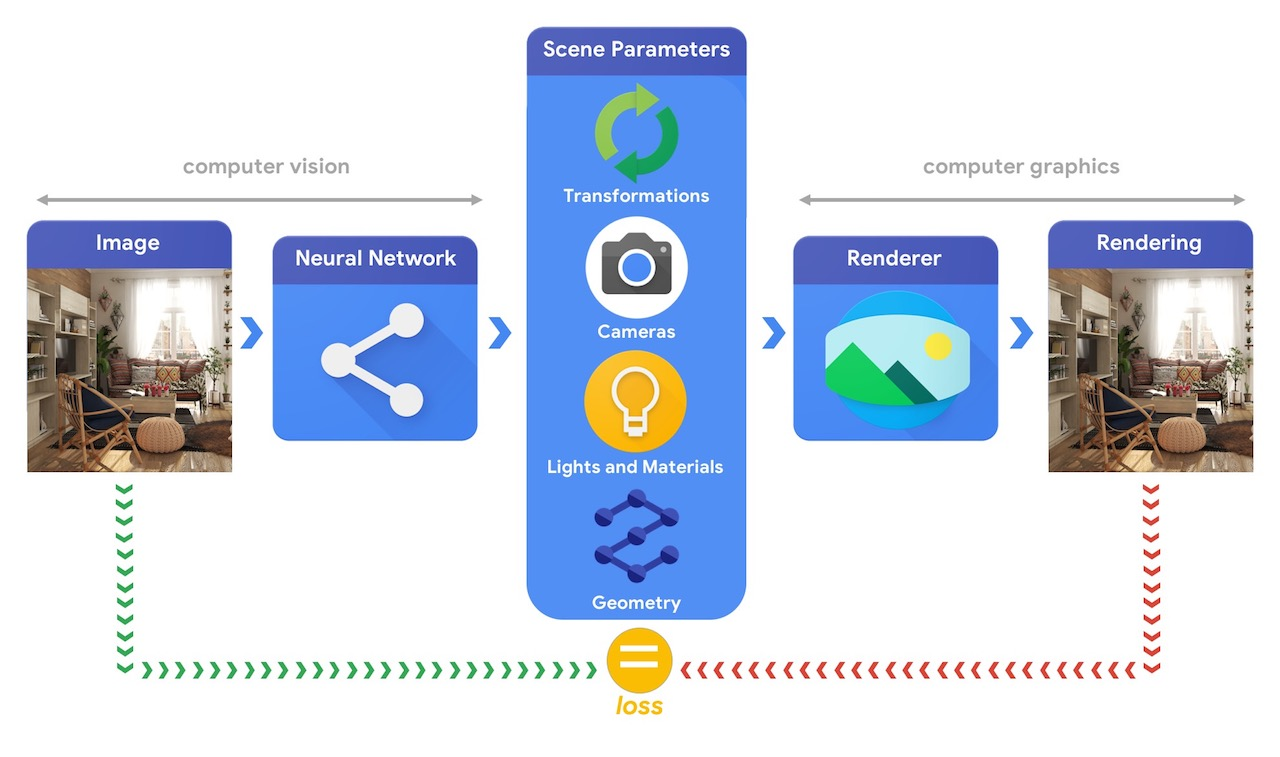

В качестве примера такой задачи, можно рассмотреть задачу *“3D mesh reconstruction from single image”*, которую мы уже упоминали в предыдущих заметках. С одной стороны, эту задачу можно решать сравнивая ошибку рассогласования между исходной моделью и предсказанной с помощью функций потерь для 3D объектов (заметка №2 данной серии). С другой стороны, можно генерировать 3D объект сначала, а после его отрендеренную картинку сравнивать с изображением-образцом (пример на рис.2).

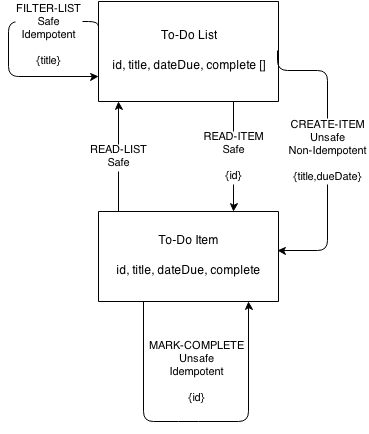

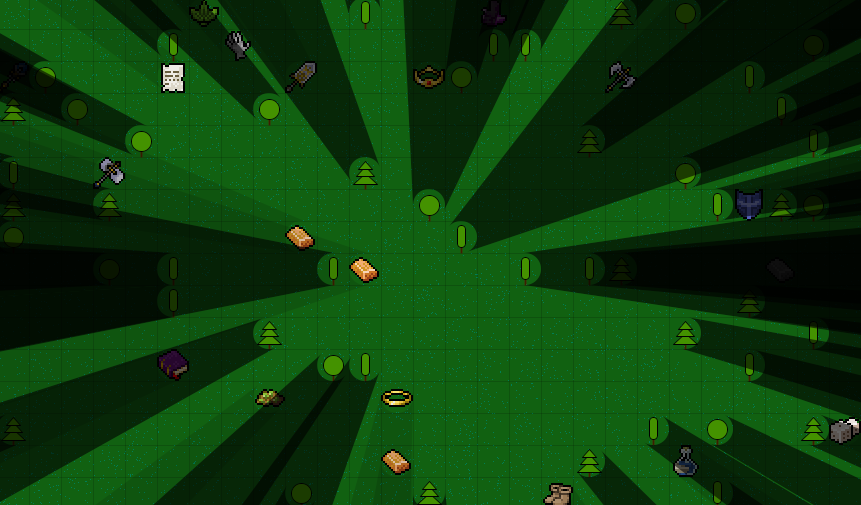

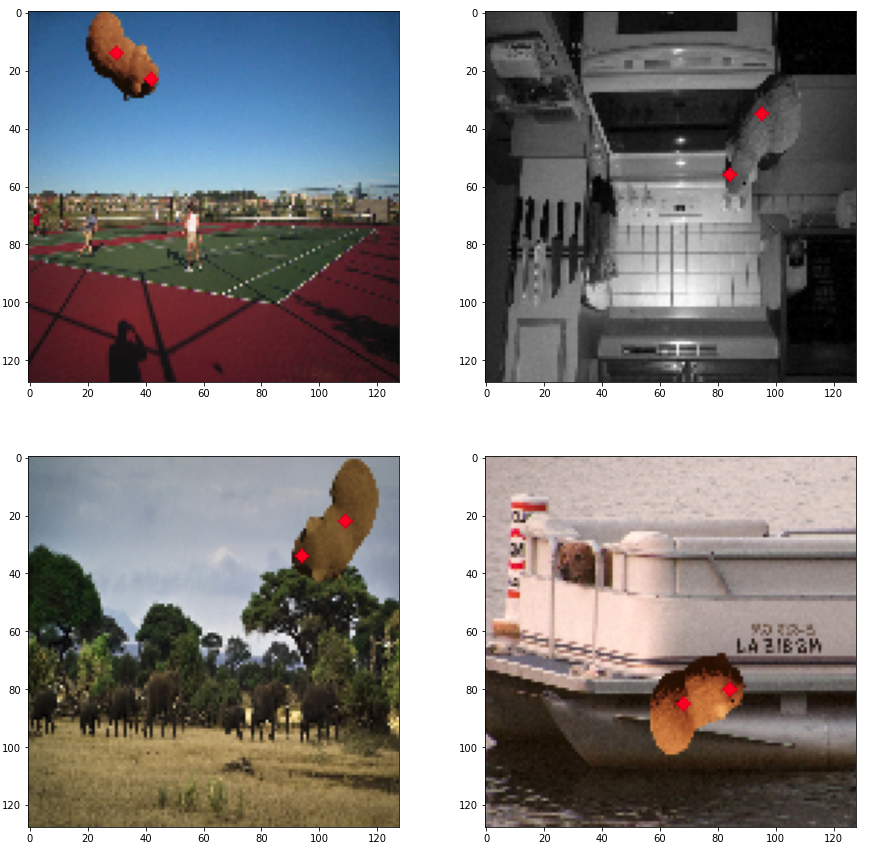

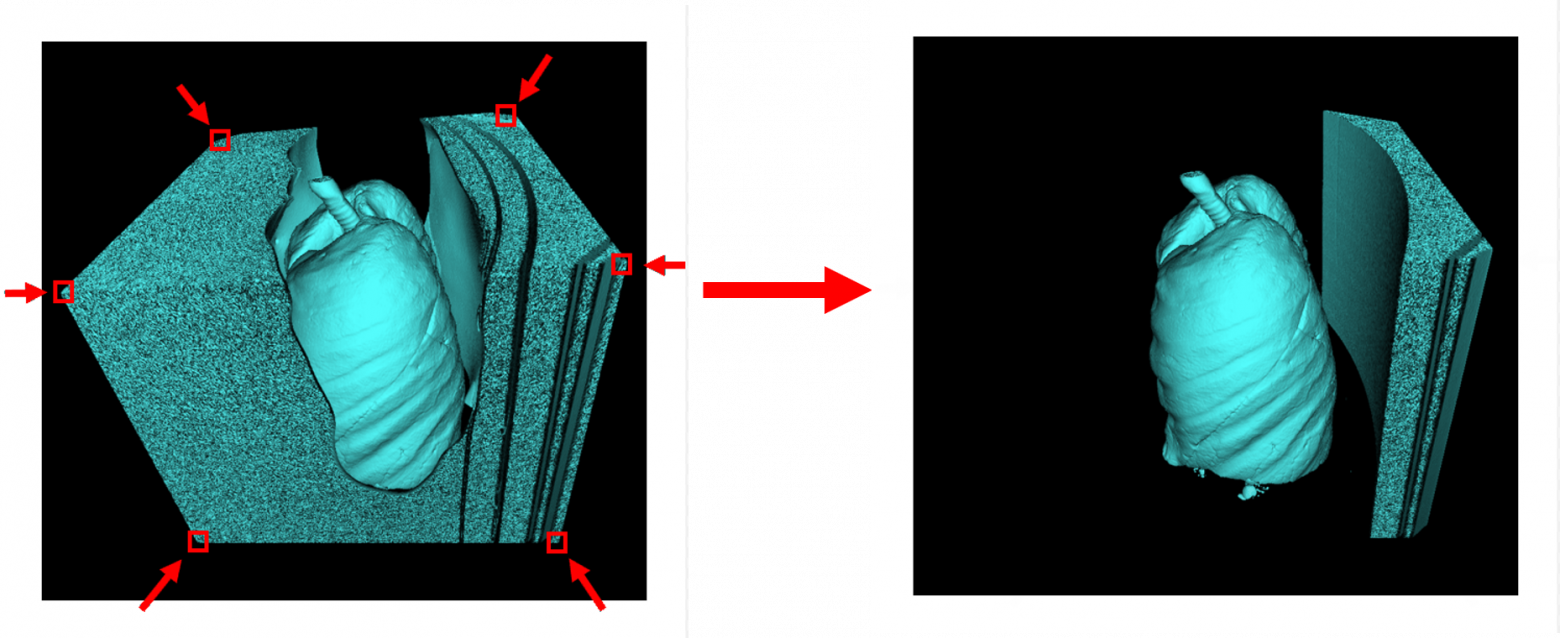

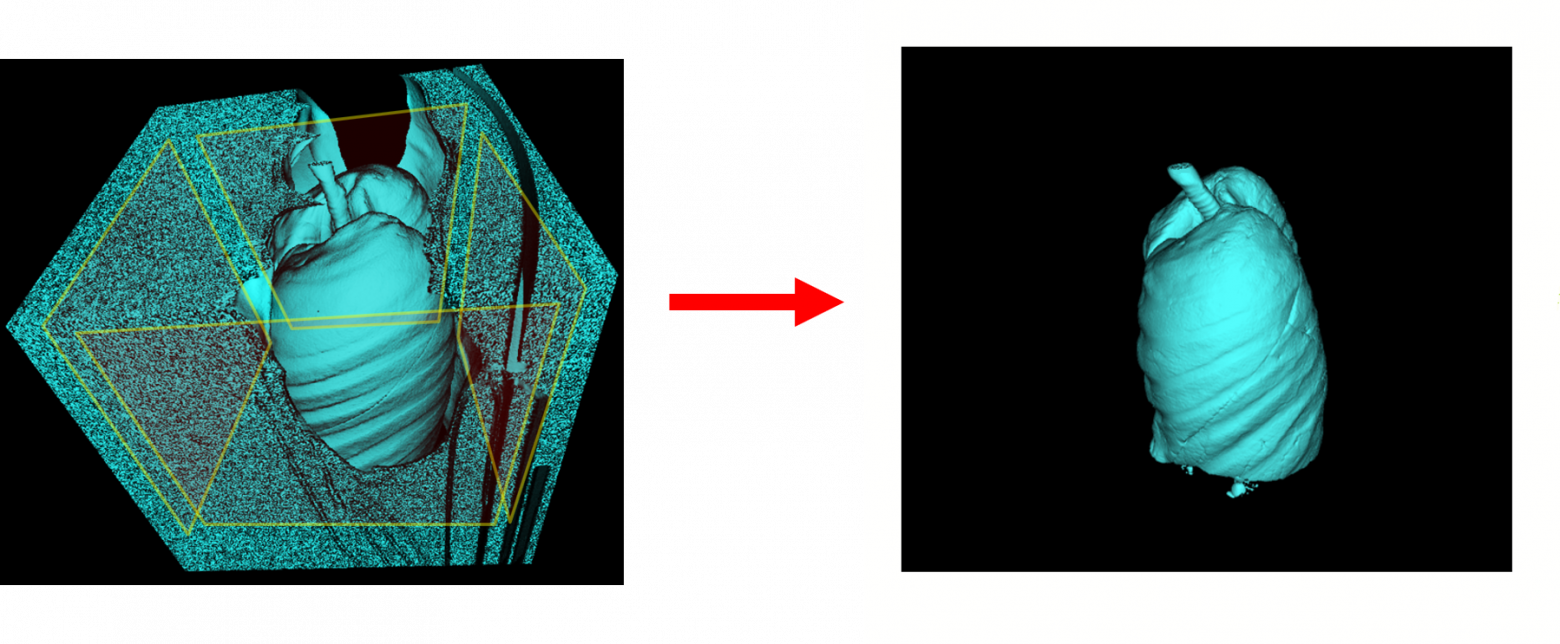

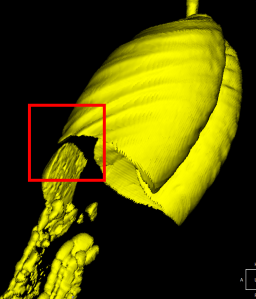

*Рис.2.1 Модель деформации меша с помощью модуля дифференциального рендеринга SoftRas ([github page](https://github.com/ShichenLiu/SoftRas)).*

*Рис.2.2 Пайплайн обучения в задаче генерации формы 3D объекта по входному изображения без 3D датасета из обзорной статьи [[9](https://arxiv.org/pdf/2006.12057.pdf)].*

Далее, при разговоре про рендеринг, мы будем рассматривать несколько основных компонентов 3D сцены:

* 3D объект, описываемый своим мешем;

* камера с набором характеристик (позиция, направление, раствор и т.д.);

* источники света и их характеристики;

* глобальные характеристики расположения объекта на сцене, описываемые матрицами преобразований.

Процедура прямого рендеринга заключается в функциональном сочетании этих основных компонент, а процедура обратного рендеринга заключается в восстановлении этих компонент по готовому изображению.

Давайте поговорим сначала о том, из каких этапов состоит традиционный пайплайн прямого рендеринга и почему он не является дифференцируемым.

Why is rendering not differentiable?

------------------------------------

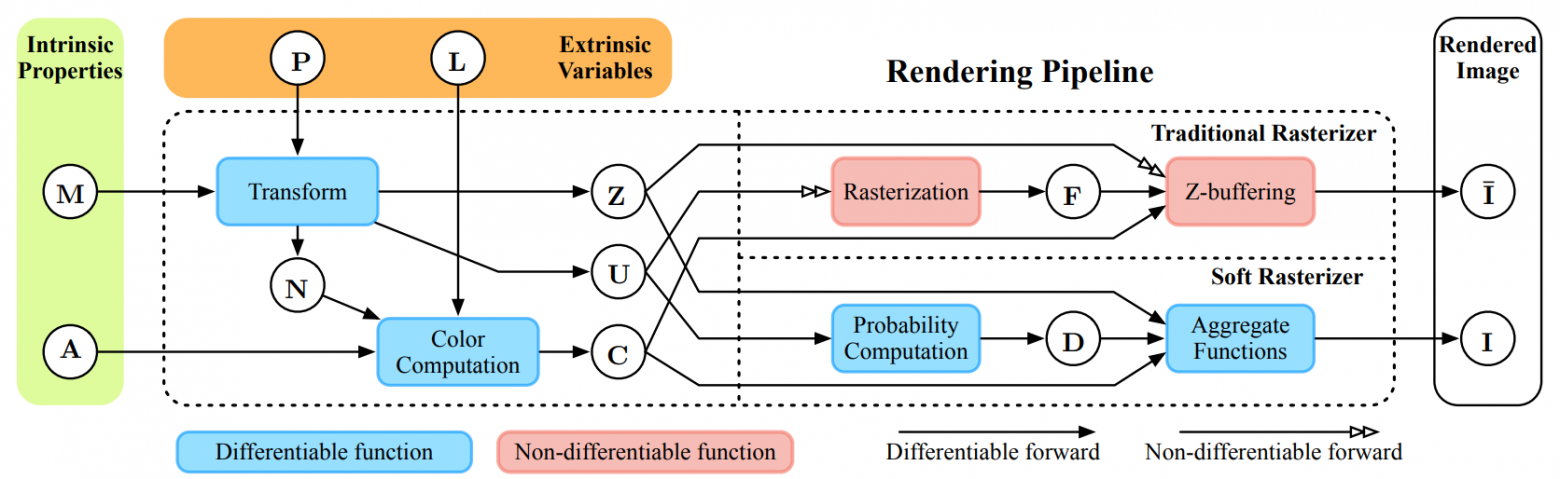

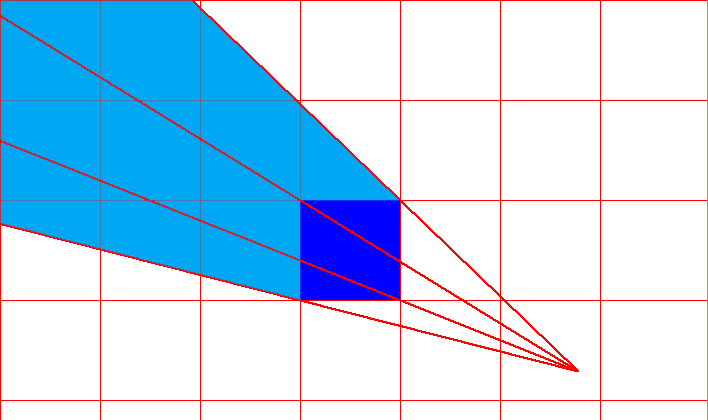

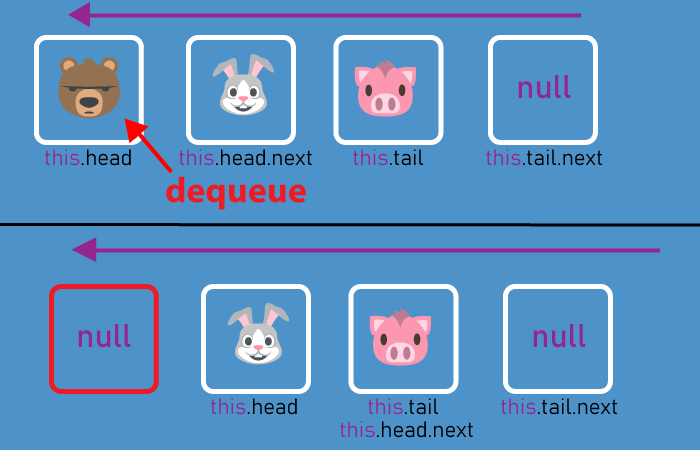

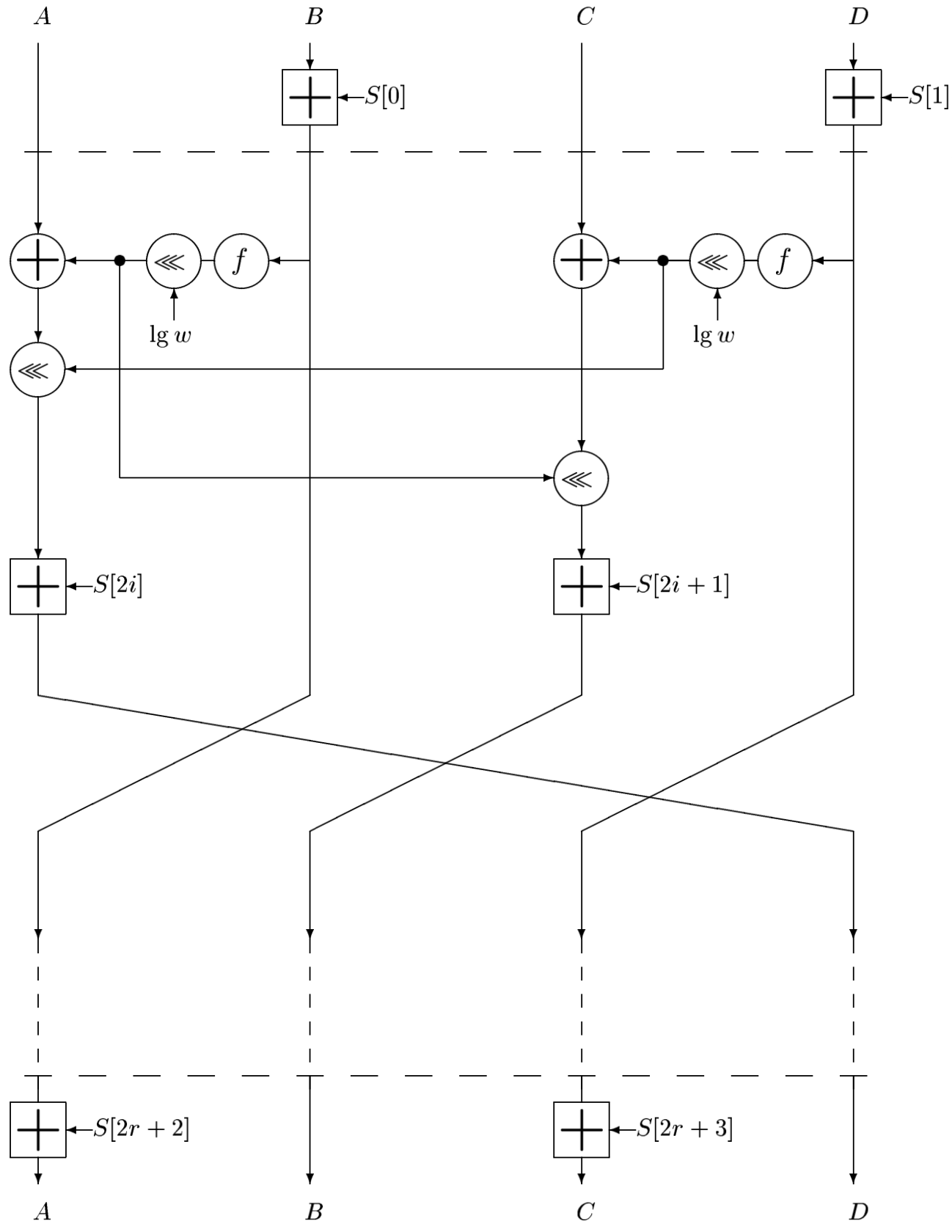

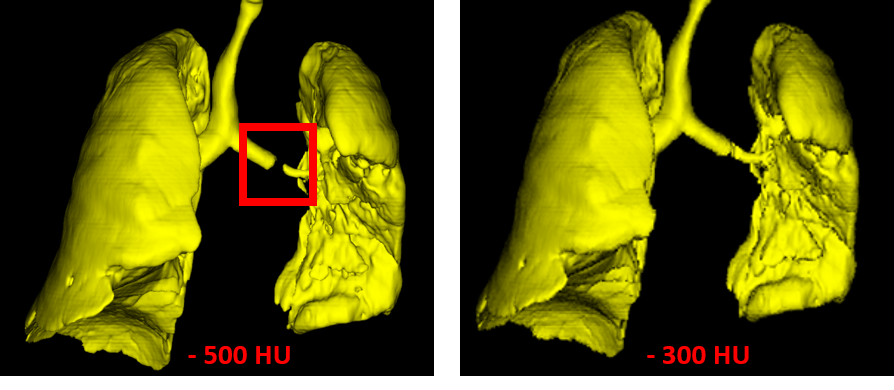

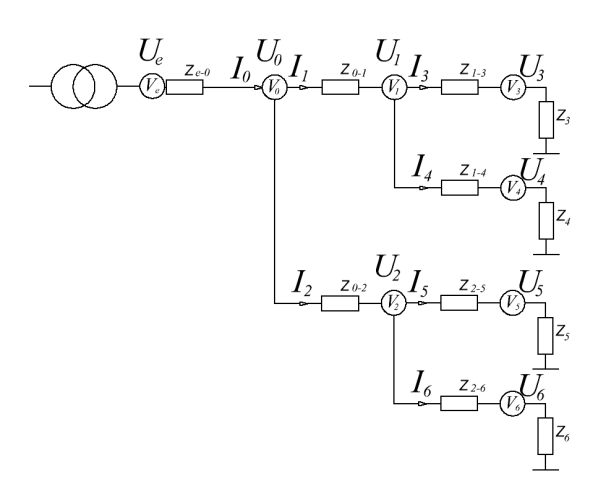

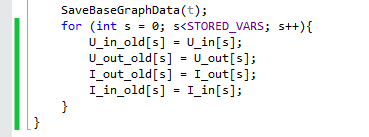

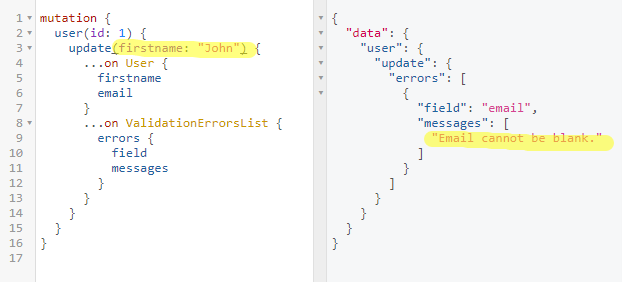

*Рис.3 Схема традиционного рендеринга и рендеринга методом Soft Rasterizer [1]. Здесь:  — меш объекта на сцене,  — модель камеры,  — модель источника освещения,  — модель текстуры,  — карта нормалей для меша,  — карта глубины получаемого изображения,  — матрица преобразования 3D в 2D для получения плоского изображения,  — растеризованное изображение,  — вероятностные карты метода Soft Rasterizer,  — изображения полученные традиционным рендерингом и методом SoftRas соответственно. Красные блоки — недифференцируемые операции, синии — дифференцируемые.*

Процедуру рендеринга можно подразделить на несколько взаимозависимых этапов (этапы традиционного рендеринга приведены на рис.3 — врехняя линия в правой части). Какие-то этапы, к примеру вычисления освещения и позиции камеры, являются дифференцируемыми, поскольку в них участвуют непрерывные функциональные зависимости (см. [модель Фонга](https://ru.wikipedia.org/wiki/%D0%97%D0%B0%D1%82%D0%B5%D0%BD%D0%B5%D0%BD%D0%B8%D0%B5_%D0%BF%D0%BE_%D0%A4%D0%BE%D0%BD%D0%B3%D1%83), на Хабре о ней и моделях освещения писали [здесь](https://habr.com/ru/post/333932/) и [здесь](https://habr.com/ru/post/353054/)), но два последних этапа не являются дифференцируемыми. Давайте разберемся почему.

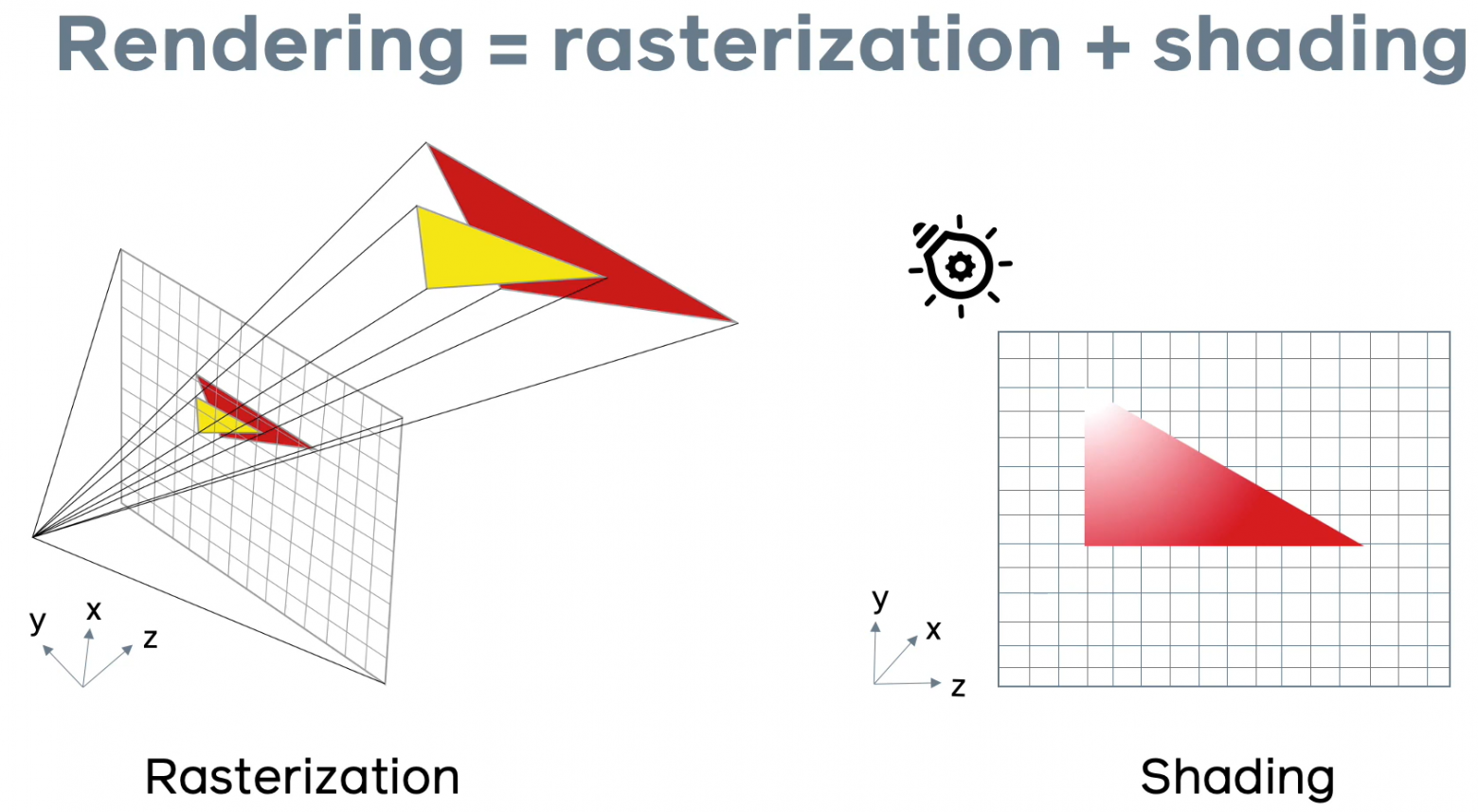

Последние два этапа, которые являются по сути и ключевыми — это [растеризация](https://ru.wikipedia.org/wiki/%D0%A0%D0%B0%D1%81%D1%82%D0%B5%D1%80%D0%B8%D0%B7%D0%B0%D1%86%D0%B8%D1%8F) и [шейдинг](https://ru.wikipedia.org/wiki/%D0%A8%D1%8D%D0%B9%D0%B4%D0%B8%D0%BD%D0%B3). (Про реализацию этих этапов на JavaScript на Хабре писали [здесь](https://habr.com/ru/post/342708/)).

Грубо говоря, проблему недифференцируемости растеризации можно описать так: “пиксели — дискретные структуры, с постоянным цветом, а исходная модель непрерывна, поэтому при проецировании из 3D в 2D часть информации теряется”.

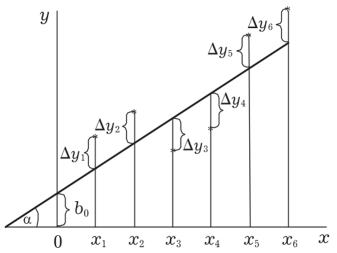

Проиллюстрируем две основные проблемы с дифференцируемостью при вычислении цвета и расстояния.

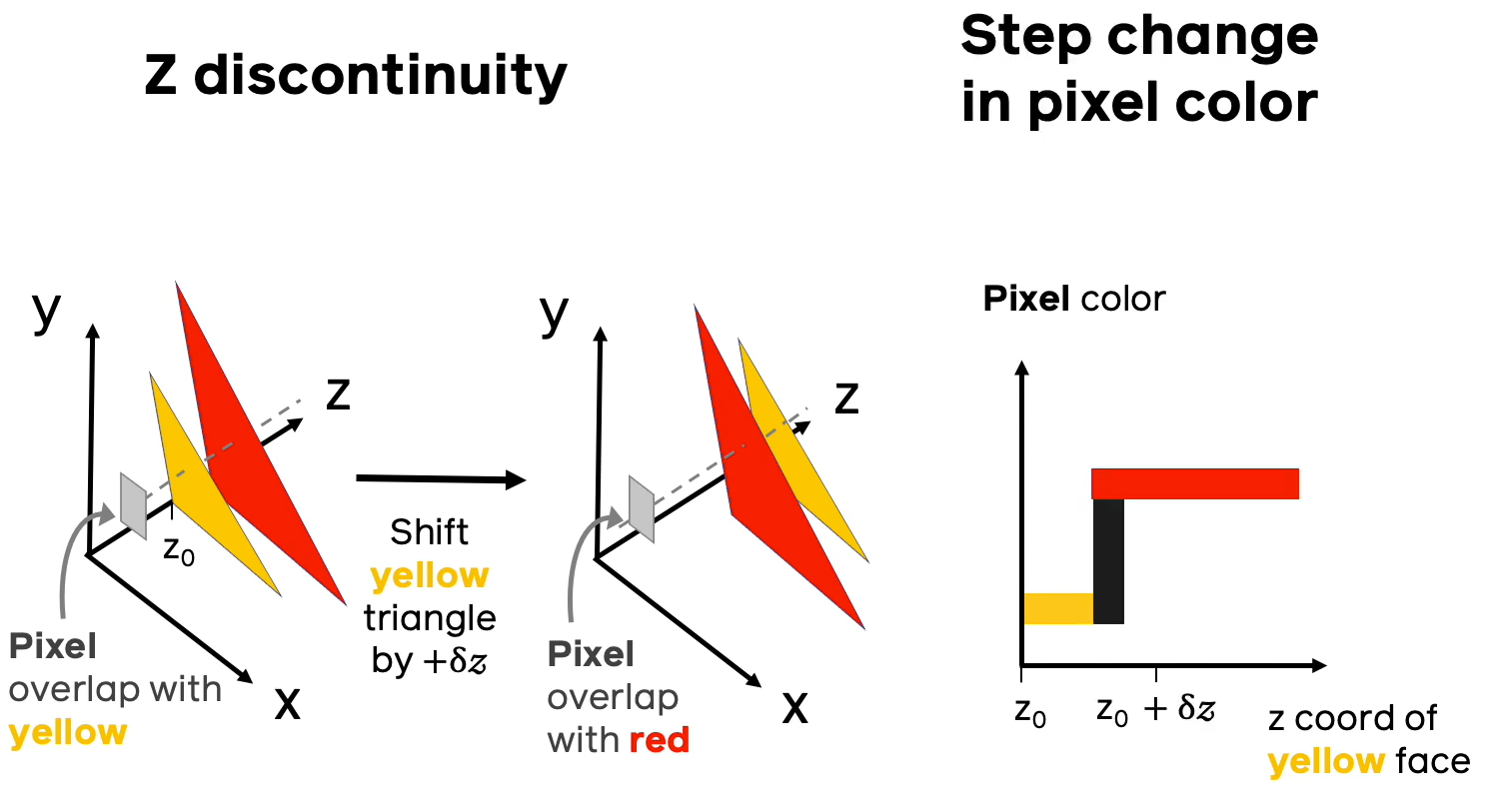

### Проблема №1 (недифференцируемость цвета по глубине)

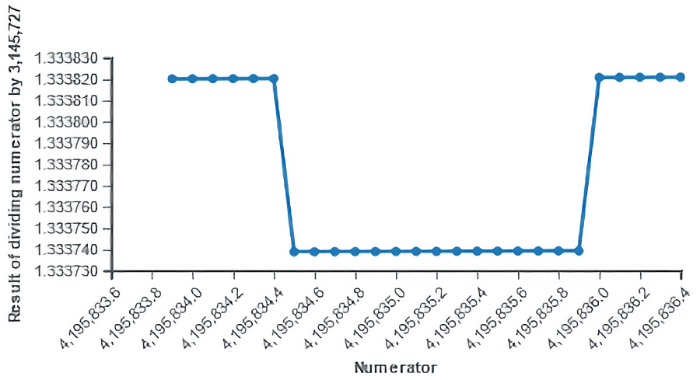

Предположим, что вдоль направления луча, проходящего через пиксель, есть несколько полигонов разных цветов, как на иллюстрации выше. Если придать малый сдвиг полигонов друг относительно друга, может случиться ситуация, когда ближайшим полигоном становится полигон другого цвета и при этом резко меняется цвет, в который нужно разукрашивать соответствующий пиксель. На правом графике иллюстрации изображена зависимость цвета пикселя (в барицентрических координатах) от расстояния до ближайшего пикселя конкретной модели. Из данного примера видно, что малому приращению расстояния до ближайшего полигона может соответствовать скачкообразному изменению в цвете, что приводит к недифференцируемости в классическом смысле.

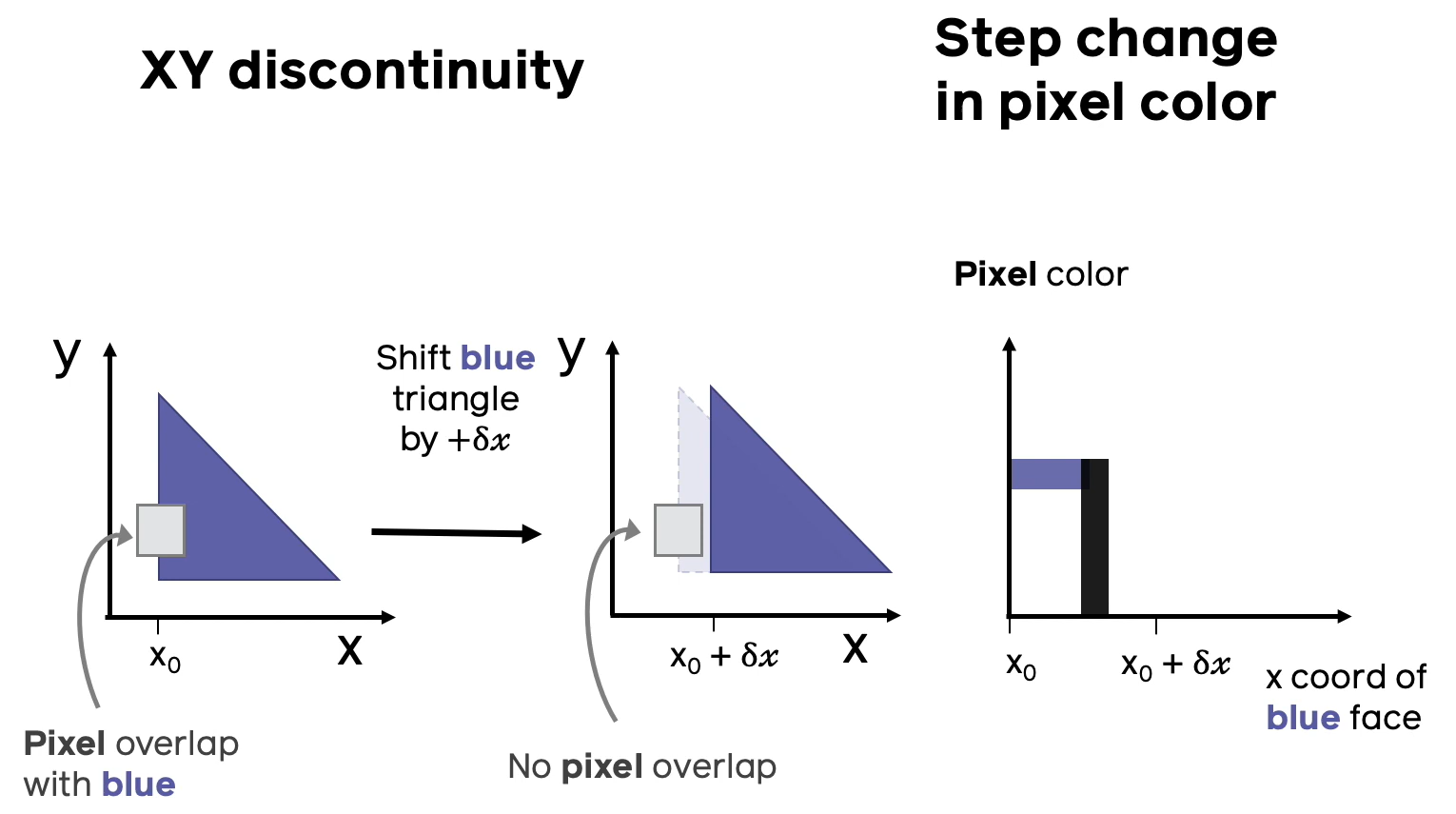

### Проблема №2 (недифференцируемость цвета при сдвигах)

Вторая проблема недифференцируемости аналогична первой, только теперь полигон будет один, а двигать мы его будем не вдоль луча, проходящего через данный пиксель, а в сторону от этого луча. Опять наблюдаем ситуацию, когда малому приращению координаты полигона соответствует скачок в цвете пикселя.

Make it differentiable! — Soft Rasterizer

-----------------------------------------

Процесс рендеринга недифференцируемый, но если бы он таковым являлся, можно было бы решать много актуальных задач в области 3D ML — мы определили проблему, посмотрим как ее можно решить.

Основные подходы к реализации дифференцируемого рендеринга можно проследить в следующей подборке публикаций:

* Loper, M.M. and Black, M.J., 2014, September. [OpenDR: An approximate differentiable renderer.](https://link.springer.com/content/pdf/10.1007/978-3-319-10584-0_11.pdf) In European Conference on Computer Vision (pp. 154-169). Springer, Cham.

* Kato, H., Ushiku, Y. and Harada, T., 2018. [Neural 3d mesh renderer.](https://openaccess.thecvf.com/content_cvpr_2018/papers/Kato_Neural_3D_Mesh_CVPR_2018_paper.pdf) In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 3907-3916).

* Li, T.M., Aittala, M., Durand, F. and Lehtinen, J., 2018. [Differentiable monte carlo ray tracing through edge sampling.](https://dl.acm.org/doi/pdf/10.1145/3272127.3275109) ACM Transactions on Graphics (TOG), 37(6), pp.1-11.

* Liu, S., Li, T., Chen, W. and Li, H., 2019. Soft rasterizer: A differentiable renderer for image-based 3d reasoning. In Proceedings of the IEEE International Conference on Computer Vision (pp. 7708-7717).

* Chen, W., Ling, H., Gao, J., Smith, E., Lehtinen, J., Jacobson, A. and Fidler, S., 2019. [Learning to predict 3d objects with an interpolation-based differentiable renderer.](https://papers.nips.cc/paper/9156-learning-to-predict-3d-objects-with-an-interpolation-based-differentiable-renderer.pdf) In Advances in Neural Information Processing Systems (pp. 9609-9619).

Также, мы настоятельно рекомендуем ознакомиться с обзорной заметкой про область дифференциального рендеринга "[Differentiable Rendering: A Survey](https://arxiv.org/pdf/2006.12057.pdf)" [[9](https://arxiv.org/pdf/2006.12057.pdf)].

Подходы основаны на разных идеях и приемах. Мы подробно остановимся только на одном, ***Soft Rasterizer***, по двум причинам: во-первых, идея данного подхода математически прозрачна и легко реализуема самостоятельно, во-вторых, данный подход реализован и оптимизирован внутри библиотеки [PyTorch 3D](https://github.com/facebookresearch/pytorch3d) [6].

Подробно со всеми аспектами реализации дифференциального рендеринга этим методом можно ознакомиться в соответствующей статье [1], мы же отметим основные моменты.

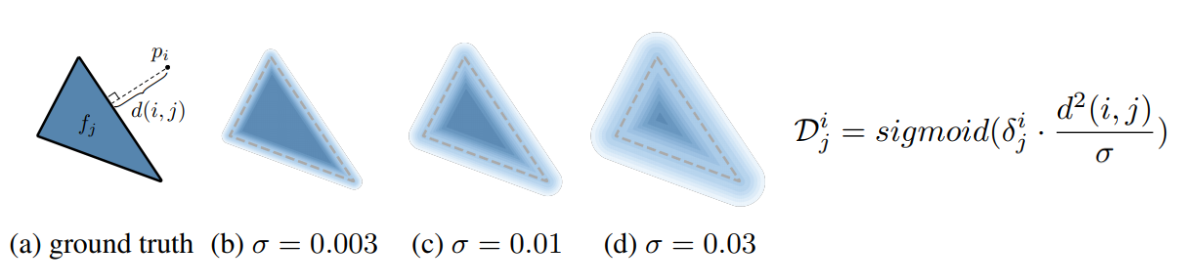

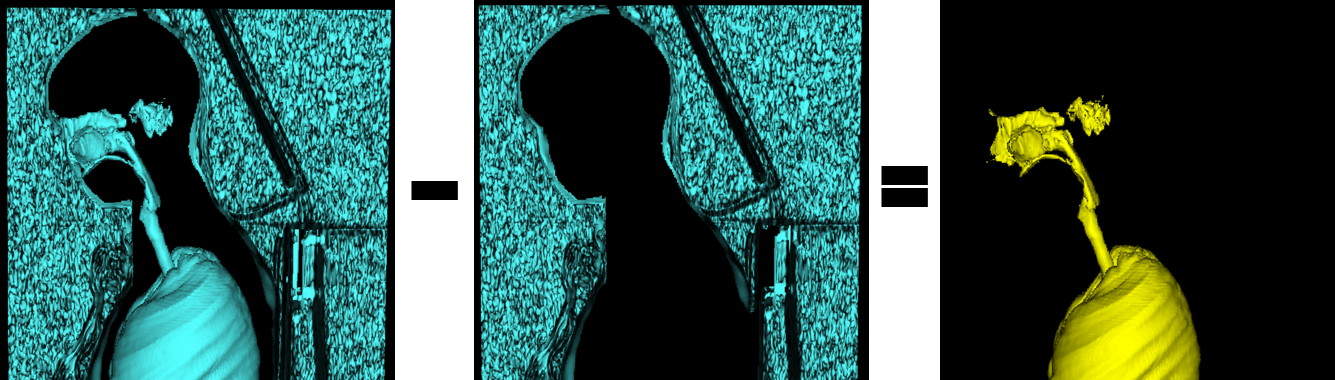

Для решение проблемы №2, авторы метода предлагают использовать “размытие” границы полигонов, которое приводит к непрерывной зависимости цвета пикселя от координат смещения полигона.

Размытие границ предполагает введение некоторой гладкой вероятностной функции , которая каждой внутренней или внешней точки пространства  ставит в соответствие число от 0 до 1 — вероятности принадлежности к данному полигону  (чем-то похоже на подход нечеткой логики). Здесь  — параметр размытия (чем больше , тем больше размытие),  — кратчайшее расстояние в проекционной плоскости от проекции точки  до границы проекции полигона  (данное расстояние обычно выбирают Евклидовым, но авторы метода отмечают, что здесь есть простор для экспериментов и, например, использование барицентрического расстояния или  также подходит для их метода),  — функция, которая равна 1 если точка находится внутри полигона и -1 если вне (на границе полигона можно доопределить значение  нулем, однако это все равно приводит к тому, что на границе полигона данная функция разрывна, поэтому для точек границ она не применяется),  — сигмоидная функция активации, которая часто применяется в глубоком обучении.

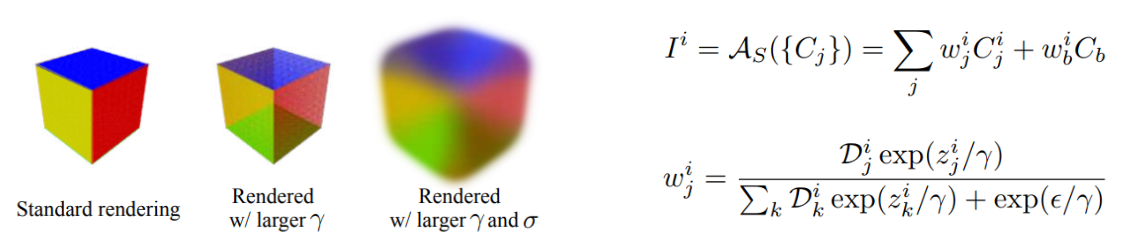

Для решения проблемы №1, авторы метода предлагают использовать “смешение” цветов k — ближайших полигонов (blending).

Коротко этот прием можно описать следующим образом: для вычисления итогового цвета -го пикселя , производят нормированное суммирование цветовых карт  для k — ближайших полигонов , причем цветовые карты получают путем интерполяции барицентрических координат цвета вершин данных полигонов. Индекс  в формуле отвечает за фоновый цвет (background colour), а оператор  — оператор агрегирование цвета.  — глубина -го пикселя относительно -го полигона, а  — параметр смешивания (чем он меньше, тем сильнее превалирует цвет ближайшего полигона).

Итоговой подход Soft Rasterizer, заключается в комбинировании этих двух идей, для одновременного плавного размытия границы и цвета.

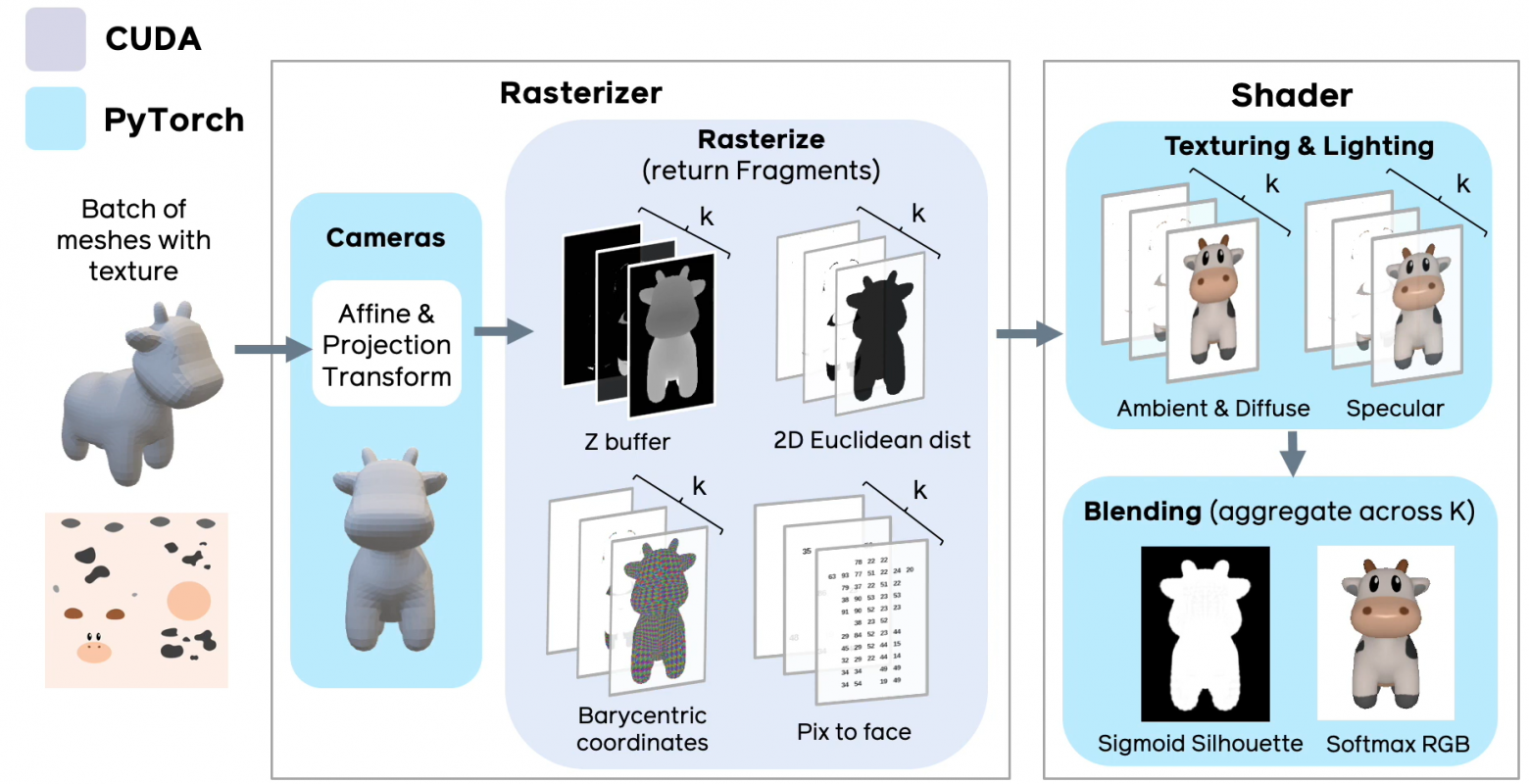

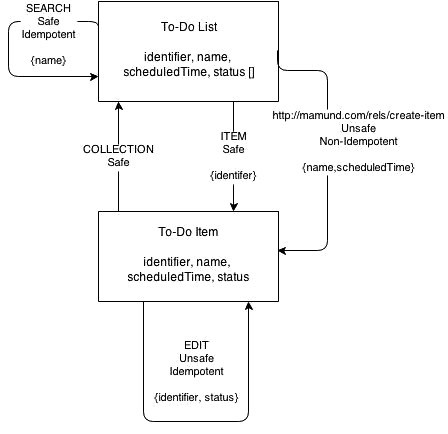

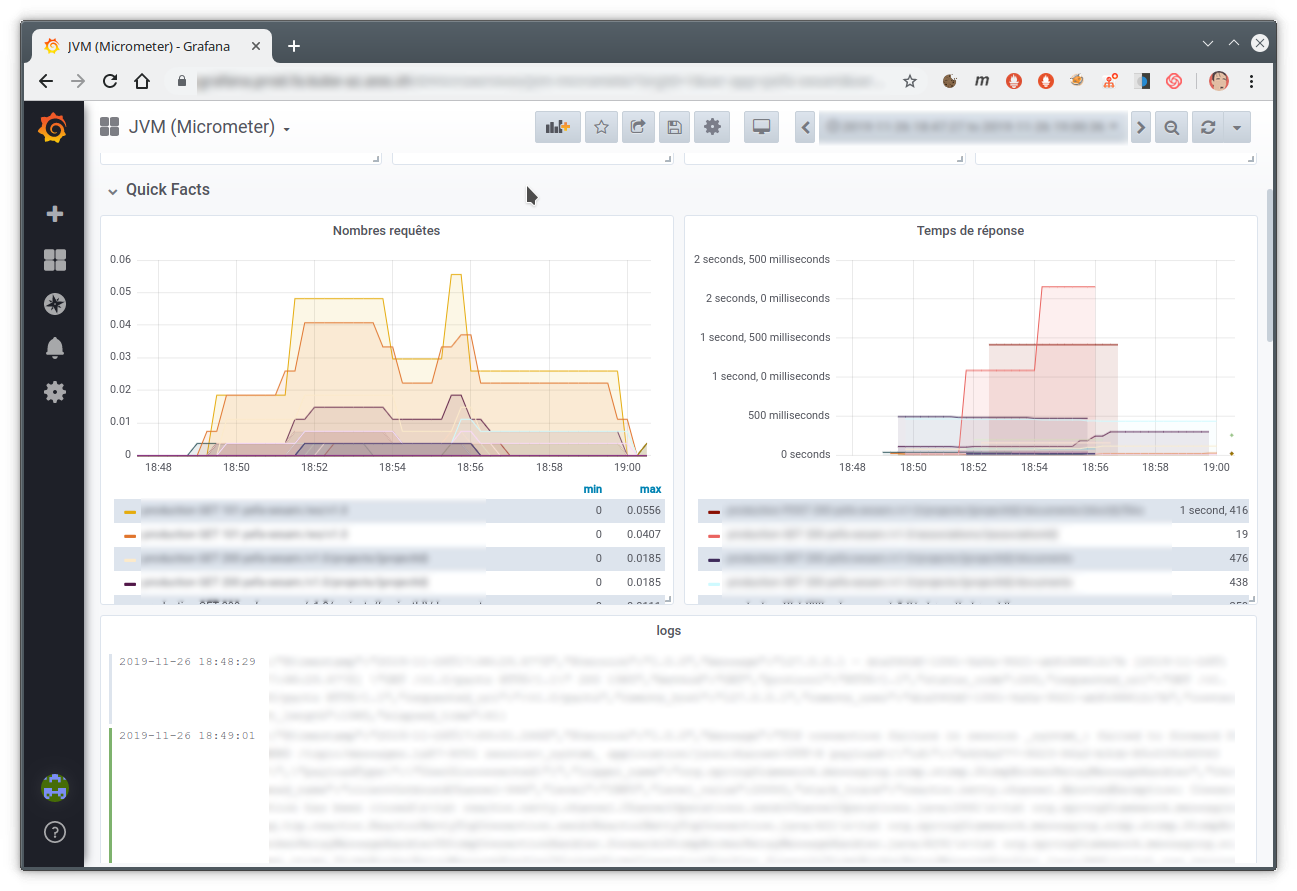

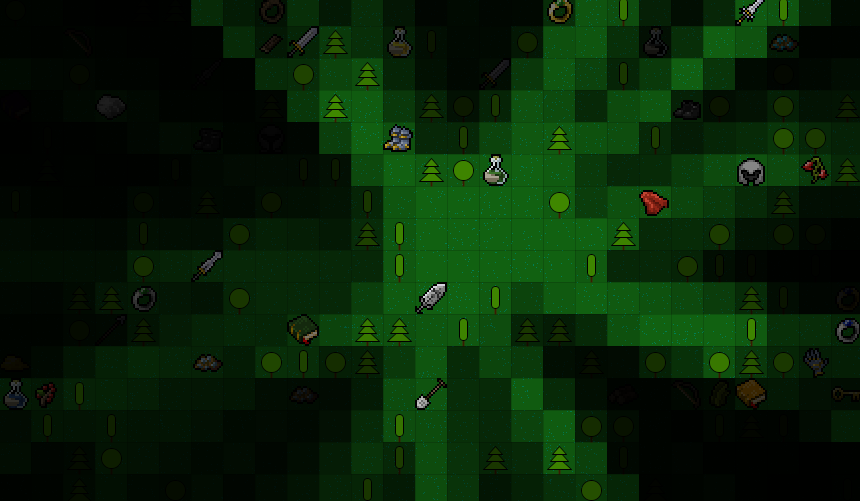

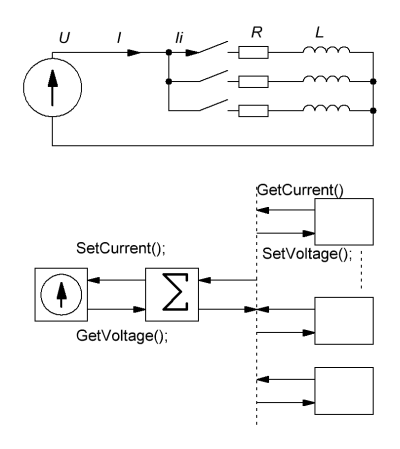

*Рис.4 Схема реализации дифференциального рендеринга в PyTorch 3D (слайд из [презентации фреймворка](https://www.youtube.com/watch?v=eCDBA_SbxCE)).*

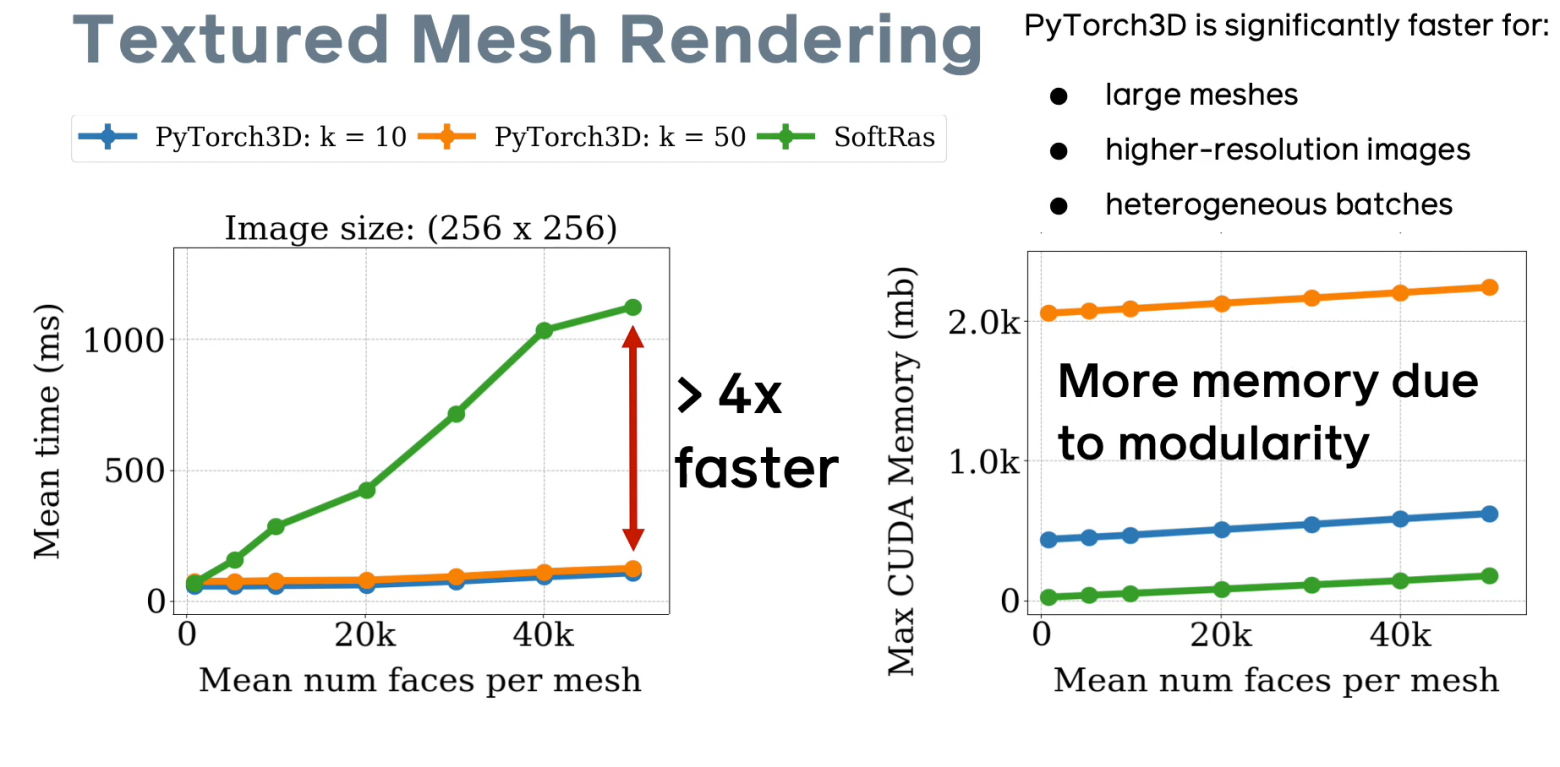

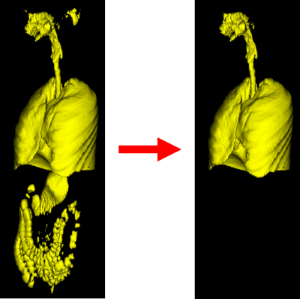

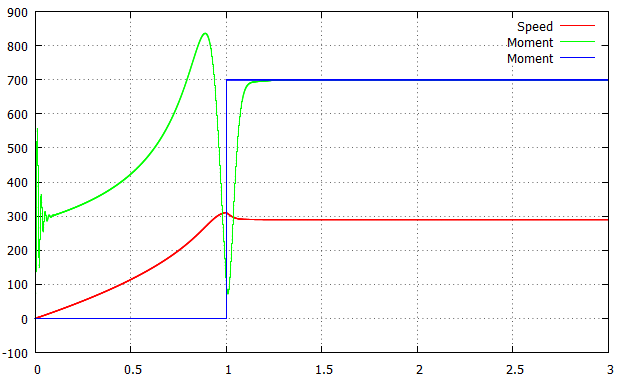

Реализация Soft Rasterizer внутри библиотеки PyTorch 3D выполнена так, чтобы максимально эффективно и удобно использовать возможности как базового фреймворка PyTorch, так и возможности технологии CUDA. По сравнению с оригинальной реализацией [[github page](https://github.com/ShichenLiu/SoftRas)], разработчикам фреймворка удалось добиться 4-х кратного приращения скорости обработки (особенно для больших моделей), при этом возрастает расход памяти за счет того, что для каждого типа данных (ката глубины, карта нормалей, рендер текстур, карта евклидовых расстояний) нужно просчитать k слоев и хранить их в памяти.

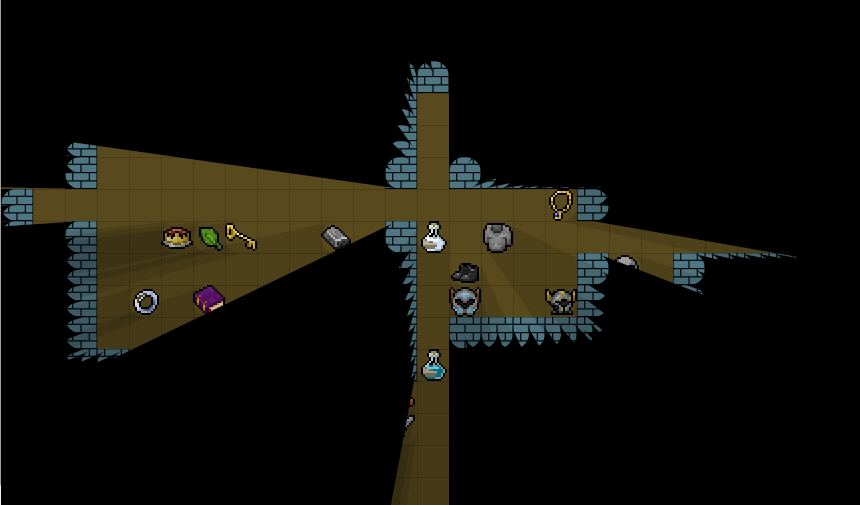

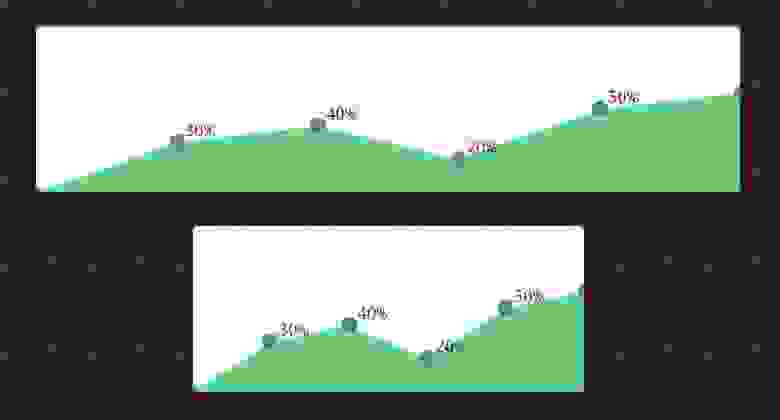

*Рис.5 Сравнение характеристик дифференциального рендеринга в PyTorch 3D (слайд из [презентации фреймворка](https://www.youtube.com/watch?v=eCDBA_SbxCE)).*

Поэкспериментировать с настройками дифференциального рендера можно как в PyTorch 3D, так в библиотеке с оригинальной реализацией алгоритма [Soft Rasterizer](https://github.com/ShichenLiu/SoftRas). Давайте рассмотрим [пример](https://github.com/ShichenLiu/SoftRas/blob/master/examples/demo_render.py), демонстрирующий зависимость итоговой картинки отрендеренной модели от параметров дифференциального рендера \sigma, \gamma.

Удобнее всего работать с этой библиотекой в виртуальном окружении anaconda, так как данная библиотека работает уже не с самой актуальной версией pytorch 1.1.0. Также обратите внимание что вам потребуется видеокарта с поддержкой CUDA.

**Импорт библиотек и задание путей до обрабатываемых моделей**

```

import matplotlib.pyplot as plt

import os

import tqdm

import numpy as np

import imageio

import soft_renderer as sr

input_file = 'path/to/input/file'

output_dir = 'path/to/output/dir'

```

Зададим начальные параметры камеры для рендеринга, загрузим меш объекта с текстурами (есть мод для работы без текстур, в этом случае нужно указать `texture_type=’vertex’`), инициализируем дифференциальный рендер и создадим директорию для сохранения результатов.

```

# camera settings

camera_distance = 2.732

elevation = 30

azimuth = 0

# load from Wavefront .obj file

mesh = sr.Mesh.from_obj(

input_file,

load_texture=True,

texture_res=5,

texture_type='surface')

# create renderer with SoftRas

renderer = sr.SoftRenderer(camera_mode='look_at')

os.makedirs(args.output_dir, exist_ok=True)

```

Сначала, посмотрим на нашу модель с разных сторон и для этого отрендерим анимацию пролета камеры по кругу с помощью рендера.

```

# draw object from different view

loop = tqdm.tqdm(list(range(0, 360, 4)))

writer = imageio.get_writer(

os.path.join(output_dir, 'rotation.gif'),

mode='I')

for num, azimuth in enumerate(loop):

# rest mesh to initial state

mesh.reset_()

loop.set_description('Drawing rotation')

renderer.transform.set_eyes_from_angles(

camera_distance,

elevation,

azimuth)

images = renderer.render_mesh(mesh)

image = images.detach().cpu().numpy()[0].transpose((1, 2, 0))

writer.append_data((255*image).astype(np.uint8))

writer.close()

```

Теперь поиграемся со степенью размытия границы и степенью смешения цветов. Для этого будем в цикле увеличивать параметр размытия  и одновременно увеличивать параметр смешения цвета .

```

# draw object from different sigma and gamma

loop = tqdm.tqdm(list(np.arange(-4, -2, 0.2)))

renderer.transform.set_eyes_from_angles(camera_distance, elevation, 45)

writer = imageio.get_writer(

os.path.join(output_dir, 'bluring.gif'),

mode='I')

for num, gamma_pow in enumerate(loop):

# rest mesh to initial state

mesh.reset_()

renderer.set_gamma(10**gamma_pow)

renderer.set_sigma(10**(gamma_pow - 1))

loop.set_description('Drawing blurring')

images = renderer.render_mesh(mesh)

image = images.detach().cpu().numpy()[0].transpose((1, 2, 0))

writer.append_data((255*image).astype(np.uint8))

writer.close()

# save to textured obj

mesh.reset_()

mesh.save_obj(

os.path.join(args.output_dir, 'saved_spot.obj'),

save_texture=True)

```

Итоговый результат на примере стандартной модели текстурированной коровы ([cow.obj](https://dl.fbaipublicfiles.com/pytorch3d/data/cow_mesh/cow.obj), [cow.mtl](https://dl.fbaipublicfiles.com/pytorch3d/data/cow_mesh/cow.mtl), [cow.png](https://dl.fbaipublicfiles.com/pytorch3d/data/cow_mesh/cow_texture.png) — удобно скачивать, например, с помощью [wget](https://habr.com/ru/company/ruvds/blog/346640/)) выглядит так:

Neural rendering

----------------

Дифференциальный рендеринг как базовый инструмент для 3D ML, позволяет создавать очень много интересных архитектур глубокого обучения в области, которая получила названия ***нейронный рендеринг (neural rendering)***. Нейронный рендеринг позволяет решать множество задач, связанных с процедурой рендеринга: от добавления новых объектов на фото и в видеопоток до сверхбыстрого текстурирования и рендеринга сложных физических процессов.

Сегодня мы оставим приложение дифференциального рендеринга к конструированию нейронного рендеринга за скобками повествования, однако порекомендуем всем заинтересовавшимся следующие источники:

* большая обзорная [статья](https://arxiv.org/pdf/2004.03805.pdf) SOTA архитектур в области нейронного рендеринга [7] на основе прошедшей [CVPR 2020](http://cvpr2020.thecvf.com/);

* видео с записью [утренней](https://www.youtube.com/watch?v=LCTYRqW-ne8) и [дневной](https://www.youtube.com/watch?v=JlyGNvbGKB8) сессией по нейтронному рендерингу с [CVPR 2020](http://cvpr2020.thecvf.com/), на основе которых и была написана статья из предыдущего пункта;

* видеолекция [MIT DL Neural rendering](https://www.youtube.com/watch?v=BCZ56MU-KhQ) с кратким обзором основных подходов и введении в тему;

* [заметка](https://towardsdatascience.com/differentiable-rendering-d00a4b0f14be) на Medium на тему дифференциального рендеринга и его приложений;

* [видео](https://www.youtube.com/watch?v=tGJ4tEwhgo8) с youtube канала two minute papers на данную тему.

Experiment: Mona Liza reconstruction

------------------------------------

Разберем пример применения дифференциального рендеринга для восстановления параметров 3D сцены по исходному изображению человеческого лица, представленный в пуле [примеров](https://github.com/BachiLi/redner/wiki) библиотеки [redner](https://github.com/BachiLi/redner), которая является реализацией идей, изложенных в статье [ [4](https://dl.acm.org/doi/pdf/10.1145/3272127.3275109) ].

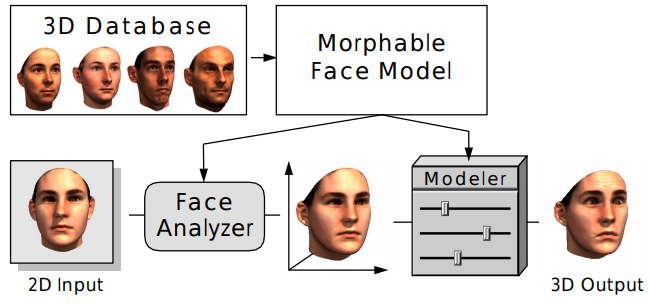

В данном [примере](https://nbviewer.jupyter.org/github/BachiLi/redner/blob/master/tutorials/3dmm.ipynb), мы будем использовать т.н. [3D morphable model](https://gravis.dmi.unibas.ch/publications/Sigg99/morphmod2.pdf) [8] — технику текстурированного трехмерного моделирования человеческого лица, ставшую уже классической в области анализа 3D. Техника основана на получение такого крытого представления признаков 3D данных, которое позволяет строить линейные комбинации, сочетающие физиологические особенности человеческих лиц (если так можно выразиться, то это своеобразный Word2Vec от мира 3D моделирования человеческих лиц).

Для работы с примером вам потребуется датасет [Basel face model (2017 version)](http://gravis.dmi.unibas.ch/PMM/data/overview/). Файл `model2017-1_bfm_nomouth.h5` необходимо будет разместить в рабочей директории вместе с кодом.

Для начала загрузим необходимы для работы библиотеки и датасет лиц.

**Загрузка библиотек**

```

import torch

import pyredner

import h5py

import urllib

import time

from matplotlib.pyplot import imshow

%matplotlib inline

import matplotlib.pyplot as plt

from IPython.display import display, clear_output

from matplotlib import animation

from IPython.display import HTML

```

```

# Load the Basel face model

with h5py.File(r'model2017-1_bfm_nomouth.h5', 'r') as hf:

shape_mean = torch.tensor(hf['shape/model/mean'],

device = pyredner.get_device())

shape_basis = torch.tensor(hf['shape/model/pcaBasis'],

device = pyredner.get_device())

triangle_list = torch.tensor(hf['shape/representer/cells'],

device = pyredner.get_device())

color_mean = torch.tensor(hf['color/model/mean'],

device = pyredner.get_device())

color_basis = torch.tensor(hf['color/model/pcaBasis'],

device = pyredner.get_device())

```

Модель лица в таком подходе разделена отдельно на базисный вектор формы — `shape_basis` (вектор длины 199 полученный методом [PCA](https://habr.com/ru/post/304214/)), базисный вектор цвета — `color_basis` (вектор длины 199 полученный методом [PCA](https://habr.com/ru/post/304214/)), также имеем усредненный вектор формы и цвета — `shape_mean`, `color_mean`. В `triangle_list` хранится геометрия усредненного лица в форме полигональной модели.

Создадим модель, которая на вход будет принимать векторы скрытого представления цвета и формы лица, параметры камеры и освещения в сцене, а на выходе будет генерировать отрендеренное изображение.

```

indices = triangle_list.permute(1, 0).contiguous()

def model(

cam_pos,

cam_look_at,

shape_coeffs,

color_coeffs,

ambient_color,

dir_light_intensity):

vertices = (shape_mean + shape_basis @ shape_coeffs).view(-1, 3)

normals = pyredner.compute_vertex_normal(vertices, indices)

colors = (color_mean + color_basis @ color_coeffs).view(-1, 3)

m = pyredner.Material(use_vertex_color = True)

obj = pyredner.Object(vertices = vertices,

indices = indices,

normals = normals,

material = m,

colors = colors)

cam = pyredner.Camera(position = cam_pos,

# Center of the vertices

look_at = cam_look_at,

up = torch.tensor([0.0, 1.0, 0.0]),

fov = torch.tensor([45.0]),

resolution = (256, 256))

scene = pyredner.Scene(camera = cam, objects = [obj])

ambient_light = pyredner.AmbientLight(ambient_color)

dir_light = pyredner.DirectionalLight(torch.tensor([0.0, 0.0, -1.0]),

dir_light_intensity)

img = pyredner.render_deferred(scene = scene,

lights = [ambient_light, dir_light])

return img

```

Теперь посмотрим как выглядит усредненное лицо. Для этого зададим первоначальные параметры освещения и позиции камеры и воспользуемся нашей моделью. Также загрузим целевое изображение, параметры которого мы хотим восстановить и взглянем на него:

```

cam_pos = torch.tensor([-0.2697, -5.7891, 373.9277])

cam_look_at = torch.tensor([-0.2697, -5.7891, 54.7918])

img = model(cam_pos,

cam_look_at,

torch.zeros(199, device = pyredner.get_device()),

torch.zeros(199, device = pyredner.get_device()),

torch.ones(3),

torch.zeros(3))

imshow(torch.pow(img, 1.0/2.2).cpu())

face_url = 'https://raw.githubusercontent.com/BachiLi/redner/master/tutorials/mona-lisa-cropped-256.png'

urllib.request.urlretrieve(face_url, 'target.png')

target = pyredner.imread('target.png').to(pyredner.get_device())

imshow(torch.pow(target, 1.0/2.2).cpu())

```

Зададим начальные значения параметров, которые будем пытаться восстановить для целевой картины.

```

# Set requires_grad=True since we want to optimize them later

cam_pos = torch.tensor([-0.2697, -5.7891, 373.9277],

requires_grad=True)

cam_look_at = torch.tensor([-0.2697, -5.7891, 54.7918],

requires_grad=True)

shape_coeffs = torch.zeros(199, device = pyredner.get_device(),

requires_grad=True)

color_coeffs = torch.zeros(199, device = pyredner.get_device(),

requires_grad=True)

ambient_color = torch.ones(3, device = pyredner.get_device(),

requires_grad=True)

dir_light_intensity = torch.zeros(3, device = pyredner.get_device(),

requires_grad=True)

# Use two different optimizers for different learning rates

optimizer = torch.optim.Adam(

[

shape_coeffs,

color_coeffs,

ambient_color,

dir_light_intensity],

lr=0.1)

cam_optimizer = torch.optim.Adam([cam_pos, cam_look_at], lr=0.5)

```

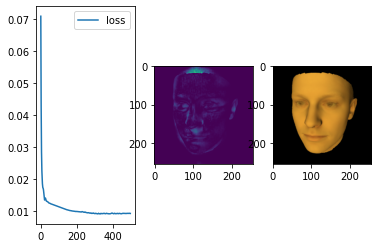

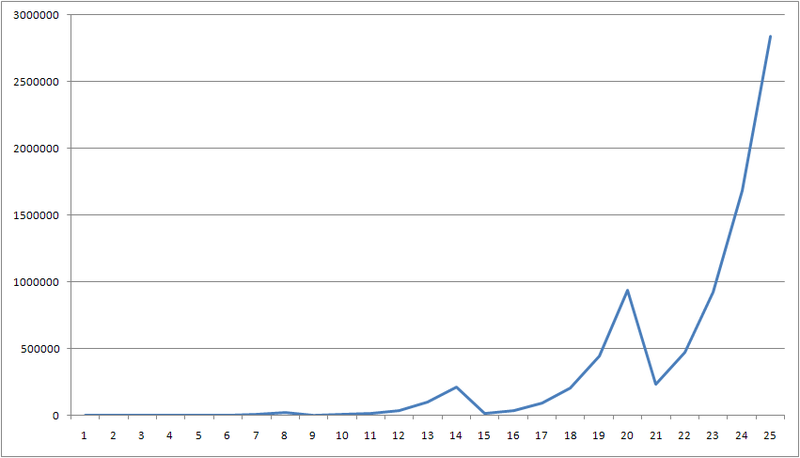

Остается организовать, оптимизационный цикл и логировать происходящее с функцией ошибки (в нашем случае это попиксельный MSE + квадратичные регуляризаторы параметров) и с самой 3D моделью.

```

plt.figure()

imgs, losses = [], []

# Run 500 Adam iterations

num_iters = 500

for t in range(num_iters):

optimizer.zero_grad()

cam_optimizer.zero_grad()

img = model(cam_pos, cam_look_at, shape_coeffs,

color_coeffs, ambient_color, dir_light_intensity)

# Compute the loss function. Here it is L2 plus a regularization

# term to avoid coefficients to be too far from zero.

# Both img and target are in linear color space,

# so no gamma correction is needed.

loss = (img - target).pow(2).mean()

loss = loss

+ 0.0001 * shape_coeffs.pow(2).mean()

+ 0.001 * color_coeffs.pow(2).mean()

loss.backward()

optimizer.step()

cam_optimizer.step()

ambient_color.data.clamp_(0.0)

dir_light_intensity.data.clamp_(0.0)

# Plot the loss

f, (ax_loss, ax_diff_img, ax_img) = plt.subplots(1, 3)

losses.append(loss.data.item())

# Only store images every 10th iterations

if t % 10 == 0:

# Record the Gamma corrected image

imgs.append(torch.pow(img.data, 1.0/2.2).cpu())

clear_output(wait=True)

ax_loss.plot(range(len(losses)), losses, label='loss')

ax_loss.legend()

ax_diff_img.imshow((img -target).pow(2).sum(dim=2).data.cpu())

ax_img.imshow(torch.pow(img.data.cpu(), 1.0/2.2))

plt.show()

```

Чтобы лучше понимать что происходило со сценой в процессе обучения можем сгенерировать анимацию из наших логов:

```

fig = plt.figure()

# Clamp to avoid complains

im = plt.imshow(imgs[0].clamp(0.0, 1.0), animated=True)

def update_fig(i):

im.set_array(imgs[i].clamp(0.0, 1.0))

return im,

anim = animation.FuncAnimation(fig, update_fig,

frames=len(imgs), interval=50, blit=True)

HTML(anim.to_jshtml())

```

Conclusions

-----------

Дифференциальный рендеринг — новое интересное и важное направление на стыке компьютерной графики, компьютерного зрения и машинного обучения. Данная технология стала основой для многих архитектур в области нейронного рендеринга, который в свою очередь расширяет границы возможностей компьютерной графики и машинного зрения.

Существуют несколько популярных библиотек глубокого вычисления (например [Kaolin](https://github.com/NVIDIAGameWorks/kaolin), [PyTorch 3D](https://github.com/facebookresearch/pytorch3d), [TensorFlow Graphics](https://github.com/tensorflow/graphics)), которые содержат дифференциальный рендеринг как составную часть. Также существуют отдельные библиотеки, реализующие функционал дифференциального рендеринга ([Soft Rasterizer](https://github.com/ShichenLiu/SoftRas), [redner](https://github.com/BachiLi/redner)). С их помощью можно реализовывать множество интересных проектов, вроде проекта с восстановлением параметров лица и текстуры портрета человека.

В ближайшем будущем, мы можем ожидать появление новых техник и библиотек для дифференциального рендеринга и их применения в области нейронного рендеринга. Возможно, уже завтра может появится способ делать реалистичную графику в реальном времени или генерировать 2D и 3D контент приемлемого для людей качества с помощью этой технологии. Мы будем следить за развитием этого направления и постараемся рассказывать о всех новинках и интересных экспериментах.

**References**

1. Liu, S., Li, T., Chen, W. and Li, H., 2019. Soft rasterizer: A differentiable renderer for image-based 3d reasoning. In Proceedings of the IEEE International Conference on Computer Vision (pp. 7708-7717). [ [paper](https://openaccess.thecvf.com/content_ICCV_2019/papers/Liu_Soft_Rasterizer_A_Differentiable_Renderer_for_Image-Based_3D_Reasoning_ICCV_2019_paper.pdf) ]

2. Loper, M.M. and Black, M.J., 2014, September. OpenDR: An approximate differentiable renderer. In European Conference on Computer Vision (pp. 154-169). Springer, Cham. [ [paper](https://link.springer.com/content/pdf/10.1007/978-3-319-10584-0_11.pdf) ]

3. Kato, H., Ushiku, Y. and Harada, T., 2018. Neural 3d mesh renderer. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 3907-3916). [ [paper](https://openaccess.thecvf.com/content_cvpr_2018/papers/Kato_Neural_3D_Mesh_CVPR_2018_paper.pdf) ]

4. Li, T.M., Aittala, M., Durand, F. and Lehtinen, J., 2018. Differentiable monte carlo ray tracing through edge sampling. ACM Transactions on Graphics (TOG), 37(6), pp.1-11. [ [paper](https://dl.acm.org/doi/pdf/10.1145/3272127.3275109) ]

5. Chen, W., Ling, H., Gao, J., Smith, E., Lehtinen, J., Jacobson, A. and Fidler, S., 2019. Learning to predict 3d objects with an interpolation-based differentiable renderer. In Advances in Neural Information Processing Systems (pp. 9609-9619). [ [paper](https://papers.nips.cc/paper/9156-learning-to-predict-3d-objects-with-an-interpolation-based-differentiable-renderer.pdf) ]

6. Ravi, N., Reizenstein, J., Novotny, D., Gordon, T., Lo, W.Y., Johnson, J. and Gkioxari, G., 2020. Accelerating 3D Deep Learning with PyTorch3D. arXiv preprint arXiv:2007.08501. [ [paper](https://arxiv.org/pdf/2007.08501.pdf) ] [ [github](https://github.com/facebookresearch/pytorch3d) ]

7. Tewari, A., Fried, O., Thies, J., Sitzmann, V., Lombardi, S., Sunkavalli, K., Martin-Brualla, R., Simon, T., Saragih, J., Nießner, M. and Pandey, R., 2020. State of the Art on Neural Rendering. arXiv preprint arXiv:2004.03805. [ [paper](https://arxiv.org/pdf/2004.03805.pdf) ]

8. Blanz, V. and Vetter, T., 1999, July. A morphable model for the synthesis of 3D faces. In Proceedings of the 26th annual conference on Computer graphics and interactive techniques (pp. 187-194). [ [paper](https://gravis.dmi.unibas.ch/publications/Sigg99/morphmod2.pdf) ][ [project page](http://gravis.dmi.unibas.ch/PMM/) ]

9. Kato, H., Beker, D., Morariu, M., Ando, T., Matsuoka, T., Kehl, W. and Gaidon, A., 2020. Differentiable rendering: A survey. arXiv preprint arXiv:2006.12057. [[paper](https://arxiv.org/pdf/2006.12057.pdf)] | https://habr.com/ru/post/520268/ | null | ru | null |

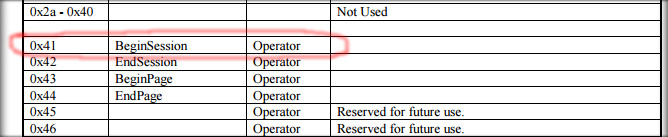

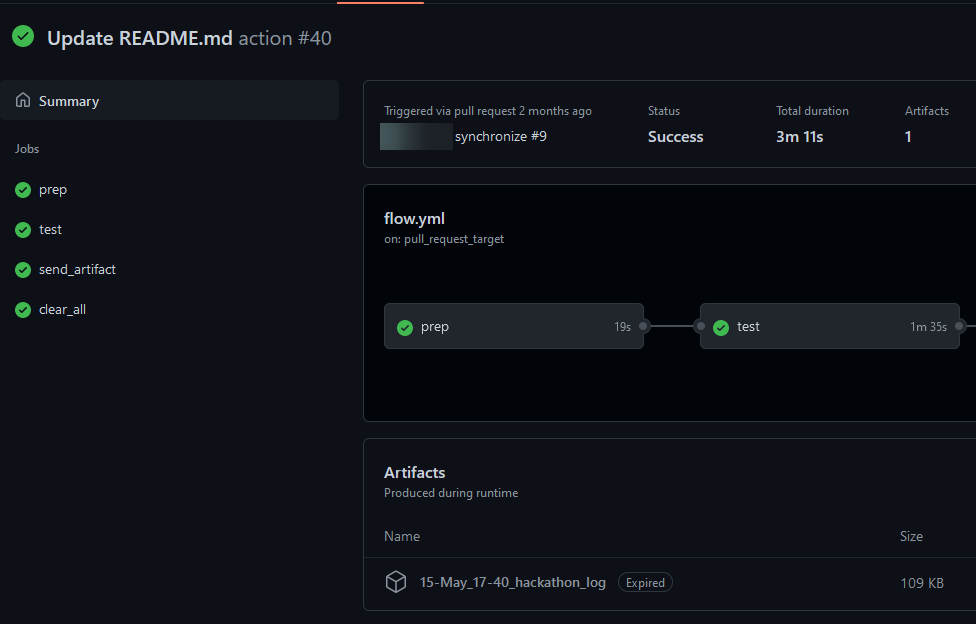

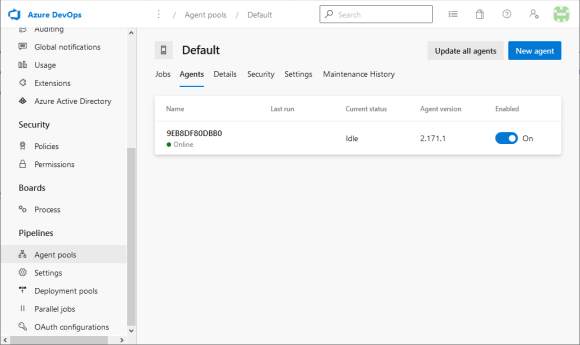

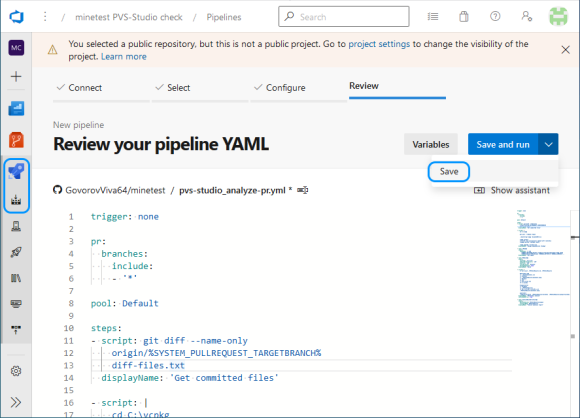

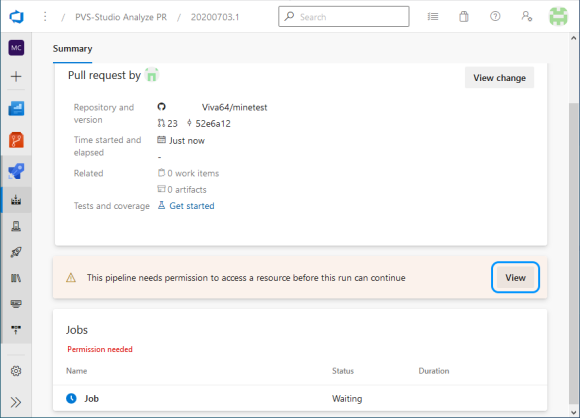

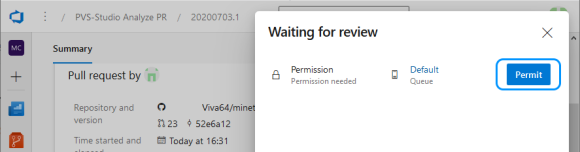

# Как я подружил BPMN и Bitbucket

Привет, Хабр! Я техлид в компании [ДомКлик](https://habr.com/ru/company/domclick/). В основном занимаюсь backend-разработкой. Мне периодически приходится погружаться и во front-разработку, но этого не происходило уже более двух лет. Сегодня я расскажу, как мне пришлось заняться front-разработкой для создания плагина для [Bitbucket](https://bitbucket.org/), с какими сложностями я столкнулся и как их решал. Также поделюсь результатом своей работы: надеюсь, он окажется полезен кому-нибудь ещё. Эта статья не является руководством по написанию плагинов для продуктов Atlassian и не описывает всех возможностей системы плагинов.

### Проблема

Некоторые наши команды используют нотацию [BPMN](https://ru.wikipedia.org/wiki/BPMN) для описания бизнес-процессов, которые мы реализуем. Недавно мой коллега [рассказал](https://habr.com/ru/company/domclick/blog/535344/), как мы пришли к применению BPMN. В качестве движка исполнения бизнес-процессов мы используем платформу [Camunda](https://camunda.com/), популярность которой, как мне кажется, обусловлена несколькими важными факторами:

* Отличный инструментарий. Сюда входят инструменты для моделирования, мониторинга, анализа бизнес-процессов.

* Отличная документация, полная и подробная.

* Возможность тонкой настройки под свои нужды благодаря огромному количеству настроек среды исполнения.

* Возможность расширения базовой функциональности через реализацию своих плагинов.

* Сообщество. Разработчики Camunda организуют [конференции](https://camunda.com/events/conferences/), [митапы](https://camunda.com/events/meetups/), записывают обучающие [видео](https://www.youtube.com/user/camundaVideo), ведут [тематические блоги](https://blog.bernd-ruecker.com/), поддерживают диалог на [форуме](https://forum.camunda.org/) и, конечно, выкладывают свой код на [GitHub](https://github.com/camunda).

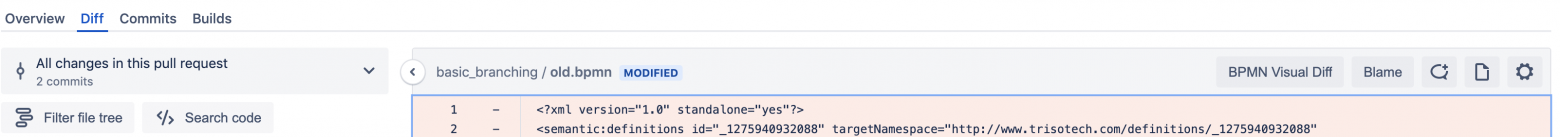

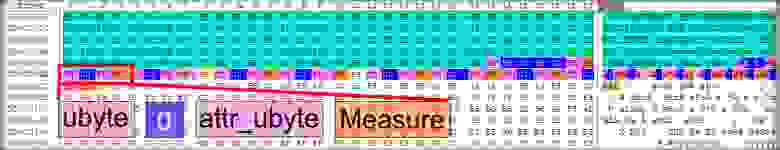

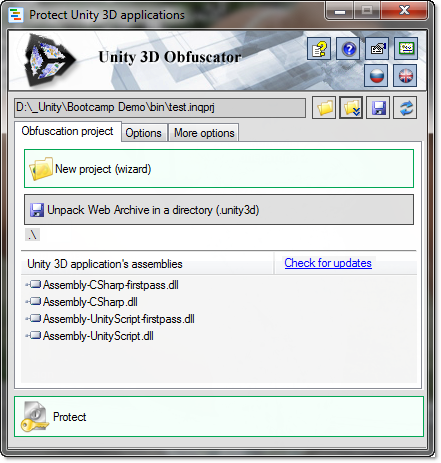

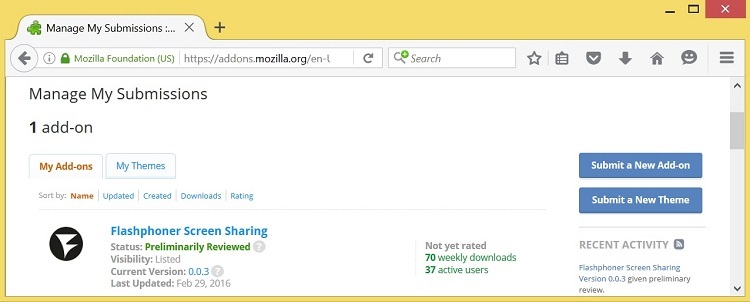

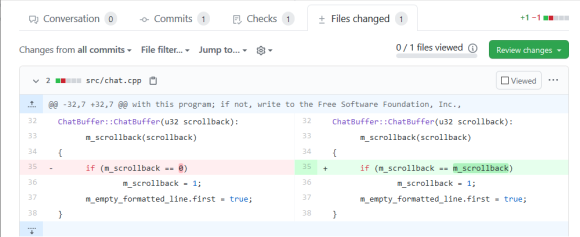

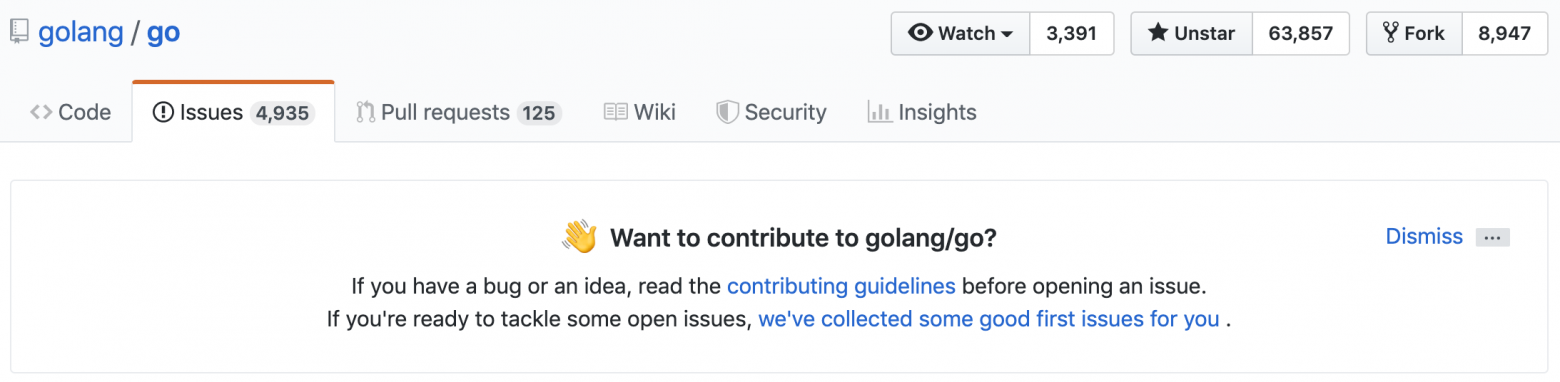

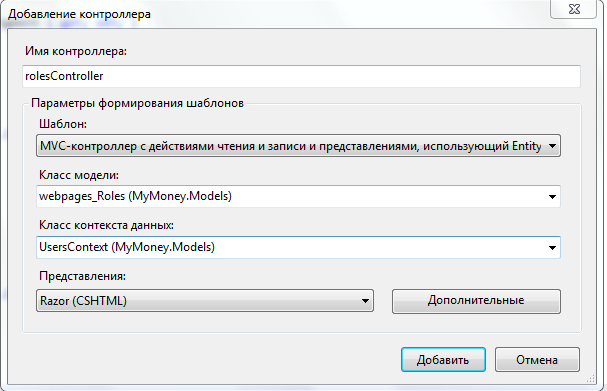

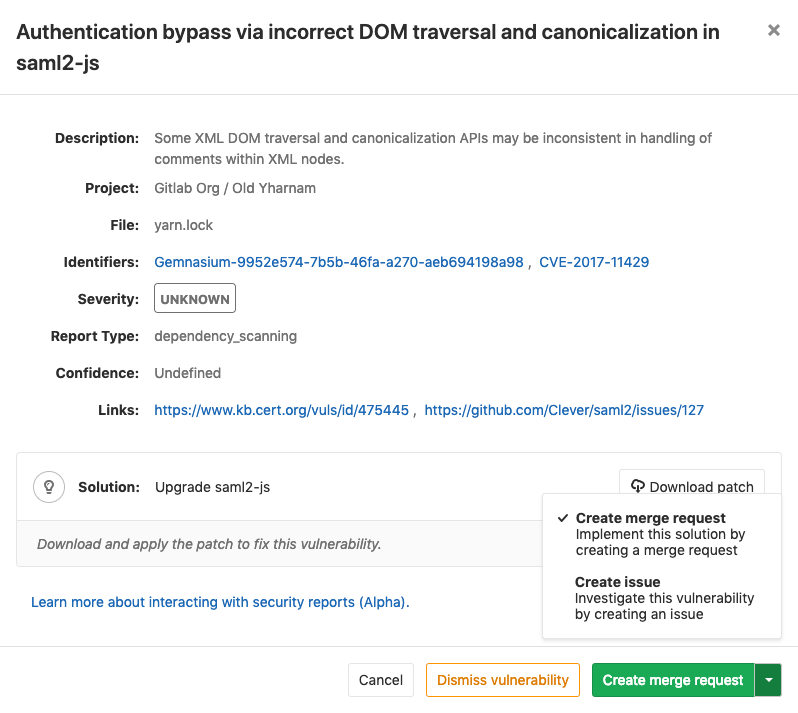

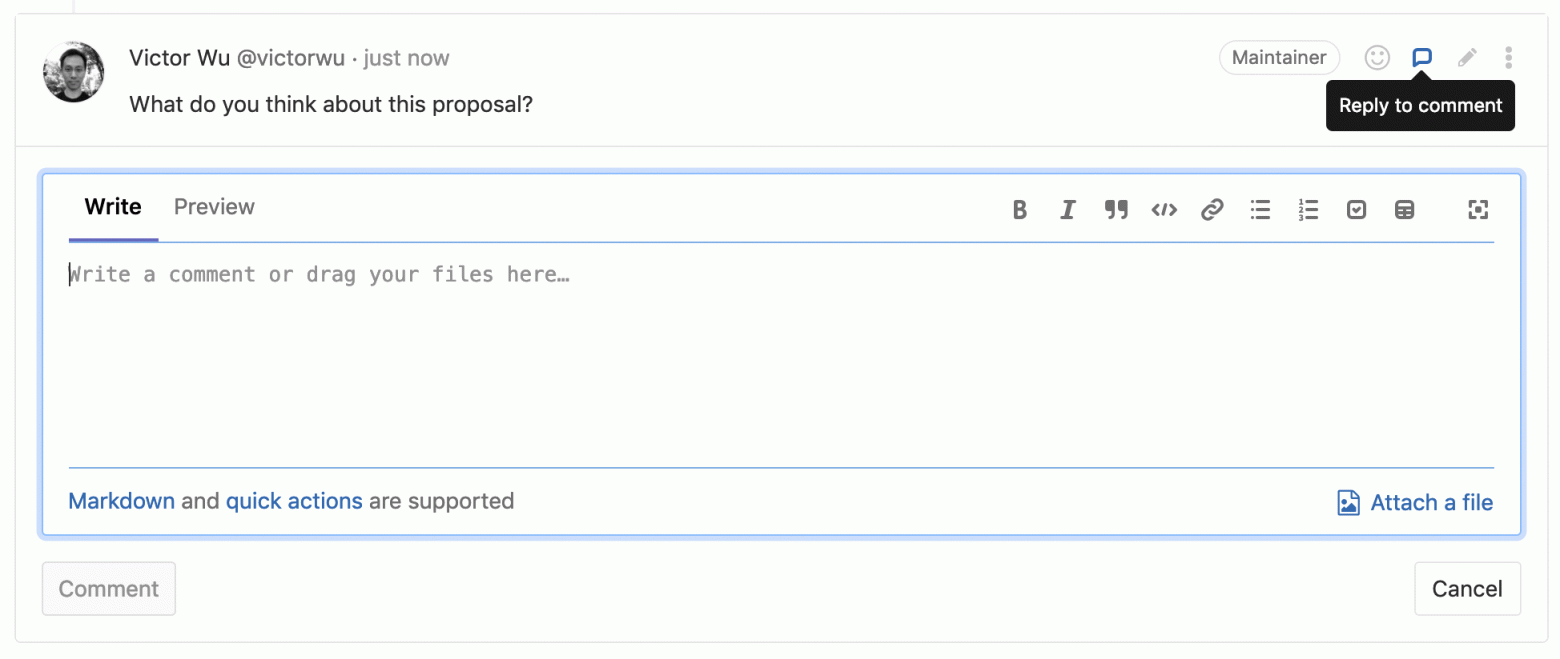

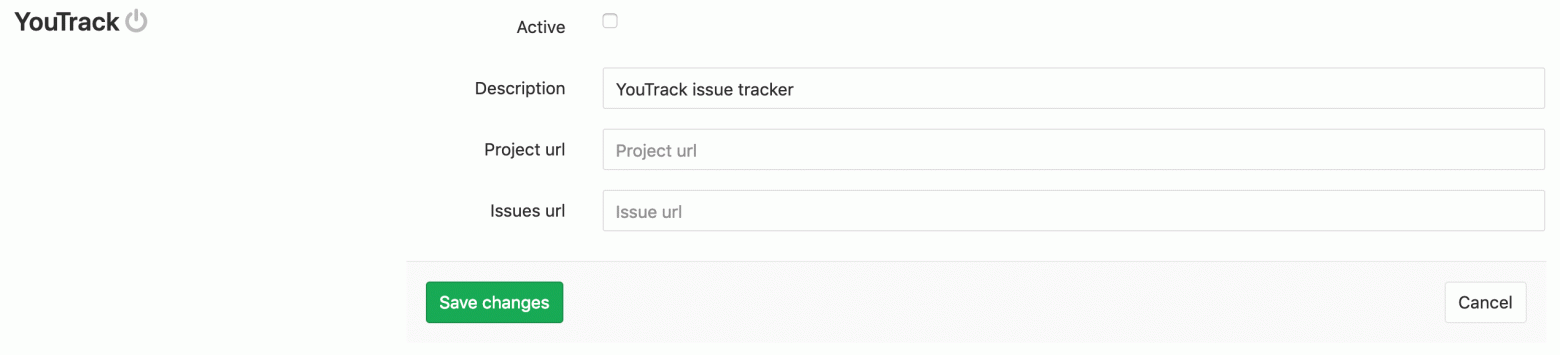

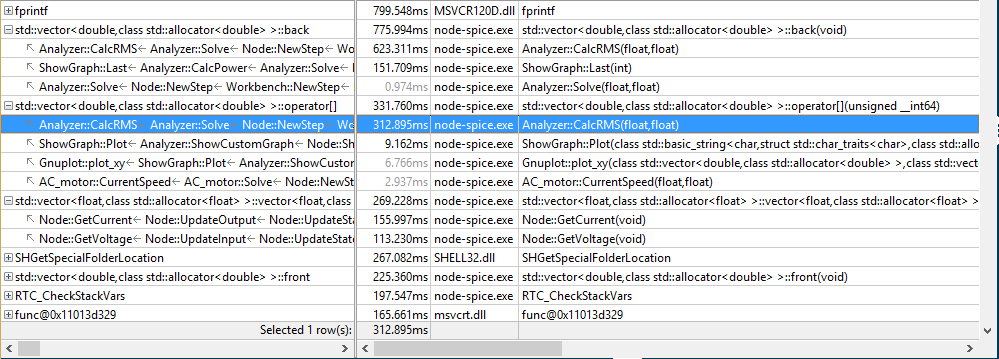

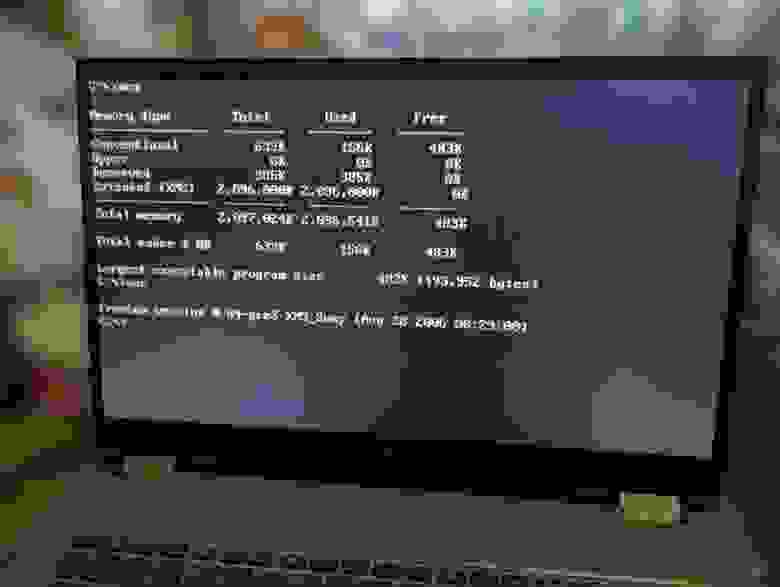

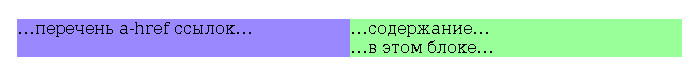

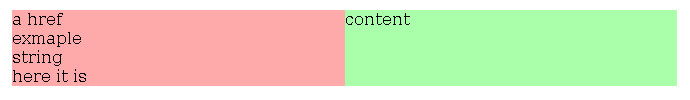

И всё было бы хорошо, но есть одна существенная проблема. Нотация BPMN использует XML для описания всех шагов, связей и расположения всех элементов схемы бизнес-процесса. Существуют различные инструменты визуального проектирования схем BPMN. Одно из самых удобных — [Camunda Modeler](https://camunda.com/download/modeler/). Любое изменение визуального представления влечет за собой изменение XML-описания. Мы в командах придерживаемся практики обязательных code review, которые проводятся средствами Bitbucket в рамках пулл-реквестов. Но рецензировать изменения в большом XML-файле, который описывает визуальное представление, практически невозможно. Попробую проиллюстрировать проблему на примере стандартного сравнения текстовых файлов, которое производит Bitbucket:

В данном случае сравнение показывает нам, что всё предыдущее содержимое файла было удалено и было добавлено полностью новое содержимое. На самом же деле на схеме изменилось лишь несколько элементов, и дополнительно был отформатирован файл BPMN.

До сих пор мы вынуждены были скачивать две версии файла (старую и новую) на локальную машину, открывать их в среде визуального просмотра и сравнивать вручную. Очень неудобно. И из-за такого подхода в прод уже просачивалось несколько багов. Актуальность этой проблемы растет вместе с количеством людей и команд, которые используют BPMN.

Долгое время меня не покидала мысль, что необходимо как-то облегчить жизнь командам, вынужденным вручную сравнивать схемы. И хорошо бы иметь встроенный в Bitbucket визуальный инструмент. Я начал изучать вопрос расширения возможностей Bitbucket с помощью плагинов. Ничего подходящего я не нашел, но зато натолкнулся на такое [демо](https://demo.bpmn.io/diff) возможностей JavaScript-библиотек от разработчиков Camunda. Это ведь то, что надо! На свой вопрос о планах разработки плагина для Bitbucket на [форуме](https://forum.bpmn.io/t/feature-request-bitbucket-plugin-to-compare-diagrams/5201) я получил отрицательный ответ. Поэтому пришлось собраться с мыслями и сделать плагин самому.

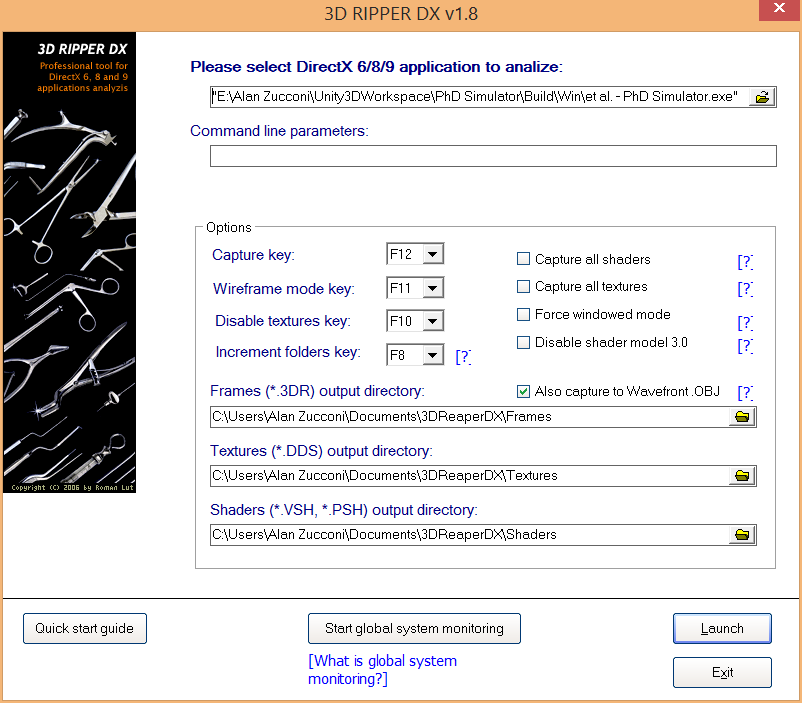

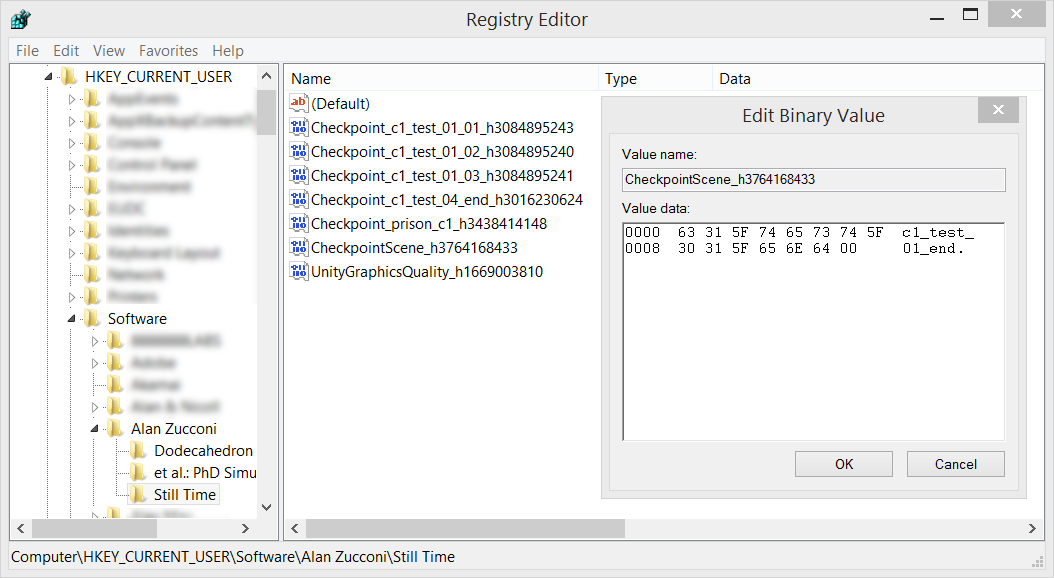

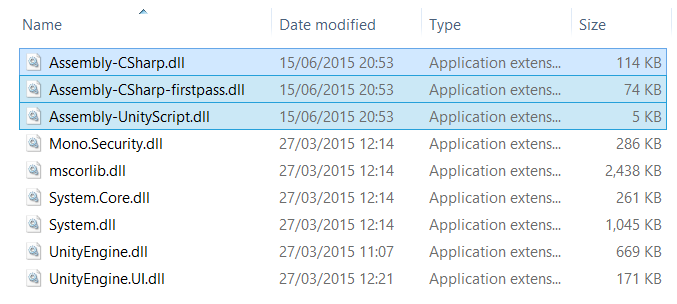

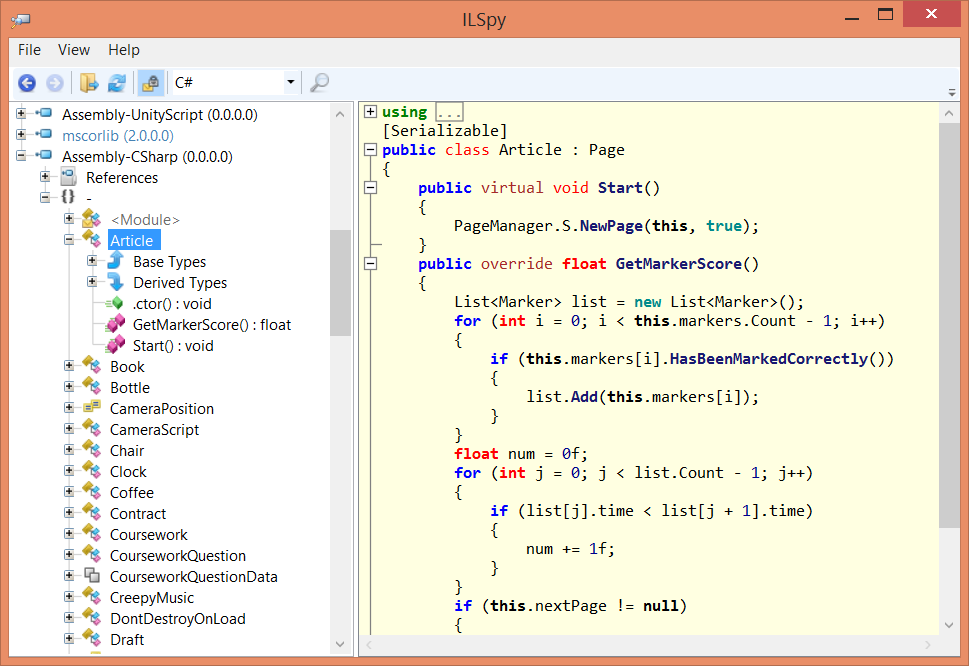

### Разработка плагина для Bitbucket

На момент начала разработки плагина я понятия не имел о том, как это делать, поэтому, как настоящий разработчик, сначала спросил у Google: «bitbucket plugin development». Google первым же результатом выдал страницу [Beginner guide to Bitbucket Server plugin development](https://developer.atlassian.com/server/bitbucket/how-tos/beginner-guide-to-bitbucket-server-plugin-development/). На этой странице мы узнаём, что есть две версии продукта: Bitbucket Server и Bitbucket Cloud. Нас интересовал Bitbucket Server. Поэтому дальнейшие шаги будут относиться только к разработке для него.

Следует заметить, что у документации Atlassian есть одна особенность: информация разбросана по множеству различных страниц, слабо связанных друг с другом. Такое впечатление, что по мере развития в документацию добавляют новые разделы, но при этом не пересматривают старые. Такой подход затрудняет поиск необходимой информации. К тому же нередко встречаются битые ссылки. Я пытался писать репорты об этом, но ситуация не меняется.

В этой статье я попробую сэкономить время тем, кто впервые сталкивается с разработкой плагинов для продуктов Atlassian, направив на действительно важные страницы и поделившись существенной информацией.

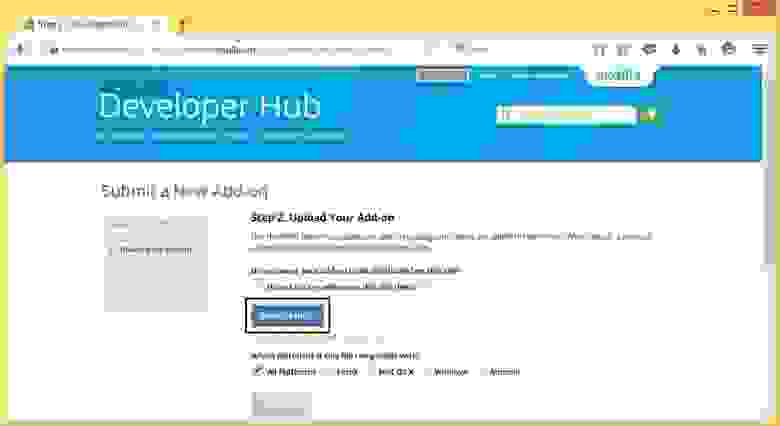

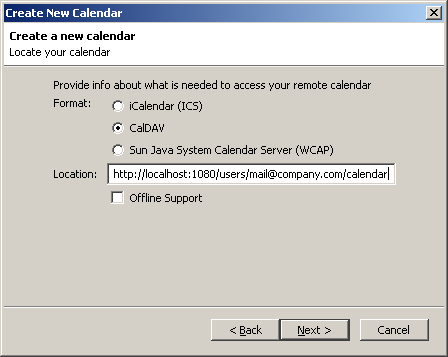

Самая важная страница — это, пожалуй, страница с инструкциями по установке, ссылкой на шаблонный проект и инструкциями по его запуску: [Getting started](https://developer.atlassian.com/server/framework/clientside-extensions/guides/introduction/). Шаблонный проект представляет собой полноценный проект с настроенной сборкой, нужными зависимостями, примерами добавления различных расширений и т.п. Необходимо лишь кое-что переименовать по прилагаемой инструкции, и можно добавлять свои расширения.

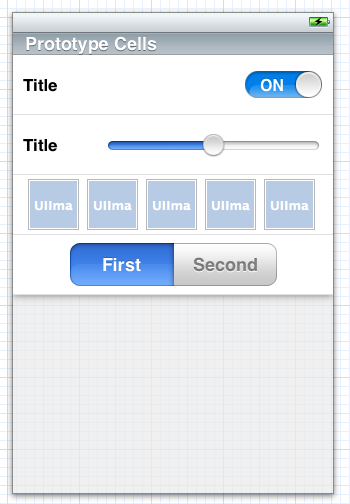

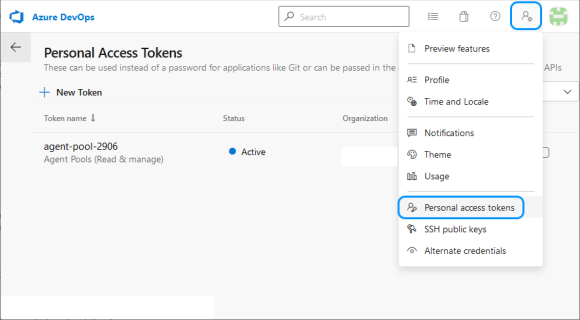

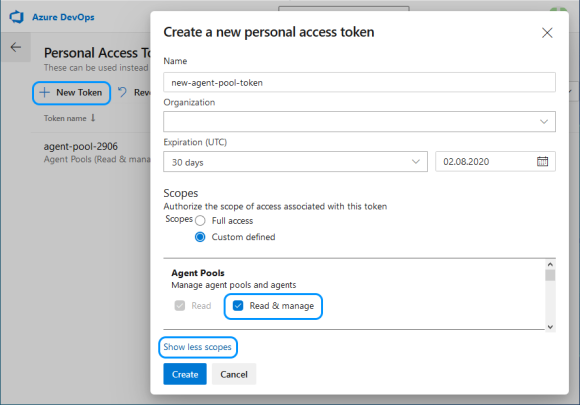

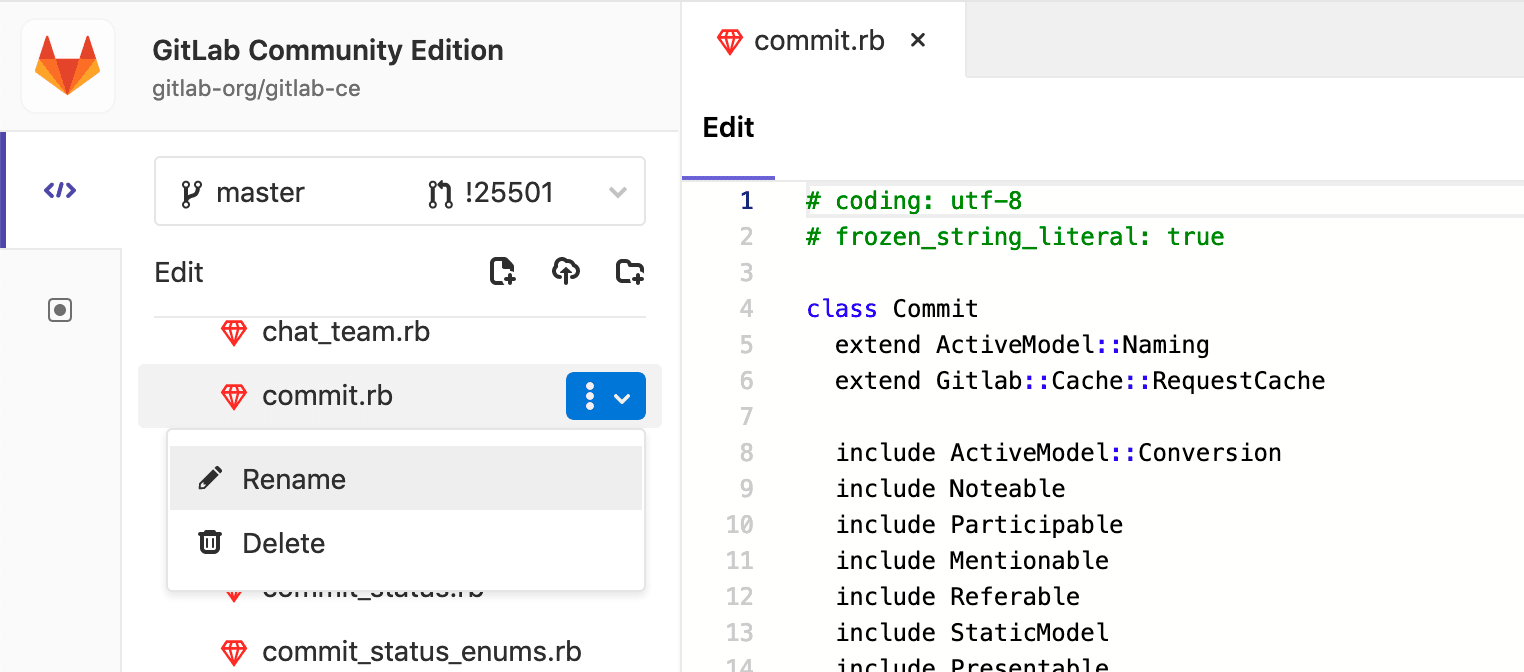

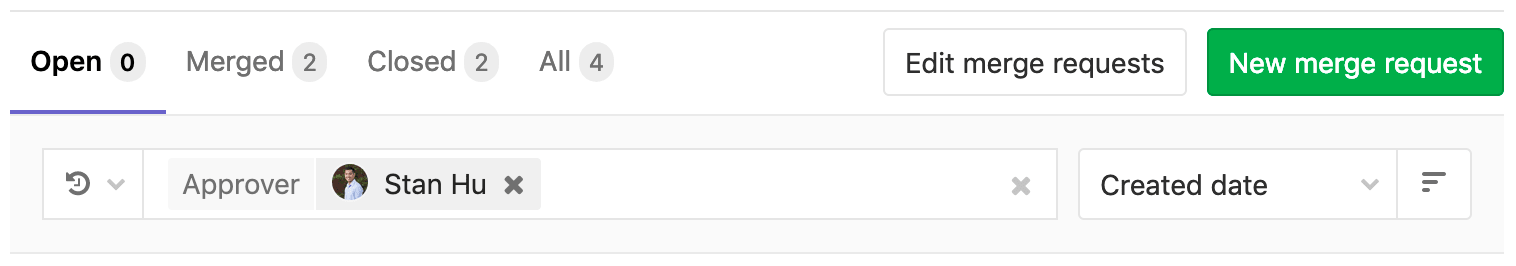

Существует два способа добавления своих элементов в UI Bitbucket на стороне клиента: [Client Web Fragments](https://developer.atlassian.com/server/bitbucket/reference/plugin-module-types/client-web-fragment/) и [Client-side Extensions](https://developer.atlassian.com/server/framework/clientside-extensions/) (aka CSE). Второй способ появился в Bitbucket Server 7 и предполагает постепенное замещение первого способа. Пока CSE доступны только на страницах, связанных с пулл-реквестами.

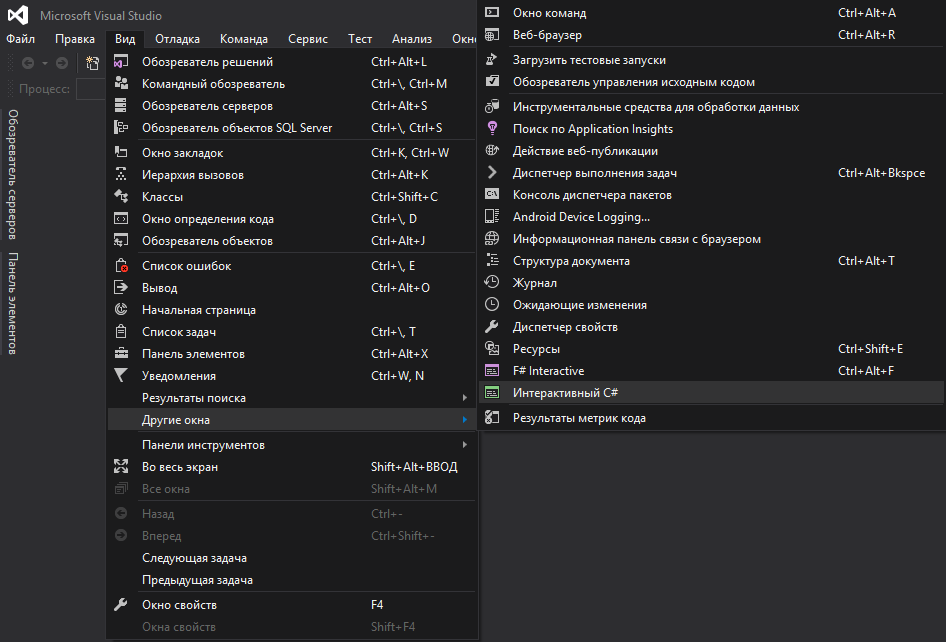

В CSE входят пять типов расширений: [кнопка, ссылка](https://developer.atlassian.com/server/framework/clientside-extensions/guides/introduction/creating-an-extension/), [модальное окно](https://developer.atlassian.com/server/framework/clientside-extensions/guides/introduction/creating-a-modal/), [панель](https://developer.atlassian.com/server/framework/clientside-extensions/guides/introduction/custom-HTML-content/), [страница](https://developer.atlassian.com/server/framework/clientside-extensions/guides/introduction/creating-a-page/). Все типы описаны на соответствующих страницах с примерами использования. Чтобы определить, какие элементы страницы предполагают расширение с помощью CSE, достаточно добавить `?clientside-extensions` к URL страницы. При переходе на такой URL подходящие места будут подсвечены специальной иконкой, при нажатии на которую можно узнать:

* какие типы расширений поддерживает этот элемент,

* идентификатор этого места (его необходимо указывать в коде вашего расширения),

* поддерживаемые атрибуты и контекст (данные, которые будут передаваться в конструктор расширения).

Подробности можно узнать на [странице](https://developer.atlassian.com/server/framework/clientside-extensions/guides/introduction/discovering-extension-points/), но я рекомендую просто поэкспериментировать с добавлением параметра к URL различных страниц в вашем Bitbucket.

Client Web Fragments я подробно рассматривать не буду, так как при реализации плагина этим инструментом воспользоваться не пришлось.

Помимо расширений на стороне клиента разработчику доступен механизм [Plugin modules](https://developer.atlassian.com/server/framework/atlassian-sdk/plugin-modules/) с разнообразным функционалом. Например, можно добавить свои ресурсы (CSS, JS и т.д.) и таким образом адаптировать поведение и UI под свои нужды.

### Трудности

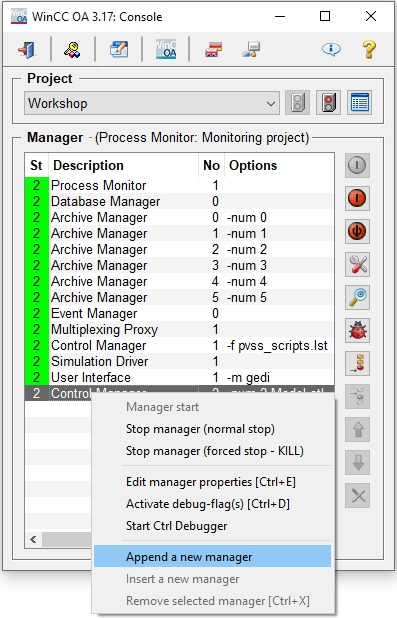

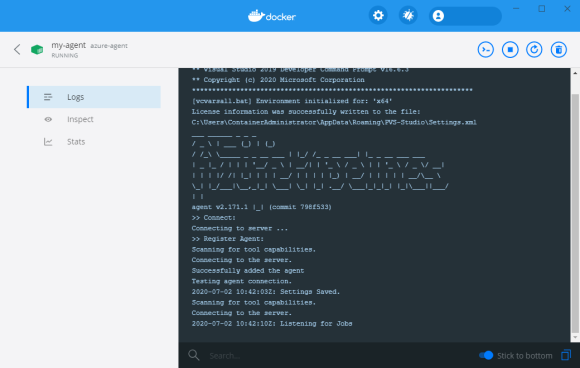

Первая трудность, с которой я столкнулся при попытке запустить шаблонный проект, заключалась в том, что расширения, реализованные в проекте, не появляются в UI Bitbucket. В логах старта обнаружилась ошибка, которая сообщала, что плагин не запускается из-за какого-то несоответствия версии библиотеки. После достаточно продолжительной медитации, гугления и исследования админки Bitbucket, причина нашлась: шаблонный проект требовал библиотеку обработки CSE версии 1.2.3. При этом на сервере оказалась установлена библиотека версии 1.0.0. Для решения этой проблемы необходимо модифицировать шаблонный проект, добавив следующий фрагмент в конфигурацию bitbucket-maven-plugin:

```

com.atlassian.maven.plugins

bitbucket-maven-plugin

…

....

com.atlassian.plugins

atlassian-clientside-extensions-page-bootstrapper

1.2.3

```

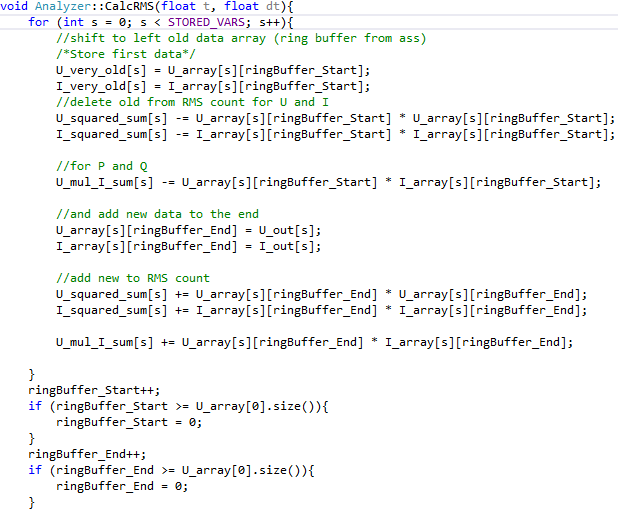

Трудность № 2. Мне необходимо было реализовать следующую логику на стороне клиента: получение двух версий содержимого BPMN-файла через REST API Bitbucket, построение модели BPMN, сравнение, отрисовка и раскраска схем. Отрисовка и раскраска требует возможности добавления собственного HTML-кода и подключения собственных стилей.

Единственным подходящим местом размещения управляющего элемента для переключения в режим графического сравнения схем оказалась шапка панели сравнения: она поддерживает CSE и обеспечивает отображение необходимого контекста (информации о проекте, репозитории, текущем выбранном файле для сравнения и номерах ревизий двух версий файла). Здесь поддерживается три типа расширений: кнопка, ссылка и модальное окно. Очевидным решением виделось использование модального окна: в этом случае пользователь оставался бы на той же странице и не терял бы контекст. Однако при использовании модального окна я столкнулся с двумя проблемами:

1. У модального окна есть несколько предустановленных размеров и нельзя указать произвольный размер. В частности, нельзя нарисовать модальное окно на весь экран, что является желательным для отрисовки схем.

2. Сейчас нет возможности привязать свои ресурсы к расширениям CSE. Либо я не обнаружил такого способа. Можно попробовать добавить JS-код и CSS-классы внутрь кода модального окна (и я даже смог это сделать и отрисовать схемы), но в результате получается совершенно неподдерживаемый кусок кода, который было бы стыдно показывать людям. К тому же это не решает первую проблему.

Далее я попробовал использовать другой тип CSE: страницу. Её использование решает первую проблему модального окна, но не решает вторую: со страницей я тоже не нашел адекватного способа подключения своих ресурсов.

Промучившись какое-то время, мне пришло в голову, что у Atlassian должна быть какая-то поддержка, форум для разработчиков. [Форум](https://community.developer.atlassian.com/c/bitbucket-development) быстро обнаружился и я задал в подходящем разделе свой вопрос: <https://community.developer.atlassian.com/t/alternative-diff-view-plugin/43717>. Однако, ответа так и не дождался. И это трудность № 3, с которой я столкнулся: низкая активность сообщества в целом и представителей Atlassian в частности. Спустя 17 дней после того, как я задал вопрос, я сам же на него и запостил ответ. Заодно ответил на вопрос другого разработчика в соседней теме, который также ждал 17 дней.

В конце концов мне удалось решить свою задачу. Я использовал кнопку CSE на странице сравнения, которая открывает новую вкладку со страницей, где отрисовывается графическое сравнение схем. Для отдельной страницы я использовал [Servlet plugin module](https://developer.atlassian.com/server/framework/atlassian-sdk/servlet-plugin-module/), который поддерживает подключение статических ресурсов. А для самого подключения я применил [Web Resource plugin module](https://developer.atlassian.com/server/framework/atlassian-sdk/web-resource-plugin-module/).

Чтобы использовать [Servlet plugin module](https://developer.atlassian.com/server/framework/atlassian-sdk/servlet-plugin-module/), необходимо реализовать свой сервлет, генерирующий HTML-код страницы. Очевидно, что отдавать контент сервлет должен только аутентифицированным пользователям. Но как это обеспечить? Если покопаться в примерах кода на ресурсах Atlassian, то можно обнаружить необходимый код для Jira с использованием её библиотеки, которая не подходит для Bitbucket. Но этот код наводит на мысль, что подобный API должен быть и у Bitbucket (хотя прямого описания в документации я не обнаружил). После некоторых поисков обнаружилась нужная библиотека:

```

com.atlassian.bitbucket.server

bitbucket-api

${bitbucket.api.version}

provided

```

В этой библиотеке есть класс AuthenticationContext с искомым методом isAuthenticated(). Осталось только заавтовайрить этот класс в классе сервлета.

Аналогичная проблема с библиотекой генерации HTML по шаблону (в моем случае это шаблон `Velocity`). Необходимо подключить библиотеку:

```

com.atlassian.templaterenderer

atlassian-template-renderer-api

${atr.version}

provided

```

И далее использовать ее в сервлете:

```

templateRenderer.render(TEMPLATE_PATH, params, response.getWriter());

```

Трудность № 4 заключалась в том, что совершенно непонятно, что за библиотеки тебе нужны для решения вполне обычных задач. В документации это либо не описано, либо находится где-то очень глубоко (поправьте меня, если я вдруг ошибаюсь).

И последний совет. Опытным frontend-разработчикам, наверное, это покажется очевидным, но я дошел до этого не сразу. Используйте режим инкогнито в браузере для тестирования своих плагинов. Это сэкономит много времени и нервов, которые были бы потрачены на поиски «странных» багов.

### Результат

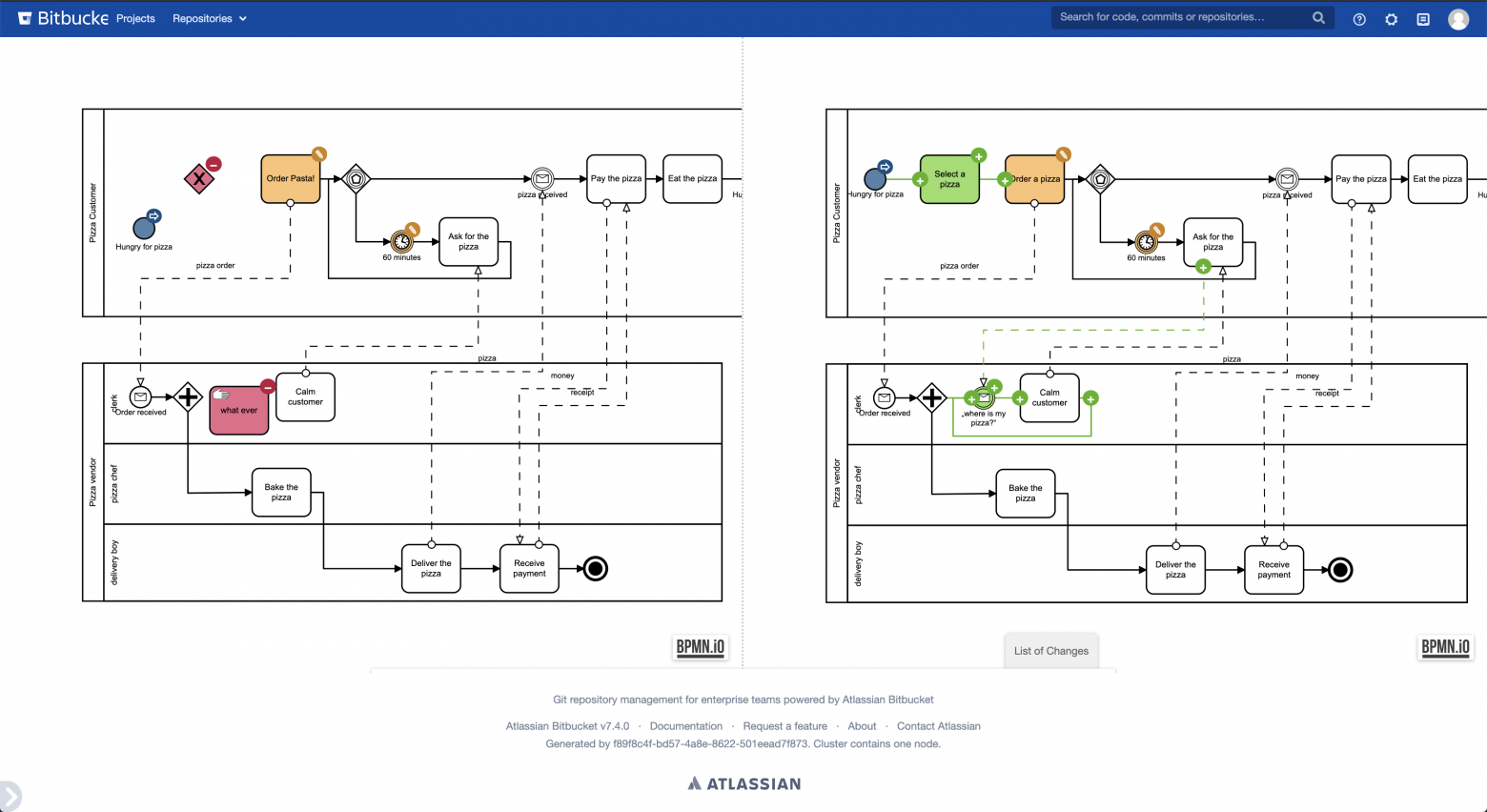

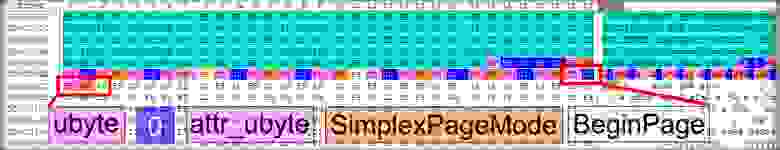

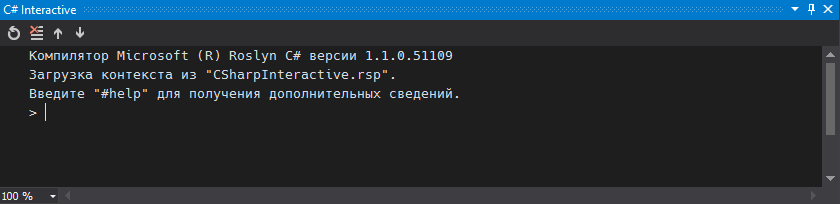

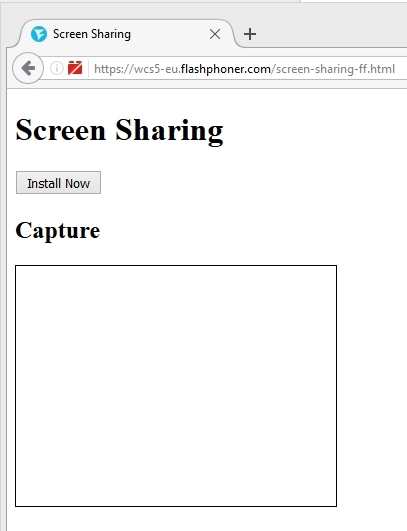

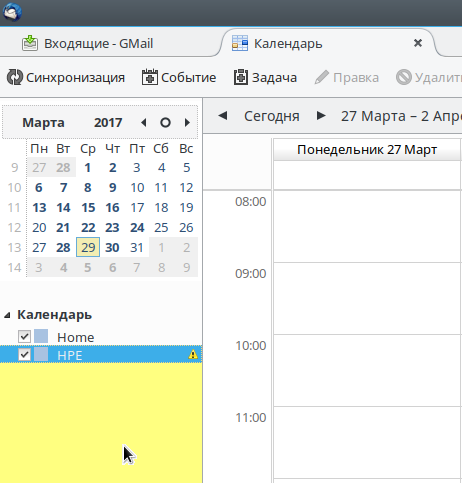

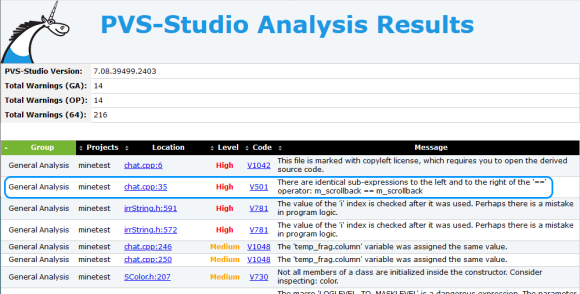

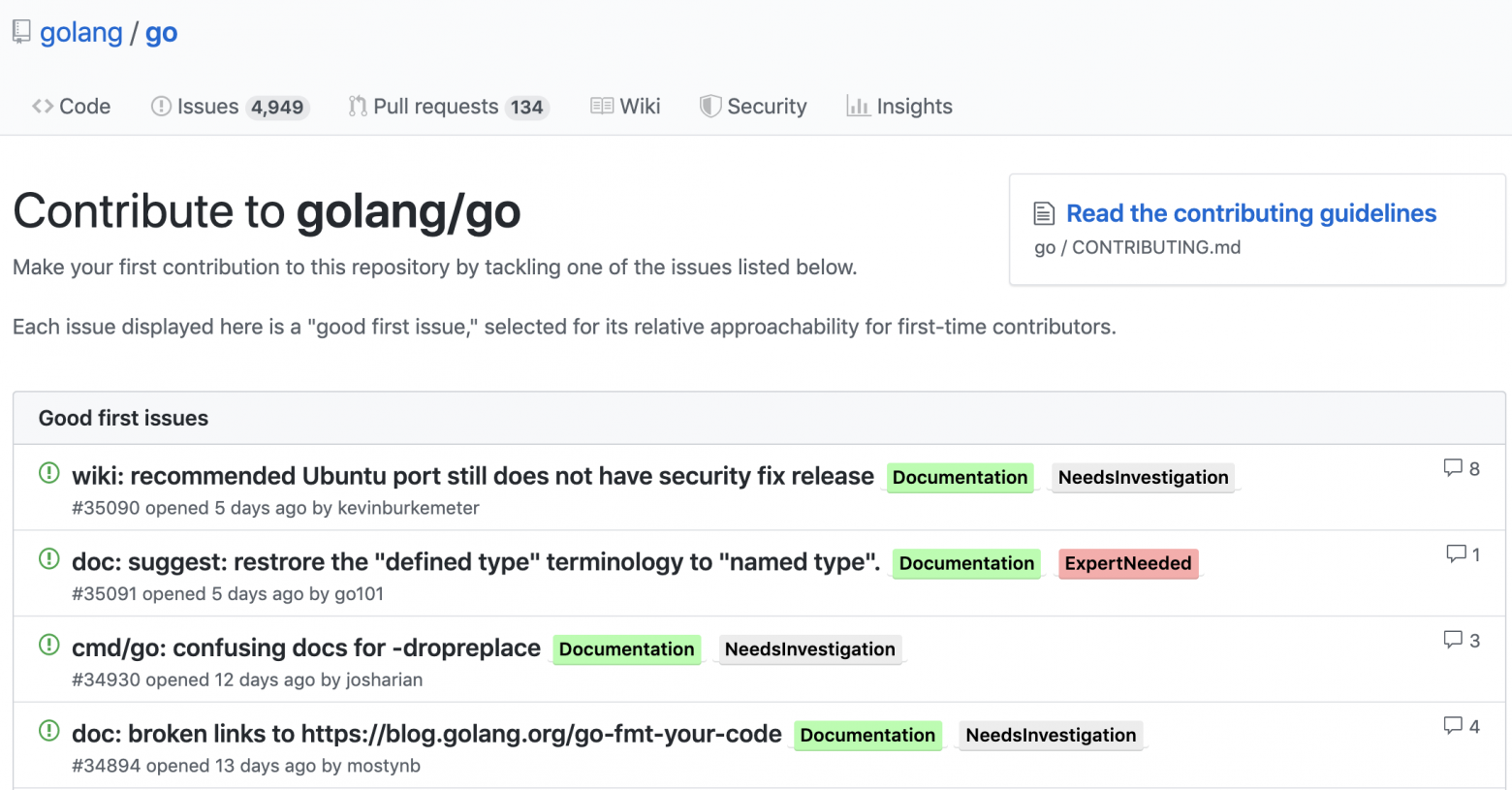

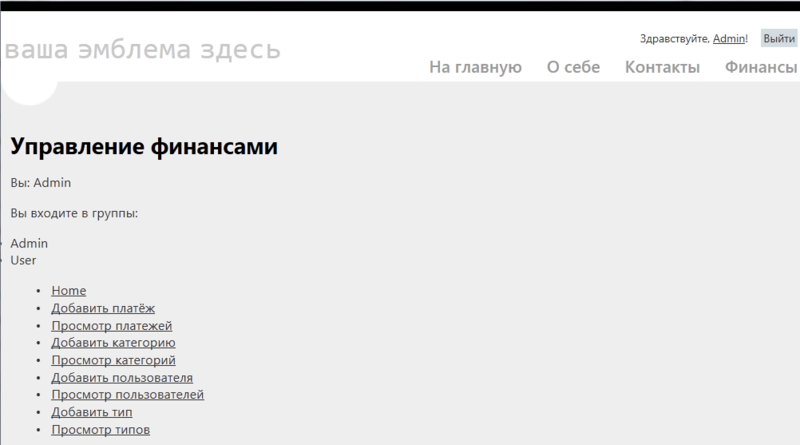

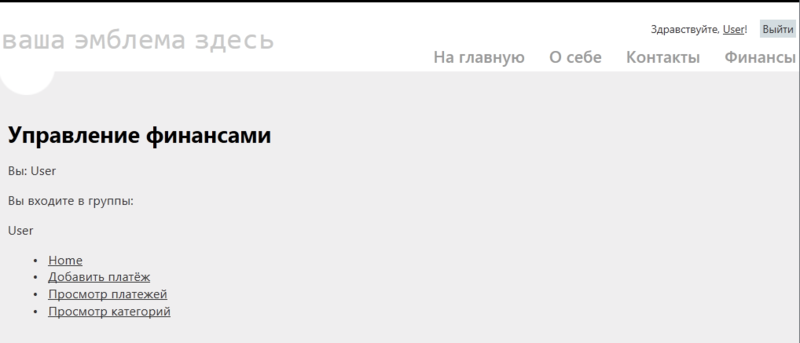

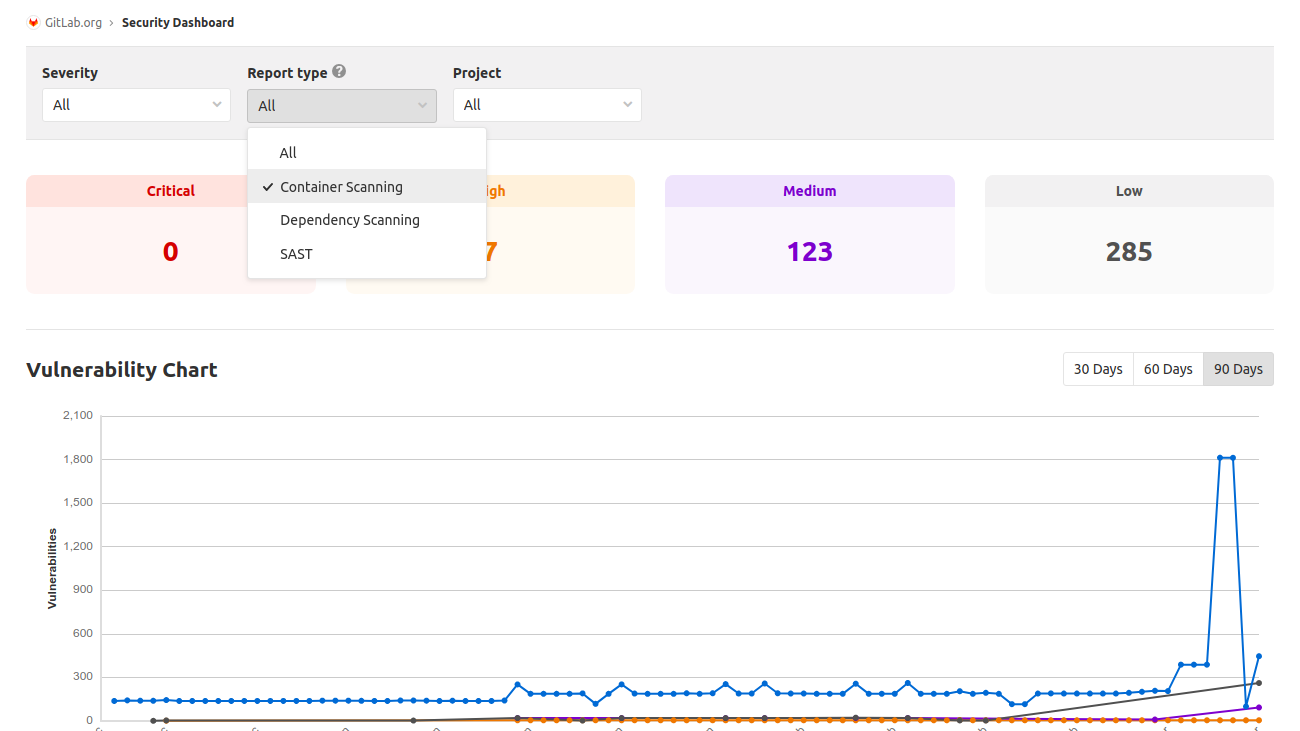

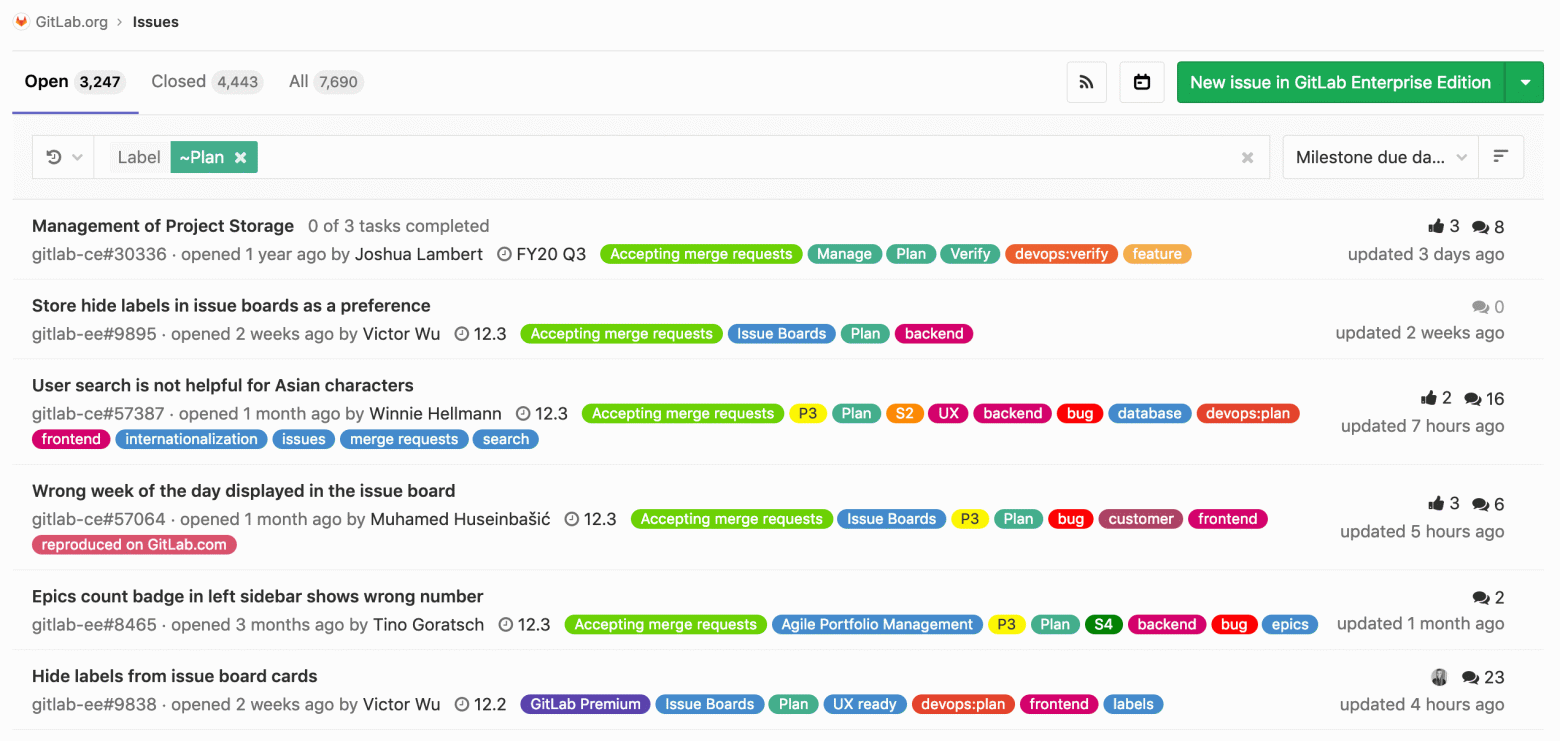

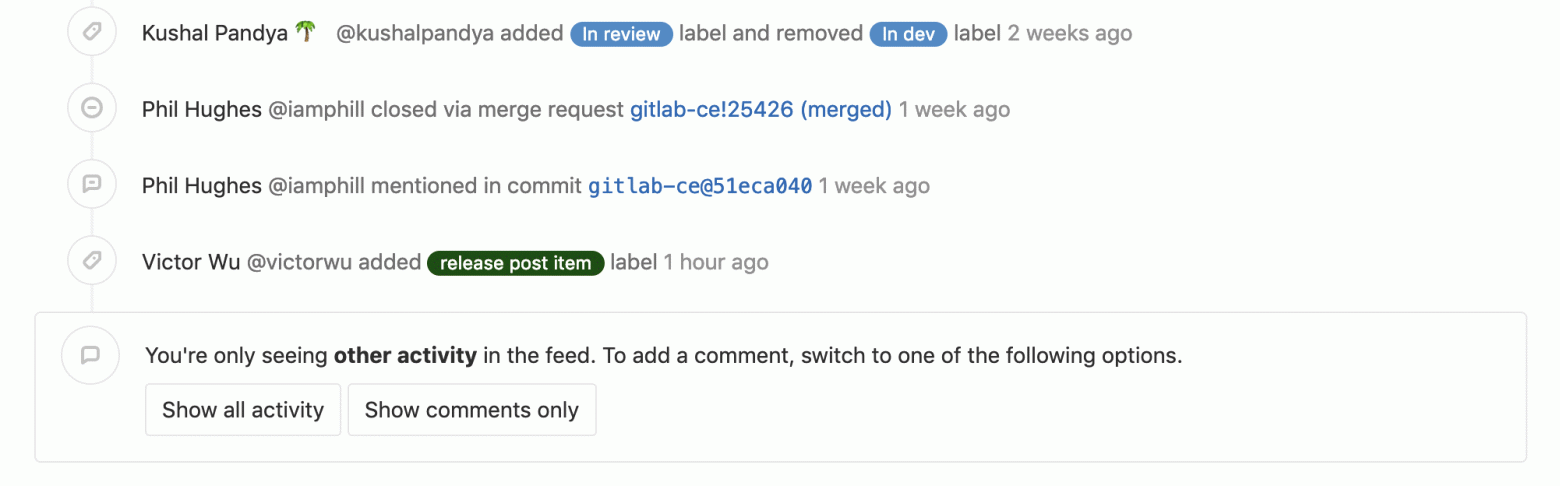

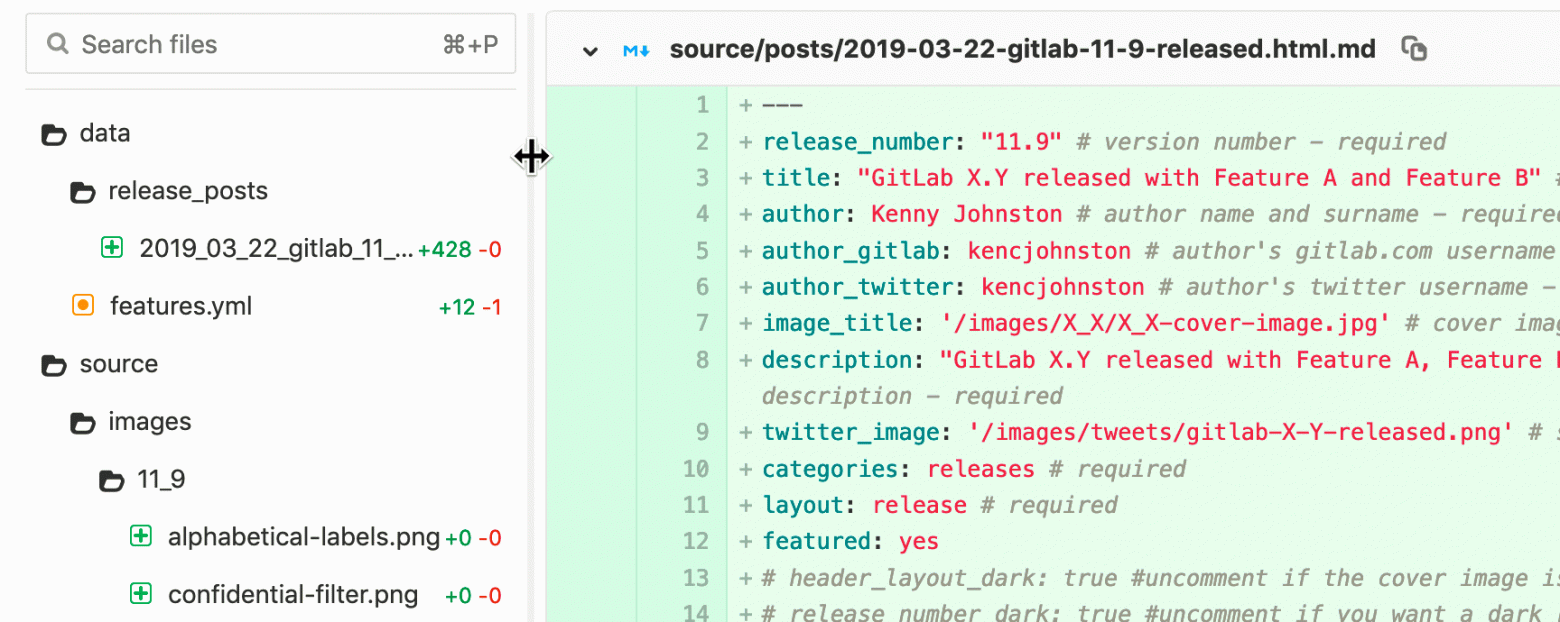

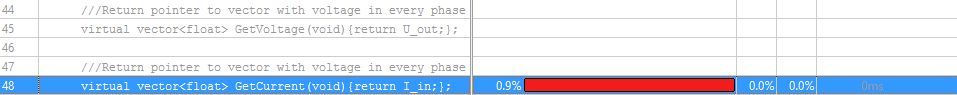

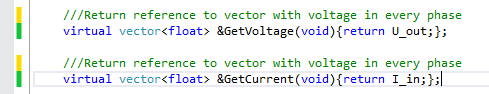

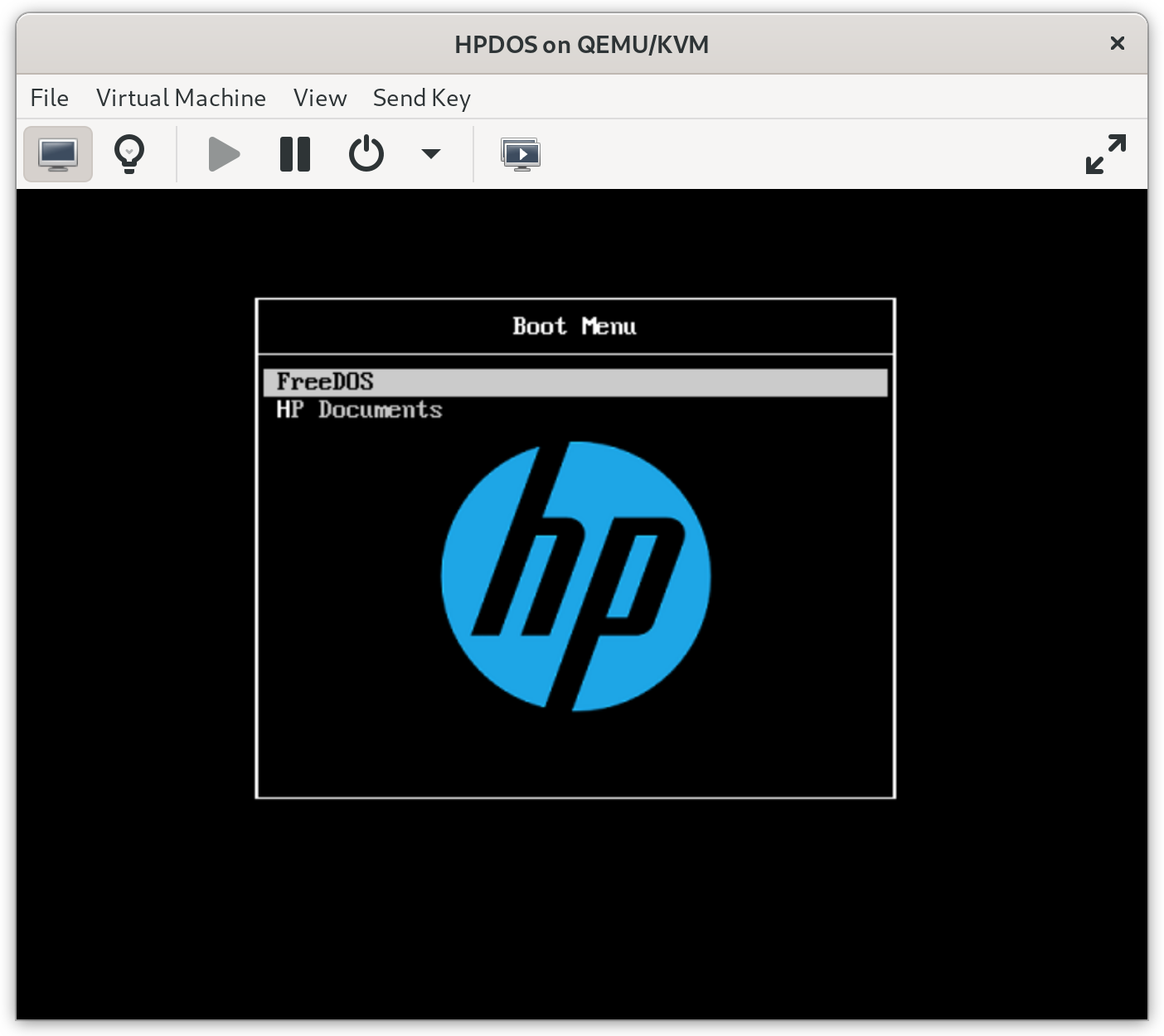

У меня получился плагин для Bitbucket Server версии 7. Плагин добавляет кнопку «BPMN Visual Diff» в шапку панели сравнения:

Кнопка отрисовывается только в том случае, если для сравнения выбран файл с расширением `.bpmn`. Таким образом, пользователи, не использующие BPMN, даже не заметят изменений.

По нажатию на кнопку открывается новая вкладка, в которой производится визуальное сравнение двух версий схемы: можно увидеть удалённые, добавленные, изменённые элементы. А для изменённых элементов дополнительно можно посмотреть, какие атрибуты этих элементов изменились и как. В результате абсолютно бесполезное сравнение текстовых файлов, приведенное в качестве примера в начале статьи, превращается вот в такое визуальное сравнение:

Исходный код проекта плагина доступен на [GitHub](https://github.com/domclick/bpmn-diff-bitbucket-plugin) под лицензией MIT. Пожелания, критика и пулл-реквесты приветствуются. В ближайших планах — адаптация плагина для Bitbucket Server версии 6. | https://habr.com/ru/post/534890/ | null | ru | null |

# Как работает JS: WebSocket и HTTP/2+SSE. Что выбрать?

**[Советуем почитать] Другие 19 частей цикла**Часть 1: [Обзор движка, механизмов времени выполнения, стека вызовов](https://habrahabr.ru/company/ruvds/blog/337042/)

Часть 2: [О внутреннем устройстве V8 и оптимизации кода](https://habrahabr.ru/company/ruvds/blog/337460/)

Часть 3: [Управление памятью, четыре вида утечек памяти и борьба с ними](https://habrahabr.ru/company/ruvds/blog/338150/)

Часть 4: [Цикл событий, асинхронность и пять способов улучшения кода с помощью async / await](https://habrahabr.ru/company/ruvds/blog/340508/)

Часть 5: [WebSocket и HTTP/2+SSE. Что выбрать?](https://habrahabr.ru/company/ruvds/blog/342346/)

Часть 6: [Особенности и сфера применения WebAssembly](https://habrahabr.ru/company/ruvds/blog/343568/)

Часть 7: [Веб-воркеры и пять сценариев их использования](https://habrahabr.ru/company/ruvds/blog/348424/)

Часть 8: [Сервис-воркеры](https://habrahabr.ru/company/ruvds/blog/349858/)

Часть 9: [Веб push-уведомления](https://habrahabr.ru/company/ruvds/blog/350486/)

Часть 10: [Отслеживание изменений в DOM с помощью MutationObserver](https://habrahabr.ru/company/ruvds/blog/351256/)

Часть 11: [Движки рендеринга веб-страниц и советы по оптимизации их производительности](https://habrahabr.ru/company/ruvds/blog/351802/)

Часть 12: [Сетевая подсистема браузеров, оптимизация её производительности и безопасности](https://habr.com/company/ruvds/blog/354070/)

Часть 12: [Сетевая подсистема браузеров, оптимизация её производительности и безопасности](https://habr.com/company/ruvds/blog/354070/)

Часть 13: [Анимация средствами CSS и JavaScript](https://habr.com/company/ruvds/blog/354438/)

Часть 14: [Как работает JS: абстрактные синтаксические деревья, парсинг и его оптимизация](https://habr.com/company/ruvds/blog/415269/)

Часть 15: [Как работает JS: классы и наследование, транспиляция в Babel и TypeScript](https://habr.com/company/ruvds/blog/415377/)

Часть 16: [Как работает JS: системы хранения данных](https://habr.com/company/ruvds/blog/415505/)

Часть 17: [Как работает JS: технология Shadow DOM и веб-компоненты](https://habr.com/company/ruvds/blog/415881/)

Часть 18: [Как работает JS: WebRTC и механизмы P2P-коммуникаций](https://habr.com/company/ruvds/blog/416821/)

Часть 19: [Как работает JS: пользовательские элементы](https://habr.com/company/ruvds/blog/419831/)

Перед вами — перевод пятого материала из серии, посвящённой особенностям JS-разработки. В предыдущих статьях мы рассматривали основные элементы экосистемы JavaScript, возможностями которых пользуются разработчики серверного и клиентского кода. В этих материалах, после изложения основ тех или иных аспектов JS, даются рекомендации по их использованию. Автор статьи говорит, что эти принципы применяются в ходе разработки приложения [SessionStack](https://www.sessionstack.com/). Современный пользователь библиотек и фреймворков может выбирать из множества возможностей, поэтому любому проекту, для того, чтобы достойно смотреться в конкурентной борьбе, приходится выжимать из технологий, на которых он построен, всё, что можно.

[](https://habrahabr.ru/company/ruvds/blog/342346/)В этот раз мы поговорим о коммуникационных протоколах, сопоставим и обсудим их особенности и составные части. Тут мы займёмся технологиями WebSocket и HTTP/2, в частности, поговорим о безопасности и поделимся советами, касающимися выбора подходящих протоколов в различных ситуациях.

Введение

--------

В наши дни сложные веб-приложения, обладающие насыщенными динамическими пользовательскими интерфейсами, воспринимаются как нечто само собой разумеющееся. А ведь интернету пришлось пройти долгий путь для того, чтобы достичь его сегодняшнего состояния.

В самом начале интернет не был рассчитан на поддержку подобных приложений. Он был задуман как коллекция HTML-страниц, как «паутина» из связанных друг с другом ссылками документов. Всё было, в основном, построено вокруг парадигмы HTTP «запрос/ответ». Клиентские приложения загружали страницы и после этого ничего не происходило до того момента, пока пользователь не щёлкнул мышью по ссылке для перехода на очередную страницу.

Примерно в 2005-м году появилась технология AJAX и множество программистов начало исследовать возможности двунаправленной связи между клиентом и сервером. Однако, все сеансы HTTP-связи всё ещё инициировал клиент, что требовало либо участия пользователя, либо выполнения периодических обращений к серверу для загрузки новых данных.

«Двунаправленный» обмен данными по HTTP

---------------------------------------

Технологии, которые позволяют «упреждающе» отправлять данные с сервера на клиент существуют уже довольно давно. Среди них — [Push](https://en.wikipedia.org/wiki/Push_technology) и [Comet](http://en.wikipedia.org/wiki/Comet_%28programming%29).

Один из наиболее часто используемых приёмов для создании иллюзии того, что сервер самостоятельно отправляет данные клиенту, называется «длинный опрос» (long polling). С использованием этой технологии клиент открывает HTTP-соединение с сервером, который держит его открытым до тех пор, пока не будет отправлен ответ. В результате, когда у сервера появляются данные для клиента, он их ему отправляет.

Вот пример очень простого фрагмента кода, реализующего технологию длинного опроса:

```

(function poll(){

setTimeout(function(){

$.ajax({

url: 'https://api.example.com/endpoint',

success: function(data) {

// Делаем что-то с `data`

// ...

// Рекурсивно выполняем следующий запрос

poll();

},

dataType: 'json'

});

}, 10000);

})();

```

Эта конструкция представляет собой функцию, которая сама себя вызывает после того, как, в первый раз, будет запущена автоматически. Она задаёт 10-секундный интервал для каждого асинхронного Ajax-обращению к серверу, а после обработки ответа сервера снова выполняется планирование вызова функции.

Ещё одна используемая в подобной ситуации техника — это [Flash](http://help.adobe.com/en_US/FlashPlatform/reference/actionscript/3/flash/net/Socket.html) или составной запрос HXR, и так называемые [htmlfiles](http://cometdaily.com/2007/12/27/a-standards-based-approach-to-comet-communication-with-rest/).

У всех этих технологий одна и та же проблема: дополнительная нагрузка на систему, которую создаёт использование HTTP, что делает всё это неподходящим для организации работы приложений, где требуется высокая скорость отклика. Например, это что-то вроде многопользовательской браузерной «стрелялки» или любой другой онлайн-игры, действия в которой выполняются в режиме реального времени.

Введение в технологию WebSocket

-------------------------------

Спецификация [WebSocket](https://developer.mozilla.org/en-US/docs/Web/API/WebSockets_API) определяет API для установки соединения между веб-браузером и сервером, основанного на «сокете». Проще говоря, это — постоянное соединение между клиентом и сервером, пользуясь которыми клиент и сервер могут отправлять данные друг другу в любое время.

Клиент устанавливает соединение, выполняя процесс так называемого рукопожатия WebSocket. Этот процесс начинается с того, что клиент отправляет серверу обычный HTTP-запрос. В этот запрос включается заголовок `Upgrade`, который сообщает серверу о том, что клиент желает установить WebSocket-соединение.

Посмотрим, как установка такого соединения выглядит со стороны клиента:

```

// Создаём новое WebSocket-соединение.

var socket = new WebSocket('ws://websocket.example.com');

```

URL, применяемый для WebSocket-соединения, использует схему `ws`. Кроме того, имеется схема `wss` для организации защищённых WebSocket-соединений, что является эквивалентом HTTPS.

В данном случае показано начало процесса открытия WebSocket-соединения с сервером `websocket.example.com`.

Вот упрощённый пример заголовков исходного запроса.

```

GET ws://websocket.example.com/ HTTP/1.1

Origin: http://example.com

Connection: Upgrade

Host: websocket.example.com

Upgrade: websocket

```

Если сервер поддерживает протокол WebSocket, он согласится перейти на него и сообщит об этом в заголовке ответа `Upgrade`. Посмотрим на реализацию этого механизма с использованием Node.js:

```

// Будем использовать реализацию WebSocket из

//https://github.com/theturtle32/WebSocket-Node

var WebSocketServer = require('websocket').server;

var http = require('http');

var server = http.createServer(function(request, response) {

// обработаем HTTP-запрос.

});

server.listen(1337, function() { });

// создадим сервер

wsServer = new WebSocketServer({

httpServer: server

});

// WebSocket-сервер

wsServer.on('request', function(request) {

var connection = request.accept(null, request.origin);

// Это - самый важный для нас коллбэк, где обрабатываются

// сообщения от клиента.

connection.on('message', function(message) {

// Обработаем сообщение WebSocket

});

connection.on('close', function(connection) {

// Закрытие соединения

});

});

```

После установки соединения в ответе сервера будут сведения о переходе на протокол WebSocket:

```

HTTP/1.1 101 Switching Protocols

Date: Wed, 25 Oct 2017 10:07:34 GMT

Connection: Upgrade

Upgrade: WebSocket

```

После этого вызывается событие `open` в экземпляре WebSocket на клиенте:

```

var socket = new WebSocket('ws://websocket.example.com');

// Выводим сообщение при открытии WebSocket-соединения.

socket.onopen = function(event) {

console.log('WebSocket is connected.');

};

```

Теперь, после завершения фазы рукопожатия, исходное HTTP-соединение заменяется на WebSocket-соединение, которое использует то же самое базовое TCP/IP-соединение. В этот момент и клиент и сервер могут приступать к отправке данных.

Благодаря использованию WebSocket можно отправлять любые объёмы данных, не подвергая систему ненужной нагрузке, вызываемой использованием традиционных HTTP-запросов. Данные передаются по WebSocket-соединению в виде сообщений, каждое из которых состоит из одного или нескольких фреймов, содержащих отправляемые данные (полезную нагрузку). Для того, чтобы обеспечить правильную сборку исходного сообщения по достижению им клиента, каждый фрейм имеет префикс, содержащий 4-12 байтов данных о полезной нагрузке. Использование системы обмена сообщениями, основанной на фреймах, помогает сократить число служебных данных, передаваемых по каналу связи, что значительно уменьшает задержки при передаче информации.

Стоит отметить, что клиенту будет сообщено о поступлении нового сообщения только после того, как будут получены все фреймы и исходная полезная нагрузка сообщения будет реконструирована.

Различные URL протокола WebSocket

---------------------------------

Выше мы упоминали о том, что в WebSocket используется новая схема URL. На самом деле — их две: `ws://` и `wss://`.

При построении URL-адресов используются определённые правила. Особенностью URL WebSocket является то, что они не поддерживают якоря (`#sample_anchor`).

В остальном к URL WebSocket применяются те же правила, что и к URL HTTP. При использовании ws-адресов соединение оказывается незашифрованным, по умолчанию применяется порт 80. При использовании wss требуется TLS-шифрование и применяется порт 443.

Протокол работы с фреймами

--------------------------

Взглянем поближе на протокол работы с фреймами WebSocket. Вот что можно узнать о структуре фрейма из соответствующего [RFC](https://tools.ietf.org/html/rfc6455#page-27):

Если говорить о версии WebSocket, стандартизированной RFC, то можно сказать, что в начале каждого пакета имеется небольшой заголовок. Однако, устроен он довольно сложно. Вот описание его составных частей:

* `fin` (1 бит): указывает на то, является ли этот фрейм последним фреймом, завершающим передачу сообщения. Чаще всего для передачи сообщения достаточно одного фрейма и этот бит всегда оказывается установленным. Эксперименты показали, что Firefox создаёт второй фрейм после того, как размер сообщения превысит 32 Кб.

* `rsv1`, `rsv2`, `rsv3` (каждое по 1-му биту): эти поля должны быть установлены в 0, только если не было достигнуто договорённости о расширениях, которая и определит смысл их ненулевых значений. Если в одном из этих полей будет установлено ненулевое значение и при этом не было достигнуто договорённости о смысле этого значения, получатель должен признать соединение недействительным.

* `opcode` (4 бита): здесь закодированы сведения о содержимом фрейма. В настоящее время используются следующие значения:

+ `0x00`: в этом фрейме находится следующая часть передаваемого сообщения.

+ `0x01`: в этом фрейме находятся текстовые данные.

+ `0x02`: в этом фрейме находятся бинарные данные.

+ `0x08`: этот фрейм завершает соединение.

+ `0x09`: это ping-фрейм.

+ `0x0a`: это pong-фрейм.

Как видите, здесь достаточно неиспользуемых значений. Они зарезервированы на будущее.

* `mask` (1 бит): указывает на то, что фрейм замаскирован. Сейчас дело обстоит так, что каждое сообщение от клиента к серверу должно быть замаскировано, в противном случае спецификации предписывают разрывать соединения.

* `payload_len` (7 битов): длина полезной нагрузки. Фреймы WebSocket поддерживают следующие методы указания размеров полезной нагрузки. Значение 0-125 указывает на длину полезной нагрузки. 126 означает, что следующие два байта означают размер. 127 означает, что следующие 8 байтов содержат сведения о размере. В результате длина полезной нагрузки может быть записана примерно в 7 битах, или в 16, или в 64-х.

* `masking-key` (32 бита): все фреймы, отправленные с клиента на сервер, замаскированы с помощью 32-битного значения, которое содержится во фрейме.

* `payload`: передаваемые во фрейме данные, которые, наверняка, замаскированы. Их длина соответствует тому, что задано в `payload_len`.

Почему протокол WebSocket основан на фреймах, а не на потоках? Если вы знаете ответ на этот вопрос — можете поделиться им в комментариях. Кроме того, [вот интересное обсуждение](https://news.ycombinator.com/item?id=3377406) на эту тему на HackerNews.

Данные во фреймах

-----------------

Как уже было сказано, данные могут быть разбиты на множество фреймов. В первом фрейме, с которого начинается передача данных, в поле `opcode`, задаётся тип передаваемых данных. Это необходимо, так как в JavaScript, можно сказать, не было поддержки бинарных данных во время начала работы над спецификацией WebSockets. Код `0x01` указывает на данные в кодировке UTF-8, код `0x02` используется для бинарных данных. Часто в пакетах WebSocket передают JSON-данные, для которых обычно устанавливают поле `opcode` как для текста. При передаче бинарных данных они будут представлены в виде [Blob](https://developer.mozilla.org/en-US/docs/Web/API/Blob)-сущностей, специфичных для веб-браузера.

API для передачи данных по протоколу WebSocket устроено очень просто:

```

var socket = new WebSocket('ws://websocket.example.com');

socket.onopen = function(event) {

socket.send('Some message'); // Отправка данных на сервер.

};

```

Когда, на клиентской стороне, WebSocket принимает данные, вызывается событие `message`. Это событие имеет свойство `data`, которое можно использовать для работы с содержимым сообщения.

```

// Обработка сообщений, отправленных сервером.

socket.onmessage = function(event) {

var message = event.data;

console.log(message);

};

```

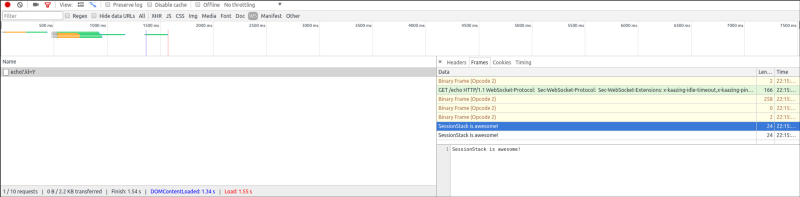

Узнать, что находится внутри фреймов WebSocket-соединения, можно с помощью вкладки Network (Сеть) инструментов разработчика Chrome:

Фрагментация данных

-------------------

Полезные данные могут быть разбиты на несколько отдельных фреймов. Предполагается, что получающая сторона будет буферизовать фреймы до тех пор, пока не поступит фрейм с установленным полем заголовка `fin`. В результате, например, сообщение «Hello World» можно передать в 11 фреймах, каждый из которых несёт 1 байт полезной нагрузки и 6 байтов заголовочных данных. Фрагментация управляющих пакетов запрещена. Однако, спецификация даёт возможность обрабатывать [чередующиеся](https://en.wikipedia.org/wiki/Interleaving_%28data%29) управляющие фреймы. Это нужно в том случае, если TCP-пакеты прибывают в произвольном порядке.

Логика объединения фреймов, в общих чертах, выглядит так:

* Принять первый фрейм.

* Запомнить значение поля `opcode`.

* Принимать другие фреймы и объединять полезную нагрузку фреймов до тех пор, пока не будет получен фрейм с установленным битом `fin`.

* Проверить, чтобы поле `opcode` у всех фреймов, кроме первого, было установлено в ноль.

Основная цель фрагментации заключается в том, чтобы позволить отправку сообщений, размер которых неизвестен на момент начала отправки данных.

Благодаря фрагментации сервер может подобрать буфер разумного размера, а, когда буфер заполняется, отправлять данные в сеть. Второй вариант использования фрагментации заключается в мультиплексировании, когда нежелательно, чтобы сообщение занимало весь логический канал связи. В результате для целей мультиплексирования нужно иметь возможность разбивать сообщения на более мелкие фрагменты для того, чтобы лучше организовать совместное использование канала.

О heartbeat-сообщениях

----------------------

В любой момент после процедуры рукопожатия, либо клиент, либо сервер, может решить отправить другой стороне ping-сообщение. Получая такое сообщение, получатель должен отправить, как можно скорее, pong-сообщение. Это и есть heartbeat-сообщения. Их можно использовать для того, чтобы проверить, подключён ли ещё клиент к серверу.

Сообщения «ping» и «pong» — это всего лишь управляющие фреймы. У ping-сообщений поле `opcode` установлено в значение `0x9`, у pong-сообщений — в `0xA`. При получении ping-сообщения, в ответ надо отправить pong-сообщение, содержащее ту же полезную нагрузку, что и ping-сообщение (для таких сообщений максимальная длина полезной нагрузки составляет 125). Кроме того, вы можете получить pong-сообщение, не отправляя перед этим ping-сообщение. Такие сообщения можно просто игнорировать.

Подобная схема обмена сообщениями может быть очень полезной. Есть службы (вроде балансировщиков нагрузки), которые останавливают простаивающие соединения.

Вдобавок, одна из сторон не может, без дополнительных усилий, узнать о том, что другая сторона завершила работу. Только при следующей отправке данных вы можете выяснить, что что-то пошло не так.

Обработка ошибок

----------------

Обрабатывать ошибки в ходе работы с WebSocket-соединениями можно, подписавшись на событие `error`. Выглядит это примерно так:

```

var socket = new WebSocket('ws://websocket.example.com');

// Обработка ошибок.

socket.onerror = function(error) {

console.log('WebSocket Error: ' + error);

};

```

Закрытие соединения

-------------------

Для того, чтобы закрыть соединение, либо клиент, либо сервер, должен отправить управляющий фрейм с полем `opcode`, установленным в `0x8`. При получении подобного фрейма другая сторона, в ответ, отправляет фрейм закрытия соединения. Первая сторона затем закрывает соединение. Таким образом, данные, полученные после закрытия соединения, отбрасываются.

Вот как инициируют операцию закрытия WebSocket-соединения на клиенте:

```

// Закрыть соединение, если оно открыто.

if (socket.readyState === WebSocket.OPEN) {

socket.close();

}

```

Кроме того, для того, чтобы произвести очистку после завершения закрытия соединения, можно подписаться на событие `close`:

```

// Выполнить очистку.

socket.onclose = function(event) {

console.log('Disconnected from WebSocket.');

};

```

Серверу нужно прослушивать событие `close` для того, чтобы, при необходимости, его обработать:

```

connection.on('close', function(reasonCode, description) {

// Соединение закрывается.

});

```

Сравнение технологий WebSocket и HTTP/2

---------------------------------------

Хотя HTTP/2 предлагает множество возможностей, эта технология не может полностью заменить существующие push-технологии и потоковые способы передачи данных.

Первое, что важно знать об HTTP/2, заключается в том, что это — не замена всего, что есть в HTTP. Виды запросов, коды состояний и большинство заголовков остаются такими же, как и при использовании HTTP. Новшества HTTP/2 заключаются в повышении эффективности передачи данных по сети.

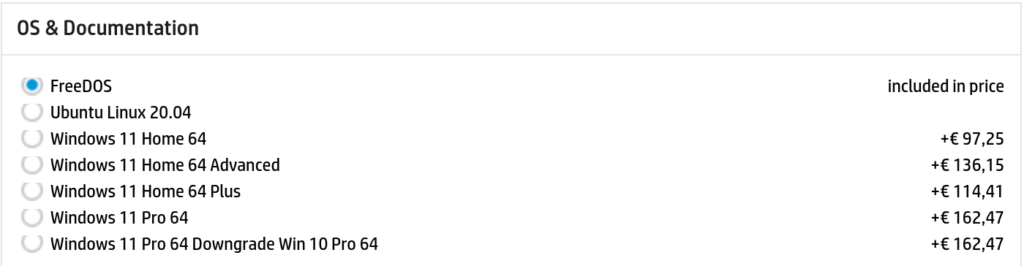

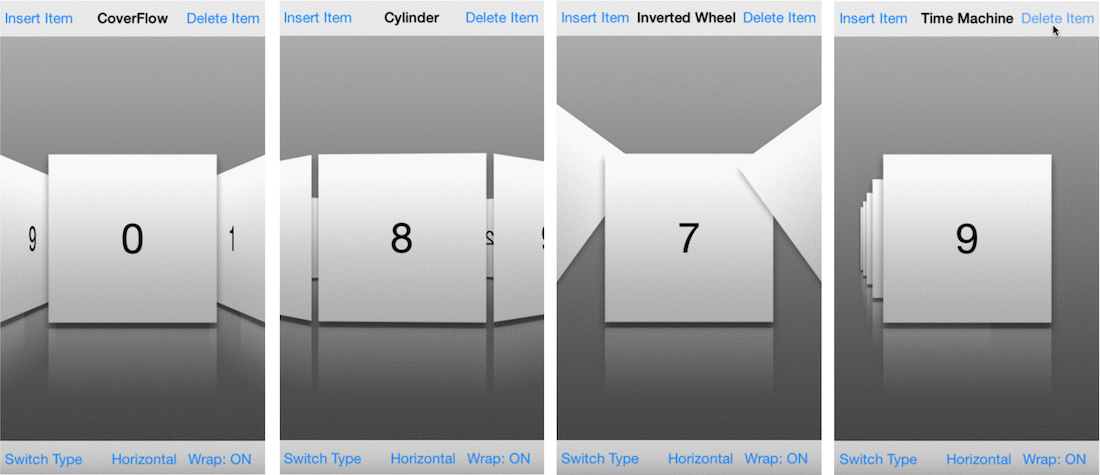

Если сравнить HTTP/2 и WebSocket, мы увидим много общих черт.

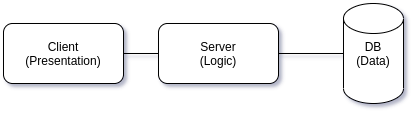

| | | |

| --- | --- | --- |

| Показатель | HTTP/2 | WebSocket |

| Сжатие заголовков | Да (HPACK) | Нет |

| Передача бинарных данных | Да | Да (бинарные или текстовые) |

| Мультиплексирование | Да | Да |

| Приоритизация | Да | Нет |

| Сжатие | Да | Да |

| Направление | Клиент/Сервер и Server Push | Двунаправленная передача данных |

| Полнодуплексный режим | Да | Да |

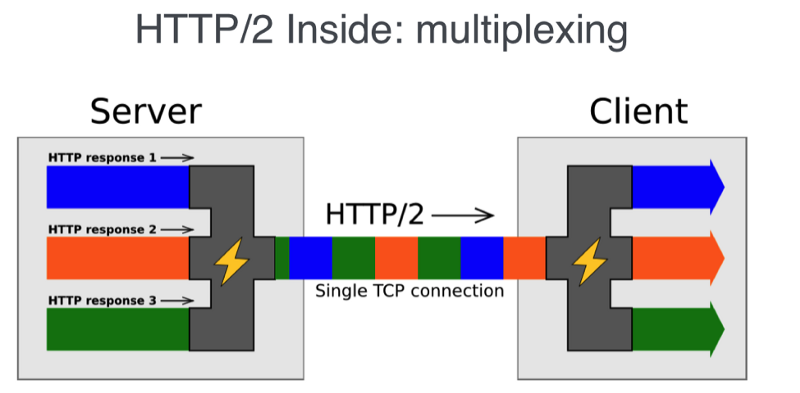

Как уже было сказано, HTTP/2 вводит технологию Server Push, которая позволяет серверу отправлять данные в клиентский кэш по собственной инициативе. Однако, при использовании этой технологии данные нельзя отправлять прямо в приложение. Данные, отправленные сервером по своей инициативе, обрабатывает браузер, при этом нет API, которые позволяют, например, уведомить приложение о поступлении данных с сервера и отреагировать на это событие.

Именно в подобной ситуации весьма полезной оказывается технология Server-Sent Events (SSE). SSE — это механизм, который позволяет серверу асинхронно отправлять данные клиенту после установления клиент-серверного соединения.

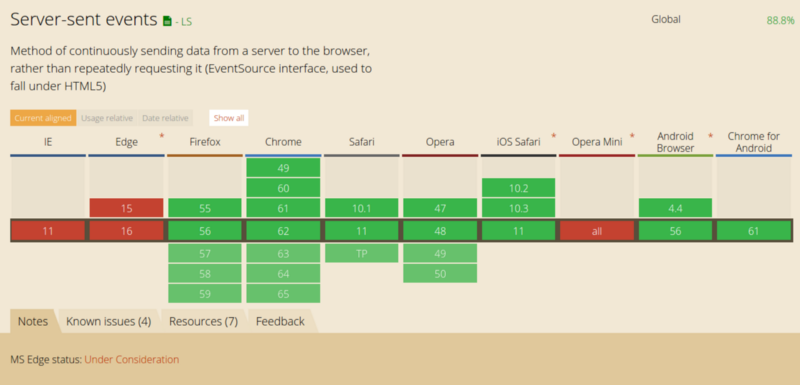

После соединения сервер может отправлять данные по своему усмотрению, например, когда окажется готовым к передаче очередной фрагмент данных. Этот механизм можно представить себе как одностороннюю модель [издатель-подписчик](https://en.wikipedia.org/wiki/Publish%E2%80%93subscribe_pattern). Кроме того, в рамках этой технологии существует стандартное клиентское API для JavaScript, называемое `EventSource`, реализованное в большинстве современных браузеров как часть стандарта HTML5 [W3C](https://www.w3.org/TR/eventsource/). Обратите внимание на то, что для браузеров, которые не поддерживают API [EventSource](http://caniuse.com/#feat=eventsource), существуют полифиллы.

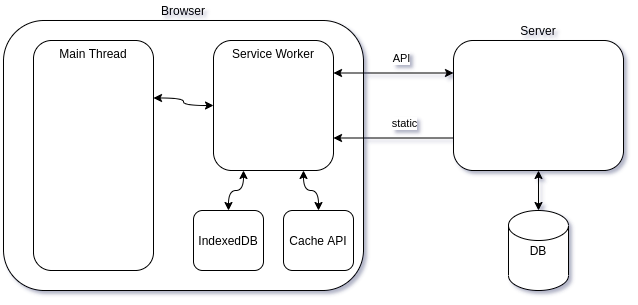

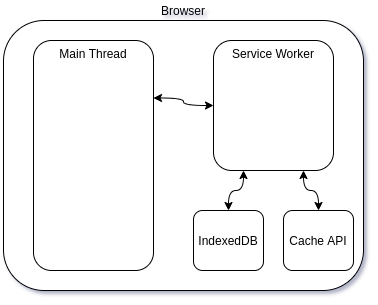

Так как технология SSE основана на HTTP, она отлично сочетается с HTTP/2. Её можно скомбинировать с некоторыми возможностями HTTP/2, что открывает дополнительные перспективы. А именно, HTTP/2 даёт эффективный транспортный уровень, основанный на мультиплексированных каналах, а SSE даёт приложениям API для передачи данных с сервера.

Для того, чтобы в полной мере понять возможности мультиплексирования и потоковой передачи данных, взглянем на определение IETF: *«поток» — это независимая, двунаправленная последовательность фреймов, передаваемых между клиентом и сервером в рамках соединения HTTP/2. Одна из его основных характеристик заключается в том, что одно HTTP/2-соединение может содержать несколько одновременно открытых потоков, причём, любая конечная точка может обрабатывать чередующиеся фреймы из нескольких потоков*.

Технология SSE основана на HTTP. Это означает, что с использованием HTTP/2 не только несколько SSE-потоков могут передавать данные в одном TCP-соединении, но то же самое может быть сделано и с комбинацией из нескольких наборов SSE-потоков (отправка данных клиенту по инициативе сервера) и нескольких запросов клиента (уходящих к серверу).

Благодаря HTTP/2 и SSE теперь имеется возможность организации двунаправленных соединений, основанных исключительно на возможностях HTTP, и имеется простое API, которое позволяет обрабатывать в клиентских приложениях данные, поступающие с серверов. Недостаточные возможности в сфере двунаправленной передачи данных часто рассматривались как основной недостаток при сравнении SSE и WebSocket. Благодаря HTTP/2 подобного недостатка больше не существует. Это открывает возможности по построению систем обмена данными между серверными и клиентскими частями приложений исключительно с использованием возможностей HTTP, без привлечения технологии WebSocket.

WebSocket и HTTP/2. Что выбрать?

--------------------------------

Несмотря на чрезвычайно широкое распространение связки HTTP/2+SSE, технология WebSocket, совершенно определённо, не исчезнет, в основном из-за того, что она отлично освоена и из-за того, что в весьма специфических случаях у неё есть преимущества перед HTTP/2, так как она была создана для обеспечения двустороннего обмена данными с меньшей дополнительной нагрузкой на систему (например, это касается заголовков).

Предположим, вы хотите создать онлайн-игру, которая нуждается в передаче огромного количества сообщений между клиентами и сервером. В подобном случае WebSocket подойдёт гораздо лучше, чем комбинация HTTP/2 и SSE.

В целом, можно порекомендовать использование WebSocket для случаев, когда нужен по-настоящему низкий уровень задержек, приближающийся, при организации связи между клиентом и сервером, к обмену данными в реальном времени. Помните, что такой подход может потребовать переосмысления того, как строится серверная часть приложения, а также то, что тут может потребоваться обратить внимание на другие технологии, вроде очередей событий.

Если вам нужно, например, показывать пользователям в реальном времени новости или рыночные данные, или вы создаёте чат-приложение, использование связки HTTP/2+SSE даст вам эффективный двунаправленный канал связи, и, в то же время — преимущества работы с технологиями из мира HTTP. А именно, технология WebSocket нередко становится источником проблем, если рассматривать её с точки зрения совместимости с существующей веб-инфраструктурой, так как её использование предусматривает перевод HTTP-соединения на совершенно другой протокол, ничего общего с HTTP не имеющий. Кроме того, тут стоит учесть соображения масштабируемости и безопасности. Компоненты веб-систем (файрволы, средства обнаружения вторжений, балансировщики нагрузки) создают, настраивают и поддерживают с оглядкой на HTTP. В результате, если говорить об отказоустойчивости, безопасности и масштабируемости, для больших или очень важных приложений лучше подойдёт именно HTTP-среда.

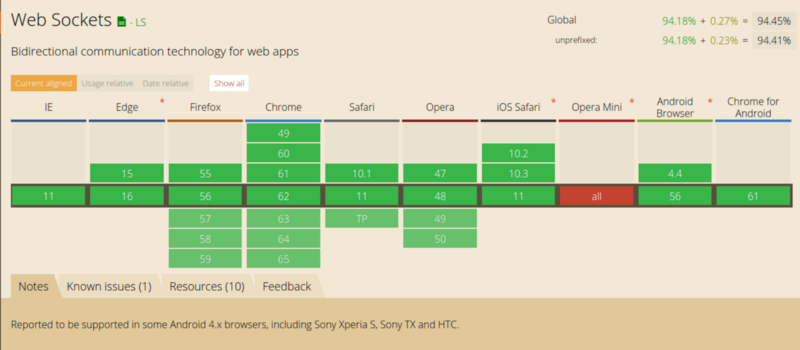

Кроме того, во внимание стоит принять и поддержку технологий браузерами. Посмотрим, как с этим дела обстоят у WebSocket:

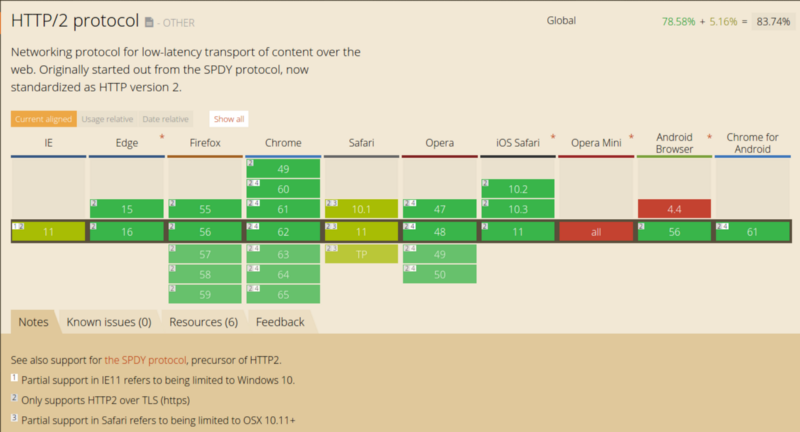

Тут всё выглядит очень даже прилично. Однако, в случае с HTTP/2 всё уже не так:

Тут можно отметить следующие особенности поддержки HTTP/2 в разных браузерах:

* Поддержка HTTP/2 только с использованием TLS (что, на самом деле, не так уж и плохо).

* Частичная поддержка в IE 11, но только в Windows 10.

* Поддержка только в OSX 10.11+ для Safari.

* Поддержка HTTP/2 только в том случае, если есть возможность пользоваться ALPN (а сервер это должен поддерживать явно).

Поддержка SSE, однако, выглядит лучше:

Не поддерживают эту технологию лишь IE/Edge. (Да, Opera Mini не поддерживает ни SSE, ни WebSocket, поэтому поддержку в этом браузере мы можем, сравнивая эти технологии, и не учитывать.) Однако, для IE/Edge существуют достойные полифиллы.

Итоги

-----

Как видите, у технологий WebSockets и HTTP/2+SSE есть, в сравнении друг с другом, и преимущества, и недостатки. Что же всё-таки выбрать? Пожалуй, на этот вопрос поможет ответить лишь анализ конкретного проекта и всесторонний учёт его требований и особенностей. Возможно, помощь при принятии решения окажет знание того, как эти технологии используют в уже существующих проектах. Так, автор этого материала говорит, что они, в SessionStack, используют, в зависимости от ситуации, и WebSockets, и HTTP.

Когда библиотеку SessionStack интегрируют в веб-приложение, она начинает собирать и записывать все изменения DOM, события, возникающие при взаимодействии с пользователем, JS-исключения, результаты трассировки стека, неудачные сетевые запросы, отладочные сообщения, позволяя воспроизводить проблемные ситуации и наблюдать за всем, что происходит при работе пользователя с приложением. Всё это происходит в режиме реального времени и не должно влиять на производительность веб-приложения. Администратор может наблюдать за сеансом работы пользователя прямо в процессе работы этого пользователя. В этом сценарии в SessionStack решили использовать HTTP, так как двунаправленный обмен данными тут не нужен (сервер просто передаёт данные в браузер). Использование в подобной ситуации WebSocket было бы неоправданно, привело бы к усложнению поддержки и масштабирования решения. Однако, библиотека SessionStack, интегрируемая в веб-приложение, использует WebSocket, и, только если организовать обмен данными по WebSocket невозможно, переходит на HTTP.

Библиотека собирает данные в пакеты и отправляет на сервера SessionStack. В настоящее время реализуется лишь передача данных с клиента на сервер, но не наоборот, однако, некоторые возможности библиотеки, которые появятся в будущем, требуют двунаправленного обмена данными, именно поэтому здесь и используется технология WebSocket.

Уважаемые читатели! Пользовались ли вы технологиями WebSocket и HTTP/2+SSE? Если да — просим рассказать о том, какие задачи вы с их помощью решали, и о том, как вам понравилось то, что получилось. | https://habr.com/ru/post/342346/ | null | ru | null |

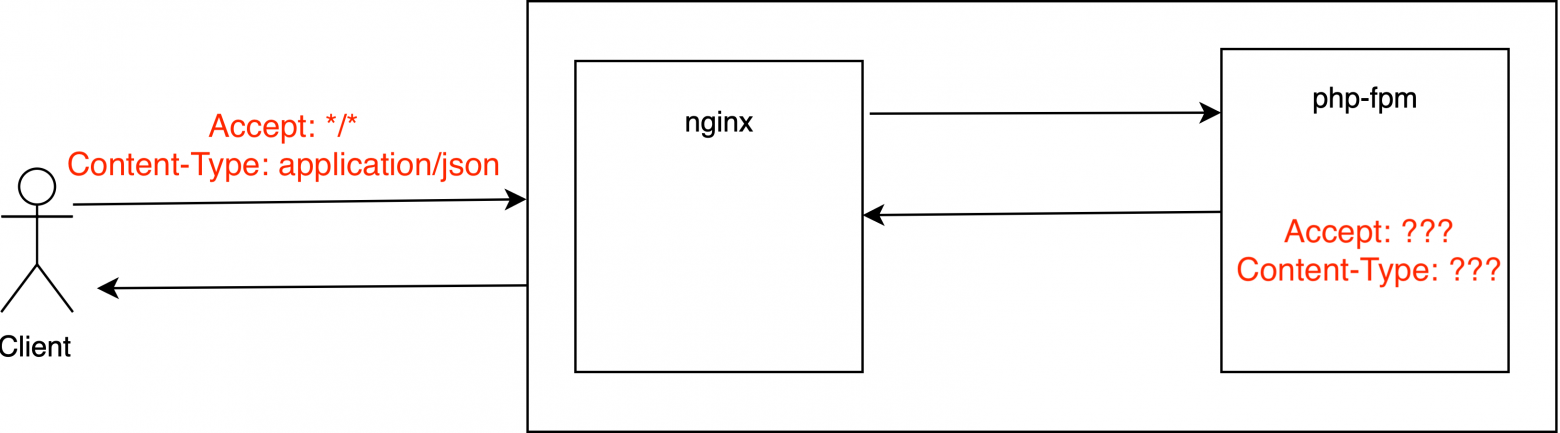

# Откуда берется заголовок Content-Type: nginx + php-fpm

Rocket science не будет. Если вы используете php-fpm, то скорее всего в связке с nginx. Простой вопрос: как в PHP получить значения HTTP заголовков запроса клиента?

1. Например, стандартные *Accept*, *Host* или *Referer*?

2. Знаете? Здорово! А как получить значение *Content-Type*, *Content-Length*?

3. Ничем вас не удивить, а как получить значение произвольного заголовка, например *X-Forwarded-For*?

### Как в PHP получить значения HTTP заголовков входящего запроса?

Всё очень просто (табличка сарказм). Нужно перейти на страницу документации переменной [$\_SERVER](https://www.php.net/manual/ru/reserved.variables.server.php).

> Переменная $\_SERVER — это массив, содержащий информацию, такую как заголовки, пути и местоположения скриптов. Записи в этом массиве создаются веб-сервером.

>

> **Нет гарантии**, что каждый веб-сервер предоставит любую из них;

>

> сервер может опустить некоторые из них или предоставить другие, не указанные здесь.

>

> Тем не менее многие эти переменные присутствуют в [спецификации CGI/1.1](http://www.faqs.org/rfcs/rfc3875.html),

>

> так что **вы можете ожидать их наличие**.

>

>

Согласитесь звучит не очень обнадеживающе? Складывается ощущение, что это переменные Шрёдингера. На странице документации приводится ответ на первый вопрос.

```

$_SERVER['HTTP_ACCEPT']

$_SERVER['HTTP_HOST']

$_SERVER['HTTP_REFERER']

```

Ок, вроде бы всё просто, хоть на странице документации и не сказано про CONTENT\_TYPE (правда есть небольшая [подсказка](https://www.php.net/manual/ru/reserved.variables.server.php#110763) комментария 2013 года), попробуем получить значение по аналогии.

```

$_SERVER['HTTP_CONTENT_TYPE']

```

К сожалению, такого ключа в массиве нет.

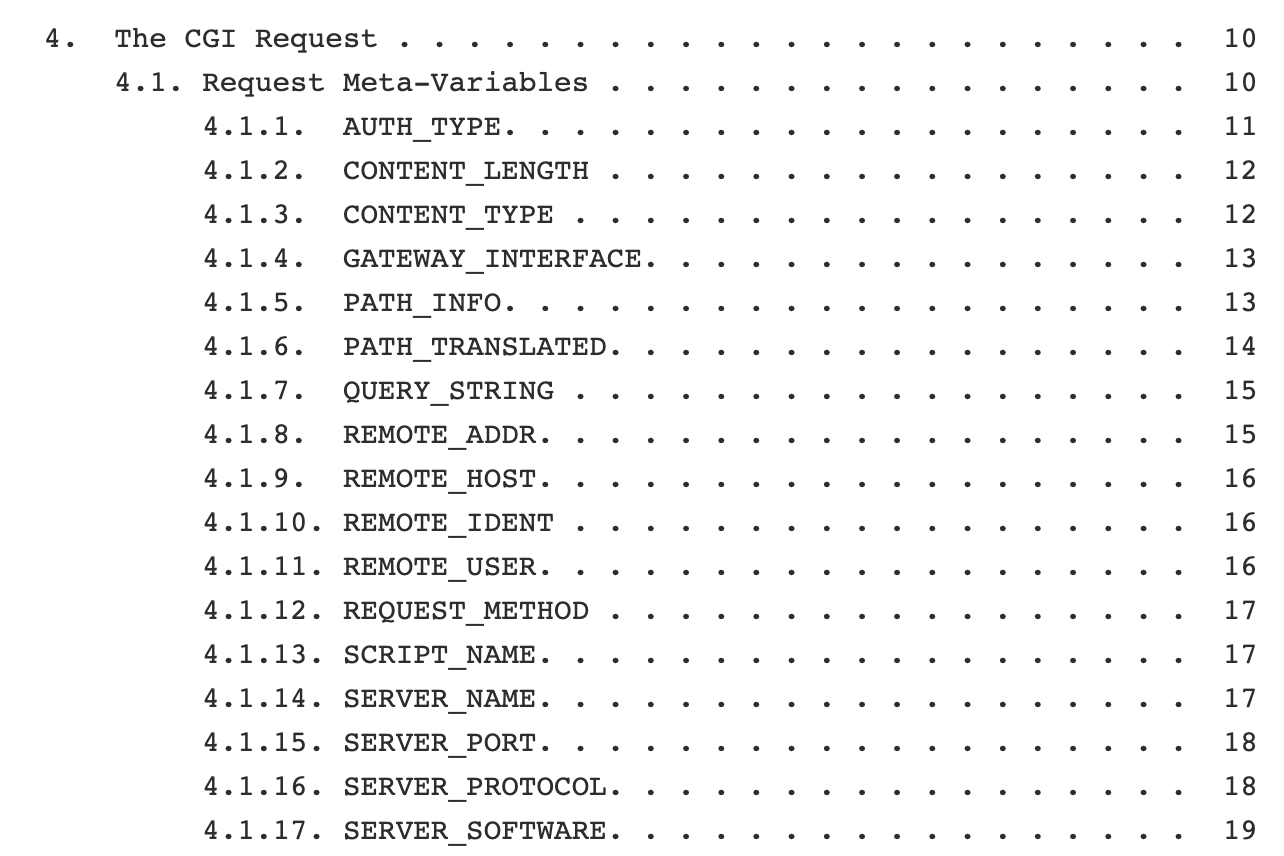

Ну да ладно, давайте посмотрим [спецификацию CGI/1.1](http://www.faqs.org/rfcs/rfc3875.html).

> 4.1.3. CONTENT\_TYPE

>

> If the request includes a message-body, the CONTENT\_TYPE variable is

>

> set to the Internet Media Type [6] of the message-body.

>

>

>

> //…

>

>

>

> There is no default value for this variable. If and only if it is

>

> unset, then the script MAY attempt to determine the media type from

>

> the data received. If the type remains unknown, then the script MAY

>

> choose to assume a type of application/octet-stream or it may reject

>

> the request with an error (as described in section 6.3.3).

>

>

>

> //…

>

>

>

> The server MUST set this meta-variable if an HTTP Content-Type field

>

> is present in the client request header. If the server receives a

>

> request with an attached entity but no Content-Type header field, it

>

> MAY attempt to determine the correct content type, otherwise it

>

> should omit this meta-variable.

>

>

Мы узнали ответ на второй вопрос.

```

$_SERVER['CONTENT_TYPE']

$_SERVER['CONTENT_LENGTH']

```

Перейдём к 3-му вопросу, продолжив чтение спецификации.

> 4.1.18. Protocol-Specific Meta-Variables

>

>

>

> The server SHOULD set meta-variables specific to the protocol and

>

> scheme for the request. Interpretation of protocol-specific

>

> variables depends on the protocol version in SERVER\_PROTOCOL. The

>

> server MAY set a meta-variable with the name of the scheme to a

>

> non-NULL value if the scheme is not the same as the protocol. The

>

> presence of such a variable indicates to a script which scheme is

>

> used by the request.

>

>

>

> **Meta-variables with names beginning with «HTTP\_» contain values read

>

> from the client request header fields, if the protocol used is HTTP.

>

> The HTTP header field name is converted to upper case, has all

>

> occurrences of "-" replaced with "\_" and has «HTTP\_» prepended to

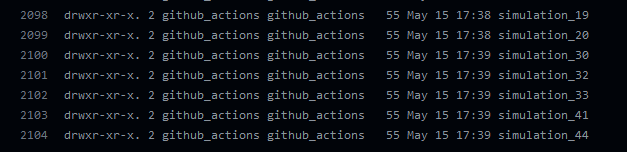

>