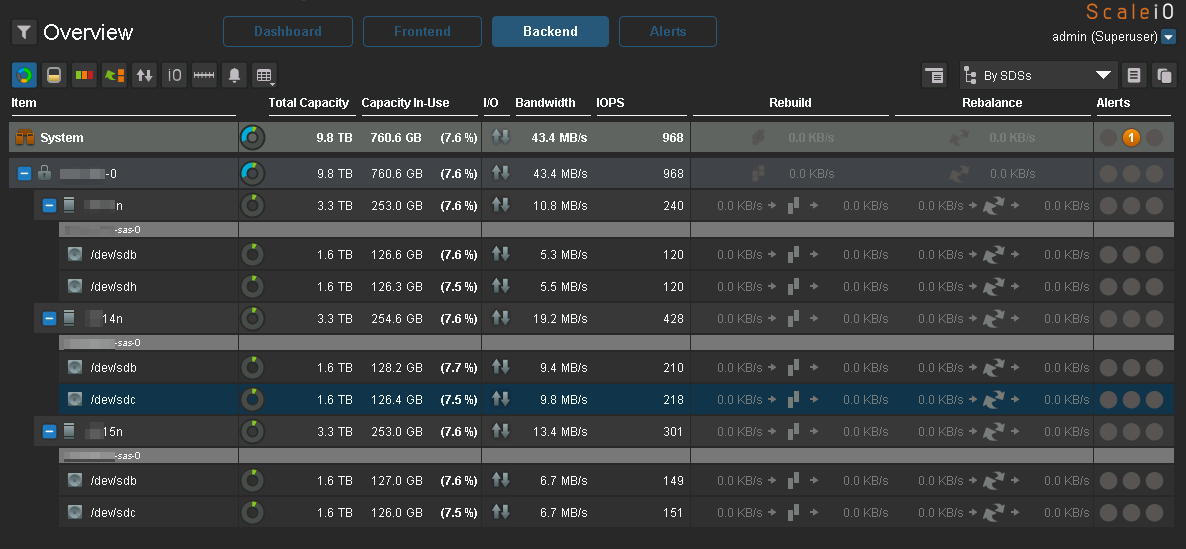

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Основы Flutter для начинающих (Часть VIII)

Flutter наделён большими возможностями для простой кастомизации пользовательского интерфейса.

Сегодня мы постараемся охватить самые главные вещи, которые могут вам пригодиться в плане создания дизайна приложения.

Статья не претендует на полный объем. В ней приведено только самое главное.

Начинаем!

Наш план* [Часть 1](https://habr.com/en/post/560008/) - введение в разработку, первое приложение, понятие состояния;

* [Часть 2](https://habr.com/en/post/560282/) - файл pubspec.yaml и использование flutter в командной строке;

* [Часть 3](https://habr.com/en/post/560646/) - BottomNavigationBar и Navigator;

* [Часть 4](https://habr.com/en/post/560806/)- MVC. Мы будем использовать именно этот паттерн, как один из самых простых;

* [Часть 5](https://habr.com/en/post/560964/) - http пакет. Создание Repository класса, первые запросы, вывод списка постов;

* [Часть 6](https://habr.com/en/post/561174/) - работа с формами, текстовые поля и создание поста.

* [Часть 7](https://habr.com/en/post/561614/) - работа с картинками, вывод картинок в виде сетки, получение картинок из сети, добавление своих в приложение;

* Часть 8 (текущая статья) - создание своей темы, добавление кастомных шрифтов и анимации;

* [Часть 9](https://habr.com/en/post/562352/) - немного о тестировании;

Добавляем кастомные шрифты

--------------------------

Попробуем сменить шрифт нашего Flutter приложения.

Перейдем на сайт [Google Fonts](https://fonts.google.com/) и скачаем шрифт [Kalam](https://fonts.google.com/specimen/Kalam).

Далее создадим папку `fonts` в корне нашего проекта:

И положим туда наши шрифты:

Теперь пропишем шрифт `Kalam` в `pubspec.yaml` файле:

```

# в данной секции вы можете подключить шрифты и assets файлы

flutter:

# указываем, что мы используем MaterialApp иконки и наше

# приложение соответствует Material Design

uses-material-design: true

# указываем кастомные шрифты

fonts:

# название семейства шрифтов

- family: Kalam

fonts:

# для каждого файла шрифта мы прописываем

# соответствующие параметры

- asset: fonts/Kalam-Regular.ttf

style: normal

- asset: fonts/Kalam-Bold.ttf

weight: 700

style: normal

- asset: fonts/Kalam-Light.ttf

style: normal

weight: 300

# прописываем директорию images

# / указывает на то, что мы собираемся включить

# все файлы которые будут в директории images

assets:

- images/

```

Не забываем выполнять `pub get` команду.

Теперь мы можем приступить к настройке темы.

Настройка темы приложения

-------------------------

Если у вас есть опыт нативной разработке на Android то вы, возможно, поймёте меня.

Одной из самых важнейших проблем в нативной разработке является поддержка более 2-х тем в приложении.

Возможно 3 и более тем - это не такой распространенный случай, как я думаю.

Но все же из коробки в Android это не так просто сделать. Вам придётся расширяться от стандартных компонентов и вытворять различные штуки (паттерн Observer, работа с Drawable в коде).

К счастью у Flutter таких проблем нет.

Переходим к созданию новой темы для нашего приложения. Для этого создадим папку `resources, а` в ней файл `theme.dart`:

```

import 'package:flutter/material.dart';

// настраиваем кастомную тему

final usualTheme = ThemeData(

// указываем primaryColor и его оттенки

primaryColor: Colors.purple[600],

primaryColorLight: Colors.purple[300],

primaryColorDark: Colors.purple[800],

// также указываем accentColor

accentColor: Colors.teal,

// настройка Theme для AppBar

appBarTheme: AppBarTheme(

shadowColor: Colors.grey.withOpacity(0.8),

elevation: 10,

),

// настройка Theme для Text

textTheme: TextTheme(

headline5: TextStyle(fontWeight: FontWeight.bold)

),

// указываем наш шрифт для всего приложения

fontFamily: "Kalam"

);

```

Если вы не понимаете назначение `primaryColor` и `accentColor` то вы можете более подробно с этим познакомиться на сайте [Material Design](https://material.io/design/color/the-color-system.html).

Осталось только заменить старую тему на новую в файле `main.dart`:

```

class MyApp extends StatelessWidget {

// функция build отвечает за построение иерархии виджетов

@override

Widget build(BuildContext context) {

// виджет MaterialApp - главный виджет приложения, который

// позволяет настроить тему и использовать

// Material Design для разработки.

return MaterialApp(

// заголовок приложения

// обычно виден, когда мы сворачиваем приложение

title: 'Json Placeholder App',

// убираем баннер

debugShowCheckedModeBanner: false,

// указываем только что созданную тему

theme: usualTheme,

// Наша главная страница с нижнем меню

home: HomePage(),

);

}

}

```

Запускаем.

Получилось довольно симпатично!

Вот мы и рассмотрели самые главные вещи, касающиеся тем приложения и кастомных шрифтов.

Как я и говорил это довольно просто :)

Заключение

----------

От себя я могу только отметить, что Flutter подарил разработчиком возможность создавать красивый UI и наслаждаться этим процессом.

Полезные ссылки:

* [Use a custom font](https://flutter.dev/docs/cookbook/design/fonts)

* [The Color system (Material Design)](https://material.io/design/color/the-color-system.html#color-usage-and-palettes)

* [Ссылка на Github](https://github.com/KiberneticWorm/json_placeholder_app/tree/lesson_8_fonts_and_themes)

Всем хорошего кода! | https://habr.com/ru/post/562136/ | null | ru | null |

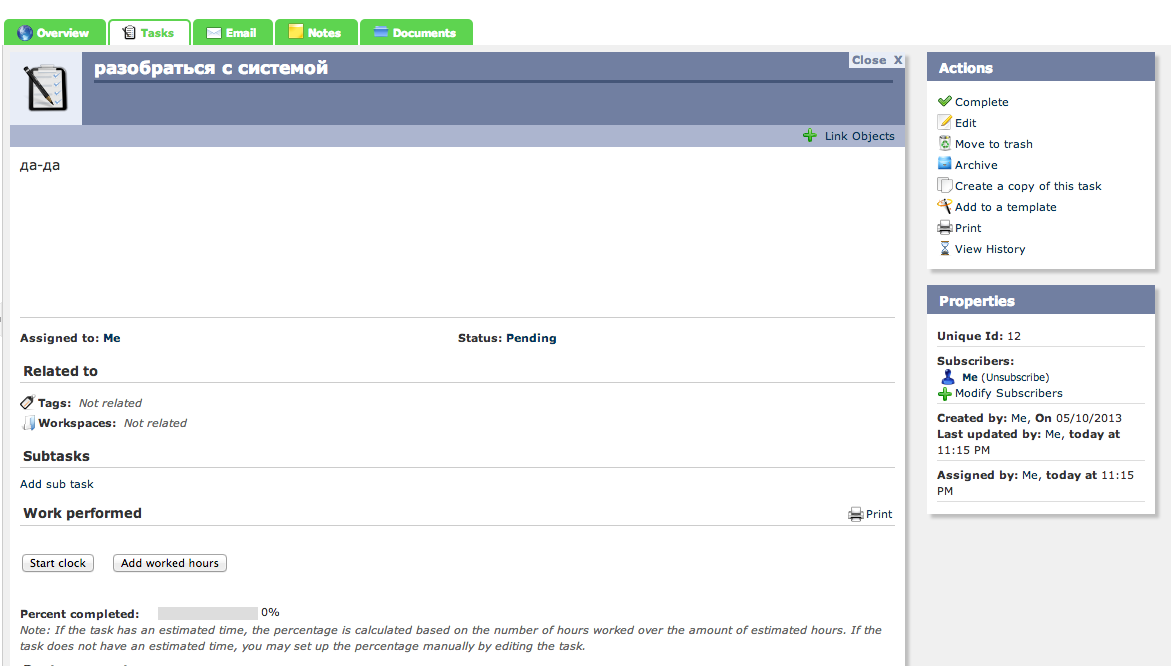

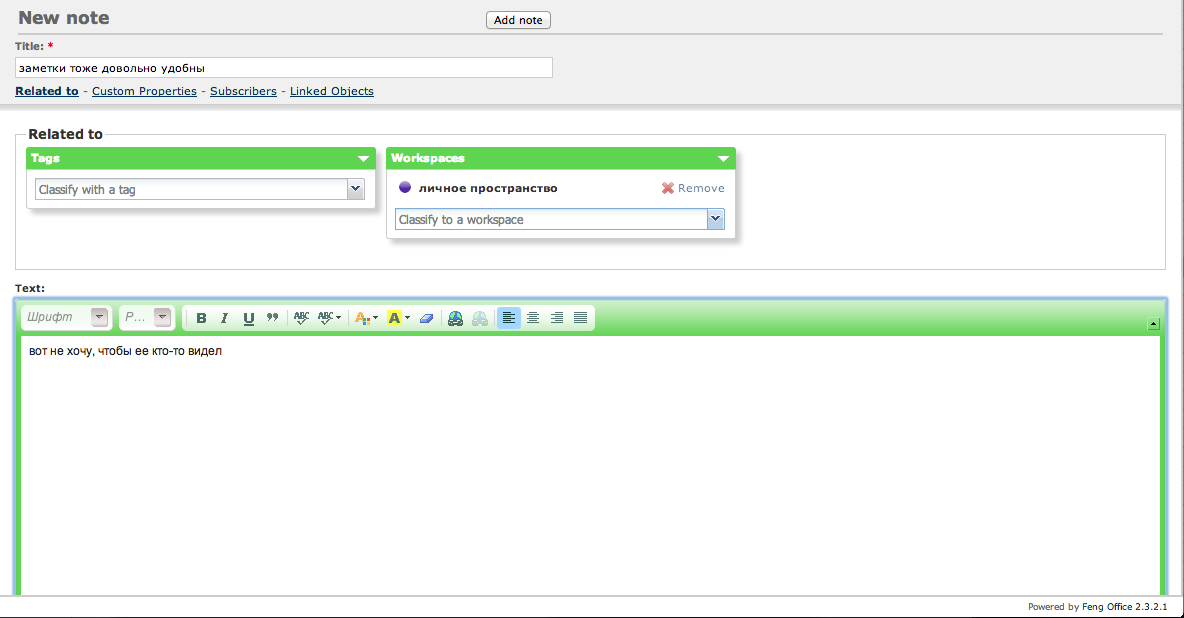

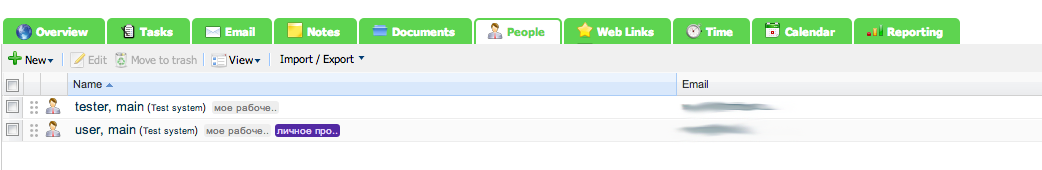

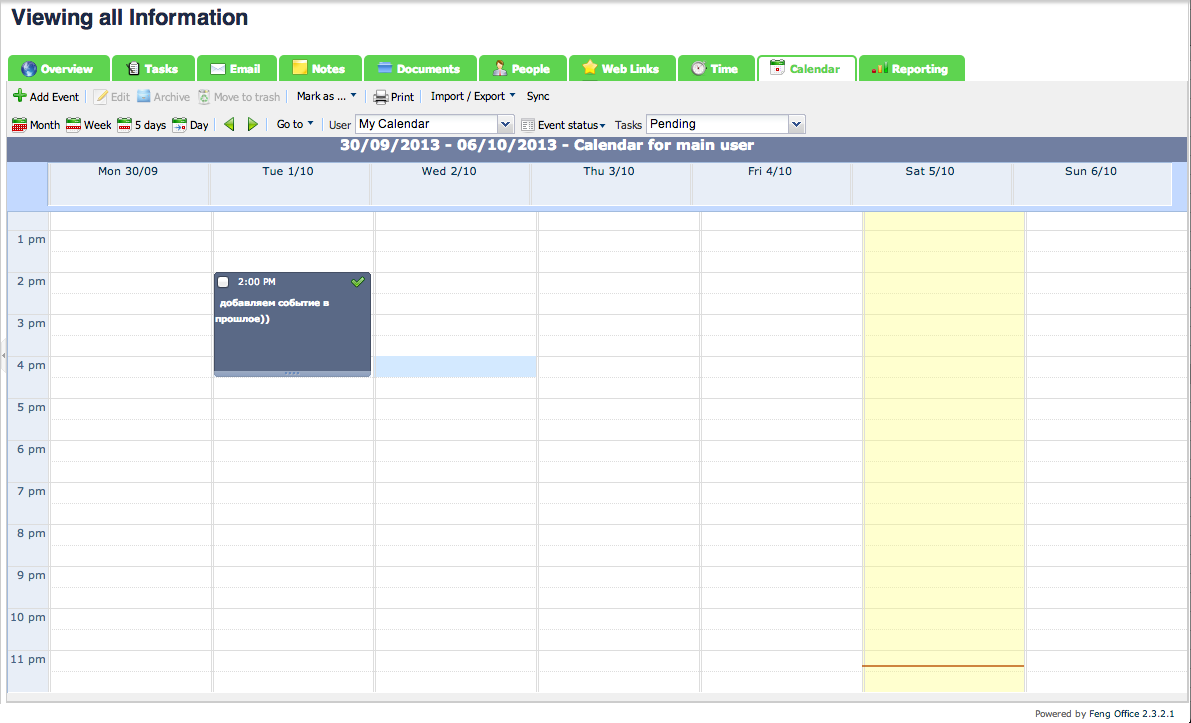

# Как я воевал с контекстами

Как истинный консерватор, я долгое время использовал исключительно MODx Evolution. Меня устраивало прежде всего наличие исчерпывающей документации, кучи статей и предельно понятной архитектуры данной версии MODx CMF. О версии Revolution я периодически читал разные статьи, но мне не хотелось менять привычную для меня систему на что-либо другое. Однако, в один прекрасный момент количество таблиц в базе данных моего мультидоменного «хомячка» на хостинге достигло устрашающих размеров. Встал вопрос о мультидоменном решении. Когда-то я вычитал о возможности создать на MODx Revolution мультидоменный сайт. Я установил движок на тестовый поддомен и начал копать глубже. Как оказалось, в самом фреймворке как такового готового решения насчёт мультидоменности пока не существует. Существует некая система контекстов. Разные контексты можно определить на разные поддомены. Только для этого нужно править файл index.php.

Первое, что приходит в голову — это использовать уже проверенный популярный код:

```

switch($_SERVER['SERVER_NAME']) {

case 'sub1.domain.tld': $modx->initialize('sub1'); break;

case 'sub2.domain.tld': $modx->initialize('sub2'); break;

case 'sub3.domain.tld': $modx->initialize('sub3'); break;

default: $modx->initialize('web');

}

```

Если, скажем, у Вас на системе контекстов зиждется многоязычность, тогда можно сделать даже так:

```

switch($_SERVER['SERVER_NAME']) {

case 'domain.ru': case 'www.domain.ru': $modx->initialize('ru'); break; // Переключаем на русский

case 'domain.fr': case 'www.domain.fr': $modx->initialize('fr'); break; // Переключаем на французский (для примера)

default: $modx->initialize('web');

}

```

И для не сильно больших порталов, где число поддоменов контролируется администратором хостинга/домена и редко меняется, такого решения хватит за глаза. Однако, давайте с Вами пофантазируем. Есть у Вас свой сервер. Это может быть Ваш личный сервер или VDS-ка на любимом хостинге. У Вас есть возможность программно создавать поддомены. Предположим, что Вы пишете свой аналог livejournal.com…

Создать контекст при помощи API не сильно сложно. Вдаваться в подробности я не стану, не слишком сильно пока что изучил API MODx Revolution. Тем не менее создать контекст и поддомен — это одно, а вот связать это воедино — другое. Здесь вышеуказанные решения не подойдут, ибо заранее неизвестно сколько будет поддоменов и как будут называться контексты для них. По идее, если алиасы контекстов совпадают с именами поддоменов, тогда вполне подойдёт решение:

```

define("myRootDomain","domain.tld");

$ctxKey = 'web';

if (preg_match('#(\w+).'.myRootDomain.'#si',$_SERVER['SERVER_NAME']) > 0) {

$ctxKey = preg_replace('#(\w+).'.myRootDomain.'#si','\1',$_SERVER['SERVER_NAME']);

if ($ctxKey == 'www') $ctxKey = 'web';

}

```

Основная информация о контекстах в MODx хранится в БД в таблицах **context**, **context\_setting**. В первой таблице находятся описания контекстов (ключ, описание, порядок отображения). Во второй — настройки контекста. Помните, в распространённых решениях нам нужно было прописывать страницы ошибок, хост и тому подобное? Вот это-то всё там и хранится. И первое, что приходит в голову — это SQL-запрос к этой таблице:

```

$SQL = "SELECT * FROM ".$table_prefix." WHERE `key`='http_host' AND `value`='".$_SERVER['SERVER_NAME']."'";

```

Если бы система контекстов была предусмотрена в старушке Evolution, тогда с алгоритмом всё было бы просто:

```

$ctxKey = 'web';

if ($result = $modx->db->query($SQL)) if ($row = mysql_fetch_assoc($result)) $ctxKey = $row['context_key'];

```

Однако, в этом отношении разработчики MODx подложили разработчикам, использующим MODx, небольшую хрюшку, ибо архитектура MODx Revolution зиждется на xPDO. А это уже не привычное нам API, а совсем другой разговор.

Изучив кучу результатов гугло-поиска, в том числе и официальную документацию на MODx Revolution API, я так и не смог понять, как проще сделать запрос к БД в MODx Revolution. Зато, копнув файл **core/model/modx/modx.php**, я обнаружил нечто следующее:

```

$pluginEventTbl= $this->getTableName('modPluginEvent');

$eventTbl= $this->getTableName('modEvent');

$pluginTbl= $this->getTableName('modPlugin');

$propsetTbl= $this->getTableName('modPropertySet');

$sql= "

SELECT

Event.name AS event,

PluginEvent.pluginid,

PropertySet.name AS propertyset

FROM {$pluginEventTbl} PluginEvent

INNER JOIN {$pluginTbl} Plugin ON Plugin.id = PluginEvent.pluginid AND Plugin.disabled = 0

INNER JOIN {$eventTbl} Event ON {$service} Event.name = PluginEvent.event

LEFT JOIN {$propsetTbl} PropertySet ON PluginEvent.propertyset = PropertySet.id

ORDER BY Event.name, PluginEvent.priority ASC

";

$stmt= $this->prepare($sql);

if ($stmt && $stmt->execute()) {

while ($ee = $stmt->fetch(PDO::FETCH_ASSOC)) {

$eventElementMap[$ee['event']][(string) $ee['pluginid']]= $ee['pluginid'] . (!empty($ee['propertyset']) ? ':' . $ee['propertyset'] : '');

}

}

```

Это фрагмент метода getEventMap класса modX. Логично предположить, что вместо длиннющего запроса мы можем вставить свой запрос и он по идее должен отработать, как нужно. В результате рождается решение:

```

$ctxCur = 'web';

$ctxQur = "SELECT * FROM `".$table_prefix."context_setting` WHERE `key`='http_host' AND `value`='".$_SERVER['SERVER_NAME']."'";

$ctxSQL = $modx->prepare($ctxQur);

if ($ctxSQL && $ctxSQL->execute()) if ($ctxRes = $ctxSQL->fetch(PDO::FETCH_ASSOC)) $ctxCur = $ctxRes['context_key'];

$modx->initialize($ctxCur);

```

При использовании данного решения нам нужно заботиться лишь о правильном указании поля http\_host в админке. И имя контекста в этом случае не обязательно должно совпадать с поддоменом. На сим всё. Спасибо за внимание к моему очередному велосипеду! | https://habr.com/ru/post/150713/ | null | ru | null |

# JavaScript-only: гомогенная архитектура веб-проектов

Работа фронтенд-разработчика наполнена задачами по оптимизации кода, переносу готовых фрагментов между версиями проектов и т.п., сложность которых зачастую определяется исторически сложившимся подходом к самой разработке. В своём докладе на конференции [HolyJS](http://holyjs.ru/), которая пройдет 5 июня в Санкт-Петербурге, фронтенд-разработчик Алексей Иванов расскажет, как объем этих проблем можно сократить отказом от привычного подхода, когда приложение состоит из разрозненных частей, в пользу «всё-в-JS». Мы же в преддверии конференции поговорили с Алексеем о том, от каких именно сложностей избавляют предлагаемые им идеи (сами идеи будут подробнее раскрыты в докладе).

[](https://habrahabr.ru/company/jugru/blog/301588/)

***— Расскажи вкратце о себе и своей работе.***

— Меня зовут Алексей Иванов, я фронтенд-разработчик в компании «Злые марсиане» (Evil Martians). Это распределенная группа разработчиков, помогающая крупным компаниям, вроде eBay или Groupon, а также различным стартапам в короткие сроки и без проблем запускать интернет-проекты с расчётом на быстрый рост.

В Марсианах я сейчас занимаюсь фронтендом сервиса под названием [eBay Social](http://ebaysocial.ru/) для российского офиса eBay. Это классическое приложение на Ruby on Rails с отдельными интерактивными частями, написанными на React.

До Марсиан я делал первую версию SPA-приложения для ridero.ru на Backbone, помогал запускать пару сервисов для Яндекса с использованием bem-tools, а также занимался разработкой других серверных и SPA-приложений разного размера, что позволило мне потрогать кучу разных инструментов и методологий разработки. Мне нравится изучать и сравнивать разные способы организации кода, работы с зависимостями и разрешения конфликтов, используемые в разных методологиях и инструментах.

**— *Откуда вообще появилась идея о каком-то глобальном изменении подхода к разработке?***

— Фронтендеры Марсиан работают с двумя основными типами проектов.

Во-первых, мы создаем классические проекты на Ruby on Rails. В таких проектах рендер шаблонов происходит на сервере внутри самих Rails, а сборка CSS и JavaScript живет отдельно в Node.js и Gulp'е или другом сборщике. Мы пользуемся пре- и постпроцессорами, собираем отдельные файлы в общие бандлы и сжимаем код Clean CSS и UglifyJS, но при этом CSS и JavaScript друг о друге знают очень мало, а про HTML, с которым они работают, вообще ничего не знают.

Во-вторых, мы создаем одностраничные приложения (SPA), которые строят HTML, а часто и CSS сразу в браузере, и с сервером общаются только на уровне данных.

По сути, это два параллельных мира в современном фронтенде. В какой-то момент SPA отпочковались от классических серверных приложений в отдельную эволюционную ветку и пошли собственным путём со своим набором мутаций и новых идей. В результате набор инструментов, который используется на этих двух типах проектов, сильно различается.

Инструменты и подходы, используемые в современных SPA, позволяют с минимальными усилиями решать многие классические проблемы фронтенд-разработки: пересечение названий переменных и CSS-классов в глобальном пространстве имен, удаление неиспользуемого кода и стилей, создание сборок CSS и JavaScript под конкретные разделы и страницы. Приятнее всего то, что основную часть работы тут за вас делает машина при вашем минимальном вмешательстве.

Поэтому возвращение к классическим серверным приложениям после работы с SPA вызывает боль и страдания. Вещи, которые в SPA работали из коробки, теперь либо никак не работают, либо требуют для реализации кучу времени и сил.

Как нормальный человек, я ищу способы избавиться от боли и страданий. И мой доклад представляет собой результатах этих поисков. Я хочу рассказать о существующих проблемах, способах их решения в SPA, инструментах, которые появились в SPA, но которые вполне можно применять и на сервере, а также о концепциях из SPA, которые пока для серверных приложений не реализованы в виде готового софта (однако в случае реализации софта они помогли бы решить многие нерешённые сейчас проблемы).

***— Можешь ли ты привести примеры упомянутых проблем, свойственных разработке серверных приложений?***

— В крупных проектах существует ряд задач, касающихся оптимизации скорости загрузки и уменьшения объема кода, который отправляется в браузер.

Допустим, мы отправляем пользователю HTML-страницу, CSS и JavaScript. CSS у нас написан по методологии БЭМ. Один из способов оптимизации — сокращение длинных имен в CSS, которые мы при разработке написали для себя, чтобы избежать конфликтов с другими классами.

Предположим, у нас есть класс:

```

.block__element_modificator {}

```

И таких строчек у нас порядка нескольких тысяч. Хочется вместо них отправлять нечто менее длинное, допустим:

```

.b1 {}

```

Как нам это сделать?

Классы CSS у нас используются в нескольких местах: во-первых, в самом CSS-файле, во-вторых, в HTML, и, в-третьих, в JavaScript.

Начнём с CSS-файла. Первое, что придется сделать, — это объединить CSS-файлы в один, так как если мы займемся заменой в разных файлах, то не сможем быть уверенными в отсутствии конфликтов (технически сократить названия можно и без объединения в один файл, но необходим будет промежуточный список замен, который придется подгружать при обработке каждого нового файла; данный вариант реализовать сложнее и затратнее с точки зрения необходимых ресурсов, — *прим. ред.*). Далее мы пройдемся по полученному файлику какой-нибудь программкой и получаем на выходе две вещи: файл с замененными именами и список замен в виде:

```

{ 'block__element_modificator': 'aBc' }

```

Пока всё просто. Идём дальше.

Теперь нам нужно заменить эти классы в HTML. Это уже не так просто: классы могут собираться из отдельных кусков строк, переменные в шаблонах могут быть частью классов, собирать имя класса из этих частей мы можем не внутри аттрибута class, а где-нибудь отдельно и т.д. Ну и где-то у нас может на теге использоваться один класс, а где-то — несколько. Нам нужно выявить все эти моменты:

Если мы пропустим хоть одно такое место, верстка сломается.

Кроме этого, названия классов мы используем в JavaScript. Там определить, что именно у нас является именем класса, еще сложнее:

```

var className = "block__element_modificator";

$elem.addClass(className);

```

но не править ничего лишнего:

```

var block = ...;

```

Стоит отметить, что класс в JavaScript может храниться просто в виде переменной, по которой не будет понятно, что это именно класс. Опять же, может использоваться всякая логика при построении имен классов, или же переменная может называться как класс, т.е. просто регулярным выражением выполнить замену будет нельзя.

В итоге простая задача — сокращение имен классов — у нас превращается во что-то нетривиальное.

При всем этом сжатие имён классов дает нам не очень большой выигрыш по размеру. Есть более эффективные способы оптимизации размера стилей — например, очистка файлов от неиспользуемых правил. При использовании библиотек вроде Bootstrap или иконочных шрифтов вроде Font Awesome в сборку попадают сотни неиспользуемых правил. Точно так же вес добавляют правила пропущенные и неочищенные при рефакторинге. Если бы мы могли отправлять в браузер только реально используемые правила, это дало бы нам гораздо больший выигрыш в размере.

***— Убирать из сборки неиспользуемые элементы так же сложно? И действительно ли этот «исторический хвост» дает большой прирост к размеру сборки?***

— Если проект развивается несколько лет, то в нем могут скопиться тонны мусора. Причем я сейчас говорю не только об отдельных именах классов, но и о сложных селекторах со вложенностью. Например, правило:

```

.news .title {}

```

У нас на сайте могут использоваться отдельно и класс news, и класс title. При этом в такой комбинации, как и в правиле, они могут никогда не встречаться. В этой ситуации правило тоже можно спокойно удалить. В результате для удаления неиспользуемого кода нам нужно понять структуру страницы, причем не только в текущем состоянии, а во всех возможных (страница может быть для авторизованного или неавторизованного пользователя, с попапом, персональной рекламой или выборкой записей определенного типа в ленте друзей). Стоит учесть, что для понимания структуры страницы нам одного HTML не достаточно, т.к. у нас есть JavaScript, который умеет все это изменять. По-хорошему, после того, как мы построили дерево возможных состояний для страницы, нам нужно понять, как именно наш JavaScript может это дерево изменять.

И вот только после того, как мы все это поняли, мы можем со спокойной совестью удалять правила из CSS.

То же самое касается сокращения JavaScript. Мы можем в автоматическом режиме удалить неиспользуемые переменные и функции. Но код, касающийся работы с HTML, мы так удалять не можем, потому что без знания структуры страницы мы не имеем возможности понять, что из него нам правда нужно, а что никогда не будет использовано.

***— А нельзя ли просто использовать какой-то другой подход при оптимизации?***

— Мы можем попробовать зайти с другой стороны. Например, разбив общий бандл CSS и JavaScript на отдельные бандлы для разных страниц, чтобы пользователю отправлялась только то, что нужно для текущей страницы. Допустим, он пришел на главную страницу — давайте отправим ему только то, что необходимо для главной, чтобы она казалась быстрее, а остальное загрузим как-нибудь потом. Для упрощения мы можем даже не по страницам сборки делать, а по состоянию пользователя — для авторизованного или неавторизованного (т.е. часть добавлять уже после авторизации).

Только для того, чтобы это сделать быстро, нам опять нужно знать, на какой странице что находится, и как HTML, CSS и JavaScript друг на друга влияют. Мы, конечно, можем это все прописать и руками, но работа эта очень долгая и неблагодарная.

И это мы пока обсудили только уменьшение размера отправляемых в браузер файлов. А существуют также проблемы конфликтов имен, разрешения зависимостей, переноса кода с проекта на проект таким образом, чтобы ничего не забыть, удаления ненужного когда из исходников в редакторе и многие другие.

***— Неужели никакого инструментария для решения этих проблем не существует? Как же тогда выйти из этого «замкнутого круга»?***

— Вначале интервью я как раз говорил, что во фронтенде сейчас существует два параллельных мира: мир серверных приложений и мир SPA. В мире SPA многие из описанных выше проблем успешно решены, и о них никто не вспоминает, а вот в мире серверных приложений они актуальны до сих пор.

При этом мы не можем все просто взять и начать писать SPA, потому что до сих пор есть большое количество областей, где динамики на страницах мало, а индексация поисковиками и доступность с максимального числа устройств актуальна: это интернет-магазины, справочники, правительственные сайты с высокими требованиями по аксессабилити и прочие.

К сожалению, просто взять существующие инструменты от SPA тоже нельзя. Они создавались под другую среду с другими требованиями. Но вот идеи и подходы, которые в этих инструментах используются, замечательно переносятся и используются где угодно. Именно об этих идеях, подходах, особенностях и проблемах их применения в разных средах, а также о том, что уже сейчас можно использовать и там, и там, и будет мой доклад на [HolyJS](http://holyjs.ru/).

***— Идея, вроде бы, лежит на поверхности. Почему же она не идёт в массы?***

— Идея ещё как идет в массы. Есть изоморфные приложения и попытки скрестить [React с Django](https://github.com/mikemcgowan/django-react) и [Rails](https://github.com/reactjs/react-rails). Есть bem-tools, поводом для создания которого были многие из проблем, о которых я буду рассказывать в своем докладе. Есть попытки подружить HTML и CSS на сервере через [pstcss-modules](https://github.com/outpunk/postcss-modules), который написал мой коллега Саша Мадянкин. То есть, подходов к проблеме с самых разных сторон много, хотя и нет одного общего популярного общепризнанного решения.

Одна из главных причин, почему это решение до сих пор не появилось, на мой взгляд, состоит в том, что количество разработчиков SPA сильно меньше, чем количество разработчиков серверных приложений. И даже среди последних тех, кто сталкивался и работал со всеми теми инструментами и концепциями, о которых я буду говорить в докладе, не очень много.

Как раз для того, чтобы как можно больше людей узнало об этих концепциях и начало думать в этих терминах и, надеюсь, писать инструменты для работы с ними на сервер, я и готовлю свой доклад.

***Благодарим за беседу!***

В рамках беседы мы вкратце описали проблемы, с которыми ежедневно сталкиваются фронтенд-разработчики. О том, как именно подход «всё в JS» может упростить ситуацию, слушайте в докладе Алексея Иванова на HolyJS. Кроме этого, на конференции будет несколько других [докладов](http://holyjs.ru/arch/), связанных с архитектурой веб-приложений. Ну и разумеется, нашему сегодняшнему собеседнику можно будет там же, не отходя от кассы, задать интересующие вас вопросы. | https://habr.com/ru/post/301588/ | null | ru | null |

# Использование JavaScript-модулей в продакшне: современное состояние дел. Часть 1

Два года назад я писал о [методике](https://philipwalton.com/articles/deploying-es2015-code-in-production-today/), которую сейчас обычно называют паттерном module/nomodule. Её применение позволяет писать JavaScript-код, используя возможности ES2015+, а потом применять бандлеры и транспиляторы для создания двух версий кодовой базы. Одна из них содержит современный синтаксис (она загружается с помощью конструкции вида | https://habr.com/ru/post/466537/ | null | ru | null |

# Дайджест интересных новостей и материалов из мира PHP № 43 (16 – 30 июня 2014)

Предлагаем вашему вниманию очередную подборку со ссылками на новости и материалы.

Приятного чтения!

### Новости и релизы

* [PHP 5.3.0](http://www.php.net/archive/2009.php#id2009-06-30-1) — Ровно 5 лет назад был выпущен [PHP 5.3](http://php.net/releases/5_3_0.php). Именно тогда были введены пространства имен, анонимные функции и ряд других возможностей, без которых сегодня трудно представить PHP-разработку.

* Релизы PHP [5.4.30](http://www.php.net/archive/2014.php#id2014-06-26-1) и [5.5.14](http://php.net/archive/2014.php#id2014-06-27-1) — Обновления актуальных веток, содержат ряд исправлений безопасности.

* [Доступен PHP 5.6.0RC1](http://www.php.net/archive/2014.php#id2014-06-19-1) — Как и было обещано ранее, 19 июня команда разработчиков PHP анонсировала выход первого релиз-кандидата. 3 июля запланирован RC2 и затем уже финальный релиз. Коротко об изменениях в 5.6 [тут](http://rmcreative.ru/blog/post/php-5.6.0rc1) .

* [Toran Proxy и будущее Composer](http://seld.be/notes/toran-proxy-and-the-future-of-composer) — Автор Composer Jordi Boggiano столкнулся с известной проблемой, когда работа над open-source продуктом занимает много времени, но не приносит дохода. Поэтому миру представлен платный продукт Toran Proxy, который позволяет быстро создавать приватные репозитории пакетов. То же самое можно было и прежде сделать с помощью Satis, но Toran Proxy значительно упрощает и делает процесс удобнее. Деньги, полученные от продаж Toran Proxy, позволят продолжить работу над бесплатными Composer и Packagist. Пожелаем автору удачи и успеха его детищам!

*  [Yii 1.1.15](http://habrahabr.ru/post/228069/) — Экстренный релиз, устраняющий проблему безопасности, найденную в 1.1.14. Более ранние версии не затронуты.

### PHP

* [RFC: Big Integer Support](https://wiki.php.net/rfc/bigint) — Предложение реализовать полноценную поддержку больших целых в PHP, что позволит использовать числа любой длины ограниченной только размером оперативной памяти. Фактически реализация полностью копирует аналогичную возможность из Python.

* RFC: [Bare Name Array Dereference](https://wiki.php.net/rfc/bare_name_array_dereference#vote), [Bare Name Array Literal](https://wiki.php.net/rfc/bare_name_array_literal#vote) — Голосования по двум противоречивым предложениям, упомянутым в [прошлом выпуске дайджеста](http://habrahabr.ru/company/zfort/blog/226433/), ожидаемо проваливаются.

### Инструменты

* [Elastica](http://elastica.io/) — PHP-клиент для ElasticSearch.

* [Swarrot](https://github.com/swarrot/swarrot) — Библиотека абстрагирующая работу с брокерами сообщений.

* [Supervisor](https://github.com/graze/supervisor) — Надстройка над Symfony/Pocess для управления дочерними процессами.

* [Промисы в PHP](http://evertpot.com/promises-in-php/) — Библиотека [sabre/event 2.0](http://sabre.io/event/) позволяет использовать в PHP концепцию промисов а-ля JavaScript.

* [PhpMetrics](https://github.com/Halleck45/PhpMetrics) — Инструмент подсчета различных метрик по PHP-коду. [Пример HTML-отчета](http://www.phpmetrics.org/report/2014-05/report.html).

* [League\Url](http://url.thephpleague.com/) — Простая библиотека для работы с URL.

* [KLogger](https://github.com/katzgrau/KLogger) — Отличный PSR-3 совместимый логгер в одном файле.

* [Smaug](https://github.com/igorw/smaug) — Библиотека для создания парсеров на PHP.

### Материалы для обучения

* [Несоответствие ссылок в вызовах функций](http://jpauli.github.io/2014/06/27/references-mismatch.html) — Отличный пост от Julien Pauli из PHP core-команды. Раскрываются некоторые особенности использования ссылок в PHP и как это отражается на потребляемой памяти.

* [realpath\_cache](http://jpauli.github.io/2014/06/30/realpath-cache.html) — Подробный пост о такой важной концепции как realpath\_cache.

* [SSL и потоки данных в PHP: вы делаете это неправильно.](http://www.docnet.nu/tech-portal/2014/06/26/ssl-and-php-streams-part-1-you-are-doing-it-wrongtm/C0) — Об аспектах безопасности при работе с потоками данных в PHP.

* [Как лучше работать с ассетами в Symfony 2](http://konradpodgorski.com/blog/2014/06/23/better-way-to-work-with-assets-in-symfony-2/) — О работе с ассетами с помощью NodeJS, Bower и GruntJS.

* [Стресс-тест вашего PHP-приложения с помощью ApacheBench](http://www.sitepoint.com/stress-test-php-app-apachebench/)

* [Используем Mockery для подмены зависимостей в ваших тестах](http://www.sitepoint.com/mock-test-dependencies-mockery/)

* [Модульное тестирование с базой данных](http://codeception.com/06-27-2014/unit-testing-with-database) — Само по себе юнит-тестирование предполагает изоляцию кода и подмену зависимостей вроде базы данных на всякого рода заглушки. Однако это не идинственный выход и в посте пример реализации тестов на Codeception с использованием базы данных.

* [Руководство по PHP-собеседованию](http://www.toptal.com/php#hiring-guide) — Рассмотрено несколько вопросов для PHP-кандидата, и что хорошо, предложены ответы.

* [8 PHP-инструментов тестирования и поддержки качества](http://www.sitepoint.com/8-must-have-php-quality-assurance-tools/) — Коротко о PHPUnit, Behat, vfsStream, PHPLOC, PHP Mess Detector, PHP CodeSniffer, Dead Code Detector, Copy Paste Detector.

* [Самые опасные угрозы качеству вашего кода](http://blog.codacy.com/2014/06/19/your-greatest-code-quality-threats-and-how-to-solve-them/)

* [Безопасные REST API на основе HMAC](http://www.9bitstudios.com/2013/07/hmac-rest-api-security/) — Описан способ использования [HMAC](https://en.wikipedia.org/wiki/Hash-based_message_authentication_code) для реализации безопасной аутентификации/авторизации в REST API.

* [Шпаргалка по кодированию данных в PHP](https://timoh6.github.io/2014/06/16/PHP-data-encryption-cheatsheet.html)

* [Время приключений с Hack и HHVM](http://www.nathandavison.com/article/21/adventure-time-with-hack-and-hhvm) — Опыт использования Hack.

* [Доступ к неопределенным элементам массива/объекта в PHP и не только](http://dev.imagineeasy.com/post/89912077319/accessing-undefined-properties-of-hashes-objects-in) — Сравнение реализации логики `array_key_exists('bar', $foo) ? $foo['bar'] : default;` в PHP и других языках.

* [Туториал по установке PHP-расширений из исходников](http://www.sitepoint.com/install-php-extensions-source/)

* [Изучайте Haskell, чтобы быть экспертами в PHP, Ruby...](http://dev.imagineeasy.com/post/90057727549/learn-you-a-haskell-for-great-good-in-php-ruby) — О положительном эффекте изучения языка другой парадигмы.

* [Типизированный PHP](https://leanpub.com/typedphp) — Новая книга, в которой рассмотрены стандартные библиотеки и расширения для реализации системы типов поверх PHP.

* [Dead Code](http://derickrethans.nl/dead-code.html) — Автор [Xdebug](http://xdebug.org/) рассказывает почему его инструмент может сигнализировать о неиспользуемых (мертвых) участках кода в совсем неочевидных местах.

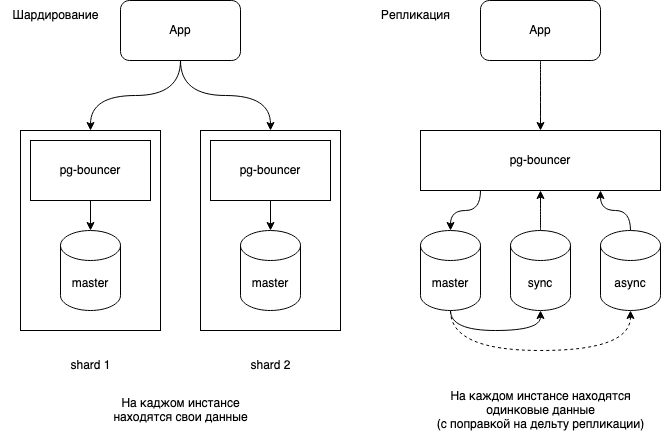

*  [Архитектура высоких нагрузок](http://ruhighload.com/post/%D0%90%D1%80%D1%85%D0%B8%D1%82%D0%B5%D0%BA%D1%82%D1%83%D1%80%D0%B0+%D0%B2%D1%8B%D1%81%D0%BE%D0%BA%D0%B8%D1%85+%D0%BD%D0%B0%D0%B3%D1%80%D1%83%D0%B7%D0%BE%D0%BA) — Принципы и способы масштабирования веб-приложений.

*  [Всё, что вы хотели узнать о рефакторинге, но боялись спросить](http://habrahabr.ru/post/227585/) — Новый отличный ресурс о рефакторинге [refactoring.guru](http://refactoring.guru/) с примерами кода на PHP и других языках.

*  [Как делать независимые от фреймворка контроллеры?](http://habrahabr.ru/post/227781/), [Избавьтесь от аннотаций в своих контроллерах!](http://habrahabr.ru/post/227787/), [Последние штрихи](http://habrahabr.ru/post/227841/) — Серия статей о контроллерах в Symfony 2.

*  [Сравнение геолокационных бинарных баз и их драйверов: GeoIP, Sypex Geo, TabGeo](http://habrahabr.ru/post/227183/)

*  [Yii2 и организация мультиязычности](http://habrahabr.ru/post/226931/)

*  [Изучаем PHP изнутри. Zval](http://habrahabr.ru/post/226707/)

*  [Боятся ли PHP-разработчики функций?](http://habrahabr.ru/post/226753/)

### Материалы c прошедших конференций

*  [Laracon 2014](http://userscape.com/laracon/2014/) — Видеозаписи всех докладов с прошедшей конференции. Один из них [о шестиугольной архитектуре](http://fideloper.com/hexagonal-architecture).

* [Dutch PHP Conference 2014](https://joind.in/event/view/1738/slides#event-tabs) — Слайды 38 докладов.

### Аудио и видеоматериалы

*  [Работа с базой данных в Symfony 2](http://code.tutsplus.com/tutorials/working-with-databases-in-symfony-2--cms-21461) — Продолжение серии скринкастов о Symfony 2. Ранее были: [валидация форм в Symfony 2](http://code.tutsplus.com/tutorials/form-validation-in-symfony-2--cms-21397), [создание повторно используемых форм](http://code.tutsplus.com/tutorials/creating-reusable-forms-in-symfony-2--cms-21244), [основы](http://code.tutsplus.com/tutorials/symfony-2-the-basics--net-37015), [роутинг](http://code.tutsplus.com/tutorials/routing-overview-basics-in-symfony-2--cms-20754), [контроллеры](http://code.tutsplus.com/tutorials/working-with-controllers-in-symfony-2--cms-21111) и [шаблоны](http://code.tutsplus.com/tutorials/working-with-templates-in-symfony-2--cms-21172).

*  [Одновременная отладка PHP и JavaScript в PhpStorm](http://confluence.jetbrains.com/display/PhpStorm/Debugging+PHP+and+JavaScript+code+at+the+same+time+in+PhpStorm)

[Быстрый поиск по всем дайджестам](http://pronskiy.github.io/php-digest/)

← [Предыдущий выпуск](http://habrahabr.ru/company/zfort/blog/226433/) | https://habr.com/ru/post/228215/ | null | ru | null |

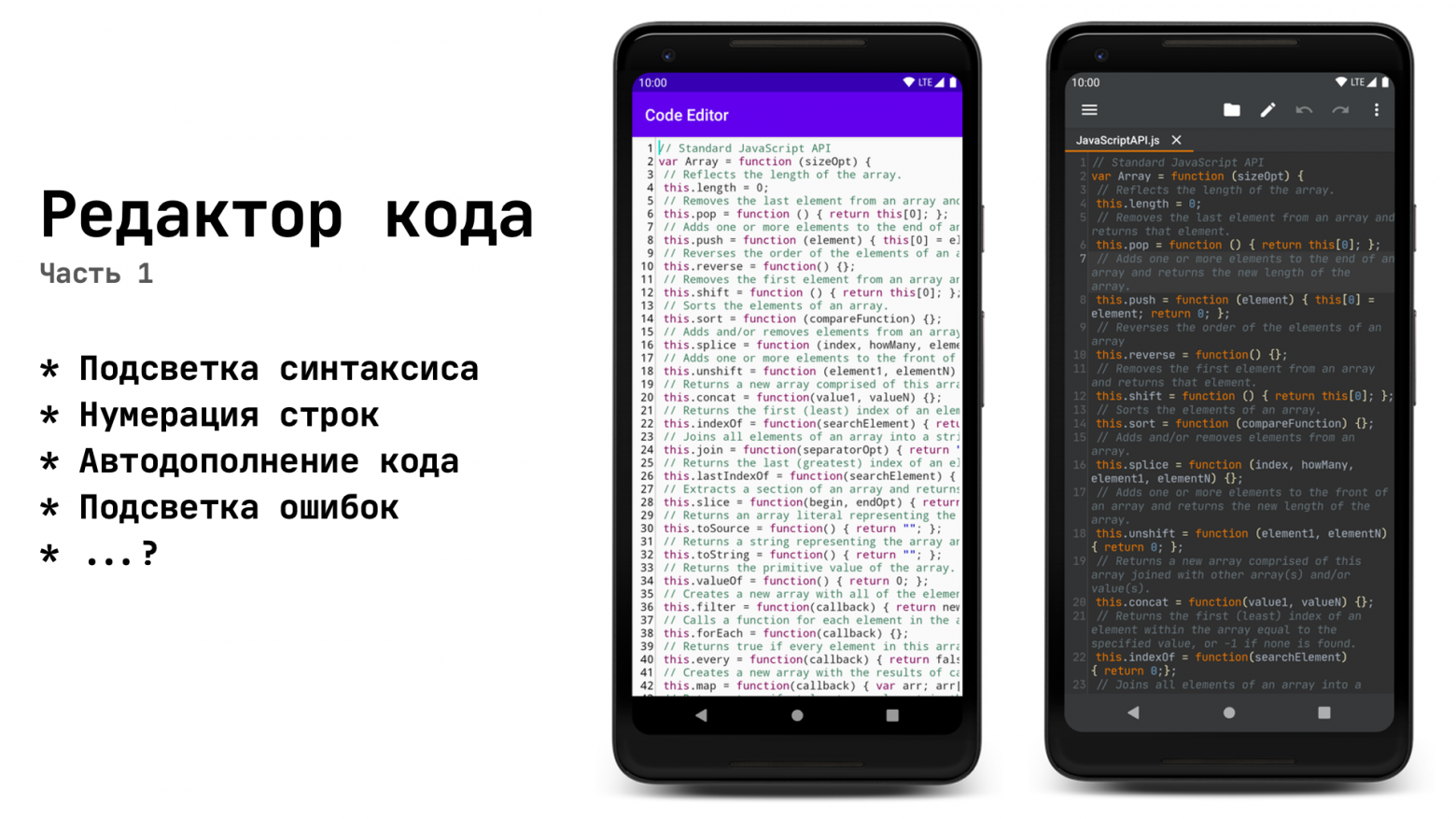

# Редактор кода на Android: часть 1

Перед тем как закончить работу над своим редактором кода я много раз наступал на грабли, наверное декомпилировал десятки похожих приложений, и в данной серии статей я расскажу о том чему научился, каких ошибок можно избежать и много других интересных вещей.

Вступление

----------

Привет всем! Судя из названия вполне понятно о чем будет идти речь, но всё же я должен вставить свои пару слов перед тем как перейти к коду.

Я решил разделить статью на 2 части, в первой мы поэтапно напишем оптимизированную подсветку синтаксиса и нумерацию строк, а [во второй](https://habr.com/ru/post/509468/) добавим автодополнение кода и подсветку ошибок.

Для начала составим список того, что наш редактор должен уметь:

* Подсвечивать синтаксис

* Отображать нумерацию строк

* Показывать варианты автодополнения *(расскажу во второй части)*

* Подсвечивать синтаксические ошибки *(расскажу во второй части)*

Это далеко не весь список того, какими свойствами должен обладать современный редактор кода, но именно об этом я хочу рассказать в этой небольшой серии статей.

MVP — простой текстовый редактор

--------------------------------

На данном этапе проблем возникнуть не должно — растягиваем `EditText` на весь экран, указываем `gravity`, прозрачный `background` чтобы убрать полосу снизу, размер шрифта, цвет текста и т.д. Я люблю начинать с визуальной части, так мне становится проще понять чего не хватает в приложении, и над какими деталями ещё стоит поработать.

На этом этапе я так же сделал загрузку/сохранение файлов в память. Код приводить не буду, в интернете переизбыток примеров работы с файлами.

Подсветка синтаксиса

--------------------

Как только мы ознакомились с требованиями к редактору, пора переходить к самому интересному.

Очевидно, чтобы контролировать весь процесс — реагировать на ввод, отрисовывать номера строк, нам придется писать `CustomView` наследуясь от `EditText`. Накидываем [`TextWatcher`](https://developer.android.com/reference/android/text/TextWatcher) чтобы слушать изменения в тексте и переопределяем метод `afterTextChanged`, в котором и будем вызывать метод отвечающий за подсветку:

```

class TextProcessor @JvmOverloads constructor(

context: Context,

attrs: AttributeSet? = null,

defStyleAttr: Int = R.attr.editTextStyle

) : EditText(context, attrs, defStyleAttr) {

private val textWatcher = object : TextWatcher {

override fun beforeTextChanged(s: CharSequence?, start: Int, count: Int, after: Int) {}

override fun onTextChanged(s: CharSequence?, start: Int, before: Int, count: Int) {}

override fun afterTextChanged(s: Editable?) {

syntaxHighlight()

}

}

private fun syntaxHighlight() {

// Тут будем подсвечивать текст

}

}

```

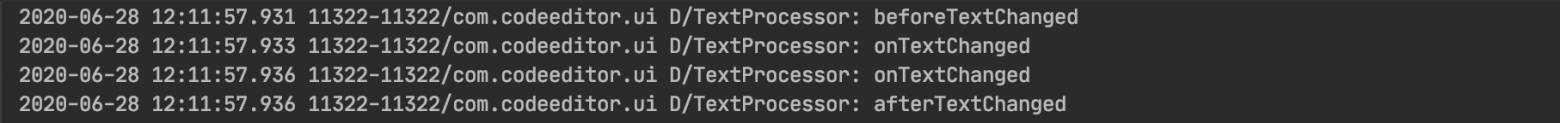

**Q:** Почему мы используем `TextWatcher` как переменную, ведь можно реализовать интерфейс прямо в классе?

**A:** Так уж получилось, что у `TextWatcher` есть метод который конфликтует c уже существующим методом у `TextView`:

```

// Метод TextWatcher

fun onTextChanged(s: CharSequence?, start: Int, before: Int, count: Int)

// Метод TextView

fun onTextChanged(text: CharSequence?, start: Int, lengthBefore: Int, lengthAfter: Int)

```

Оба этих метода имеют одинаковое название и одинаковые аргументы, да и смысл вроде у них тот же, но проблема в том что метод `onTextChanged` у `TextView` вызовется вместе с `onTextChanged` у `TextWatcher`. Если проставить логи в тело метода, то увидим что `onTextChanged` вызовется дважды:

Это очень критично если мы планируем добавлять функционал Undo/Redo. Также нам может понадобится момент, в котором не будут работать слушатели, в котором мы сможем очищать стэк с изменениями текста. Мы ведь не хотим, чтобы после открытия нового файла можно было нажать Undo и получить совершенно другой текст. Хоть об Undo/Redo в этой статье говориться не будет, важно учитывать этот момент.

Соответственно, чтобы избежать такой ситуации можно использовать свой метод установки текста вместо стандартного `setText`:

```

fun processText(newText: String) {

removeTextChangedListener(textWatcher)

// undoStack.clear()

// redoStack.clear()

setText(newText)

addTextChangedListener(textWatcher)

}

```

Но вернёмся к подсветке.

Во многих языках программирования есть такая замечательная штука как [RegEx](https://ru.wikipedia.org/wiki/%D0%A0%D0%B5%D0%B3%D1%83%D0%BB%D1%8F%D1%80%D0%BD%D1%8B%D0%B5_%D0%B2%D1%8B%D1%80%D0%B0%D0%B6%D0%B5%D0%BD%D0%B8%D1%8F), это инструмент позволяющий искать совпадения текста в строке. Рекомендую как минимум ознакомится с его базовыми возможностями, потому что рано или поздно любому программисту может понадобится «вытащить» какой-либо кусочек информации из текста.

Сейчас нам важно знать только две вещи:

1. **Pattern** определяет что конкретно нам нужно найти в тексте

2. **Matcher** будет пробегать по всему тексту в попытках найти то, что мы указали в **Pattern**

Может не совсем корректно описал, но принцип работы такой.

Т.к я пишу редактор для JavaScript, вот небольшой паттерн с ключевыми словами языка:

```

private val KEYWORDS = Pattern.compile(

"\\b(function|var|this|if|else|break|case|try|catch|while|return|switch)\\b"

)

```

Конечно, слов тут должно быть гораздо больше, а ещё нужны паттерны для комментариев, строк, чисел и т.д. но моя задача заключается в демонстрации принципа, по которому можно найти нужный контент в тексте.

Далее с помощью **Matcher** мы пройдёмся по всему тексту и установим спаны:

```

private fun syntaxHighlight() {

val matcher = KEYWORDS.matcher(text)

matcher.region(0, text.length)

while (matcher.find()) {

text.setSpan(

ForegroundColorSpan(Color.parseColor("#7F0055")),

matcher.start(),

matcher.end(),

Spannable.SPAN_EXCLUSIVE_EXCLUSIVE

)

}

}

```

**Поясню:** мы получаем объект **Matcher** у **Pattern**, и указываем ему область для поиска в символах (Соответственно с 0 по `text.length` это весь текст). Далее вызов `matcher.find()` вернёт `true` если в тексте было найдено совпадение, а с помощью вызовов `matcher.start()` и `matcher.end()` мы получим позиции начала и конца совпадения в тексте. Зная эти данные, мы можем использовать метод [`setSpan`](https://developer.android.com/guide/topics/text/spans) для раскраски определённых участков текста.

Существует много видов спанов, но для перекраски текста обычно используется [`ForegroundColorSpan`](https://developer.android.com/reference/android/text/style/ForegroundColorSpan).

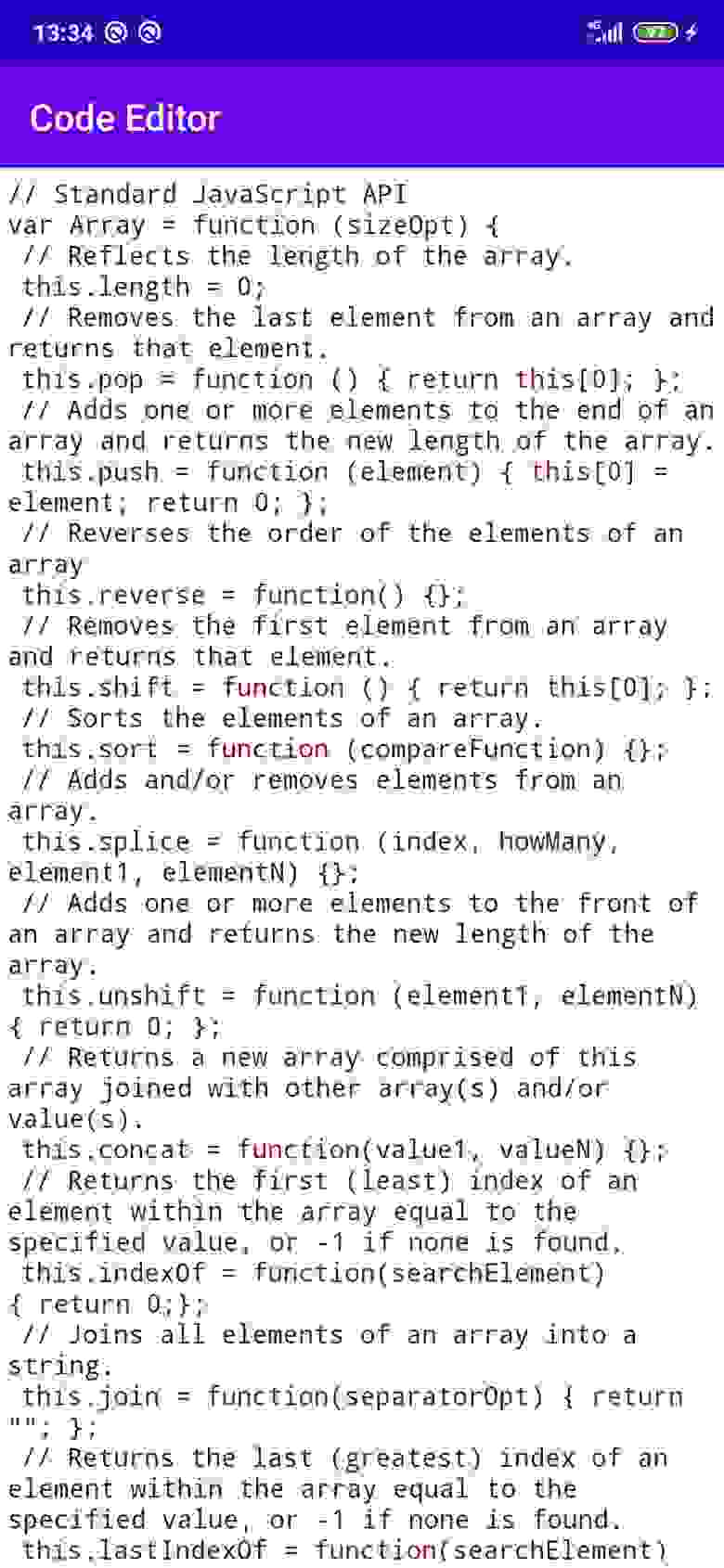

#### Итак, запускаем!

Результат соответствует ожиданиям ровно до того момента, пока мы не начнём редактировать большой файл (на скриншоте файл в ~1000 строк)

Дело в том что метод `setSpan` работает медленно, сильно нагружая UI Thread, а учитывая что метод `afterTextChanged` вызывается после каждого введенного символа, писать код становится одним мучением.

#### Поиск решения

Первое что приходит в голову — вынести тяжелую операцию в фоновый поток. Но тяжелая операция тут это `setSpan` по всему тексту, а не регулярки. (Думаю, можно не объяснять почему нельзя вызывать `setSpan` из фонового потока).

Немного поискав тематических статей узнаем, что если мы хотим добиться плавности, придётся подсвечивать **только видимую часть** текста.

Точно! Так и сделаем! Вот только… как?

#### Оптимизация

Хоть я и упомянул что нас заботит только производительность метода `setSpan`, всё же рекомендую выносить работу RegEx в фоновой поток чтобы добиться максимальной плавности.

Нам нужен класс, который будет в фоне обрабатывать весь текст и возвращать список спанов.

Конкретной реализации приводить не буду, но если кому интересно то я использую [`AsyncTask`](https://developer.android.com/reference/android/os/AsyncTask) работающий на [`ThreadPoolExecutor`](https://developer.android.com/reference/java/util/concurrent/ThreadPoolExecutor). (Да-да, AsyncTask в 2020)

Нам главное, чтобы выполнялась такая логика:

1. В `beforeTextChanged` **останавливаем** Task который парсит текст

2. В `afterTextChanged` **запускаем** Task который парсит текст

3. По окончанию своей работы, Task должен вернуть список спанов в `TextProcessor`, который в свою очередь подсветит только видимую часть

И да, спаны тоже будем писать свои собственные:

```

data class SyntaxHighlightSpan(

private val color: Int,

val start: Int,

val end: Int

) : CharacterStyle() {

// можно заморочиться и добавить italic, например, только для комментариев

override fun updateDrawState(textPaint: TextPaint?) {

textPaint?.color = color

}

}

```

Таким образом, код редактора превращается в нечто подобное:

**Много кода**

```

class TextProcessor @JvmOverloads constructor(

context: Context,

attrs: AttributeSet? = null,

defStyleAttr: Int = R.attr.editTextStyle

) : EditText(context, attrs, defStyleAttr) {

private val textWatcher = object : TextWatcher {

override fun beforeTextChanged(s: CharSequence?, start: Int, count: Int, after: Int) {

cancelSyntaxHighlighting()

}

override fun onTextChanged(s: CharSequence?, start: Int, before: Int, count: Int) {}

override fun afterTextChanged(s: Editable?) {

syntaxHighlight()

}

}

private var syntaxHighlightSpans: List = emptyList()

private var javaScriptStyler: JavaScriptStyler? = null

fun processText(newText: String) {

removeTextChangedListener(textWatcher)

// undoStack.clear()

// redoStack.clear()

setText(newText)

addTextChangedListener(textWatcher)

// syntaxHighlight()

}

private fun syntaxHighlight() {

javaScriptStyler = JavaScriptStyler()

javaScriptStyler?.setSpansCallback { spans ->

syntaxHighlightSpans = spans

updateSyntaxHighlighting()

}

javaScriptStyler?.runTask(text.toString())

}

private fun cancelSyntaxHighlighting() {

javaScriptStyler?.cancelTask()

}

private fun updateSyntaxHighlighting() {

// подсветка видимой части будет тут

}

}

```

Т.к конкретной реализации обработки в фоне я не показал, представим что мы написали некий `JavaScriptStyler`, который в фоне будет делать всё тоже самое что мы делали до этого в UI Thread — пробегать по всему тексту в поисках совпадений и заполнять список спанов, а в конце своей работы вернёт результат в `setSpansCallback`. В этот момент запустится метод `updateSyntaxHighlighting`, который пройдётся по списку спанов и отобразит только те, что видны в данный момент на экране.

#### Как понять, какой текст попадает в видимую область?

Буду ссылаться на [эту статью](https://habr.com/ru/post/204248/), там автор предлагает использовать примерно такой способ:

```

val topVisibleLine = scrollY / lineHeight

val bottomVisibleLine = topVisibleLine + height / lineHeight + 1 // height - высота View

val lineStart = layout.getLineStart(topVisibleLine)

val lineEnd = layout.getLineEnd(bottomVisibleLine)

```

И он работает! Теперь вынесем `topVisibleLine` и `bottomVisibleLine` в отдельные методы и добавим пару дополнительных проверок, на случай если что-то пойдёт не так:

**Новые методы**

```

private fun getTopVisibleLine(): Int {

if (lineHeight == 0) {

return 0

}

val line = scrollY / lineHeight

if (line < 0) {

return 0

}

return if (line >= lineCount) {

lineCount - 1

} else line

}

private fun getBottomVisibleLine(): Int {

if (lineHeight == 0) {

return 0

}

val line = getTopVisibleLine() + height / lineHeight + 1

if (line < 0) {

return 0

}

return if (line >= lineCount) {

lineCount - 1

} else line

}

```

Последнее что остаётся сделать — пройтись по полученному списку спанов и раскрасить текст:

```

for (span in syntaxHighlightSpans) {

val isInText = span.start >= 0 && span.end <= text.length

val isValid = span.start <= span.end

val isVisible = span.start in lineStart..lineEnd

|| span.start <= lineEnd && span.end >= lineStart

if (isInText && isValid && isVisible)) {

text.setSpan(

span,

if (span.start < lineStart) lineStart else span.start,

if (span.end > lineEnd) lineEnd else span.end,

Spannable.SPAN_EXCLUSIVE_EXCLUSIVE

)

}

}

```

Не пугайтесь страшного `if`'а, он всего лишь проверяет попадает ли спан из списка в видимую область.

#### Ну что, работает?

Работает, вот только при редактировании текста спаны не обновляются, исправить ситуацию можно очистив текст от всех спанов перед наложением новых:

```

// Примечание: метод getSpans из библиотеки core-ktx

val textSpans = text.getSpans(0, text.length)

for (span in textSpans) {

text.removeSpan(span)

}

```

Ещё один косяк — после закрытия клавиатуры кусок текста остаётся неподсвеченным, исправляем:

```

override fun onSizeChanged(w: Int, h: Int, oldw: Int, oldh: Int) {

super.onSizeChanged(w, h, oldw, oldh)

updateSyntaxHighlighting()

}

```

Главное не забыть указать [`adjustResize`](https://developer.android.com/guide/topics/manifest/activity-element#wsoft) в манифесте.

#### Скроллинг

Говоря про скроллинг снова буду ссылаться на [эту статью](https://habr.com/ru/post/204248/). Автор предлагает ждать 500 мс после окончания скроллинга, что противоречит моему чувству прекрасного. Я не хочу дожидаться пока прогрузится подсветка, я хочу видеть результат моментально.

Так же автор приводит аргумент что запускать парсер после каждого «проскроленного» пикселя затратно, и я полностью с этим согласен (вообще рекомендую полностью ознакомится с его статьей, она небольшая, но там много интересного). Но дело в том, что у нас **уже** есть готовый список спанов, и нам **не нужно** запускать парсер.

Достаточно вызывать метод отвечающий за обновление подсветки:

```

override fun onScrollChanged(horiz: Int, vert: Int, oldHoriz: Int, oldVert: Int) {

super.onScrollChanged(horiz, vert, oldHoriz, oldVert)

updateSyntaxHighlighting()

}

```

Нумерация строк

---------------

Если мы добавим в разметку ещё один `TextView` то будет проблематично их между собой связать (например, синхронно обновлять размер текста), да и если у нас большой файл то придется полностью обновлять текст с номерами после каждой введенной буквы, что не очень круто. Поэтому будем использовать стандартные средства любой `CustomView` — рисование на `Canvas` в `onDraw`, это и быстро, и не сложно.

Для начала определим что будем рисовать:

* Номера строк

* Вертикальную линию, отделяющую поле ввода от номеров строк

Предварительно необходимо вычислить и установить `padding` слева от редактора, чтобы не было конфликтов с напечатанным текстом.

Для этого напишем функцию, которая будет обновлять отступ перед отрисовкой:

**Обновление отступа**

```

private var gutterWidth = 0

private var gutterDigitCount = 0

private var gutterMargin = 4.dpToPx() // отступ от разделителя в пикселях

...

private fun updateGutter() {

var count = 3

var widestNumber = 0

var widestWidth = 0f

gutterDigitCount = lineCount.toString().length

for (i in 0..9) {

val width = paint.measureText(i.toString())

if (width > widestWidth) {

widestNumber = i

widestWidth = width

}

}

if (gutterDigitCount >= count) {

count = gutterDigitCount

}

val builder = StringBuilder()

for (i in 0 until count) {

builder.append(widestNumber.toString())

}

gutterWidth = paint.measureText(builder.toString()).toInt()

gutterWidth += gutterMargin

if (paddingLeft != gutterWidth + gutterMargin) {

setPadding(gutterWidth + gutterMargin, gutterMargin, paddingRight, 0)

}

}

```

**Пояснение:**

Для начала мы узнаем кол-во строк в `EditText` (не путать с кол-вом "`\n`" в тексте), и берем кол-во символов от этого числа. Например, если у нас 100 строк, то переменная `gutterDigitCount` будет равна 3, потому что в числе 100 ровно 3 символа. Но допустим, у нас всего 1 строка — а значит отступ в 1 символ будет визуально казаться маленьким, и для этого мы используем переменную `count`, чтобы задать минимально отображаемый отступ в 3 символа, даже если у нас меньше 100 строк кода.

Эта часть была самая запутанная из всех, но если вдумчиво прочитать несколько раз (поглядывая на код), то всё станет понятно.

Далее устанавливаем отступ предварительно вычислив `widestNumber` и `widestWidth`.

#### Приступим к рисованию

К сожалению, если мы хотим использовать стандартный андройдовский перенос текста на новую строку то придется поколдовать, что займет у нас много времени и ещё больше кода, которого хватит на целую статью, поэтому дабы сократить ваше время (и время модератора хабра), мы включим горизонтальный скроллинг, чтобы все строки шли одна за другой:

```

setHorizontallyScrolling(true)

```

Ну а теперь можно приступать к рисованию, объявим переменные с типом `Paint`:

```

private val gutterTextPaint = Paint() // Нумерация строк

private val gutterDividerPaint = Paint() // Отделяющая линия

```

Где-нибудь в `init` блоке установим цвет текста и цвет разделителя. Важно помнить, что если вы поменяйте шрифт текста, то шрифт `Paint`'а придется применять вручную, для этого советую переопределить метод [`setTypeface`](https://developer.android.com/reference/android/widget/TextView#setTypeface(android.graphics.Typeface)). Аналогично и с размером текста.

После чего переопределяем метод `onDraw`:

```

override fun onDraw(canvas: Canvas?) {

updateGutter()

super.onDraw(canvas)

var topVisibleLine = getTopVisibleLine()

val bottomVisibleLine = getBottomVisibleLine()

val textRight = (gutterWidth - gutterMargin / 2) + scrollX

while (topVisibleLine <= bottomVisibleLine) {

canvas?.drawText(

(topVisibleLine + 1).toString(),

textRight.toFloat(),

(layout.getLineBaseline(topVisibleLine) + paddingTop).toFloat(),

gutterTextPaint

)

topVisibleLine++

}

canvas?.drawLine(

(gutterWidth + scrollX).toFloat(),

scrollY.toFloat(),

(gutterWidth + scrollX).toFloat(),

(scrollY + height).toFloat(),

gutterDividerPaint

)

}

```

#### Смотрим на результат

Выглядит круто.

Что же мы сделали в `onDraw`? Перед вызовом `super`-метода мы обновили отступ, после чего отрисовали номера только в видимой области, ну и под конец провели вертикальную линию, визуально отделяющую нумерацию строк от редактора кода.

Для красоты можно ещё перекрасить отступ в другой цвет, визуально выделить строку на которой находится курсор, но это я уже оставлю на ваше усмотрение.

Заключение

----------

В этой статье мы написали отзывчивый редактор кода с подсветкой синтаксиса и нумерацией строк, а в следующей части добавим удобное автодополнение кода и подсветку синтаксических ошибок прямо во время редактирования.

Также оставлю ссылку на исходники моего редактора кода на [GitHub](https://github.com/massivemadness/Squircle-CE), там вы найдёте не только те фичи о которых я рассказал в этой статье, но и много других которые остались без внимания.

**UPD:** [Вторая часть тут](https://habr.com/ru/post/509468/)

Задавайте вопросы и предлагайте темы для обсуждения, ведь я вполне мог что-то упустить.

Спасибо! | https://habr.com/ru/post/509300/ | null | ru | null |

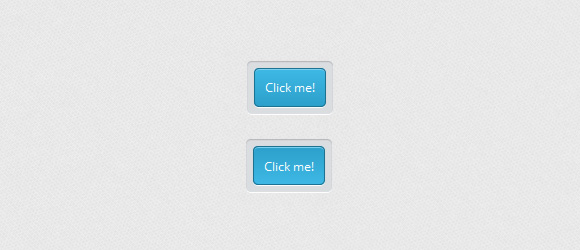

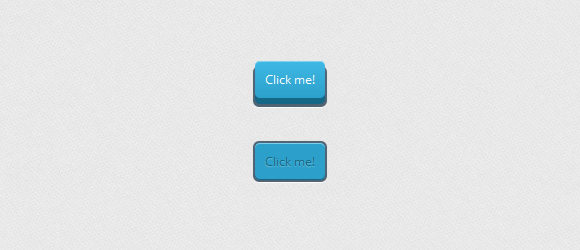

# CSS кнопки с помощью псевдо-элементов

Здравствуйте, друзья. За последний месяц я экспериментировал с псевдо-элементами, особенно, с их использованием в создании кнопок. Таким образом, удалось создать крутые эффекты, которые раньше можно было сделать только со спрайтами.

В этом уроке я покажу как создать кнопку с изюминкой, используя только якорный тег и мощь CSS.

Используется шрифт «Open Sans» [Стива Мэттсона](https://profiles.google.com/107777320916704234605/about).

**Дисклеймер**

*Я не буду использовать CSS префиксы в данных примерах, но вы найдете их в исходных файлах.*

*Я не использовал свойство transition, потому что только Firefox поддерживает его в псевдо-элементах. Кроме этого, я считаю что кнопки работают хорошо и без его использования.*

### Разметка

Для работы всех кнопок пригодится только якорь, все остальные элементы мы будем создавать с помощью псевдо-класса ::before.

```

[Click me!](#)

```

Первый пример

-------------

Я думаю это самый легкий пример, который делается обычным CSS.

### Стили

Прежде всего, зададим основные стили для кнопки в обычном и активном состоянии. Обратите внимание, что кнопка позиционирована относительно. Это поможет при позиционировании элемента ::before:

```

.a_demo_one {

background-color:#ba2323;

padding:10px;

position:relative;

font-family: 'Open Sans', sans-serif;

font-size:12px;

text-decoration:none;

color:#fff;

border: solid 1px #831212;

background-image: linear-gradient(bottom, rgb(171,27,27) 0%, rgb(212,51,51) 100%);

border-radius: 5px;

}

.a_demo_one:active {

padding-bottom:9px;

padding-left:10px;

padding-right:10px;

padding-top:11px;

top:1px;

background-image: linear-gradient(bottom, rgb(171,27,27) 100%, rgb(212,51,51) 0%);

}

```

Теперь сделаем серый контейнер вокруг кнопки, используя псевдо-элемент ::before. Абсолютное позиционирование сделает нашу жизнь легче при позиционировании самого элемента.

```

.a_demo_one::before {

background-color:#ccd0d5;

content:"";

display:block;

position:absolute;

width:100%;

height:100%;

padding:8px;

left:-8px;

top:-8px;

z-index:-1;

border-radius: 5px;

box-shadow: inset 0px 1px 1px #909193, 0px 1px 0px #fff;

}

```

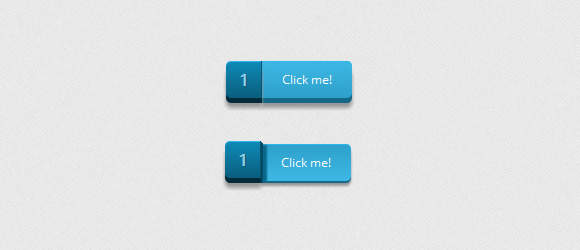

Второй пример

-------------

Этот пример немного сложнее из-за 3D-эффекта. Изначально кнопка находится за пределами контейнера, затем, при щелчке она уходит вниз:

```

.a_demo_two {

background-color:#6fba26;

padding:10px;

position:relative;

font-family: 'Open Sans', sans-serif;

font-size:12px;

text-decoration:none;

color:#fff;

background-image: linear-gradient(bottom, rgb(100,170,30) 0%, rgb(129,212,51) 100%);

box-shadow: inset 0px 1px 0px #b2f17f, 0px 6px 0px #3d6f0d;

border-radius: 5px;

}

.a_demo_two:active {

top:7px;

background-image: linear-gradient(bottom, rgb(100,170,30) 100%, rgb(129,212,51) 0%);

box-shadow: inset 0px 1px 0px #b2f17f, inset 0px -1px 0px #3d6f0d;

color: #156785;

text-shadow: 0px 1px 1px rgba(255,255,255,0.3);

background: rgb(44,160,202);

}

```

### Стили

А вот здесь уже сложнее:

Так как положение псевдо-элемента зависит от родительского элемента, то при перемещении родительского элемента на несколько пикселей, псевдо-элемент необходимо переместить на столько же пикселей, но в другую сторону.

```

.a_demo_two::before {

background-color:#072239;

content:"";

display:block;

position:absolute;

width:100%;

height:100%;

padding-left:2px;

padding-right:2px;

padding-bottom:4px;

left:-2px;

top:5px;

z-index:-1;

border-radius: 6px;

box-shadow: 0px 1px 0px #fff;

}

.a_demo_two:active::before {

top:-2px;

}

```

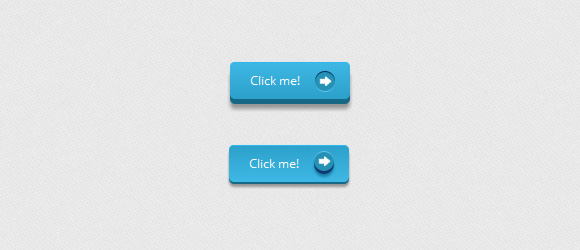

Третий пример

-------------

Это одна из моих любимых кнопок, так как такой еще не было, перед тем, как я ее создал. Кажется, людям она очень нравится. Кнопка разделена на две части, и когда вы нажимаете на нее, она как бы «ломается».

### Стили

Опять таки, начнем с легкой части. Обратите внимание на то, что здесь появился отступ. Он необходим для компенсирования ширины псевдо-элемента, если нужно расположить кнопку по центру. Если же не нужно, то отступ можно не использовать.

```

.a_demo_three {

background-color:#3bb3e0;

font-family: 'Open Sans', sans-serif;

font-size:12px;

text-decoration:none;

color:#fff;

position:relative;

padding:10px 20px;

border-left:solid 1px #2ab7ec;

margin-left:35px;

background-image: linear-gradient(bottom, rgb(44,160,202) 0%, rgb(62,184,229) 100%);

border-top-right-radius: 5px;

border-bottom-right-radius: 5px;

box-shadow: inset 0px 1px 0px #2ab7ec, 0px 5px 0px 0px #156785, 0px 10px 5px #999;

}

.a_demo_three:active {

top:3px;

background-image: linear-gradient(bottom, rgb(62,184,229) 0%, rgb(44,160,202) 100%);

box-shadow: inset 0px 1px 0px #2ab7ec, 0px 2px 0px 0px #156785, 0px 5px 3px #999;

}

```

Перейдем к псевдо-элементам:

```

.a_demo_three::before {

content:"·";

width:35px;

max-height:29px;

height:100%;

position:absolute;

display:block;

padding-top:8px;

top:0px;

left:-36px;

font-size:16px;

font-weight:bold;

color:#8fd1ea;

text-shadow:1px 1px 0px #07526e;

border-right:solid 1px #07526e;

background-image: linear-gradient(bottom, rgb(10,94,125) 0%, rgb(14,139,184) 100%);

border-top-left-radius: 5px;

border-bottom-left-radius: 5px;

box-shadow:inset 0px 1px 0px #2ab7ec, 0px 5px 0px 0px #032b3a, 0px 10px 5px #999 ;

}

.a_demo_three:active::before {

top:-3px;

box-shadow:inset 0px 1px 0px #2ab7ec, 0px 5px 0px 0px #032b3a, 1px 1px 0px 0px #044a64, 2px 2px 0px 0px #044a64, 2px 5px 0px 0px #044a64, 6px 4px 2px #0b698b, 0px 10px 5px #999 ;

}

```

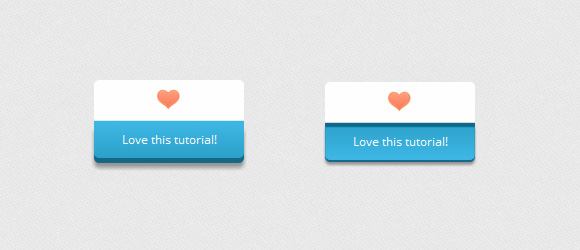

Четвертый пример

----------------

На этот раз мы будем использовать псевдо-элемент для стрелки, используя фоновое изображение. Вместо изображений так же можно использовать эти [шрифтовые иконки](http://css-tricks.com/examples/IconFont/).

### Стили

```

.a_demo_four {

background-color:#4b3f39;

font-family: 'Open Sans', sans-serif;

font-size:12px;

text-decoration:none;

color:#fff;

position:relative;

padding:10px 20px;

padding-right:50px;

background-image: linear-gradient(bottom, rgb(62,51,46) 0%, rgb(101,86,78) 100%);

border-radius: 5px;

box-shadow: inset 0px 1px 0px #9e8d84, 0px 5px 0px 0px #322620, 0px 10px 5px #999;

}

.a_demo_four:active {

top:3px;

background-image: linear-gradient(bottom, rgb(62,51,46) 100%, rgb(101,86,78) 0%);

box-shadow: inset 0px 1px 0px #9e8d84, 0px 2px 0px 0px #322620, 0px 5px 3px #999;

}

.a_demo_four::before {

background-color:#322620;

background-image:url(../images/right_arrow.png);

background-repeat:no-repeat;

background-position:center center;

content:"";

width:20px;

height:20px;

position:absolute;

right:15px;

top:50%;

margin-top:-9px;

border-radius: 50%;

box-shadow: inset 0px 1px 0px #19120f, 0px 1px 0px #827066;

}

.a_demo_four:active::before {

top:50%;

margin-top:-12px;

box-shadow: inset 0px 1px 0px #827066, 0px 3px 0px #19120f, 0px 6px 3px #382e29;

}

```

Пятый пример

------------

Этот пример не очень крутой, но вы можете его доработать по своему усмотрению.

### Стили

```

.a_demo_five {

background-color:#9827d3;

width:150px;

display:inline-block;

font-family: 'Open Sans', sans-serif;

font-size:12px;

text-decoration:none;

color:#fff;

position:relative;

margin-top:40px;

padding-bottom:10px;

padding-top:10px;

background-image: linear-gradient(bottom, rgb(168,48,232) 100%, rgb(141,32,196) 0%);

border-bottom-right-radius: 5px;

border-bottom-left-radius: 5px;

box-shadow: inset 0px 1px 0px #ca73f8, 0px 5px 0px 0px #6a1099, 0px 10px 5px #999;

}

.a_demo_five:active {

top:3px;

background-image: linear-gradient(bottom, rgb(168,48,232) 0%, rgb(141,32,196) 100%);

box-shadow: inset 0px 4px 1px #7215a3, 0px 2px 0px 0px #6a1099, 0px 5px 3px #999;

}

.a_demo_five::before {

background-color:#fff;

background-image:url(../images/heart.gif);

background-repeat:no-repeat;

background-position:center center;

border-left:solid 1px #CCC;

border-top:solid 1px #CCC;

border-right:solid 1px #CCC;

content:"";

width:148px;

height:40px;

position:absolute;

top:-30px;

left:0px;

margin-top:-11px;

z-index:-1;

border-top-left-radius: 5px;

border-top-right-radius: 5px;

}

.a_demo_five:active::before {

top: -33px;

box-shadow: 0px 3px 0px #ccc;

}

```

В заключение

------------

Ну, вот и все. Не забывайте, что эти создание этих кнопок является экспериментом, так что не каждый браузер будет корректно их отображать.

Спасибо за чтение этого урока, я надеюсь, вы найдете ему применение.

[Демонстрация](http://salavat.me/examples/css-knopki-s-pomoschyu-psevdo-elementov/) | [Исходники](http://salavat.me/examples/css-knopki-s-pomoschyu-psevdo-elementov/css-knopki-s-pomoschyu-psevdo-elementov.zip) | https://habr.com/ru/post/136048/ | null | ru | null |

# Авторизация через fancybox в yii

Статья о том, как прикрутить fancybox-авторизацию к проекту на yii в кодировке win-1251. Если вы оказались более счастливым разработчиком, и ваш проект в utf, можете просто пропускать пункты, относящиеся к encoding hell, остальное все так же. Хотя, возможно тогда вам и не понадобится эта статья.

В статье предполагается, что все классы, отвечающие за авторизацию пользователей, у вас уже есть, и нужно только заставить их работать через fancybox.

##### Подключаем fancybox

Скачиваем расширение [fancybox](http://www.yiiframework.com/extension/fancybox/), кладем в папку extensions.

Подключаем в шаблоне:

```

php

$this-widget('application.extensions.fancybox.EFancyBox', array());

?>

```

Делаем в шаблоне ссылку, по которой будет вызываться наш fancybox:

```

php

echo CHtml::link('Войти', array('/some_controller/fancy/'), array('class'='fancy_auth'));

?>

```

По классу ссылки fancy\_auth навешиваем событие:

```

$(document).ready(function(){

$(".fancy_auth").fancybox({

'transitionIn' : 'elastic',

'transitionOut' : 'elastic',

'width' : 345,

'height' : 360,

'autoDimensions': false,

'autoSize': false,

'speedIn' : '500',

'speedOut' : '500',

'type' : 'ajax',

'closeBtn' : false

});

```

В основном, параметры приведены для примера. Единственное, на что стоит обратить внимание — 'type': 'ajax'. Если вы сделаете 'type': 'iframe', не будет работать код обработки успешного запроса, который я привожу ниже, а именно — код перезагрузки страницы. Если после авторизации перезагрузка вам не нужна, выбирайте тип по своему усмотрению.

##### Контроллер

Как видно из параметров ссылки, представление, содержащее форму авторизации, отдается методом fancy контроллера some\_controller. У меня этот метод выглядит так:

```

public function actionFancy()

{

$model=new UserLogin;

$this->performAjaxValidation($model);

echo $this->renderPartial('_login_utf',array('model'=>$model),true,true);

}

```

По умолчанию, значение последнего параметра у renderPartial — false. В данном случае, для нас важно выставить его в true, потому что он отвечает за обработку методом processOutput(), который в методе render вызывается и по умолчанию, и подключает все необходимые скрипты и прочее динамическое содержимое. Без этого у нас не будет работать обработка ошибок при регистрации.

##### Шаблон и немного encoding hell

Если вам повезло, и у вас проект на utf-8, просто создаете нужное представление. Например, так:

```

php $form=$this-beginWidget('CActiveForm', array(

'id'=>'user-login',

//отправляем данные экшену, отвечающему за авторизацию

'action' => Yii::app()->createUrl('/user/login'),

//включаем ajax-валидацию ошибок

'enableAjaxValidation'=>true,

'clientOptions'=>array(

'validateOnSubmit'=>true,

//назначаем js функцию, которой нужно передать управление после того, как пришел ответ.

//более подробные пояснения и код функции будут приведены ниже

'afterValidate' => 'js:afterValidate',

),

)); ?

php echo $form-labelEx($model,'username'); ?>

php echo $form-textField($model,'username'); ?>

php echo $form-error($model,'username'); ?>

php echo $form-labelEx($model,'password'); ?>

php echo $form-passwordField($model,'password'); ?>

php echo $form-error($model,'password'); ?>

php echo CHtml::SubmitButton('Войти и скачать', array(

'type' = 'POST',

// Результат запроса записываем в элемент, найденный

// по CSS-селектору #msg.

'update' => '#msg',

'class'=>'journalFancySubmit',

)); ?>

php $this-endWidget(); ?>

```

Если все очень печально, и ваш проект на win-1251, как и мой, то ваш шаблон отобразится квадратиками, то есть не в той кодировке. Холливарщики скажут — переделывайте срочно в utf, и будут правы, но к сожалению, часто реалии таковы, что по тем или иным причинам перенести весь проект в религиозно верную кодировку нельзя, а чтоб работало — надо. Самым простым костылем мне показалось просто сделать сам файл шаблона в кодировке utf-8. Тогда все отдается корректно.

##### Обработка ajax-валидации в контроллере, снова проблемы в кодировкой

Для того, чтобы контроллер корректно работал с установленной вами ajax-валидацией, нужно добавить обработку ajax-запроса в контроллере, обычно это делается так:

```

if (isset($_POST['ajax']) && $_POST['ajax'] === 'login-form') {

echo CActiveForm::validate($model);

Yii::app()->end;

}

```

Но в случае win-1251 мы получим ошибку, поскольку json\_encode, вызывающаяся в конце для возвращения результата валидации не хочет работать с этой кодировкой. Нужно переписать метод validate:

```

protected function validate($models, $attributes=null, $loadInput=true)

{

$result=array();

if(!is_array($models))

$models=array($models);

foreach($models as $model)

{

if($loadInput && isset($_POST[get_class($model)]))

$model->attributes=$_POST[get_class($model)];

$model->validate($attributes);

foreach($model->getErrors() as $attribute=>$errors)

$result[CHtml::activeId($model,$attribute)]=$errors;

}

if (empty($result)) {

$utf_result = array();

}

foreach ($result as $key => $value) {

if (is_array($value)) {

foreach ($value as $inner_key => $inner_value) {

$utf_result[$key][$inner_key] = iconv('windows-1251', 'UTF-8', $inner_value);

}

} else {

$utf_result[$key] = iconv('windows-1251', 'UTF-8', $value);

}

}

return function_exists('json_encode') ? json_encode($utf_result) : CJSON::encode($utf_result);

}

```

Здесь скопирован метод CActiveForm::validate и в конце добавлена перекодировка $result.

Соответственно, меняем вызов

```

echo CActiveForm::validate($model);

```

на

```

echo $this->validate($model);

```

Теперь стандартная обработка ошибок будет работать корректно.

##### После успешной авторизации

Авторизация прошла успешно, теперь самое время вспомнить о js-функции afterValidate, которую мы подключали в clientOptions при создании виджета формы авторизации:

```

'clientOptions'=>array(

'validateOnSubmit'=>true,

'afterValidate' => 'js:afterValidate',

```

afterValidate — функция, которая будет вызвана после выполнения ajax-проверки.

Входящие параметры — (data, hasError), form — JQuery представление объекта формы, data — json-ответ от сервера, HasError — булевское значение, указывающее, были ли ошибки при валидации.

Имейте ввиду, afterValidate доступно только если validateOnSubmit установлена в истину.

В этой функции вы можете сделать все, что вам нужно после того, как юзер успешно авторизовался.

Например, у меня она выглядит примерно так:

```

function afterValidate(form, data, hasError) {

if (hasError == false) {

window.location.reload();

parent.$.fancybox.close();

}

}

```

##### Источники

Все решения взяты с [yii-форума](http://www.yiiframework.ru/forum/) и [stackoverflow.com](http://stackoverflow.com) и просто просуммированы в статье.

##### Вместо заключения

Желаю вам и себе работать только с проектами в utf-8 и радоваться жизни. | https://habr.com/ru/post/218639/ | null | ru | null |

# Исполнит ли React Native мечту программиста: единый код для web, android и ios?

Писать код – сложно. Писать код для нескольких платформ – еще сложнее. Программисты это знают, и последние двадцать лет идеи «универсального всемогутора» будоражат умы и воплощаются в разные технологии. Начиная от Java и заканчивая phonegap разработчики очень хотели, чтобы один раз написал и везде работало. Но не складывалось.

А потом facebook сделал ReactJS. Чтобы чат себе починить. И сложилось. Идея сборки интерфейса из javascript “кубиков” оказалась настолько хороша, что facebook портировал фреймворк на мобильные платформы, сделав сначала React Native для iOS, а через полгода и для Android. Сможет ли технология, пришедшая из веба, сделать то, что не получилось у таких монстров, как Java и .NET?

### **Давняя мечта: write once, run anywhere**

Кроссплатформенная разработка стала популярна совсем недавно. Еще пятнадцать лет назад слово «программа» было синонимом «программа под windows». Подавляющее большинство компьютеров работали на windows. В параллельном мире энтерпрайз решений жили HP-UX (более известное как «чпукс»), серверный линукс и джава. В другом параллельном мире – макось с фотошопом и иллюстратором. Миры не пересекались, программы создавались под конкретные платформы и кроссплатформенные решения были скорее курьезом, чем необходимостью.

А потом случилось несколько вещей. «Выстрелили» мобильные платформы, выросла популярность маков, кардинально упростилась покупка и аренда софта. Программы начали использовать все, а не только «компьютерщики». И неожиданно оказалось, что давний слоган Java “write once, run anywhere” стал очень актуален. Огромному количеству компаний, начиная от банков и заканчивая старбаксом, понадобились приложения. Желательно – сразу для всех актуальных платформ. Крайне желательно подешевле. И совсем хорошо, если прямо сейчас.

### **Мечте мешают design guides и скорость выполнения**

Разработчики было стряхнули пыль с проверенных инструментов, но оказалось, что не все так просто. Подавляющее большинство технологий кроссплатформенной разработки, доступные на мобильных платформах, сами рисуют пользовательский интерфейс. Отчего он, во-первых, выглядит чужеродно. А, во-вторых, тормозит. Добавим к этому «протекающие абстракции»: любое сложное приложение рано или поздно выходит за рамки кроссплатформенного фреймворка и приходилось расширять его «родным» кодом, что часто приводит к проблемам взаимодействия между расширением и самим фреймворком.

Фреймворки и библиотеки, призванные решать эту проблему, начали плодиться как грибы после денежного дождя: Appcelerator, Phonegap, Xamarin, FireMonkey, NativeScript. Но особую популярность никто не завоевал, а в интернете стали появляться статьи вида «Как мы начали делать банк-клиент на *название фреймворка* и через год выкинули его, перейдя на натив».

### **React приносит адаптивный дизайн из веба в мобайл**

И тут, в середине 2015 года, Facebook представляет React Native. На первый взгляд, ничего нового. JavaScript, из которого можно создавать «родные» элементы пользовательского интерфейса как на iOS, так и на Android. У Appcelerator такое уже было много лет.

Дьявол скрывался в деталях. Сборка интерфейса «из кубиков» и заимствованный из веба «адаптивный» подход к дизайну позволили сделать интересную штуку. Используя React, интерфейс верстается семантически, как в вебе. Вместо того, чтобы оперировать элементами интерфейса ios или android, дизайнер создает интерфейс из логических компонент: «экран», «заголовок», «список», «кнопка». А уже сверстанный интерфейс доводится напильником до конкретных платформ: несколько строчек кода превращают компонент «прогресс» в набор HTML тегов для веба, **ProgressBarAndroid** для android и **ProgressViewIOS** для ios.

Такой подход очень удобен: вначале интерфейс быстро верстается из универсальных блоков, а затем дорабатывается под каждую платформу только там, где это действительно надо. Это удивительно напоминает адаптивную верстку, когда вначале верстается универсальный «резиновый» интерфейс, а затем с помощью **@media** дорабатывается под экран телефона, экран планшета и большой экран.

### **Прототип приложения теперь можно сделать за пару дней**

В качестве примера посмотрим на тестовое приложение для нашего React Native SDK. С помощью SDK можно совершать и принимать обычные или видео звонки, включая бесплатные peer to peer. А приложение показывает, как им пользоваться: окно логина, окно ввода номера или имени, россыпь кнопочек вида «позвонить», «включить видео», «отключить микрофон» и тому подобных. Если посмотреть [на исходник](https://github.com/voximplant/react-native-demo), то мы увидим один код, работающий на обоих платформах. Отличается код только там, где мы сами этого захотели. К примеру, используется нативная версия переключателя, поэтому его имплементация разделена на два файла: **ColorSwitch.ios.js** и **ColorSwitch.android.js**

Демо приложение было сделано за два дня. Сразу под ios и android. А если мы захотим сделать версию для веба, то это займет от силы еще день (да, web sdk у нас есть и да, он может звонить из браузера благодаря магии webRTC). Все что нужно будет сделать – это заменить элементы пользовательского интерфейса на div’ы и поменять несколько вызовов sdk, которые отличаются между веб и мобайл версией.

```

Peer-to-peer

{settings\_p2p = value}}/>

Video

this.videoSwitch(e)}/>

```

фрагмент кода [отсюда](https://github.com/voximplant/react-native-demo/blob/master/UserAgent.js)

### **Все ли так гладко на практике?**

С каждым месяцем [все больше](https://facebook.github.io/react-native/showcase.html) компаний используют ReactJS и React Native. Тем не менее, технология еще очень молодая (android версии всего несколько месяцев от роду), и все «детские болезни» идут в комплекте.